-

自带 Nano 改图,一键总结 N 个网页!Chrome 这次更新,让所有 AI 插件都下岗了(附国内开启方法)

讲真,作为每天和浏览器打交道超过 10 小时的“重度冲浪选手”,Chrome 几乎就是我的第二个办公桌。自打 AI 爆火之后,为了提效,我这浏览器右上角就没清净过。我装了五花八门的插件:有的专门用来总结长文章,有的用来跟网页对话……但懂得都懂,没有一个真的特别好使。直到昨天,Google 亲手扔下了一个“核弹级更新”,我瞬间觉得:那些折腾了半天的 AI 插件,终于可以通通删掉了!(具体的开启教学我…- 0

- 0

-

一文了解Ragflow知识库优化检索的方法

摘要:在我们使用的开源的AI Agent开发工具中,ragflow因为它的知识库相对比较专业,也受到很多开发者的喜欢,目前在github上的星级有62.2K的星。是一个非常受欢迎的开源项目。成为众多开发者和企业处理海量数据、实现高效知识检索与应用的得力助手。但是由于构建知识库的设置不当也会让检索准确性下降很多,本文基于当前的开源情况,深入探讨的优化知识库检索的几个关键参数设置的问题。提升检索召回率…- 0

- 0

-

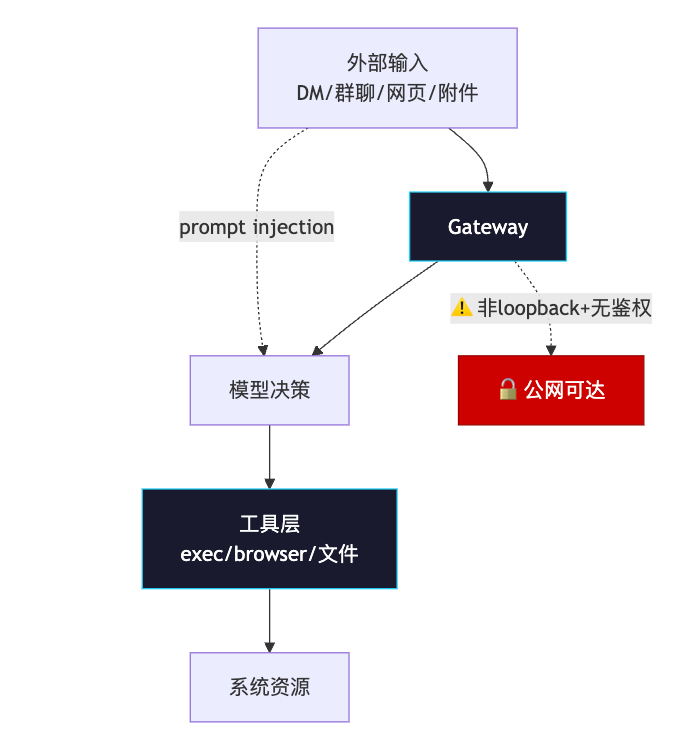

你的 Moltbot 很可能正在裸奔:安全宝典清单

写这篇的原因前两天帮朋友看他的 Moltbot 配置,打开一看,网关直接绑在 0.0.0.0,没有任何 token。我问他知不知道这意味着什么,他说"应该只有我自己能连吧"。不是的。这意味着任何人只要扫到你的 IP 和端口,就能给你的 bot 发消息,然后你的 bot 就会照做——跑命令、读文件、开浏览器,什么都行。后来我又刷到有人做公网扫描,一下子扫出 …- 0

- 0

-

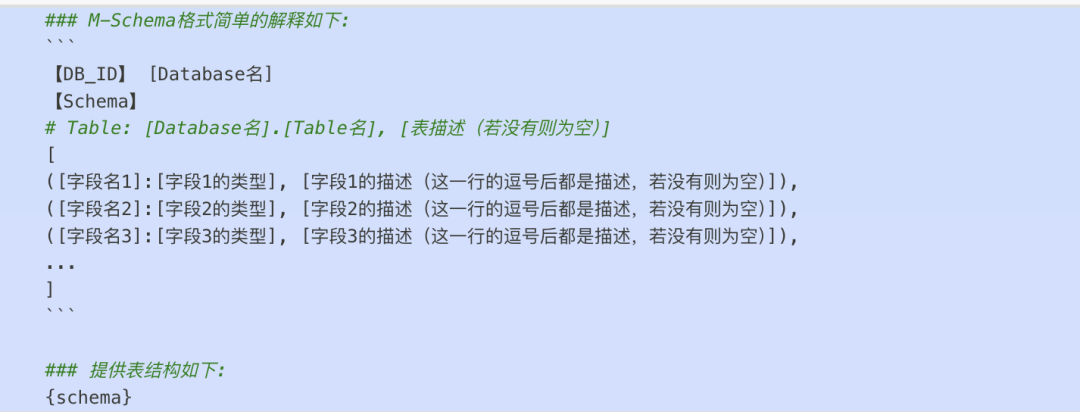

再看表格RAG 怎么做?及大模型问数开源项目SQLBot实现解析

今天是2025年8月13日,星期三,北京,晴我们继续看RAG方向,这次集中在问数这个场景。讲几个方案,一个是Demo级大模型问数开源项目SQLBot实现解析,看看实现细节。另一个是再看TableRAG的几个思路,看看真多文档中的表格,怎么做RAG,连同之前讲过的,温故而知新。多总结,多归纳,多从底层实现分析,会有收获。一、Demo级大模型问数开源项目SQLBot实现解析大模型问数开源工作,chat…- 0

- 0

-

Context Is All You Need:快手后端AI Coding的实践与思考

导读过去数月,快手内部围绕真实需求场景,探索 Java 后端 AI Coding 落地方案。经探索,快手主站团队将真实需求的 AI 代码采纳率逐步提升至60%~90%,沉淀出面向后端的 “码图” 框架,初步摸索出人与 AI 协同的 AI Native 研发范式。本文将结合真实案例,深入分析 Java 后端 AI Coding 的难点及解决方案。一、从一个真实案例说起在实际项目开发中,我们曾碰到这样…- 0

- 0

-

大模型增强检索优化之——用智能体去重构你的RAG系统

“ 不论是RAG,还是智能体都仅仅只是一门技术;而不同的业务场景需要选择合适的技术实现。”最近这段时间一直在做一个RAG检索增强的系统,但由于前期对需求了解不足,导致目前系统开发遇到一些问题,那就是目前使用纯粹的RAG技术很难解决业务需求问题。目前的需求是在一个大的业务场景下有三个子场景,但这个三个场景的入口只有一个对话框,因此需要根据用户的意图来进行识别,然后判断属于哪个子场景。因此,…- 0

- 0

-

别再神话 Claude Skills 了:这 12 个“致命”局限性你必须知道

网上有很多介绍 Claude Skills 的文章,但是很少有人提 Skills 的局限性。甚至看到有人稍微把 Skills 吹过头了!说实话,Skills 是解决大模型缺乏专业知识、解决上下文窗口等问题的一个先进解法,但目前还不完美。我认为当你无法说出一个技术的局限性的时候,也就意味着其实你对这个技术的了解并不够。这篇文章结合自己的理解,谈谈 Claude Skills 的局限性,希望对大家有启…- 0

- 0

-

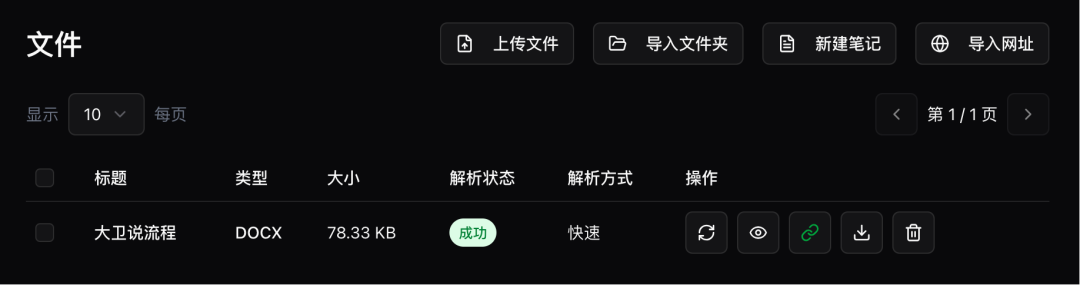

大模型RAG实战|基于ThinkDoc文档解析与融合检索能力,提升RAG效果

最近ThinkDoc智能知识库上线了。个人与开发者都可以用。对于个人,作为知识工作者或专业人士,我们可以把 ThinkDoc 作为自己的个人知识库。在上传文档资料之后,我们可以通过智能对话、检索分析和专业写作等智能体直接交互,提升个人的工作效率。对于开发者,我们可以把 ThinkDoc 作为团队或企业的知识库平台。通过 ThinkDoc 丰富的 API 接口,调用强大的文档上传…- 0

- 0

-

从 "实习生" 到 "超级专家":Claude Skills 凭什么颠覆 AI 工作流?

Skill即生产力:AI Agent时代的“超能力”正在爆发最近AI圈被一个词彻底刷屏——Skill 前言2026年,如果你还在手动填表、爬数据、写周报……那你可能已经错过了新一轮AI生产力革命。Skills正以燎原之势席卷整个AI圈。GitHub上动辄上万Star的项目、开发者社区里高频讨论的话题、甚至非技术岗位也开始尝试部署——Skills,正在成为下一代AI Agent的核心“操作系统”。 …- 0

- 0

-

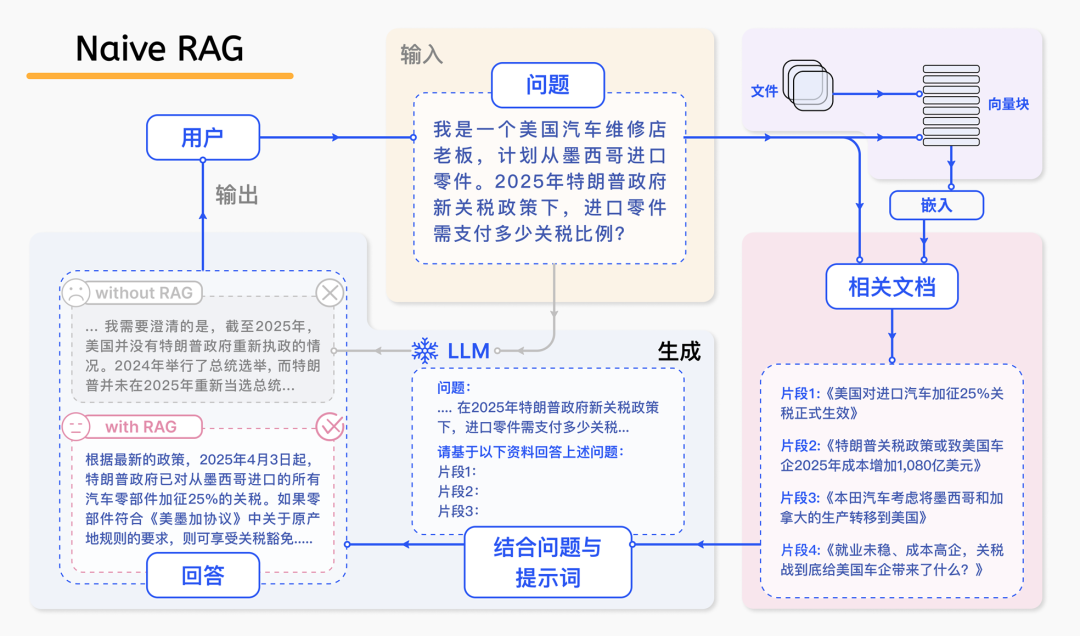

当AI学会“查资料”:RAG如何让智能回答更靠谱?

你有没有过这样的经历:问智能助手一个专业问题,它看似自信满满地给出答案,结果细究之下却发现漏洞百出?比如问“2024年诺贝尔物理学奖得主是谁”,它可能搬出2022年的名单;聊一部刚上映的电影,它却描述着十年前的老剧情。这不是AI故意“撒谎”,而是传统大语言模型存在一个致命短板——知识“过时”且“有限”。不过,如今一种叫RAG(检索增强生成)的技术正在改变这一局面。简单说,RAG让AI学会了“查资料…- 0

- 0

-

不需要Mac mini,花一杯咖啡的钱几分钟开箱即用玩转 Clawdbot

TL;DR最近Moltbot(Clawdbot)大火, 据说MAC mini都卖断货了, 我这种懒人虽然家里还有一个公司回购的Macbook, 但是真不想搞了. 下面我教大家花一杯咖啡的钱, 几分钟就给自己弄一个, 还可以在钉钉上直接召唤机器人.这次使用了阿里云的百炼和无影来快速搭建. 然后把机器人关联到了钉钉上. 总体来说配置非常简单顺手, 比起隔壁那啥改一堆配置文件简单多了.使用这…- 0

- 0

-

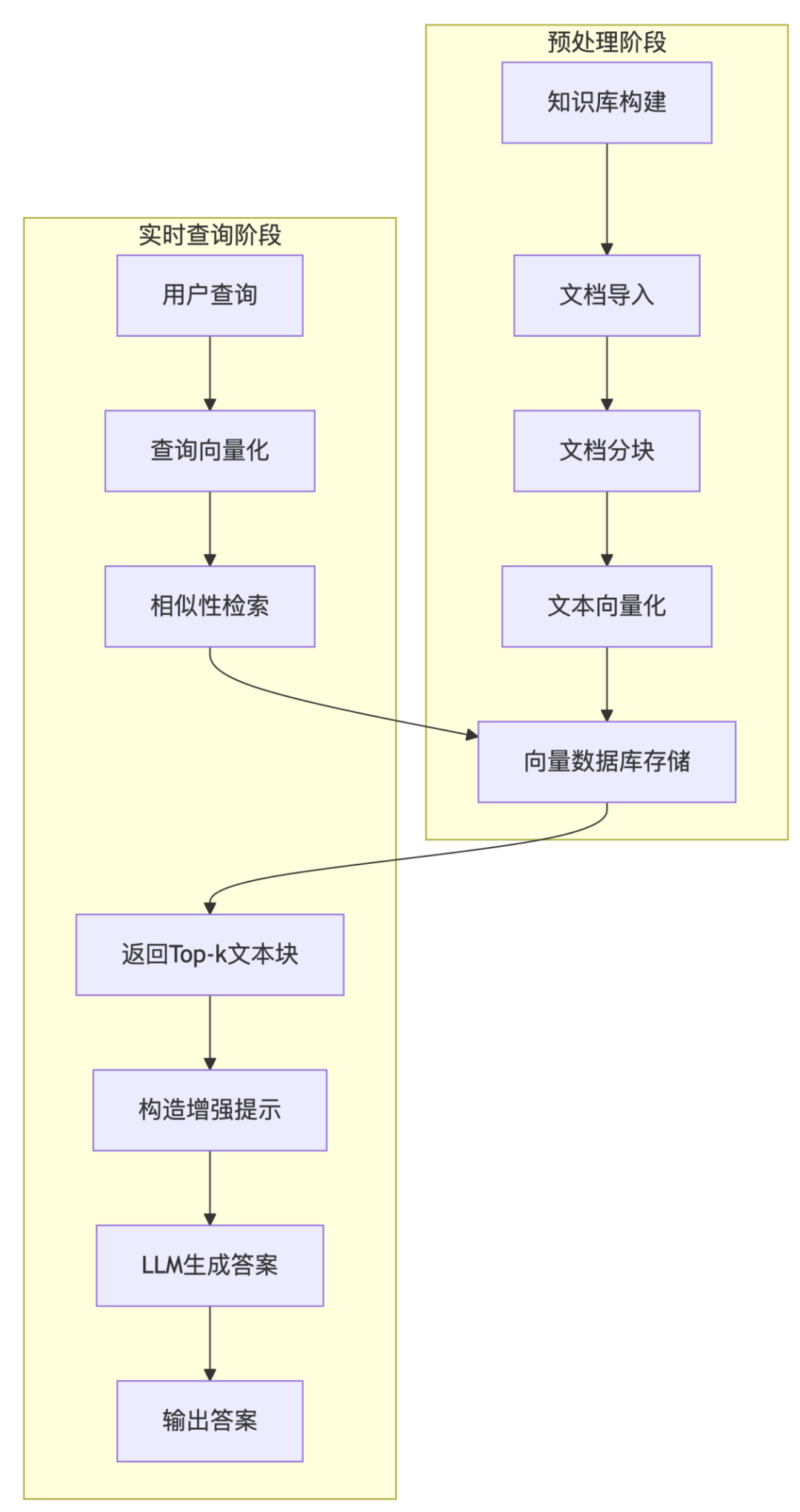

检索增强生成(RAG):让AI拥有“知识库”能力

RAG(Retrieval-Augmented Generation,检索增强生成)是一种将信息检索与大语言模型生成相结合的技术框架。其核心思想是:在生成回答或文本前,先从外部知识库中动态检索与用户查询相关的信息,再基于检索结果生成更准确、更可靠的答案。简单来说就是,RAG让大模型能像“开卷考试”一样,先查资料再答题。尽管大语言模型已展现出令人瞩目的理解和生成能力,但在实际应用中还面临着幻觉、时效…- 0

- 0

-

Google 王炸更新 Gemini 和 Chrome 合体 绞杀一切竞争对手…

很多人一直吐槽 Google,Gemini 那么强了,人家都推出了AI浏览器,为什么Chrome 却一直还是原地踏步?Google 到底在干嘛?现在它终于来了Gemini 和 Chrome 合体了...Google 刚刚发布了基于最新 Gemini 3 模型的 Chrome 重大更新,这不仅仅是一个插件或侧边栏的升级,而是对浏览器核心逻辑的重构。Chrome 正在从一个被动的“…- 0

- 0

-

从 RAG 到 KAG :结构化思考范式下的复杂推理

导语 |随着人工智能技术的迅速发展,基于大语言模型(LLMs)的应用逐渐成为主流。然而,这些大模型在实际应用中仍像在“闭卷考试”,一旦题目超纲便只能凭空编造,即便后来引入 RAG 让其“开卷”,也常因翻不到正确的页码而答非所问。尤其在垂直领域的应用中,单纯依靠大模型往往无法满足复杂业务对精准问答、实时知识更新和推理深度的需求。因此,技术正从 RAG (Retrieval Augmente…- 0

- 0

-

超越Skill?又一新技术让AI编码准确率从53%跃升至100%

Anthropic 为什么推出 Skills?它会革谁的命!当大家还沉醉在Skills的独特魅力时,由Jude Gao主导新研究再次给上下文工程带来新的发现。仅仅通过一个8KB的AgentS.md文件改动,就让AI编码智能体的表现从53%跃升至100%。问题的核心AI编码智能体面临一个尴尬的现实:它们的训练数据总是落后于框架的更新速度。Next.js 16引入的'use cache�…- 0

- 0

-

别问原理,直接喂饭:11 个生产级 Skill 仓库,拿走不谢

刚才看到群里又有人问:“大佬,SKILL.md 到底该怎么写?”我的第一反应不是想教他,而是想报警。都 2025 年底了,Agent Skills 早就不是什么“黑科技”了,而是标配!Claude 有了,ChatGPT 有了,CodeX 也标配了。一句话总结现状: 以前你不写 Skill 是因为“太超前”,现在你不写 Skill,就像拿着 iPhone 17 却只会打电话——是你落伍了,不是 AI…- 0

- 0

-

构建端到端的高级RAG AGENT

在本文中我们将介绍如何使用 LangGraph 实现复杂的 RAG 智能体。该智能体能够重写用户问题、对其进行分类、验证文档相关性,甚至在最终优雅放弃前,还能用优化后的查询进行重试。在我们深入构建高级 RAG 智能体之前,重新审视如何将 RAG 用作 LangGraph 智能体中的工具会很有帮助。介绍传统的 RAG(检索增强生成)系统适用于简单的问题,但难以处理复杂的对话场景。当用户提出…- 0

- 0

-

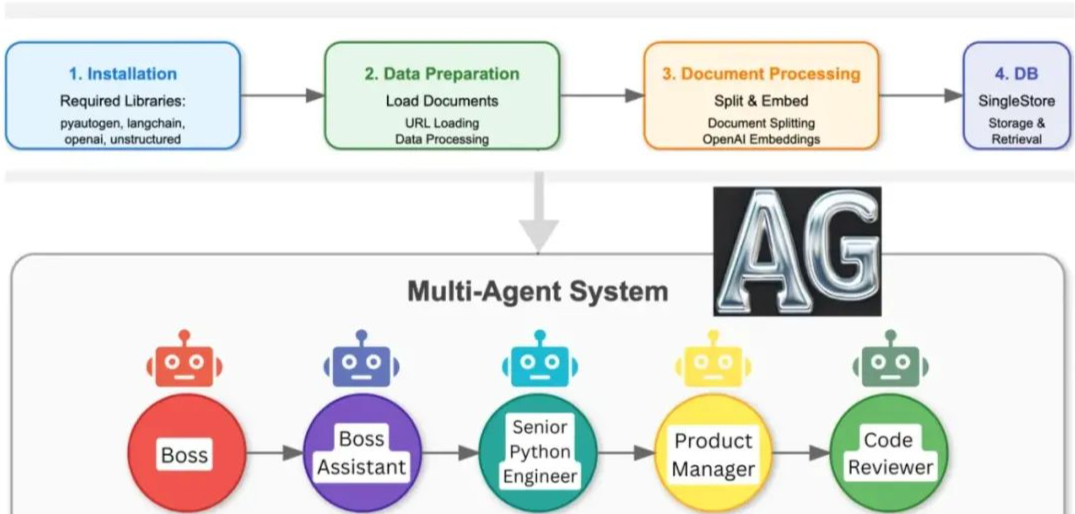

手搓系列|MAS+RAG实现博客搜索与问答

序最近正好在研究RAG,虽然RAG有很多问题被诟病,但预计未来三年仍然是构建Agent扩展知识库的关键技术,RAG的问题也会逐一被弥补或完善,就像MAS的问题目前最佳解法是构建个性化的Context engineering一样。本文记录构建Agentic RAG系统的过程,结合了LangChain (文档处理), LangGraph (Agent流程控制), Google Gemini (LLM)…- 0

- 0

-

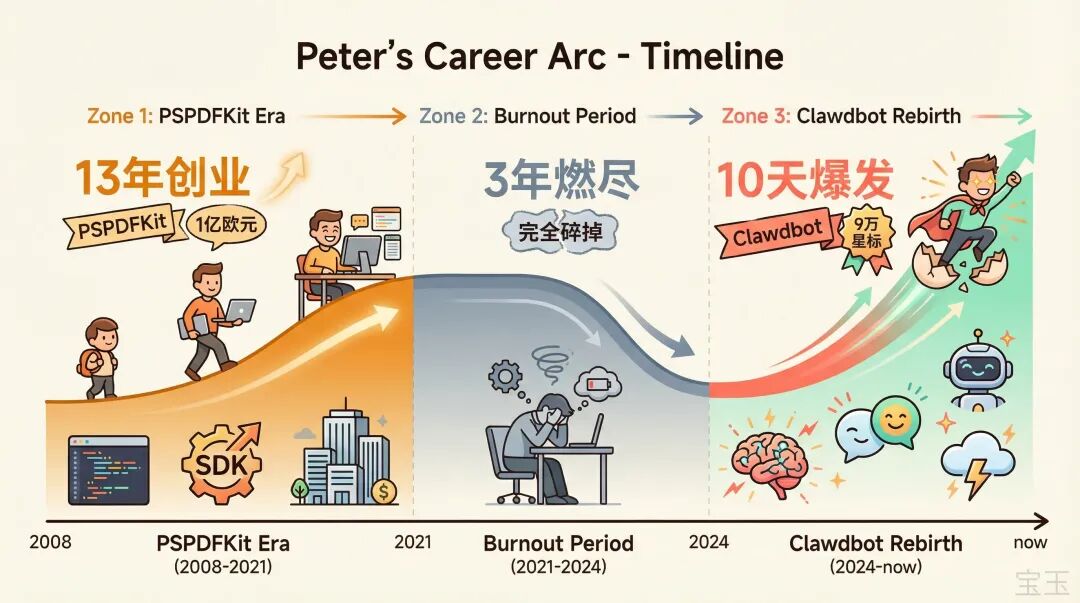

燃尽、重启、爆火:Clawdbot 创始人的 35 分钟访谈实录

Clawdbot(刚改名 Moltbot)最近大火,作者 Peter Steinberger 是奥地利开发者,也是 PSPDFKit 的创始人。公司 2021 年被 Insight Partners 以超过 1 亿欧元投资,随后他彻底燃尽(burnout),消失了三年。2025 年 11 月,他用 10 天“凭感觉搓出”(vibe-coded)了 Clawdbot。几周后,GitHub 星标数(S…- 0

- 0

-

RAG 还能不用 Embedding?OpenAI 给出了新玩法

如果你在用LLM构建应用,你很可能已经和RAG打过交道。RAG 对于用外部数据来增强LLM的能力很棒,但其中的检索——往往很复杂。我自己就曾花上好几个小时纠结:切分块的大小、重叠的策略、该用哪种向量嵌入模型。至于管理向量数据库?那更是一个完整的基础设施挑战。所以,当我在 OpenAI 的 Cookbook 中偶然看到他们关于另一种 RAG 思路的最新研究时——一种号称可以绕过传统嵌入的方案——我的…- 0

- 0

-

Agent原生架构:Claude Code 后时代该如何构建智能体应用

最近Claude Code大火,火的原因不简单是Vibe编程神器本身,更重要的是它正在重新定义智能体的开发范式,过去利用胶水代码或者拖拉拽方式构建的传统(面向过程)智能体,或将被那种只需要描述结果,交给持续循环运行达成目标的Agent原生智能体所颠覆。Claude Code配合恰到好处的的插件、Skills等机制证明了一个好的编程智能体就是一个好的通用智能体。让智能体重构代码库的架构,同样能让它整…- 0

- 0

-

Agent Skill:让AI拥有"随身携带的专业操作手册"

Agent Skill:让AI拥有"随身携带的专业操作手册"在AI时代,我们经常遇到这样的困惑:同一个AI助手,有时候能高效完成专业任务,有时候却又表现得像个新手。这背后的关键在于——AI是否掌握了特定的专业知识和操作规范。今天要介绍的Agent Skill(智能体技能),正是解决这个问题的方案。它就像是给AI配备的"随身专业操作手册",让AI在面对特定任务…- 0

- 0

-

基于 pgvector 构建企业级 RAG 系统的实战指南

1. 背景在 AI 驱动的企业知识管理与自动化运维领域,RAG(Retrieval-Augmented Generation) 模式已经成为提升大模型回答准确度和上下文理解能力的关键方案。 传统大模型(LLM)仅依赖训练语料回答问题,而 RAG 在推理前引入 外部知识检索,可显著减少幻觉(Hallucination),提升对领域专属知识的掌握能力。在向量数据库的选择上,pgve…- 0

- 0

-

使用RAG构建高质量知识库(二)- 数据分块

上一篇文章我们介绍了RAG的基本概念和原理, 感兴趣的同学也可以回去补补课。使用RAG构建高质量知识库(一)今天咱们就继续来聊聊知识库的数据清洗与分块策略。为啥要分块为了精准召回知识库的内容!事实上,如果我们不做分块,直接把整个知识库丢给大模型,让他参照执行,在知识内容较少的情况下,是完全可行的。但在真实使用场景,往往知识库都非常复杂,比如在AI医疗场景,知识库会收录上万本权威医疗指南,每个指南都…- 0

- 0

❯

购物车

优惠劵

搜索

扫码打开当前页

联系我们

返回顶部

幸运之星正在降临...

点击领取今天的签到奖励!

恭喜!您今天获得了{{mission.data.mission.credit}}积分

我的优惠劵

-

¥优惠劵使用时效:无法使用使用时效:

之前

使用时效:永久有效优惠劵ID:×

没有优惠劵可用!