AI资讯

-

我制作了 Feishu2MD 的桌面应用,帮助你快速批量导出飞书文档

飞书文档➡️Markdown 太长不看版: 可以直接在这里下载。遇到不安全警告是因为我没有签名,可以在系统设置「隐私与安全性」中主动放行。🔗 https://github.com/bakabakamio/Feishu2MD-Exporter/releases 在这里阅读项目说明,遇到问题可以在 Issues 里面反馈或者直接在文章中留言:🔗 https://github.com/bakabakam…... -

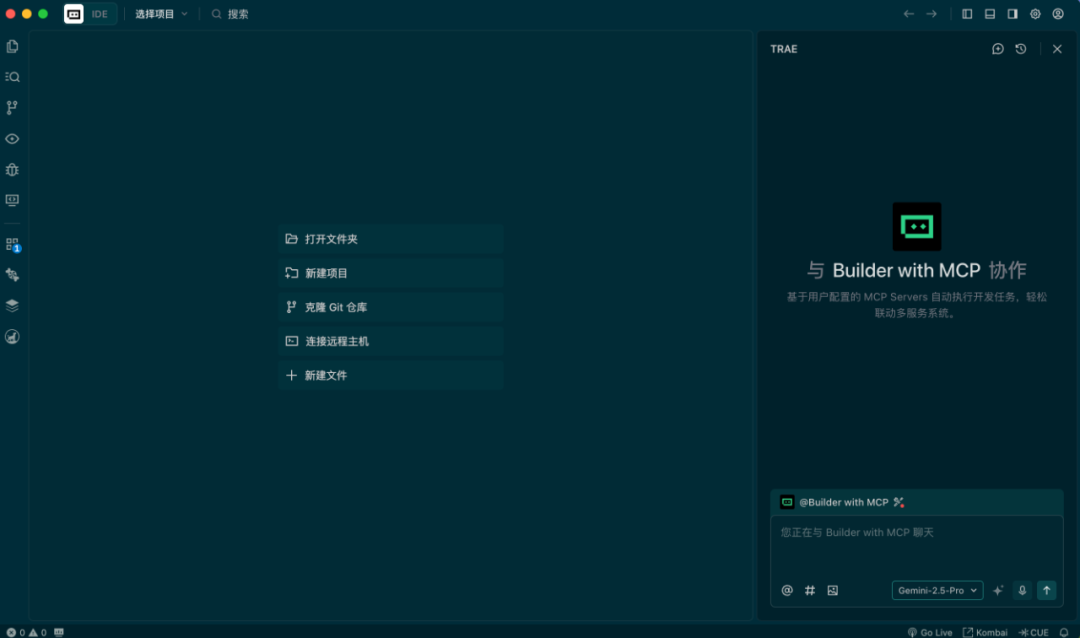

TRAE SOLO 3.0:从氛围编程到精准编程的演进与实战策略🧣

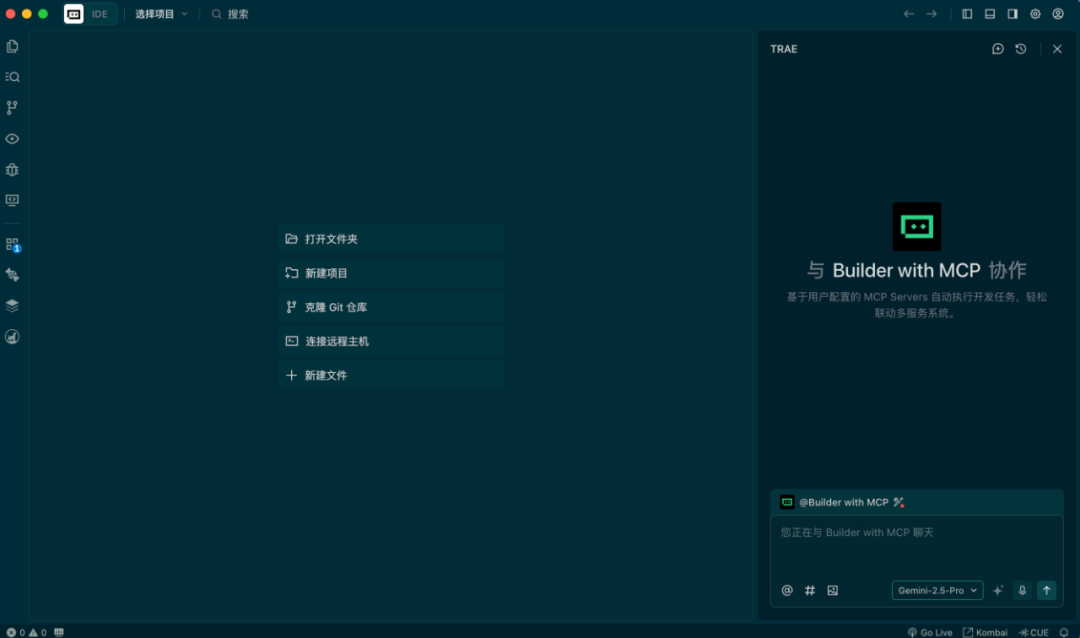

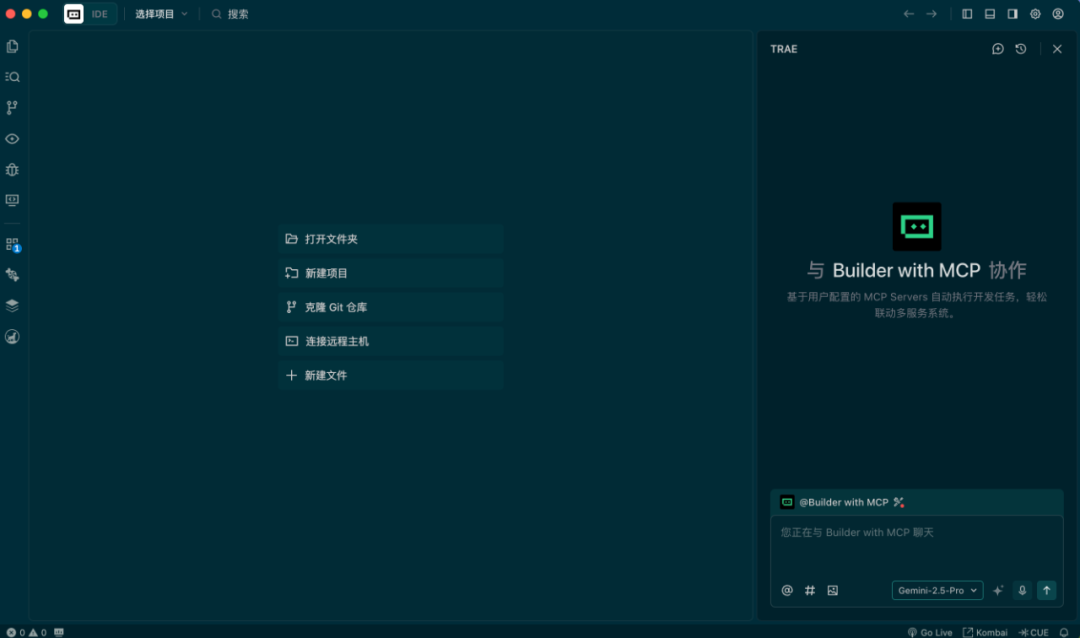

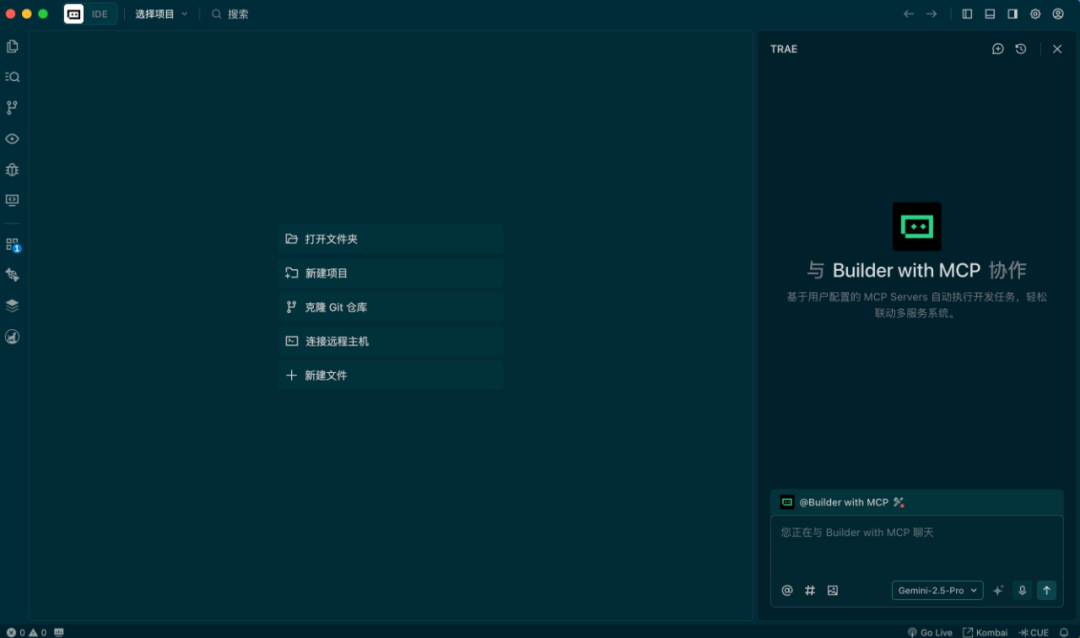

TRAE SOLO 的版本迭代与架构升级TRAE SOLO 工具历经了多次迭代,旨在实现更精细化的控制和更高效的编程效果。版本历程:从 2025 年 3 月的 1.0 版本,到 8 月的 2.0 版本,最终演进至 11 月的 3.0 版本。界面变化:界面从最初的一个界面增加到 2.0 阶段的两个界面,再到 3.0 版本采用的三栏设计。左侧栏:任务栏,用于管理任务。中间栏:对话栏,用于核心交互和任务…... -

TRAE SOLO 3.0:从氛围编程到精准编程的演进与实战策略🧣

TRAE SOLO 的版本迭代与架构升级TRAE SOLO 工具历经了多次迭代,旨在实现更精细化的控制和更高效的编程效果。版本历程:从 2025 年 3 月的 1.0 版本,到 8 月的 2.0 版本,最终演进至 11 月的 3.0 版本。界面变化:界面从最初的一个界面增加到 2.0 阶段的两个界面,再到 3.0 版本采用的三栏设计。左侧栏:任务栏,用于管理任务。中间栏:对话栏,用于核心交互和任务…... -

神器🫰在Office里免费整合任意一家AI大模型!

昨天一个朋友说他在Word里面,用了一个插件,可以在右侧和AI对话,然后把AI生成的内容载入到左边的文档中。我当时心理的想法:我这是穿越了吗?这不是我去年2月就实现,然后又扔掉的功能吗?是的,去年不坑盒子就实现了这样的功能,虽然能够把右侧AI生成的内容一键载入到左边的正文之中,但如果想把正文之中的内容提交给AI就得复制粘贴过去。于是,我就给大家实现了在Word里面点哪儿写哪儿,拖哪儿写哪儿。AI直…... -

TRAE SOLO 3.0:从氛围编程到精准编程的演进与实战策略🧣

TRAE SOLO 的版本迭代与架构升级TRAE SOLO 工具历经了多次迭代,旨在实现更精细化的控制和更高效的编程效果。版本历程:从 2025 年 3 月的 1.0 版本,到 8 月的 2.0 版本,最终演进至 11 月的 3.0 版本。界面变化:界面从最初的一个界面增加到 2.0 阶段的两个界面,再到 3.0 版本采用的三栏设计。左侧栏:任务栏,用于管理任务。中间栏:对话栏,用于核心交互和任务…... -

神器🫰在Office里免费整合任意一家AI大模型!

昨天一个朋友说他在Word里面,用了一个插件,可以在右侧和AI对话,然后把AI生成的内容载入到左边的文档中。我当时心理的想法:我这是穿越了吗?这不是我去年2月就实现,然后又扔掉的功能吗?是的,去年不坑盒子就实现了这样的功能,虽然能够把右侧AI生成的内容一键载入到左边的正文之中,但如果想把正文之中的内容提交给AI就得复制粘贴过去。于是,我就给大家实现了在Word里面点哪儿写哪儿,拖哪儿写哪儿。AI直…... -

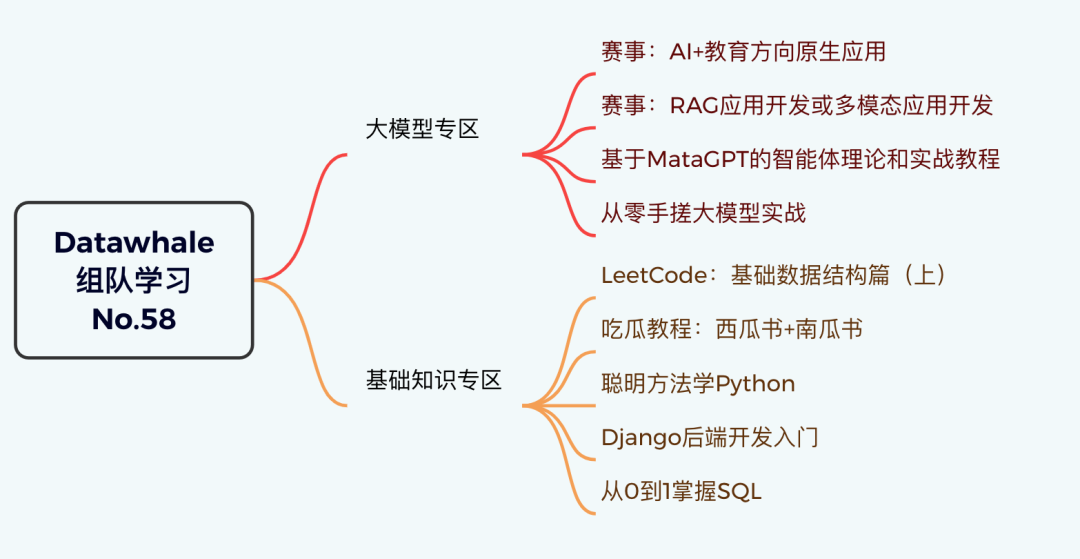

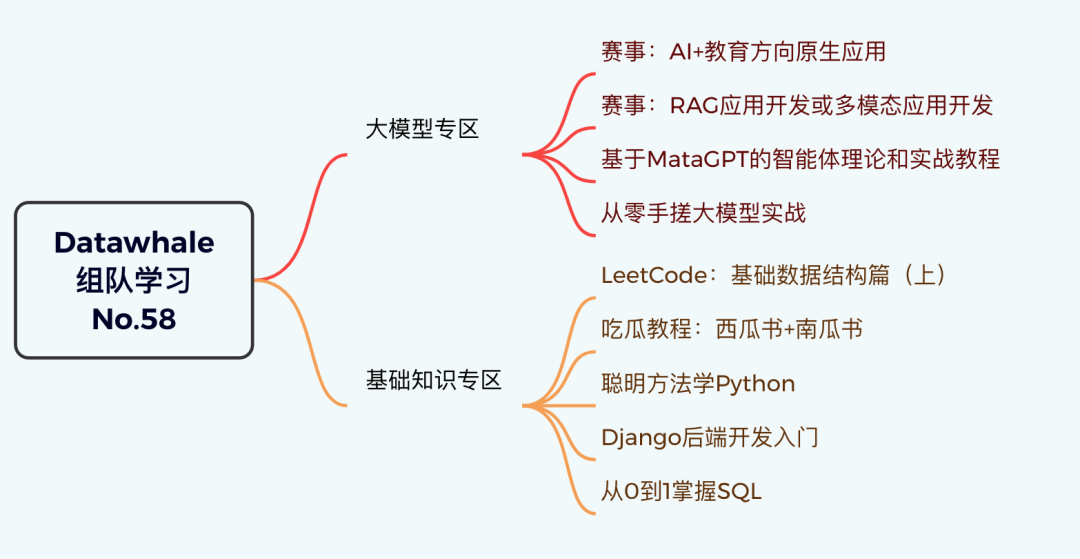

AI+X 大模型专区学习(史上最丰富🥳)

Datawhale学习 项目来源:Datawhale团队、百度智能云、飞桨AI+X系列:和学习生态伙伴联合发起,将人工智能(AI)与各个学科、领域、行业(X)结合, 激发无限潜力和创造力(X),让学习者拥有更多可能性(X)。本期学习包含大模型和基础知识两大专区,共9个学习内容,详情如下(本次学习资料均已开源,详情链接可见文末):本 文 目 录1. 学习报名方式2. 组队学习模…... -

AI+X 大模型专区学习(史上最丰富🥳)

Datawhale学习 项目来源:Datawhale团队、百度智能云、飞桨AI+X系列:和学习生态伙伴联合发起,将人工智能(AI)与各个学科、领域、行业(X)结合, 激发无限潜力和创造力(X),让学习者拥有更多可能性(X)。本期学习包含大模型和基础知识两大专区,共9个学习内容,详情如下(本次学习资料均已开源,详情链接可见文末):本 文 目 录1. 学习报名方式2. 组队学习模…... -

TRAE SOLO 3.0:从氛围编程到精准编程的演进与实战策略🧣

TRAE SOLO 的版本迭代与架构升级TRAE SOLO 工具历经了多次迭代,旨在实现更精细化的控制和更高效的编程效果。版本历程:从 2025 年 3 月的 1.0 版本,到 8 月的 2.0 版本,最终演进至 11 月的 3.0 版本。界面变化:界面从最初的一个界面增加到 2.0 阶段的两个界面,再到 3.0 版本采用的三栏设计。左侧栏:任务栏,用于管理任务。中间栏:对话栏,用于核心交互和任务…... -

神器🫰在Office里免费整合任意一家AI大模型!

昨天一个朋友说他在Word里面,用了一个插件,可以在右侧和AI对话,然后把AI生成的内容载入到左边的文档中。我当时心理的想法:我这是穿越了吗?这不是我去年2月就实现,然后又扔掉的功能吗?是的,去年不坑盒子就实现了这样的功能,虽然能够把右侧AI生成的内容一键载入到左边的正文之中,但如果想把正文之中的内容提交给AI就得复制粘贴过去。于是,我就给大家实现了在Word里面点哪儿写哪儿,拖哪儿写哪儿。AI直…...