-

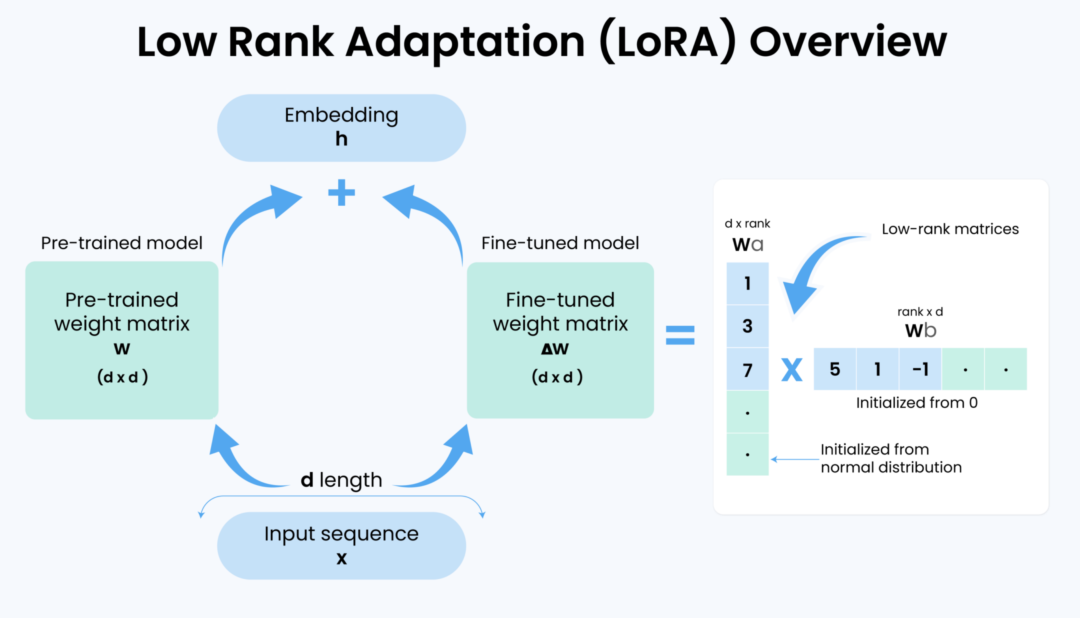

深入理解大模型微调,LoRA超参数指南

#Unsloth AI 制作了一份 #LoRA 超参数掌握指南,做到正确微调大语言模型,学会使用更少幻觉训练更智能的模型、选择最佳学习率和参数配置、避免过拟合与欠拟合等关键技术。关注公众号 #极客开源 👆 获取最新一手#AI大模型 #开源项目信息,如果这篇文章对你有用,可以点个“♥️推荐”,听说会影响公众号推荐算法。Low-Ra…- 0

- 0

-

【大模型微调】5.调参经验总结与显存占用因素探究

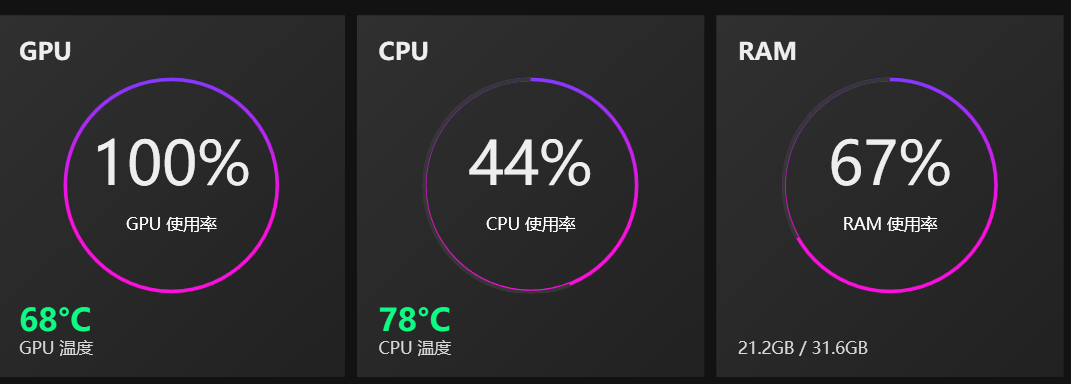

引言本文承接本系列第二篇文章,继续探究各参数应该如何进行设置,以及其对模型显存的影响。调参参考经验总结训练模型的过程通常被戏称为“炼丹”。参数组合和结果息息相关,但没有标准最优参数组合。因此,在自行钻研之前,有必要先看看别人是怎么做的。1. 北航 ACT 实验室的调参经验北航 ACT 实验室做了一份教程[1],参数经验概括如下:1.调大学习率默认的学习率是5e-5,其调大一倍,改成1e-4,调大学…- 0

- 0

-

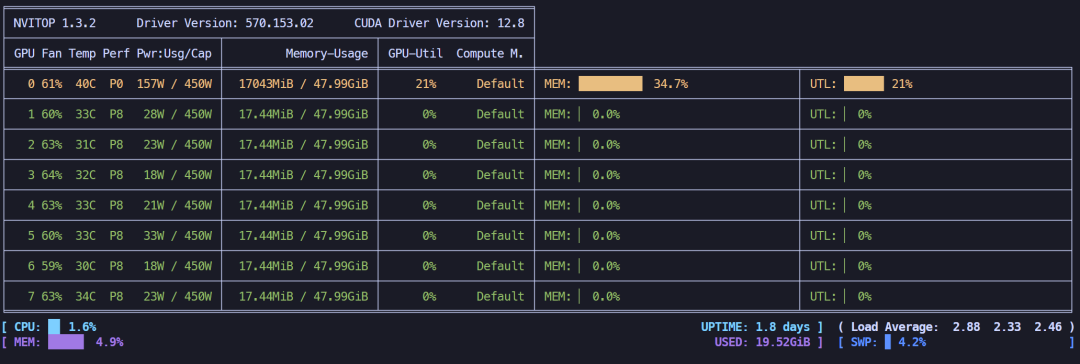

手把手教你用LLaMA-Factory微调Qwen3大模型

思路: 在AutoDL云服务器上安装LLaMA-Factory环境,然后微调Qwen3-4B大模型一、环境准备1)购买AutoDL云主机,3090显卡的即可(如果本地有GPU机器,请用自己的),我购买AutoDL时,选择了PyTorch2)安装Anaconda(AutoDL上已默认安装miniconda3)Anacoda官网:https://www.anaconda.com/根据你自己的…- 0

- 0

-

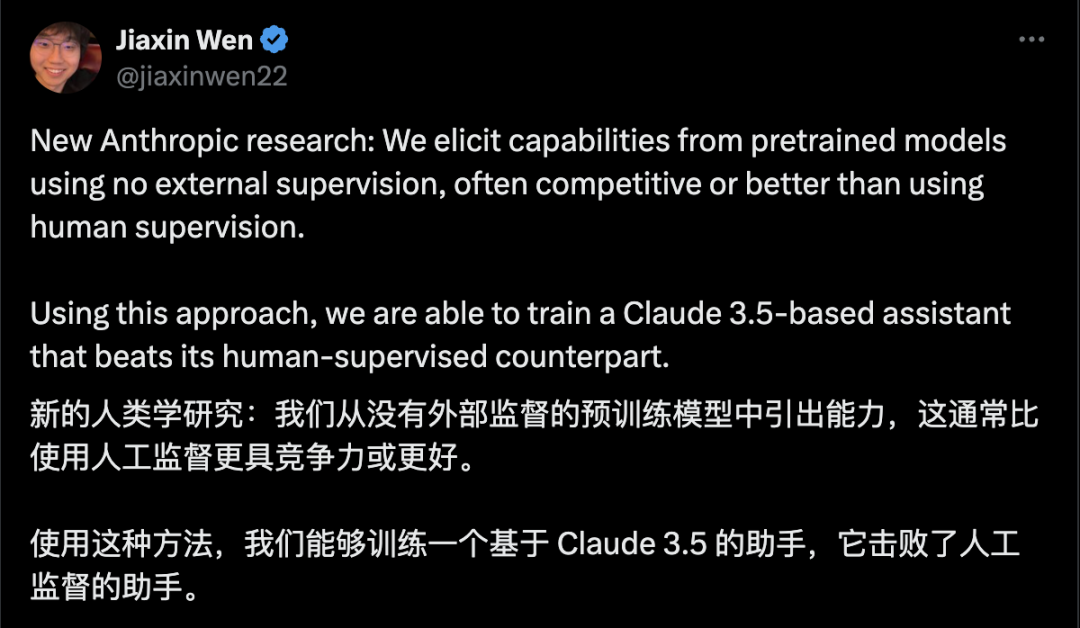

AI 彻底摆脱人类!Anthropic让模型自己微调自己,左脚踩右脚要上天……

AI 学会了自我打分和学习,然后实现自我提升!Anthropic的研究人员找到了一种让语言模型自我微调的方法——模型通过评估自己的答案来提升能力,彻底摆脱了人类标注的瓶颈。这项名为Internal Coherence Maximization(ICM)的技术让预训练模型能够生成并信任自己的标签。在数学、事实检验和对话质量等任务上,它的表现与黄金标准训练相当,甚至超越了人类标注。最令人震撼的是,用这…- 0

- 0

-

大模型微调(Fine-tuning)

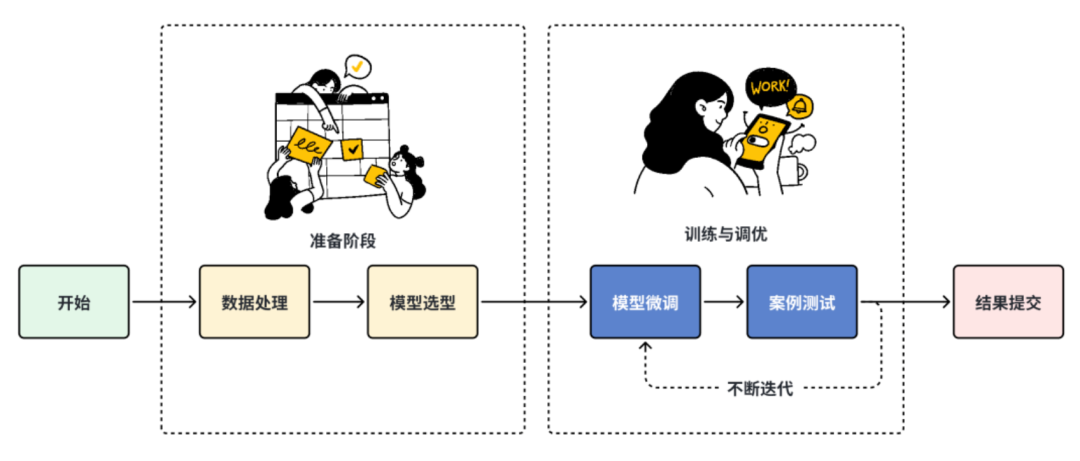

为何用公司数据做微调训练操作:基于预训练好的模型(如DeepSeek-R1),使用公司内部的办公数据(如会议纪要、邮件模板、审批流程等标注数据),对模型进行二次训练。目的:使模型适应特定任务或领域。让模型更贴合办公场景的专业术语、流程或风格(例如生成符合公司规范的报告、自动分类内部工单)。需训练资源和时间,但远低于预训练。微调流程大致包括:确定任务和目标:首先需要明确微调的任务是什么,比如文本分类…- 0

- 0

-

从0到1微调安全大模型

本文将详细介绍如何通过各种开源框架在本地完成安全大模型的微调,从底层模型层来优化模型,做出适合安全研究人员的大模型微调简介微调,指的是在一个已经经过大规模、通用数据集预训练好的基础模型上,使用相对较小规模的、特定领域或特定任务的数据集,对该模型进行进一步训练的过程。 微调 = 预训练模型 + 特定任务数据 + 进一步训练本质:是一种高效的迁移学习方法,利用预训练模型强大的通用能力,通过少…- 0

- 0

-

从一位AI大厨的角度带你全方位了解大模型微调

从 GPT3 到 ChatGPT、到DeepSeek横空出世,微调在其中扮演了重要角色。什么是微调(fine-tuning)?微调能解决什么问题?什么是 LoRA?如何进行微调?本文将围绕以一个AI厨师的例子,从微调,蒸馏,强化学习之前的关系,微调的分类,实施方案等为大家普及大模型微调的相关知识:文末有厨师照片。微调,蒸馏,强化学习随着DeepSeek等大模型的快速发展,AI训练技术正经历着从&q…- 0

- 0

-

我用unsloth将Qwen3大模型微调成了一个脑筋急转弯专家

而今天的Unsloth更适合在硬件资源有限的场景下做微调,它比LLama-Factory更节省GPU显存。一、环境准备1)购买AutoDL云主机(这里之所以选择它,是因为性价比很高,很适合新手做实验),选择3090显卡的即可(如果本地有GPU机器,请用自己的),我购买AutoDL时,选择了PyTorch2)安装Anaconda(AutoDL上已默认安装miniconda3)Anacoda官网:ht…- 0

- 0

-

单卡4090上一键GRPO微调Qwen3最新模型

模型和数据集下载因为国内的网络环境,造成我有 connection timeout 恐惧症,所以第一件事就是把该下载的下载好,不要在运行中去动态下载。本文用到的模型和数据集地址:https://modelscope.cn/models/Qwen/Qwen3-4B-Basehttps://huggingface.co/datasets/unsloth/OpenMathReasoning-miniht…- 0

- 0

-

文本生成Embedding通俗理解 & 微调模型的流程

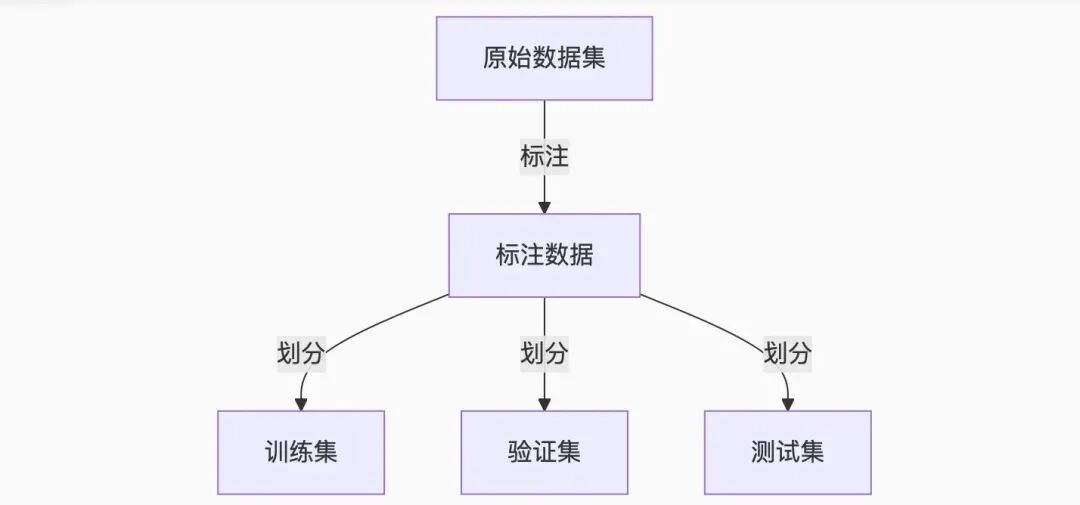

文本是怎么生成 Embedding 的?总体流程:输入文本 → 用“Embedding模型”处理 → 输出一个向量(embedding)比如你输入一句话:“人工智能改变世界”,Embedding 模型会输出一个像这样的向量:[0.432, -0.115, ..., 0.981]每个逗号分隔的部分就是一个纬度,这个向量通常是几百维,比如384维、76…- 0

- 0

-

企业内部部署ai大模型选型要点

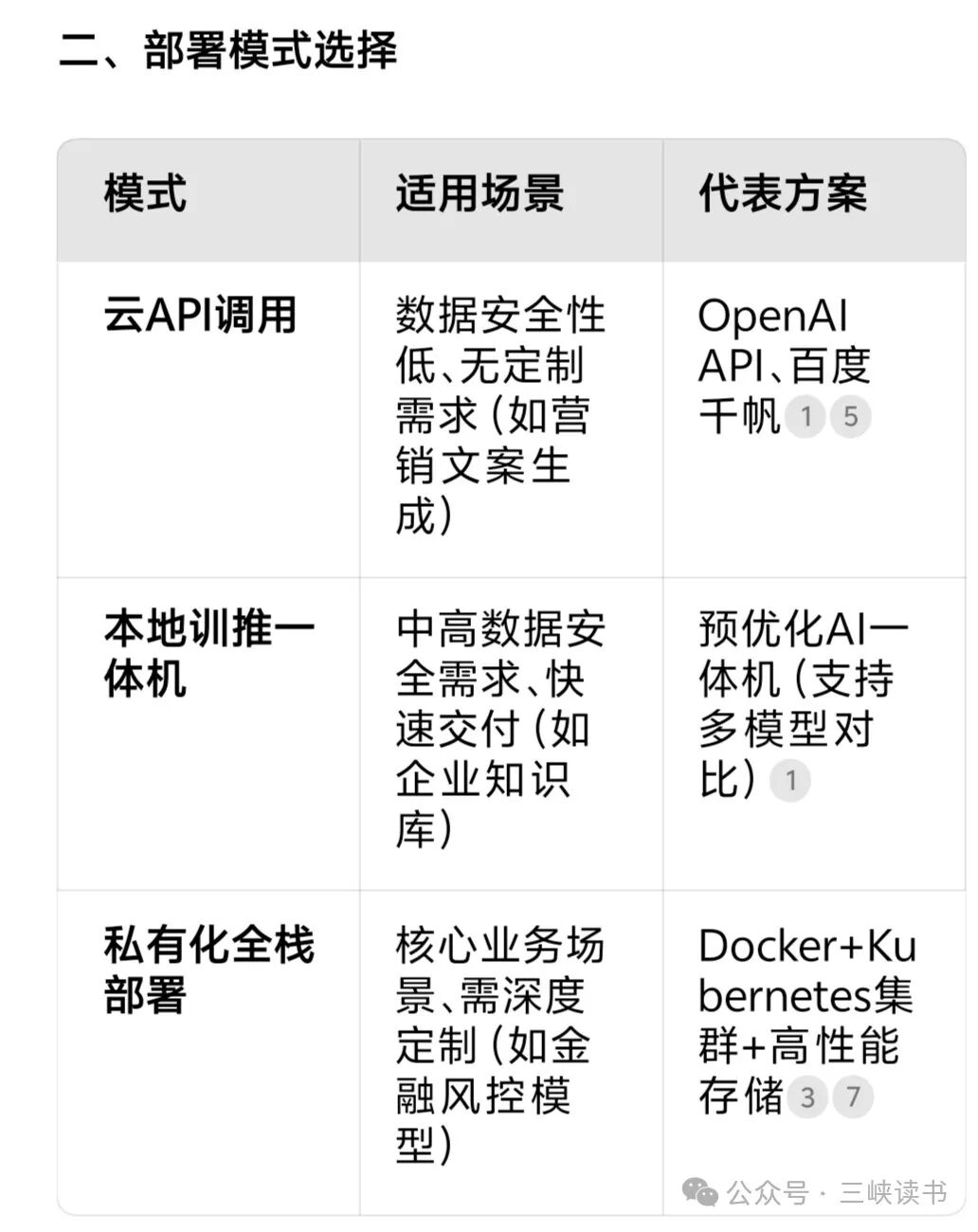

企业内部部署AI大模型的方案选型需要综合考虑业务场景、数据安全、硬件性能和运维成本等多个维度。结合等搜索结果,以下是关键选型要点及推荐方案:一、选型核心因素1. 业务需求与数据敏感性 - 通用场景(如智能客服、政策问答):优先选择成熟NLP大模型(如GPT系列、文心一言),采用基于行业案例的开源模型或云API。 - 高数据…- 0

- 0

-

Trae AI 1.4 正式上线:比cursor更划算的工具来了!

在 AI 编程工具市场竞争白热化的 2025 年,一款名为 Trae 的国产工具正在掀起技术风暴。5 月 27 日发布的 v1.4 版本,不仅解决了困扰开发者数月的排队难题,更以突破性的定价策略重新定义了行业标准。据 TECHWEEKLY 最新统计数据显示,全球 AI 编程工具市场年增长率已达 37%,但用户满意度却因高昂价格持续走低(数据来源:《2025 全球开发者工具调查报告》)。? 价格屠夫…- 0

- 0

-

大模型微调知识与实践分享

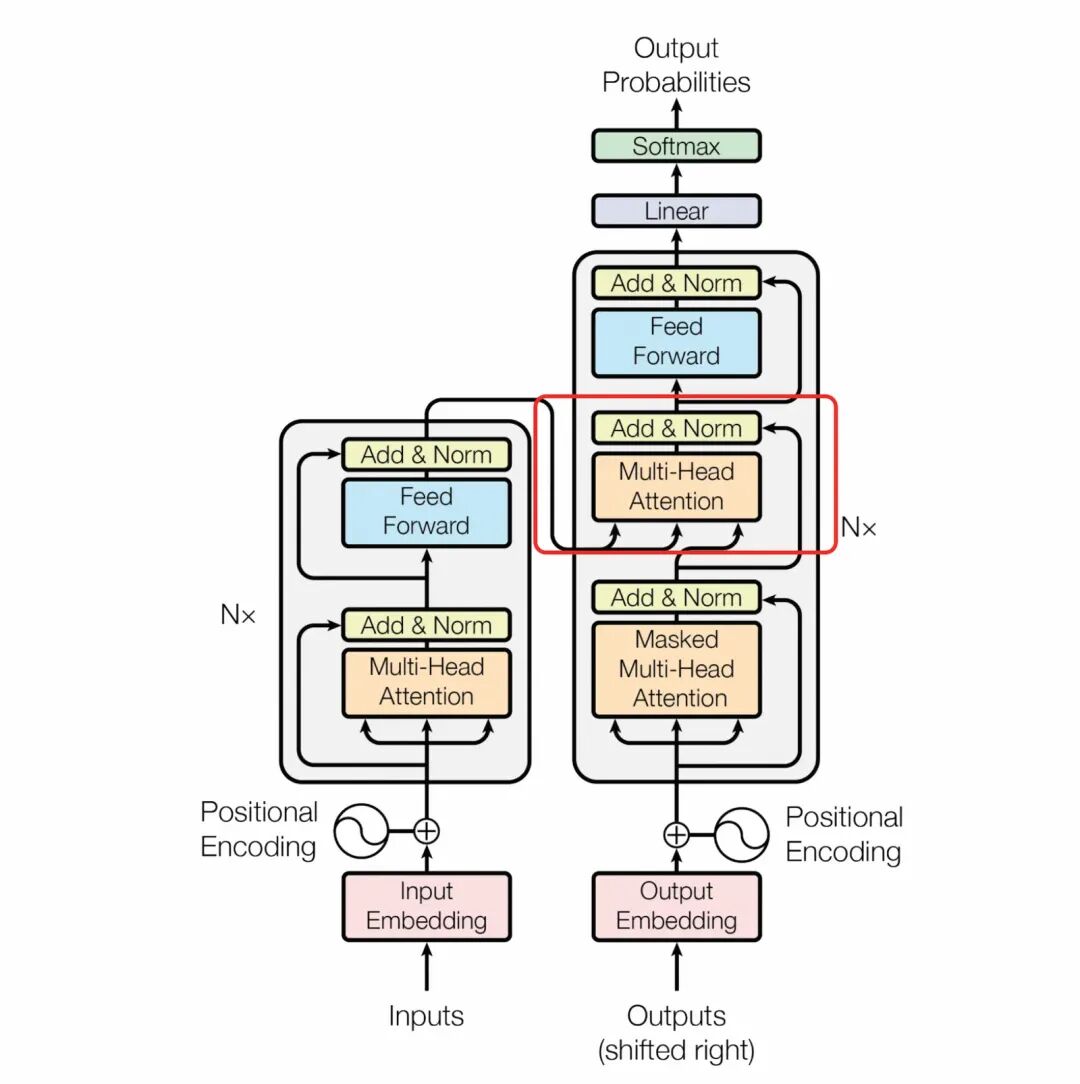

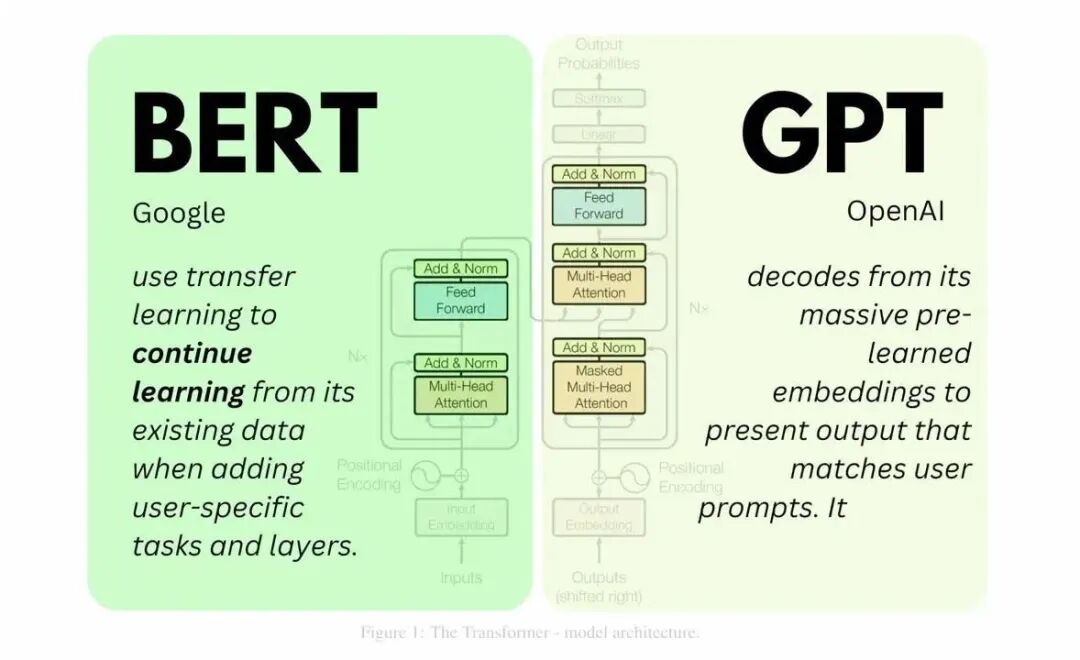

一、微调相关知识介绍1.1. 认识大模型在介绍LLM的微调知识前,我们先具象的认识下大模型长什么样子,包括模型结构、参数量、精度、显存占用。1.1.1. 模型结构《Attention Is All You Need》是一篇Google提出的将Attention思想发挥到极致的论文。这篇论文中提出一个全新的模型,叫 Transformer,抛弃了以往深度学习任务里面使用到的 CNN 和 RNN。可以…- 0

- 0

-

OpenRouter 的 3 个实用快捷方式:省钱、提速与联网搜索

OpenRouter 提供了几个很实用的快捷方式(Shortcuts),想和大家分享一下。它们可以附加在模型名称后面,实现不同的功能::nitro - 按吞吐量排序(优先选择速度最快的提供商):floor - 按最低价格排序(优先选择价格最低的提供商):online - 为模型提供 Web 搜索能力像这样:// 按吞吐量排序(优先选择速度最快的提供商){ &…- 0

- 0

-

DeepSeek V3 0526更新?实测代码能力已经提升,附实测案例。

刚刚,DeepSeek V3 0526更新了,然后又秒删。我就测试了一下,上周我测试Grok的时候,对比了DeepSeek,当时DeepSeek还不能实现的一些代码和游戏已经可以实现了。Grok 3刚刚更新功能,代码能力突破,GPT被狙击。DeepSeek应该已经更新了吧,我实测效果代码能力是提升了的。来看看案例。1,我让DeepSeek写周瑜的文章。文章比较难看出效果,来看看代码能力。2,上周D…- 0

- 0

-

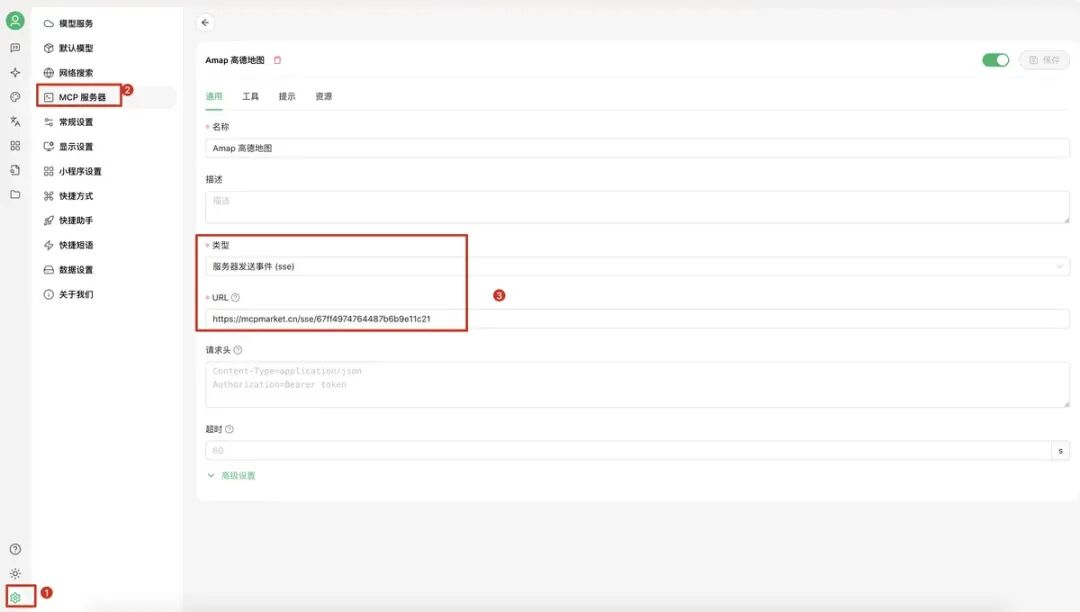

从MCP实践到开发简单的MCP服务

一 前言上次玩MCP已经过了一段时间了,尝试的都比较简单的MCP,这次想找几个实用的MCP服务器实战下,看看效果。二 实用的高德地图MCP高德地图的MCP是基于SSE的,是一种基于HTTP的技术,客户端和服务器端建立持久连接,服务器端可以实时单向向客户端推送消息,无需客户端反复请求,有点类似websocket;高德地图 MCP Server 是基于 SSE(Server-Sent Events)技…- 0

- 0

-

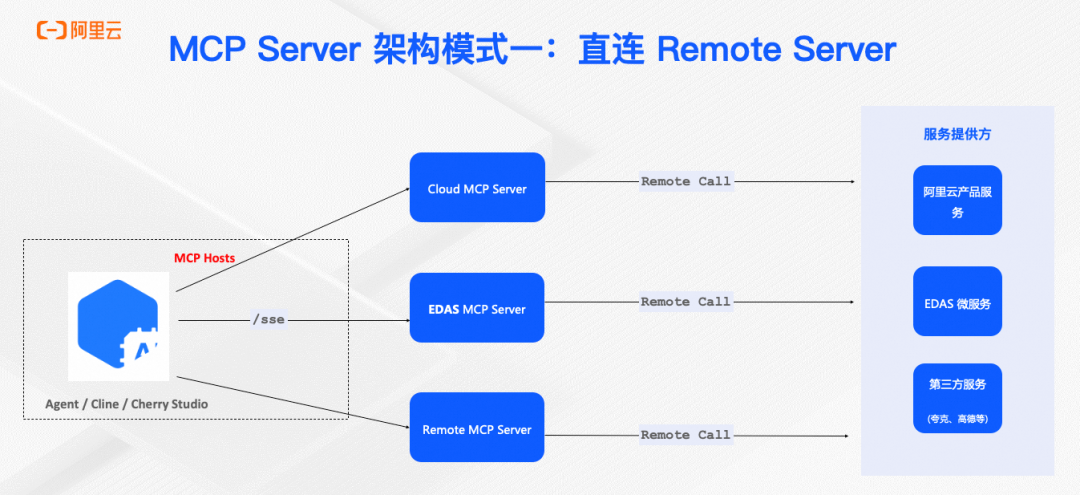

MCP Server的五种主流架构与Nacos的选择

在AI大模型应用爆发的今天,Model Context Protocol (MCP) 作为连接AI大模型与应用的关键协议,正在快速普及。然而,如何在企业级环境中高效部署和管理MCP服务,成为技术团队面临的重要挑战。本文将深入剖析MCP Server的五种主流架构模式,并结合Nacos服务治理框架,为企业级MCP部署提供实用指南。MCP架构的演进与挑战MCP协议为AI应用提供了标准化的交互方式,但在…- 0

- 0

-

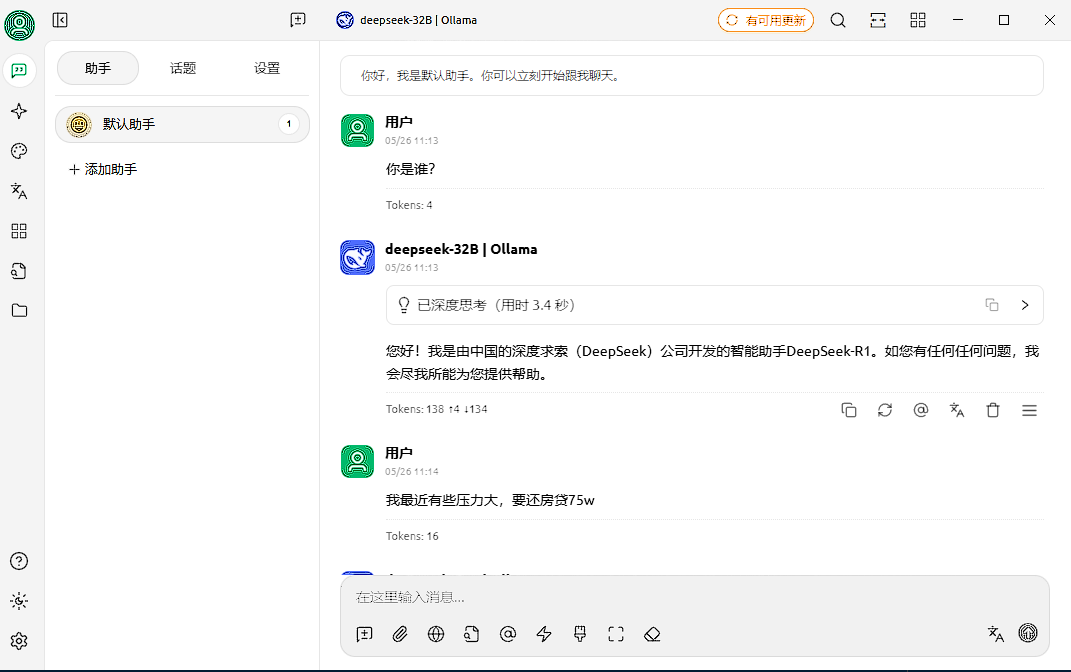

聊聊Cherry Studio如何接入vLLM部署的本地大模型

接入本地大模型,vLLM部署,Ascend 910B4服务器,以OpenAI API兼容格式对外提供服务。这其实就是一个很方便的UI客户端,LLM来源是各个线上云服务厂商或是本地部署的大模型,很方便。默认模型服务商下载好cherry studio,默认启用的模型服务是硅基流动,比较快速且方便简单。参考:使用硅基流动API + Cherry Studio解锁DeepSeek R1满血版体验全攻略[1…- 0

- 0

-

一文搞懂大模型的预训练(Pre-training)

今天来聊一聊BERT和GPT的预训练,从而了解大模型的第四步:Pre-training。预训练(Pre-training)是大语言模型(如BERT、GPT)训练的第一阶段,其核心目标是通过自监督学习从海量无标注文本中学习通用的语言表示(Language Representation)。这一阶段的目标是让模型掌握语言的语法、语义、常识等基础能力,为后续的微调(Fine-tuning)打下基础。一、B…- 0

- 0

-

颠覆认知!大模型自检自改新范式,彻底告别人工标注

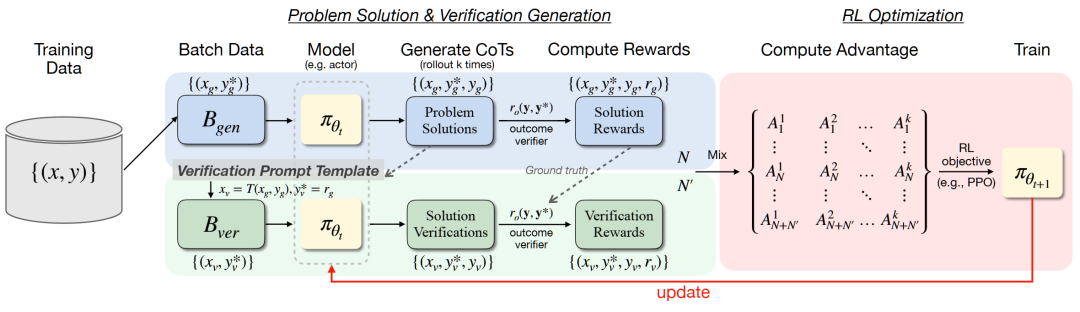

❝一句话概括,这篇论文教大模型左右互搏,自己出题自己改,改不好还要挨板子,堪称精神分裂式学习法。第一阶段:识别核心概念此阶段是介绍阶段不要引入公式和符号,使用自然语言描述1. 论文的motivation分析这篇论文讨论的是在大语言模型(LLM)做复杂推理时,如何让模型不仅能“算对答案”,还能够“自我审查”和“自我验证”。目前一种常见的强化学习方案是给模型一个“可验证的奖励”(verifiable …- 0

- 0

-

Reasoning模型蒸馏实践:用大模型提升小模型能力

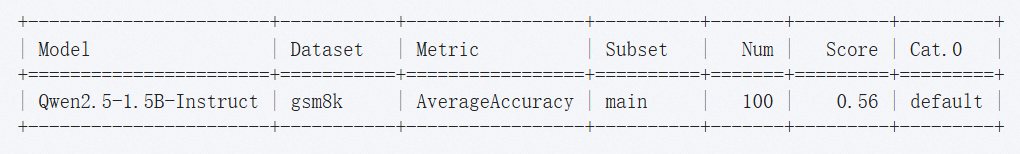

01前言DeepSeek-R1的爆火让更多开发者注意到模型蒸馏技术——这种让小模型也能"开小灶"习得大模型知识精华的秘诀。今天我们就用Qwen2.5-1.5B小模型(相当于AI界的初中生)来进行实践!? 什么是模型蒸馏?就像普通学生跟着学霸学解题思路:-教师模型 = 学霸本霸(比如DeepSeek-R1)-学生模型 = 需要进步的Qwen2.5-1.5B-蒸馏数据 = 学霸的解…- 0

- 0

-

OpenAI 重磅推出!核心API新增MCP功能,智能体开发迎来翻天覆地的变化

昨天凌晨,OpenAI以全资收购io的消息成为热点焦点。同时,OpenAI还发布了另一项重要更新——智能体开发的核心API(Responses API)现已支持MCP功能。 传统上,开发智能体时,需要通过函数调用与外部服务进行交互,每次操作都需经过大模型、后端及外部服务之间多次网络传输,这不仅增加了延迟,也令系统扩展和管理更加复杂。 而现在,借助Responses API的MCP支持,开发者无需为…- 0

- 0

-

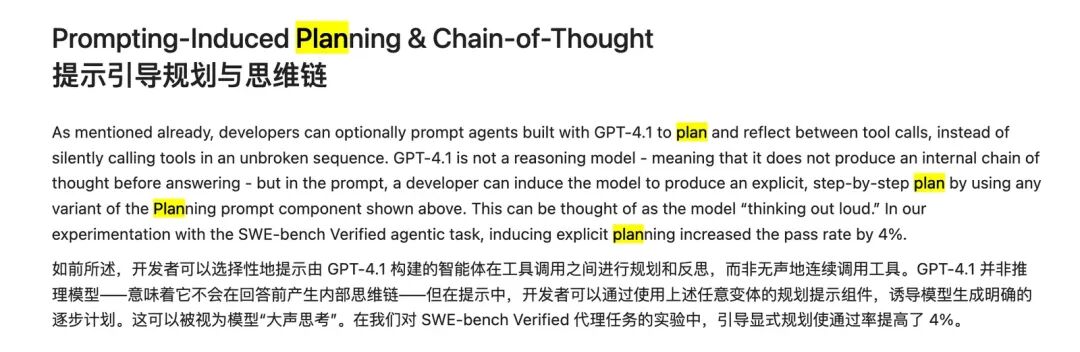

如何让 Agent 规划调用工具

为什么需要规划根据 Anthropic 和 OpenAI 的建议,对于多工具的 Agent 智能体,让模型在调用工具前规划都能有效提升效果。OpenAIOpenAI 通过引导显式规划[1]使得(SWE-bench)通过率提高了4%,OpenAI 是通过 Prompt 引导模型思考,Prompt 如下: You MUST plan extensively before each funct…- 0

- 0

-

如何为你的AI战略选择最佳云模型

AI重塑云战略!公有云拥抱AI驱动服务,加速ML和自动化;私有云强化数据安全,边缘计算保障隐私;混合云优化资源管理,IoT赋能预测性维护。自动化、AI成本管理、边缘计算和合规性成云原生关键趋势。选择最佳云模型,决胜AI时代!云计算已经重新定义了组织管理数据、推动创新和扩展运营的方式。传统上,公司会根据其特定的可扩展性、安全性和合规性需求,在公共云、私有云和混合云模型之间做出选择。然而,…- 0

- 0

❯

购物车

优惠劵

搜索

扫码打开当前页

联系我们

返回顶部

幸运之星正在降临...

点击领取今天的签到奖励!

恭喜!您今天获得了{{mission.data.mission.credit}}积分

我的优惠劵

-

¥优惠劵使用时效:无法使用使用时效:

之前

使用时效:永久有效优惠劵ID:×

没有优惠劵可用!