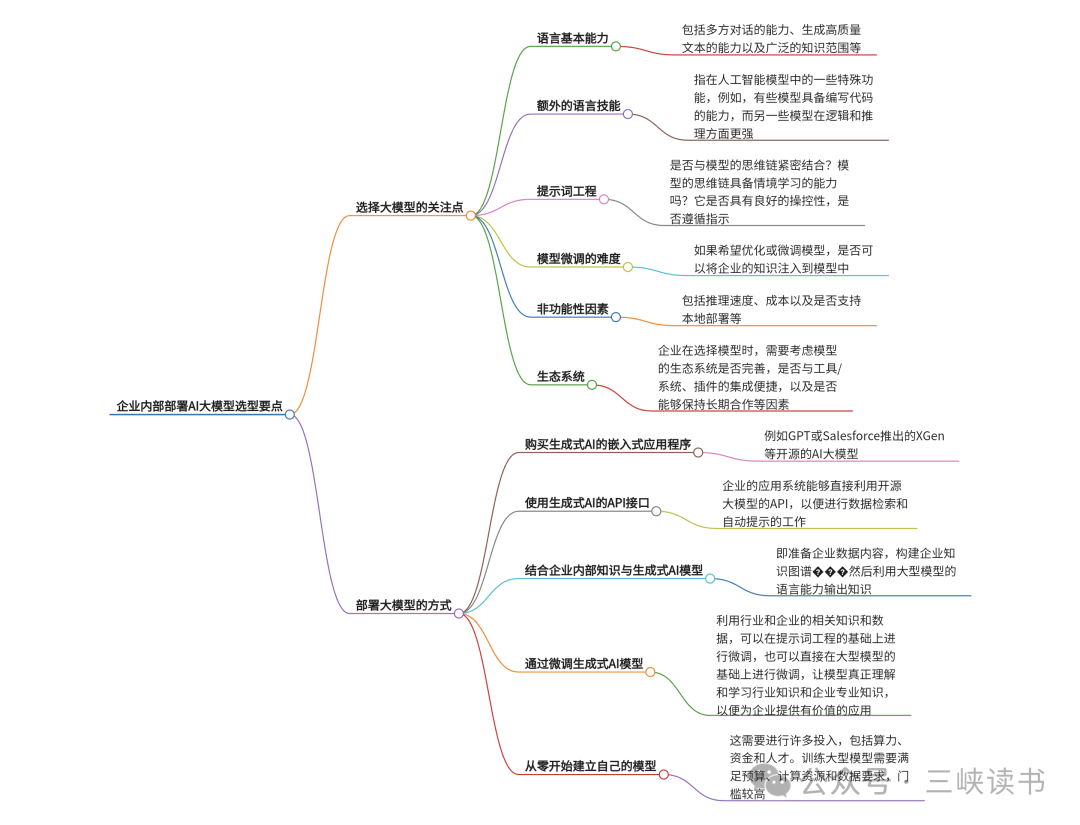

企业内部部署AI大模型的方案选型需要综合考虑业务场景、数据安全、硬件性能和运维成本等多个维度。结合等搜索结果,以下是关键选型要点及推荐方案:

一、选型核心因素

1. 业务需求与数据敏感性

– 通用场景(如智能客服、政策问答):优先选择成熟NLP大模型(如GPT系列、文心一言),采用基于行业案例的开源模型或云API。

– 高数据敏感性(如金融、医疗):必须私有化部署,结合企业数据微调行业大模型(L1/L2级),避免数据外流。

– 实时性要求:选择低延迟本地推理方案,如训推一体机。

2. 技术储备与资源投入

– 技术能力较弱的企业可选用预调优的全栈一体机,集成计算/存储/网络/管理工具,降低部署复杂度。

– 具备技术团队的企业可自主搭建基础设施,但需评估硬件采购、网络优化和运维成本。

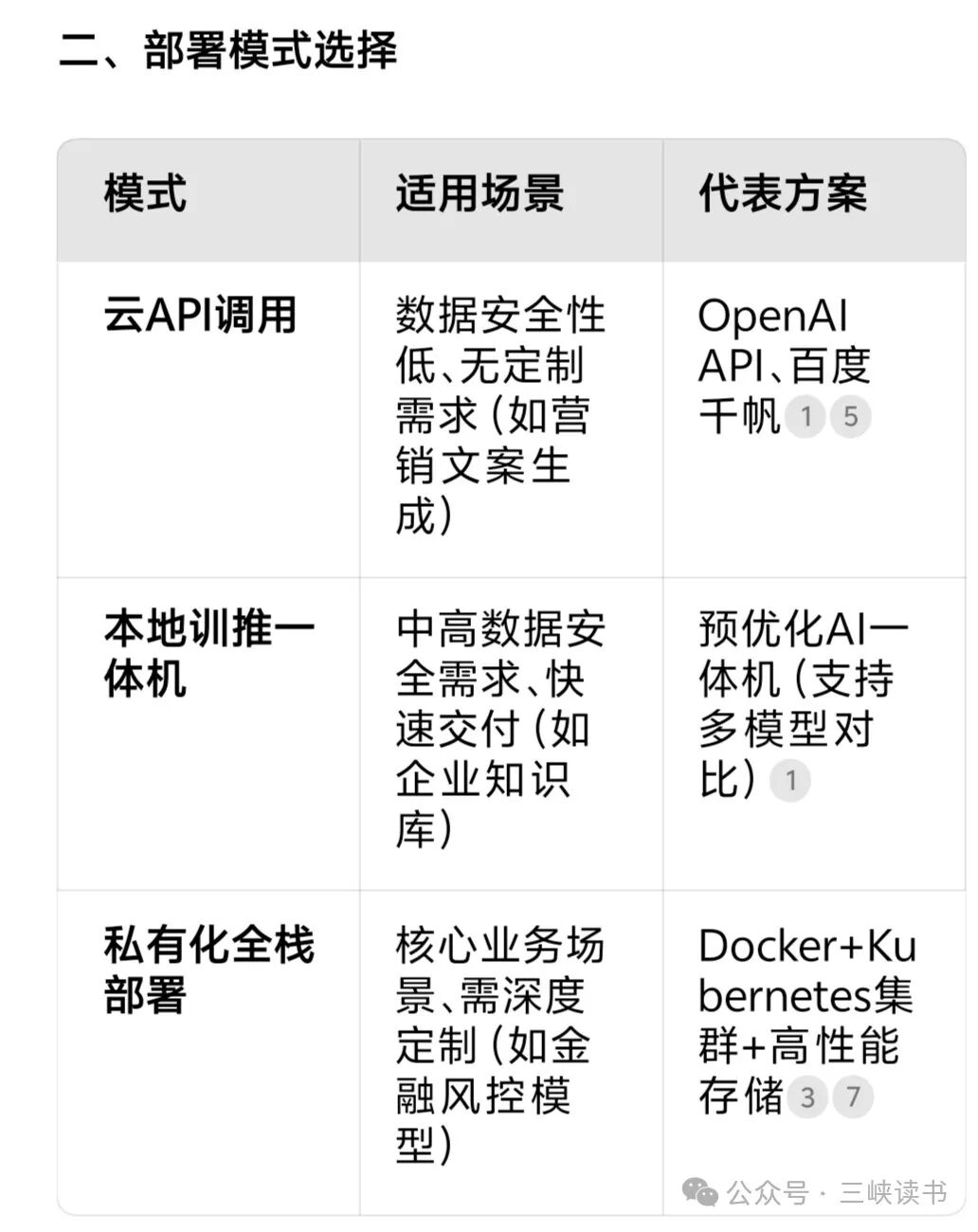

二、部署模式选择

三、基础设施要求

1. 硬件配置

– 计算:推荐NVIDIA A100/H100 GPU集群,支持200G/400G RDMA网络,满足多机多卡训练。

– 存储:需高性能共享存储(如Ceph/分布式文件系统),优化小文件IO性能,支持Checkpoint快速读写。

– 网络:低延迟InfiniBand或高速以太网,避免训练瓶颈。

2. 软件工具链

– 训练框架:PyTorch、TensorFlow,结合DeepSpeed/Megatron-LM优化分布式训练。

– 部署工具:Ollama(本地模型运行)、OpenWebUI(图形化交互)、Docker/K8s容器化。

四、模型调优与数据管理

1. 模型评估与迭代

– 使用评测工具(如SuperCLUE、Ragas)对比模型在理解准确性、结果可读性、行业适配性的表现。

– 建立反馈机制优化L1/L2模型,支持边云协同更新。

2. 数据治理

– 数据预处理:清洗、标注、增强行业数据,构建高质量训练集。

– 存储优化:训练数据与预处理平台共享存储,减少拷贝耗时。

五、安全与运维建议

1. 全链路安全设计

– 加密模型传输与存储,限制API访问权限,防止模型泄露。

– 审计数据使用日志,满足GDPR等合规要求。

2. 运维优化

– 选择支持统一监控管理的一体机方案,降低故障排查复杂度。

– 定期性能测试与硬件扩容,保障7×24小时服务稳定性。

推荐方案

– 通用型:训推一体机(如华为Atlas 800)+ 行业微调NLP模型(如ChatGLM-6B),适合中等规模企业。

– 高端定制型:本地GPU集群(8*A100)+ Kubernetes调度 + 私有化知识库,适合金融/医疗等核心场景。