-

驯服AI的艺术:参数调整完全手册

前言还记得那些老式音响的旋钮吗?轻轻一转,声音就能从轻柔变得震耳欲聋。AI模型也有类似的"旋钮",只不过它们控制的不是音量,而是AI的"个性"和"创造力"。想象一下,你有一个AI朋友。有时候,你希望它像一本百科全书那样精确;有时候,你又想让它像疯狂诗人一样天马行空。这就是我们今天要聊的内容——如何通过调整那些神秘参数,让AI按照你的意愿跳…- 0

- 0

-

Ollama部署大模型以及配置外部访问

最近在做向量化模型的技术选型,没有GPU所以打算装个ollama先试一下(vLLM要求必须是GPU才行)。ollama安装比较简单,基本属于傻瓜式安装但是我这台机器下载速度贼慢,所以考虑借助魔塔社区安装了(https://modelscope.cn/models/modelscope/ollama-linux/summary)但是这种方式对p…- 0

- 0

-

企业私有化 LLM 应用开发路径:从技术跟风到业务驱动

在元宝、豆包等公共AI平台大行其道的今天,为何许多企业仍需要通过本地开发LLM应用构建私有化AI系统?答案的核心在于:重要的不是跟风部署一个大模型,而是打造真正能落地的业务驱动型AI应用范式。一、知识库革命:从“单兵作战”到“集团军作战”公共平台的致命伤: ❌ 文档零散上传:每次只能传1份合同,500页产品手册得分拆50次上传❌ 知识更新滞后:新版本技术图纸需手动替换,极易导致…- 0

- 0

-

本地部署大语言模型指南

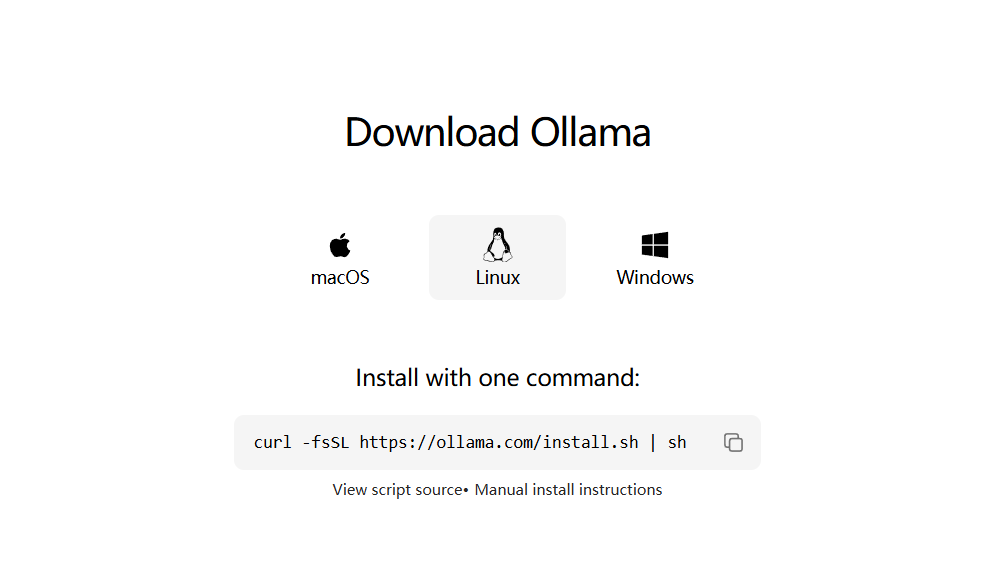

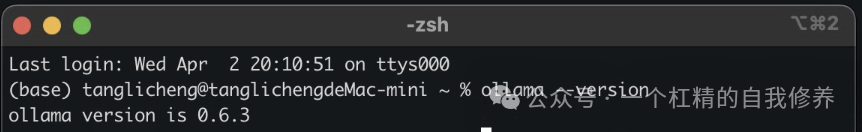

这里选用Ollama+QwQ32b作为本地大模型运行的基础,如果没有并发需求可以选用LM Studio,支持m系列芯片的MLX框架,生成token速度比Ollama快50%,但缺点是不支持并发。本文以Mac OS部署Ollama+QwQ32B为例:一、安装 Ollama1. 官网下载安装访问 Ollama 官网,下载 macOS 版本安装包。安装时需将应用拖入「应用程序」文件夹,并输入系…- 0

- 0

-

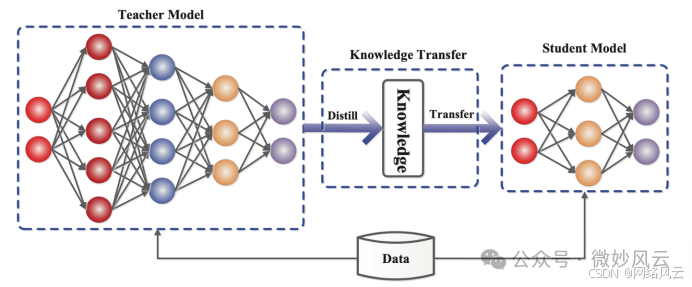

深入浅出大模型:大模型预训练、后训练、微调

今天,我们通过最为通俗易懂的比喻,来详细阐述大模型训练的三个不同阶段:❶预训练(Pre-training)、❷后训练(Post-training)以及❸微调(Fine-tuning)。先看预训练 预训练,即利用庞大的通用数据集对模型进行初步训练,使其具备基础知识和技能,例如通用的语言…- 0

- 0

-

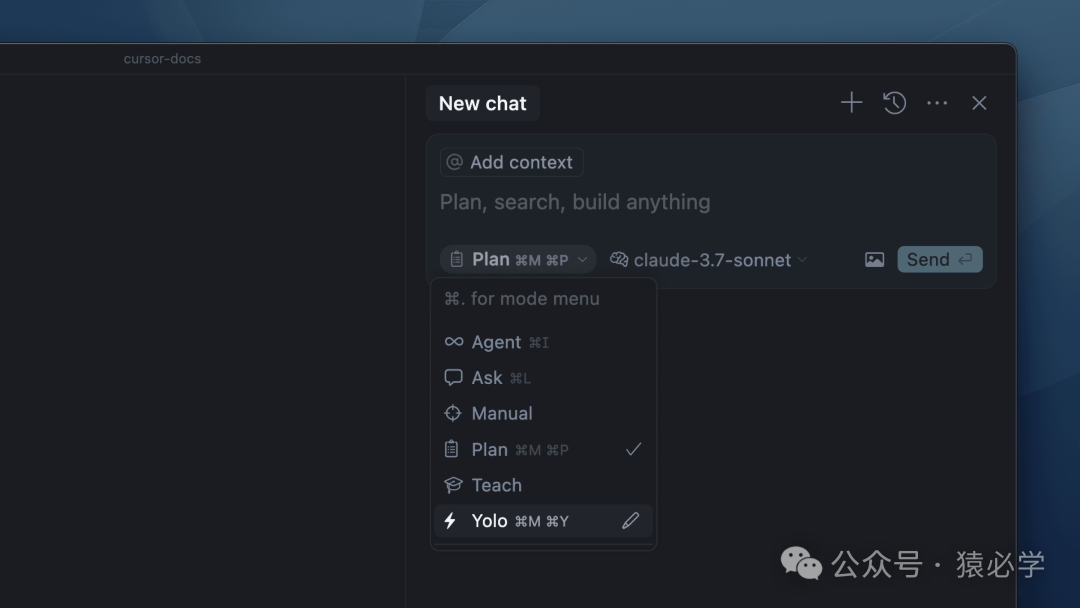

Cursor最新版本0.48太炸裂了

最重要的是Composer 的功能被集成到Agent 中,Agent模式可以自动执行。聊天选项卡,自定义模式和更快的索引此版本引入了用于并行对话的聊天选项卡、具有自定义模式的重新设计的模式系统以及对成本可见性、索引性能和 MCP 可靠性的改进。此外,聊天结束时会播放声音通知内置模式和自定义模式(beta)代理和询问模式是 Cursor 中的内置模式,现在可以选择添加自定义模式。我们还将“Edit”…- 0

- 0

-

30分钟开发完成!Trae+Claude 3.7 打造小程序全流程揭秘!

在上一篇文章里,我们用 Trae 已经完成了设计稿,本文将展示用Trae+Claude 3.7 从零开发一个倒数日小程序的完整过程。从项目最初的页面生成开始,到不断收到反馈后针对UI细节、交互逻辑、页面布局以及按钮样式等方面进行逐步调整,最终成功开发出一款符合预期的应用。设计稿正式开始之前,先回顾一下设计稿:提示词你是一位资深前端工程师,拥有丰富的前端和微信小程序开发经验,请根据我的要求开发一个倒…- 0

- 0

-

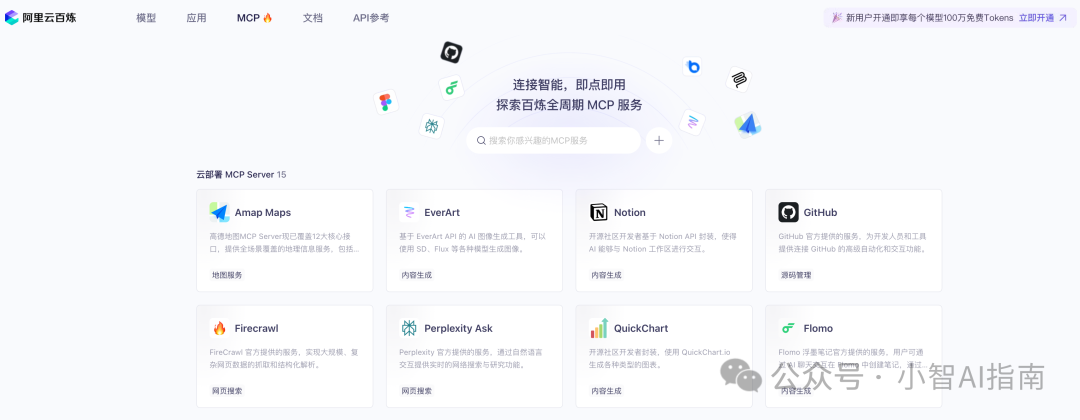

6个MCP服务平台推荐,阿里百炼提供一键部署

前言MCP 服务最近是火的一塌糊涂,它的最大价值是将模型使用工具的难度降低。早在3月份的时候小智就出过一篇文章给大家详细介绍过MCP,主要是为了普及一下MCP的基础概念以及部署步骤,没有实际应用场景。本篇文章着重给大家分享一下怎么用阿里百炼的 MCP 服务构建Agents 应用。6个MCP服务平台阿里百炼https://smithery.aihttps://mcpservers.orghttps:…- 0

- 0

-

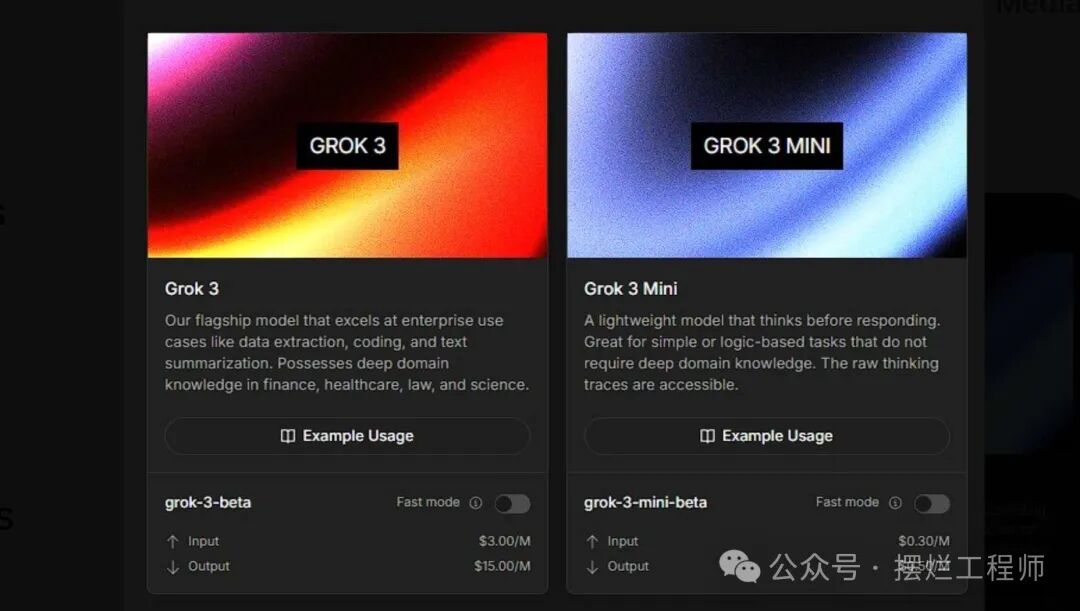

Grok3 API 已经全网上线了!附上免费使用Grok3 API的教程

Grok3 API 现在已经全网上线可以使用,只要需要绑定卡并且充值不低于5美金就可以免费使用Grok3 API。grok-3-beta和grok-3-mini-beta 现在可用,支持文本模式,上下文窗口为131072 tokens定价(每百万tokens):grok-3-beta,输入:3.00美元,输出:15.00美元grok-3-mini-beta,输入:0.30美元,输出:0.50美元另…- 0

- 0

-

「扣子罗盘」全新上线,适合百万 Agent 创业者的搞钱神器

就在刚刚,扣子宣布重大升级!此次更新主要聚焦在Agent开放平台的订阅套餐以及Agent开发调优方面,前者是为个人、团队、企业在扣子平台上提供更多的权益,后者则是提供了更多的开放能力。全新的订阅套餐机制如下:个人免费版:无需付费即可使用,适合个人用户进行简单尝鲜和基础使用。不支持增购资源,用户无需支付任何费用。个人进阶版:在个人免费版的基础上,此版本适用于个人超级开发者。提供了更多的资源和功能,包…- 0

- 0

-

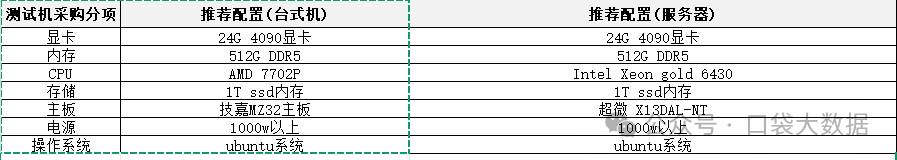

仅需10万不到,DeepSeek R1 671B大模型本地部署实战指南

最近帮一个朋友部署本地的671b版本的deepseek r1,需求是要完全本地部署,但是又不想花太高的成本,没有并发要求,我一想,用ktransformers框架来部署完全合适。关于机器配置,在挑挑拣拣评比之后,设备选择如下,最终选择的是其中的服务器配置。这套设备下来总成本不到10万,相比如动辄几百万的满血版deepseek R1或者花个五六十万买个deepseek 70b的一体机要值当的多,且不…- 0

- 0

-

从 0 开始,手把手教你开发第一个MCP服务!

最近看到很多群友的聊天:"MCP 开发太麻烦了 ??"这句话可真是说到我心坎里去了!我刚开始看的时候也是一脸懵圈,那些文件夹、代码看得我一愣一愣的。皇天不负有心人,经过一周的折腾和实验,我终于找到了一个超简单的自然语言开发方法 。? 这是一个超简单的入门教程,带你用纯自然语言开发出人生第一个MCP服务!⏱️ 预计动手时间:20分钟? 适合人群:想快速入门MCP的小伙伴对AI开发…- 0

- 0

-

端到端的训练,怎么复现 Deep ReSearch(上) :先从 Deep Search 做起

知乎:https://zhuanlan.zhihu.com/p/1892489650469323191 (已授权)大家好,我想通过这个系列的文章,与大家分享如何复现Deep Research的一些关键洞见。在上一篇关于Agent的博客-25年什么样的 Agent 会脱颖而出:简单胜于复杂中,我提到:OpenAI并不是简单地在GPT基础上套壳(套壳指的是在 GPT 模型的基础上,通过定制化…- 0

- 0

-

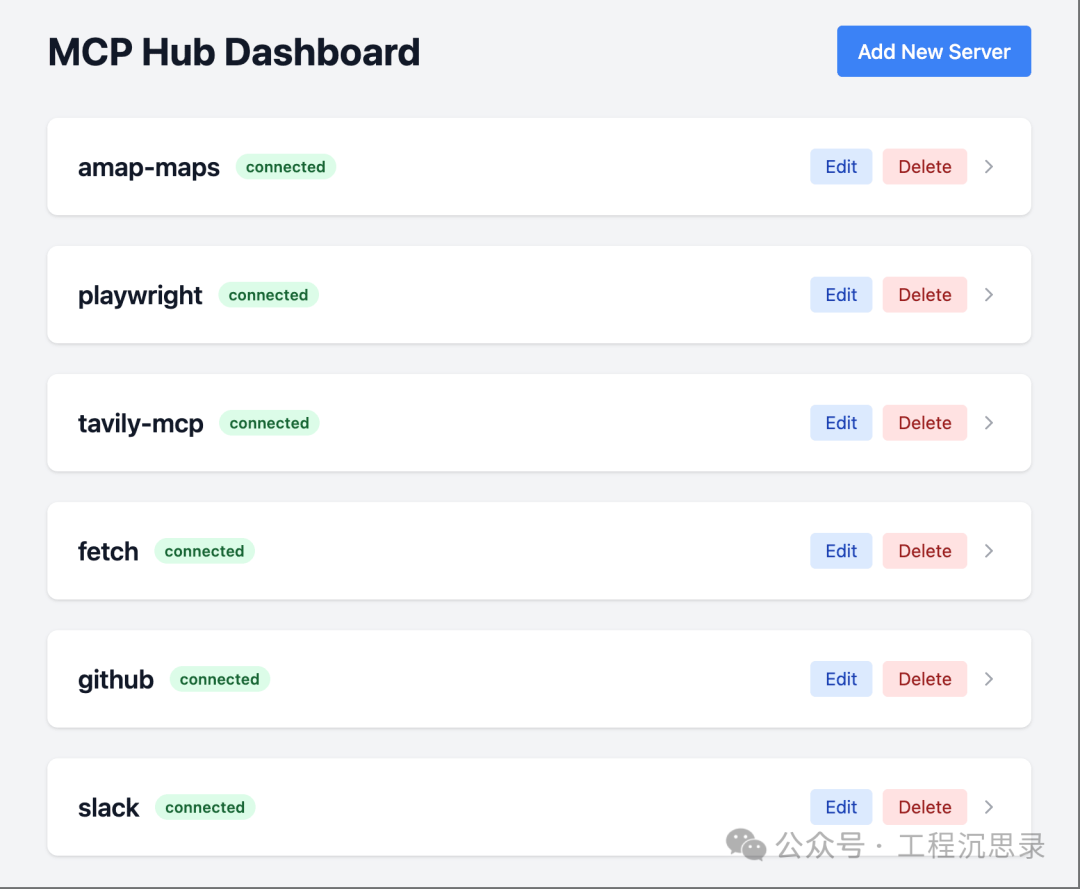

如何一键部署你的专属 MCP 服务

随着 MCP 逐渐成为行业事实标准,如何高效搭建和管理多个 MCP 服务已成为个人开发者面临的主要挑战。本文将介绍一种简便的解决方案,帮助您快速构建自己的 MCP 服务。什么是 MCP?模型上下文协议(Model Context Protocol,MCP)是由 Anthropic 推出的开放标准,旨在为大型语言模型(LLMs)提供标准化接口,使其能够直接连接外部数据源和工具。简言之,MCP 如同 …- 0

- 0

-

给Ai-Agent重塑真身 —浅谈如何优雅地拆解AI-Agent

前言最近随着manus的火爆, 其实大家更关注AI-Agent的开发技术了.毕竟大模型是大脑, 而Ai-Agent才是给最强大脑重塑真身的那个莲藕. 而我也这多半年的时间里, 研究了很多AI-Agent框架. 而在AI-Agent开发中, 其实也发现了一些技巧,思路和架构思考. 比如, 我们如何更好的跟LLM进行交流? 如何可以更好的优化我们的prompt和token数量? 如何能让LLM更快的返…- 0

- 0

-

什么时候应该拆workflow,什么时候应该指望模型

一个很常见,但似乎没有专门讲过的问题。新场景构建新场景构建,最主要的是尽快验证技术上能做出符合要求的效果。一般都是先从整个问题开始,如果发现解决的不够好,就逐步拆解,直到在研发成本可控的范围内作出一个类workflow方案,或者发现做不出来。如果光靠workflow做不出来,或者需要的研发时间太多,最终方案可能过于复杂时,应该考虑通过模型的方式解决,在应用层一般考虑的都是SFT或者RFT,根据场景…- 0

- 0

-

Gemini 2.5 Pro与Claude 3.7 Sonnet编程性能对比

AI领域的语言模型竞赛日趋白热化,尤其在编程辅助方面表现突出。Gemini 2.5 Pro和Claude 3.7 Sonnet作为该领域的佼佼者,本文通过一系列编程测试与基准评估对两者的编码功能进行对比分析。核心结论:• Gemini 2.5 Pro在SWE Bench硬核编程测试中以63.8%的通过率略胜Claude 3.7 Sonnet的62.3%。• 两款模型在完成不同类型编程任务时各具优势…- 0

- 0

-

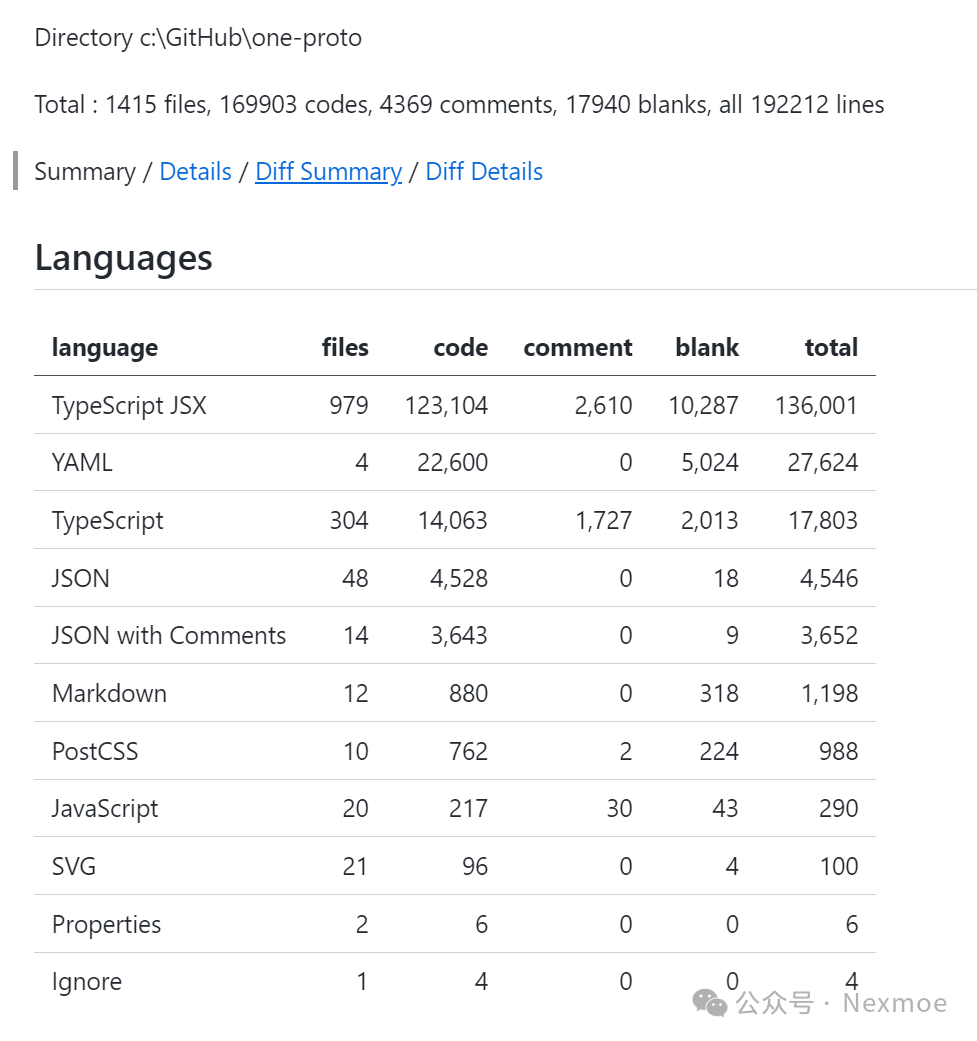

20 万行代码:我们如何构建和维护大规模 AI 原型系统

项目简介在三个月的时间里,我们从零开始搭建了一个包含 20 万行代码的 AI 原型系统。这是一个非常庞大的项目,就像建造一座大楼一样,需要科学的规划和管理。为了让这个系统易于维护和扩展,我们采用了一种叫做 monorepo(单一代码仓库)的项目管理方式,并特别注重可复用工具包的设计。这篇文档将用通俗易懂的语言,为大家介绍这个项目是如何组织和管理的。什么是 monorepo?monorepo 就像是…- 0

- 0

-

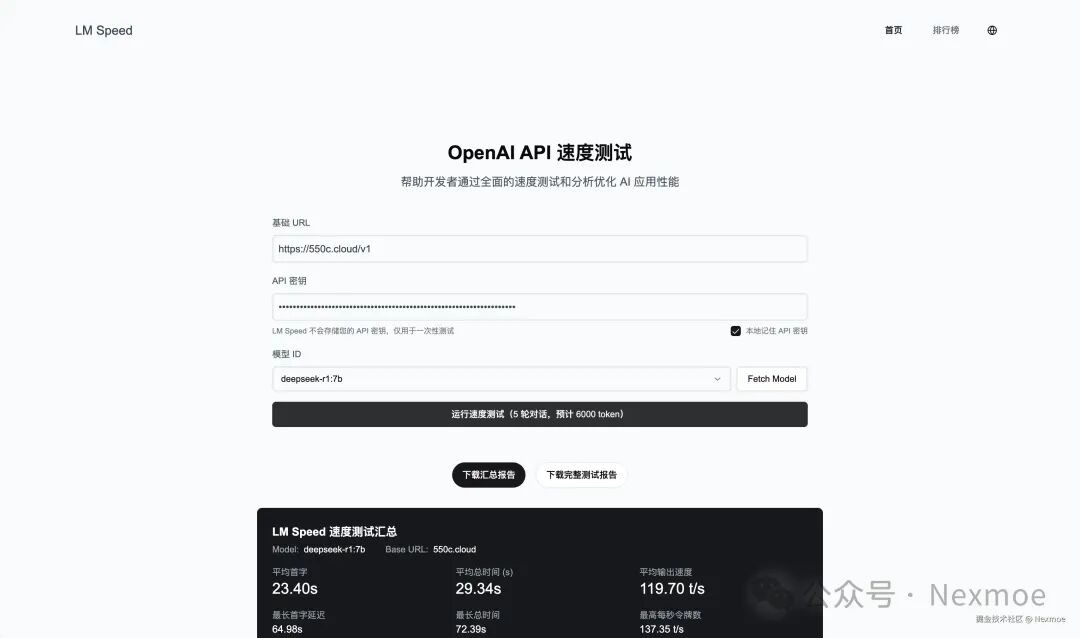

LM Speed – 简单的大模型测速分析工具核心价值

核心价值为 AI 应用开发者提供精准可靠的 OpenAI API 性能测试解决方案,通过多维度的实时数据分析,帮助用户快速定位性能瓶颈,优化模型调用策略。同时提供直观的排行榜功能,让用户能够轻松比较和选择最适合的模型和服务商。解决的三大核心痛点1. 响应质量不透明DeepSeek 官方的 API 不能用?硅基流动的 API 太慢?在选择 LLM API 服务时,开发者经常面临服务质量难以评估的问题…- 0

- 0

-

选择合适的 llms 以实现最佳性能:2025 年最大化 AI 聊天机器人效能的指南

如何从 ChatGPT、Kimi、Qwen 等获取最佳答案如何从 ChatGPT、Kimi、Qwen 等获取最佳答案在人工智能的革命中,我们有许多 LLM,每个月我们都会看到新的 LLM 或现有 LLM 的更新版本。但我们不知道的是:• 哪个 LLM 能比其他更好地帮助我。• 我该如何与 LLM 讨论以获得最佳答案。如何选择 LLM实际上,LLM 的使用取决于您想要解决的领域和…- 0

- 0

-

60G内存+14G显存运行满血DeepSeek R1!Ktransformers+Unsloth联合部署方案实践!

本文内容出自九天老师公开课,详细讨论了采用KTransformers部署Unsloth动态量化DeepSeek R1满血模型的全网最高性价比部署方案。话不多说,我们直接开始!一、DeepSeek R1低成本本地部署方案介绍1. KTransformer与Unsloth动态量化方案介绍 截至目前,DeepSeek R1模型本地部署最具性价比的方案…- 0

- 0

-

Ray 在 Bilibili 的场景探索与落地实践

导读 2024 年 12 月 6 日,由 Ray 中文社区、蚂蚁开源联合主办的 Ray Forward 2024 年度盛会在北京蚂蚁 T 空间成功举办。其中,Bilibili 基础架构部技术专家郑志升分享了《Ray 在 Bilibili 的场景探索与落地实践》。Ray 作为新兴分布式计算框架,为 B 站业务发展提供了强大助力。本文将详细解读 B 站如何借助 Ray 实现技术突破与业务升级…- 0

- 0

-

Spring AI+DeepSeek R1搭建企业私有化模型工具(直接使用)

本文分享基于Spring AI+DeepSeek R1搭建企业私有化模型工具的案例,效果截图:可自由切换部署的本地模型,选择deepseek-r1 1.5b参数模型:选择deepseek-r1 7b参数模型:涉及到的技术有OLLAMA、DeepSeek R1与Spring AI,OLLAMA部署在Linux操作系统,Spring AI项目本地可以直接跑,也可以部署在服务器上。01OLLAMA安装在…- 0

- 0

❯

购物车

优惠劵

搜索

扫码打开当前页

联系我们

返回顶部

幸运之星正在降临...

点击领取今天的签到奖励!

恭喜!您今天获得了{{mission.data.mission.credit}}积分

我的优惠劵

-

¥优惠劵使用时效:无法使用使用时效:

之前

使用时效:永久有效优惠劵ID:×

没有优惠劵可用!