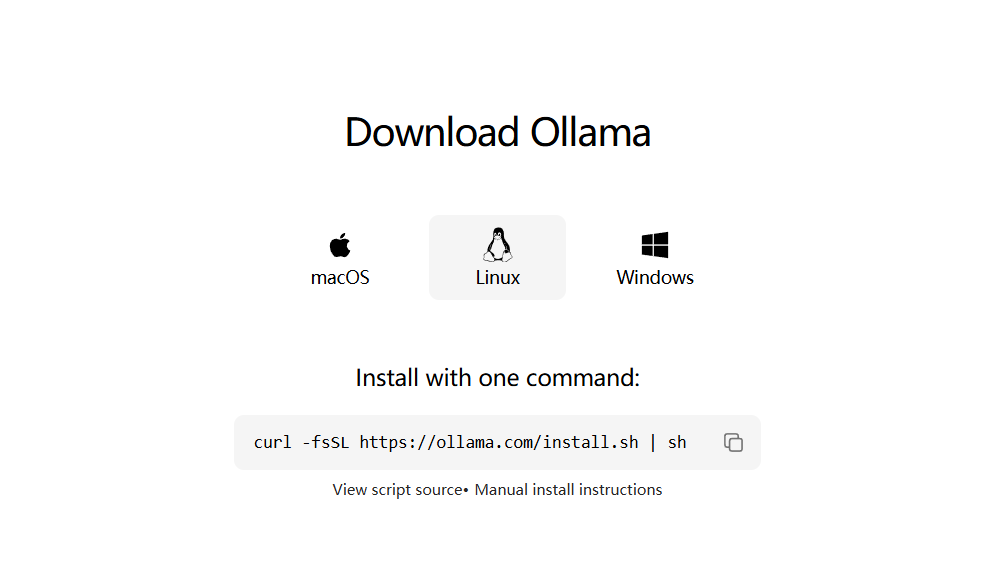

最近在做向量化模型的技术选型,没有GPU所以打算装个ollama先试一下(vLLM要求必须是GPU才行)。

但是我这台机器下载速度贼慢,所以考虑借助魔塔社区安装了(https://modelscope.cn/models/modelscope/ollama-linux/summary)但是这种方式对python版本有要求,起码要在Python 3.8以上。

# 模型拉取ollama pull scratchfens/QwQ-32B-CoD

# 启动模型服务并进入交互页面ollama run scratchfens/QwQ-32B-CoD

默认的ollama安装完成后只能在本地访问,外部机器是不能访问到这个服务的,这个时候就需要修改ollama的配置文件,配置文件的目录

/etc/systemd/system/ollama.service

修改配置文件,在service上增加一项,指定对外的端口和地址

Environment="OLLAMA_HOST=10.128.5.150:8090"

# 重新加载配置文件sudo systemctl daemon-reloadsudo systemctl restart ollama

export OLLAMA_HOST="10.128.5.150:8090"ollama --version

真服了!!!

真服了!!!