如何从 ChatGPT、Kimi、Qwen 等获取最佳答案

如何从 ChatGPT、Kimi、Qwen 等获取最佳答案

在人工智能的革命中,我们有许多 LLM,每个月我们都会看到新的 LLM 或现有 LLM 的更新版本。

但我们不知道的是:

-

• 哪个 LLM 能比其他更好地帮助我。 -

• 我该如何与 LLM 讨论以获得最佳答案。

如何选择 LLM

实际上,LLM 的使用取决于您想要解决的领域和问题。

这意味着要识别您的问题属于哪个领域。

例如:

-

• 解决数学问题 -

• 与计算机视觉相关的问题(处理图像) -

• 使用编码解决问题 -

• 或简单地处理一般任务

但我怎么知道我领域中更好的 LLM?

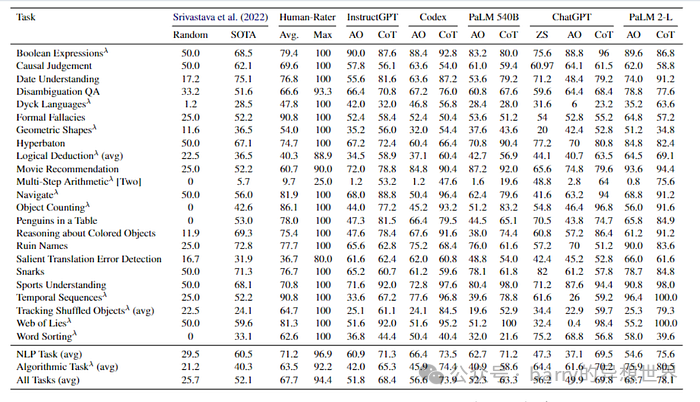

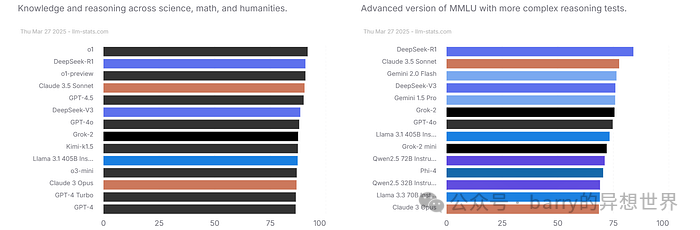

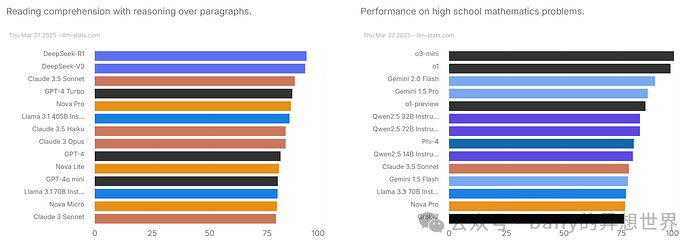

别担心,有一些组织评估 LLM,这被称为 基准测试。

所以 基准测试 是一种用于根据 LLM 在不同任务中的表现进行评估和比较的测试。

由于 LLM 设计用于各种目的,基准测试帮助我们了解哪个模型最适合特定需求。

常见的基准测试包括:

-

• MMLU: 测试多个学科的常识。 -

• HELLASWAG: 测量 LLM 预测下一个逻辑句子的能力。 -

• GSM8K: 评估数学问题解决能力。 -

• HumanEval: 通过检查 LLM 是否能够生成正确的 Python 程序来测试编码能力。

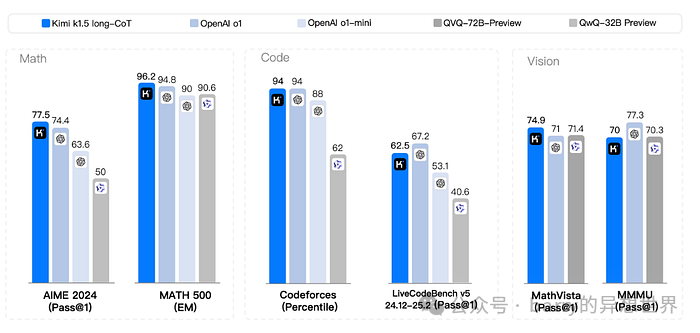

评估示例

如您所见,Kimi LLM 在解决数学问题方面表现更好。

此外,模型的评估还取决于您使用的语言:

我该如何与 LLM 讨论以获得最佳答案

要从 LLM 获取最佳答案,您需要给出好的提示。

以下是关键策略:

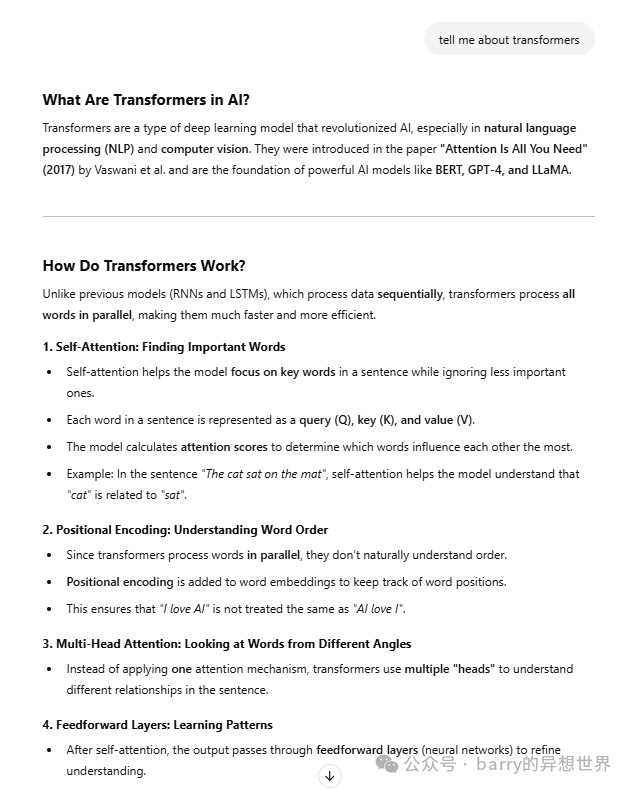

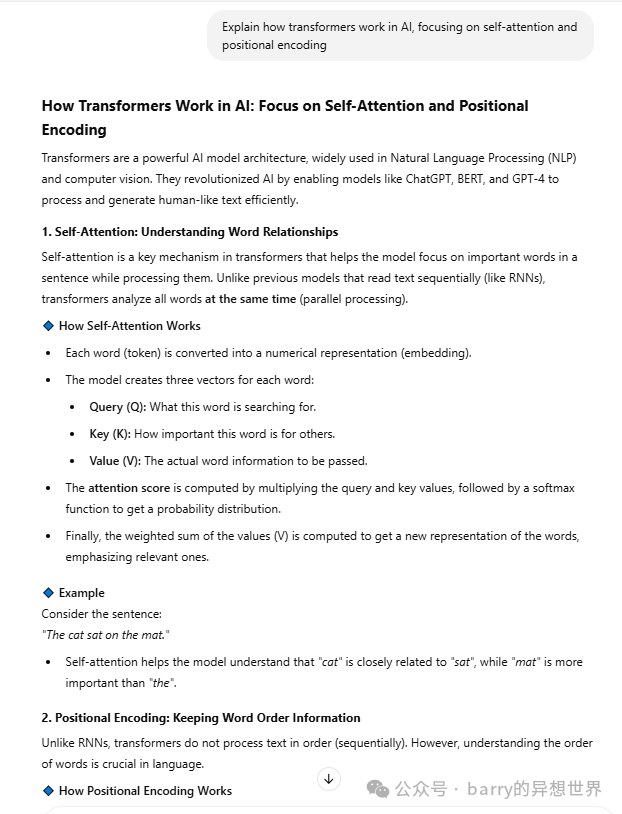

1. 清晰具体

-

• 而不是:“告诉我关于人工智能的事。” 尝试:“解释一下变压器在人工智能中的工作原理,重点关注自注意力和位置编码。” 您的请求越精确,响应就会越好。

2. 提供背景信息

-

• LLM 在拥有背景信息时响应更好。 -

• 示例:没有背景信息: “总结一下这段文字 'your text'。” -

• 有背景信息: “用简单的术语为电子商务初学者总结这段文字。”

3. 使用逐步说明

-

• 而不是:“生成用于数据清理的 Python 代码。” 尝试:“编写一个 Python 脚本来清理数据集:去除重复项、处理缺失值和标准化列名。”

4. 定义输出格式

-

• 如果您需要特定的结构,请提及。 -

• 示例:“用要点总结这篇文章。” -

• “生成一个用于发票处理的键值对的 JSON 输出。”

5. 实验和迭代

-

• 如果响应不完美,精炼您的提示。 -

• 示例:如果答案过于技术性,可以调整为 “用通俗的语言解释。”

6. 使用角色基础的提示

-

• 通过分配角色来引导 LLM。 -

• 示例:“你是一名高级人工智能工程师。向一名初级开发人员解释强化学习。”

7. 拆分复杂问题

-

• 而不是:“告诉我关于无货源电商的所有事情。” 尝试:“解释一下无货源电商的基础。” -

• “描述广告在无货源电商中的作用。”

总结:

在本文中,我探讨了如何优化与 LLM 聊天机器人的互动,以获得更好的答案。

我讨论了 基准测试,它帮助评估和比较不同模型在推理、编码和文本理解等任务中的表现。

常见的基准测试包括 MMLU 用于常识,GSM8K 用于数学,HumanEval 用于编码。