-

终于有人说清楚AI开发的全流程了!

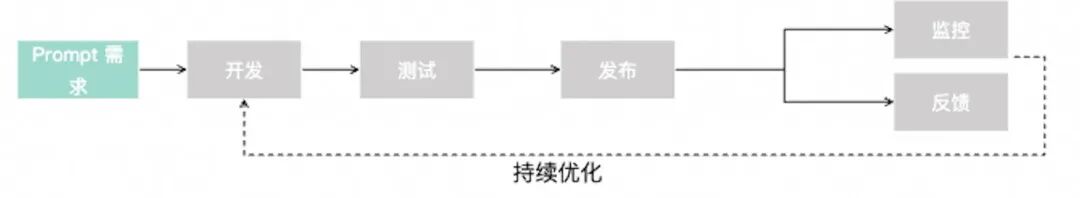

引言在需求分析阶段,明确的业务目标与模型性能的深刻理解是项目的基石,本文特别强调通过 AI OPS促进产品和业务团队的自主参与 AI需求调研,这不仅有助于保证技术实现与实际业务需求的高度契合,还能增强跨团队协作的效率。开发阶段则注重AI模型的选择和优化,本文详细讨论了在性能与成本之间寻求最佳平衡的策略,包括对响应时间、Token数量,以及API调用成本的全面考量。此外,通过AI OPS工具的应用,…- 0

- 0

-

模型部署:Ollama 和 GPUStack如何选择?

Ollama 大家应该不陌生了,它是一个专注于本地化运行和管理大型语言模型的工具,主要用于简化模型的部署和使用流程。而 GPUStack 是一个开源的GPU集群管理平台,专注于异构资源整合和分布式推理,适用于企业级私有化大模型部署。因此,两者对自身的定位完全不同。 Ollama 定位:轻量级本地模型部署工具,专注于快速启动和易用性,适…- 0

- 0

-

6 个 Cursor 0.46 版本高频问题

Cursor 在官网正式发布了 0.46 版本,功能很多,今天聊下几个大家最关心的问题。1、要不要更新 0.46 版本按需,根据官网论坛的帖子,Windows 版本还是存在一些小问题,如果没有强需求,不建议更新。比如 0.45 的版本也可以正常使用 Claude 3.7 模型,就没有必要单独为了这个功能去升级新版本。2、是否可以使用 Claude 3.7 版本Cursor …- 0

- 0

-

我打算用腾讯IMA,实现长生不老。

我想用AI干票大的——投喂一个AI分身。让它在我死后继续存在曲线实现长生不老:数字永生。这是独属于我一个人的智能体,我不会公开它,在我活着的时候只为我所用。它是我的私人助理,更是最懂我的那个人,虽然我没上过北大清华,但是AI可以让北大清华的教授给我上私教课。等有一天我魂归大海的时候,它就可以作为另外一个我存在这个世界上,替我回答我的儿子和孙子们记不住的童年细节。五千年前秦始皇想尽一切办法没能求得仙…- 0

- 0

-

私有化部署DeepSeek + RAGFlow,技术小白也能轻松学会

① 我本地的环境AMD Ryzen 5 5600G 3.90 GHz16.0 GB (15.4 GB 可用)1TB固态没有独显(哈哈)Windows 11 专业版本地虚拟机CentOS Linux release 7.9.2009 (Core)安装好 Docker,这个不会可以问AI,Linux几行命令就搞定以上环境相信大部分朋…- 0

- 0

-

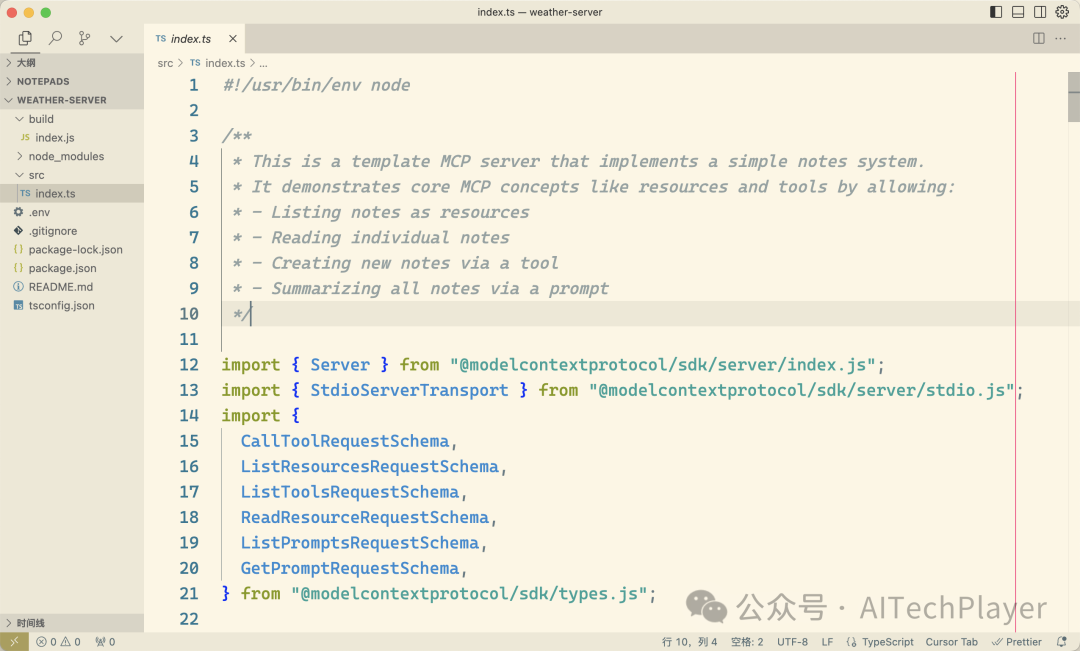

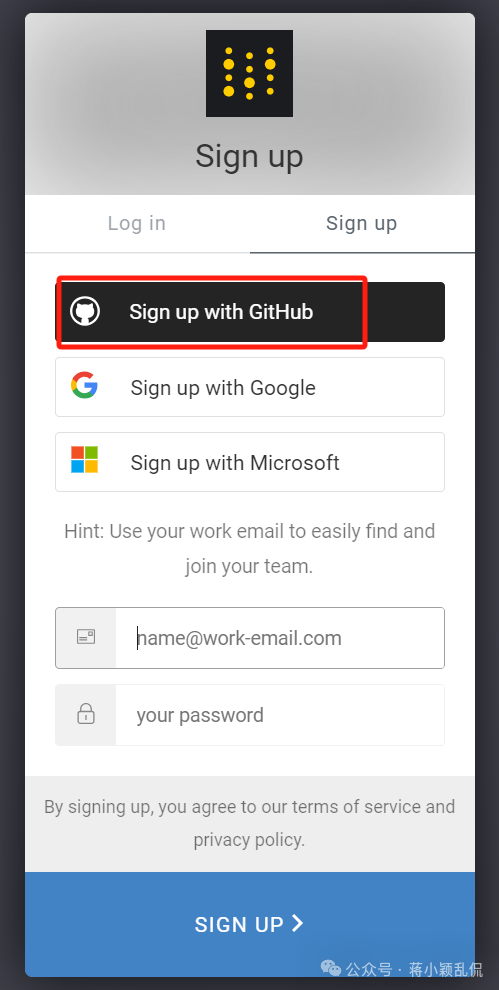

一步一步构建 MCP Server

本文我们将通过一个 TypeScript 的 MCP 服务器示例来演示如何编写一个 MCP 服务器。我们将创建一个天气服务器,提供当前天气数据作为资源,并让 Claude 使用工具获取天气预报。这里我们需要使用 OpenWeatherMap API[2] 来获取天气数据,直接注册然后在 API keys[3] 页面即可获取一个免费的 API 密钥。环境准备我们需要准备一个 TypeScript 的…- 0

- 0

-

三水区市场监管局开展DeepSeek应用技能培训

为深入推进市场监管数字化建设,加快人工智能技术在市场监管领域的创新应用,2月27日下午,三水区市场监督管理局举办DeepSeek应用技能培训会。本次培训由佛山市市场监督管理局主办,特邀53AI创始人杨芳贤担任主讲,全区市场监管系统近百名干部职工参加培训。培训紧贴政务服务、决策辅助、数据分析等政务办公需求,深入讲解DeepSeek基础操作、大模型落地应用“三步走”路线、智能政务应用前景、人工智能本地…- 0

- 0

-

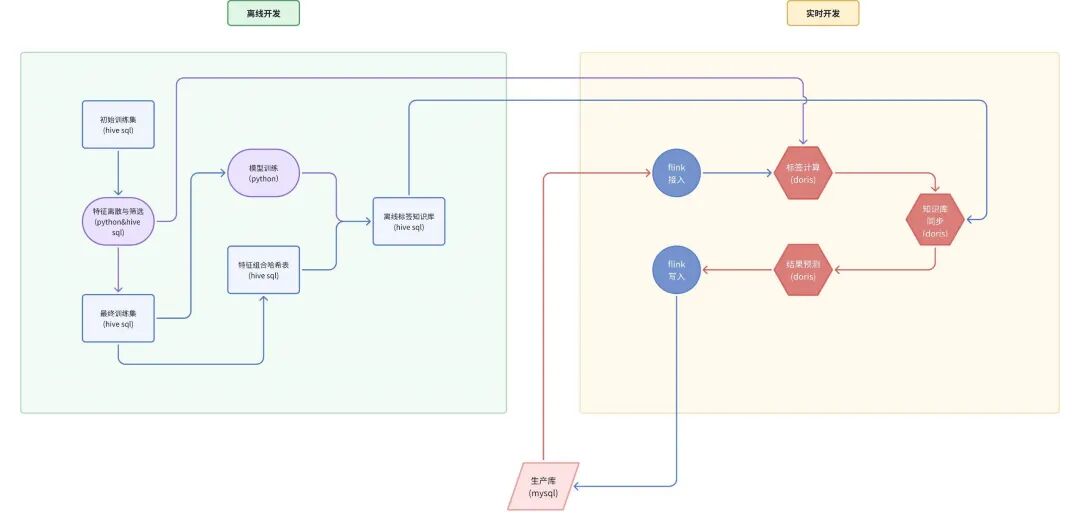

火花思维:基于离线标签知识库和实时数仓实现轻量级算法服务的技术方案

导读 本文介绍了火花思维:基于离线标签知识库和实时数仓实现轻量级算法服务的技术方案。主要内容包括以下几个部分:1. 背景2. 技术框架3. 关键技术节点4. 实现案例5. 总结与展望分享嘉宾|茆中尧 火花思维出品社区|DataFun01背景火花思维(下称:火花)是一家专注于青少年思维训练及综合素质提升的互联网教育企业,产品包含逻辑思维、中…- 0

- 0

-

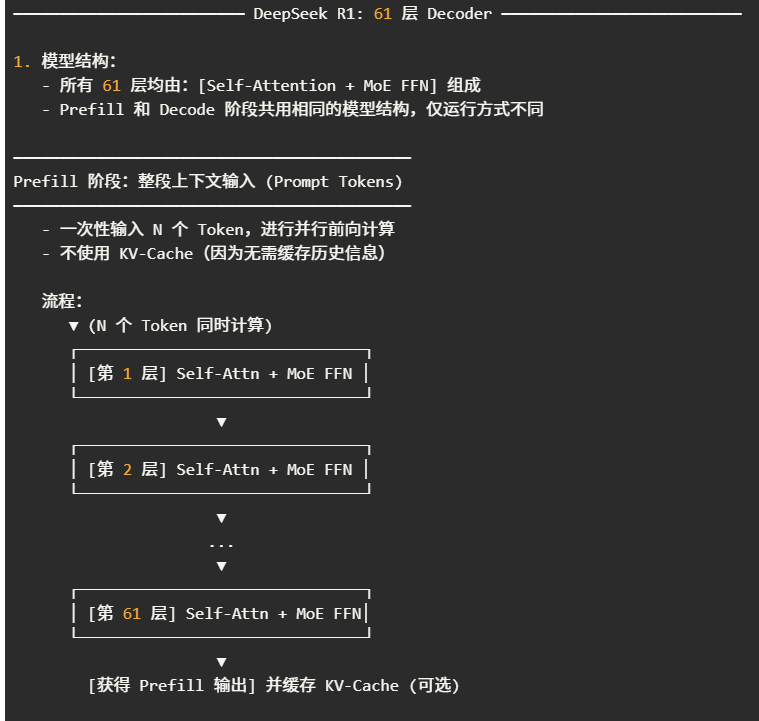

DeepSeek部署实践解析

一、推理的两个阶段模型推理主要分两个阶段:Prefill和decoder。Prefill 阶段的输出,指的是模型在一次性处理所有输入 Token(即 Prompt Tokens)后,为每个输入 Token 生成的隐藏状态(hidden states)。这些隐藏状态可以被用于后续任务,比如解码阶段的进一步生成、分类任务,或者其他下游操作。要点总结: 1. 统一的 61 层结构: …- 0

- 0

-

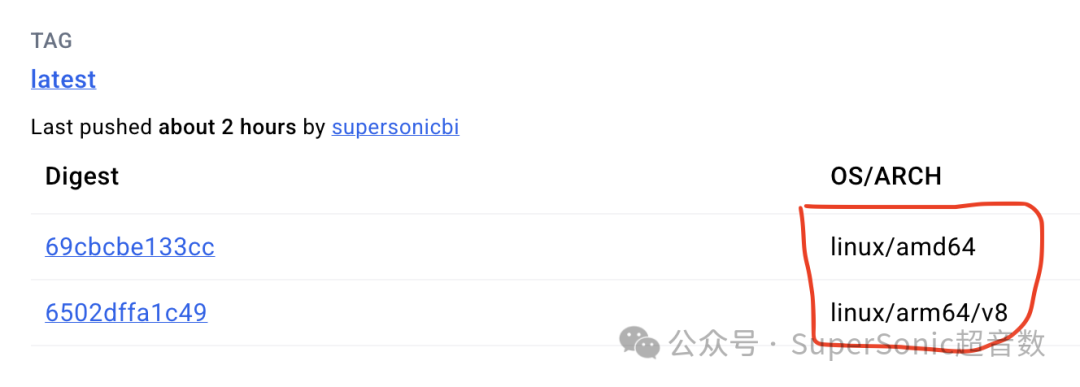

SuperSonic 0.9.10版本发布

0.9.10针对用户高频反馈的bug、易用性、兼容性方面做了大量优化。这里从部署、解析、权限、集成四个维度来简要概述。部署Docker和安装包部署都被进一步简化,从而降低用户的学习成本,请参考文章5分钟极简部署SuperSonic。值得一提的是,Docker镜像已支持amd和arm两种体系架构:另外,需要特别注意的是,0.9.10升级到Spring 3.0(特别鸣谢mislayming贡献PR),…- 0

- 0

-

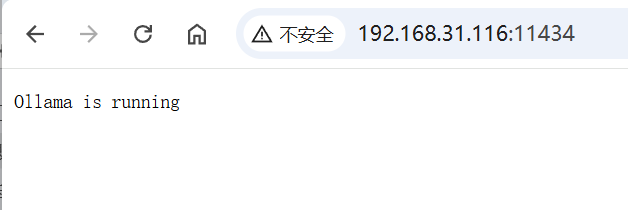

数据不出内网:基于Ollama+OneAPI构建企业专属DeepSeek智能中台

前言之前已经在Linux服务器上使用Ollama部署了DeepSeek这次在没有外网(应该说是被限制比较多)的服务器上部署,遇到一些坑,记录一下ollamaollama 自然无法使用在线安装脚本了根据 ollama 的文档先在本地电脑根据服务器的系统和CPU架构下载安装包curl -L https://ollama.com/download/ollama-linux-amd64.tgz -o ol…- 0

- 0

-

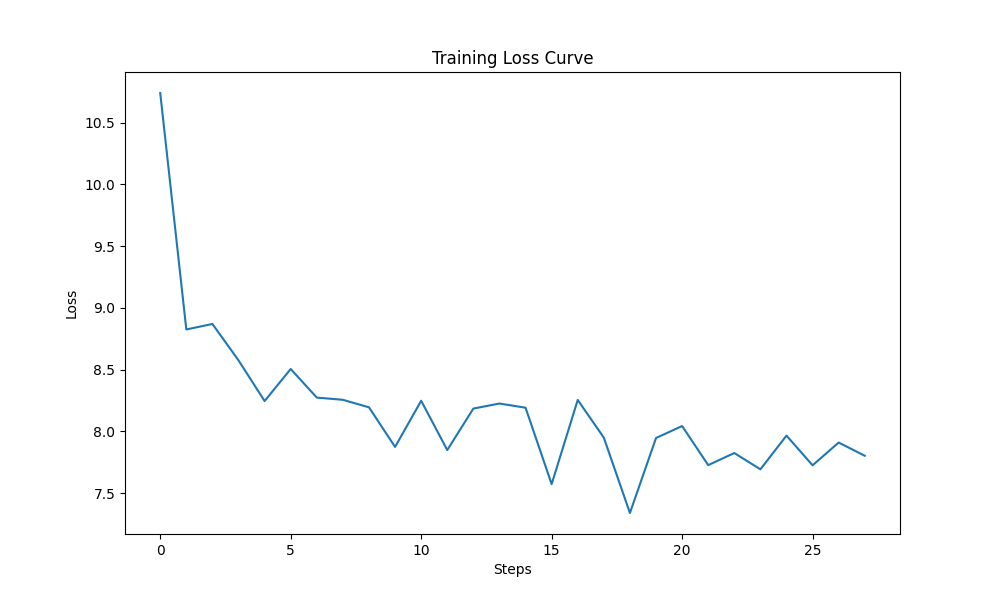

零基础入门:DeepSeek微调的评测教程来了!

前言:大模型评测是一个系统工程,本文希望通过比较通俗的方式给大家直观感受大模型微调后的效果,相关是思路想法旨在起到抛砖引玉的效果,如果学习者对大模型评测有深厚的兴趣,可以从不同的角度进行学习。三天前,看到了我们 Datawhale 公众号上发了文章《零基础入门:DeepSeek 微调教程来了!》反响很好,其中的内容写的非常接地气,适合学习者进行学习体验。于是,我尝试在那篇文章的基础上进行了复现,并…- 0

- 0

-

一拥而上采用DeepSeek?作为Agent架构师需要三思

春节假期被DeepSeek刷屏了,不少同学出了多个维度的解析,也介绍了不同平台支持一键部署DeepSeek的教程。作为尝鲜和使用,这样使用无可厚非,对于Agent ToB商用来说,是否要第一时间追逐采用最新的模型,这又是另外一个话题。先说观点,我认为是有必要紧跟热点技术,但不能一拥而上,Agent ToB商用的架构师在设计方案时需要考虑切换模型带来的风险、选择合适的业务进行试点、通过技术架构封装底…- 0

- 0

-

本地部署DeepSeek大模型全攻略:从全量模型到蒸馏版,打造你的私有AI大脑! ——无需天价算力,普通人也能玩转企业级AI!

一、为什么选择本地部署DeepSeek?1️⃣ 数据绝对安全案例:上海某三甲医院部署医疗诊断助手,单日处理3.2TB含患者隐私的CT影像和电子病历数据,满足《健康医疗数据安全指南》(GB/T 39725-2020)合规要求技术实现:采用国密SM4-CBC加密算法进行传输层加密(TLS 1.3定制协议)基于Intel SGX构建可信执行环境,内存隔离敏感数据处理流程使用LUKS磁盘加密和K…- 0

- 0

-

内外网DeepSeek部署实战:Ollama + 多客户端 + RAG + 越狱

1. 前言 (不仅仅是概述)大家好!我是AI安全工坊。最近,我一直在研究如何在内网环境中安全、高效地部署大型语言模型DeepSeek(LLM)。这篇教程不仅仅是操作指南,更是我的实战经验总结,希望能帮助大家少走弯路!2. 前置条件 (磨刀不误砍柴工)2.1 硬件要求 (这可不是闹着玩的!)GPU: 强烈建议使用NVIDIA RTX 3090或更高型号的GPU,显存至少24GB。相信我,小…- 0

- 0

-

保姆级教程~本地微调DeepSeek-R1-8b模型

一、文档说明与服务器准备1.1 文档说明笔者正在从传统云计算行业向AI靠拢中,相关底层理论知识也正在学习中,所以此篇微调DeepSeek-R1-Distill-Llama-8B模型的操作文档是参考其他教学资料(在本文最后已经注明)所做的操作记录,其中已经将相关问题如下载模型大文件、操作过程中相关python库版本问题、wandb认证问题等解决,并记录在此文档中。所以说这是一篇保姆级别的"…- 0

- 0

-

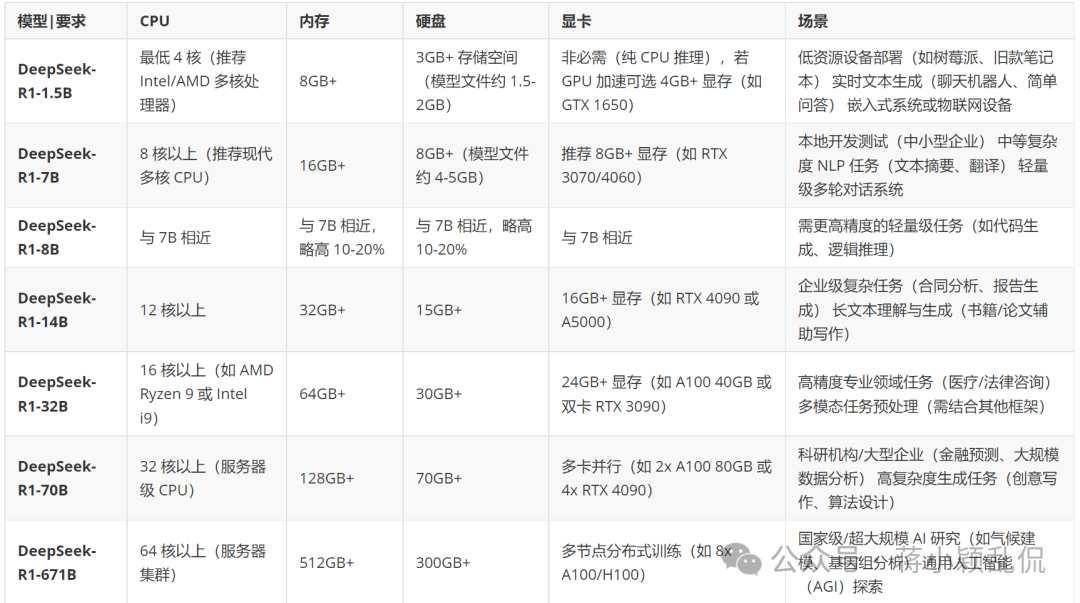

DeepSeek-R1本地部署配置要求

一、前言随着DeepSeek-V3与R1的持续爆火,国内各个厂商掀起了一场接入或适配DeepSeek模型的浪潮,这无疑是一件好事。同时,也有越来越多的用户或公司想要在本地部署DeepSeek模型,体验其带来的便捷功能或二次开发,但DeepSeek模型部署时对硬件有一定要不,以下这DeepSeek-R1的基础模型及蒸馏模型的部署硬件要求进行整理汇总。二、DeepSeek-R1基础模型本地部署配置要求…- 0

- 0

-

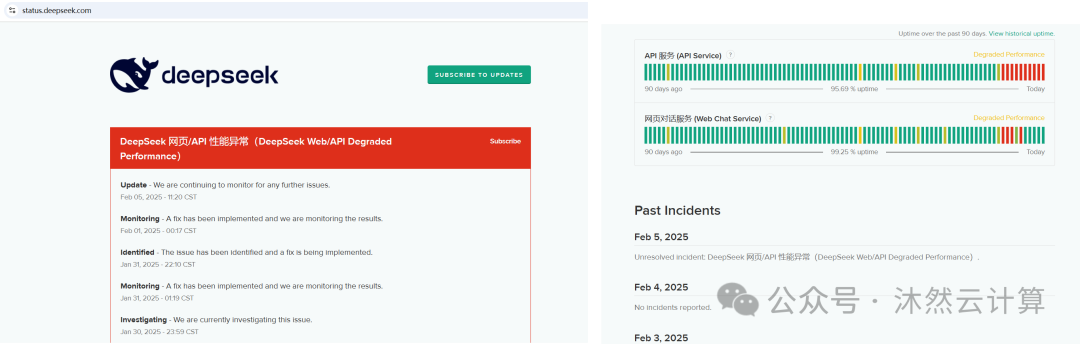

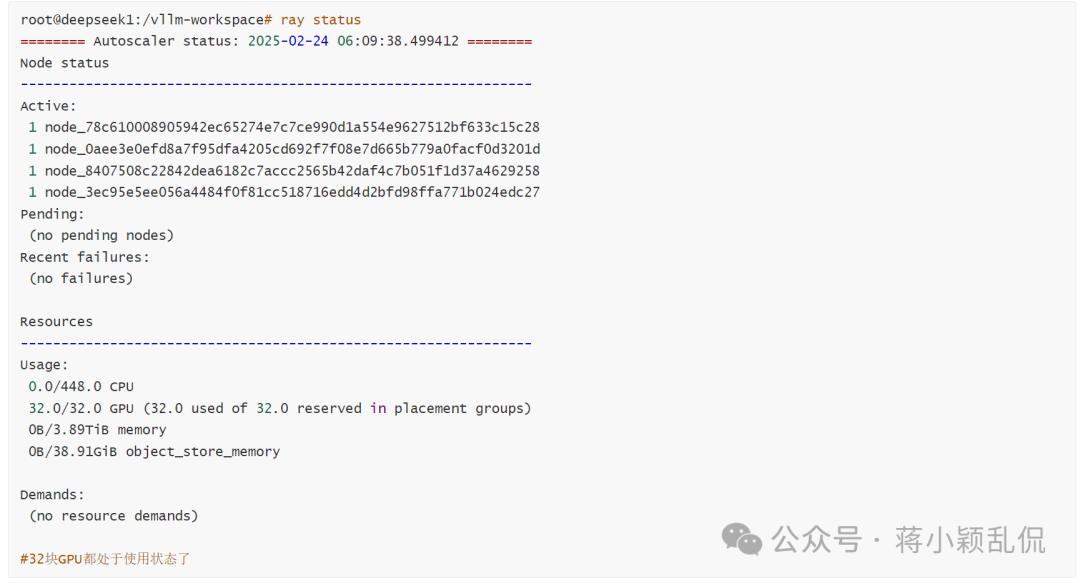

已成功部署满血版DeepSeek-R1-671B,可承接咨询或部署业务

本人成功在4台服务器成功部署满血版DeepSeek-R1-671B,相关信息简介如下,现可承接咨询指导或部署业务订单,部署过程正在逐步优化完善,大家可相互一起学习。以下有部署成功后的相关内容展示。满血版DeepSeek-R1-671B内容展示Ray集群状态Production Metrics(self-llm) deepseek@deepseek2:~$ curl http://10.119.85…- 0

- 0

-

别被 “一键部署” 骗了!使用Ollama本地部署DeepSeek 避坑指南

最近最火的莫过于DeepSeek,现在网上关于 AI 模型部署的文章一抓一大把,动不动就是 “一键部署,轻松上手”、“30 分钟搭好一个本地能跑起来的大模型”。可现实是,当你真上手用 Ollama 搭建 DeepSeek 模型时,那简直就是踩坑大冒险!今天咱就来好好唠唠那些坑,帮你顺利搭建属于自己的 DeepSeek。Ollama 是什么Ollama 则是咱们搭建模型的得力助手,它就像是一个智能的…- 0

- 0

-

以小模型之名,泼一盆理性的冷水:DeepSeek-R1 7B实测引发的局限性反思

近期,笔者以DeepSeek-R1 7B模型为核心搭建知识库系统,实测中发现其表现存在较大落差。本文以此次实践为例,结合行业研究数据,剖析小模型辅助的局限性,探讨优化方向,并理性定位其适用场景。一、实测暴露的三大核心问题知识检索与推理的“双面性”在知识库问答测试中,模型虽能快速响应,但常出现以下问题:检索偏差:对文档中复杂逻辑的提取存在断章取义现象,例如将技术术语的上下文关联割裂,导致答案偏离原意…- 0

- 0

-

自动动手,用Deepseek打造自己的APS AI Agent

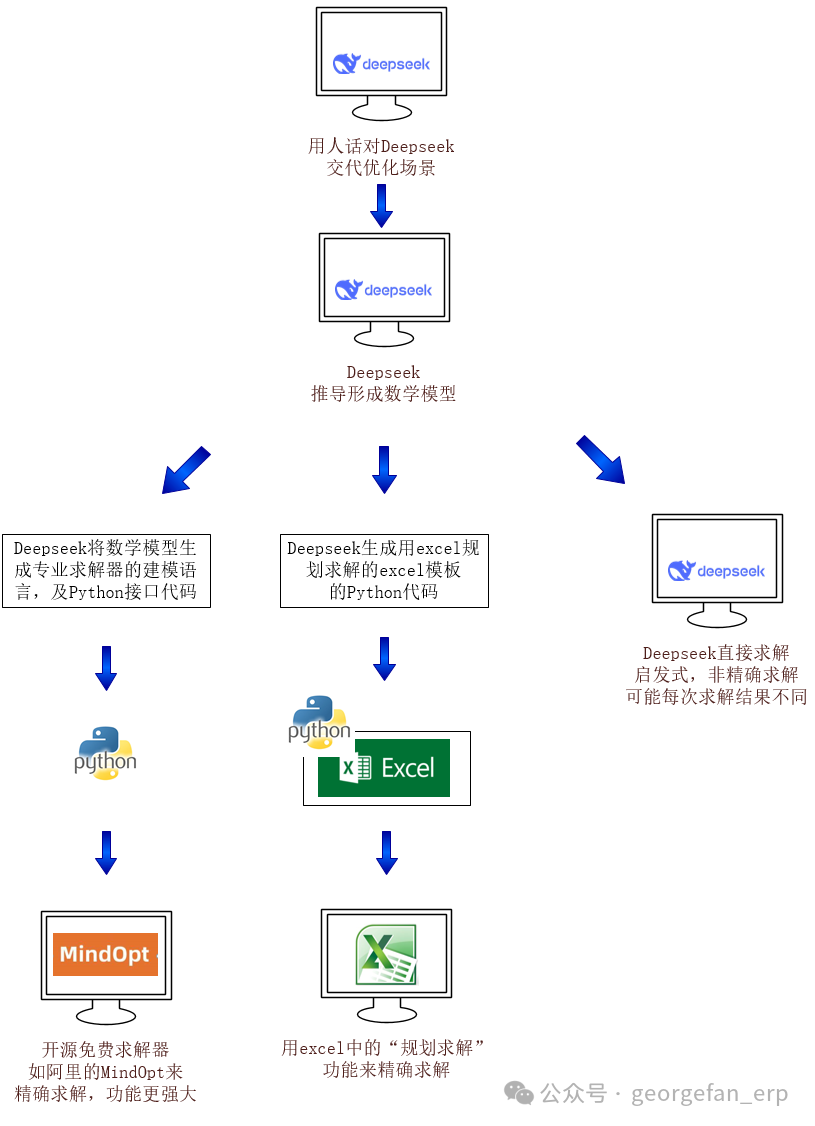

从前面的测试来看,Deepseek中对求解问题能直接求解,但求解精度存在问题。本文简要介绍如何使用比较专业的求解器来求解。最终达到的效果是,你用自然语言描述待优化场景,其后就不用操心了,一切交给Deepseek来第三方求解来完成,整个路径通过自动生成的Python代码整合通了。下图是可参考的框架:从右往左,一个一个说。Deepseek直接求解:最省事。但Deepseek目前没有专业的求解能力,它使…- 0

- 0

-

一文告诉你DeepSeek私有化部署应该选择什么版本

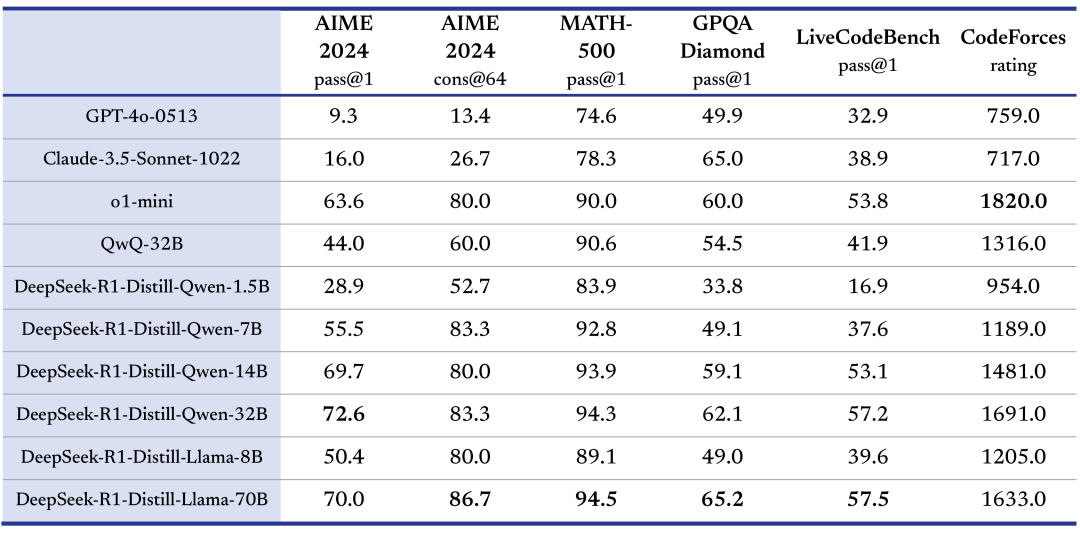

近段时间全民都在进行DeepSeek炼丹,蒸馏版、满血版、量化版各种版本满天飞,各种术语眼花缭乱。考虑到安全问题,很多企业不会考虑使用公有云API服务,而是考虑使用GPU服务器进行私有化部署,那究竟应该选择什么版本呢?下面说说我的看法,我的结论是:性价比之选是14B量化版,性能之选是32B量化版,671B满血版是土豪的选择。首先要科普几个术语,蒸馏是指的知识的传递,现在DeepSeek开源的R1蒸…- 0

- 0

-

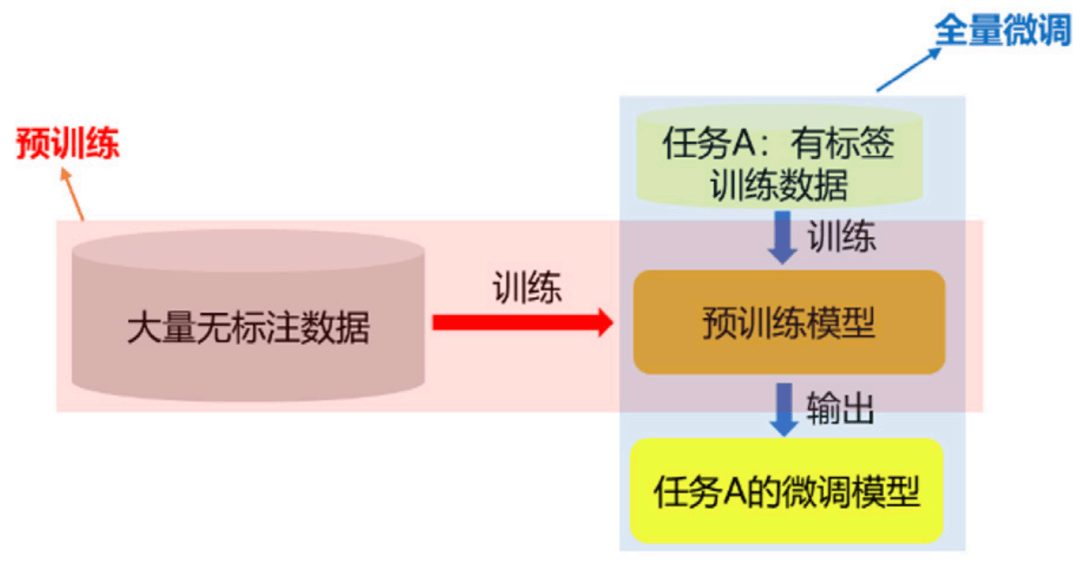

为啥大模型要设计成预训练和微调两个阶段?

导读在人工智能领域,大模型的设计与训练一直是热门话题。细心的朋友可能会发现,大模型的训练通常分为预训练和微调两个阶段。那么,为什么要这样设计呢?今天我们就来聊聊其中的原因。unsetunset一、什么是预训练和微调?unsetunset1. 预训练预训练是指使用海量的未标注数据对模型进行训练,使其学习到通用的知识和模式。这些数据通常来自书籍、文章、网站等多种来源,涵盖了广泛的领域和语言结构。通过预…- 0

- 0

-

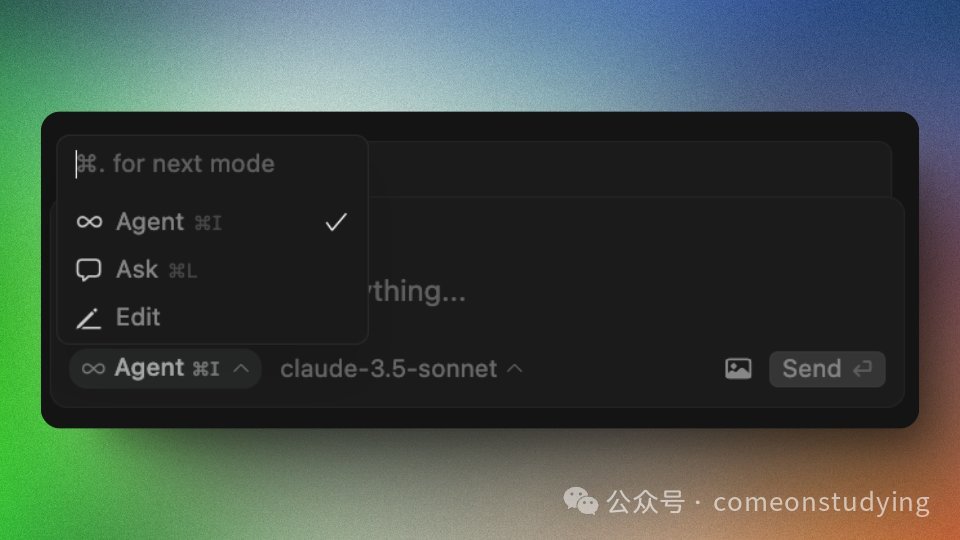

Cursor 重大更新!Agent 模式全面升级,UI 大改版

Cursor 正式发布0.46版本,全新的 Agent 模式 以及 UI界面,让AI编程体验再次提升,我们来看下都有哪些变化。Agent 模式全面升级更强大的 AI 体验Agent 现在是默认模式:Agent 已成为默认模式,带来更强大、更统一的 AI 体验。以往在 Chat、Composer 和 Agent 切来切去,很容易搞混,现在是一个智能且能根据需…- 0

- 0

❯

购物车

优惠劵

搜索

扫码打开当前页

联系我们

返回顶部

幸运之星正在降临...

点击领取今天的签到奖励!

恭喜!您今天获得了{{mission.data.mission.credit}}积分

我的优惠劵

-

¥优惠劵使用时效:无法使用使用时效:

之前

使用时效:永久有效优惠劵ID:×

没有优惠劵可用!