一、前言

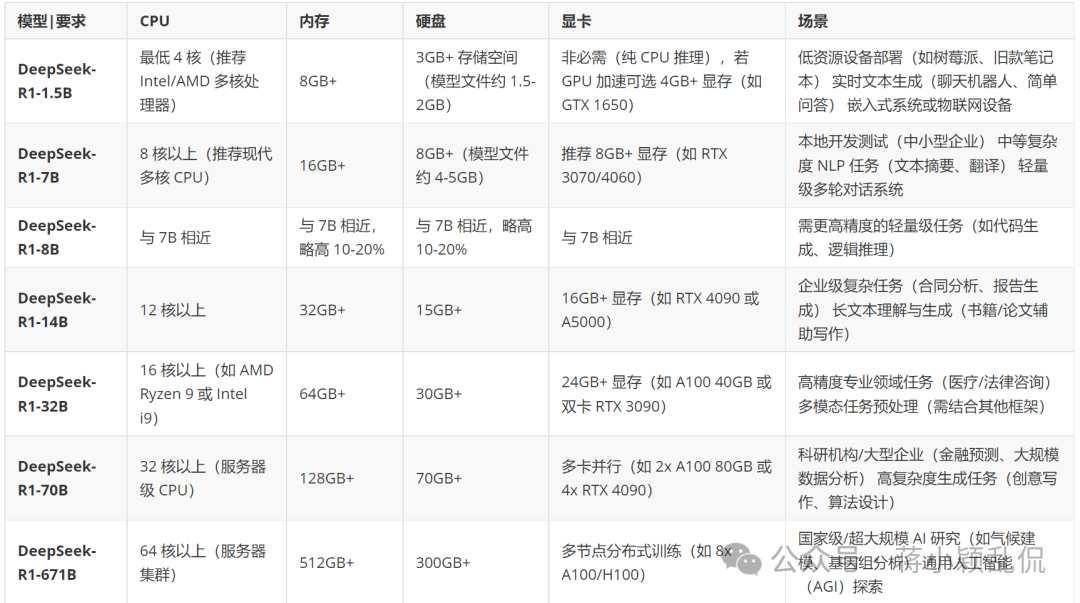

随着DeepSeek-V3与R1的持续爆火,国内各个厂商掀起了一场接入或适配DeepSeek模型的浪潮,这无疑是一件好事。同时,也有越来越多的用户或公司想要在本地部署DeepSeek模型,体验其带来的便捷功能或二次开发,但DeepSeek模型部署时对硬件有一定要不,以下这DeepSeek-R1的基础模型及蒸馏模型的部署硬件要求进行整理汇总。

二、DeepSeek-R1基础模型本地部署配置要求

针对DeepSeek-R1模型本地部署与使用的通用建议

-

• 量化优化:使用 4-bit/8-bit 量化可降低显存占用 30-50%。 -

• 推理框架:搭配 vLLM、TensorRT 等加速库提升效率。 -

• 云部署:70B/671B 建议优先考虑云服务以弹性扩展资源。 -

• 能耗注意:32B+ 模型需高功率电源(1000W+)和散热系统。

三、DeepSeek-R1蒸馏模型及其量化版本本地部署配置要求

使用蒸馏模型时,CPU配置应该尽量跟同等参数规模的DeepSeek-R1模型靠近或略低。本人在本地使用一个NVIDIA A40也成功部署了DeepSeek-R1-Distill-Llama-70B,试用着直接使用ollama或使用python程序向其提问,其回答问题的速度与准确性(只针对所提普通问题而言)还能接受。

另外,在部署与使用AI模型过程中,我们应该根据自己的需求从较小的模型开始部署进行试用,如有需要再升级至更高参数规模的模型,在满足需求的同时也可以避免资源的浪费。