-

Claude动手抄OpenAI老家了:一键把你在 ChatGPT 攒的记忆全搬走

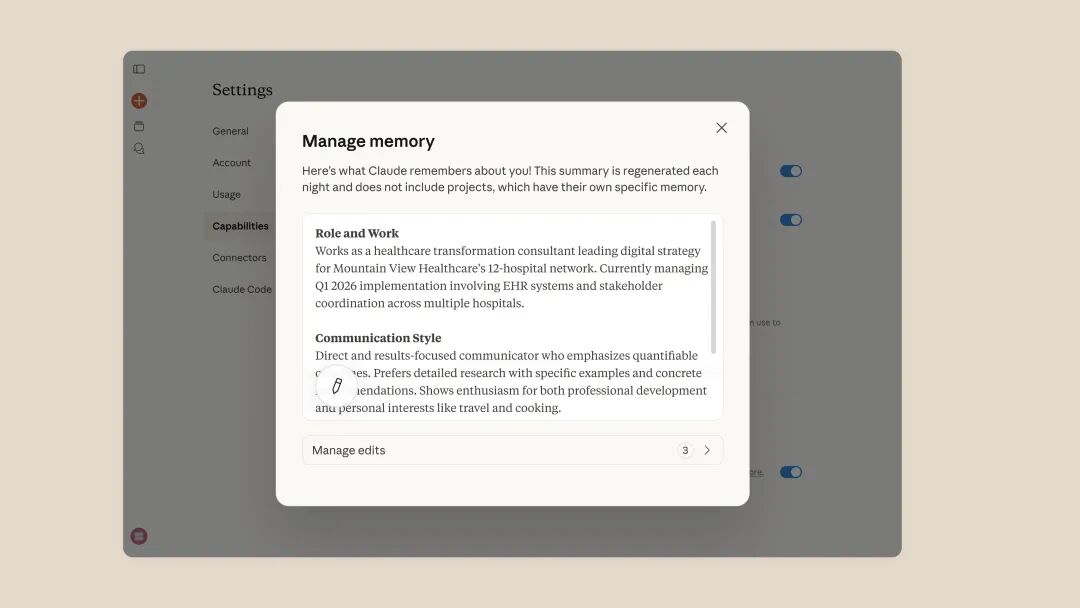

你在 ChatGPT 攒了一年的偏好、习惯、工作上下文,现在可以三步搬进 Claude 了。不用重新调教,不用从头来过。Anthropic 上线了一个记忆迁移工具(Memory Import),让你把 ChatGPT、Gemini 等 AI 助手里积累的个人偏好和上下文,一键导入到 Claude 的记忆系统里。功能入口:https://claude.com/import-memory支持平台:Cl…- 0

- 0

-

Claude Code 的记忆机制:从CLAUDE.md到Auto Memory,它到底记住了什么?

Claude Code 刚上线了一个新功能叫 Auto Memory - 让 AI 自己记笔记,下次对话自动带上。听起来很美好,但如果你不理解它的记忆体系是怎么分层的,很容易搞出一堆互相矛盾的指令,或者发现"明明告诉过它"的东西下次又忘了。这篇把 Claude Code 的记忆机制从头理清。一、两种记忆Claude Code 的记忆分两大类:CLAUDE.m…- 0

- 0

-

目前较优的知识库解决方案

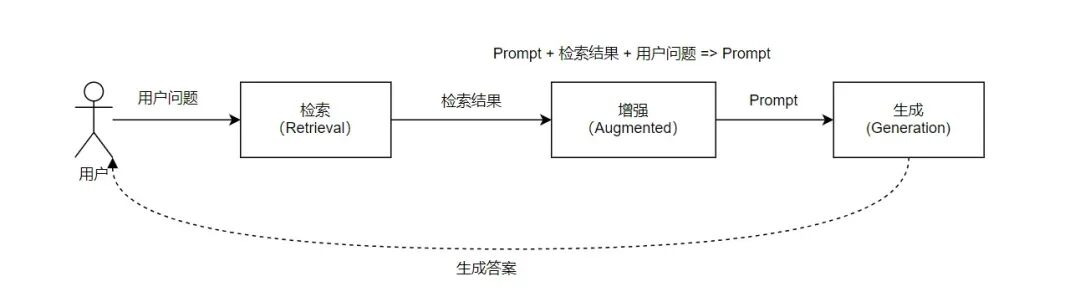

知识库的问题大概跟外星人能否听到甚至听懂旅行者号上面的金唱片是一个问题。AI是否能听懂我们想找什么?又如何感知我们的情绪,旅行者号的解决方案是给了操作说明,然后多种声音模式等。其实我们用RAG搞知识库也可以这么搞,精准的控制切片信息和给AI一个操作手册。总比叫外星人听懂地球语言(自己训练模型)要省事儿很多。逻辑上来说,我们希望AI在工作中如实的向我们反馈信息,而知识库作为必要的验证过程,也有不可或…- 0

- 0

-

谷歌WebMCP 现已推出抢先预览版

网站以后不止给人看,还得给 智能体用和看。Google 推动 W3C 生态里的 WebMCP,Chrome 也已经放出预览版。以前 Agent 想操作网站,基本只能走 UI 路线:模拟点按钮、填表单、读 DOM,非常慢,还很费 token。WebMCP 想做的是让网站直接声明“我提供哪些能力”,把动作变成结构化的 tools,让 Agent 直接调用。谁先把 WebMCP 的工具层设计好,谁就先吃…- 0

- 0

-

RAG不会过时,但你需要这10个上下文处理技巧|Context Engineering系列一

RAG效果不及预期,试试这10个上下文处理优化技巧 对大部分开发者来说,搭一个RAG或者Agent不难,怎么把它优化成生产可用的状态最难。 在这个过程中,检索效率、准确性、成本、响应速度,都是重点关注问题。 那么,如何对其进行优化?业内一致看好Context Engineering也就是上下文工程。 本系列文章,将从上下文工程的不同环节(上下文处理与生成、上下文处理、上下文管理)最新的行业探索与进…- 0

- 0

-

龙虾养成日记PPT看不过瘾?内部版逐字稿来了

春节14天,1157条消息,22万字对话——我从零养了一只AI龙虾。到第14天,它变成了一支8个Agent的团队,7×24小时自动运转。后来做了一场直播,全网超20万观看,新增关注超过99.99%同类主播。没抽奖没福利,观众平均看了22分钟。为什么这么多人想看?我觉得原因很简单:大家都知道AI是一次特别重要的革命,但不太相信,或者说不知道到底能做成啥样,因为它太新了。而我是自己身体力行去验证的——…- 0

- 0

-

深度解析 RAG 索引:决定检索质量的核心机制与六大策略

检索增强生成(RAG)技术正在重塑大语言模型(LLM)获取外部知识的方式。然而,在实际开发中,许多工程师往往过度关注“检索(Retrieval)”环节,而忽视了更为基础的“索引(Indexing)”设计。本文将深入探讨 RAG 索引的本质,指出索引与检索的区别,并结合代码示例,详细解析六种在生产环境中被验证有效的索引策略,旨在帮助开发者构建更精准、低幻觉的语义推理系统。一、 什么是 RAG 索引?…- 0

- 0

-

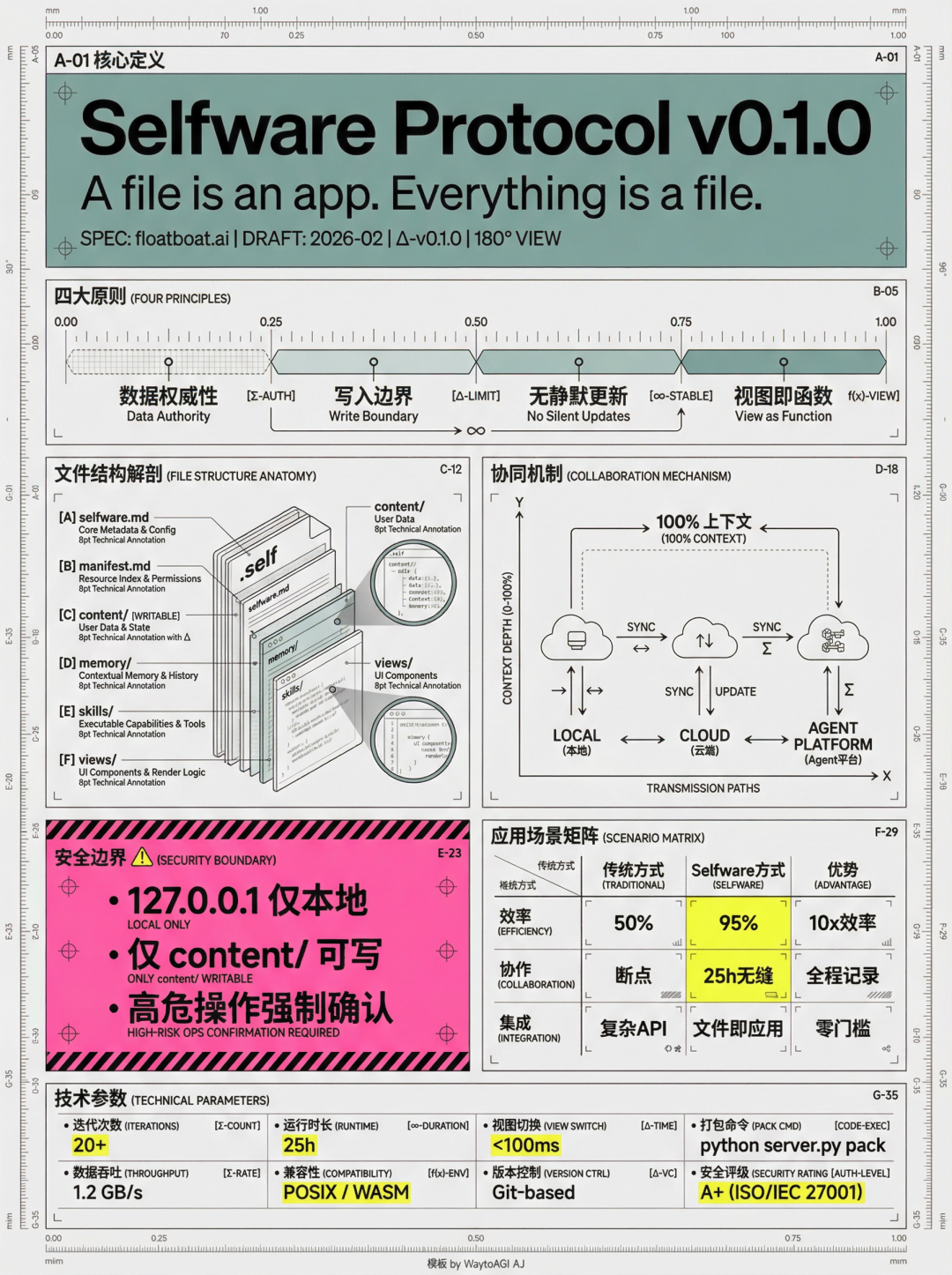

属于Agent的文件协议来了!Selfware让Agent之间无缝传递上下文

2月26日晚8点,WaytoAGI 共学邀请来了 floatboat.ai 的创始人少卿和架构师 Remy。少卿是社区老朋友,做过「出国点餐一条龙」,这次带来了一个叫 Selfware 的开放协议,专门解决 Agent 之间上下文传递的问题。直播里有个细节挺有意思。AJ 说她前一天晚上试了一下,一开始完全看不懂这是什么,但让 Claude Code 跑了一遍之后,立刻…- 0

- 0

-

RAG 知识库的四个段位

有个哥们跟我吐槽说公司花了200万搞的AI客服系统,客户问"你们产品有什么优势",回答居然说"我觉得一般般"。这让我想起了最近在技术圈热议的话题:RAG技术到底该怎么选?说白了,RAG就是让AI从"闭卷考试"变成"开卷考试"。但这个"开卷考试"可不简单,里面的门道多着呢。RAG不是万能药,但没它万万…- 0

- 0

-

对话 PallasAI:行业对 GEO 的理解都是错误的,我们想重新定义 GEO

三个月内,PallasAI 获得了两笔投资,目前累计融资超千万人民币。PallasAI,也是市场上首款提供标准化服务的 GEO AI Agent。在创始人 Ethan 看来,GEO 并不是简单的面向 AI 的 SEO,「到底怎么样让 AI 更全面地理解你?这才是做 GEO 的本质。」也正因此,传统 SEO 时代很多围绕关键词的打法,在 GEO 时代是完全失效的。套用关键词的逻辑去堆砌和优化 pro…- 0

- 0

-

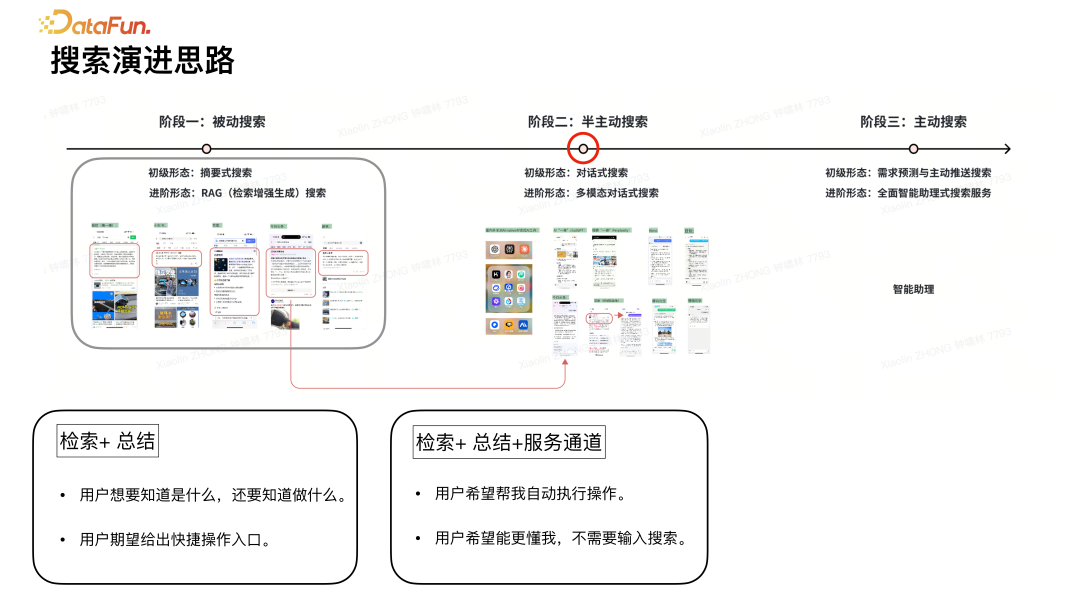

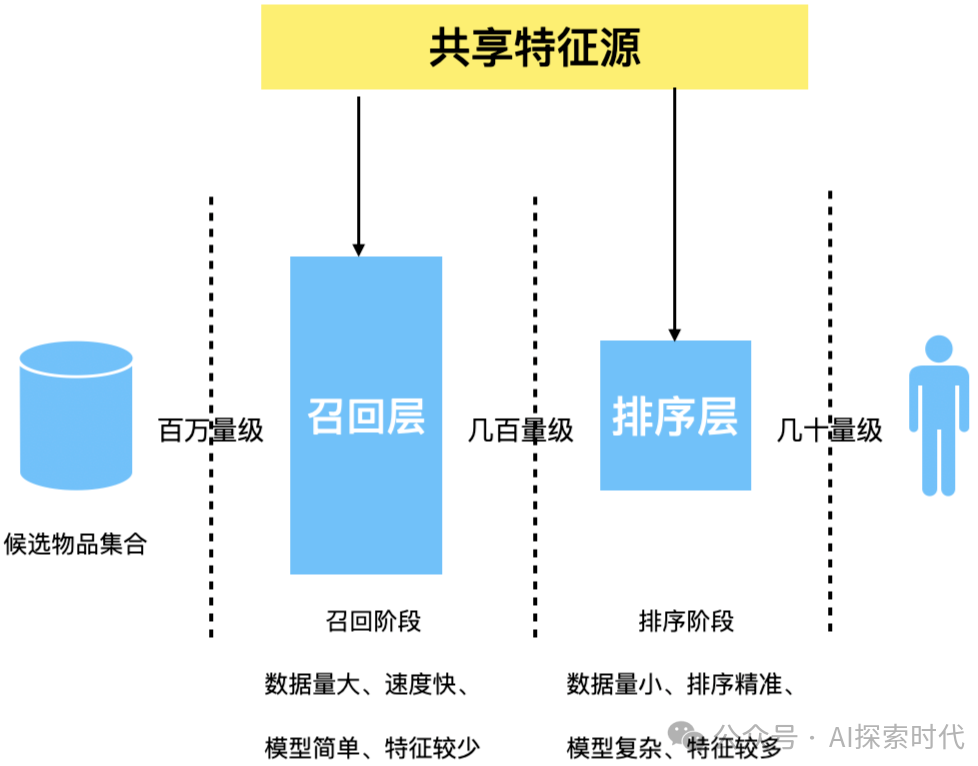

基于 RAG 的 AI 搜索技术实践

导读 本文介绍了基于 RAG 的 AI 搜索技术实践。今天分享主要包含三部分:1. 搜索演进思路2. 关键技术落地实践:重点阐述技术点的实际落地方式3. 总结展望补充说明:安全合规部分会简要提及,因敏感性不纳入 PPT 总结。分享嘉宾|钟啸林 NIO(蔚来汽车) 搜推算法负责人编辑整理|陈锡杜内容校对|郭慧敏出品社区|DataFun01搜索演进思路1.&nb…- 0

- 0

-

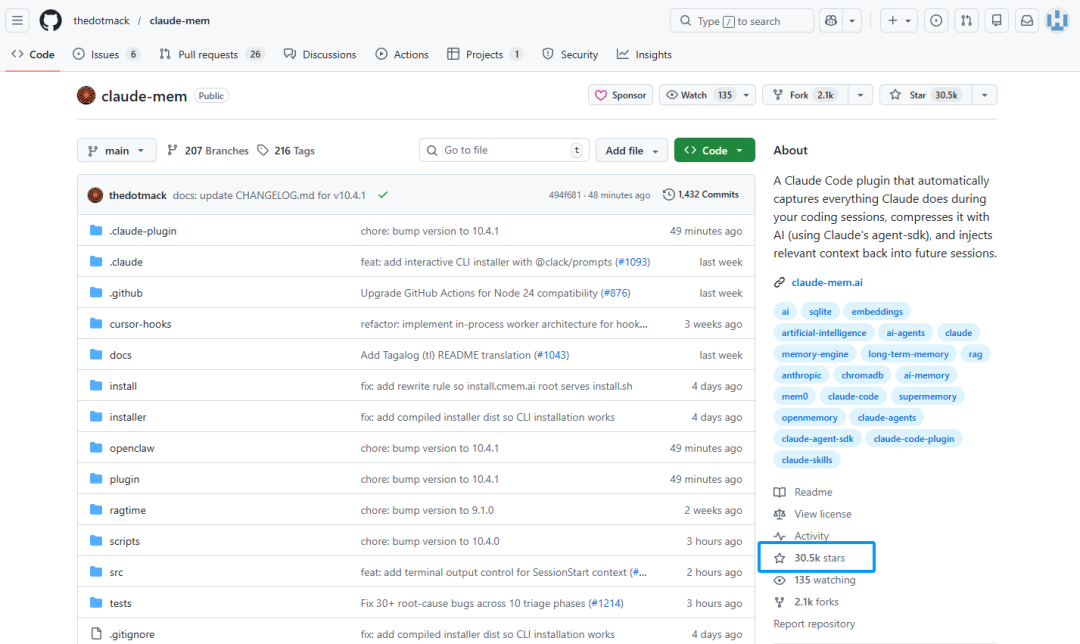

斩获30.5k Star!Claude Code长期记忆插件Claude-Mem开源,实现跨会话上下文无缝保留

重度依赖 Claude Code 等编程智能体的开发者,大多都在为一个绕不开的痛点而抓狂:AI助手总是“阅后即焚”,跨会话失忆严重。每次开启一个新的会话, Claude Code 就像一张白纸。昨天刚敲定的架构设计、上周踩过的 API 坑、团队的代码规范,它统统不记得了。于是只好从头复制粘贴历史上下文、重复解释需求。这不仅浪费了大量开发时间,更是在无形中白白烧掉了大量的 Tok…- 0

- 0

-

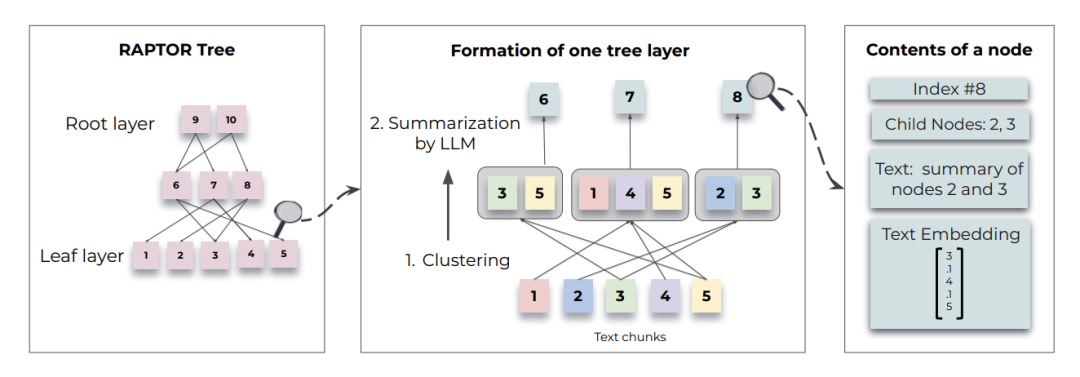

深入探索RAPTOR:构建知识森林,突破RAG语义检索瓶颈的技术解析

一、传统检索的痛点现有检索系统(如BM25或向量库)往往存在两大短板:信息碎片化:仅返回孤立文本片段,割裂整体逻辑上下文缺失:难以理解文档的层次结构与宏观主题当传统检索还在“关键词匹配”的平原上徘徊时,RAPTOR已带我们登上语义理解的树冠层。这片由斯坦福培育的“知识森林”,正为LLM注入真正的理解力——未来已来,只是尚未均匀分布。二、RAPTOR的森林建造术RAPTOR通过构建语义摘要树解决上述…- 0

- 0

-

智能体技能构建手册:让AI真正"动手"的模块化艺术

—— 从插件思维到生产级技能,一份工程师必备的实战指南🎯 智能体(Agent)的能力边界,不取决于它有多"聪明",而取决于它拥有多少可靠、可复用、可组合的技能(Skills)模块。一、什么是"智能体技能"?想象一下:你的AI智能体是一位全能管家。但它不会凭空变出能力——它需要"工具包"。技能(Skill),就是这样一个即插即用的能力单元:…- 0

- 0

-

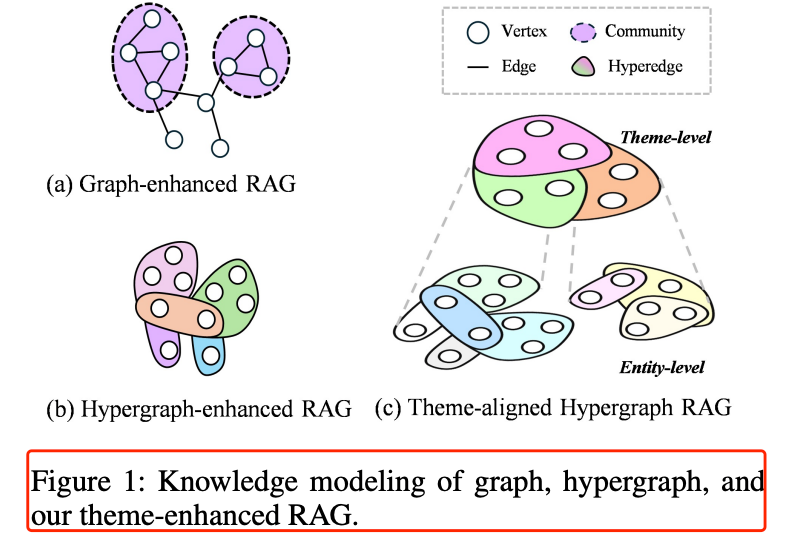

AAAI-26 | Cog-RAG:用双超图,重构RAG的认知流程

Cog-RAG: Cognitive-Inspired Dual-Hypergraph with Theme Alignment Retrieval-Augmented Generation 西交、清华、西电联合团队 https://arxiv.org/pdf/2511.13201一、当 RAG 陷入“实体孤岛”Retrieval-Augmented Generation(R…- 0

- 0

-

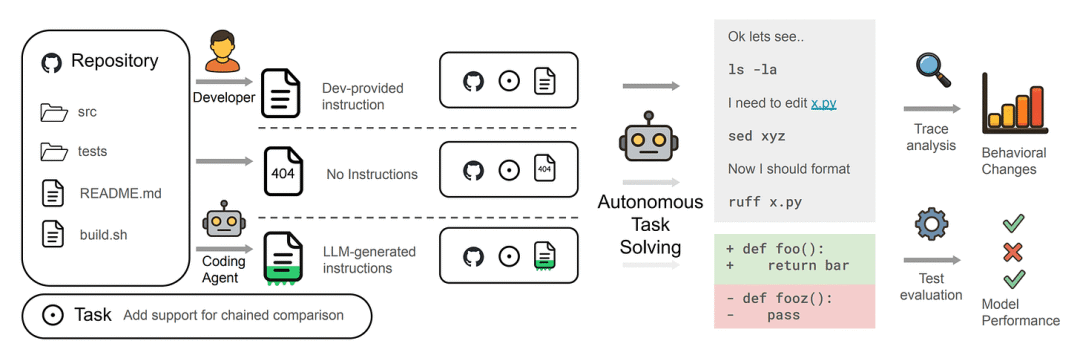

AGENTS.md 真的能帮助编码智能体吗?

我现在运行的每个重要编码项目,根目录下都有一个 CLAUDE.md 或 AgentS.md 文件。它告诉智能体应该运行哪些命令、遵循哪些规范、以及哪些文件需要避开。和许多 AI 工程师一样,我一直认为这能让智能体表现更好。大多数使用编码智能体进行构建的人都持有同样的假设。苏黎世联邦理工学院(ETH Zurich)SRI 实验室的一篇新论文对这一假设进行了严格检验。简短的答案是:情况比较复杂,如果你…- 0

- 0

-

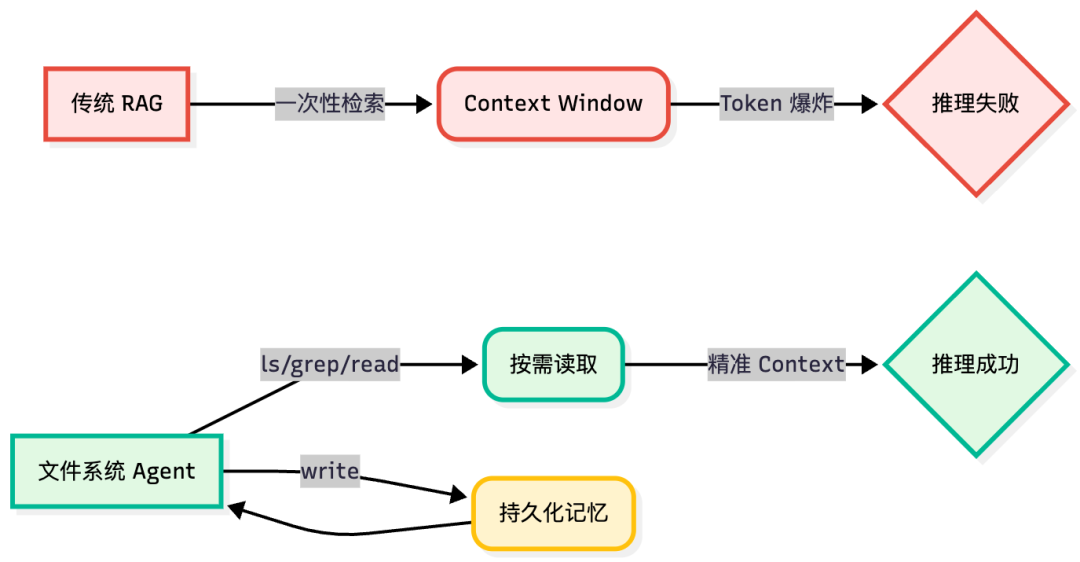

涌现观点|从 RAG 到文件系统:Agent 记忆的“逆向进化”

unsetunset困在“上下文迷雾”中的巨兽unsetunset上周五下午,我盯着屏幕上的一个数据,愣了足足十秒。一份 EMNLP 的报告给了我当头一棒:即使你的检索准确率是 100%,一旦上下文超过 30,000 个 Token,推理准确率就会出现断崖式下跌,跌幅最高可达 85%。我感觉像被谁打了一拳。我们一直以为,给 Agent 喂越多的数据,它就越聪明。但这就像给一个正在做微积分的学生,塞…- 0

- 0

-

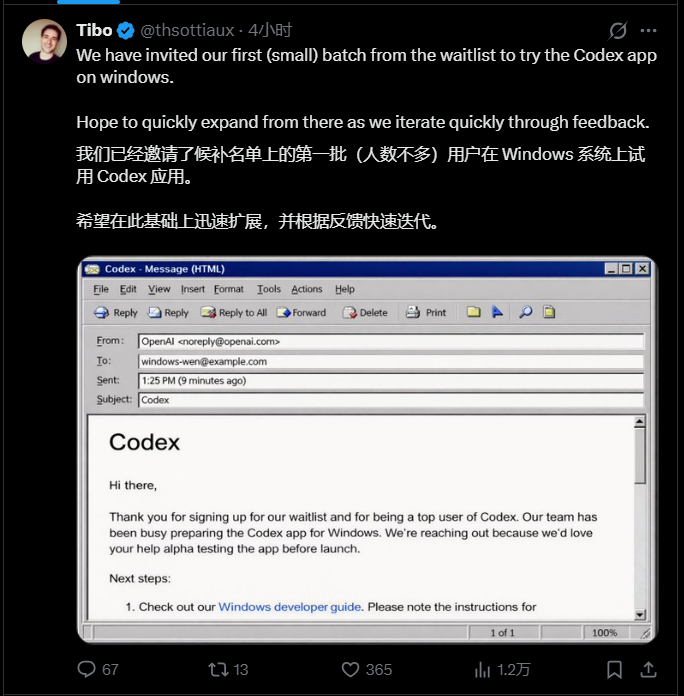

Codex负责人自曝OpenAI内部开发:每周都在重塑!Codex已经化成队友,可通宵运行、自我测试!新人建议:基础永不过时;win版本将上线

“未来某个时间点,也许我们会为Agent构建软件。那时候,Agent可能会成为产品经理或产品工程师。”昨天,OpenAI Codex 工程主管 Tibo Sottiaux 和 OpenAI 应用首席技术官 Vijaye Raji 做客 Pragmatic Summit,对外分享了 OpenAI 内部工程师的真实体感和感受。回顾过去的 2025年, Tibo 表示变化程度可以用“震撼”来形容。哪怕只…- 0

- 0

-

RAG的进化之路:从DrQA流水线到LLM的即时上下文服务

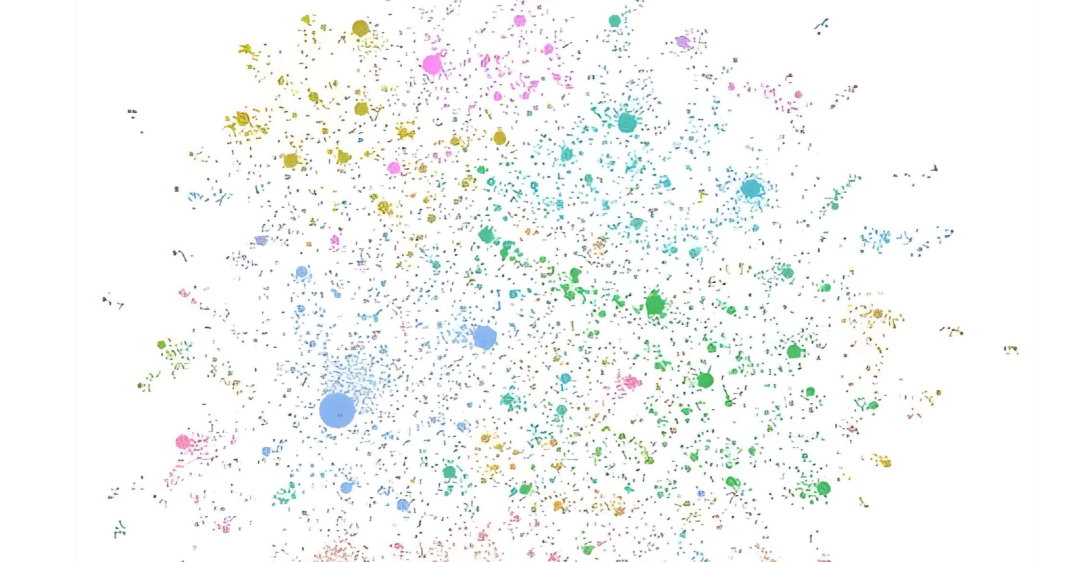

一、RAG的本质:参数记忆与外部知识的协同艺术检索增强生成(RAG)看似简单——“给定问题,获取相关文档,让模型基于文档作答”,但这背后藏着近十年自然语言处理(NLP)领域在检索、知识表示与模型注入上的持续迭代。其核心是打通两种记忆:参数记忆:存储在模型权重中的通用知识(如语言规律、常识);非参数记忆:外部知识库(数据库、维基百科、PDF、工单、代码等)中的专属信息。从技术逻辑来看,RAG系统的核…- 1

- 0

-

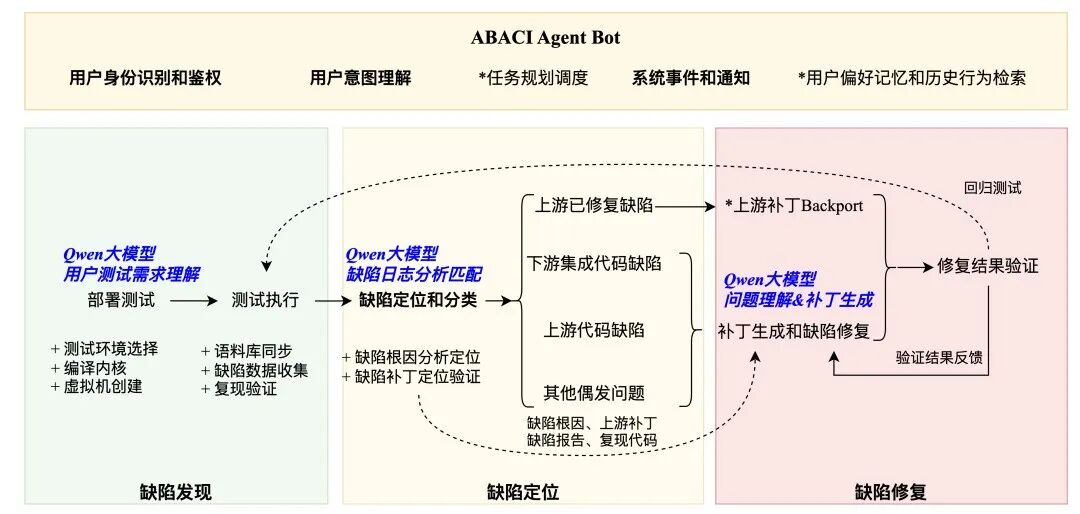

ABACI内核缺陷智能体:让模糊测试真正“自动化”

本文介绍了ABACI内核缺陷智能体如何通过自动化技术改进Linux内核的测试、分析和修复过程。一、内核缺陷智能体:测试-分析-修复全链路自动化传统的测试手段,如单元测试、静态分析和人工代码审查,面对Linux内核这样千万行级别的庞大代码库时显得力不从心。尤其是在新内核版本频繁迭代的背景下,它们要么覆盖率不足,难以触及深层路径;要么误报率高,消耗大量人力进行验证。如何在短时间内高效、系统地发现和处理…- 0

- 0

-

RAG知识库迎来大洗牌:GraphRAG如何让机器真正读懂世界?

昨晚和技术团队复盘项目时,大家的一致感受是:传统RAG系统已经走到了尽头。我们花了大半年时间搭建的企业知识问答系统,本以为能解决复杂查询问题,结果用户体验却越来越糟糕。用户问一个稍微复杂的问题,系统就开始胡言乱语,答案支离破碎,根本无法形成完整的逻辑链条。这让我突然意识到一个问题:传统RAG本质上就是个高级搜索工具,就像在图书馆里疯狂翻书找关键词,却永远无法理解书籍背后的深层逻辑。直到GraphR…- 0

- 0

-

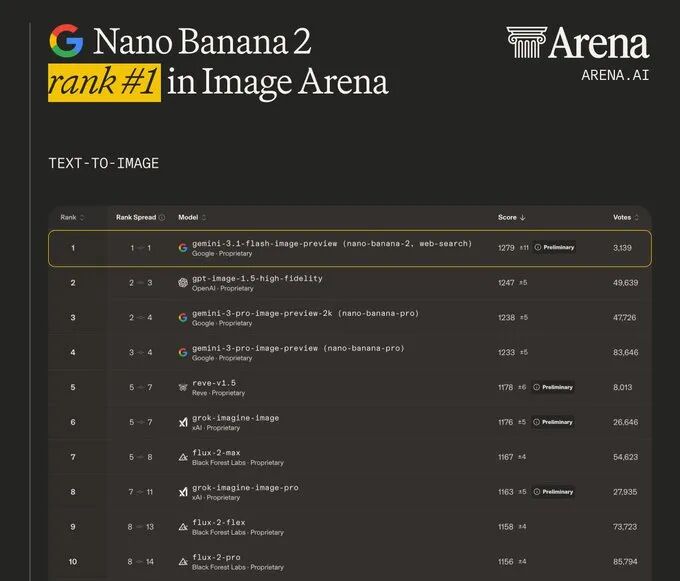

谷歌 Nano Banana 2 凌晨突袭!生图速度飙升,价格直接腰斩,Pro 功能竟然也免费了?

我们这边才开工,谷歌就悄悄放了个大招:Nano Banana 2 (NB2) 正式上线了。Nano Banana 2 已经在人工智能图像分析领域的文本转图像类别中排名第一!换句话说,它就是 AI 图像的新王。图:Nano Banana 2 登顶文生图第一那么这个新版本到底有什么亮点?我做了一晚的测评,一起来看看。Lovart 已经第一时间接入了 Nano Banana 2,我有一些例子是通过 Lo…- 0

- 0

-

RAG数据召回优化方案——先进行标量召回再进行相似度召回

“ RAG召回时最好进行多次过滤,这样才能大大提升召回文档的质量。”关于RAG数据召回技术,大家都都知道现在普遍使用的是相似度(语义)召回方式;但对没有真正实际操作过的人来说,可能会认为RAG只能进行相似度召回;但在真正的业务场景中,标量召回的效果可能会比相似度召回更好。原因在于,RAG的目的是为了更准确的召回与问题相关的内容,但并没有限制具体的召回方式,不论是传统的字符匹配,分词技术(…- 0

- 0

-

为什么 AI 的性价比极高,却只能卖到“奶茶价”

有朋友反馈希望聊聊AI产品交易问题,目前的AI应用chatbot、智能搜索、openclaw这种自主决策的bot调度应用,都还是体验大于价值。很简单,你在多大程度上愿意完全委托任务给他,这个就是临界点,AI coding、AI for software engineering正在经历这样的递进。因为目前 AI 的价值锚点是“可替代的个人体验”,而不是“不可替代的社会角色”对用户来说:奶茶 = 情绪…- 0

- 0

❯

购物车

优惠劵

搜索

扫码打开当前页

联系我们

返回顶部

幸运之星正在降临...

点击领取今天的签到奖励!

恭喜!您今天获得了{{mission.data.mission.credit}}积分

我的优惠劵

-

¥优惠劵使用时效:无法使用使用时效:

之前

使用时效:永久有效优惠劵ID:×

没有优惠劵可用!