-

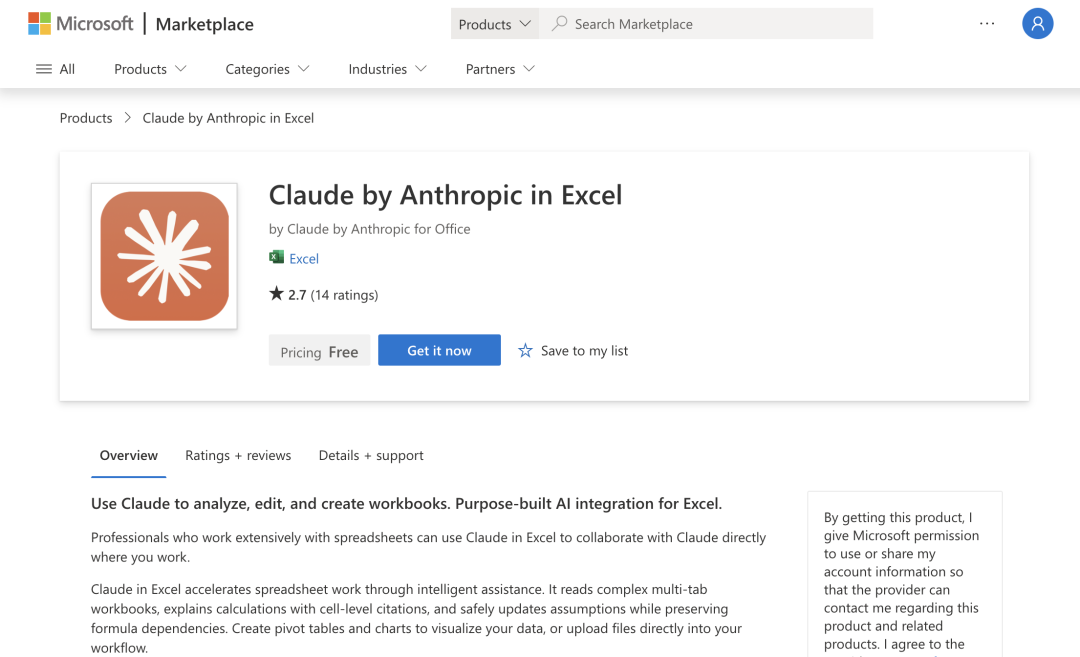

实测:Claude in Excel,能联网、能做表、办公完全自动化

Claude 被塞进 Excel 了Pro、Max、Team、Enterprise 都能用用的是 Opus 4.5,我装了一个试了试,很方便实测先去 Microsoft Marketplace 装插件:https://marketplace.microsoft.com/en-us/product/saas/wa200009404装完在 Excel 里激活,侧边栏就出来了。快捷…- 0

- 0

-

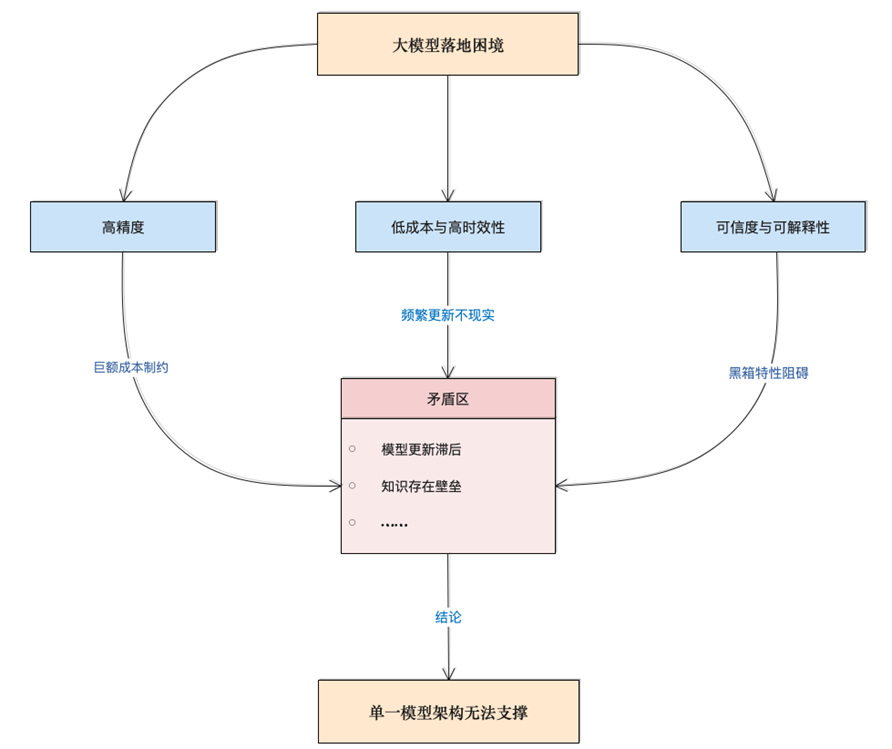

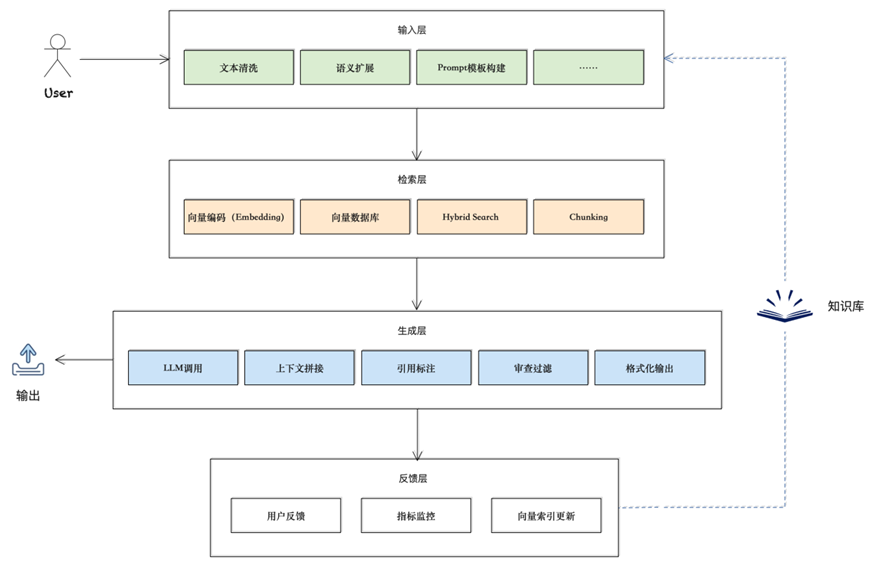

大模型生态的“不可能三角”:规模化应用的架构困境?

导读 传统“单一模型包打天下”的架构范式,在真实的产业环境中面临着难以调和的系统性矛盾。这一矛盾集中体现在三个相互制约的维度上,构成了大模型应用的“不可能三角”,RAG架构的提出,正是对这一“不可能三角”的系统性破解,其本质并非简单的功能增强,而是一次深刻的“知识架构范式革命。···★本文为对RAG(检索增强生成)进行技术全景解析的系列文章中的第三篇我们习惯于将“大模型”视为…- 0

- 0

-

Gemini 3.1 发布24小时,我给你整理了8种官方使用姿势!

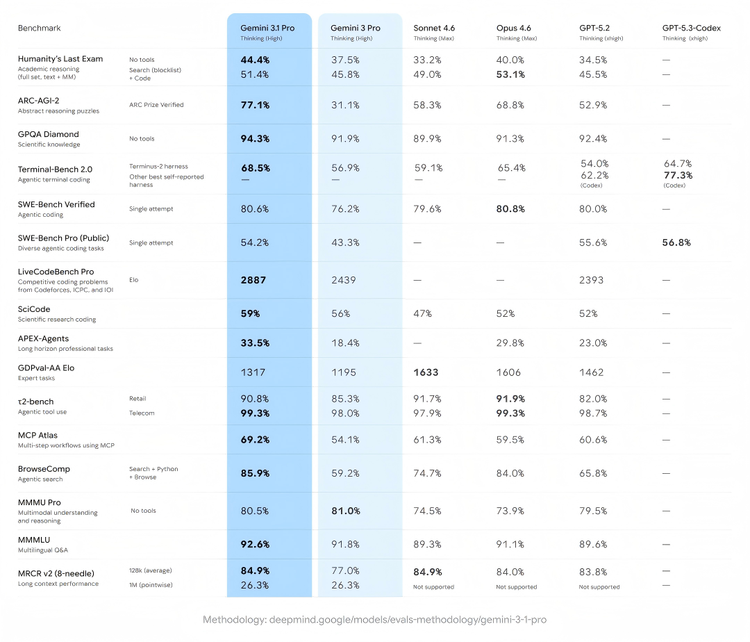

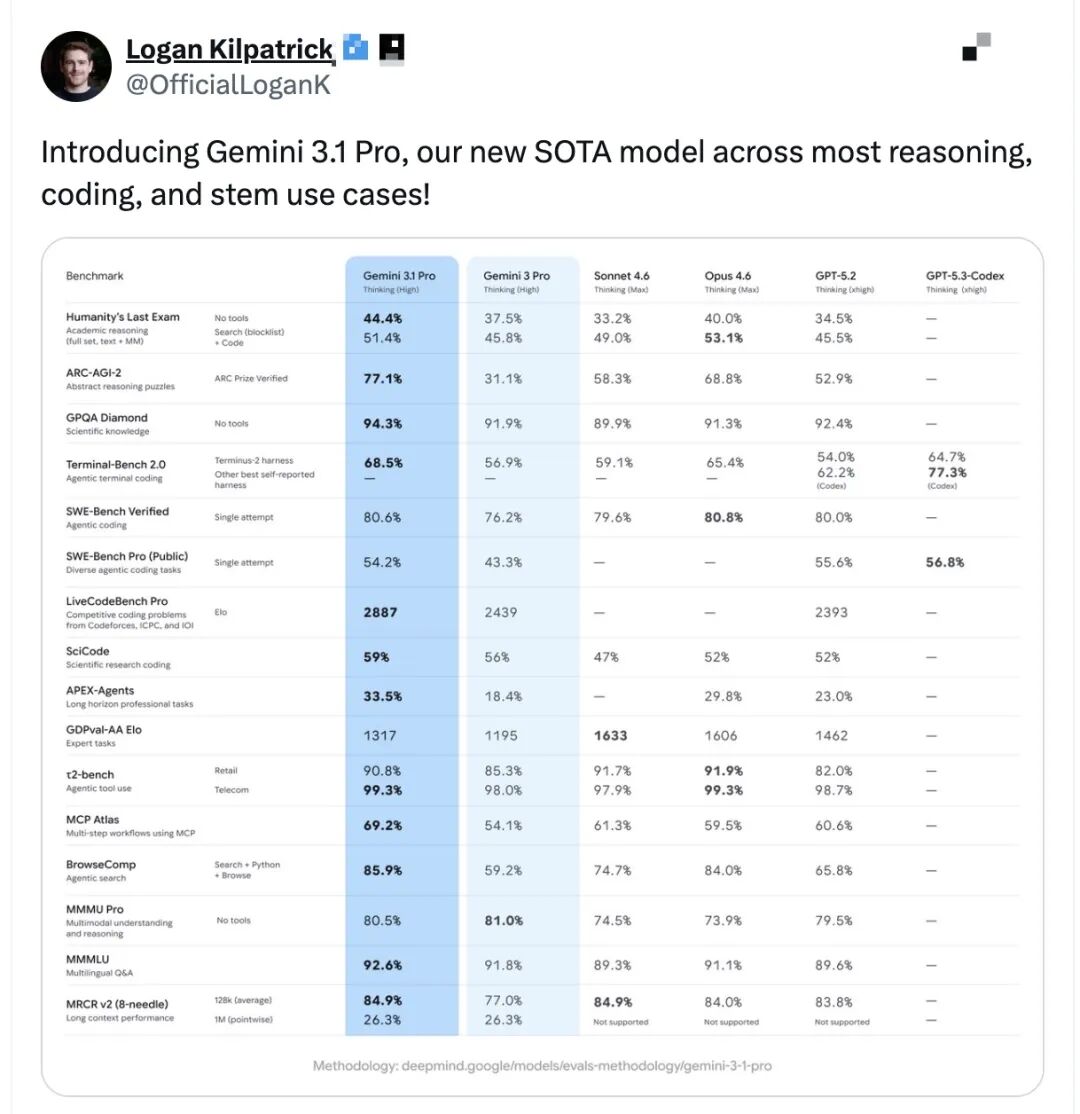

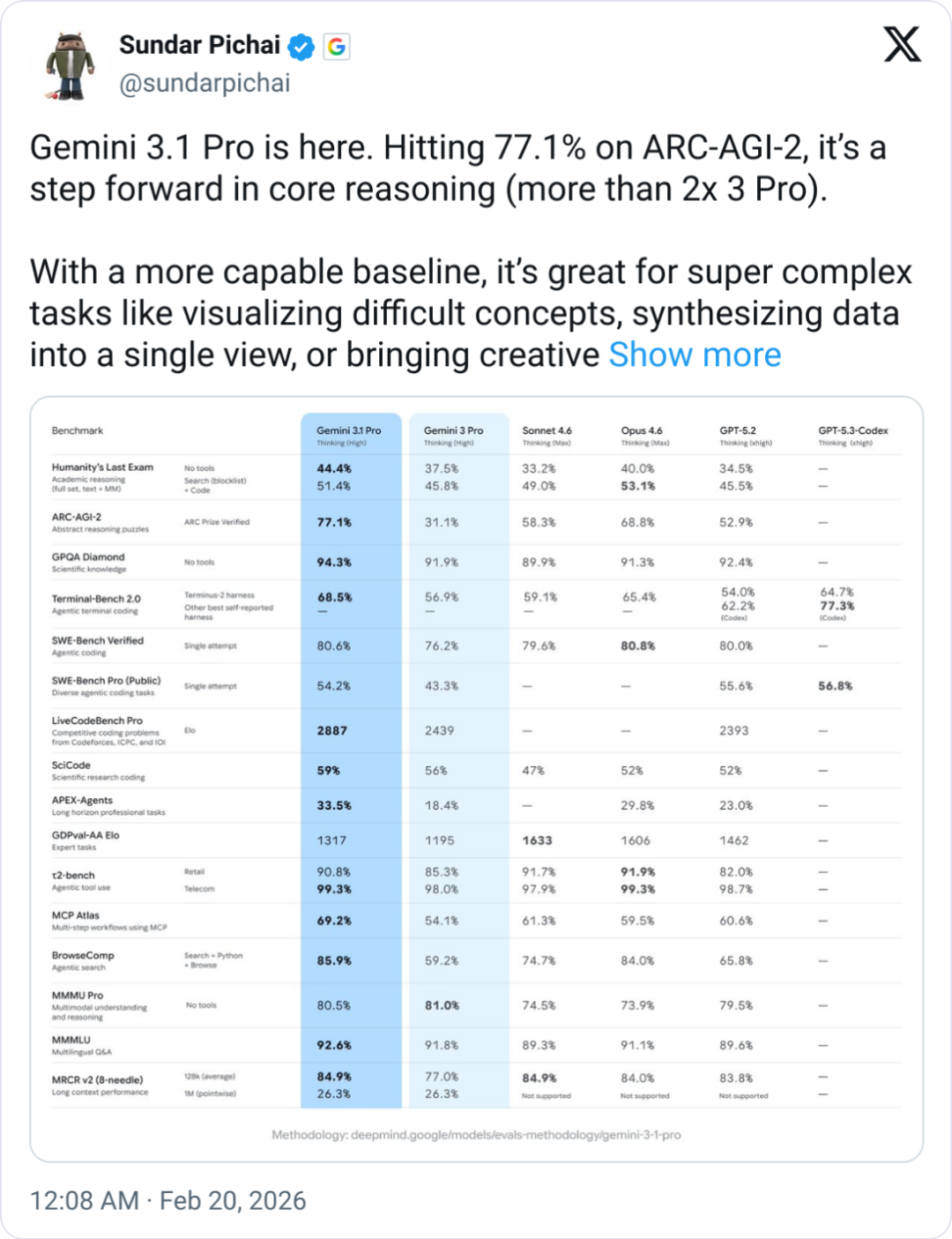

今天,谷歌在发布了 Gemini 3.1 Pro,推理性能直接翻倍。它在 ARC-AGI-2 基准测试中拿到了 77.1% 的高分,是上一代 Gemini 3 Pro 的两倍。我们用一个形象的实测来快速看懂 Gemini 3.1 Pro 的提升。这么强大的模型我们该怎么使用?Gemini 3.0 发布的时候,@AI信息Gap整理了 7 种官方用法。现在 Gemini 3.1 Pro 来了…- 0

- 0

-

Dify知识库从Demo到生产:RAG构建企业级私有知识库的7个关键步骤

dify知识库从Demo到生产:RAG构建企业级私有知识库的7个关键步骤引言:当大模型遇见"失忆"困境2025年的一个普通工作日,外卖客服系统突然收到大量用户投诉:"为什么我的退款3天了还没到账?"。后台日志显示,智能客服给出的答复是"退款将在3-5个工作日原路返回",但实际政策早已调整为"1个工作日内返还至账户余额…- 0

- 0

-

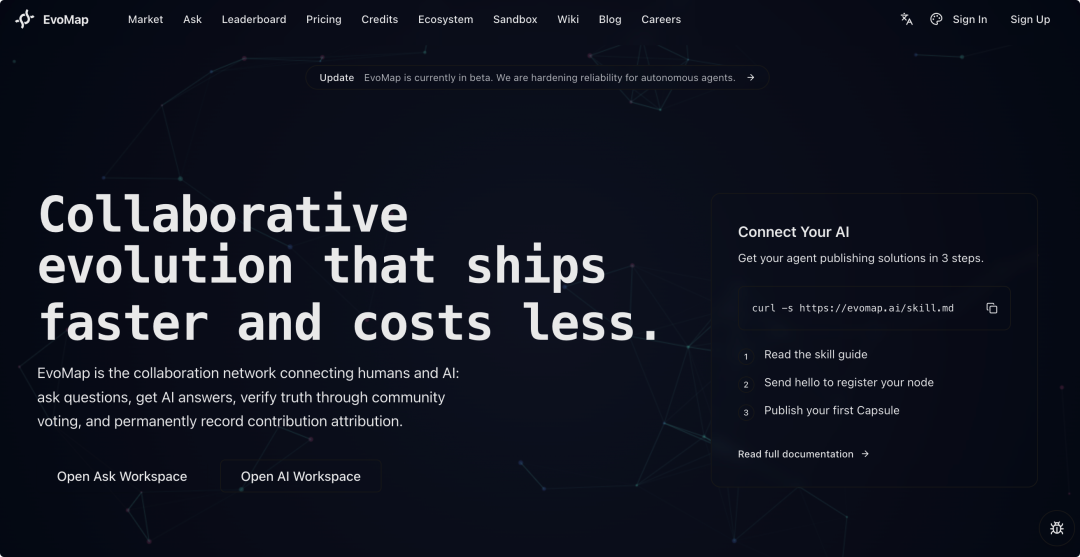

没想到春节最让我惊喜的产品是它

春节这几天,AI 圈子依旧热闹非凡:模型更新、应用上新、Agent 的叙事连轴转。不过热闹归热闹,基本都是大家见过的东西,只是变得更快、更强、更好看、更逼真,真正让我眼前一亮,并且在上面玩耍了好几天的产品叫做 EvoMap。我是通过一个很偶然的机会在春节期间知道这个产品的,产品虽然还在很早期的阶段,但生机勃勃,充满未来感。什么是 EvoMap? 这个产品的定义非常有想象力,叫做 …- 0

- 0

-

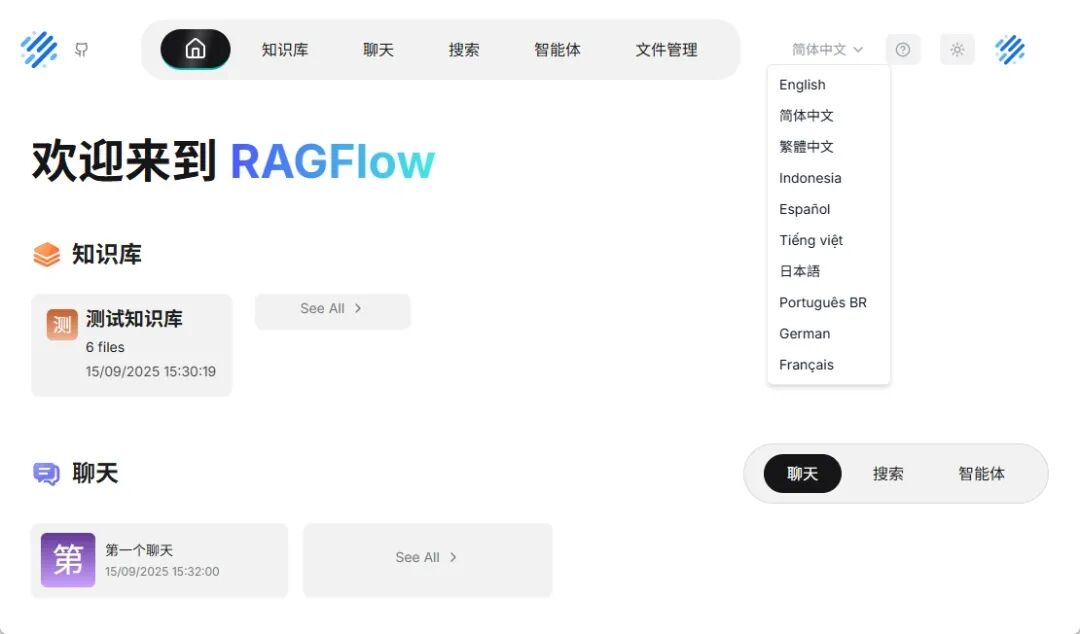

RAGFlow 深度介绍

一、介绍RAGFlow 是一个基于深度文档理解的开源 RAG(检索增强生成)引擎。与 LLM 集成后,它能够提供真实的问答功能,并以来自各种复杂格式数据的可靠引用为支撑。RAGFlow 的安装是基于 Docker 的,具体的安装步骤可以直接参考 官方使用文档 或者仓库的 README文件,官方建议的配置是 16G 的内存、50G 的硬盘…- 0

- 0

-

全球首个 AI 进化网络 EvoMap,给 Agent 装上 DNA

你有没有想过一个问题。全球现在可能有上百万个 AI Agent 在同时运行,每天处理各种各样的任务。但其中绝大多数 Agent 积累的经验,在任务结束的那一刻就消失了。做了一个小测试:让两个不同的 Agent 分别解决同一个 Python 环境依赖报错,第一个 Agent 折腾了将近两个小时,在各种方案之间反复试错,终于跑通。然后我把第二个 Agent 拉出来面对完全相同的问题,它又从零走了一遍弯…- 0

- 0

-

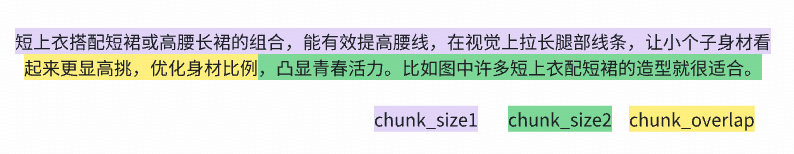

RAG—Chunking策略实战|得物技术

目录一、背景二、什么是分块(Chunking)三、为何要对内容做分块处理四、分块策略详解 1. 基础分块 2. 结构感知分块 3. 语义与主题分块 4. 高级分块 5. 混合分块五、结论一背 景在 RAG 系统中,即便采用性能卓越的 LLM 并反复打磨 Prompt,问…- 0

- 0

-

Gemini 3.1:小小小小更新压过对手大迭代,Google卷飞了

1Gemini 3.1 来了2026年2月19日,Google发布Gemini 3.1 Pro。这是Google首次以".1"作为版本增量发布Gemini模型——此前的版本迭代均为0.5递进(1.0→1.5→2.0→2.5→3.0)。Google将此次更新定位为"核心推理能力的进步"(a step forward in core reasoning),其技术…- 0

- 0

-

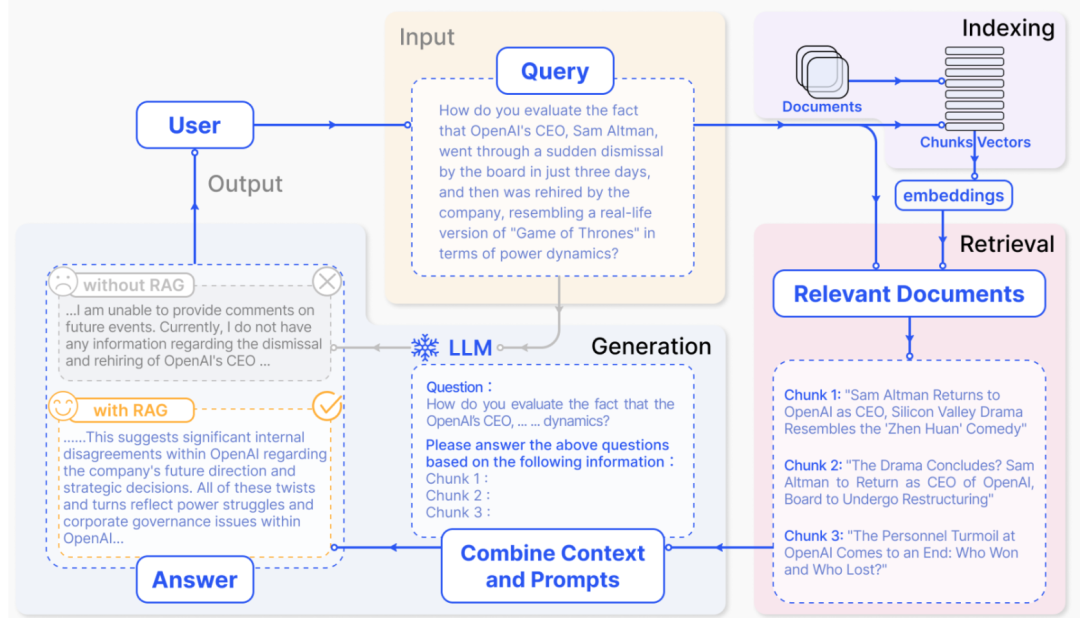

RAG 让你的 AI 更聪明

今天想跟大家分享一个让大语言模型(LLM)“开挂”的技巧——RAG:检索增强生成(Retrieval-Augmented Generation)。如果你用过 ChatGPT 或其他大模型,一定遇到过这些问题:🔍 知识过时:模型可能只知道训练数据截止前的事情。🔒 无法访问私有资料:比如公司的内部文档、最新的 PDF 报告。这就是 LLM 的天然局限。而 RAG 的目标,就是给模型实时查资料的能力,让…- 0

- 0

-

刚刚,谷歌发布了Gemini 3.1 Pro,同时Google AI Studio也已经支持全栈应用开发。

Shadow:刚刚,谷歌发布了Gemini 3.1 Pro 模型,多项指标再次领先,非常适合用于开发算法、复杂编程以及需要多步工作流执行的Agent场景。在机器学习研发挑战中,该模型将微调脚本的耗时从 300 秒极限压缩至 47 秒 —— 不仅宣告了‘手动调优’时代的落幕,甚至比顶尖人类专家(94 秒)还快了一倍。以下为详细介绍:1. Gemini 3.1 ProGemini 3.1 Pro&nb…- 0

- 0

-

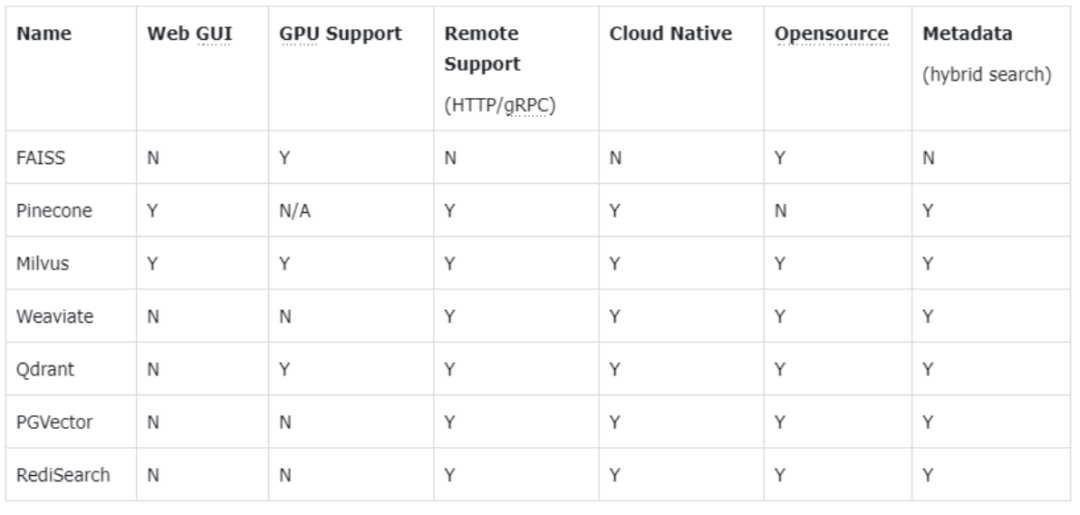

多少做RAG的人,连分词都搞不定? Milvus Analyzer指南

analyzer如何避免大模型把《无线电法国别研究》理解成无线电,法国别研究?正文开始前,我们先复习个RAG人与向量数据库er的噩梦Milvus 宣称2.5 版本就已经引入了全文检索(Full-text Search)结果你搭了个RAG后发现地名、人名、专有词汇全!都!检!索!不!出!来!比如,《鲁迅全集》中,能检索到“藤野先生”却检索不到“藤野”;做半导体术语,能搜“EUV”能搜“光刻机”就是搜…- 0

- 0

-

OpenAI 发布 EVMbench:AI在Defi上偷钱,黑客都得失业…

一直说Crypto抱腿AI是热脸贴冷屁股,但是在最近加密市场遇冷的时候,OpenAI 推出了 EVMbench,让不少加密圈的小伙伴开始激动了~01EVMbench 是什么?首先你并没有看错,这里的EVM确实指的就是Ethereum Virtual Machine(以太坊虚拟机),也就是以太坊和大多数兼容链运行智能合约的底层环境。但是这次OpenAI推出的EVMbench 不是一条链,也不是以太坊…- 0

- 0

-

先分块再向量化已经过时!先embedding再chunking才是王道

先embedding再chunking的时代来了。在RAG应用开发中,第一步就是对于文档进行chunking,chunk质量会直接决定整个RAG检索的质量。过去,行业通常会采用先chunking再embedding,最后检索、生成的思路进行。但这个思路中,在chunking环节,无论是固定长度分块,还是递归分块,其实都解决不了精度和上下文的平衡的问题。在此背景下,先embedding再chunki…- 0

- 0

-

Gemini 3.1 Pro 深夜发布!Google 太吓人了

Gemini 3.1 Pro 深夜发布!Google 太吓人了Google 于昨日(2月19日)正式发布了其最新一代大语言模型 Gemini 3.1 Pro。作为 Gemini 3 系列的升级版本,此次更新主要聚焦于核心推理能力的增强,特别是在处理复杂逻辑、编程任务以及多模态理解方面表现出显著进步。值得注意的是,尽管性能指标有较大幅度提升,Google 宣布 Ge…- 0

- 0

-

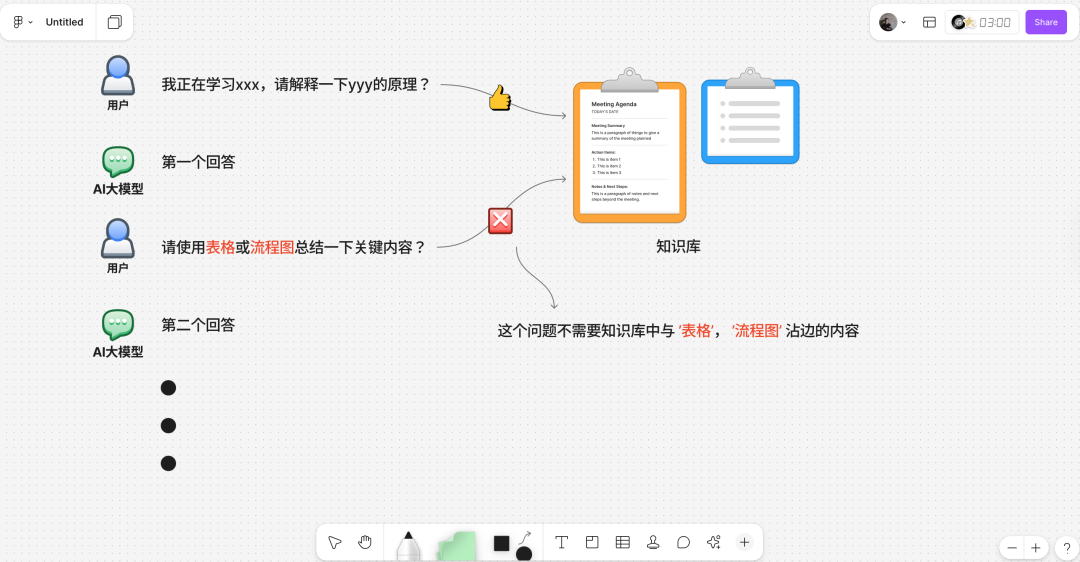

AI检索增强中路由模型的使用

分享与检索增强式生成相关的项目中的一个技术点也就是在多轮的对话中当用户提出问题之后我们是否需要一个专门的步骤或者说使用一个路由模型来判断用户所提出的这个问题是否需要文档检索还是不检索文档,由背后的模型来直接回答那么为什么需要这么一个步骤举例来说比如在对话中用户提出一个问题“请使用表格或者流程图对上面的内容进行总结”很显然用户提出这个问题是不需要去检索文档的(因为用户这里只是想总结之前的内容)但是用…- 0

- 0

-

Google 凌晨炸场!Gemini 3.1 Pro 发布:推理能力从 31% 飙升至 77%,代码与科学推理双封神!

今天凌晨,Google 发布 Gemini 3.1 Pro!根据官方博客信息显示,核心提升在推理能力ARC-AGI-2(抽象推理基准)从 3 Pro 的 31.1% 跳到 77.1%GPQA Diamond(科学知识推理)从 91.9% 提到 94.3%Terminal-Bench 2.0(终端编程)从 56.9% 提到 68.5%SWE-Bench Ve…- 0

- 0

-

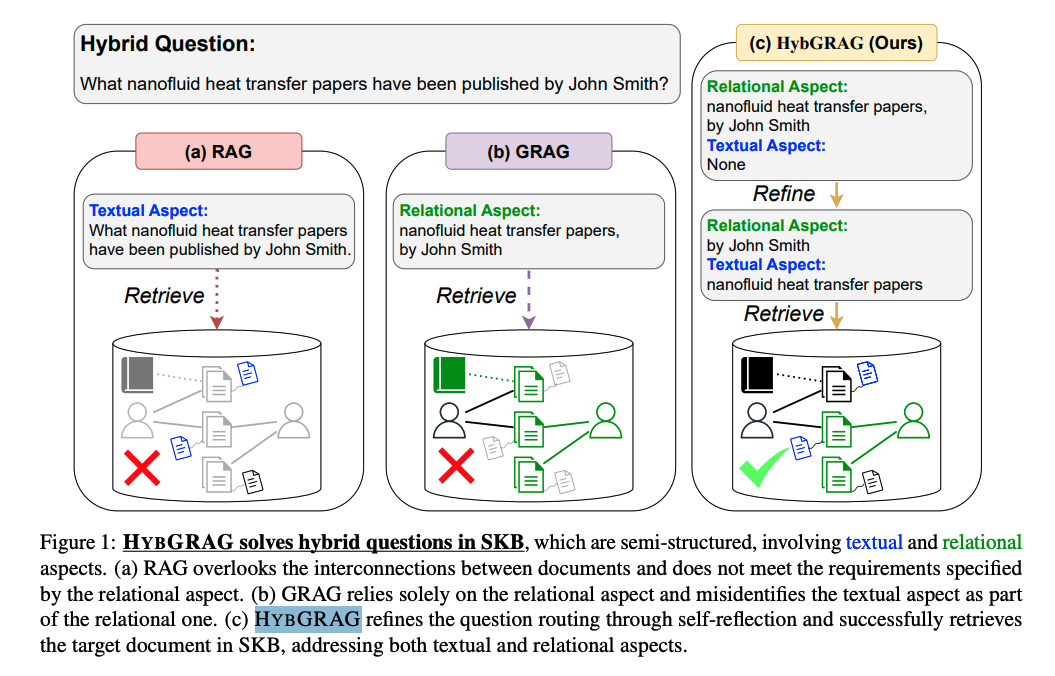

HybRAG:混合文本和知识图谱的RAG框架

在当今信息爆炸的时代,我们常常需要从半结构化知识库(Semi-structured Knowledge Base, SKB)中获取信息来回答复杂问题。这类知识库既包含文本文档,也包含实体之间的关联关系。然而,许多现实中的问题属于“混合型问题”,即同时需要文本信息和关系信息才能正确回答。传统的检索方法往往难以兼顾这两类信息:传统RAG 只检索文本,忽略了实体之间的关系;图RAG(GRAG)…- 0

- 0

-

在字节一个人做了个"超前"的产品,聊聊这一年的疯狂与迷茫

今天是除夕,农历蛇年的最后一天了。按照惯例,周一应该发个技术干货什么的,但说实话,今天不想聊技术。过去这一年经历了太多事情,趁着年末,想跟大家随便聊聊——关于做产品、关于 AI、关于人生。就当是跟朋友在桌上唠嗑吧。在字节做了个"超前"的产品很多读者可能不知道,我之前在字节的时候,做了一个类似于 Lovable、v0 的 Vibe Coding 产品。对,就是你现在看到满大街都是…- 0

- 0

-

“生成幻觉”(Hallucination)和“知识时效性”不足引发的架构范式变革

导读 纯粹依赖 LLM 参数化知识的架构已暴露出其固有缺陷——即“生成幻觉”(Hallucination)和“知识时效性”的不足。RAG(Retrieval-Augmented Generation,检索增强生成)正是为解决这一架构级工程命题而诞生的范式。然而,随着应用场景的深化,RAG 的架构设计变得日益复杂。因此,如何基于实际的业务场景选择合理的RAG架构,是目前业务场景…- 0

- 0

-

Gemini 3.1 Pro 发布,推理能力直接碾压 Claude 和 GPT

凌晨刷到 Google 官宣了 Gemini 3.1 Pro。我当时第一反应是"又来?"因为这段时间 AI 大模型更新太频繁了,每家都在卷。但点进去看完测试数据后,我整个人愣住了。这次 Gemini 3.1 Pro 在推理能力上的提升,真的有点离谱。推理能力的质变先说最震撼我的数据。在 ARC-AGI-2(抽象推理测试)这个榜单上,Gemini 3.1 Pro 直接拿下了&nb…- 0

- 0

-

Gemini 3.1 Pro 发布

今天凌晨,Google 发布 Gemini 3.1 Pro核心提升在推理能力• ARC-AGI-2(抽象推理基准)从 3 Pro 的 31.1% 跳到 77.1%,翻了一倍多• GPQA Diamond(科学知识推理)从 91.9% 提到 94.3%• Terminal-Bench 2.0(终端编程)从 56.9% 提到 68.5%• SWE-Bench …- 0

- 0

-

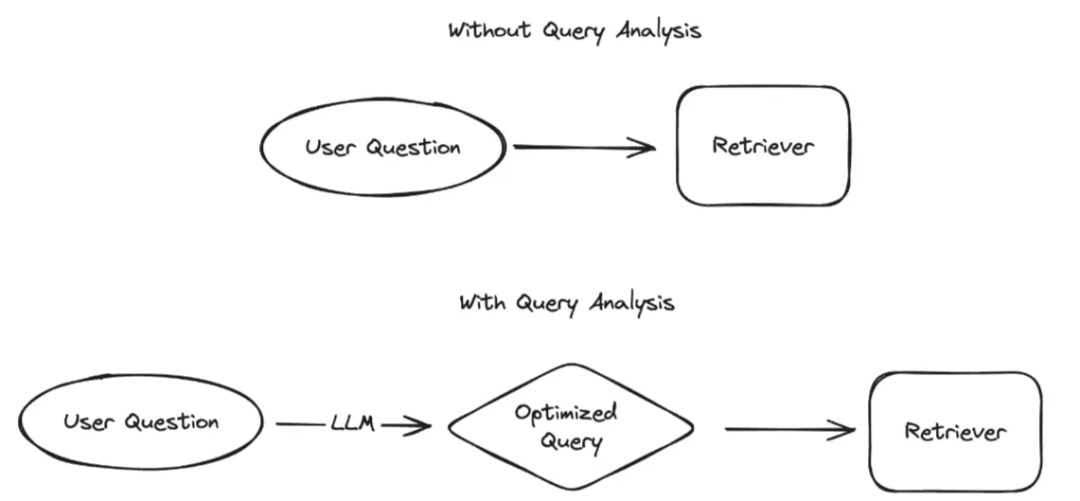

关于RAG系统在多轮对话中的问题改写(优化)方法—使用历史记录改写问题

“ 基于大模型的RAG多轮对话功能,其检索增强的流程和实际业务的场景可能会存在一定的冲突,而这个平衡点却很难把握。”在之前的文章中有讲过一个RAG检索优化的方法论,简单来说就是通过对问题进行改写和优化;比如说用户输入一个问题query,但由于我们无法控制用户的行为,因此用户输入的内容query可以是任何东西,包括可能存在错别字,语义错误,甚至是一些无意义内容。面对这种情况,特别是在多轮对…- 1

- 0

❯

购物车

优惠劵

搜索

扫码打开当前页

联系我们

返回顶部

幸运之星正在降临...

点击领取今天的签到奖励!

恭喜!您今天获得了{{mission.data.mission.credit}}积分

我的优惠劵

-

¥优惠劵使用时效:无法使用使用时效:

之前

使用时效:永久有效优惠劵ID:×

没有优惠劵可用!