-

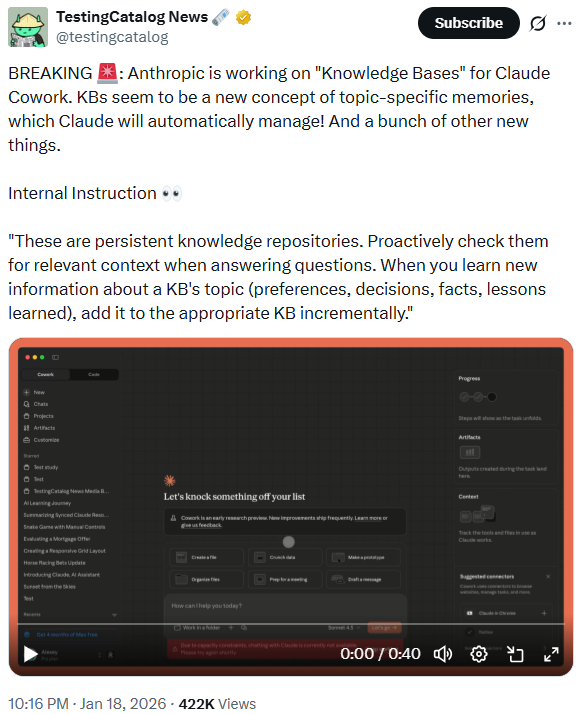

Claude被曝加入“永久记忆”功能,AI开始真正记住工作了

聊天机器人结束对话即“失忆”的局面,正在被一项新功能打破。近日,据多方消息爆料,Anthropic 公司正在为 Claude Cowork 进行重大更新,通过开发知识库(Knowledge Bases)的方式让其获得“永久记忆”。这标志着用户与 Claude 交互方式正在发生变革:从传统的聊天机器人单次对话保留上下文的模式,向多对话、多任务之间持续调用关键信息的模式转变。基于这项功能, AI 有可…- 0

- 0

-

RAG(检索增强)当主要的问题以及评估方法

RAG(检索增强生成)虽然极大地提升了大型模型(LLM)回答问题的准确性和时效性,但在实际落地过程中,它远非一个完美的解决方案。下面,我们将详细梳理当前 RAG 系统遇到的主要问题,以及业界为解决这些问题而探索出的先进解决实践和涌现出的优秀开源产品。一、 当前 RAG 系统面临的核心问题RAG 的问题可以归结为一句话:“垃圾进,垃圾出”(Garbage In, Garbage Out)。这个“垃圾…- 0

- 0

-

告别知识库"大海捞针"!Dify元数据过滤让RAG检索效率翻倍

引言你的dify知识库是不是经常让你感觉像在"大海捞针"?明明上传了几千份文档,但每次查询都要翻遍整个知识库才能找到想要的信息?用户问个简单问题,系统却返回一堆不相关的内容?别担心,这个痛点终于有解了!2025年3月18日,Dify发布了v1.1.0版本,引入了革命性的"元数据过滤"功能。这个功能就像给你的知识库装上了"智能导航系统&q…- 0

- 0

-

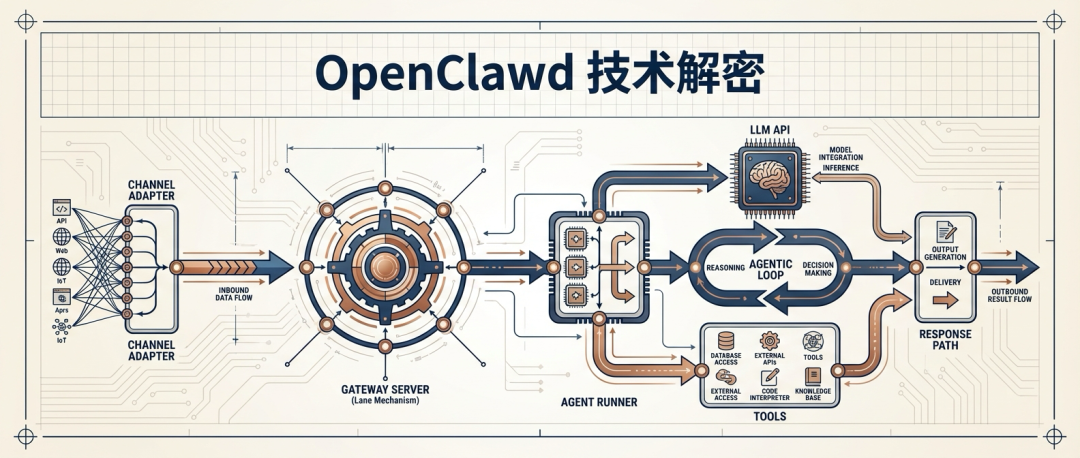

人人都在谈论ClawdBot,但你真的懂它的技术原理吗?

当 AI 助手成为日常工作流的一部分,你有没有想过:那些流畅的对话、精准的代码执行、无缝的浏览器操作背后,究竟藏着怎样的技术魔法?OpenClawd(原名 Moltbot/ClawdBot)作为一款可本地部署的个人 AI 助手,不仅在功能和体验上表现出色,其底层架构设计更值得每一位 AI 工程师深入研究。本文将从技术架构的表层切入,深入剖析其设计理念与核心机制,带你真正理解这个系统「擅长什么」以及…- 0

- 0

-

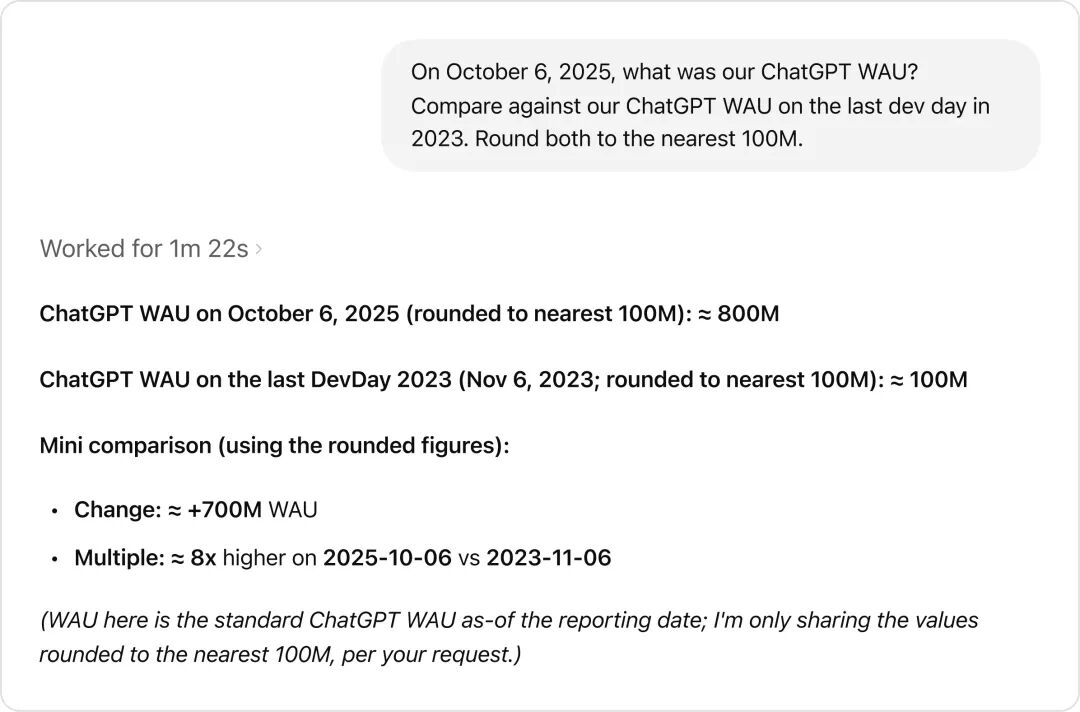

OpenAI 内部 Data Agent 最佳实践

Data Agent 核心目标就是给 AI 提供 Self-learning 环境仅仅有元数据还不够,要拿到更源头的信息(这个过程中权限逻辑至关重要),Code 是整个过程的通用语言实时的,真实的,有机的 Context 直接决定 Agent 效果翻译,整理,微调 by 付子豪(SioFU,AI PM)数据是系统学习、产品迭代和公司决策的底层动力,但真正把“数据”转化…- 0

- 0

-

RAG成败,始于分块:从“无脑”切分到“智能”切割,一份给工程师的Chunking实战指南

导语你是否也遇到过这样的情况:RAG系统里的LLM明明很强大,Prompt也精心调校过,但最终的问答效果就是不尽如人意?答案时常上下文不全,甚至出现事实性错误。 我们排查了检索算法,优化了Embedding模型,却往往忽略了数据进入向量库之前的最关键一步:文档分块。 不恰当的分块,就像是给模型提供了一堆被打乱顺序、信息残缺的“坏数据”。模型能力再强,也无法从支离破碎的知识中推理…- 0

- 0

-

刚刚,谷歌版「世界模型」震撼公测!网友实测炸翻天:游戏末日来了?

中国开源力量,再一次倒逼硅谷!就在昨天,蚂蚁灵波宣布上线世界模型LingBot-World,一发布即成SOTA。外国网友纷纷惊叹之际,谷歌似乎也感受到了威胁。就在当天凌晨,谷歌正式宣布:Genie 3开启公测!这可真是太震撼了,要知道,去年8月谷歌预告了Genie 3之后,一直没有什么后续动作。被中国AI力量这么一逼,谷歌版「黑客帝国」终于来了。只要一句话,人人都能实时创造互动宇宙了。更厉害的是,…- 0

- 0

-

一图看懂传统 RAG 与 Agentic RAG 的实战差异

在大型语言模型(LLM)日益普及的今天,检索增强生成(Retrieval-Augmented Generation,RAG)已成为提升 LLM 知识准确性和时效性的关键技术。它通过将 LLM 与外部知识库相结合,有效解决了 LLM 知识滞后和“幻觉”等问题。然而,RAG 技术本身也在不断演进。从最初的传统 RAG 结构,到如今备受关注的 Agentic RAG(智能体式 RAG…- 0

- 0

-

不好意思,我要给Clawdbot泼一盆冷水

声明:本文完全由人类撰写,不含任何AI,本文没有任何广,个人观点仅供参考。周一早上醒来,我就被铺天盖地的Clawdbot刷屏了。这盛况,丝毫不亚于一年前Manus发布的时候。可以看到,几乎所有人都在说它好,泼冷水的占比不到1/10。好,那就让我来做这1/10中的一员吧。其实关注过最近几年AI产品发布的同学都会有一个感觉:发布会上,总是吹的很牛逼,但是实际体验下来,并没有很显然的WOW Moment…- 0

- 0

-

优化 GraphRAG:LightRAG的三大改进

🛠️ 优化 GraphRAG:LightRAG 的三大改进🐼 概要这篇文章是写给已经了解 GraphRAG 基本概念,并希望探讨其在实际应用中如何进行优化的朋友。我们知道 GraphRAG 擅长处理全局性问题,但它的效率、成本和数据更新的灵活性也常常受到关注。本文将从 GraphRAG 的几个核心痛点出发,介绍一种在索引、检索和更新三个方面进行改进的思路,看看如何让它变得更轻量、更快速、也更适应动…- 0

- 0

-

Arber碎碎念之2026版

2025全年都有种强烈的感觉:从整个社会、到DATASTORY,到我自身都在发生一些深刻的变化。宏观视角上,存量经济大盘让大家冷静的同时,AI热潮汹涌也在催生创新,大家对长期主义和对创新的价值共识在形成,很多事情本该回归常识,好事情;微观视角下,AI Agentic时代人和人的差异越来越大,无论主动还是被动,人人都会面临从员工向老板或创始人的模式转变,想清楚要做什么并且承担责任比具体做重要的多。就…- 0

- 0

-

深入解析RAG多轮会话优化:从查询重写到高级策略

一、背景:为何多轮会话是RAG的"必修课"?检索增强生成(Retrieval-Augmented Generation, RAG)技术通过结合外部知识库,极大地提升了大型语言模型(LLM)回答问题的准确性和时效性。一个基础的RAG应用在处理单轮、独立的问答时表现优异。然而,真实世界的交互远不止于此。人类的交流充满了上下文依赖,是自然流畅的多轮对话。用户很自然地会将这种交流习惯带…- 0

- 0

-

Claude Code 进阶指南:Skills、Subagents 和 MCP,官方文档没写的实战经验<

一、这篇文章是写给谁的你用过 Claude Code,觉得还行,但总感觉没发挥出全部实力。前面的那篇「Claude Code 完全指南:一位资深工程师的实战心得」,讲的是基础用法和常见的坑。这篇是第二部分,直接进深水区:Skills(技能)、SubAgents(子代理)、MCP(模型上下文协议)。这三个功能官方文档都有。问题是文档只说是什么,不说怎么组合、哪些配置有用。Eyad 花了几周才搞明白,…- 0

- 0

-

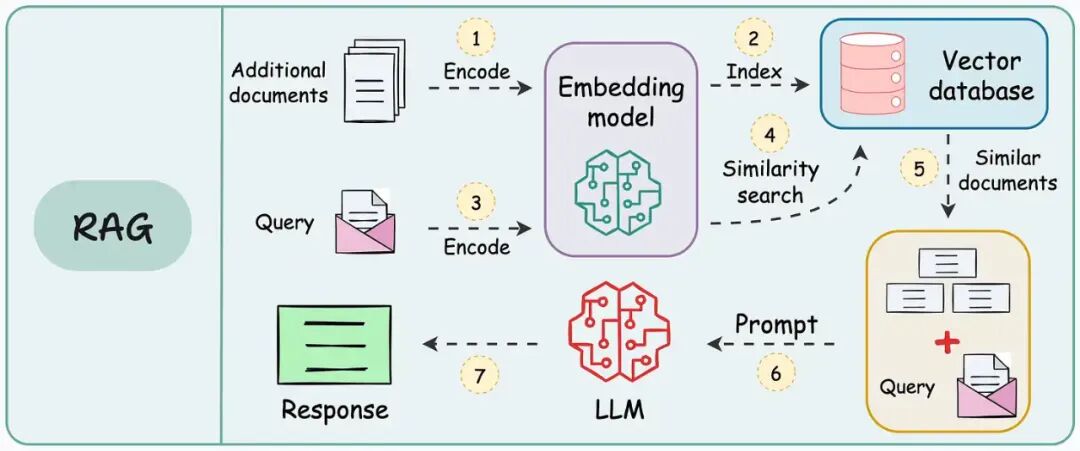

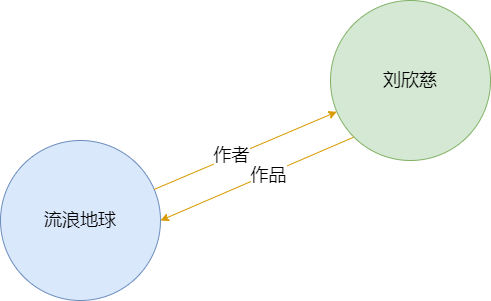

基于LLM知识图谱构建高精度RAG

当前, RAG 已经成为业内公认的大模型知识库关键技术路线最佳落地范式之一。RAG 为生成式大模型与外部信息交互提供了良好的解决方案。RAG 通常包括两个阶段:检索上下文相关信息和使用检索到的知识指导生成过程,其基本流程可以分为知识文本准备、文本切分转换、向量数据存储、问题理解及检索、生成问题解答,如下图所示:RAG概念最早由Facebook提出,但受限于当时语言模型的能力,并未引发更多的关注。在…- 0

- 0

-

OpenAI o1架构师爆料:AI Scaling已到瓶颈,AGI需要会自学的模型

当整个硅谷都在狂热地讨论"堆更多数据、砸更多算力"的scaling法则时,一个曾亲手打造OpenAI o1、o3推理模型的核心人物站出来说:这条路走不通了。Jerry Tworek,这位刚刚离开OpenAI研究团队的前主管,在最新访谈中首次系统阐述了一个颠覆性观点——真正的AGI不是靠"喂更多数据"训练出来的,而是需要模型自己学会"从失败中持续学习…- 0

- 0

-

从图的视角看 RAG:GraphRAG 的工作方式与思考

📄 从图的视角看 RAG:GraphRAG 的工作方式与思考🐼 概要这篇文章是写给对检索增强生成 (Retrieval-Augmented Generation, RAG) 技术感兴趣,并希望了解一些新方法的初学者。我们可能都用过检索增强生成 (RAG),它在文档里查找具体答案时很方便。但如果我们的问题更大一些,比如“这几百份报告里,主要的争议点是什么?”或者“这个项目的所有访谈记录合起来,反映了…- 0

- 0

-

我们这一生,都在努力传递上下文

大模型火了蛮久的上下文工程,是说让合适的信息,在合适的时候让大模型看到。我想,人类何尝不是这样呢?一、上下文是什么?上下文指的是背景、未被言明的共识、理解当前这条信息所需的全部环境。没有上下文,信息就是孤立的碎片,容易被误读。而我们的一生,正是在各个维度上构建和传递这种上下文。我们用日记记录,就是为明天的自己传递今天的上下文。而失忆,就是丢失了自我和他人的上下文。如果我失忆了,我还是我吗?对于熟悉…- 0

- 0

-

使用RAG构建高质量知识库(三)- 数据嵌入

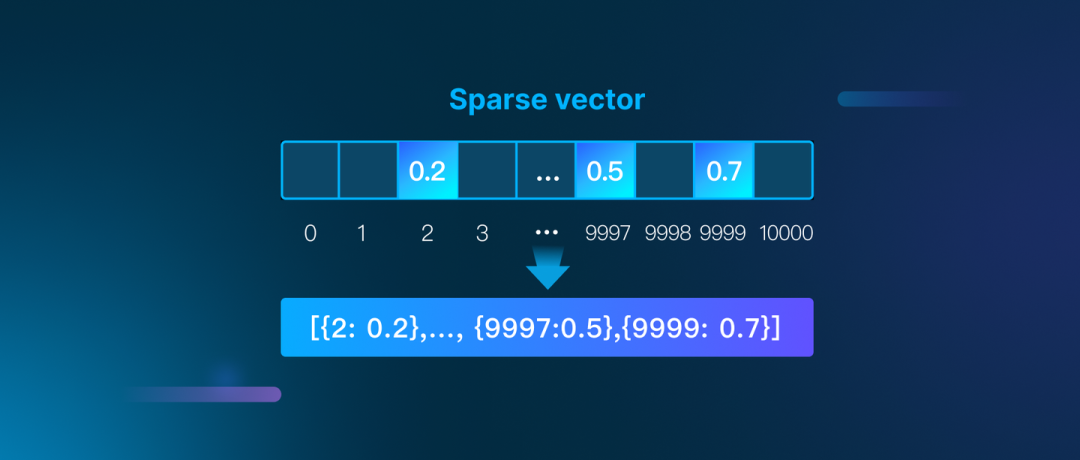

书接上文,咱们继续来聊聊数据嵌入和向量化。我们知识库的数据经过清洗和分块后,就需要进行向量化,然后存储在向量数据库中。完整的RAG流程如下:向量长啥样密集向量一般会有64 ~ 1536个维度,维度越多,能表示的精度越高,但相应的存储和计算成本越高。# 原文“AI-Tech实验室”# 密集向量[ 0.11878310581111173, 0.9…- 0

- 0

-

Transformers V5正式发布!这次更新到底香不香?

最近AI圈有个事挺有意思——Hugging Face家的Transformers库,悄咪咪把V5正式版给放出来了。就是那个几乎每个搞AI开发的人都用过的库,从BERT到GPT,从Stable Diffusion到Llama,背后都少不了它。说实话,看到这个消息我第一反应是:这么快?V4感觉还没用热乎呢。但仔细一看更新日志,好家伙,改动还真不少。详细看:https://github.com/hugg…- 0

- 0

-

RAG实践技巧:将向量库降级为“语义路由器”,让答案更合理

做教学类工作的同学一定要警惕知识诅咒,因为知者不难、难者不会,比如最近在训练营中我就遇到了类似的问题:学员们真的会对一些概念搞不清楚,初学者对于:Langchain、向量化、RAG 他们是很难分清楚的,我们在做课程设计的时候一定要更加细致一些。所以,我们今天做一篇科普文章,对几个概念进行下简单说明,首先Langchain需要被单拎出来,因为他是一套Agent开发框架,非要去对比也应该是C…- 0

- 0

-

反击 OpenAI!谷歌史诗级更新:Gemini in Chrome 正式上线,免费用

Gemini + Chrome,你期待吗?终于,它来了!这个谷歌刚刚发布的新功能叫 Gemini in Chrome。Chrome 浏览器右边加了个 AI 侧边栏,不管你在看什么网页,点一下右上角的 Gemini 图标,或者按 Ctrl+G,侧边栏就出来了。总结页面、对比标签页、直接提问,都行。重点是,基础功能免费。Gemini in Chrome,本质上就是把 Chrome …- 0

- 0

-

别只顾着卷检索了!真正决定RAG上限的,是这四个“后处理”工程

引言在上一篇文章中告别“搜不到、搜不准”:用这套查询优化,让你的RAG检索召回率飙升,我们探讨了多种提升RAG系统检索阶段性能的策略,包括索引优化、查询转换、混合搜索及QA对生成。这些方法旨在从源头提高信息检索的召回率与准确性。获得了初步的检索结果后,本篇文章将聚焦于后续的关键环节,即如何将这些信息转化为高质量、可靠的最终答案。内容将围绕以下几个核心主题展开:结果精炼: 对初步检索到的文…- 0

- 0

-

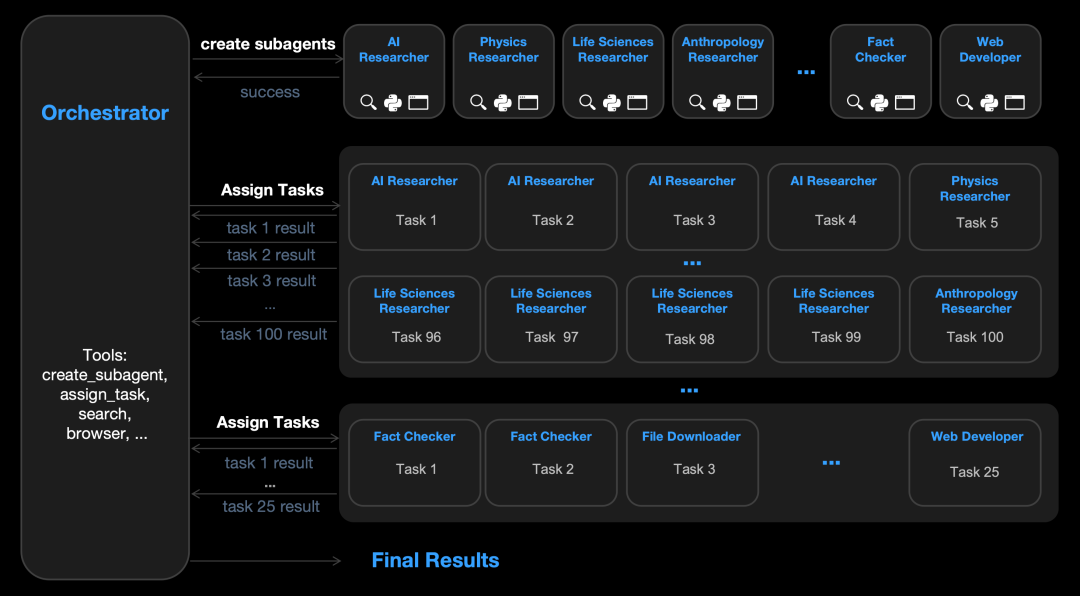

群体智能到来:浅谈Kimi K2.5之Agent Swarm

0/ 前言: Scaling Out, Not Up!以上是一天前Kimi在AMA活动上,杨植麟就Scaling Law撞墙这个话题的分享:- 传统 Scaling 受限于高质量语料枯竭,而 Agent Swarm 通过并行增加执行任务的智能体数量开辟新维度,即不再只追求模型更大,而是让智能体作为集群协作。- 这本质上是Test-time Compute 的新形态:面对复杂任务,系统动态…- 0

- 0

-

RAG 入门指南:LlamaIndex、GraphRAG、 RAGFlow 学习建议与技术选型

本文主要介绍了当前构建基于大语言模型的应用时最主流的 RAG 的核心思想、基本工作流程,RAG 与 LlamaIndex、GraphRAG、 RAGFlow 之间的关系与区别以及RAG学习建议与技术选型。1. RAG 检索增强生成(Retrieval-Augmented Generation)首先, RAG 不是一个工具,而是一种技术范式或架构思想。1.1.…- 0

- 0

❯

购物车

优惠劵

搜索

扫码打开当前页

联系我们

返回顶部

幸运之星正在降临...

点击领取今天的签到奖励!

恭喜!您今天获得了{{mission.data.mission.credit}}积分

我的优惠劵

-

¥优惠劵使用时效:无法使用使用时效:

之前

使用时效:永久有效优惠劵ID:×

没有优惠劵可用!