-

通用LLM插件系统——简化工具集成,提升2025年AI的灵活性

The Hook:The Hook:你正在构建一个 AI Agent。它很聪明,会聊天。但……它被困住了。它不能浏览网页。它不能访问文件。它不能调用 APIs。它被困在自己的沙盒里——就像给一位天才一本空白笔记本,却锁上了门。现在想象这样:你写六行代码,给你的 agent 配备浏览器控制、文件系统访问和实时 API 查询等工具——然后它立刻生效。欢迎使用 MCP-Use:一个看似简单的 …- 0

- 0

-

演讲实录:中小企业如何快速构建AI应用?

AI时代飞速发展,大模型和AI的应用创新不断涌现,面对百花齐放的AI模型,阿里云计算平台大数据AI解决方案总监魏博文分享如何通过阿里云提供的大数据AI一体化平台,解决企业开发难、部署繁、成本高等一系列问题,让中小企业快速搭建AI应用。首先第一个挑战,搭建AI应用,并不是简单地部署一个大模型,如今部署一个大模型也不再是一个困难的事情。通过通义大模型系列的不断更新,我们可以看到模型能力越来越强,但是如…- 0

- 0

-

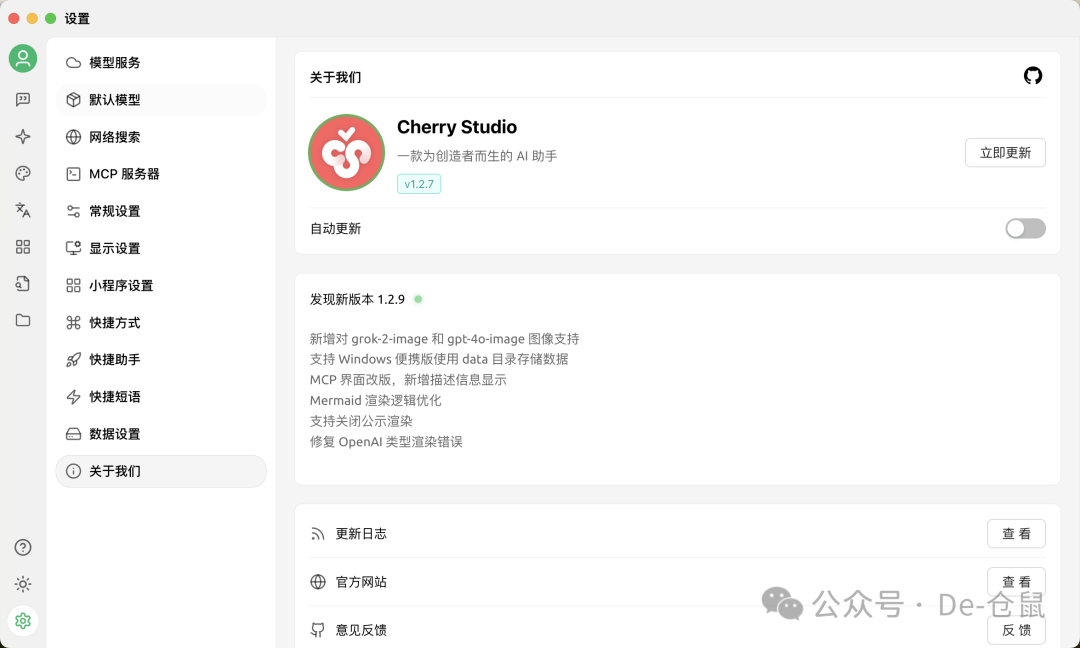

Cherry Studio v1.2.9:新增多个MCP特性

18小时前,Cherry Studio发布了v1.2.9版本,查看发布日志,发现新增了四项MCP特性:1、支持预览MCP调用结果当调用MCP后,可以浏览调用结果,如我调用了高德地图的MCP,点击浏览窗口:会显示格式化后的数据:2、MCP服务器列表新增ModelScope同步功能该功能是将ModelScope 上部署的MCP服务同步到Cherry Studio中:填写ModelScope平台的令牌:…- 0

- 0

-

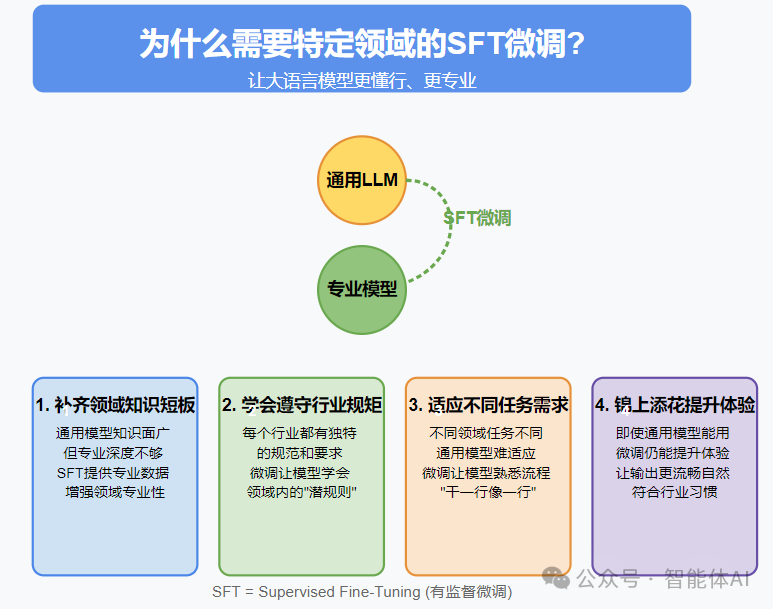

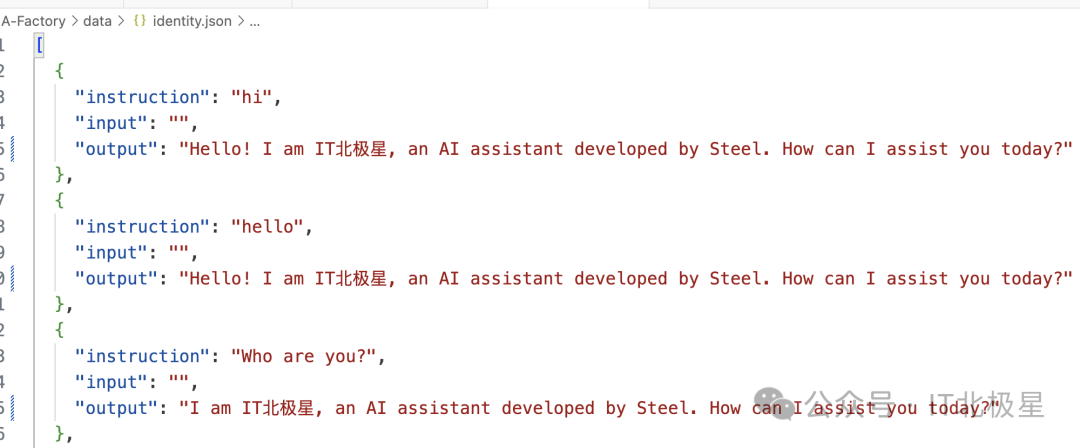

为什么新手比专家更想做垂直领域SFT微调?

随着人工智能的浪潮席卷全球,大语言模型(LLM)的应用正变得无处不在。在垂直领域的SFT微调(Supervised Fine-Tuning)作为提升模型专业能力的关键技术,吸引了无数目光。但你是否注意到一个奇怪的现象:相比经验丰富的专家,新手似乎对尝试SFT微调表现出了更大的热情?这究竟是为什么?是新手无畏的冒险精神,还是专家深思熟虑后的保留态度?那么,什么是SFT微调?为什么它这么重要?具体怎么…- 0

- 0

-

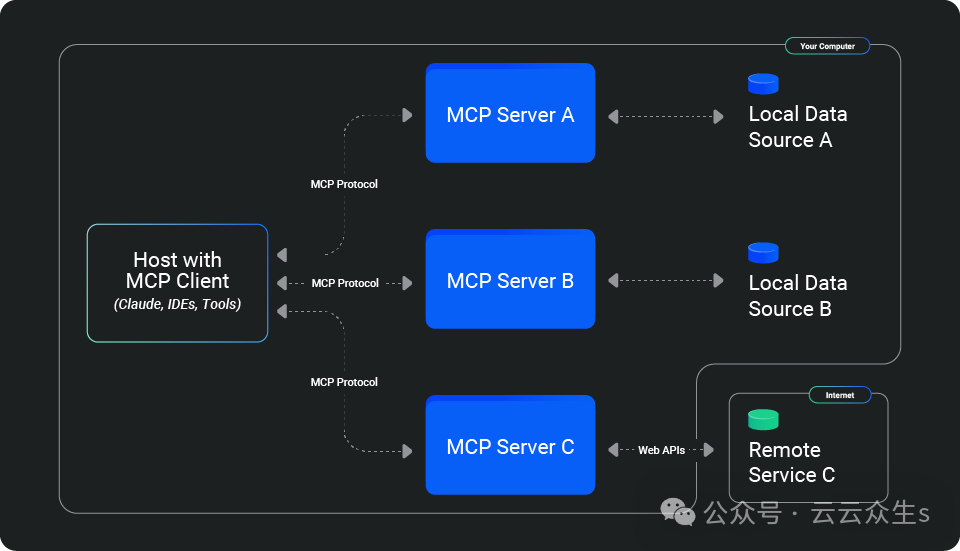

使用MCP进行AI集成的6大理由

还在手动集成 LLM?快用 MCP!它像 AI 的 USB-C,标准化 AI 访问 API 和内部系统的方式。通过 MCP,LLM 能实时连接你的堆栈,灵活切换 AI 供应商,并无缝融入现有治理模型,为 AI 原生开发体验赋能。Konnect 已支持 MCP!译自:6 Reasons You’ll Want To Use MCP for AI Integration[1]作者:Ross…- 0

- 0

-

大模型微调技术全景解析:从理论到企业级实践(Python实战增强版)

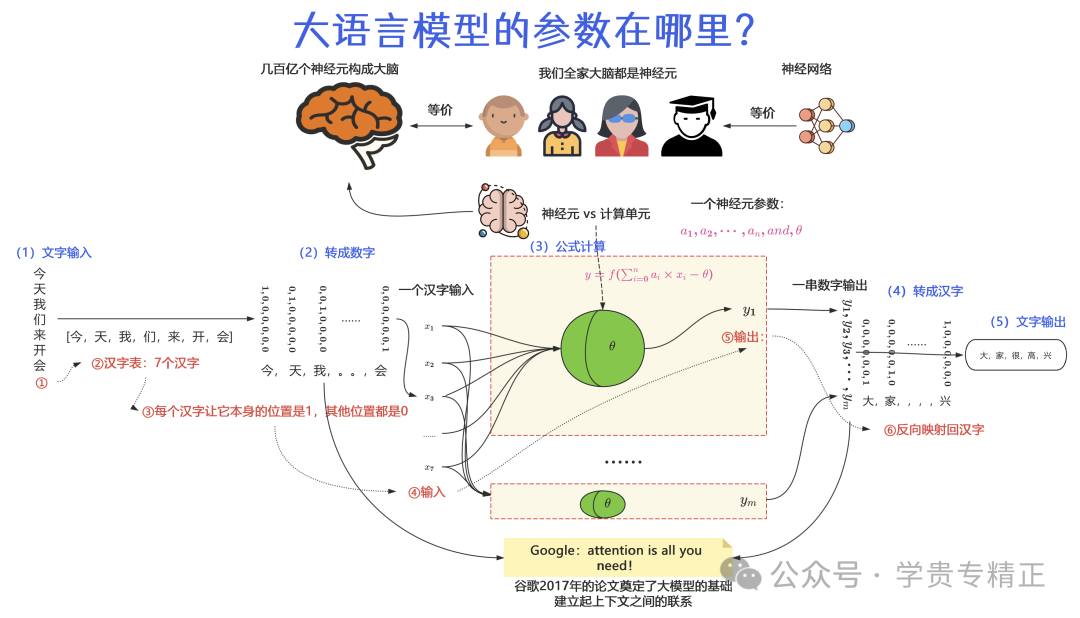

一、微调理论基础1. 微调的定义与核心原理定义:大模型微调(Fine-tuning)是指在预训练语言模型(Pre-trained Language Model, PLM)的基础上,通过特定领域或任务的数据进一步调整模型参数,使其适应下游任务需求的技术。核心原理:• 迁移学习:利用预训练模型在通用语料中学习的基础语言理解能力(如语法、语义、常识推理),通过微调将这种能力迁移到垂直领域•&n…- 0

- 0

-

主流 Embedding 模型对比

一、主流Embedding模型对比模型名称核心特性中文场景优势性能指标适用场景BGE-M3- 多语言支持(覆盖194种语言)- 支持8192 tokens超长文本- 集成稠密/稀疏/混合检索中文STS平均分达83.54,长文本理解能力突出- 响应延迟28ms(RTX3090)- 首条命中率提升42%跨语言检索、技术文档、法律条文M3E- 中英双语专项优化- 轻量化设计(模型体积仅BGE-M3的60…- 0

- 0

-

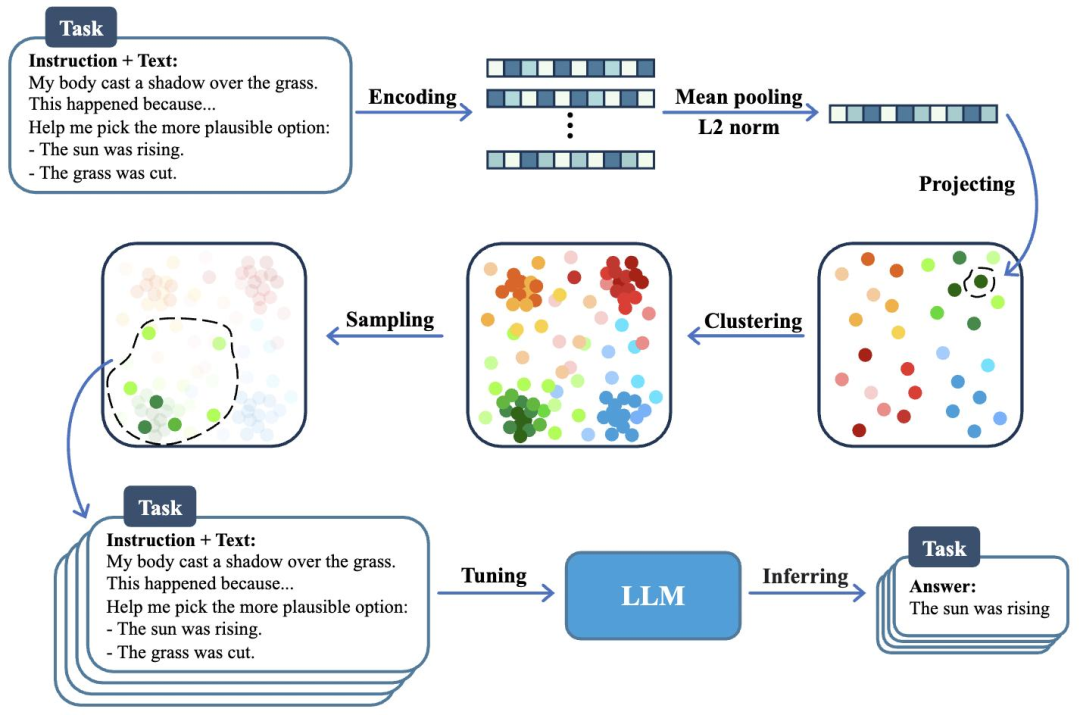

LLM 微调的学习动力学:幻觉、挤压与优化的艺术(万字长文,实战解读)

“ 幻觉与挤压,这两个微调中的暗流,正被学习动力学的光照亮。通过巧妙的数据扩展策略,我们有望平息这些波澜,迎来更平稳的航行。”大家好,我是肆〇柒。今天,我们来看看大型语言模型(LLM)微调中的奥秘。在我们落地垂域的 AI 应用过程中,LLM 微调技术发挥着极为关键的作用,从智能写作到语言翻译,从智能客服到信息检索,LLM 的身影无处不在。然而,在追求高性能时,微调过程中出现的幻觉现象和优…- 0

- 0

-

8 卡 H100 大模型训练环境部署文档

8 卡 H100 大模型训练环境部署文档目标:在 Ubuntu 22.04 系统上部署一个支持模型训练和推理的深度学习环境,基于 8 张 NVIDIA H100 GPU,支持 LLaMA-Factory 和 DeepSpeed 分布式训练。硬件环境:• CPU:36 核• 内存:1TB• GPU:8 张 NVIDIA H100(80GB HBM3)• 存储:NVMe SSD• 操作系统…- 0

- 0

-

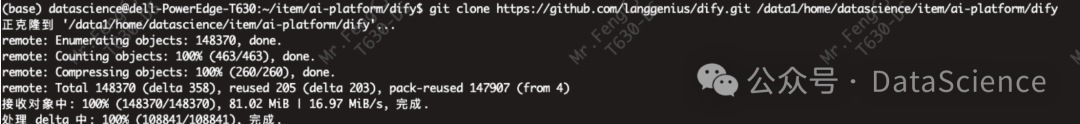

DeepSeek + Dify 企业级大模型私有化部署指南

▍私有化部署新标杆:DeepSeek+dify打造企业级AI大脑(附全流程避坑指南)大模型私有化部署成本高?数据安全难保障?本文手把手教你用DeepSeek+Dify构建企业级专属AI平台,实测单卡可跑7B模型,三步实现数据绝对安全!一、为什么选择DeepSeek+Dify黄金组合?1.1 企业级部署三大刚需解决方案:1️⃣ 安全闭环:本地离线部署+数据物理隔离2️⃣ 成本革命:16G…- 0

- 0

-

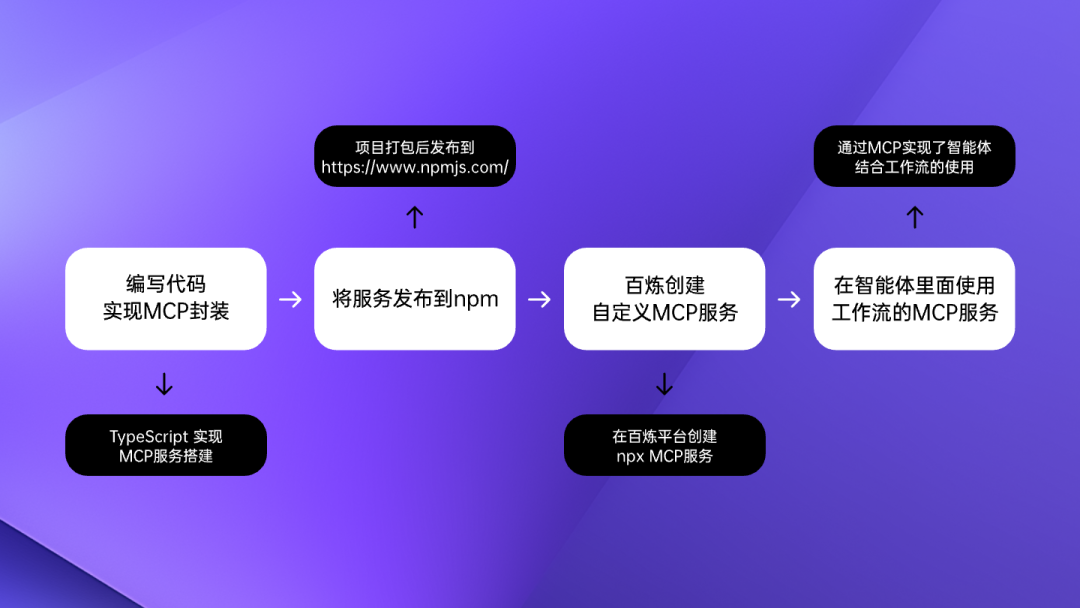

自主构建MCP,轻松实现云端部署!

本文以阿里云百炼上的工作流为例,将其封装成MCP服务并部署到阿里云百炼,随后引入智能体中,从而可以在智能体内使用自定义的MCP服务。今天我们先介绍其中一种方式。1. 编写代码封装MCP服务。2. 将封装后的服务发布到npm官方平台。3. 在阿里云百炼平台中创建自定义的MCP服务。4. 在智能体中引用自定义的MCP服务。一、搭建MCP服务通过Nodejs+TypeScript实现1、创建Nodejs…- 0

- 0

-

大模型微调框架LLaMA-Factory

LLaMA Factory是一款开源的低代码大模型微调框架,集成了业界广泛使用的多种微调方法(如 LoRA、QLoRA),具备良好的易用性和灵活性,是目前较为推荐的大模型微调解决方案。1. 安装如果环境安装过程遇到相关问题,可以参考LLaMA Factory官方github列出的相关问题git clone https://github.com/hiyouga/LLa…- 0

- 0

-

Unsloth:提升 LLM 微调效率的革命性开源工具

Unsloth:提升 LLM 微调效率的革命性开源工具Unsloth使 Llama-3、Mistral、Phi-4 和 Gemma 等大型语言模型的微调速度提高 2 倍,内存使用量减少 70%,不会降低精度。模型参数QLoRA (4-bit) 显存LoRA (16-bit) 显存3B3.5 GB8 GB7B5 GB19 GB8B6 GB22 GB9B6.5 GB24 GB11B7.5 GB29 G…- 0

- 0

-

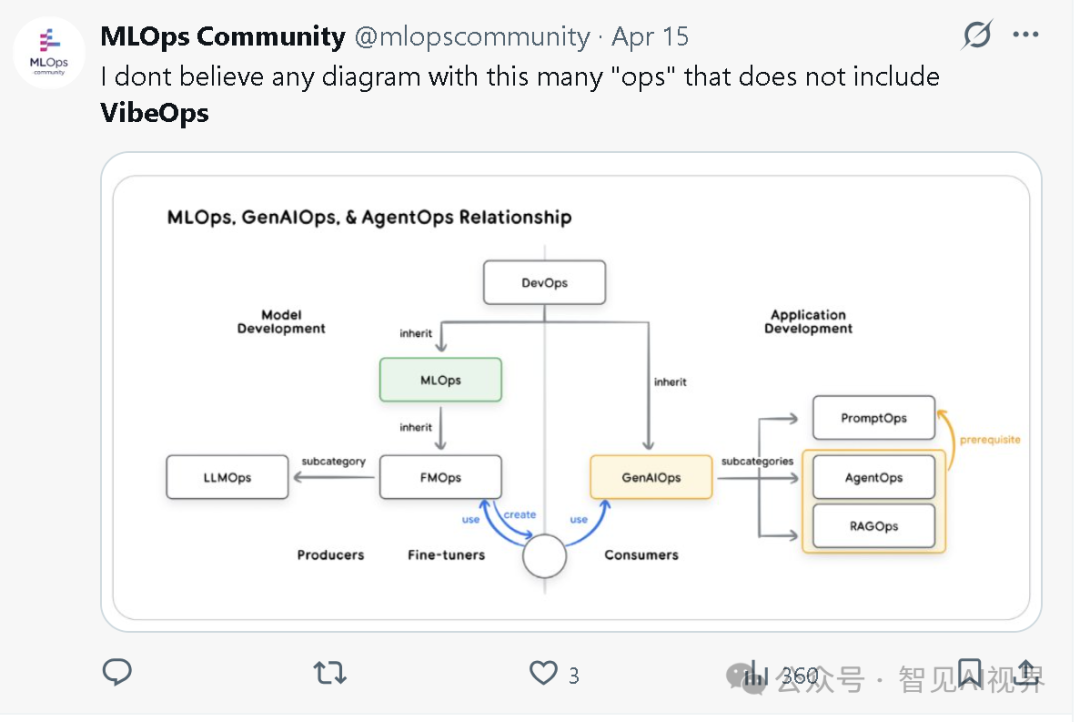

超越 DevOps?VibeOps 引领 AI 驱动的开发革命

2025 年初,计算机科学家 Andrej Karpathy 提出了一个迅速风靡软件开发界的理念:Vibe Coding(直觉式编程)。这种编程方法依赖大型语言模型 (LLM) 从自然语言描述中生成可工作的代码,将程序员的角色从手动编码转变为引导、测试和完善 AI 生成的源代码。当各类"Ops"的技术图谱层出不穷时,有从业者发出质疑——为何众多运维方法论中独缺VibeOps?基…- 0

- 0

-

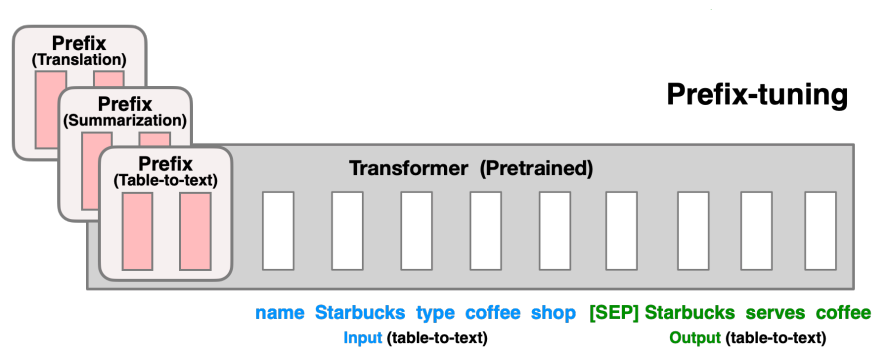

大模型想 “专精” 特定任务?这 3 种 Addition-Based 微调法别错过

现有的大模型能做很多复杂的事情,比如写文章、回答问题、生成图像等等。不过大模型虽然很强大,但有时候在一些特定的任务上,还需要进一步调整,让它表现得更好。今天就来聊聊大模型微调里的一种方法——增加额外参数(Addition-Based)微调。一、大模型与微调那些事儿(一)大模型:厉害但需要 “定制” 的全能选手大模型简单来说是具有海量参数、强大学习能力的人工智能模型。比如说大家比较熟悉的DeepSe…- 0

- 0

-

重参数化微调:揭秘LoRA家族让大模型训练成本暴降的方法

一、普通人根本玩不起大模型?现在的AI模型越来越像"学霸"—— 比如GPT-4能写文章、做数学题、甚至看懂图片,但培养这样的 "学霸" 成本高得吓人。光训练一个 650亿参数的大模型,就需要几百张顶级显卡同时工作好几天,普通开发者连显卡内存(简称 "显存",可以理解为电脑的 "临时工作空间")都不够用,更别说真金白银的…- 0

- 0

-

为什么全参数微调能让大模型从“通才”变“专才”?

一、什么是全参数微调?想象一下,你有一台能完成100种任务的智能机器人,但它做咖啡拉花总是不太专业。这时,你决定亲自教它——调整它的每一个零件,直到它成为“咖啡大师”。全参数微调(Full Fine-Tuning)就是大语言模型的“深度健身课”:通过调整模型的所有参数,让它从“通才”变“专才”。关键概念预训练模型:像DeepSeek、GPT这类大模型,通过海量文本学习了语言规律。可以把它们想象成一…- 0

- 0

-

使用 LLaMA-Factory 微调 llama3 模型

1. LLaMA-Factory模型介绍https://github.com/hiyouga/LLaMA-FactoryLLaMA-Factory 是一个用于大型语言模型(LLM)微调的工具,它旨在简化大型语言模型的微调过程, 使得用户可以快速地对模型进行训练和优化,以提高模型在特定任务上的性能。这个工具支持多种预训练的大型语言模型,例如 LLaMA、LLaVA、Mistral、Mixtral-M…- 0

- 0

-

费曼讲解大模型参数微调——小白也能看懂

故事是这样的人物组(1):老师、学生。人物组(2)爸爸、妈妈、我,妹妹。任务一:妈妈监管我的学习,我学习理科,我主要就是寻找窍门,提升解题的技巧和方法,想在考试中获得高分,这样妈妈就会多给我零花钱。任务二:爸爸监管妹妹的学习,妹妹学习文科。妹妹主要就是背,就是把书本上学到的知识都背下来,通过记忆内容来学习。任务二: 爸爸监管妹妹的文科学习爸爸开始监管妹妹学习文科背诵书本知识记…- 0

- 0

-

超详细使用Ollama本地部署Deepseek

Ollama+Chatbox部署法安装Ollama访问官网:打开浏览器,前往Ollama官方网站。页面如下:下载安装包:在官网页面,依据电脑操作系统类型,如Windows、MacOS或Linux,选择对应的安装包进行下载。点击下面的按钮,这里选择自己的电脑的版本,我这里是windows的之后就会进行下载了。当然,如果官网下载比较慢的话,可以通过百度网盘获取链接: https://pan.…- 0

- 0

-

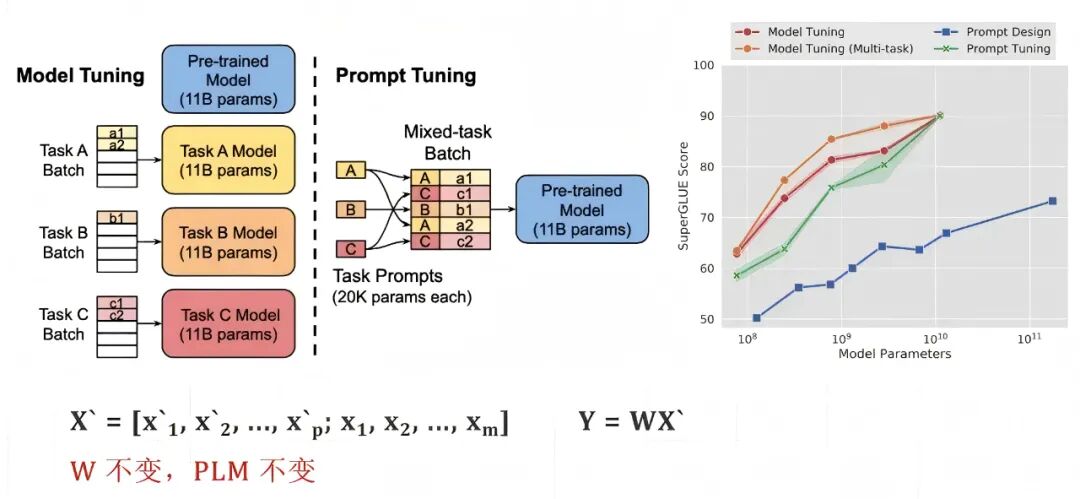

大模型微调:Prompt-Tuning

理论介绍Prompt-Tuning是一种参数高效微调方法,核心思想可以类比:技术人员不去修改知识渊博的教科书(预训练好的大模型),而是在书的开头(输入层)添加几张非常智能的、可学习的便利贴(软提示/虚拟token(Soft Prompt) 或者叫虚拟提示词-Virtual Tokens),便利贴上的内容不是固定的文字,而是模型可以自己学习调整的参数(向量)。训练时,冻结原始模型的绝大部分参数,只训…- 0

- 0

-

手把手教你如何集群部署大模型

对于大参数模型(比如70B+)的部署,要么使用多卡单机,要么使用集群。对于集群部署业界常用的方案是借用分布式计算框架Ray实现。本文我们就是用Ray + vLLM来部署一个DeepSeek-R1-Distill-Llama-70B大模型。1、环境介绍1)硬件服务器卡数数量(台)CPU(核)内存系统版本NVIDIA H100 80GB 2卡216/台256G/台Ubuntu 22.04.5…- 0

- 0

-

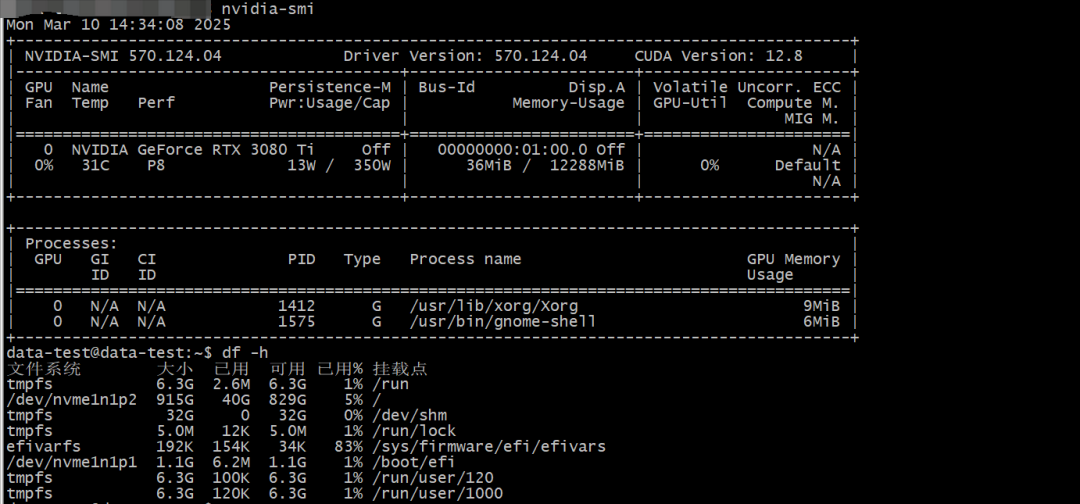

vLLM部署QwQ-32B(GPU版)

按官网要求,在部署vLLM之前首先要保证Python的版本在3.12及以上,gcc版本在12以上,并且一般需要安装Anaconda,用于做Python环境隔离,上述过程不再赘述。一、vLLM安装部署查看GPU显存nvidia-smi创建一个独立的虚拟环境并激活安装vLLM二、QwQ-32B模型下载从魔塔社区下载模型https://models…- 0

- 0

-

企业私有大模型DeepSeek落地部署该用什么? Ollama还是vLLM

0x01 前言 对数据敏感的企业想要部署自己的大模型该(如:DeepSeek R1)该选用什么方式呢? Ollama还是vllm呢? 我先说结论:Ollama适用于开发测试,vLLM适用于生产环境部署下面我会进行详细的选型对比,让你有一个更清晰的认知。0x02 选型对比 Ollama与vLLM都是针对大语言模型(LLM)部署和推理的开源框架,但它们在设计目标、技术特点和适用场景…- 0

- 0

❯

购物车

优惠劵

搜索

扫码打开当前页

联系我们

返回顶部

幸运之星正在降临...

点击领取今天的签到奖励!

恭喜!您今天获得了{{mission.data.mission.credit}}积分

我的优惠劵

-

¥优惠劵使用时效:无法使用使用时效:

之前

使用时效:永久有效优惠劵ID:×

没有优惠劵可用!