-

MiniMax音频依托MCP协议,打造多模态Tool新标杆!

不管是企业拍摄广告,还是跨境电商,音频作为信息传播的主要载体,它的制作效率跟质量直接影响着作品的影响力。但是,传统的全人工音频制作流程耗费大量的人力与时间,效果也不尽人意,这不,MiniMax音频凭借它卓越的技术实力帮我们解决了这个痛点。01全球达人背书,看看真实用户怎么说?海外达人实测:YouTube创作者@Kingy AI使用MiniMax后直言:“用MiniMax Audio克隆我…- 0

- 0

-

给AI装个眼睛——能说、能看、能分享屏幕

快速0成本部署你的专属Gemini多模态AI助手!没错,就是Google最新发布的Gemini 2.0,不仅完全免费,还支持语音对话、视频通话、屏幕分享等功能。1.像和朋友/专家聊天一样与AI语音对话2.开启摄像头让AI"看"到你在做什么、识别物体、判别物料等(场景自己脑补)。3.分享屏幕让AI帮你分析代码、文档。4.手机电脑随时随地无缝使用。我已经帮你踩过所有的坑,整理了最详…- 0

- 0

-

AI 陪伴下半场,「桌宠」或是最好的载体

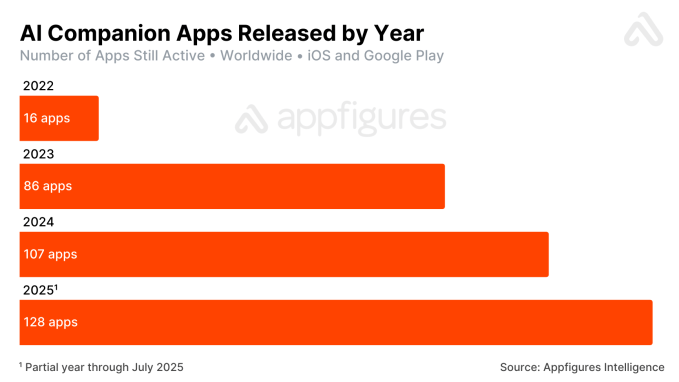

近一年,AI 伴侣类应用的数量还在不断增长。根据应用情报公司 Appfigures 提供的最新数据,在全球 337 款活跃且可创收的 AI 伴侣应用中,从 2025 年开始到今天,就发布了 128 款产品。截至 2025 年 7 月,苹果应用商店和谷歌应用商店中的 AI 伴侣应用全球下载量已达 2.2 亿次,2025 年上半年下载量同比增长 88%,达到 6000 万次。由于 AI 虚拟陪伴类产品…- 0

- 0

-

MIRIX重塑AI多模态长期记忆:超Gemini 410%,节省99.9%内存,APP同步上线

MIRIX,一个由 UCSD 和 NYU 团队主导的新系统,正在重新定义 AI 的记忆格局。 在过去的十年里,我们见证了大型语言模型席卷全球,从写作助手到代码生成器,无所不能。然而,即使最强大的模型依然有一个根本性的弱点:它们不记得你。 针对这一现状,加利福尼亚大学圣迭戈分校(UCSD) 博士生 Yu Wang 和纽约大学教授陈溪(Xi Chen)联合推出并开源了 MIRIX —— 全球首个真正…- 3

- 0

-

探索AI营养师:多模态知识图谱在食品领域大模型问答升级的革命性作用

摘要 我们提出了一个统一的食品领域问答框架,结合了大规模的多模态知识图谱(MMKG)和生成式人工智能。我们的MMKG链接了13,000个食谱、3,000种食材、140,000条关系以及14,000张图片。我们使用40个模板和LLaVA/DeepSeek增强技术生成了40,000对问答。通过联合微调Meta LLaMA 3.1-8B和Stable Diffusion 3.5-Large,将BERT分…- 3

- 0

-

多模态商品图文生成系统可落地的完整方案

围绕多模态商品图文生成系统,提供一套可落地的完整方案: 一、本地与在线部署流程详解 我们以 BLIP + 大语言模型(如ChatGLM/Qwen/ChatGPT) 的组合为基础,构建完整的“输入商品图片 → 生成商品描述”流程。 A. 本地部署方案(适合私有化/边缘部署) 技术选型: 图像→文本模型:BLIP / BLIP2(Hugging Face) 文本优化:Qwen/Qwen2, Cha…- 5

- 0

-

Coze、Dify、Ragflow等AI平台对比指南

dify、n8n、Coze、Fastgpt、Ragflow到底该怎么选?超详细指南~" data-itemshowtype="0" linktype="text" data-linktype="2">Dify、n8n、Coze、Fastgpt、Ragflow到底该怎么选?超详细指南~最近想选择一个平台尝试搭建智能体,以下是…- 19

- 0

-

基于 Ollama 多模态引擎的 Qwen 2.5 VL 模型部署及其应用

点击蓝字 关注我们Ollama 于 5 月份推出的全新多模态引擎。新的多模态引擎,可突破旧架构的设计依赖限制,为本地部署的多模态 AI 模型提供更准确、可靠、灵活的运行环境,并严格确保推理过程符合模型的设计初衷(忠于原始模型,对模型原始意图的忠实执行)。本文介绍基于Ollama 多模态模型引擎的 Qwen 2.5 VL 模型部署及其应用,主要内容如下: Ollama 全新多模态模型引擎介绍 Qwe…- 9

- 0

-

Dify落地知识库场景的小思考及多模态RAG结合图像信息的几种策略评估

今天是2025年7月1日,星期二,北京,晴 今天是2025年下半年的第一天,新的起点,我们继续看技术。 从评估角度看多模态RAG中的文档信息增强,逐步整合跨模态输入(文本、图像、字幕、OCR)后对应的相应影响,虽然说,这种范式看起来像是去年的,但温故而知新。 另外,来看看一个问题,关于dify是否应该被抛弃的一些思考?还是要分具体使用场景去看。 一、从评估角度看多模态RAG中的文档信息增强 来看最…- 5

- 0

-

RAG知识库构建新框架-EasyDoc小模型+多模态大模型结合的文档智能解析框架

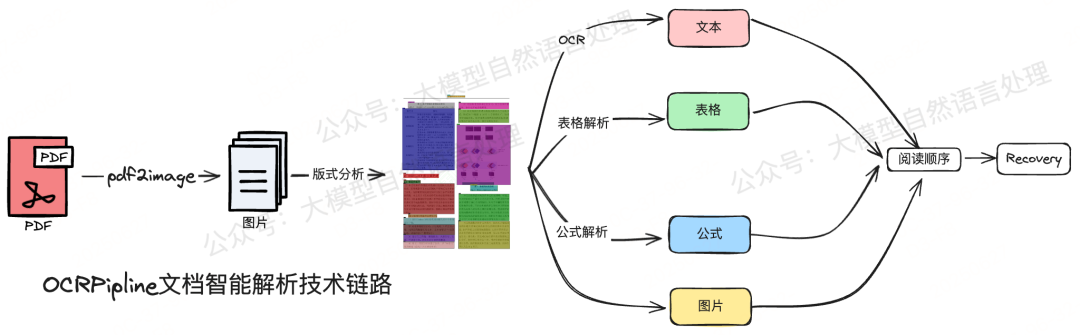

传统的基于OCR的pipline的相关技术路线(如下图),目前多模态大模型的出现,文档解析技术链路出现了新的一些玩法。 最近看到一个新产品,EasyDoc(https://www.easylink-ai.com/easy-doc/),在原有的OCR链路中引入了多模态大模型进行图表理解,由此,笔者又更新了一张图,如下: 图2:OCRpipline结合多模态大模型的文档智能解析技术路线下面我们来看结合…- 8

- 0

-

Dify v1.4.0中的Multi-Modal LLM Output:基本操作和原理

本文使用dify 1.4.0版本,该版本除了浅色和深色模式之间切换功能外,还有一个重要功能,即多模态大语言模型输出,允许大语言模型(LLMs)在 LLMNode 中同时处理文本和图像。这一功能提升了数据交互的丰富性,并增强了模型的能力。 一.Gemini 2.0 Flash Exp模型 1.测试Chatflow流程 现在可使用 Gemini 2.0 Flash Exp 模型尝试这些新功能,这一集成…- 1

- 0

-

搜索 ≠ 简单匹配!0代码实现语义级图文互搜

在图像、文本、视频等非结构化数据爆发增长的今天,传统的图文检索方式已难以满足企业对高效、精准、可扩展的搜索需求。越来越多的应用开始支持“输入一段文字,找到最匹配的图片”或“上传一张图,找出视觉最相似的内容”。这些看似简单的功能背后,其实隐藏着不小的技术挑战。比如:如何快速从上百万张图片中找到最相似的?如何保证检索系统的扩展性和稳定性?如何降低开发和运维成本? 本方案将介绍借助阿里云 Milvus …- 3

- 0

-

AI提效99.5%!英国政府联手 Gemini,破解城市规划审批困局

❝手写批注 + 模糊地图 + 纸质文档 = 城市发展“卡脖子”难题?现在,AI只需40秒搞定!英国政府用 Google Gemini 多模态技术重塑城市规划系统,全国35万份积压申请即将“一键解码”!导语:AI,不止是聊天机器人,它正重构政府效率在英国,一份房屋建设或改造的申请常常需要数周才能审批通过。根源在于大量基于纸质档案的城市规划文件,图纸模糊、注释潦草、信息零散,规划人员常常要花上&nbs…- 4

- 0

-

多模态 RAG VS 传统文本 RAG ,到底效果如何,从应用视角来测试下

基于文本的传统 RAG 缺陷我们团队近期主要在做两件事:已有的文本知识库产品进行客户交付以及提供一些咨询服务正在研发一款多模态 RAG 产品在基于文本的知识库实际企业落地过程中,客户反馈最大的问题还是 准确率不足 。出现准确略不足的最主要原因还是数据源的复杂性,文档中存在图片、表格、页眉页脚、边框等都会影响到输出的准确性。即使在 RAGFlow 的 DeepDOC 和三方视觉模…- 4

- 0

-

实战复盘 | 基于视觉模型的多模态 RAG 系统,我们踩过的坑与收获 (项目已开源)

背景在 KnowFlow 内部交流群的同学都知道,近期我们团队在做一款基于视觉模型的多模态 RAG 系统。2 周左右密集开发之后,我们进行了全方位的测试,在群内公开召集难啃的文档,现在整体上对于多模态 RAG 有了更加深入的认识。分享本篇也是给同行的开发者或有意向的客户提供一些建议和思考,本文视角遵循客观、理性视角,大家放心食用。什么是多模态 RAG?目前市场内主流的 RAG 系统技术…- 6

- 0

-

多模态模型在RagFlow中的应用

在RagFlow的最新版本中(0.19.0)中,为了提升对文档中各类图片的解析效果,也尝试引入了多模态模型(image2text)对图片内容进行增强解析。我们来详细分析一下相关的过程。 首先需要在当前租户下配置一个image2text的模型(这里有个坑,后面会讲到),在RagFlow的文档解析过程中主要有三个场景使用到这个image2text模型,我们一一来看下: PDF文档内容提取 如果配置…- 4

- 0

-

清华首创多模态+知识图谱+RAG,问答精准度超 94%

本公众号主要关注NLP、CV、LLM、RAG、Agent等AI前沿技术,免费分享业界实战案例与课程,助力您全面拥抱AIGC。 一、多模态RAG面临的困难 知识图谱(KGs)通过将实体及其关系以结构化形式编码,为多跳推理和精准召回上下文提供了可行性。 但是在多模态资源中,实体之间的关系非常复杂,导致检索输出碎片化和持续的幻觉问题。 并且知识图谱的构建和维护需要大量人工劳动,将其与向量搜索和 LLM …- 3

- 0

-

Deepseek 多模态来解析图片,结合上下文分析pdf文档

欢迎关注: 打造你的文档小助手:PDF智能解析系统揭秘! 嘿,朋友们!你有没有为翻阅一堆PDF文件头晕眼花过?有没有为从文档中提取关键信息熬夜到怀疑人生?别担心!今天我要隆重介绍一款“文档界的卷王” ——PDF智能解析系统!它不仅能帮你轻松搞定PDF,还能生成酷炫的分析报告,简直是懒人福音! 这货到底有啥用? 简单来说,这套系统能让你从“手动狗头”进化到“智能AI狗头”。它的核心功能包括: 1. …- 4

- 0

-

Lovart再次证明:AI不是卖工具而是卖成果

本周AI圈几乎被新的一款垂直Agent刷屏了。这就是由Liblib海外子公司推出的设计垂类agent:Lovart。 与市面上的传统设计工具或嵌入式AI插件不同,它能够直接理解用户的自然语言指令,自动生成从品牌设计到营销物料的全流程、多模态内容,包括图像、视频和音乐。 具体可以看下官方视频 垂直领域深耕优于通用化竞争与前段时间爆火的通用型AI Agent-Manus不同,而Lovart则是设计专精…- 1

- 0

-

Dolphin-API:字节Dolphin多模态文档解析模型API化全攻略

Dolphin是字节跳动于2025年5月在Hugging Face等平台低调发布并开源的一款新型多模态文档图像解析模型。它并非简单地堆砌参数,而是通过精巧的架构设计,以约322M的参数量,在文档解析领域实现了令人瞩目的性能突破。本文将在项目源码的基础上,通过Docker部署Dolphin API可供dify平台调用。 Dolphin基本原理 概述 Dolphin的核心特点在于其创新的“先分析后解析…- 3

- 0

-

本地AI对话神奇,ChatWise到底有什么用?

1.1. ChatWise 是什么? ChatWise 是一款功能丰富的本地化 AI 聊天客户端。你可以把它理解为一个集成了多种 AI 模型调用、并提供了强大扩展能力的“AI 工作台”。它的核心特性包括: 优秀的MCP支持:这是 ChatWise 最显著的亮点之一。它内置了对 MCP 协议的良好支持,并提供了相对直观和易用的界面来配置和管理各种 MCP 服务。这使得用户可以比较方便地将外部能力集成…- 7

- 0

-

从BGE到 CLIP,从文本到多模态,Embedding 模型选型终极指南

通过通过将原始输入转换为固定大小的高维向量,捕捉语义信息,embedding(嵌入)模型在构建RAG、推荐系统,甚至自动驾驶的模型训练过程中都产生着至关重要的影响。 即使 OpenAI、Meta 和 Google 等科技巨头,也选择在近些年来,在 embedding 模型的研发上持续加大投入。以 OpenAI 为例,其最新的 text-embedding-3-small生成 1536 维向量,在…- 7

- 0

-

AI Agent到底哪家强?横评五款主流Agent

最近,满地都是AI Agent,仅最近半个月,就爆出了10多款(详细介绍)。 来自近期在上海分享的PPT AI Agent,现已成为继LLM(Large Language Model,大语言模型)后的时髦新宠,各家厂商疯狂推Agent犹如过江之鲫。 那么问题来了,到底哪个Agent更胜一筹?今天,我们就来给大家横向测评一下。 关于测评方法 我选择了5款热门的通用型AI Agent,分别是Gensp…- 3

- 0

-

AI Agent协议A2A交互细节详解

自我介绍 大家好,我是Aaron。过去一直从事算法领域相关工作,自工作以来,一直持续在关注算法相关技术的发展,当前除了在工作中会进行一些AI的落地实践,工作之余也在通过AI辅助编程做一些有趣的探索,比如ragflow4j(https://github.com/aaronshan/ragflow4j) ,后续会持续更新AI实践过程中的心得体会,以及AI知识分享。欢迎大家关注我关注公众号,以便第一…- 4

- 0

❯

购物车

优惠劵

搜索

扫码打开当前页

联系我们

返回顶部

幸运之星正在降临...

点击领取今天的签到奖励!

恭喜!您今天获得了{{mission.data.mission.credit}}积分

我的优惠劵

-

¥优惠劵使用时效:无法使用使用时效:

之前

使用时效:永久有效优惠劵ID:×

没有优惠劵可用!