-

微软官宣All in智能体,SWE Agent首曝光!奥特曼预警2025编程巨变

【新智元导读】2025年,软件工程要彻底变天了。先有奥特曼预言,后有微软下场All in智能体。刚刚,首个自主SWE智能体面世,不仅会主动改bug修复错误,还能自主提交PR评论。奥特曼预言,2025年软件工程将迎来巨变。开年智能体大爆发,AI自动化软件工程已成为不争的事实。就在今天,纳德拉官宣,GitHub Copilot将all-in智能体,微软自主的SWE智能体首次亮相。GitHub现任CEO…- 0

- 0

-

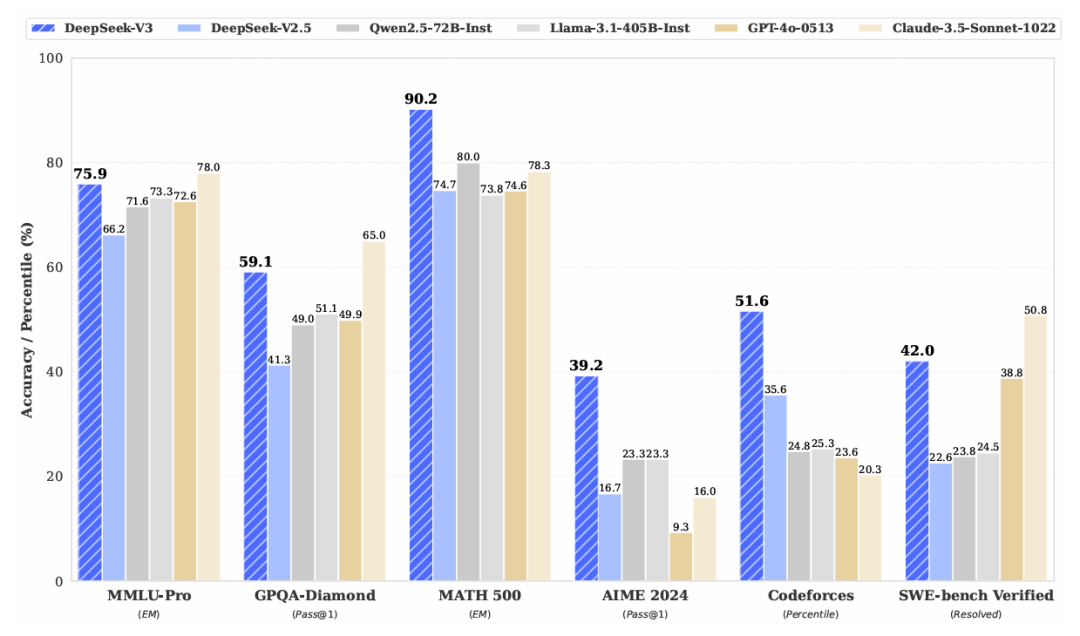

我们应如何看待DeepSeek的557.6万美元训练成本?|甲子光年

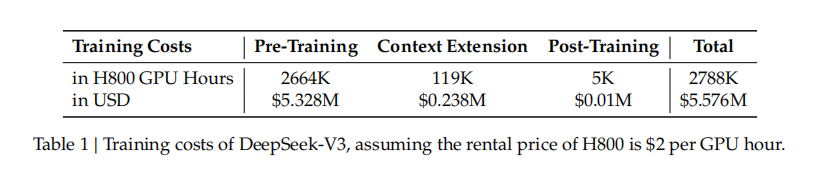

三个月前,我们和中国科学院院士、清华大学计算机系教授张钹曾经聊过一个话题:“为什么在提高算法效率上中国人会做得更好?”张钹告诉我们:“对中国企业来讲,算法效率是生命攸关的,我们必须全力以赴。也许因为美国人有强大的算力,算法效率对他们来说只是锦上添花而已。”当时,我们对这句话感受还不是很深,直到后来看到了DeepSeek-V3技术报告里的这张表格。DeepSeek-V3的训练成本(假设H800的租赁…- 0

- 0

-

10分钟让WPS接入DeepSeek,实现AI赋能

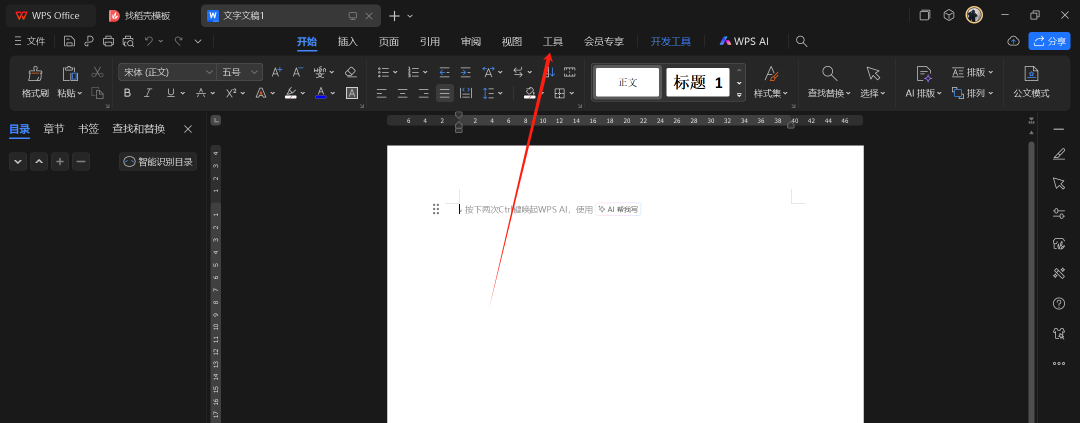

-正文-在办公场景中,WPS 作为一款强大的办公软件,不仅提供了丰富的文档编辑功能,还支持宏(Macro)来实现自动化处理。随着人工智能技术的发展,将大模型(如 ChatGPT、DeepSeek、文心一言等)集成到 WPS 中,可以大幅提升文档编辑、内容创作、数据分析的效率。本文介绍如何通过 WPS JS宏调用 DeepSeek 大模型,实现自动化文本扩写功能。1.随便打开一个word文档,点击工…- 0

- 0

-

“李飞飞团队50美元复刻DeepSeek R1”之辨

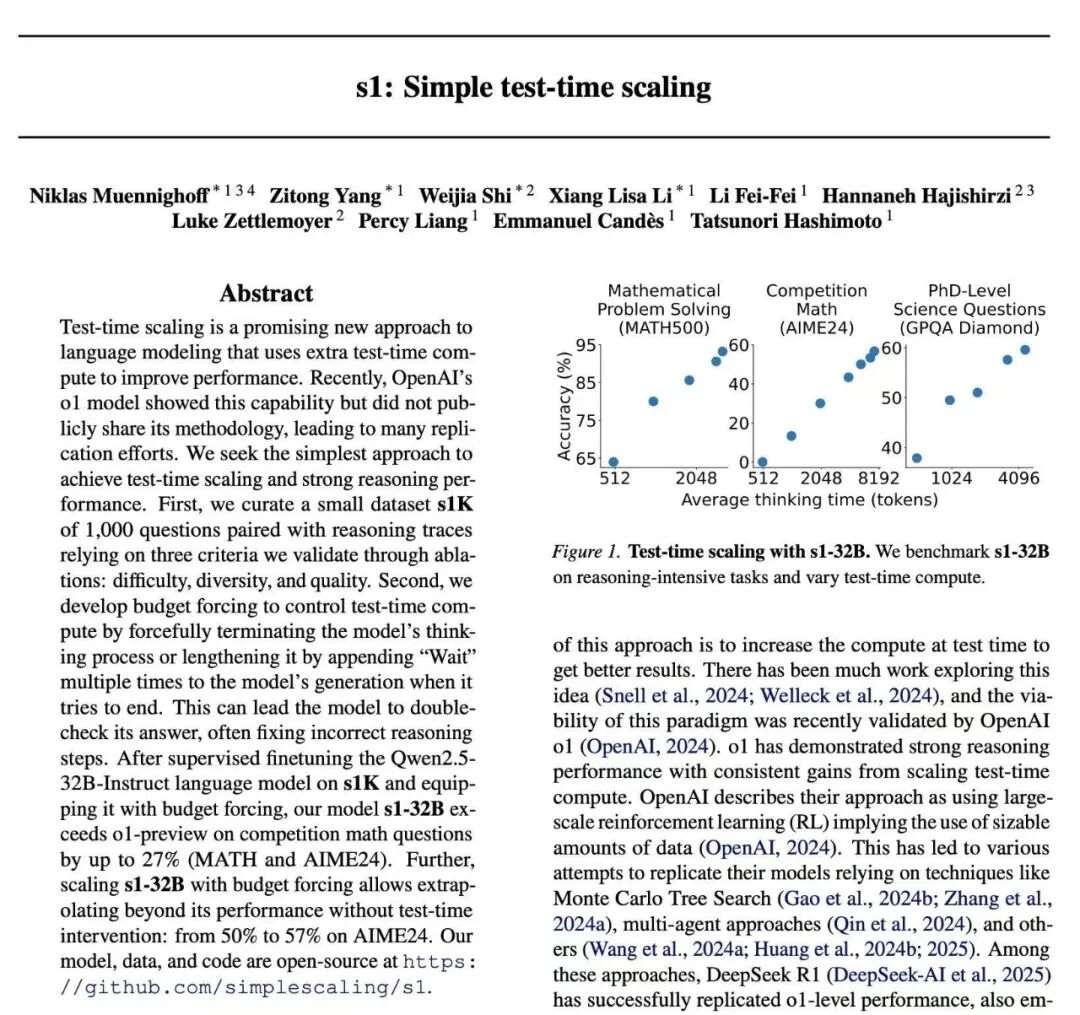

近日,AI领域又迎来一枚“深水炸弹”,斯坦福大学李飞飞团队联合华盛顿大学研究人员以不到50美元的云计算费用,成功训练出了一个名为s1的推理模型。其数学与编码能力测试表现,与OpenAI的o1、DeepSeek的R1等模型不相上下。根据研究团队的测试结果,在竞赛数学问题上,s1-32B的表现较o1-preview高27%(MATH和AIME24);且该模型在AIME24上的表现,几乎与Gemini …- 0

- 0

-

DeepSeek V3:AI领域的全新突破,性能与效率双重飞跃

DeepSeek V3 简介:创新架构,极致性能DeepSeek V3是DeepSeek系列的最新版本,继承了前两个版本(V1和V2)的核心优势,同时在技术架构和优化方法上进行了大规模的升级。V1:聚焦于数据质量和基础架构的优化,采用LLaMA架构,并通过高质量的数据集与Supervised Fine-Tuning(SFT)进行风格对齐。V2:引入了Multi-Head Latent Attent…- 0

- 0

-

完整的671B R1塞进本地,详尽教程来了!

过年这几天,DeepSeek 算是彻底破圈了,火遍大江南北,火到人尽皆知。虽然网络版和 APP 版已经足够好用,但把模型部署到本地,才能真正实现独家定制,让 DeepSeek R1 的深度思考「以你为主,为你所用」。然而,完整的 671B MoE 模型也可以通过针对性的量化技术压缩体积,从而大幅降低本地部署门槛,乃至在消费级硬件(如单台 Mac Studio)上运行。那么,如何…- 0

- 0

-

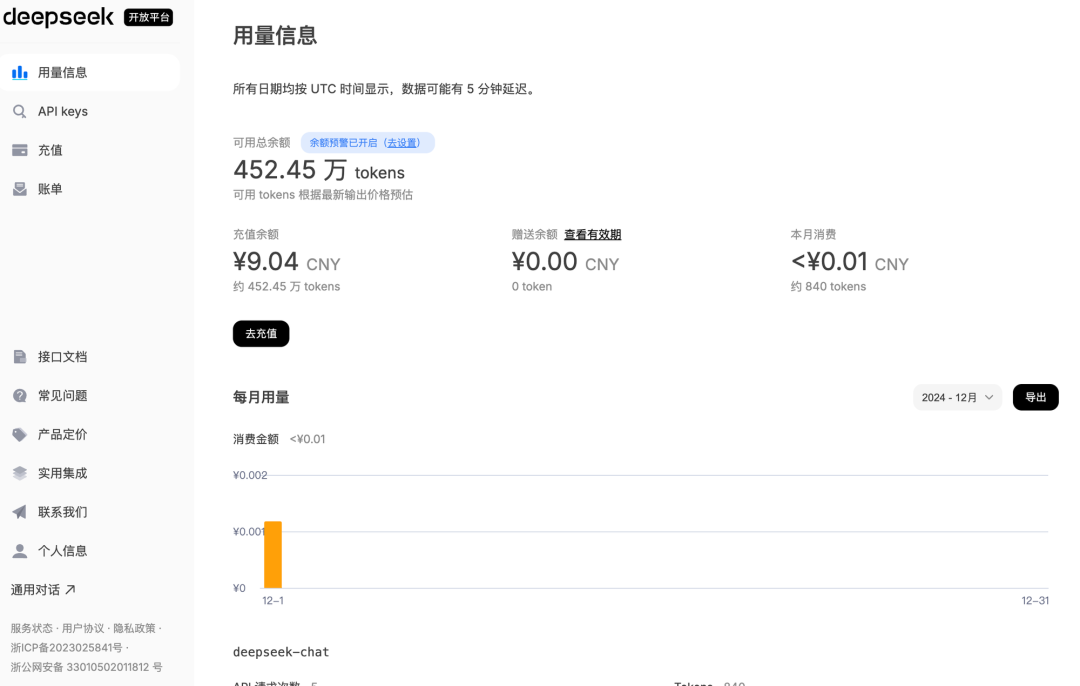

【DeepSeek x 飞书】在飞书智能伙伴搭建平台上用 DeepSeek 模型

Deepseek 出了名的量大管饱,而对于一般常见的 Chat 场景,直接使用 DeepSeek 是个不错的选择,作为普通用户,完全可以直接使用 DeepSeek来接入飞书智能伙伴,降低自己的模型消费成本。我就试着将 DeepSeek 接入到了我的飞书智能伙伴搭建平台上。创建 Deepseek API Key首先,访问 DeepSeek 开放平台[1],进入 API…- 0

- 0

-

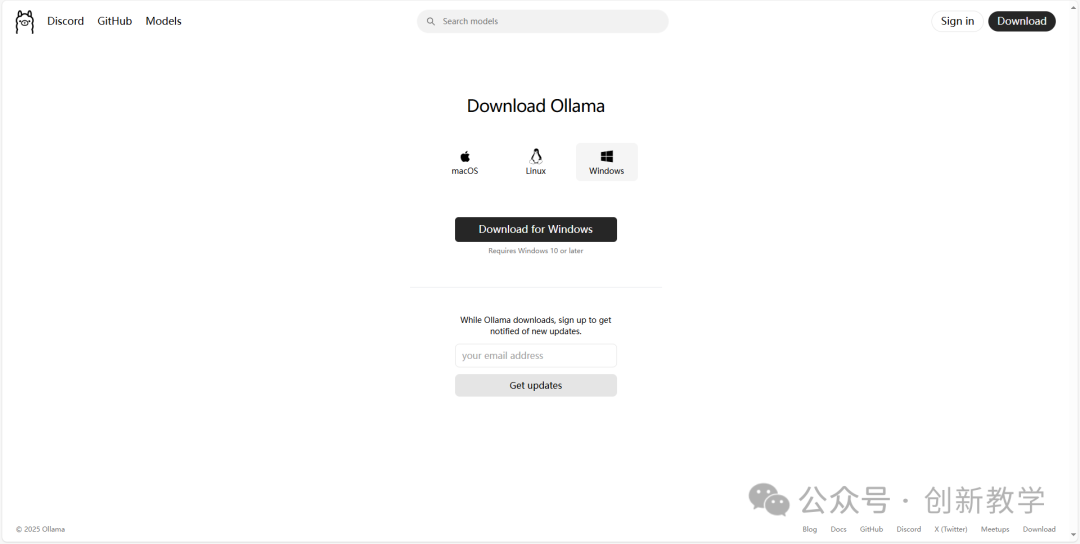

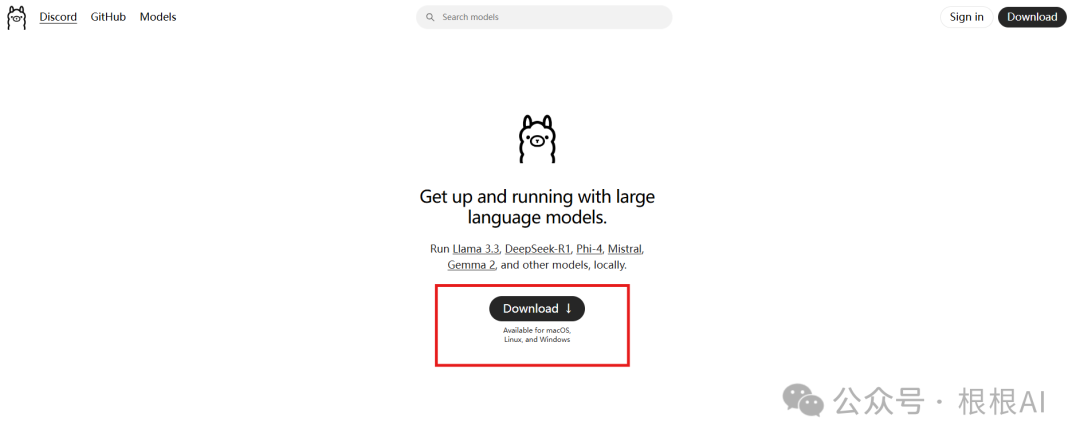

DeepSeek大模型本地部署全攻略:从工具选择到可视化操作

今天,我们将为大家详细讲解如何把DeepSeek大型模型部署在本地。考虑到用户对数据隐私的重视,不希望将数据上传至云端,或者需要在无网络环境下使用该模型,此时便可采用本地部署的方式。要进行DeepSeek大模型的本地部署,我们首先需要借助一款能够在本地运行该模型的工具。在这里,我们以Ollama为例来进行说明。Ollama具有广泛的模型支持能力,尤其擅长处理那些可在本地运行的模型。它的一大优势在于…- 0

- 0

-

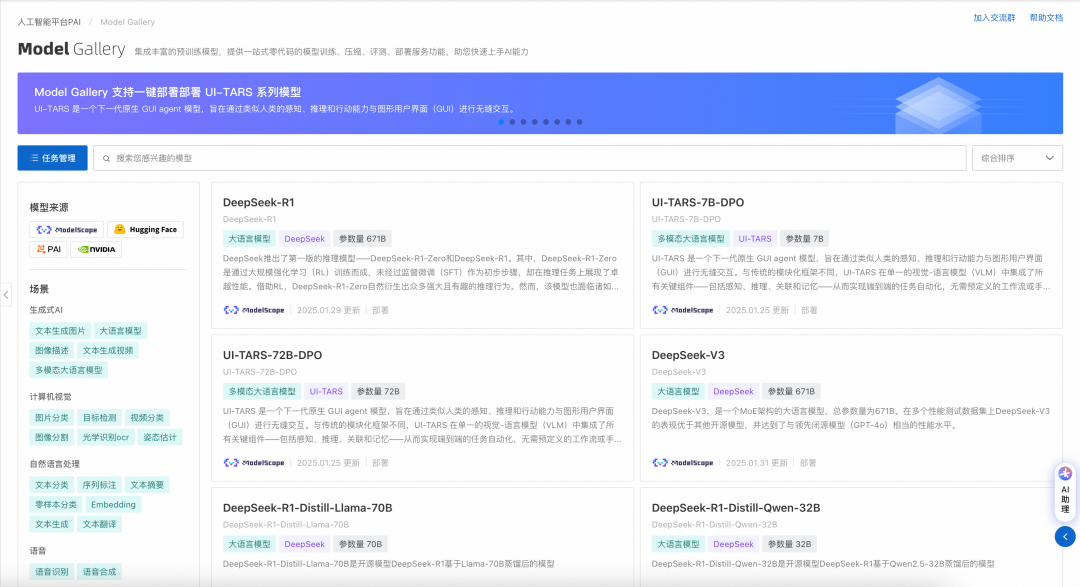

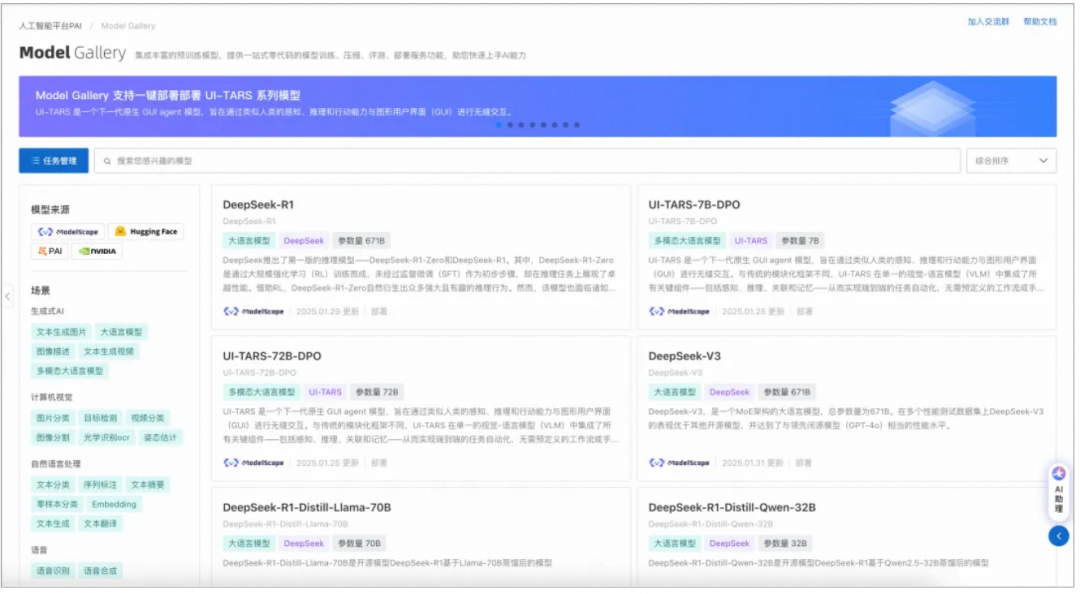

3步,0代码!一键部署DeepSeek-V3、DeepSeek-R1

大年初六,我们进入正题:阿里云PAI Model Gallery支持云上一键部署DeepSeek-V3、DeepSeek-R1。在该平台上用户可以零代码实现从训练到部署再到推理的全过程,简化模型开发流程,为开发者和企业用户带来了更快、更高效、更便捷的AI开发和应用体验。// 第一步:进入Model Gallery页面点击链接:https://pai.console.aliyun.com/#/qui…- 0

- 0

-

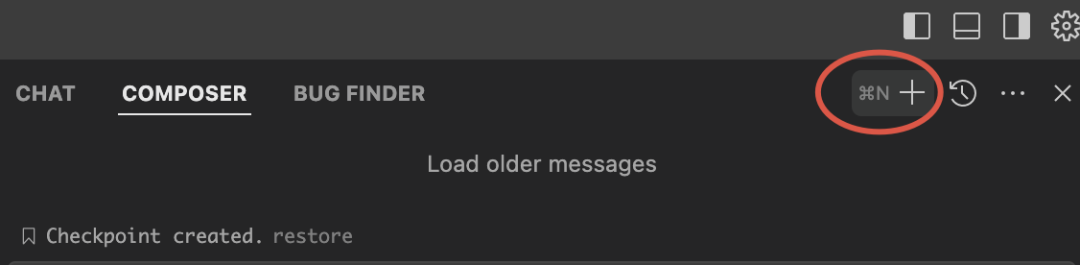

深度使用Cursor碰到的几个问题

记录一下目前使用Cursor碰到的几个问题:1、生成的代码有些地方存在些小问题,这不是关键,关键是我不想浪费次数让他来改,自己直接手动改了,结果下次修改他又给我改回去了。。。 我再改回来,下次他又改回去,就很犟。解决方案就是,还是让他来改吧,他会记录所有修改记录,后面就不会错了。2、让他生成markdown格式的文件,经常文件里面只生成了一部分,剩下的全都输出成文案展示在界面上了,到现在都没解决。…- 0

- 0

-

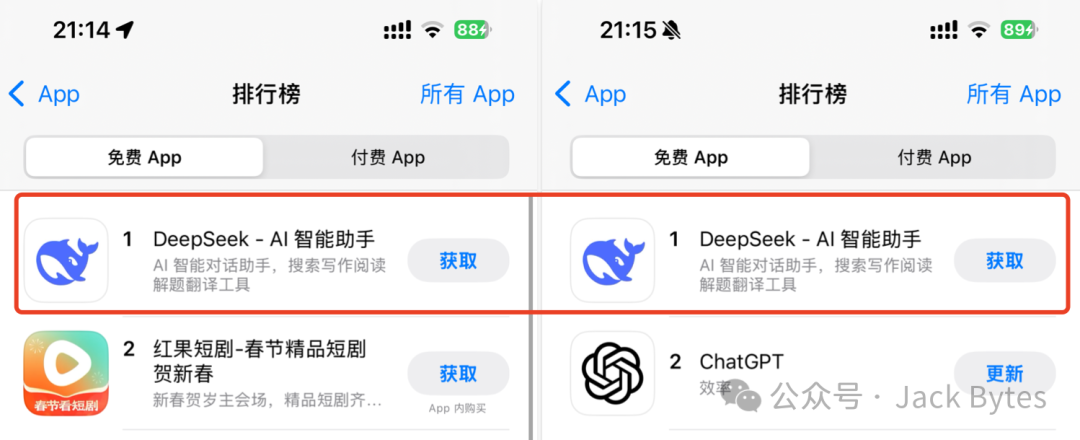

DeepSeek被质疑抄袭?别怕!在本地部署DeepSeek R1,并添加私有知识库,支持联网搜索!

兄弟们,最近DeepSeek的热度真的是一波接着一波,先是登上中国和美国苹果应用榜单第一名:这一波做空,导致英伟达的股价暴跌10%+,市值蒸发6000亿美元:然后是受到大量来自美国IP的恶意攻击,导致线上服务瘫痪,无法进行注册:昨天,马斯克、OpenAI纷纷质疑DeepSeek抄袭,白宫也对DeepSeek展开国家安全调查:这一系列事件都表明:他们慌了。其实他们不管质疑不质疑,先不管用什么手段,来…- 0

- 0

-

Cursor帮我节约了90%的时间

事情是这样的,半年之前,那时候我已经知晓了AI的出现,我偶尔会使用一下诸如kimi、阿里千问这样的产品。都平平无奇,对工作最多锦上添花,甚至很多AI有点傻。直到我使用到了Cursor,彻底转变了我对AI的看法。在我深度使用,开发了一款又一款应用后,最令我感到震惊的是它的大工程能力。比如我现在要开发一款应用,我告诉他想法和需求,他不只会分析描述的内容,还会结合已有项目的内容进行综合分析。这一点,也不…- 0

- 0

-

3步,0代码!一键部署DeepSeek-V3、DeepSeek-R1

阿里云PAI Model Gallery支持云上一键部署DeepSeek-V3、DeepSeek-R1。在该平台上用户可以零代码实现从训练到部署再到推理的全过程,简化模型开发流程,为开发者和企业用户带来了更快、更高效、更便捷的AI开发和应用体验。第一步:进入Model Gallery页面点击文末阅读原文,或复制链接:https://pai.console.aliyun.com/?utm_conte…- 0

- 0

-

别被Deepseek低成本冲昏头!本地化部署后续的“甜蜜陷阱”,你真能扛住吗?

最近,Deepseek的爆火让整个科技圈沸腾,甚至已向各行各业的普通人蔓延。像我这样关心AI的人,在我的今日头条首页,“DeepSeek浓度”已经达到了80%,好像掉入了一个DeepSeek的信息茧房。朋友圈里,技术大牛们纷纷晒出自己的“私人版知识库利器”,论坛上也充斥着各种“手把手教你本地部署”的教程。一时间,“人人都能拥有自己的AI助手”似乎成了现实。但冷静下来想想:这真的是适合所有人的最好选…- 0

- 0

-

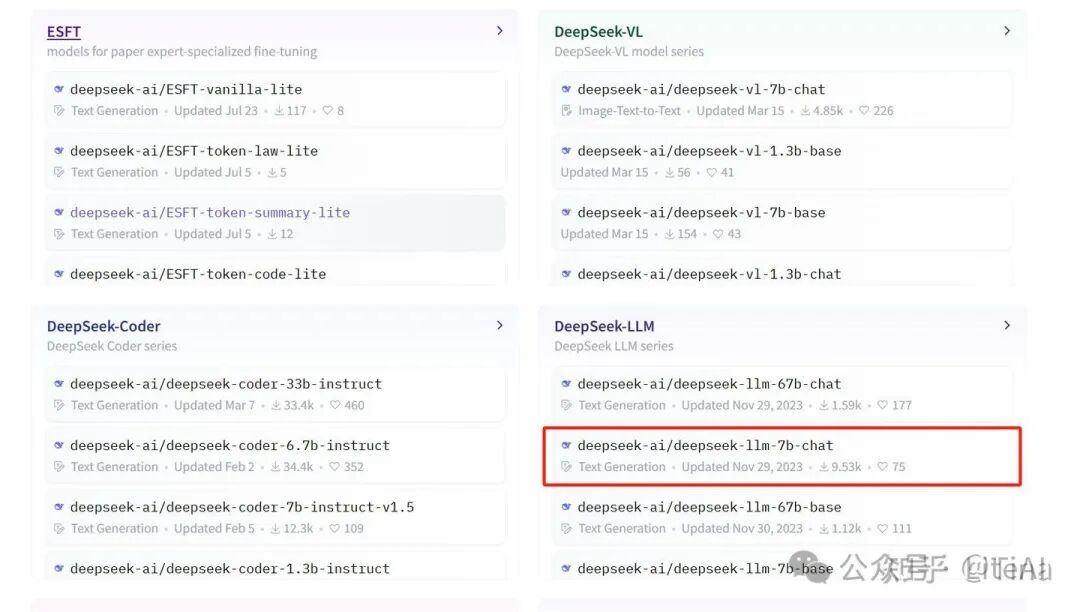

DeepSeek-llm-7B-Chat微调教程

前言DeepSeek系列大模型由杭州深度求索人工智能基础技术研究有限公司提供,该系列大模型有以下这些优势:高性价比:DeepSeek-V2模型以其史无前例的性价比著称,推理成本被降到每百万token仅1块钱,约等于Llama3 70B的七分之一,GPT-4 Turbo的七十分之一。架构创新:DeepSeek对模型架构进行了全方位创新,提出崭新的MLA(一种新的多头潜在注意力机制)架构,把显存占用降…- 0

- 0

-

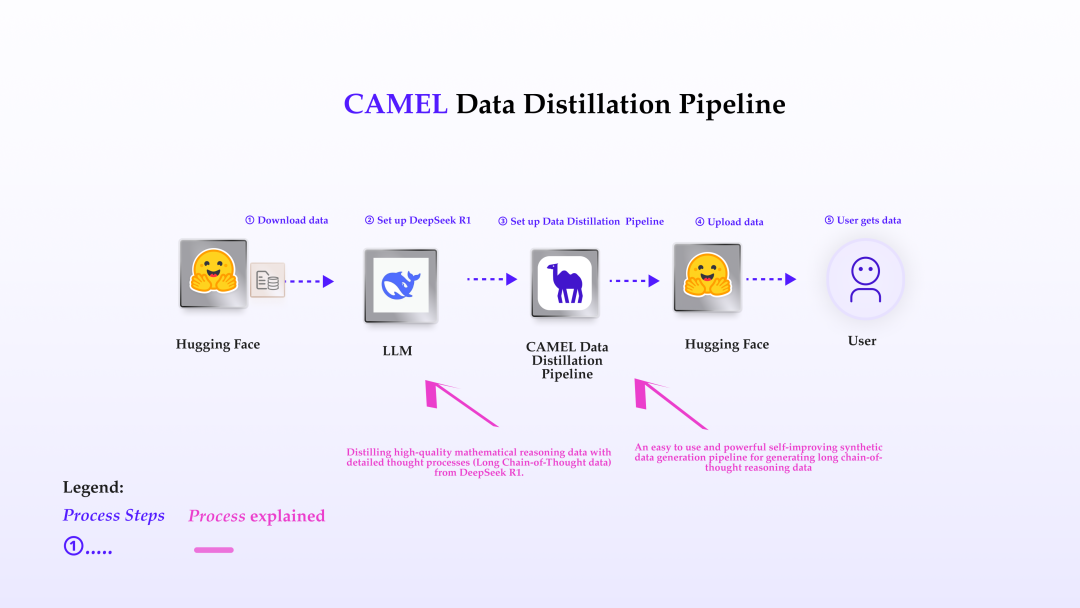

如何用CAMEL从DeepSeek-R1蒸馏数学推理数据?手把手教你实现!

DeepSeek R1,这款备受瞩目的业界领先的推理模型,凭借卓越的数学推理能力和高效的逻辑处理,在近期引发了广泛关注。无论是基础算术还是复杂的数学难题,它都能轻松应对,为开发者提供强大的计算支持。现在,结合 CAMEL 框架,我们可以利用长链式思维(Long Chain-of-Thought, CoT)提取数学问题的详细推理过程,从 DeepSeek R1 中蒸馏出高质量的数…- 0

- 0

-

完整的671B MoE DeepSeek R1怎么塞进本地化部署?详尽教程大放送!

过年这几天,DeepSeek 算是彻底破圈了,火遍大江南北,火到人尽皆知。虽然网络版和 APP 版已经足够好用,但把模型部署到本地,才能真正实现独家定制,让 DeepSeek R1 的深度思考「以你为主,为你所用」。关于本地部署,大多数人使用的是蒸馏后的8B/32B/70B版本,本质是微调后的Llama或Qwen模型,并不能完全发挥出DeepSeek R1的实力。然而,完整的6…- 0

- 0

-

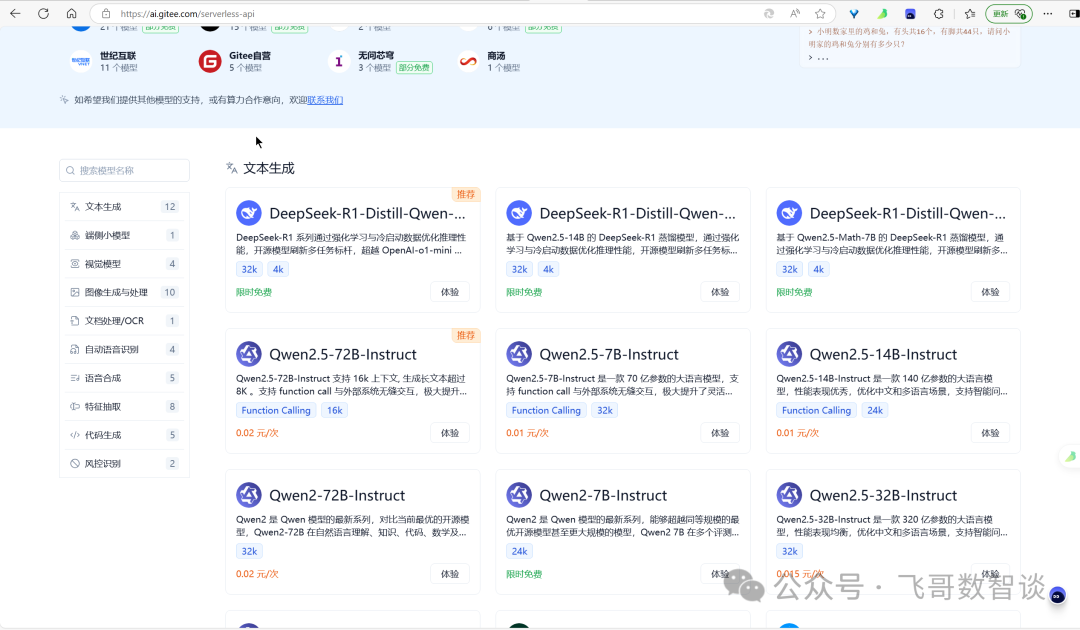

基于GiteeAI快速搭建自有DeepSeek

前言DeepSeek的能力有目共睹,但是最近对话服务由于一些外部原因经常出现无法响应的情况,用起来不是很顺畅。作为一个工程师,今天我们尝试通过一些免费资源快速搭建一个自用的DeepSeek。开发软件毋庸置疑是Cursor,只有不断使用,我们才能更加准确的把握它的能力范围。模型的话直接采用Gitee AI提供的Serverless API,重要的是,每个账号每天有100次免费使用机会。前置知识Git…- 0

- 0

-

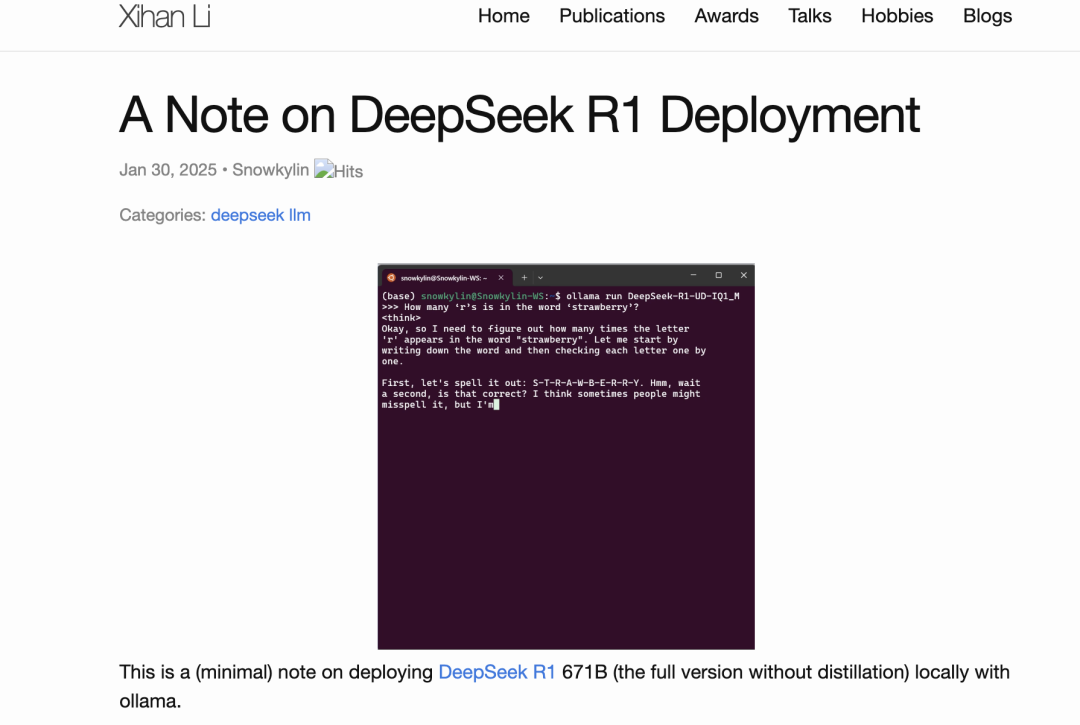

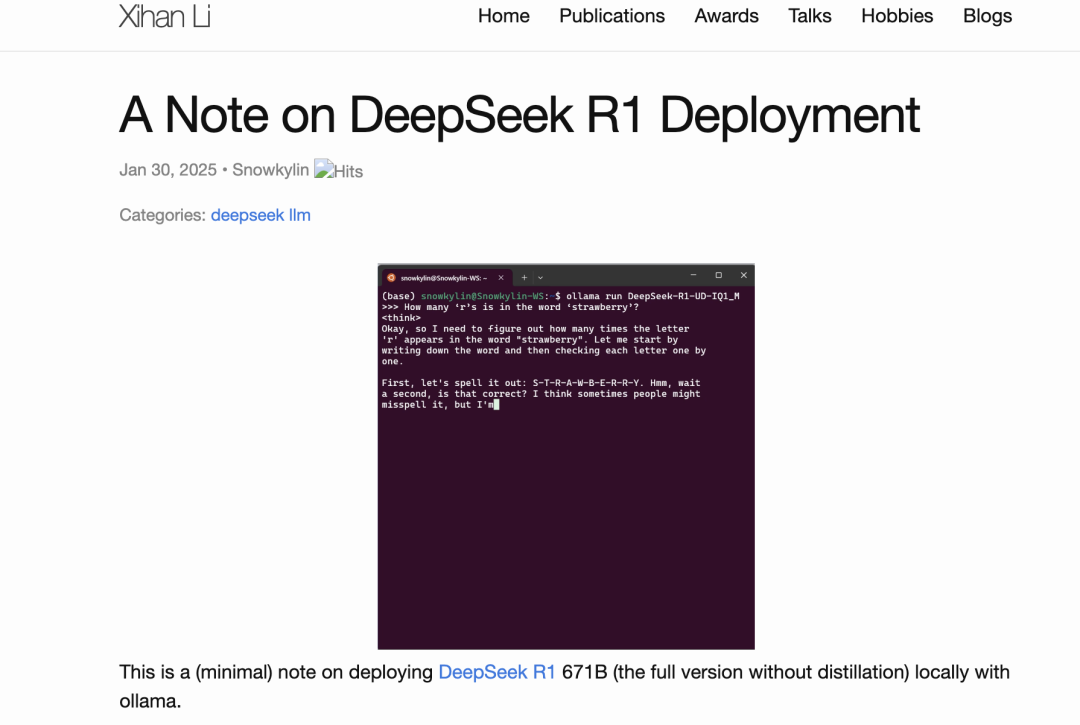

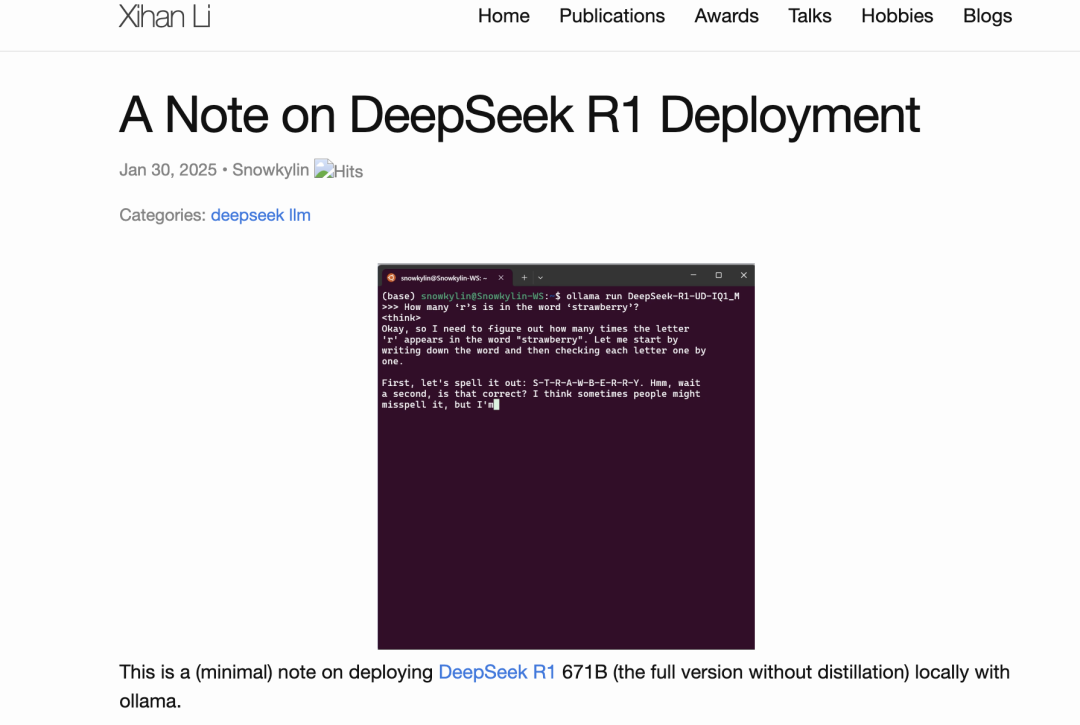

DeepSeek R1 671B 完整版本地部署教程来了!!!

来源 | 机器之心本文的作者是李锡涵(Xihan Li)。他是伦敦大学学院(UCL)计算机系博士研究生,谷歌开发者专家,主要研究方向为学习优化,在 NeurIPS、ICLR、AAMAS、CIKM 等会议发表过学术论文,Circuit Transformer 作者,图书《简明的 TensorFlow 2》(https://tf.wiki)作者。过年这几天,DeepSeek 算是彻底破圈了,…- 0

- 0

-

一文读懂DeepSeek-R1本地部署配置要求(建议收藏)

发布把AI带回家:DeepSeek-R1本地部署指南!再也不怕宕机了!!后,有不少读者私信询问本地部署DeepSeek-R1的电脑配置要求。收到,本文来一起看看DeepSeek-R1每个版本的配置要求及适合场景。根据 Ollama 平台提供的 DeepSeek-R1 模型信息,以下是不同参数量模型的本地部署硬件要求和适用场景分析。注:部分数据基于模型通用需求推测,具体以实际部署…- 0

- 0

-

本地Ollama部署DeepSeek R1模型接入Word

本地部署的优势如下:1.响应速度快本地处理减少网络传输,响应速度更快。且本地部署的稳定性更强,不受网络波动影响,确保服务持续可用。2.数据隐私与安全文本数据无需上传至外部服务器,降低了泄露风险。3.完全免费虽然DeepSeek的API key费用极低,但在高强度的办公场景下仍需要消耗一笔费用。本地部署模型能够做到完全免费,不花一分钱。接下来,本文将讲述如何本地部署DeepSeek-R1模型,并将其…- 0

- 0

-

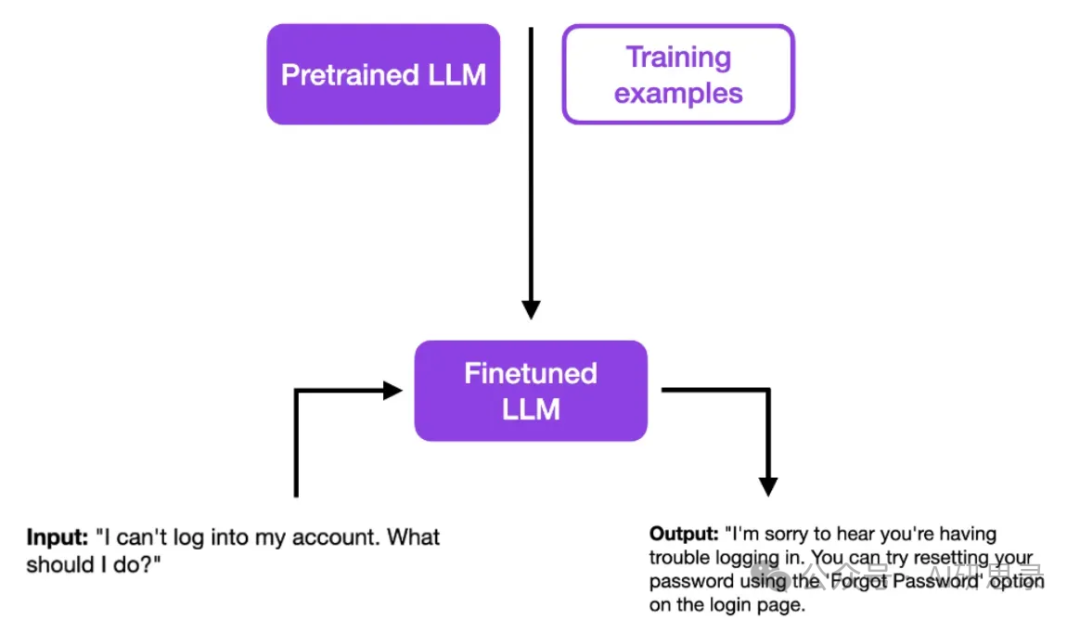

白话科普 | 看完即可上手DeepSeek训练,构建专属大模型,LoRA技术让你轻松训练行业大模型

微调(Fine-tuning)是AI领域的“秘密武器”,它让普通人也能轻松打造专属的大语言模型。本文深入解析微调的核心原理,结合实际代码案例,手把手教你如何用LoRA(Low-Rank Adaptation)高效微调大模型。从数据准备到参数配置,再到模型训练与评估,每一步都详细拆解。无论你是技术小白还是资深开发者,都能从中找到启发。为什么微调是AI普惠的关键?在AI领域,大模型的预训练就像建造一座…- 0

- 0

-

o3-mini来了,OpenAI首个可以免费用的推理模型!还是被DeepSeek卷到了!

清晨六点半,窗外还泛着薄雾般的青灰色,枕边的手机突然发出刺耳的蜂鸣。迷蒙中伸手摸索着关闭闹钟,一道冷光却猝然刺破昏暗——屏上跳出的消息写着:“o3-mini 来了”。瞬间,尚未清醒的神经仿佛被注入了一剂浓缩咖啡,我猛地从床上坐起,连拖鞋都来不及穿就冲向了电脑。今天,OpenAI 发布了两个版本:o3-mini 和 o3-mini-high。o3-mini 系列:小型推理模型的全新进化o3-mini…- 0

- 0

❯

购物车

优惠劵

搜索

扫码打开当前页

联系我们

返回顶部

幸运之星正在降临...

点击领取今天的签到奖励!

恭喜!您今天获得了{{mission.data.mission.credit}}积分

我的优惠劵

-

¥优惠劵使用时效:无法使用使用时效:

之前

使用时效:永久有效优惠劵ID:×

没有优惠劵可用!