为什么微调是AI普惠的关键?

在AI领域,大模型的预训练就像建造一座摩天大楼的地基,而微调则是为这座大楼装上定制化的窗户和门,让它更适合你的需求。无论是ChatGPT、GitHub Copilot,还是最近爆火的DeepSeek,背后都离不开微调技术的身影。

微调并不是什么高深莫测的东西,它是一种利用已有大模型,通过少量数据和计算资源,快速适配特定任务的技术。简单来说,就是“站在巨人的肩膀上”,用更低的成本和更高的效率,打造属于自己的AI工具。

这篇文章将带你深入了解微调的核心原理,并通过代码实例展示如何使用LoRA进行高效微调。无论你是技术小白还是资深开发者,都能从中找到启发。

一. 什么是微调?为什么要微调?

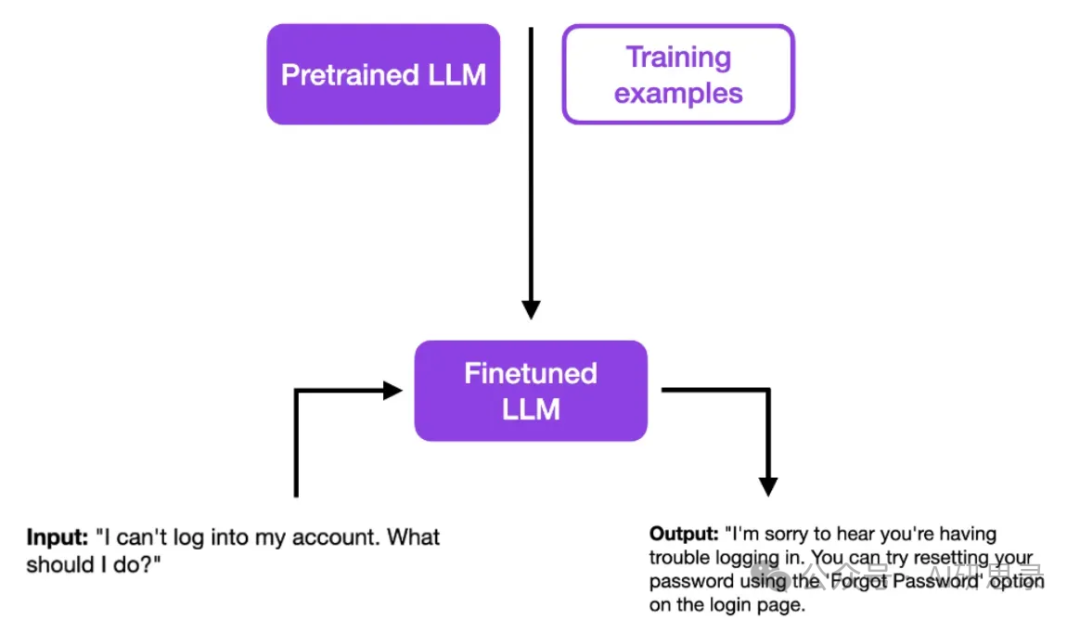

1. 微调的基本概念

微调(Fine-tuning)是指在已经训练好的大模型基础上,针对特定任务或场景进行进一步训练的过程。与从零开始训练一个模型相比,微调可以大幅降低时间、计算资源和数据的需求。

举个例子,假设你有一个通用的大语言模型,它可以回答各种问题,但对医疗领域的专业术语并不熟悉。这时,你可以通过微调,用少量医疗相关的数据重新训练这个模型,让它成为一位“医疗专家”。

2. 微调能解决什么问题?

-

增强特定领域能力:比如情感分类、对话生成、API编排等。 -

减少幻觉现象:让模型生成的内容更加准确、可靠。 -

提高一致性:即使每次生成的内容不同,也能保持高质量。 -

降低成本:相比于从头训练,微调所需的计算资源和数据量少得多。 -

避免数据泄露:可以在本地或私有云环境中完成微调,保护敏感数据。

简而言之:微调四大作用

-

知识植入:让AI学会《药典》中的专业术语 -

思维矫正:杜绝“秦始皇用iPhone”式幻觉 -

个性定制:1小时克隆马斯克的推特文风 -

成本瘦身:70亿参数模型效果碾压万亿基座

3. 微调的实际应用

-

模拟特定人物说话方式:比如character.ai,通过微调让模型模仿某个历史人物或名人。 -

支持多国语言:让模型学会处理小语种或方言。 -

行业专用模型:如医疗大模型、法律大模型、金融风控模型等。 -

艺术创作:比如Stable Diffusion中的“炼丹”教程,很多都是基于微调技术。

二. 微调的核心步骤与技术细节

1. 数据准备:高质量+多样性

微调的第一步是准备好高质量的数据。正如一句老话所说:“Garbage in, garbage out”。如果你喂给模型的是垃圾数据,那么输出的结果也会很糟糕。

-

高质量:确保数据标注准确,尽量人工生成而非依赖其他模型。 -

多样性:覆盖尽可能多的场景,避免模型过拟合。 -

数量要求:通常50-100条数据就能看到明显效果,1000条左右可以达到不错的效果。

数据格式通常如下

数据集通常采用了 JSON 格式 ,并且每一条数据记录由三个主要字段组成:instruction、input 和 output。

{

"instruction": "介绍疾病",

"input": "请介绍一下什么是急性肠胃炎",

"output": "急性胃肠炎是由各种原因引起的胃肠黏膜的急性炎症,可以由各种不同类型的病原微生物如细菌、病毒、寄生虫所引发。此外,非感染的因素如吸取刺激性食物、药物、酒精或食品过敏也可能引起急性胃肠炎。通常,该病多发生于夏秋季节,并且儿童或抵抗力较差的人群更易感。

常见的急性胃肠炎的临床症状包括恶心、呕吐、腹痛和腹泻,严重者可能出现脱水、电解质失衡以及生命威胁。疾病可通过接触带菌者或吃喝被污染的食物和水进行传播,也可由人与人直接接触传播。",

},

{

"instruction": "介绍疾病",

"input": "请介绍一下什么是高血压",

"output": "高血压(也称血压升高),是血液在流动时对 血管壁 造成的压力值持续高于正常的现象。根据《中国高血压临床实践指南》,成人高血压的诊断标准是 收缩压 ≥130mmHg和/或 舒张压 ≥80mmHg。高血压的发病原因多为遗传因素和不健康的生活方式,如高盐饮食、过量饮酒、长期精神紧张和体力活动不足等。",

},

]

每条数据是一个 JSON 对象,包含以下字段:

-

instruction(指令) -

描述任务类型或模型需要完成的任务目标。 -

这个字段定义了模型在当前对话中的角色或功能。例如,示例中, instruction的值为"介绍疾病",表示模型的任务是“介绍某种疾病的定义和相关信息”。 -

input(输入) -

提供具体的输入内容或问题,作为模型生成输出的依据。 -

在示例中, input的值分别为"请介绍一下什么是急性肠胃炎"和"请介绍一下什么是高血压",这是用户提出的具体问题。 -

output(输出) -

模型需要生成的目标答案或响应内容。 -

这个字段包含了与 input相对应的正确答案。例如,针对"请介绍一下什么是急性肠胃炎",output提供了一段关于急性肠胃炎的详细描述。

数据集的特点

-

结构化清晰 每条数据都遵循统一的格式,便于模型理解和学习。

instruction明确了任务类型,input提供了具体的上下文,output则给出了正确的回答。 -

任务导向 数据集以任务为中心,通过

instruction字段明确了模型需要完成的任务类型。这种设计使得数据集适用于多种应用场景,例如问答系统、知识科普、医疗咨询等。 -

高质量标注

output字段的内容通常是经过人工整理或专业审核的高质量文本。这种高质量的标注能够帮助模型更好地学习特定领域的知识。 -

多样性 虽然示例中只展示了“介绍疾病”的任务,但实际数据集中可以通过不同的

instruction值来支持多种任务类型。例如: -

instruction: "翻译句子",input: "将‘你好’翻译成英文",output: "Hello"。 -

instruction: "生成代码",input: "写一个Python函数计算斐波那契数列",output: Python代码片段。

2. 参数设置:学习率、LoRA配置等

在微调过程中,参数设置至关重要。以下是几个关键点:

-

学习率:控制模型更新的速度,过大容易导致震荡,过小则收敛缓慢。 -

LoRA配置: -

r:低秩矩阵的秩,通常设置为1~8,经验值为4。 -

lora_alpha:缩放因子,用于控制LoRA矩阵对原始权重的影响程度,建议初始值设为32。 -

lora_dropout:防止过拟合的参数,通常设置为0.01。

3. 模型选择:LoRA的优势

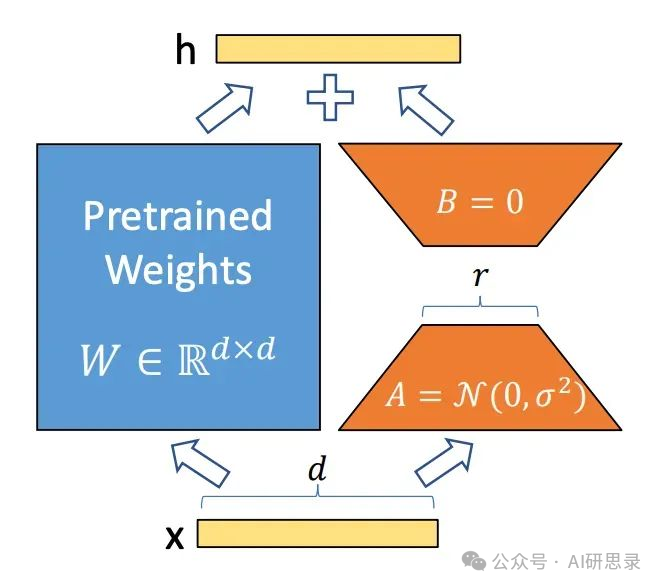

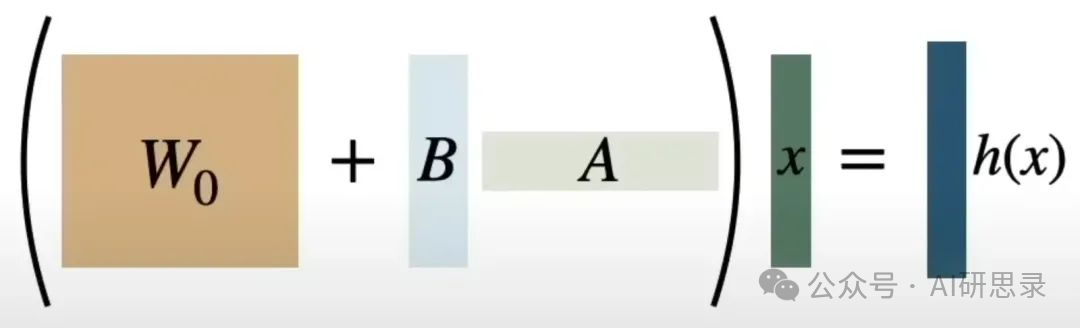

LoRA(Low-Rank Adaptation)是一种高效的微调方法,其核心思想是通过引入低秩矩阵来减少需要更新的参数数量。(来源 LoRA 论文:LORA: LOW-RANK ADAPTATION OF LARGE LANGUAGE MODELS)

LoRA 原理具体

-

模型原始模型的权重矩阵是一个高维矩阵(如768×768),直接调整所有参数会消耗大量计算资源。 -

LoRA将其分解为两个低维矩阵(如768×4和4×768),从而显著降低了计算成本。

以一个具体的例子来看:

-

如果模型原始矩阵维度为1000×1000,需要调整100万个参数。 -

使用LoRA后,仅需调整1000×4 + 4×1000 = 8000个参数。

打个比方,这就像你有一把瑞士军刀,里面有很多工具(像剪刀、螺丝刀等等),但是在解决特定任务时,通常只需要用到其中的几个工具就可以完成大多数工作。在这个例子中,模型的矩阵就像瑞士军刀,虽然它很复杂(全秩),但实际上你只需要用到一些简单的工具(低秩)就足够了。

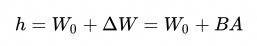

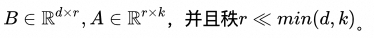

也就是说微调的时候,只调整那些对特定任务有影响的参数就可以了。原始矩阵维度较高,假设为 维矩阵 ,要想进行矩阵调整,并且保持矩阵的数据(为了重用),最简单方式是使用矩阵加法,增加一个 维度的矩阵 。但如果微调的数据,还是一个 维度的矩阵,参数量就很多。LoRA 通过将后者表示为低秩分解,来减少参数的量级。

举例来说,假设原始权重矩阵 的维度为 ,如果直接对其进行全参数微调,则需要调整 个参数。而 LoRA 通过将 分解为两个低秩矩阵 和 ,显著减少了参数数量。

假设 为低秩矩阵的秩, 的维度为 , 的维度为 。此时,需要调整的参数数量为 。如果 较小(如 4),则参数数量大幅减少。

其中

LoRA的可重用性

LoRA的一个重要特性是可重用性。由于LoRA不改变原模型的参数,因此可以在多任务或多场景中灵活应用。例如,在手机终端上运行的模型可以根据不同的任务动态加载对应的LoRA参数,从而大大降低存储和运行空间的需求。

这种高效性使得即使是普通人,也可以在免费的GPU资源(如Google Colab)上完成微调。

4. 代码示例:用LoRA微调DistilBERT

以下是一个简单的代码示例,展示如何用LoRA微调一个DistilBERT模型,用于电影评论的情感分类任务。

-

初始模型:https://huggingface.co/distilbert/distilbert-base-uncased -

微调数据:https://huggingface.co/datasets/stanfordnlp/imdb -

Python代码:

# 安装必要库

!pip install datasets transformers peft

# 加载IMDB数据集

from datasets import load_dataset

dataset = load_dataset("stanfordnlp/imdb")

# 加载初始模型

from transformers import AutoModelForSequenceClassification, AutoTokenizer

model_name = "distilbert-base-uncased"

model = AutoModelForSequenceClassification.from_pretrained(model_name)

tokenizer = AutoTokenizer.from_pretrained(model_name)

# 数据预处理

def preprocess_function(examples):

return tokenizer(examples['text'], truncation=True, padding='max_length', max_length=128)

encoded_dataset = dataset.map(preprocess_function, batched=True)

# 配置LoRA

from peft import LoraConfig, get_peft_model

lora_config = LoraConfig(

task_type="SEQ_CLS",

r=4,

lora_alpha=32,

lora_dropout=0.01,

target_modules=["q_lin"]

)

model = get_peft_model(model, lora_config)

# 训练模型

from transformers import Trainer, TrainingArguments

training_args = TrainingArguments(

output_dir="./results",

evaluation_strategy="epoch",

learning_rate=5e-5,

per_device_train_batch_size=16,

num_train_epochs=3,

weight_decay=0.01

)

trainer = Trainer(

model=model,

args=training_args,

train_dataset=encoded_dataset["train"],

eval_dataset=encoded_dataset["test"]

)

trainer.train()

# 测试结果

predictions = trainer.predict(encoded_dataset["test"])

print(predictions.metrics)

这段代码展示了如何用LoRA微调一个67M参数的DistilBERT模型,最终将分类正确率从50%提升到87%。

三. 微调的未来与挑战

1. 算力门槛逐渐降低

随着算力成本的下降和微调技术的进步,越来越多的企业和个人能够参与到AI开发中。例如,DeepSeek的成功证明了,即使没有顶级GPU,也可以通过算法优化实现顶尖性能。

2. 数据质量的重要性

尽管微调降低了对数据量的需求,但对数据质量的要求却越来越高。未来,如何获取高质量、多样化的数据将成为微调成功的关键。

3. 行业专用模型的崛起

随着微调技术的普及,各行各业都将出现更多专用AI模型。这些模型不仅能提高工作效率,还能为企业带来巨大的商业价值。

四:微调的最佳实践与注意事项

1. 数据质量的重要性

高质量的数据是微调成功的关键。即使是少量数据,只要质量足够高,也能取得显著效果。因此,在收集数据时,应尽量确保数据的准确性、多样性和代表性。

2. 防止过拟合

微调过程中,模型可能会因为数据量较少而出现过拟合现象。为了防止这种情况,可以通过以下方法进行优化:

-

增加正则化:如L2正则化或Dropout。 -

使用交叉验证:通过多次划分训练集和验证集,评估模型的泛化能力。 -

调整超参数:如学习率、批量大小等。

3. 微调后的评估

微调完成后,应对模型进行充分的评估,以确保其在目标任务上的表现达到预期。常用的评估指标包括准确率、F1分数、BLEU分数等。

五. 微调的实际应用场景

1. 情感分析

情感分析是微调的经典应用场景之一。通过微调,可以让模型更好地理解文本中的情感倾向,从而用于舆情监控、用户反馈分析等领域。

2. 对话系统

微调可以帮助模型更好地适应对话任务,使其生成的回复更加自然、连贯。例如,通过微调,可以让模型模仿特定人物的说话风格,从而用于虚拟助手或游戏角色。

3. 多语言支持

微调还可以用于扩展模型的语言支持范围。例如,通过微调,可以让模型学会处理小语种或方言,从而满足全球化的需求。

六. 微调的未来发展与趋势

1. 自动化微调

随着自动化机器学习(AutoML)的发展,未来的微调过程可能会变得更加智能化和自动化。例如,通过自动搜索最佳超参数、自动选择微调策略等,进一步降低微调的技术门槛。

2. 联邦学习与隐私保护

联邦学习是一种分布式机器学习方法,允许多个设备或机构在不共享数据的情况下共同训练模型。未来,微调技术可能会与联邦学习相结合,从而在保护数据隐私的同时实现模型的优化。

3. 更高效的微调方法

除了LoRA外,未来可能会涌现出更多高效的微调方法,如Adapters、Prefix Tuning等。这些方法将进一步降低微调的成本,使更多企业和个人能够参与到AI开发中。

抓住AI时代的机遇

微调技术让我们看到了AI普惠的可能性。无论是个人开发者还是中小企业,都可以通过微调打造自己的AI产品。DeepSeek的成功只是一个开始,未来还有无数机会等待我们去探索。