-

企业部署DeepSeek的AI基础设施方案建议

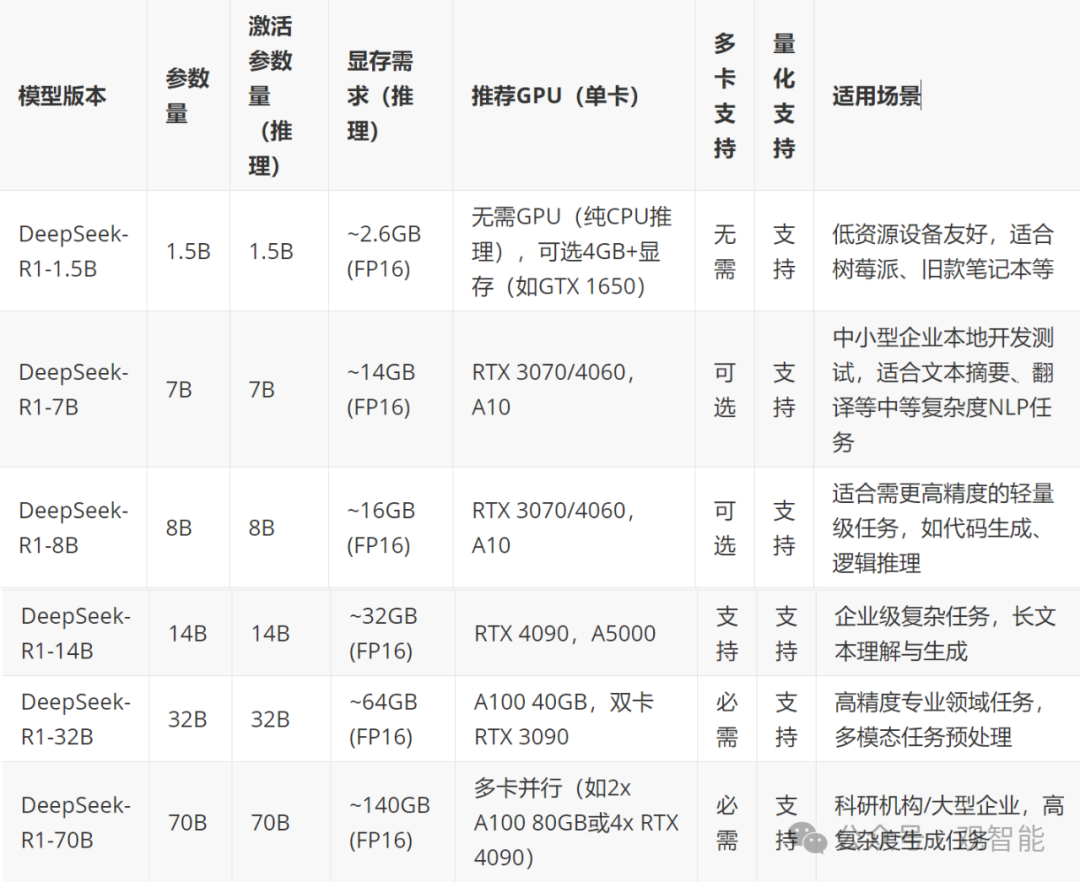

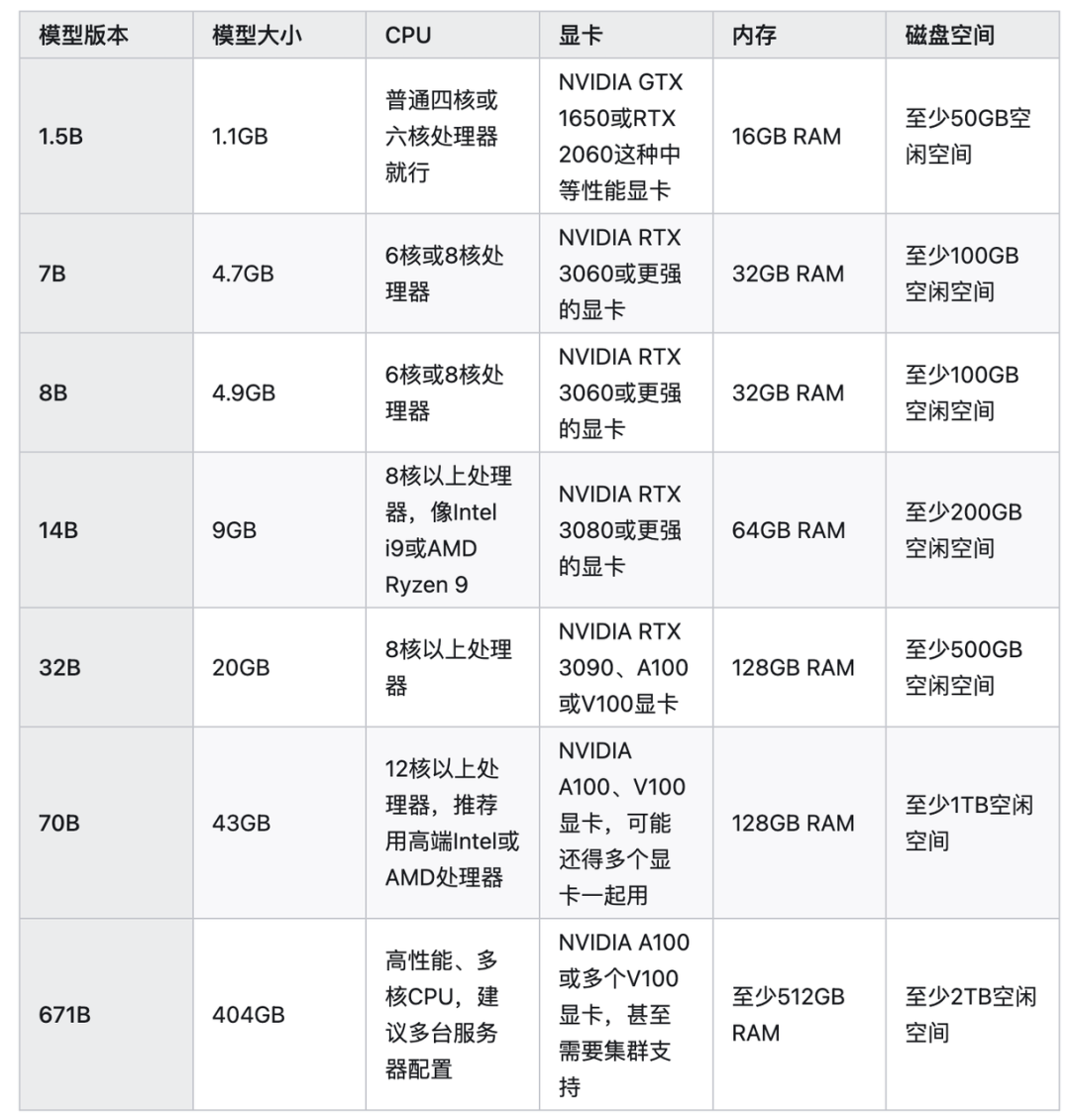

要成功实现 DeepSeek 大模型的私有化部署,绝非易事,从模型选型到基础设施搭建,再到推理部署工程优化,每一个环节都需要精心规划与考量。接下来,让我们深入探讨企业私有化部署 DeepSeek 的关键要点与策略。1 DeepSeek模型选型在企业进行 deepseek 大模型私有化部署时,模型选型是至关重要的第一步,它直接关系到后续的应用效果与成本投入。通过业务场景适配性分析确定合适的模型,能让…- 0

- 0

-

DeepSeek本地部署,可视化、无延迟、畅快使用

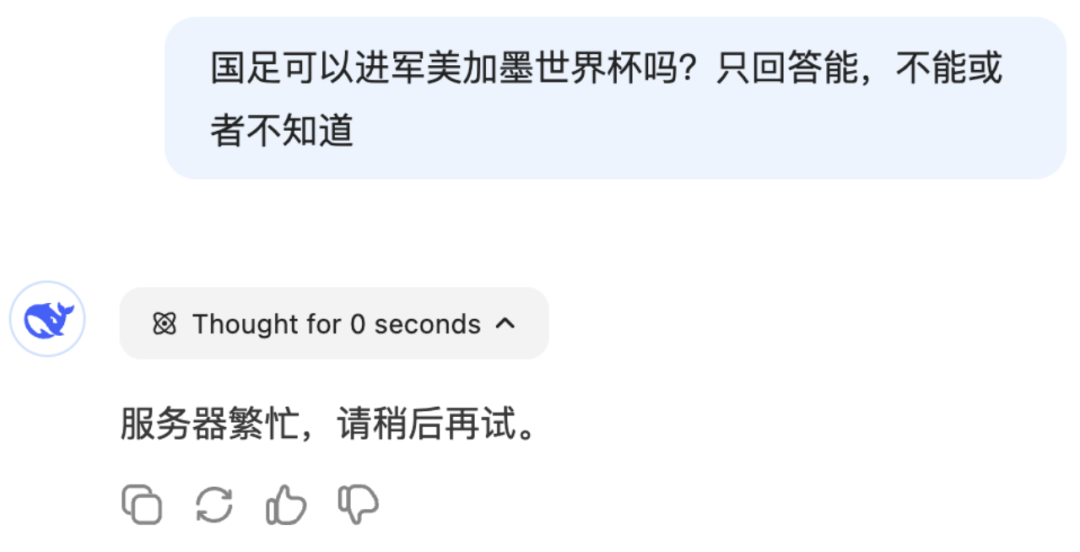

你的DeepSeek又提示服务器繁忙了吗?很多朋友已经发现DeepSeek的API服务能力远远没有跟上它的爆火程度,回答问题的响应速度明显比豆包、Kimi、智谱等国产大模型慢,时不时还会崩掉~~无论是个人体验还是企业业务,都需要一个低延迟响应大模型服务。此外,如果有数据隐私、定制化(微调、RAG、多模态)等需求时,本地部署就更加必要了。其中RAG技术请参阅LangChain+RAG第一步,选择模型…- 0

- 0

-

这次是我被吓尿了:Deepseek把APS排程优化公司的桌子掀翻了

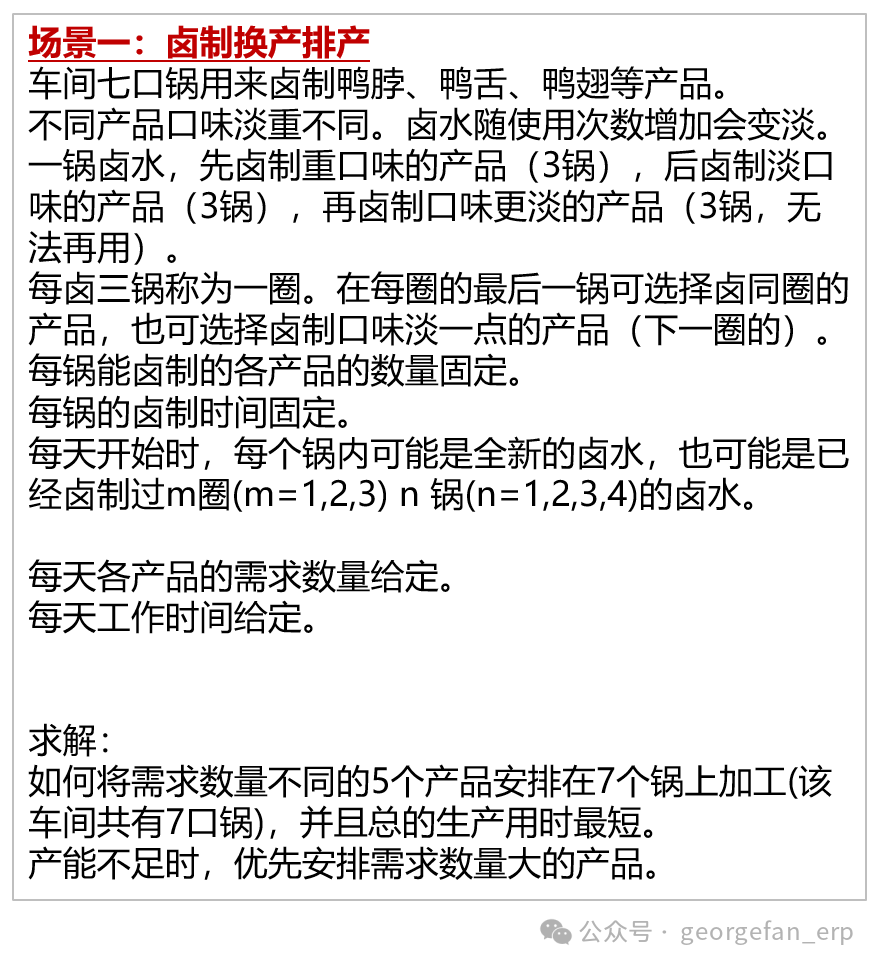

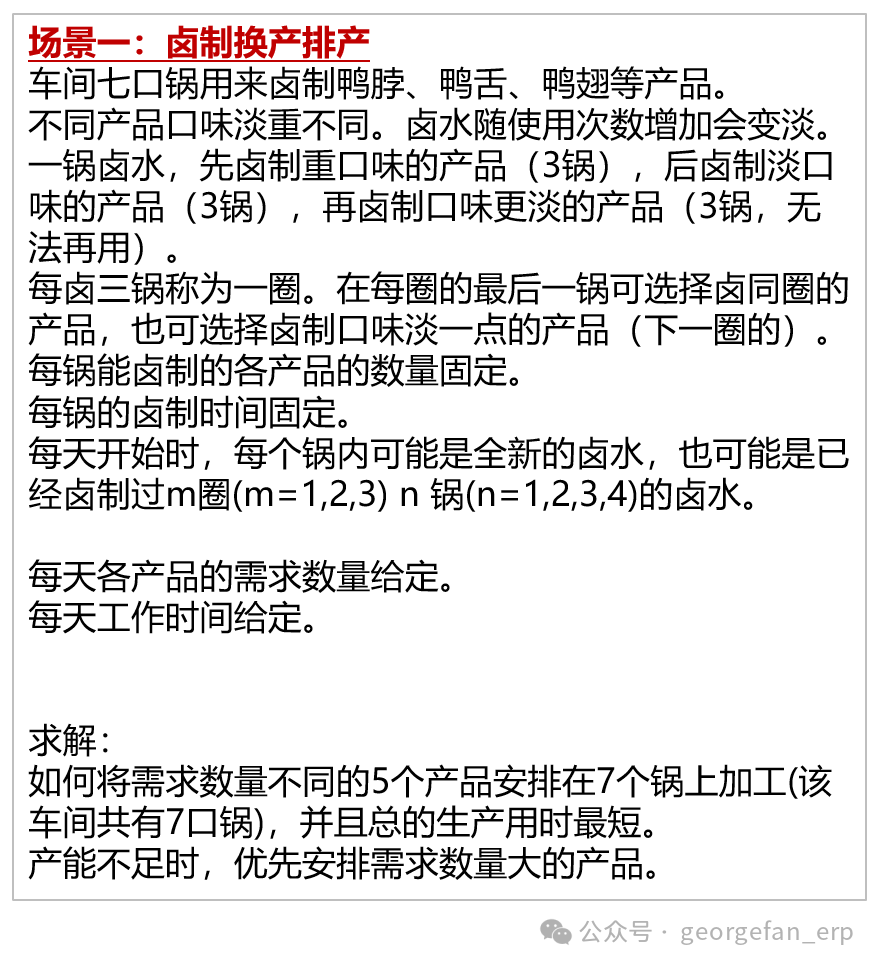

Deepseek的推理能力的边界在哪里?Deekseek的推理能力在ERP中能起些作用?今天向Deepseek问了一个排程优化的问题,Deepseek的推理时间用了407秒,我几乎闻到了服务器电源传出的焦糊的味道,然而,最终结果还是令人满意。问题的提出DeepSeek的输出为了解决卤制换产排产问题,需综合考虑卤水状态转换、产品需求优先级及产能分配,以最小化总生产时间。以下是分步解决方案:问题分析1…- 0

- 0

-

这次是我被吓尿了:Deepseek把APS排程优化公司的桌子掀翻了

Deepseek的推理能力的边界在哪里?Deekseek的推理能力在ERP中能起些作用?今天向Deepseek问了一个排程优化的问题,Deepseek的推理时间用了407秒,我几乎闻到了服务器电源传出的焦糊的味道,然而,最终结果还是令人满意。问题的提出DeepSeek的输出为了解决卤制换产排产问题,需综合考虑卤水状态转换、产品需求优先级及产能分配,以最小化总生产时间。以下是分步解决方案:问题分析1…- 0

- 0

-

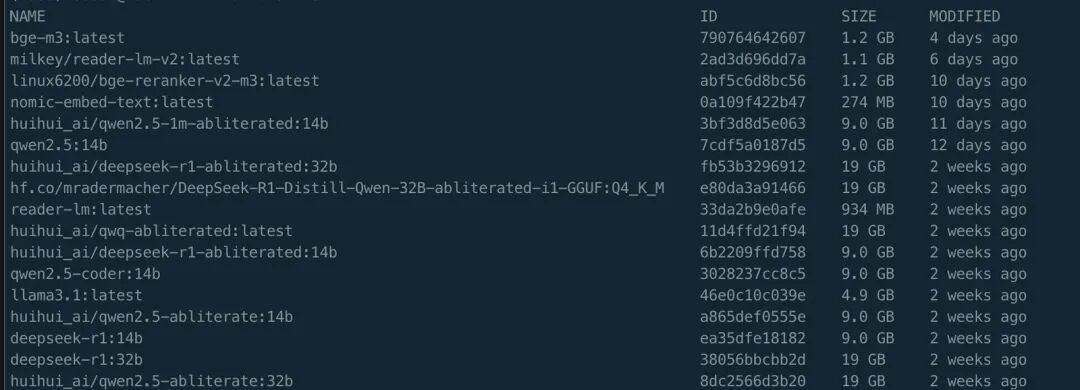

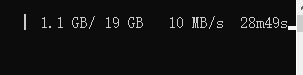

DeepSeek等8种大模型本地化部署及其表现

01背景 由于访问过多,目前满血版DeepSeek R1 (深度思考模式)使用经常受限:付费API的deepseek-reasoner模式也同样受限:OpenAI开放了免注册的chatbox,但还是有地区使用限制。本地化部署大模型有多种方式:Ollama和vLLM等。本文主要介绍Ollama的蒸馏模型(Distilled models)部署及其表现。 …- 0

- 0

-

字节MarsCode支持DeepSeek啦,深度思考过程教我学编程,AI做到了授人以渔

现在各个应用都在接入DeepSeek,编程工具中也不能漏掉,MarsCode在2月20号已经接入了DeepSeek,是时候体验一把了。安装MarsCode如果你还没有使用MarsCode,安装过程也介绍下,以Visual Studio Code中为例,打开VSCode扩展窗口,在搜索窗口搜索MarsCode,找到MarsCode 插件单击「install」,完成安装,登录即可使用MarsCode …- 0

- 0

-

大模型微调(Fine-tuning)全解,需要了解的都在这里

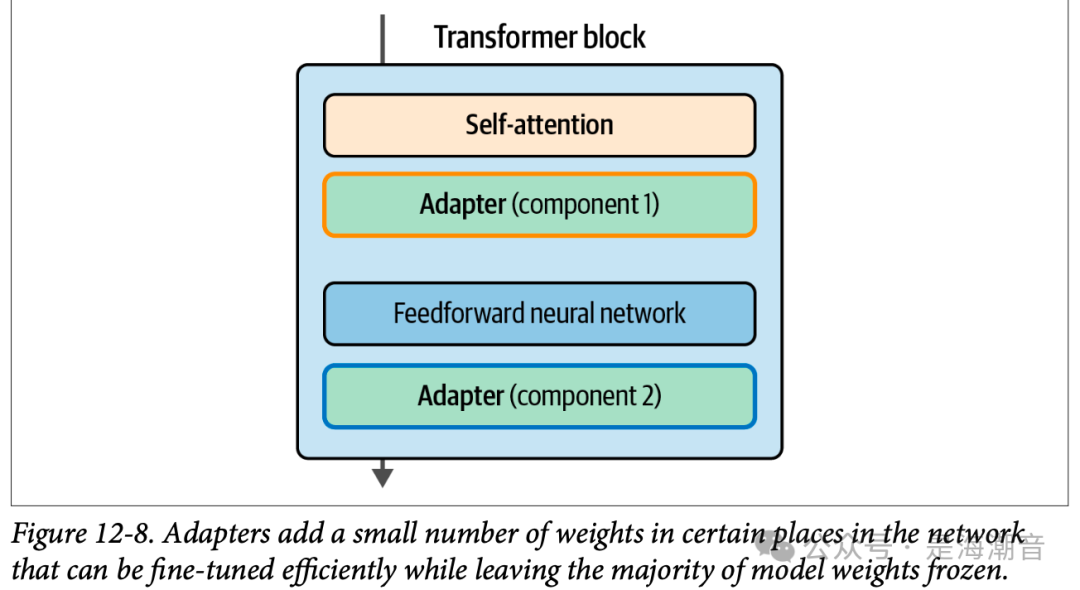

1. 微调基础概念介绍1.1 微调基本概念所谓大模型微调,指的在已有的大规模预训练模型基础上,通过对标注数据进行训练,进一步优化 模型的表现,以适应特定任务或场景的需求。不同于RAG或者Agent技术,通过搭建工作流来优化模型表现,微调是通过修改模型参数来优化模型能力,是一种能够让模型“永久”掌握某种能力的方法。1.2 全量微调与高效微调而从方法的大类上来划分,微调又可以划分为全量微…- 0

- 0

-

LLM 联网搜索,到底是咋回事?

0x0 序近段时间 DeepSeek 的服务火遍了全网,无论是使用网页还是使用 App 都能享受到 深度思考 + 联网搜索 的至尊体验。奈何免费的东西往往是需要排队的,从年开始 DeepSeek 的服务就一度处于不可用状态,就算是年后,网络搜索也是经常处于不可用的状态。所以这个和模型配套的网络搜索能力到底是什么东西呢?他是模型自带的?还是一种模型之外需要开发的附加功能呢?趁着我国补的 Mac Mi…- 0

- 0

-

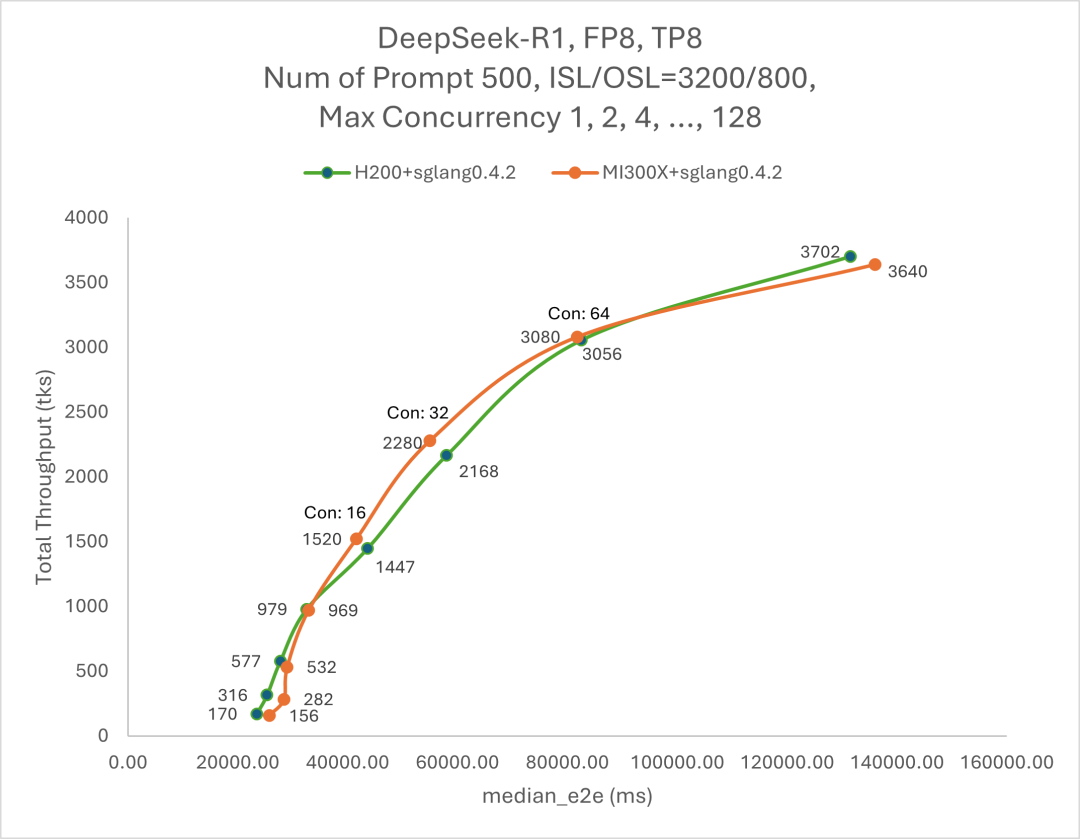

在火山引擎部署DeepSeek,更快、更省、更安全

DeepSeek 等大模型的持续火爆,让越来越多的行业开始接受和使用生成式 AI,但大规模 AI 推理场景也带来了新的技术挑战。大部分企业如果继续用现有的 IT 能力本地化部署 DeepSeek,将面临模型效果适配周期长、模型性能优化难度大、集群资源需求扩容慢等挑战。此外,运维成本高、安全风险难保障等问题也会拖慢 AI 业务创新节奏。而一旦遇到流量高峰,就需要继续在推理层加大 GPU 和算力的投入…- 0

- 0

-

MCP 三大核心概念(2): 用MCP实现数据调用、API执行与模板生成的完整链条

下面我会模拟三个“虚拟文件”,分别代表 Resources、Tools 和 Prompts,通过这些“文件”的内容来说明它们在 MCP 中的用法。每个文件都会有实际代码或伪代码,尽量贴近真实开发场景。文件 1:Resources 用法展示文件名:server_logs.txt描述:假设这是一个服务器日志文件,通过 MCP 的 Resources 暴露给 LLM,让它分析错误。内容:[2025-02…- 0

- 0

-

零基础入门:DeepSeek微调教程来了!

开门见山,直接给大家展示微调前后的效果。微调前:微调后:在此处可以看到很明显大模型进行微调后口吻已经发生了更改。据笔者使用下来的记录表示,微调后的大模型思考时间更加短暂。接下来,让我们一起逐步完成微调实践,共同优化模型性能!一、什么是大模型微调?微调就像给一个“学霸”补课,让它从“通才”变成某个领域的“专家”。此处以本文进行微调的医学数据进行举例: 假设你有一个很聪明的朋友,他读过全世界…- 0

- 0

-

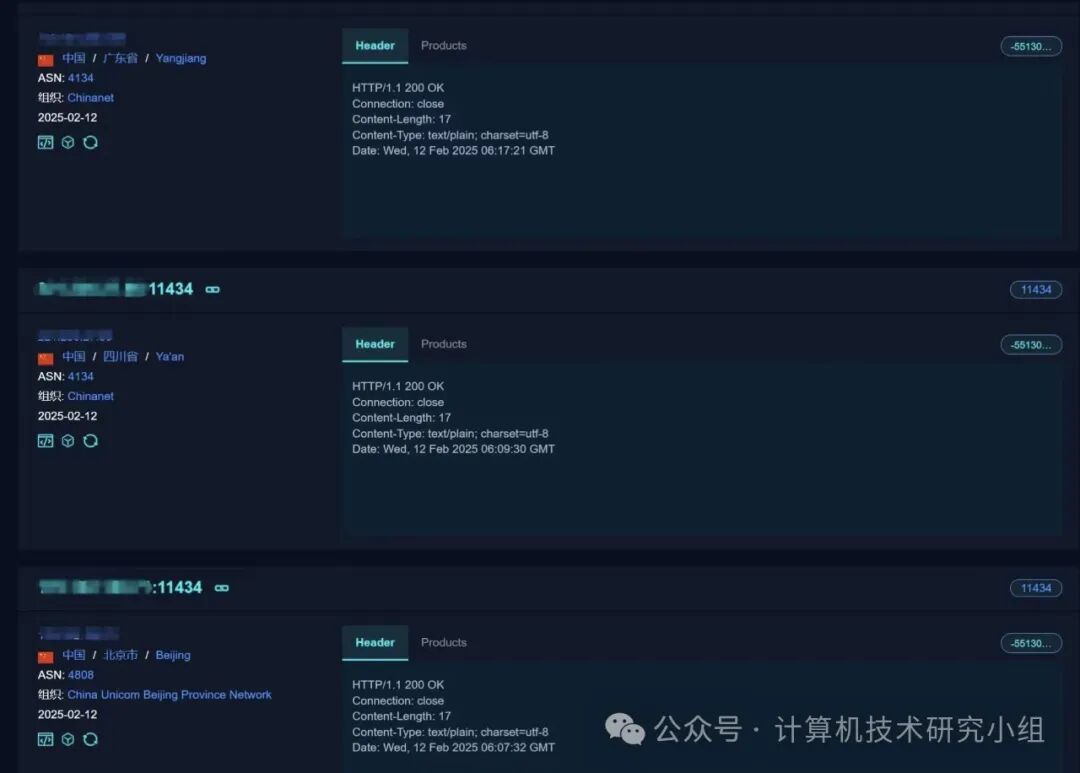

本地部署DeepSeek安全风险自查及安全加固方案

简要介绍 随着人工智能技术的快速发展,AI大模型DeepSeek部署需求日益增长。然而,在享受AI技术带来便利的同时,我们也不能忽视其背后潜在的安全风险。 近期有关DeepSeek本地部署存在安全风险事件的报道引发了关注,其中Ollama服务作为一个重要的开源框架,因其配置导致的安全风险受关注。本文将分析这一问题,并提供安全加固方案。安全风险原因…- 0

- 0

-

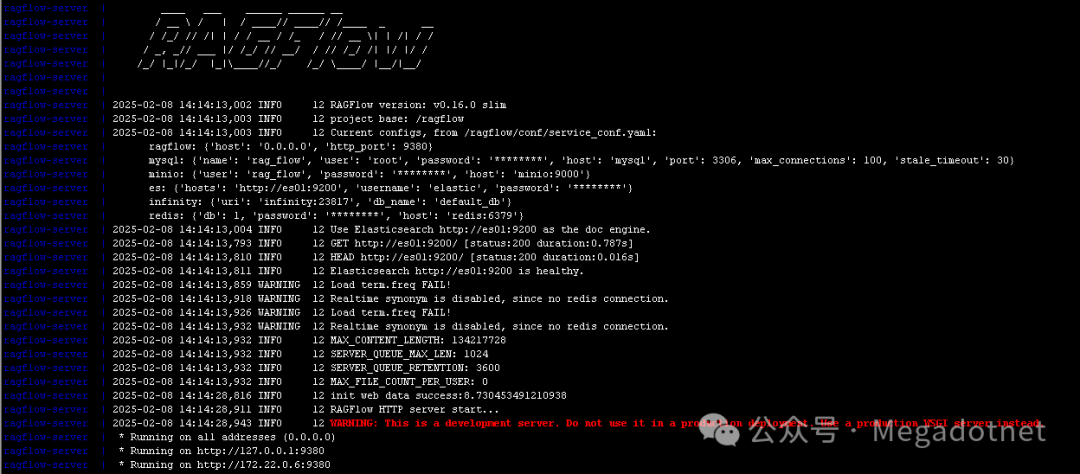

Ragflow v0.16部署实践

RAGFlow 部署方式基于 Docker 部署:前置条件:需要满足一定的硬件配置,如 CPU ≥ 4 核,RAM ≥ 16 GB,Disk ≥ 50 GB,同时安装 Docker ≥ 24.0.0 与 Docker Compose ≥ v2.26.1。操作步骤:首先克隆 RAGFlow 的仓库,进入其 Docker 文件夹,利用提前编译好的 Docker 镜像启动服务器。启动成功后,通过浏览器访…- 0

- 0

-

基于多教师蒸馏的持续学习技术

编者荐语在人工智能技术快速迭代的背景下,模型开发面临着如何在新任务中保持高效学习同时不遗忘旧知识这一重大挑战。本文深入介绍了持续学习技术的核心理念,并聚焦于多教师蒸馏方法,探讨如何通过多个模型协作来提升学习效率和新旧知识传递效果。期望本文能为关注持续学习技术创新的研究者与使用者提供全新的视角和有价值的参考。本文已在国际学术会议-信号处理顶级会议ICASSP 上发表。基于多教师蒸馏的持续学…- 0

- 0

-

核弹级产品 MetaGPT X 发布:一键生成全栈应用程序!

最近,一款名为 MetaGPT X(MetaGPT X)的产品横空出世,引发了广泛的关注和讨论。这款由 MetaGPT 团队推出的多智能体开发平台,被形容为“核弹级”产品,因为它在软件开发领域的影响力可能不亚于一场核爆。那么,MetaGPT X 到底是什么?它真的会让程序员集体失业吗?MetaGPT X 是什么?根据官方介绍, MetaGPT X&…- 0

- 0

-

单卡4090用Deepseek-R1思想GPRO训练QWen基础模型完整step

都是单刀直入,直接开干的风格。这里略微做下说明:A: 是基于Deepseek-R1蒸馏Qwen2.4-32B得到的模型DeepSeek-R1-Distill-Qwen-32B 做的 LoRA 微调。LoRA 是PEFT(Parameter-Efficient Fine-Tuning)参数高效微调的一种具体方法,简单理解就是锁定模型的大部分权重,只用特定领域的数据集训练改变少量权重以提升效果。优点是…- 0

- 0

-

通义灵码 + DeepSeek:AI 编程助手的强强联合,让开发效率飙升!

在 AI 技术飞速发展的今天,编程领域也迎来了深刻的变革。AI 编程助手的出现,不仅提高了开发效率,还降低了编程的门槛,让更多的开发者能够轻松应对复杂的开发任务。近期,阿里云旗下的通义灵码宣布全面支持 DeepSeek-V3 和 DeepSeek-R1 模型,这标志着 AI 编程领域又迈出了重要的一步。本文将…- 0

- 0

-

某安全团队针对网安大模型的微调初体验

前言某安全团队针AI 模型进行的微调。什么是微调?开源出来的模型相当于一个大学生,什么都会一点,但是什么都不精通,而经过数据训练微调的大模型,就好比报了个培训班,培训班的质量决定了专业领域的分析程度。大模型微调的相关技术难题1.数据集的投喂,如果想训练出一个专业的模型,需要大量的数据投喂,更何况是安全行业,数据本来就真真假假,且需要强大的知识体系才能治理处指定格式的数据。2.泛化能力下降,微调后的…- 0

- 0

-

DeepSeek R1 70B本地版和官网版测试: 思考深度、内容结构、语言风格、搜索能力有出入

本地化部署了R1 70B版本,配合Page Assist UI插件做了测试,这里用常见几个问题来测试一下本地版本和官网版本差距的区别。下图是不同版本配置图片的大小, 我部署的70B,我在96G内存的Macbook M2测试过,复杂问题等10秒开始思考回答,遇到要生成200字回答以上的复杂问题,笔记本风扇会响会发烫; 而64G的linux服务器则要等15秒才会开始回答,没有笔记本快,但是不会机器风扇…- 0

- 0

-

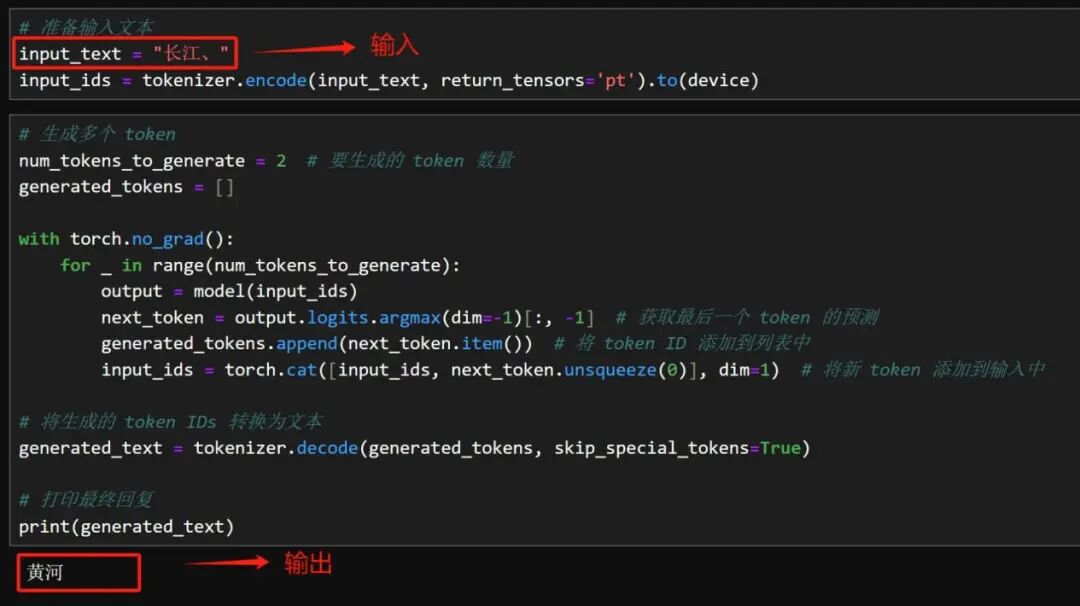

一文搞懂DeepSeek – 基于R1蒸馏Qwen1.5B

知识蒸馏是一种将复杂的大型模型(教师模型)的知识迁移到较小的模型(学生模型)中的技术。在这个过程中,教师模型的推理能力和知识被提炼并转移到学生模型中,从而使学生模型能够在保持较高性能的同时,具有更低的计算复杂度和资源消耗。图解深度学习 - 数据蒸馏和知识蒸馏DeepSeek通过创新的蒸馏技术、精心准备的数据、有效的蒸馏方法和模型微调与优化等手段,成功地将R1的模型能力蒸馏到Qwen-1.5B中,使…- 0

- 0

-

基于Ubuntu Ollama 部署 DeepSeek-R1:32B 聊天大模型(附带流式接口调用示例)

最近 DeepSeek出来了,很火,说是能跟ChatGpt o1 媲美,结果,用了DeepSeek的官方服务,提示“服务器繁忙 请稍后再试。”,我就想,算了,自己部署个吧。我这个是基于docker部署的,首先要docker 支持 显卡,这样才会跑的更快,基于CPU 还是比较卡的,耗费的内存也比较多。部署非常方便,除了下载很慢,基本都是环境问题,环境解决完就没啥大问题。服务器基础资源这就…- 0

- 0

-

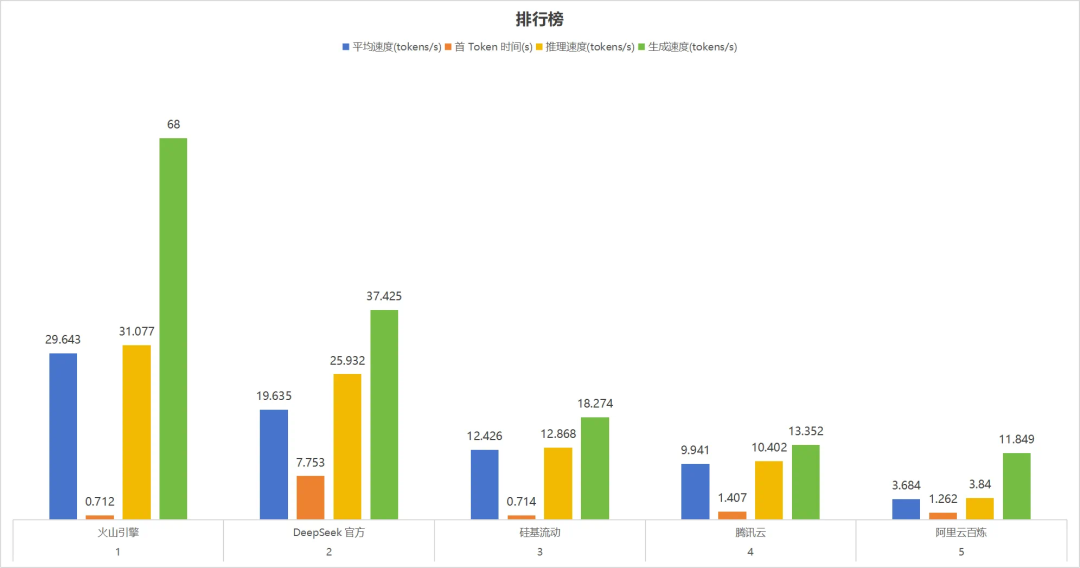

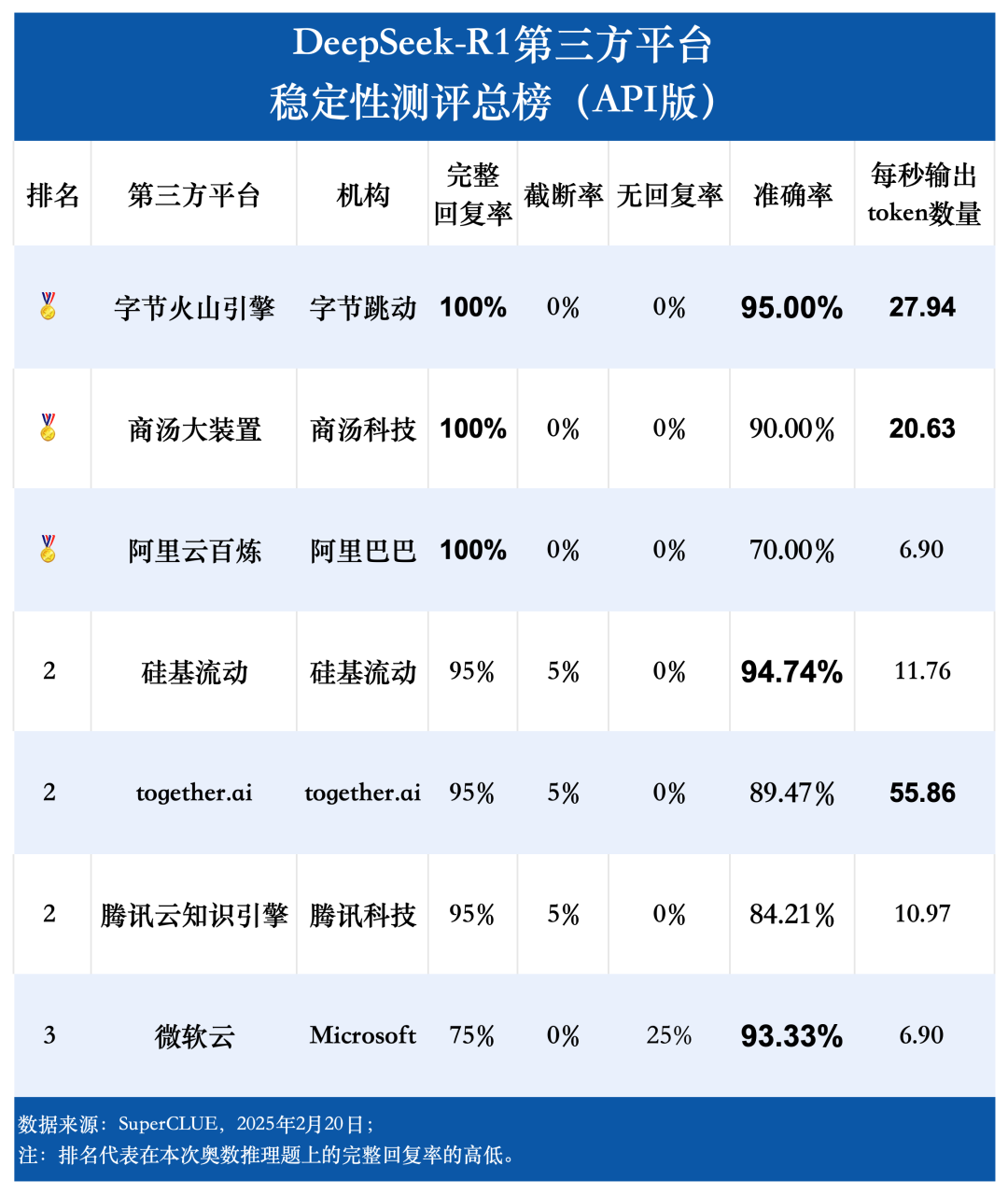

DeepSeek-R1第三方稳定性测试(API端):首批结果出炉!

# 背景介绍为了给用户提供更全面、客观的参考,并帮助他们选择合适的服务平台,我们在7个服务平台上进行了DeepSeek-R1的API稳定性测评,从回复率、准确率和推理耗时等方面评估其表现。本次测评在同一机器上对第三方平台发送请求,使用20道小学奥数推理题测试,temperature为0.6,max_token设为平台最大值或16000,采用流式输出方式记录耗时及输出token数量。每题尝试三次避免…- 0

- 0

-

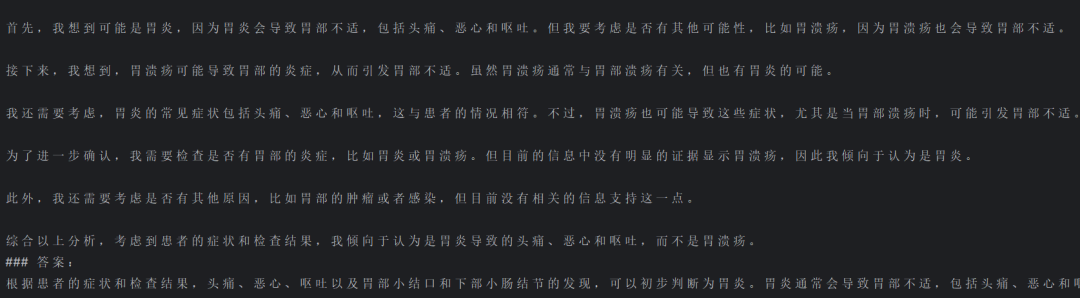

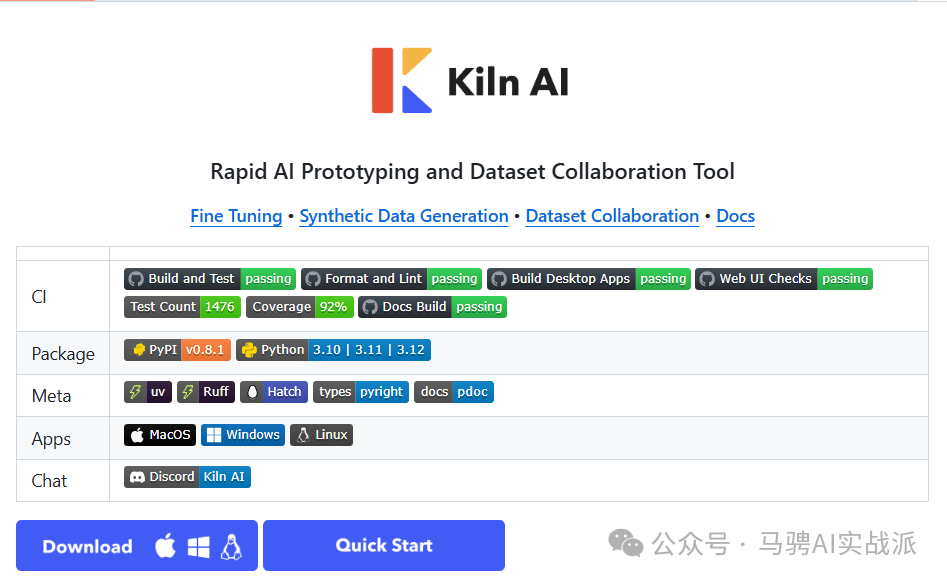

企业AI私有化终极方案:DeepSeek-R1蒸馏实战全解析

当模型蒸馏遇上零代码:Kiln框架技术解析技术核心:全自动模型蒸馏流水线Kiln框架通过三阶段流程实现模型蒸馏自动化:关键技术创新点:? 全平台桌面客户端支持(Win/Mac/Linux)? 支持Llama/GPT4o/Mixtral等主流模型蒸馏?️ 隐私优先架构设计(支持Ollama本地化运行)? 可视化数据生成工具(支持多模态数据标注)企业级应用场景实测医疗行业案例: 某三甲医院基于3万份电…- 0

- 0

❯

购物车

优惠劵

搜索

扫码打开当前页

联系我们

返回顶部

幸运之星正在降临...

点击领取今天的签到奖励!

恭喜!您今天获得了{{mission.data.mission.credit}}积分

我的优惠劵

-

¥优惠劵使用时效:无法使用使用时效:

之前

使用时效:永久有效优惠劵ID:×

没有优惠劵可用!