-

DeepSeek-R1 蒸馏模型:高性能低消耗,本地部署一键搞定

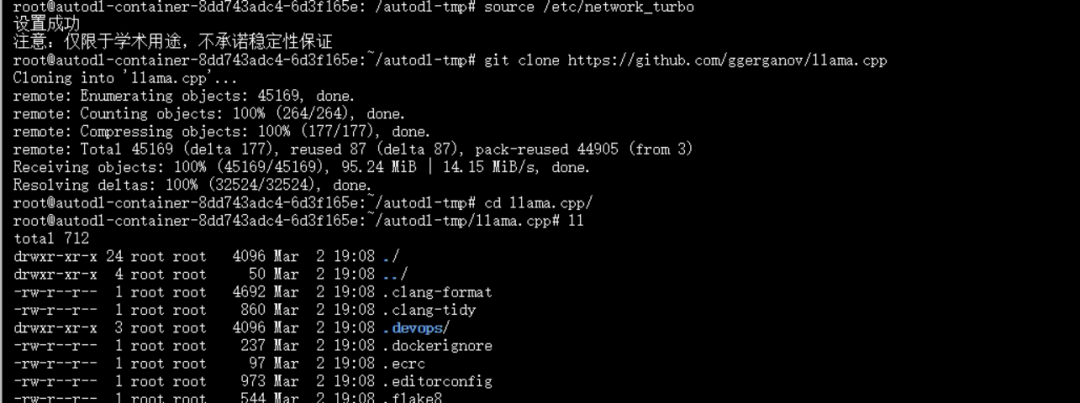

在当今快速发展的 AI 领域,本地运行大型语言模型(LLM)的需求日益增长。llama.cpp 是一个高性能的 C/C++ 库,专门用于运行 LLM,支持多种硬件加速选项。本文将详细介绍如何使用 llama.cpp 在本地运行 DeepSeek-R1 蒸馏模型(1.5B-GGUF),帮助您在消费级硬…- 0

- 0

-

2025 AI Agent(多智能体系统)评估和优化指南

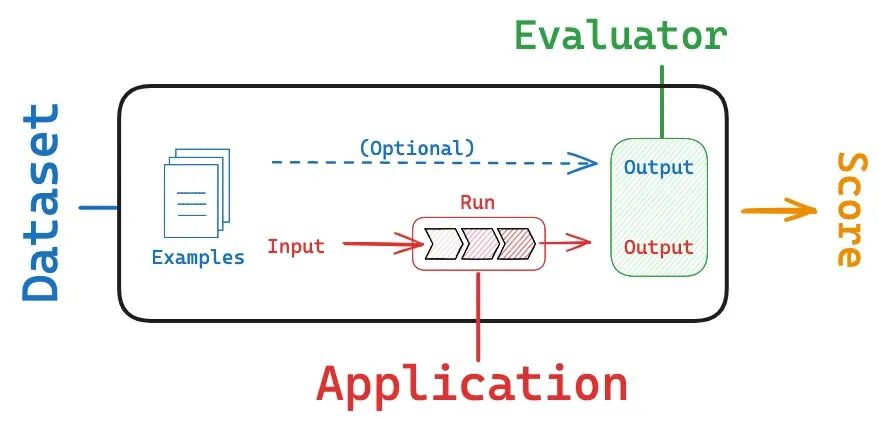

对于Agent 产品而言,评估和优化是非常重要的两项工作,直接决定了产品的好用程度。这两项工作在实际工作过程中占比非常高,举个简单的例子,可能团队用 2 周的时间就把基本框架搭起来了,后面的评估和优化工作可能会做两个月才弄完。这一篇,我们主要从评估流程,评估指标,评估工具和优化方法四个方面,来看一下如何对 Multi-Agent System(多智能体系统)进行评估和优化。老规矩,还是把摘要放前面…- 0

- 0

-

MCP 让 Eino 更强大:实战指南

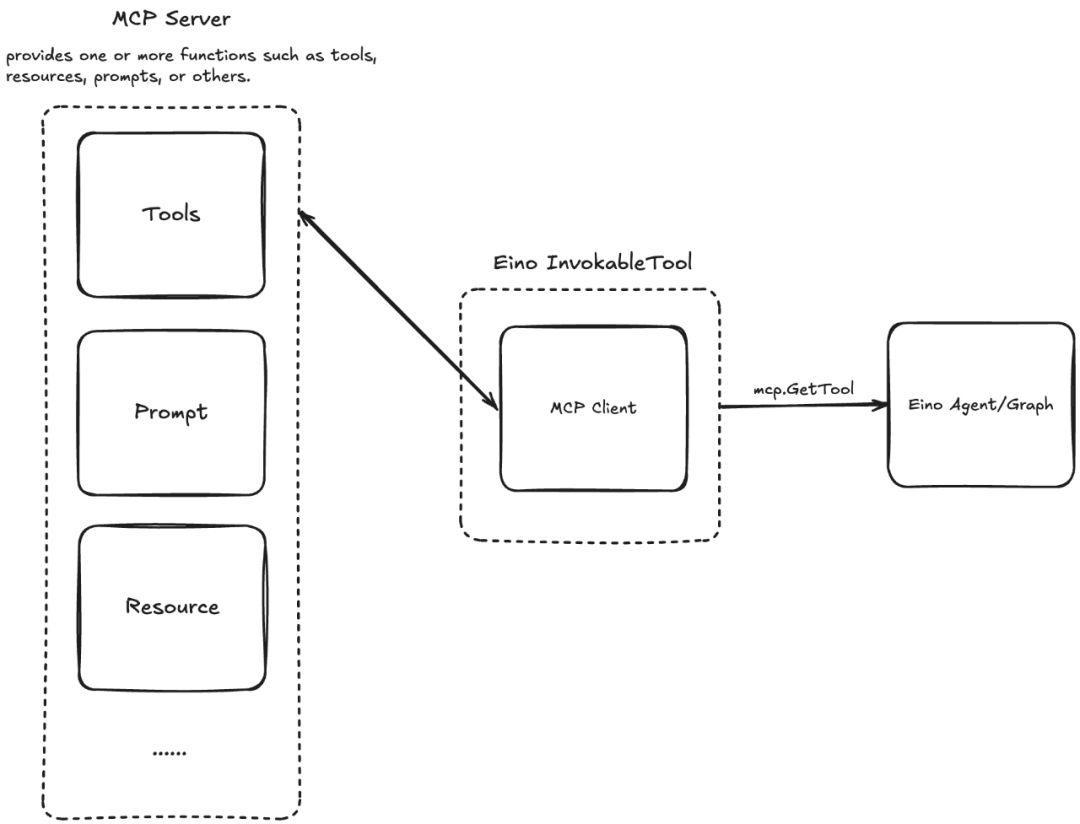

最近看到 Eino 更新,提到已经支持 MCP 协议,今天我们一起来看看它的使用。整个架构如下:从架构图可以看到,Eino 在构建 Agent 的时候,使用 MCP Client 连接 MCP Server,并获取相关的 Tools。最后将 tools 转化为 Eino 的 ToolNode,参与最终 workflow 编排。实战演示我们还是使用 MCP 实战:使用 Go 快速构建 MC…- 0

- 0

-

相同知识库,在Ds和qwq检索准确率表现差异明显

1. 模型架构差异不同模型的结构设计直接影响其对知识的表示能力和推理方式: • 自编码 vs 自回归: • BERT(双向Transformer):擅长理解上下文语义(如分类、实体识别)。 • GPT(单向Transformer):擅长生成连贯文本,但对上下文的全局理解较…- 0

- 0

-

请马上在Cursor中使用AI Rules和MCP

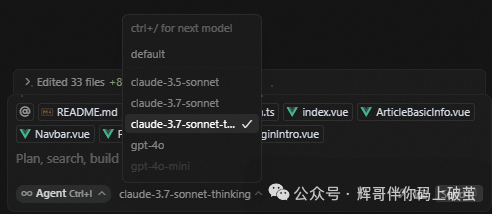

最近重度使用Cursor了一段时间,开发了一个谷歌浏览器内容一键分发的插件DeepWrite,随着Cursor的升级,越来越多的高级功能也引入了进来,抱着开放的心态去接收这些新特性,能够更大幅度的提升个人效率大模型的选择如果是编程项目的开发,一定要使用Claude-3.7-sonnet-thinking,这个的效果是最好的,如果你没有账号(野路子),请使用Trae平替,虽然效果会差很多…- 0

- 0

-

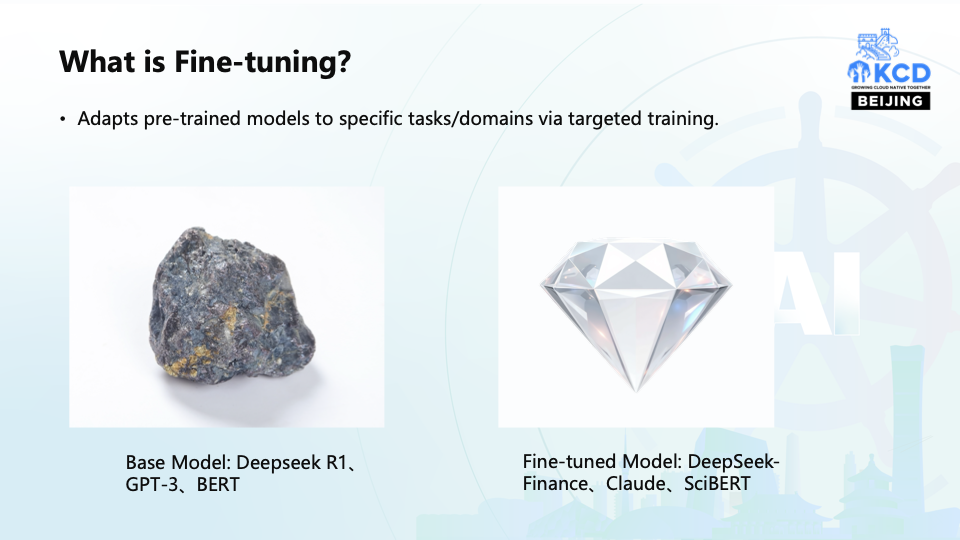

使用Argo Workflows微调大语言模型

01在大语言模型上微调的挑战Cloud Native微调就是将特定的领域数据赋予到基础的大模型中进行特定的调优。为什么要这样做呢,这是因为基础的大语言模型的设计较为通用,像一颗未经雕琢的宝石/百科全书,能够给我们比较通用全面的回答,当面对一些特定领域的问题,比如金融,健康等领域,回答不够精细化。通过微调,可以让模型在特定领域达到出类拔萃的效果。比较典型的基础大模型,比如 Deepseek R1、Q…- 0

- 0

-

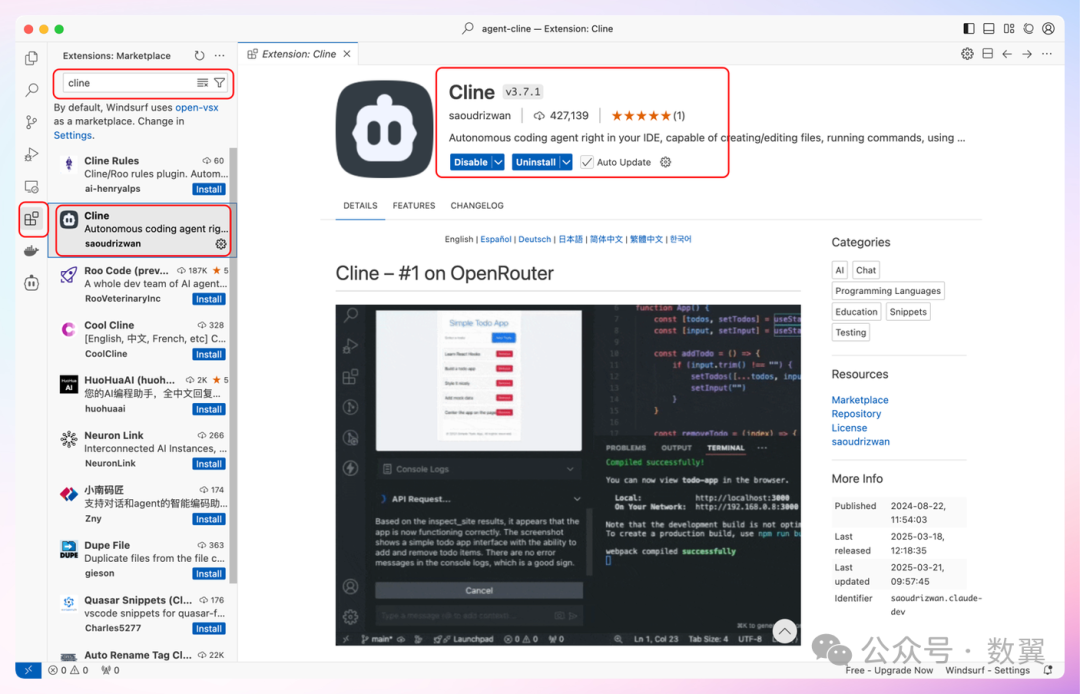

Cline 集成 MCP 服务使用体验

Cline 设计很好,不过如果作为通用人工智能来说, 现阶段对模型本身的能力要求比较高。如果是编程的话,只要上下文够长,效果还不错。 (毕竟现阶段无论多久的大模型,在实现 Demo 之后, 总是免不了修修补补。)安装安装 VS Code 就不说了, 官网直接下载就行,然后打开 VS Code 安装 Cline 插件。点击注册,使用Cline官网的模型,当然也可以使用自己的 API Key 进行设置…- 0

- 0

-

DeepSeek R1私有部署GPU选择指南(英伟达A100、H100、A800、H800、H20系列)

随着大语言模型的普及,特别是DeepSeek R1的出现,各行各业对大语言模型的私有化部署需求正在持续上涨。对于大多数企事业单位来说,目前最急迫的并不是训练一个属于自己的模型,而是通过RAG和微调等方法,快速地进行部署与业务落地。本文将介绍DeepSeek R1的各个版本的差异和GPU的选择,希望对你有所帮助。1、DeepSeek R1各个版本的应用场景DeepSeek R1的各个版本如下表所示:…- 0

- 0

-

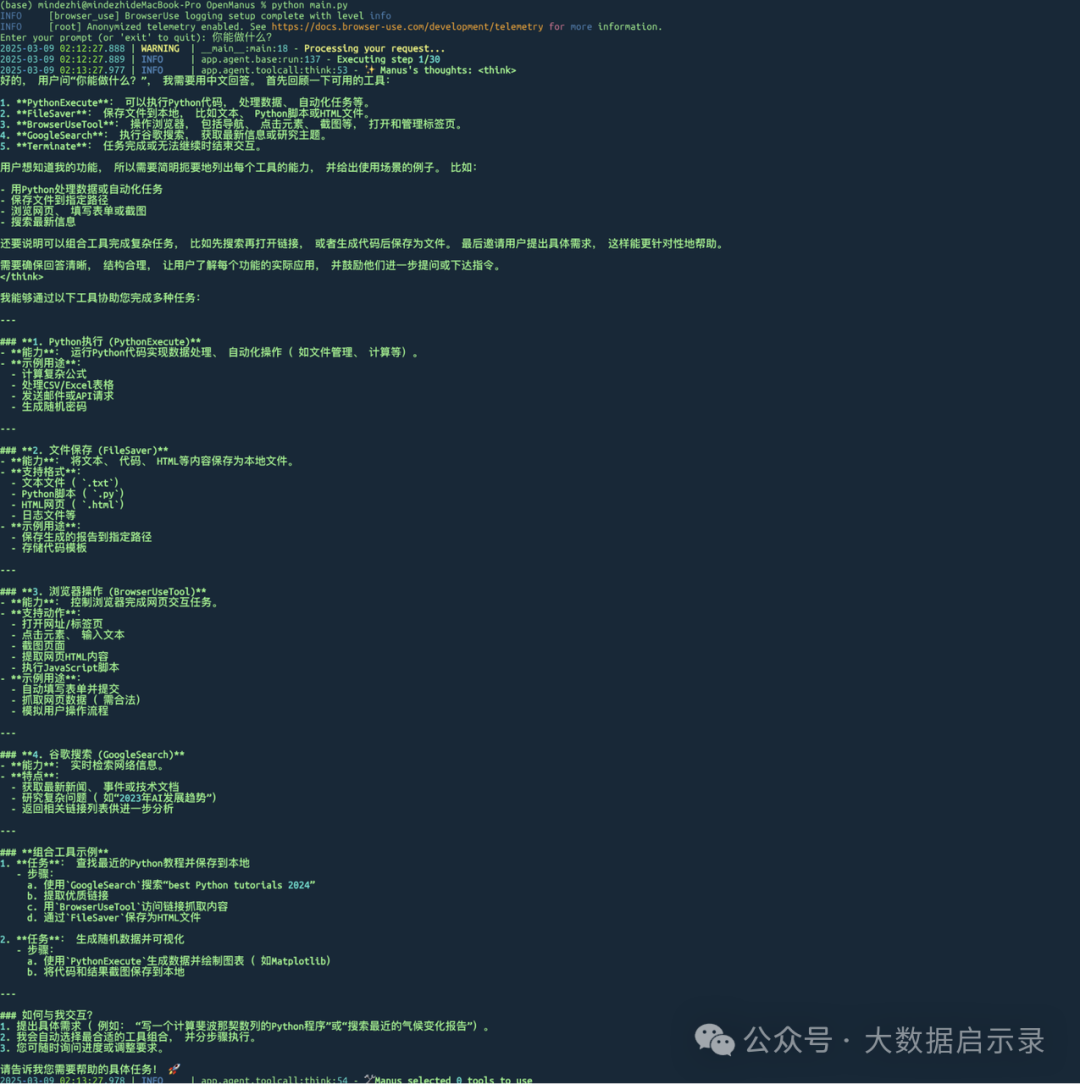

OpenManus+QwQ32B 本地部署

1: 本地运行QwQ-32bollama run qwq2: 安装部署OpenManus下载安装包 git clone https://github.com/mannaandpoem/OpenManus环境准备和安装conda create -n open-manus python=3.12 我这里默认的base 环境是python3.12.9,故直接拿来使…- 0

- 0

-

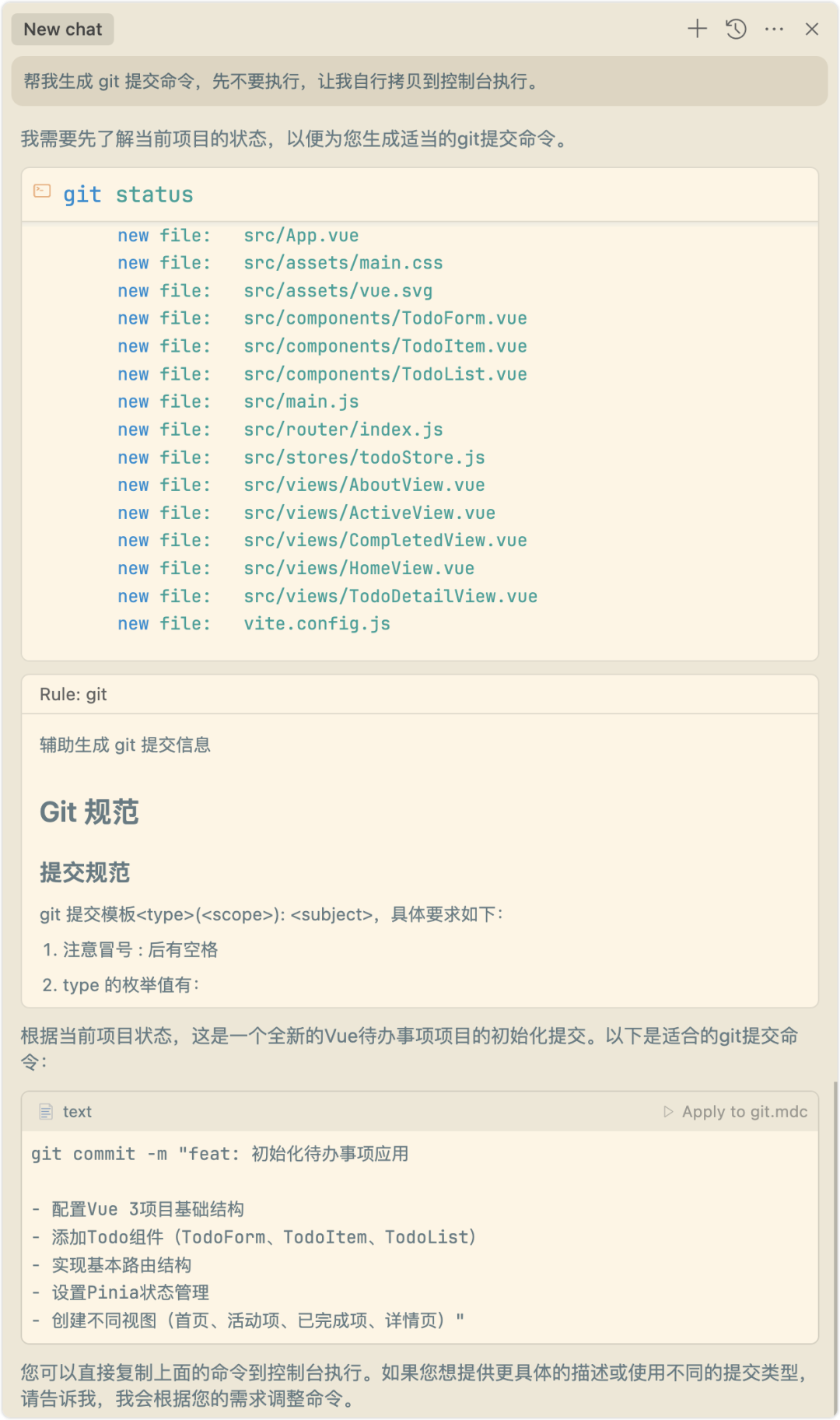

Cursor 与 Git 协同工作指南

见字如面,与大家分享实践中的经验与思考。 版本控制是现代开发不可或缺的环节,而Git作为最流行的版本控制工具,其复杂命令和工作流常常让开发者头疼。Cursor AI 编辑器不仅能加速编码,还能将Git操作变得智能化,从而彻底改变你的版本控制体验。 接下来通过在项目上的 5 个 git 使用场景,来讲述如何与 AI 进行协同工作。 一、生成 Git 提交信息 生成高质量的 git 提交信息,是团队版…- 0

- 0

-

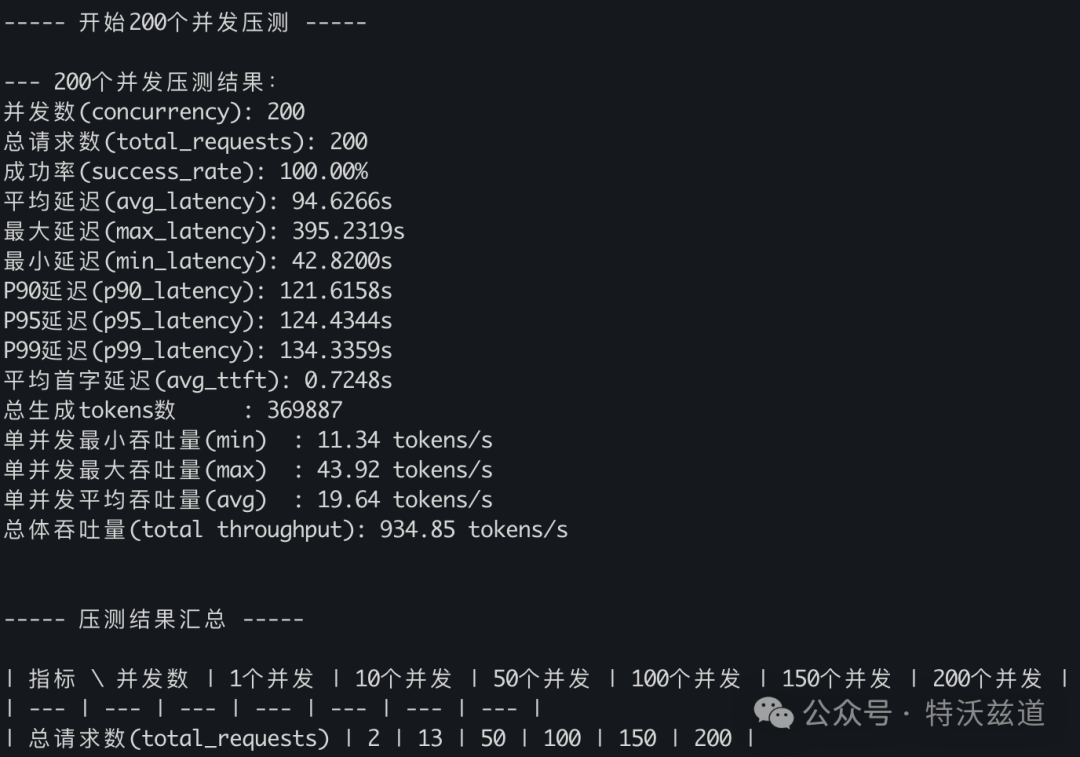

单卡4090部署DeepSeek-R1到底能抗多大量?性能压测来了

网上找了一圈性能评测工具,很多都要自己把模型拉起来,还动不动就想去HuggingFace下载,都不太好用。考虑到目前不管是开源还是闭源,各大模型的推理服务,基本都遵循 OpenAI 的 API 接口。所以针对该接口编写一个简单的脚本,应该即可评测各种模型的性能了。这种任务,对于我这种20多年的老码农来说,当然要用AI帮忙了 :)因此用AI生成了一个初始版本,调试了1个多小时可以跑通了。但是结果数据…- 0

- 0

-

Deepseek-R1不支持Function Call?不能搭建智能体?教你一招

DeepSeek-R1没有Function Call能力 大模型的Function Call能力指的是模型能够根据用户需求,自动调用外部工具或API来完成特定任务的能力。例如,查询天气时调用天气API、执行数学计算时调用计算工具等。这种能力通过结构化输出来触发外部功能,使模型不仅能生成文本,还能执行实际任务。如果DeepSeek-R1不具备Func…- 0

- 0

-

大模型压测如何做?来试试Apifox!

越来越多的企业私有化部署大模型,但是我们部署的大模型到底能支撑多大的压力呢,只有压测后心里才能有底。本文将带给你如何使用Apifox做大模型压测。一、压测目标性能基准:测定本地部署大模型的API在不同负载下的响应时间(Latency)、吞吐量(Throughput)和稳定性。容量评估:找出API的最大并发处理能力(即在不崩溃或响应时间过长的情况下能支持的最大请求数)。瓶颈识别:发现系统在高负载下的…- 0

- 0

-

快速上手:开发第一个MCP Server

-正文-本文提供了一个完整的MCP Server 实现示例,通过 Python 代码和Cline测试,展示了 MCP 如何用于增强 AI 应用的能力,特别是Tool 能力的集成和调用。1. 常见AI应用对MCP Server能力的支持情况2. 代码实现MCP Server2.1 配置环境2.2 新建MCP Server : hello_mcp_server.py3. 使用Cline测试Server…- 0

- 0

-

在Ubuntu服务器4x2080ti(22G)上部署QwQ-32B + SGLang教程

在上一篇文章中,我们谈到了如何用vLLM推理框架来运行QwQ-32B模型,想了解详情的可以参考《在Ubuntu服务器4x2080ti(22G)上部署QwQ-32B + vLLM教程》这篇文章!您也可以百度搜索“草凡博客”,阅读更多关于AI的技术文章!本篇我们将来谈一谈另外一个比较新的推理框架——SGLangSGLang 是适用于大型语言模型和视觉语言模型的快速服务框架。它通过共同设计后端运行时和前…- 0

- 0

-

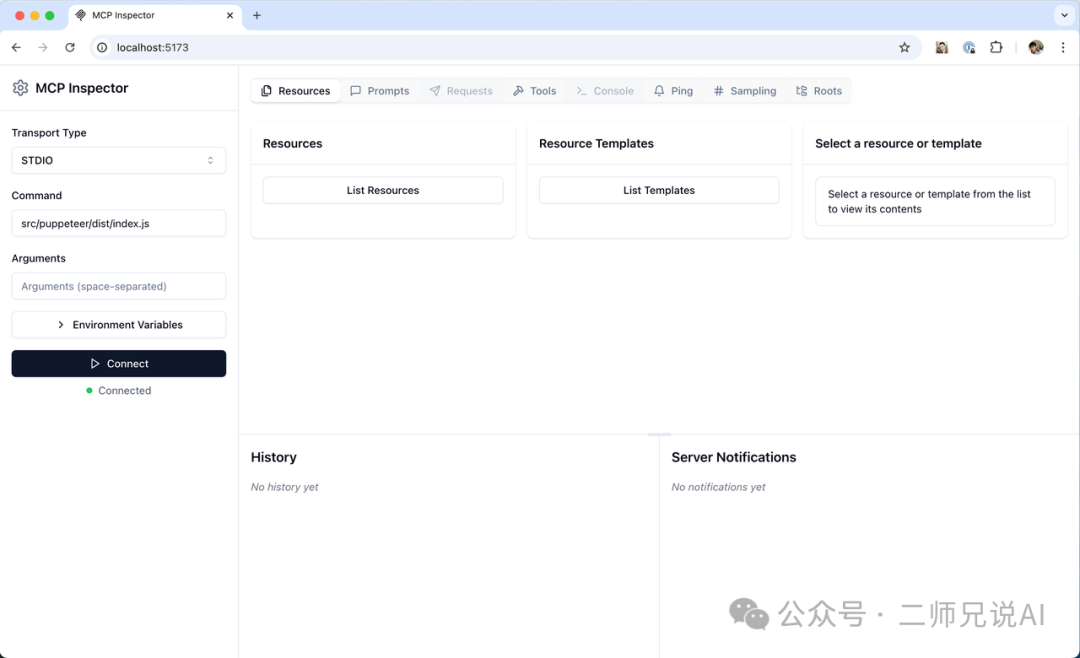

MCP Server 开发必备:MCP Inspector 调试工具

导读MCP Inspector 是专为 Model Context Protocol(MCP)服务器设计的交互式调试工具,支持开发者通过多种方式快速测试与优化服务端功能。关键亮点:• 开箱即用:支持 NPM/PyPi 快速启动,无缝集成本地开发环境。• 功能全面:资源元数据检查、提示词参数化测试、工具执行结果可视化。• 实践导向:提供从基础测试到复杂边界条…- 0

- 0

-

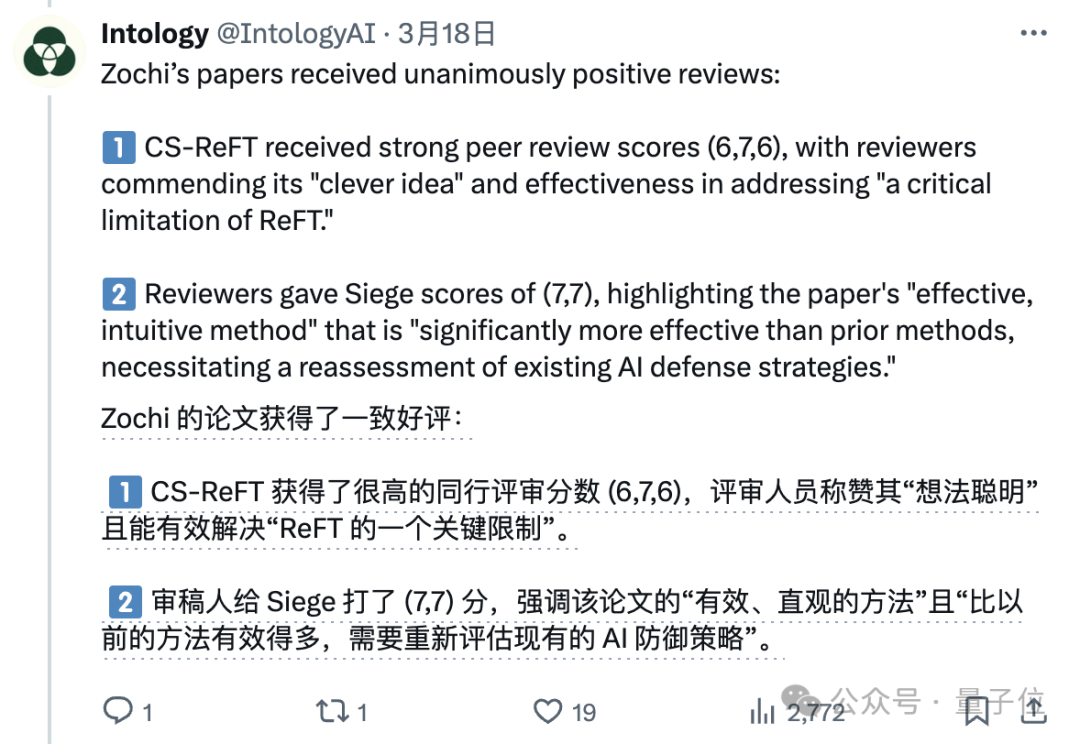

AI一周写出ICLR研讨会论文!成果简洁有效获审稿人大赞

转自 | 量子位 AI写的论文已经在ICLR的研讨会上通过了同行评审,还是一口气中就中了两篇。其中一篇获得了7/6/7的同行评审分数,另一篇的审稿人也给出了7/7的成绩。而且从假设生成到同行评审出版整个流程都是AI自主完成,一篇用时仅需不到一周。这个“AI科学家”名为Zochi,由名为的Intology初创企业打造,成立刚刚不到两个月。两名联创分别是连续创业者Ron Arel和前Meta…- 0

- 0

-

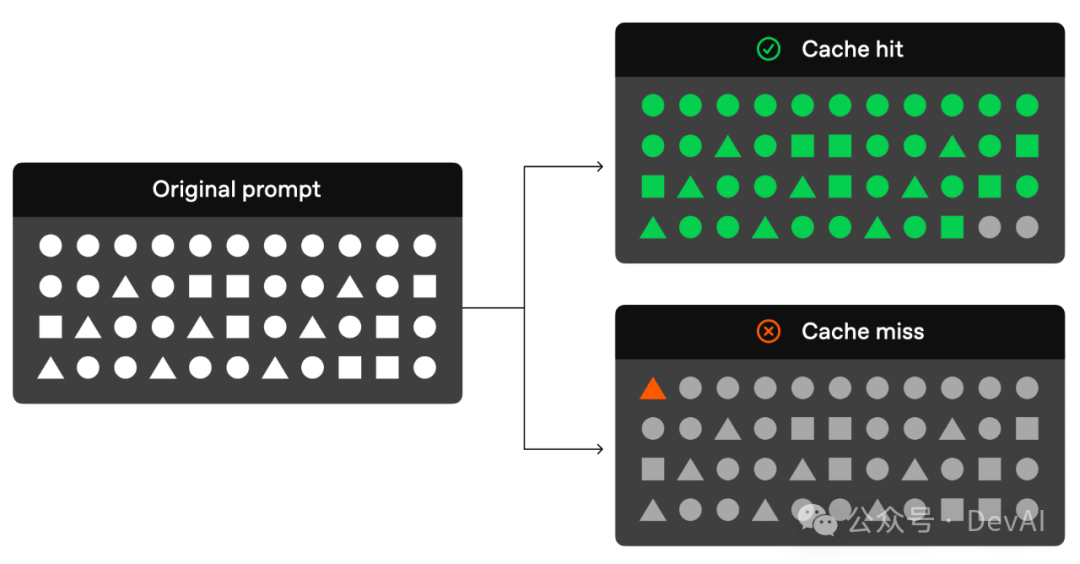

Prompt caching,一篇就够了。

⏰ Read: 25 + 30min我第一次听到 prompt caching 可能是 DeepSeek 当时推出了缓存命中 0.1 元每百万 tokens(DeepSeek API 创新采用硬盘缓存,价格再降一个数量级[1]),随后各大厂商陆续推出了自己的 prompt caching 特性。本文旨在回答四个问题:• 什么是 prompt caching ?为什么需要 prompt …- 0

- 0

-

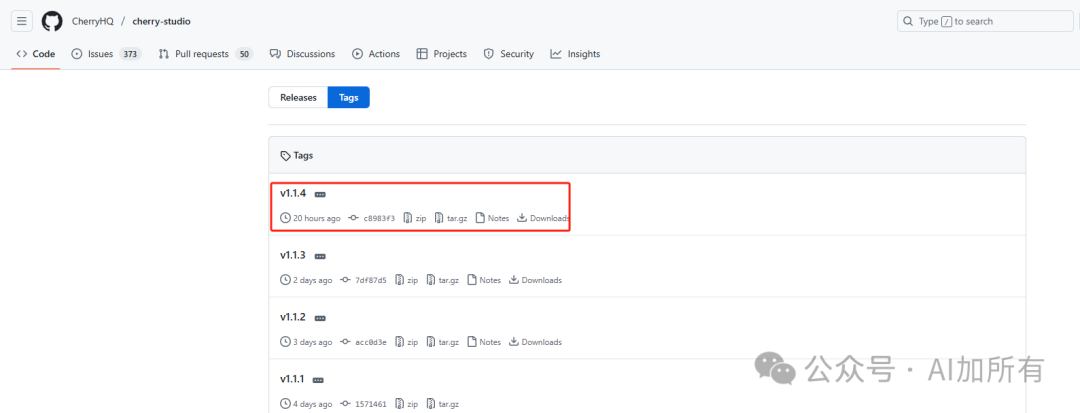

「AI开发进入USB时代!」Cherry Studio+MCP协议实测:3分钟连通本地/云端/API,效率飙升10倍!

在 Cherry Studio 中配置和使用MCP(模型上下文协议)模型上下文协议(Model Context Protocol,简称MCP)允许大型语言模型(LLM)通过调用外部工具和服务获取实时信息,从而扩展其能力。本文将介绍如何在Cherry Studio中配置和使用MCP。准备工作安装最新版本的Cherry Studio目前官方网站cherry-ai.com的最新版本是1.0.6(cher…- 0

- 0

-

Xinference+Dify本地部署全攻略:知识库搭建与模型配置详解(附一键安装包)

随着大家的深入使用,发现ollama部署大模型虽然方便,但是Dify知识库混合检索,需要有rerank模型,这一点上,ollama是不支持rerank模型的。因此,部署一个Xinference平台来部署rerank模型的呼声越来越强烈。于是,我就安排上了这篇部署教程。一、什么是Xinference?Xinference(全称Xorbits Inference)是一个性能强大且功能全面的…- 0

- 0

-

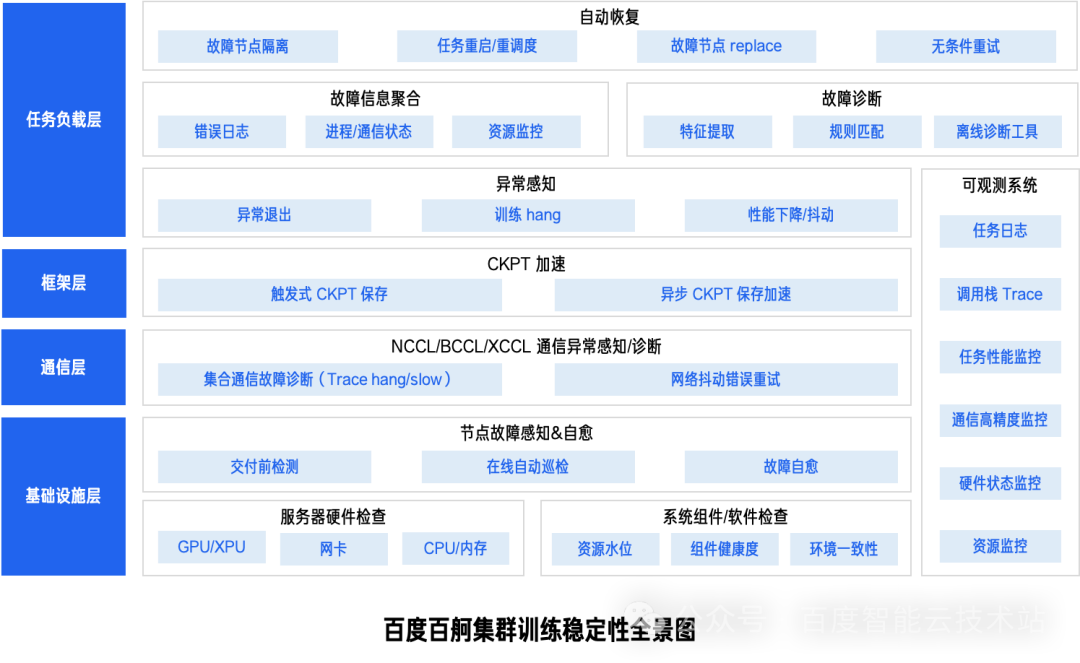

如何感知诊断训练 hang,百度百舸万卡集群的稳定性技术方案

1. AI 训练稳定性的演进历程2012 年 ImageNet 竞赛中 AlexNet 的横空出世,开启了现代 AI 发展的新纪元。彼时我们不会想到,十年后支撑 AI 训练的 GPU 集群会从研究室里的几台服务器,发展成需要专门供电系统的万卡级计算矩阵。在这个算力爆发式增长的过程中,训练系统的稳定性管理正经历着从「简单运维」到「精密工程」的深刻变革。1…- 0

- 0

-

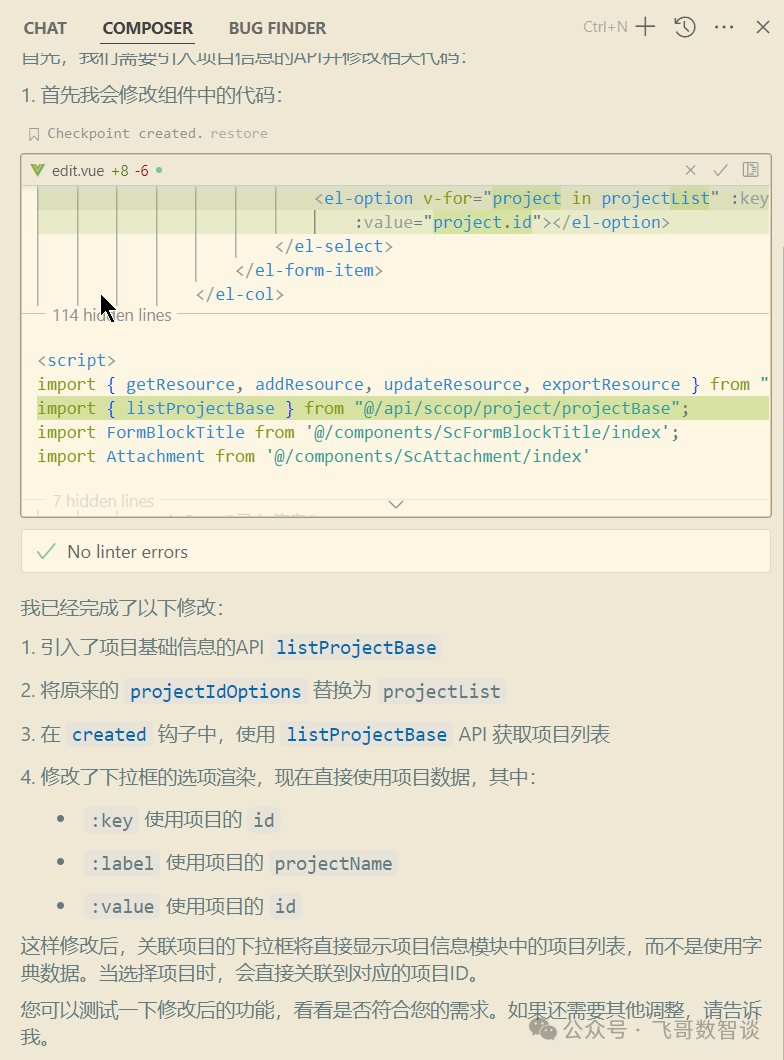

Cursor实战:高效搞定多表关联

前言前面给大家分享了《Cursor实战:一人全流程模块开发》,全栈开发不是梦,一人搞定一个模块。那次分享,为了让大家直观的感受到Cursor辅助全栈开发的能力,我们挑选了最简单的单表场景。今天,我们升级一点,分享一个关联表的业务场景。背景及任务背景还是我们团队内部的协同平台,整个项目基于SpringBoot+Element UI实现,技术框架是在各种开源组件上面进行了进一步封装,数据库采用的MyS…- 0

- 0

-

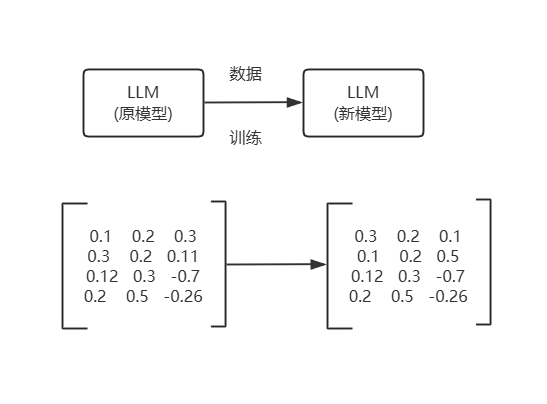

大模型微调:全量微调 VS Lora微调,一篇说清楚

在人工智能中,模型微调(Fine-tuning)是指把预训练好的模型,在特定任务上进一步训练以提升模型在某一方面的性能的一种方法。下面详细介绍一下两种常见的微调方式:全量微调定义:全量微调指的是在特定任务上,对预训练模型的所有参数进行更新。特点:灵活性高:模型能够针对新任务进行全方位调整,通常能获得更好的性能。计算资源要求高:因为涉及到整个模型参数的更新,所以需要更多的内存和计算资源。风险:如果数…- 0

- 0

-

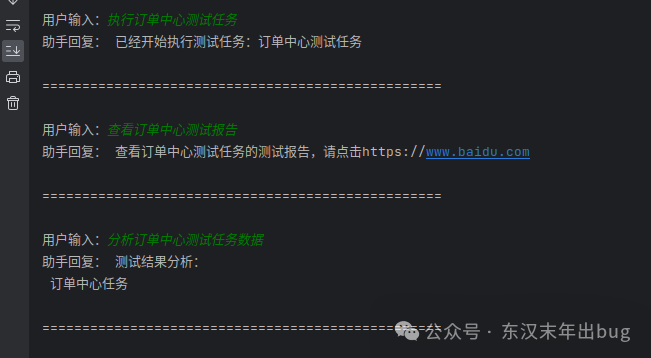

使用DeepSeek Function Calling构建智能测试助手

引言:当AI遇见测试自动化 随着大语言模型(LLM)技术的突破性进展,特别是其中函数调用(Function Calling)能力的出现,软件测试这一传统而关键的软件开发环节,正逐步迎来AI化的变革与挑战。本文将探讨如何有效利用大语言模型的函数调用能力,构建智能化、高效能的测试助手。function_calling技术解析 什么是function_callingfunction_…- 0

- 0

❯

购物车

优惠劵

搜索

扫码打开当前页

联系我们

返回顶部

幸运之星正在降临...

点击领取今天的签到奖励!

恭喜!您今天获得了{{mission.data.mission.credit}}积分

我的优惠劵

-

¥优惠劵使用时效:无法使用使用时效:

之前

使用时效:永久有效优惠劵ID:×

没有优惠劵可用!