-

通用语音识别模型VibeVoice ASR:长达60分钟音频一次性“直出”结构化转写

语音识别技术在近年来取得了飞速发展,但在面对真实的复杂场景时,许多系统依然显得有些力不从心:漫长的会议、多人混杂的交谈、极具专业性的行业术语,或是中英夹杂的日常对话…… 传统的语音识别系统往往需要将长音频切分成一个个短小的片段,分别识别后再费力地“拼凑”起来。这种“化整为零”的方法不仅容易丢失上下文,还常常在谁说了什么、什么时候说的等问题上张冠李戴。近日,微软亚洲研究院发布了一款通用的语音识别模型…- 0

- 0

-

用Karpathy的设计哲学重构龙虾助手的知识库架构

在龙虾狂热传播的今天,我们面临一个现实问题:云端API的token成本让持续使用变得极其昂贵。我构建的这套系统,基于Andrej Karpathy的本地化知识库设计哲学,实现了完全本地化的AI能力。这不是概念验证,而是可以日常使用的完整工作流程。PART 01设计逻辑的工程本质这个本地最小化知识库能够处理文本和PDF,完全由本地语言模型和嵌入模型驱动。最令人惊讶的是,这个最小化系统设计思维的实战演…- 0

- 0

-

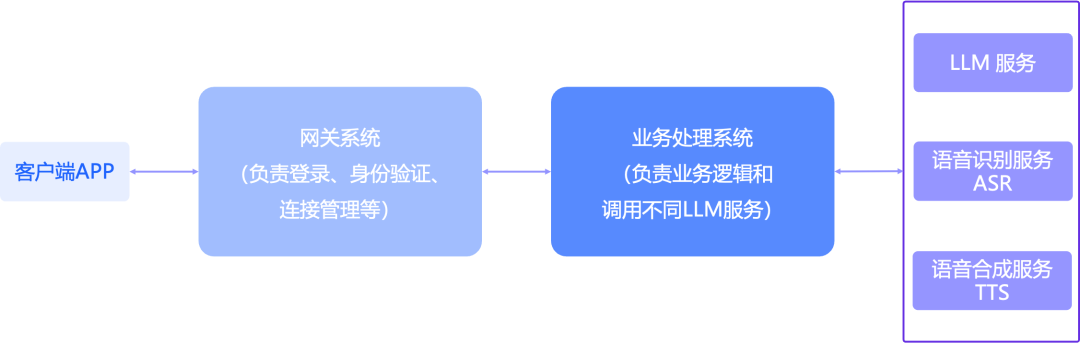

Agent 语音交互如何更稳、更快?一次高并发消息链路优化实践

随着大语言模型(LLM)、语音识别(ASR)、语音合成(TTS)等能力逐步成熟,AI Agent 开始从文本交互走向语音交互,典型场景包括 AI 教师、AI 情感聊天、AI 助手等。相比文本输入,语音更自然、更实时,用户可以直接通过说话完成提问、练习、任务触发与多轮对话,这也让“和 Agent 用语音对话”真正进入实际业务场景。但当 Agent 语音交互进入高并发场景后,很多团队会发现:最先遇到瓶…- 0

- 0

-

AI数据工程师在应用中如何"返璞归真"

阿里妹导读本文反思了“知识库+Prompt工程+工具调用”这一轻量级Agent构建模式的局限性,指出其难以应对真实业务场景中的知识质量、语义理解与规模化维护挑战。(本文内容基于作者个人技术实践与独立思考,旨在分享经验,仅代表个人观点。)一、引言:Agent热潮下的实践反思回顾过去2–3年,AI演进速度堪比代码提交频率——快的甚至让人来不及写“注释”。在这波浪潮中,“AI Agent”迅速从学术圈的…- 0

- 0

-

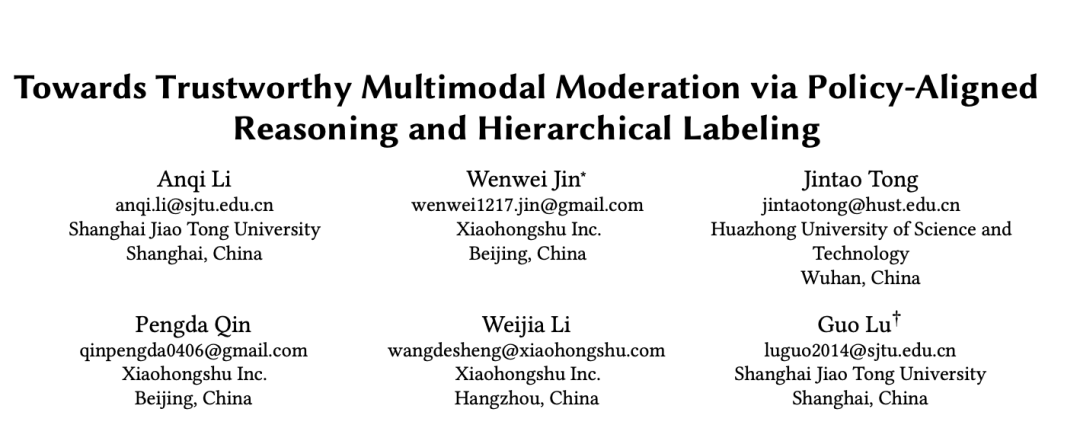

KDD 2026 | 小红书内容审核:Hi-Guard 让内容治理“知其然,更知其所以然”

引言:内容安全是平台治理的生命线,旨在精准识别与处置色情和暴力等不健康和违规内容。传统审核模型通过“黑盒”分数直接给出识别结论,在处理复杂语义和隐晦内容时和规则对齐方面存在困难。推动治理模型从“标签驱动”向“政策规则驱动”演进,同时具有政策规则的可解释性,已成为构建可信可泛化安全系统的核心方向。为解决上述问题,小红书内容理解团队提出层级式治理框架 Hi-Guard,通过分层流水线与路径感知的强化学…- 0

- 0

-

AIOps探索:分享一套保障100%准确率的告警知识检索方案

研究AIOps已有数月,目前手里有不少可落地的方案了,接下来会把这些方案全部整理到我的大模型课程里。欢迎大家把你遇到的场景在评论区留言。我会在能力范围内给你提供思路和建议。经常看我公众号的朋友应该知道,这段时间我整理了很多关于AIOps的一些感想,同时也了解到了不少企业或者团队遇到的问题。其中最为典型的问题就是关于告警以及根因分析。可能对于小规模应用或者平台来说,问题很好解决,因为体量不大,系统复…- 0

- 0

-

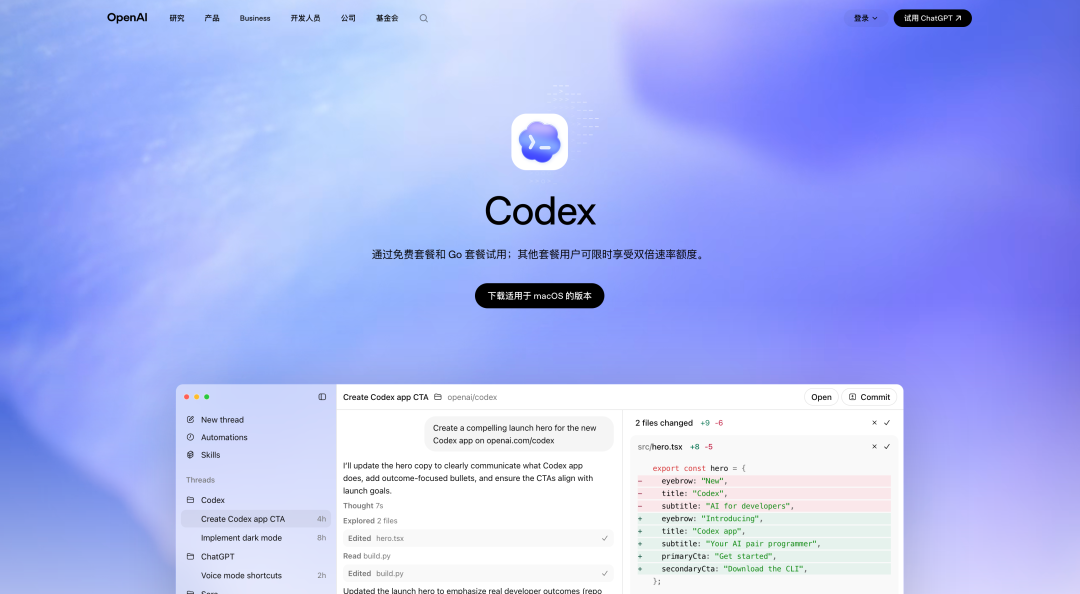

零帧起手 Codex × Figma 双向工作流实操

前几天我发了一篇关于 Figma 着急了!Codex 和 Figma 双向构建前端 UIAgent的完美融合" data-itemshowtype="0" linktype="text" data-linktype="2">取代Figma的新神器?Paper:设计、代码与AI Agent的完美融合的文章。很多人小…- 0

- 0

-

全网爆火的大模型AI知识库,保姆级教程来了

构建Karpathy大神同款AI知识库Karpathy 发了一条推文,分享了他近期重点在用 AI 构建个人知识库,短短两天,全网千万人观看。“我最近发现一件非常有用的事:用 LLMs 为各种研究主题建立个人知识库。这样一来,我最近的大部分 token 使用量更多地用于处理内容,而不是编写或修改代码。”然后就在昨天,他公开了整个构建的思路:思路很简单:不要把笔记分散在各种应用里,而是全扔进一个文件夹…- 0

- 0

-

Seedance 2.0 正式发布

今天,我们正式发布新一代视频创作模型 Seedance 2.0。Seedance 2.0 采用统一的多模态音视频联合生成架构,支持文字、图片、音频、视频四种模态输入,集成了目前业界最全面的多模态内容参考和编辑能力。相比 1.5 版本,Seedance 2.0 的生成质量大幅提升,其在复杂交互和运动场景下的可用率更高,物理准确度、逼真度、可控性显著增强,更加贴合工业级创作场景的需求。其核心亮点如下:…- 0

- 0

-

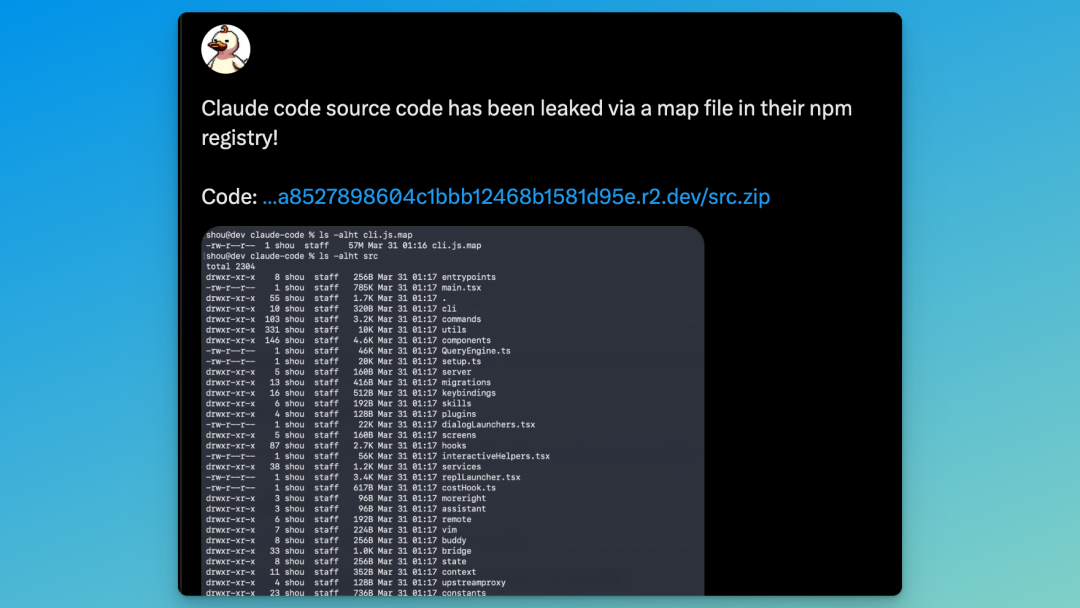

RAG进化了,深扒Claude Code源码中RAG高级技巧

本文基于对Claude Code源码的深入分析,揭示其如何将RAG从"外挂知识库"升级为"操作系统级内存管理"。最近,Claude Code的源码被动开源,引发了广泛关注。在深入分析其源码后,我们发现它完全颠覆了传统RAG(检索增强生成)的玩法。传统RAG大多停留在"文档切分、向量库存储、相似度检索"的初级阶段,而Claude Code则…- 0

- 0

-

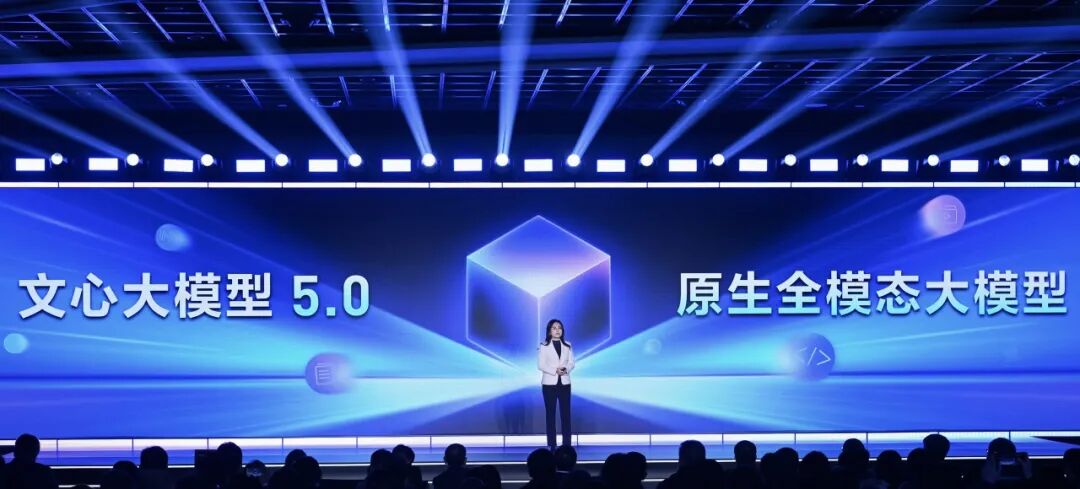

文心大模型5.0正式版,上线!

今天,在百度文心Moment大会现场,文心大模型5.0正式版上线。文心大模型5.0正式版参数达2.4万亿,采用原生全模态统一建模技术,具备全模态理解与生成能力,支持文本、图像、音频、视频等多种信息的输入与输出。在40余项权威基准的综合评测中,文心5.0正式版的语言与多模态理解能力稳居国际第一梯队。图像与视频生成能力与垂直领域专精模型相当,整体处于全球领先水平。目前,用户可在文心APP、文心一言官网…- 0

- 0

-

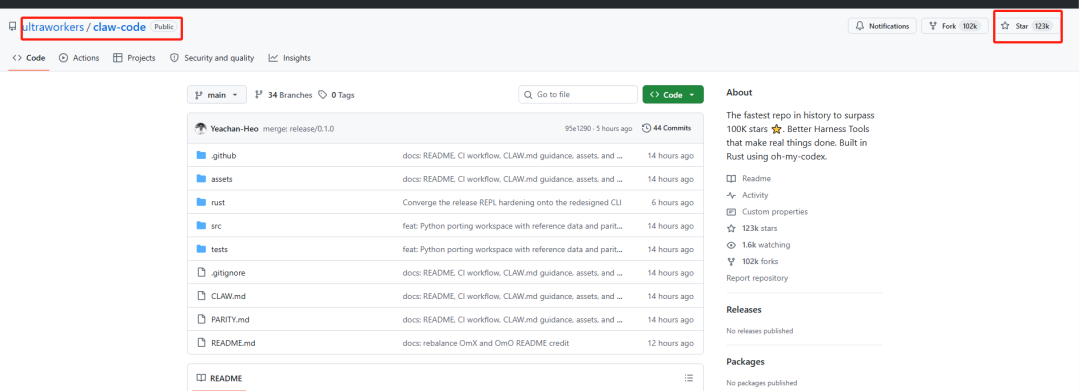

Claude Code 源码一夜流出:会看热闹的人很多,会读源码的人很少

2026 年 3 月 31 日下午,Claude Code 的完整源码意外流出来了。不是那种大家想象中的“被黑了”,也不是内部有人泄密,更像是发布 npm 包的时候手一滑,把 source map 也一起带进去了。有朋友闹了个乌龙,看到 Anthropic 官方 GitHub 上有个 claude-code 仓库,就以为它本来已经开源了。但那个仓库更像是个文…- 0

- 0

-

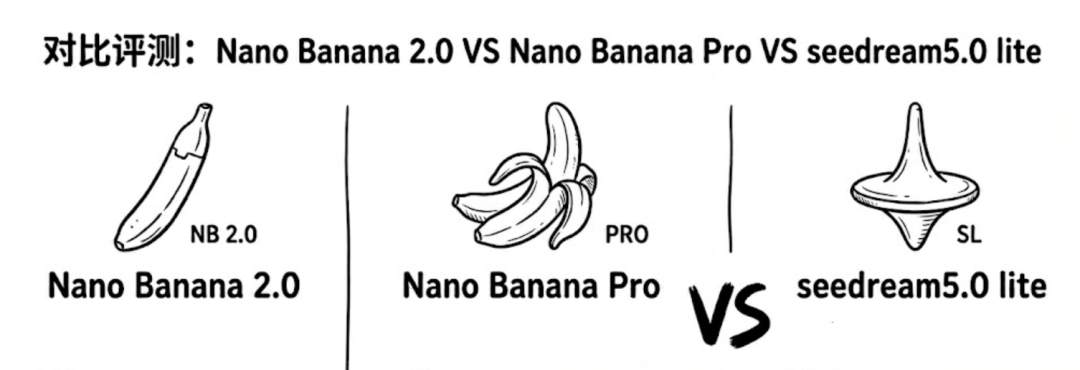

NanoBanana 2.0 来了, 对比前一代和即梦 5.0 lite,它依旧强的离谱

刚刚,Nano Banana 2.0 上线, 一看到这个名字有点恍惚,我以为上个版本也是 2.0,专门去搜索了,才弄明白:25 年 11 月 20 号发布的是 nanobanana pro25 年 9 月发的 nanobanana而香蕉模型的 API 生图名称是 gemini-3-pro-image-preview这个混乱的命名让我想起了 GPT4.0 系列,好在不需要在对话框里去选择那…- 0

- 0

-

OpenDataLoader:PDF文档提取的一站式方案

很长时间没有关注文档解析这一块的进展,最近发现了一个新的专门针对LLM和RAG场景优化的PDF解析工具OpenDataLoader,在基准测试中取得了0.90 的综合得分,位居同类工具之首。因此本文将深入查看 OpenDataLoader的技术架构、核心特性,并与MinerU、PaddleOCR-VL等主流方案进行对比,分析这个新项目有什么设计亮点。项目概述OpenDataLo…- 0

- 0

-

Seedance 2.0上线火山方舟体验中心,API即将开放

今天,豆包视频生成模型 Seedance 2.0 正式上线火山方舟体验中心。Seedance 2.0采用多模态音视频联合生成架构,支持文字、图片、音频、视频四种模态输入,集成了目前业界最全面的多模态内容参考能力。相比1.5版本,Seedance 2.0的生成质量大幅提升,其在复杂交互和运动场景下的可用率更高,物理准确度、逼真度、可控性显著增强,更加贴合工业级创作场景的需求。企业和个人用户…- 0

- 0

-

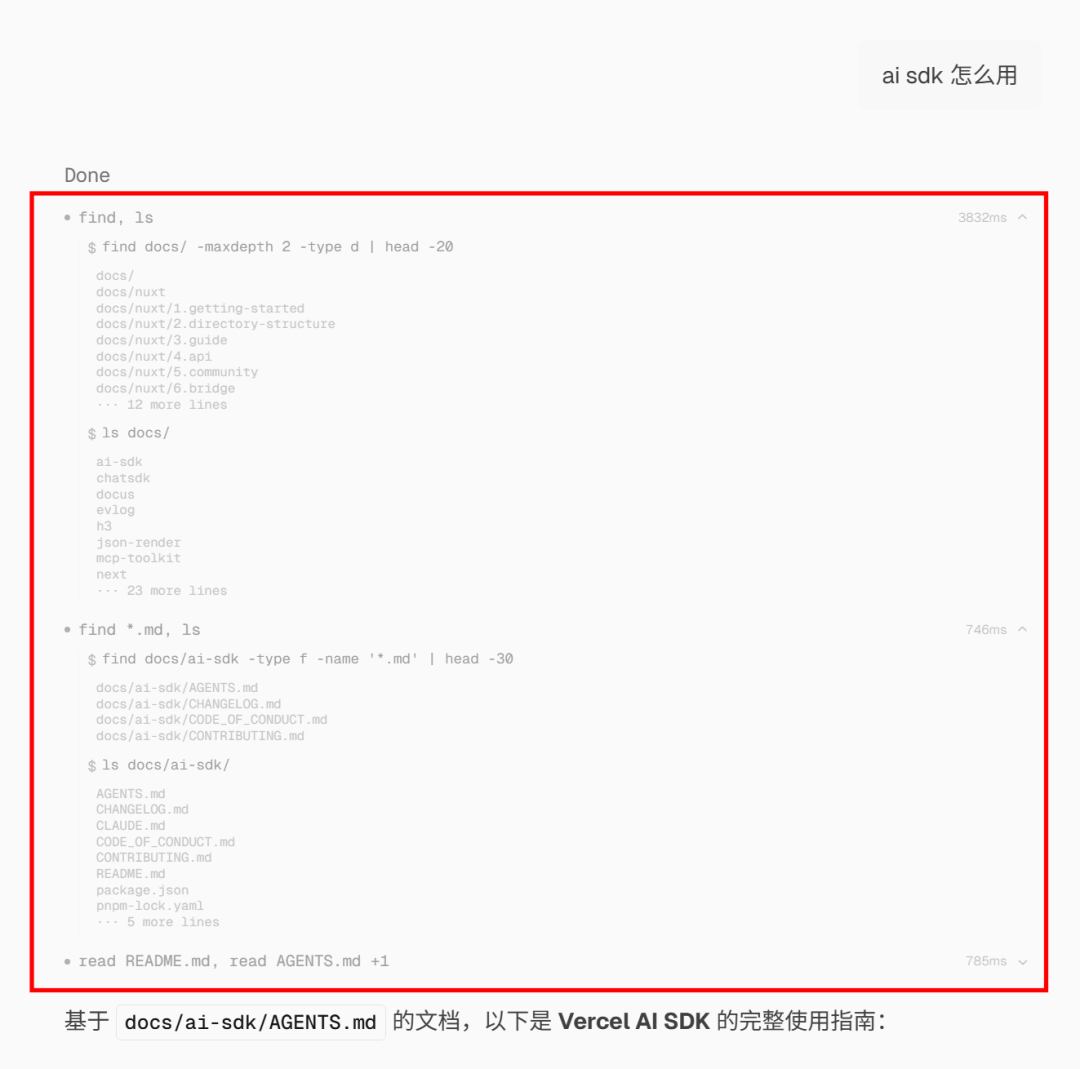

只用文件系统和 Bash,Vercel 做出了一套高效 RAG

不建向量库,也能做 RAG?Vercel 给了一个新答案Vercel 发了一篇博客:Build knowledge Agents without embeddings。开源了一个知识库agent问答项目 Knowledge Agent Template。该项目不靠“embeddings”实现了一个知识库搜索问答系统。它把知识库当成一个可搜索的文件系统:模型在 sandbox 里调用 gr…- 0

- 0

-

GraphRAG新范式 = LPG + 本体RDF

https://arxiv.org/pdf/2603.22340Graphs RAG at Scale: Beyond Retrieval-Augmented Generation With Labeled Property Graphs and Resource Description Framework for Complex and Unknown Search Spac…- 0

- 0

-

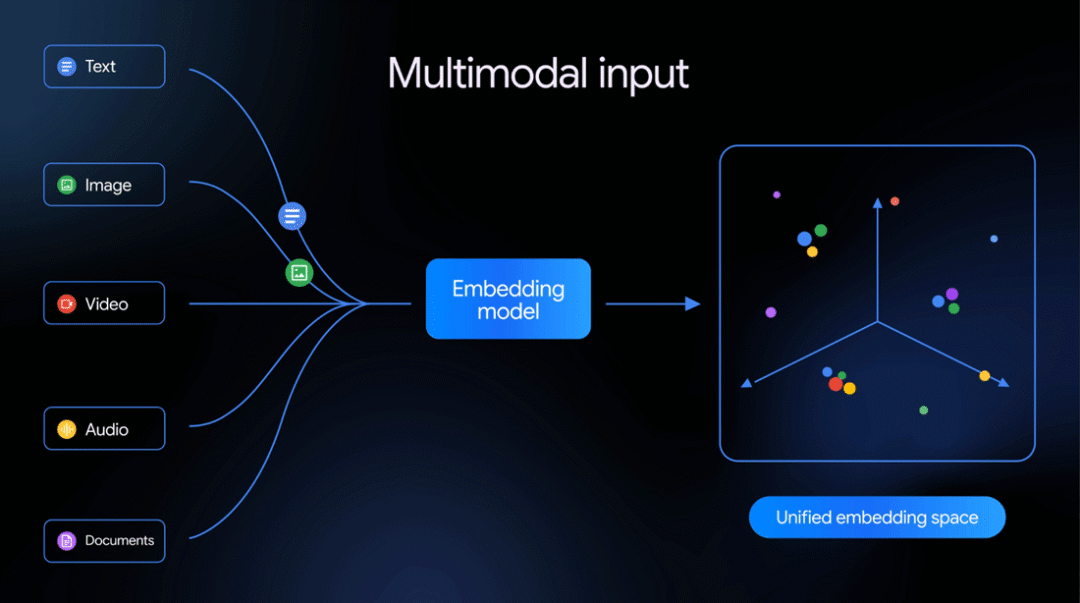

Google 发布首个全模态 Embedding 2 模型,文本图片音视频 PDF 统一到一个向量空间

Google 发布了一个新模型:Gemini Embedding 2。这是业界第一个原生支持五种模态的 Embedding 模型,能把文本、图片、视频、音频和 PDF 文档全部映射到同一个向量空间里。一个向量空间,五种数据类型。这个分量,做过 RAG 或语义搜索的,应该有所体会。先说 Embedding如果你不太了解 Embedding 是什么,可以这样理解:Embedding 就是把各种信息翻译…- 0

- 0

-

DeepSeek-OCR 2 来了,让 AI 也能像人一样,带着逻辑去看图

大家好,我是 Ai 学习的老章 关于 大模型 OCR,我之前写过不少: DeepSeek 最新开源OCR模型,实测,不如百度 DeepSeek-OCR本地部署(下):vLLM离线推理 为什么 DeepSeek-OCR 如此重要? 【教程】DeepSeek-OCR本地部署(上):CUDA 升级12.9,vLLM升级至最新稳定版 撸了一个 OCR 大模型对比工具:DeepSeekOCR、PaddleO…- 0

- 0

-

深度解析 PageIndex:无向量 RAG 框架的技术实现与原理剖析

摘要:本文深入剖析 PageIndex 的核心技术细节,详解 PDF/Markdown 文档的结构化索引构建流程、目录智能检测算法、LLM 驱动的树搜索检索机制,以及无向量 RAG 的完整实现原理。无论你是 RAG 技术研究者还是工程实践者,这篇技术解析都将为你揭示一种全新的文档检索范式。⭐ GitHub 14K Stars | 🔗 https://github.co…- 0

- 0

-

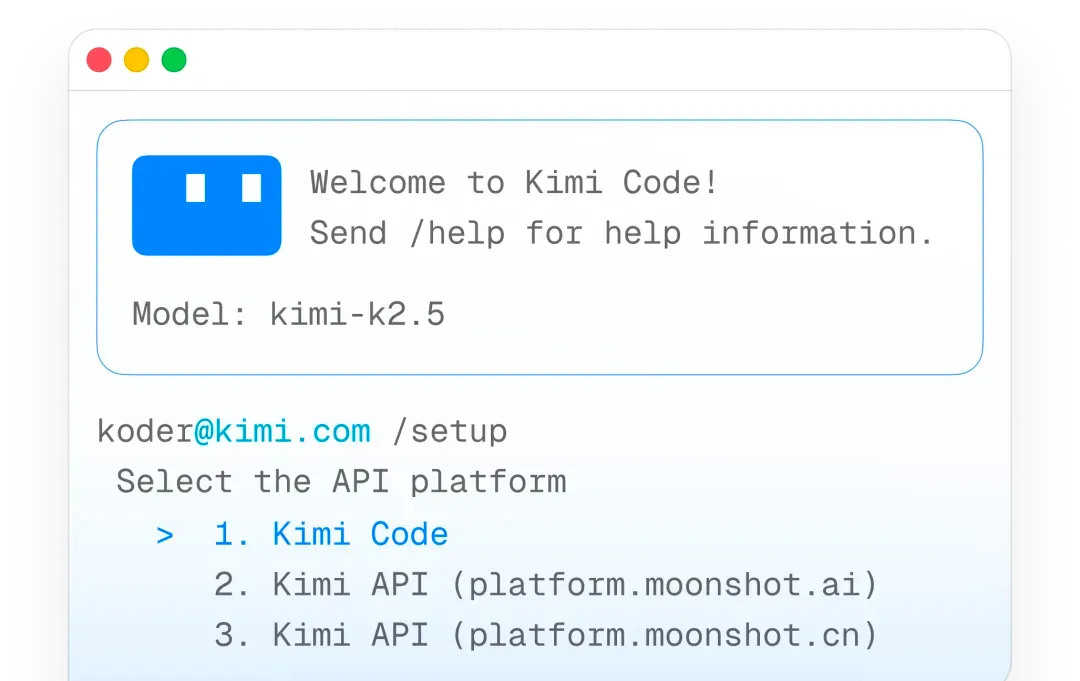

月之暗面Kimi正式发布官方编程工具:Kimi Code

月之暗面已正式发布 Kimi 的编程工具:Kimi Code。据介绍,它不仅能在终端里直接运行,还能无缝集成到 VSCode、Cursor、JetBrains 和 Zed 等主流编辑器中。Kimi Code 可充分发挥 K2.5 的多模态优势,支持直接输入图片和视频进行编程辅助,并能自动发现并将你现有的技能迁移到新的工作流中。官方介绍称,Kimi Code Bench 是其内部的代码能力评测基准,…- 0

- 0

-

使用 Agent Skills 做知识库检索,能比传统 RAG 效果更好吗?

使用 Agent Skills 做知识库检索,是一种什么体验?它能比传统的分块+向量匹配的 RAG 效果更好吗?大家好,欢迎来到 code秘密花园,我是花园老师,这一期我们进入 Agent Skills 的实战章节。基础回顾我们上期视频介绍了 Skills 的工作原理和使用方法,我们简单回顾一下:Skills 是最近 Anthropic 推出的一个 Agent 领域的行业标准,它本身就是一个文件夹…- 1

- 0

-

Gemini Embedding 2把多模态信息整合同一向量空间了,还需要多向量列吗?

昨天,谷歌正式发布首个原生多模态嵌入模型 Gemini Embedding 2。可以一次性把文本、图像、视频、音频、文档几大模态数据,全部映射进同一个统一的向量空间,做统一的管理与检索。那么问题来了,既然一个向量模型就能搞定全模态数据的语义表示,那向量数据库深耕多年的多向量列技术,还有存在的必要吗?01 Gemini Embedding 2,突破在哪里?Embedding模型的本质,是把…- 0

- 0

-

告别向量数据库!PageIndex:让AI像人类专家一样阅读长文档

传统RAG的检索准确率让你头疼?试试这个在金融问答基准测试中达到98.7%准确率的开源项目!前言:RAG的困境在使用大语言模型处理企业文档时,你是否遇到过这样的问题:向量检索经常"文不对题",检索到的内容看起来相似但实际不相关长文档被切成碎片后,上下文信息丢失严重检索结果难以解释,不知道为什么返回了这些内容面对专业文档(财报、法规、技术手册),检索准确率直线下降这些问题的根源在…- 0

- 0

❯

购物车

优惠劵

搜索

扫码打开当前页

联系我们

返回顶部

幸运之星正在降临...

点击领取今天的签到奖励!

恭喜!您今天获得了{{mission.data.mission.credit}}积分

我的优惠劵

-

¥优惠劵使用时效:无法使用使用时效:

之前

使用时效:永久有效优惠劵ID:×

没有优惠劵可用!