大家好,我是智见君!

今天凌晨 3 点多,OpenAI 在 X 上扔了一条大消息:ChatGPT Images 2.0 正式发布。官方给它的定位是”state-of-the-art 的图像模型”,能处理复杂的视觉任务,生成精准且立刻可用的画面。

但真正让我眼睛一亮的,是官方描述里的这一句话:

“从今天起,所有 ChatGPT 和 Codex 用户都能用。”

没错,以前专心写代码的 Codex,现在也能画图了。

我第一时间上手试了一下

趁着热乎,我打开自己的 Codex(v0.122.0,模型是 gpt-5.4),丢了一句话过去:

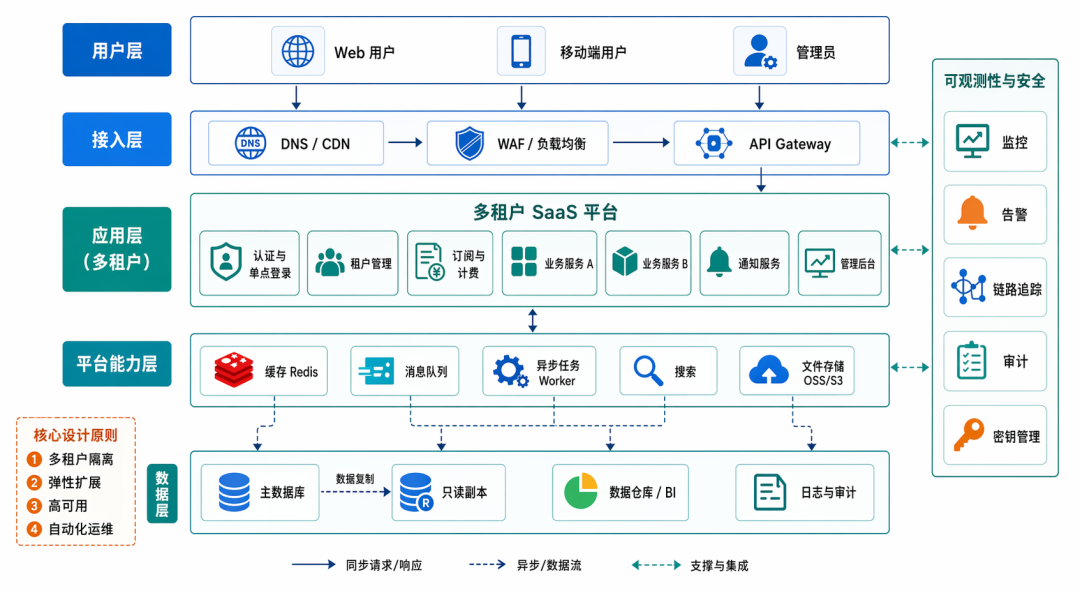

画一个图:SaaS 架构应该是什么样子?

没配置任何图像模型的密钥,没装额外插件,Codex 直接就开画了。一分钟不到,一张分层清晰的 SaaS 架构图就扔到了本地目录 .codex/generated_images/ 下。

扫一眼就能看出完成度:

-

• 分层清晰:从上到下依次是用户层、接入层、应用层(多租户)、平台能力层、数据层 -

• 支撑能力单独拉出:右侧竖着一条”可观测性与安全”纵向区,涵盖监控、告警、链路追踪、审计、密钥管理 -

• 设计原则做成小便签:左下角贴了一张橙色的”核心设计原则”,列出多租户隔离、弹性扩展、高可用、自动化运维四点 -

• 图例规范:底部用不同的线型区分了同步请求、异步数据流、支撑与集成三种关系

最让我意外的是中文渲染。以前让 AI 画带中文的架构图,要么字糊成一团,要么把”业务服务”写成乱码。这次从”多租户 SaaS 平台”到”文件存储 OSS/S3″,所有中文标签都清清楚楚,连中英文混排都排版得整整齐齐,比此前的版本好了不是一点半点。

更关键的是整个过程:不用配图像模型的密钥、不用切到 ChatGPT 网页、不用跳出编码流程。在终端里写代码,顺手就把配图生成了。

这就是 Codex 原生接入 Images 2.0 的价值:编程 Agent 第一次有了一支画笔。

一句话概括这次更新

OpenAI 把这次的图像模型叫做 Images 2.0,底层模型的代号是 gpt-image-2,API 也同步开放。几个关键数字先抛出来:

-

• 最高支持 2K 分辨率 -

• 宽高比从 3:1 到 1:3 全覆盖 -

• 知识截止到 2025 年 12 月 -

• 带思考(thinking)的图像生成先开放给 ChatGPT Plus、Pro 和 Business 用户,企业版即将跟进

相比两年前的 DALL-E 3,Images 2.0 肉眼可见的一个进步是:它真的会写字了。那些年被网友截图调侃过的拼写错误(比如把 “enchilada” 画成 “enchuita”、把 “churros” 画成 “churiros”),这次基本绝迹。

更精确的指令执行和细节控制

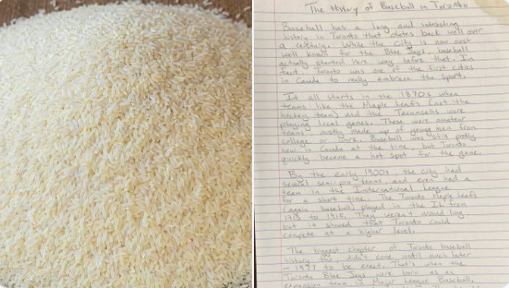

OpenAI 给了一个很直观的演示:一盘米饭。放大到极致,每一粒米的颗粒感、反光、影子都交代得清清楚楚。旁边放一本手写笔记本,字迹是连贯的英文手写体,能正常读通。

这一直是图像模型的老大难问题。小号字体、图标、UI 元素、密集的构图、细微的风格约束,以前随便一个就能把模型搞崩。Images 2.0 声称把这些细节全部拉到了可用水平,而且一次性最高能输出 2K 分辨率的画面。

对设计师来说这很关键。以往 AI 生成的图只能当”灵感草图”,线稿、细节、字体全要人工重画。Images 2.0 如果真能做到官方宣传的水准,它就从”参考稿”变成了”可直接交付的素材”。

跨语言能力有了明显提升

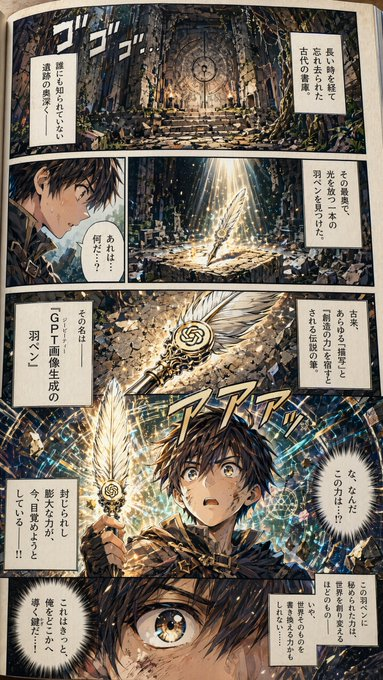

Images 2.0 这次专门强调了非英文文本的渲染,日语、韩语、中文、印地语、孟加拉语都在优化名单里。

官方放了一张日式漫画的样例,四格分镜、对白、拟声词 “ゴゴゴ” 全都排版到位,甚至连 “羽ペン”(羽毛笔)这种复合词都写对了。熟悉日漫套路的读者应该能感受到,这不是单纯”生成一张日文图”,而是模型真的理解了漫画的视觉语言。

这背后的意义是,图像模型正在从”照着画”走向”理解着画”。以前你让它画一张带中文的海报,它可能把”开业大吉”画成一堆像汉字又不是汉字的符号。现在它能当真正的文字来写,字形、排版、语序都在线。

宽高比放开到 3:1 和 1:3

这是很实用的一个升级。以前生成横幅广告、PPT 封面、社交媒体卡片、长海报,宽高比卡死在 1:1、16:9 几个常见档位,用起来很别扭。

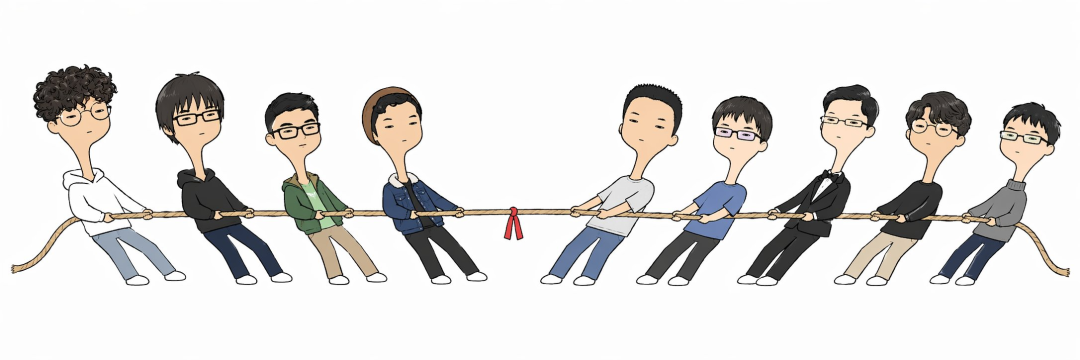

Images 2.0 直接把范围拉到 3:1 到 1:3。横的可以做 Banner、幻灯片、封面图,竖的可以做海报、长图文、朋友圈九宫格。官方甚至放了一张超长竖图的拔河场景,身高比例被夸张拉伸,但人物结构完全没崩。

风格的精致与照片写实

Images 2.0 能同时驾驭照片、电影静帧、像素艺术、漫画等多种视觉语言,在纹理、光影、构图和细节上都更一致。

官方特别提到了几个可以直接落地的场景:游戏原型制作、分镜设计、营销创意、特定媒介或类型的素材生成。对游戏开发者和独立创作者来说,这意味着很多前期开发环节可以被压缩到几个 prompt 里。

现实世界的智能:它能读懂内容再画

这可能是 Images 2.0 区别于其他图像模型的核心能力。官方给的示例是康托尔对角线法(Cantor’s Diagonalization),一个数学证明。模型不仅画出了清晰的分步图示,每一步的数学表达式、符号、逻辑关系都正确。

这意味着它不再是单纯的”美学引擎”,而是把文本推理能力接进了图像生成。OpenAI 给它的定位很明确:从文案撰写到数据分析再到设计构图,一条龙做完。

说白了,以前的图像模型像艺术家,现在的 Images 2.0 更像是会思考的设计师。

Codex 也能画图,到底意味着什么

回到开头那个点。Codex 是 OpenAI 家的编程 Agent,原来主要面向写代码的开发者。现在把图像生成塞进去,实际意义是什么?

最直接的场景有几个:

-

• 前端开发:一边写 React 组件,一边让 Codex 直接生成对应的 Icon、Banner、空状态插画,不用再切到别的工具 -

• 产品原型:写 PRD 时同步让 Codex 画 UI 草图、流程图、架构图 -

• 文档与演示:写技术文档时自动生成配图,做汇报时直接出 PPT 封面 -

• 游戏与素材:写游戏逻辑时同步生成角色、场景、UI 素材

对 Agent 工作流来说,这是一次能力扩展。以前 Agent 只能”生成代码 + 写文字”,现在能”生成代码 + 写文字 + 画图”,一套流程里闭环的事情更多了。

过去几个月,Codex 一直在往”完整软件工厂”的方向上走。代码、测试、部署、文档都在一个 Agent 里搞定,现在加上图像生成,基本上一个独立开发者需要的能力栈齐全了。

可用性、API 和定价

Images 2.0 从今天起向所有 ChatGPT 和 Codex 用户开放。带思考的图像生成(Images with thinking)是 Plus、Pro、Business 用户先用,企业版稍后跟进。手机端记得更新到最新版。

API 这边,模型 ID 是 gpt-image-2,已经可以调用。OpenAI 暂时没给出完整的定价表,只说”价格取决于质量和分辨率”。想接入到自家产品里的团队可以先跑几个 demo 看看效果。

智见君的判断

这次升级最值得关注的不是画得多好看,而是图像生成正在从”创意工具”变成”生产力工具”。

过去两年,图像模型基本都在比拼谁的画风更艺术、谁的脸更逼真。但对绝大多数真实的工作场景来说,人们要的不是一张很美的图,而是一张能直接用的图。海报上的字不能错、图表的数据不能乱、UI 元素要精确对齐、多语言要能看懂。

Images 2.0 解决的就是这些”不性感但必须”的问题。它让渡了一部分艺术家气质,换来了更可靠的工程属性。对于把 AI 当工作伙伴的人来说,这比再高一分的”审美分”有用得多。

顺带一提,Codex 用户这次多了一个画图能力。对那些做全栈、独立开发、内容创作的朋友,工作流可能要重新设计一下了。