-

刚刚,李飞飞最新成果发布,手机也能跑亿级粒子的 3D 世界了|附体验地址

拍一圈照片,就能生成一个可交互的 3D 世界,已经不是什么新鲜话题了。但问题是如何把一个大世界塞进普通人的手机浏览器里。就在刚刚,李飞飞旗下 AI 世界模型公司 World Labs 发布并开源了一个最新成果:Spark 2.0。这个专为网页端设计的动态 3D 高斯点云(3DGS)渲染引擎,让在任何设备的浏览器里流畅运行上亿粒子的超大 3D 场景,开始逐渐成为现实。为什么把亿级粒子的 3D 世界塞…- 0

- 0

-

豆包「打电话」升级 Seeduplex:周围再吵,只认准你的声音

最近在用豆包的语音通话功能,跟它聊 AI + OPC 的选题。说到一半,脑子里突然卡壳,想找个更准确的词,就停了大概一两秒。我心想完了,下意识等待着被它打断,因为以前用语音 AI 都是这样,你稍微一顿,它就急着往上接,搞得像在跟一个急性子同事抢麦。但这次它没有。它就安安静静等着,直到我把后半句说完,才开始回应。那个瞬间我愣了一下,感觉跟之前用的语音助手完全不是一回事。更让我意外的是这周我去公园里的…- 1

- 0

-

美团发布原生多模态 LongCat-Next:当视觉和语音成为AI的母语

物理世界的信息由图像、声音、文字交织而成。今天的大模型,本质上仍然是以语言为中心的建模系统,语言作为人类智慧符号化表述,在“压缩即智能”的范式下表现出强大的能力。但通往真正的物理世界智能,也许语言并不是世界的边界。视觉、语音与文本等多模态信号,实际上是对现实物理对象的不同侧面投影。这就引出一个根本问题:能否让 AI 像处理语言一样,用同一种方式简洁有效地处理物理世界的多种信息? 如果能,…- 0

- 0

-

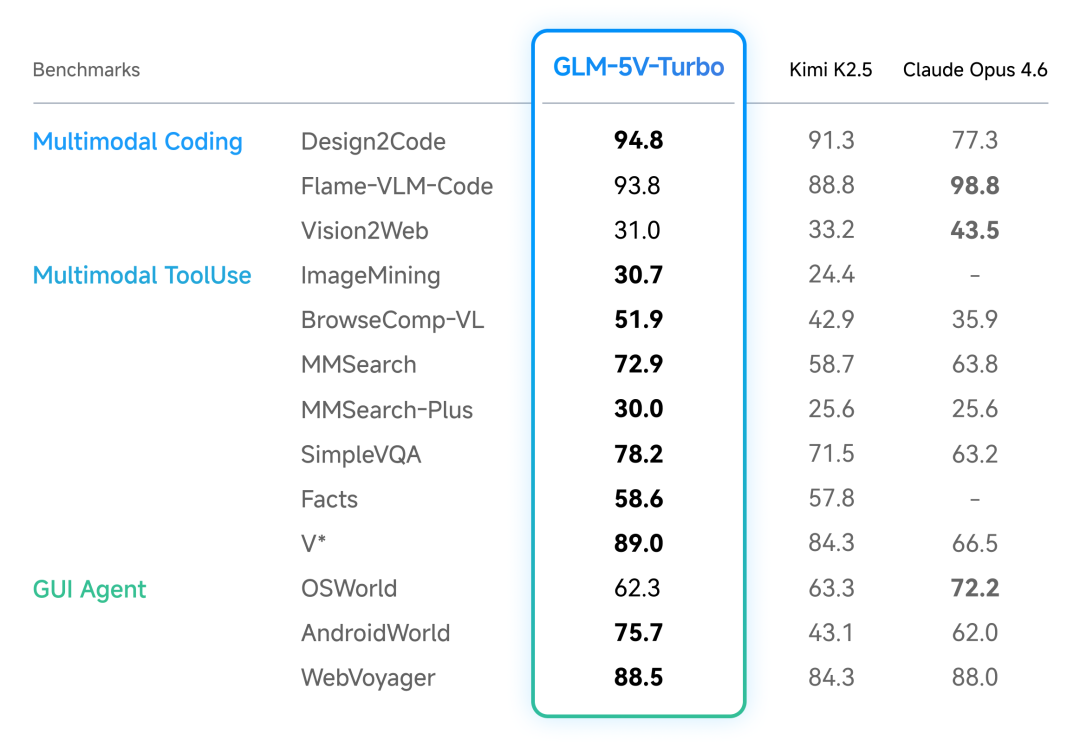

全解读|智谱 GLM-5V-Turbo 发布,多模态 Coding 基模

MODEL今天,智谱发布 GLM-5V-Turbo,定位「面向视觉编程的多模态 Coding 基座模型」一句话概括:在 GLM-5-Turbo 的编程和龙虾能力基座上,加入了原生的视觉理解和推理能力模型能看懂设计稿、截图、网页界面,据此生成完整可运行的代码GLM-5V-Turbo Playground:左边是手绘草图,右边是生成的完整前端页面从 GLM-5 到 GLM-5V-Turbo先理一下产品…- 0

- 0

-

GLM-5V-Turbo:多模态Coding,图像即代码

Agent时代,模型能力由模型智能以及其处理的context容量两个维度定义。一个能够原生处理图片、视频、文本等多模态context,同时擅长复杂编程、长程规划、动作执行的Coding基座模型,将是所有AI原生应用的基石。今天,我们发布GLM-5V-Turbo,面向视觉编程打造的多模态Coding基座模型。GLM-5V-Turbo从预训练阶段深度融合视觉与文本能力,让编程不再局限于纯文本输入。模型…- 0

- 0

-

突破零样本TTS音色克隆上限:LongCat-AudioDiT 的声音克隆艺术

音频生成技术正在经历一场全新的范式迁移——从传统级联架构,逐步向端到端生成范式演进。长期以来,主流的做法是“曲线救国”:合成系统先将音频压缩成梅尔频谱图等中间表征,再依赖神经声码器“翻译”回波形。每一次转换都带来信息损失与误差累积,最终丢失了最需要保留的细腻音色与个性化细节。能不能让 AI 直接学会声音本身的规律,跳过中间环节?为破解这一技术瓶颈,美团 LongCat 团队正式发布 LongCat…- 0

- 0

-

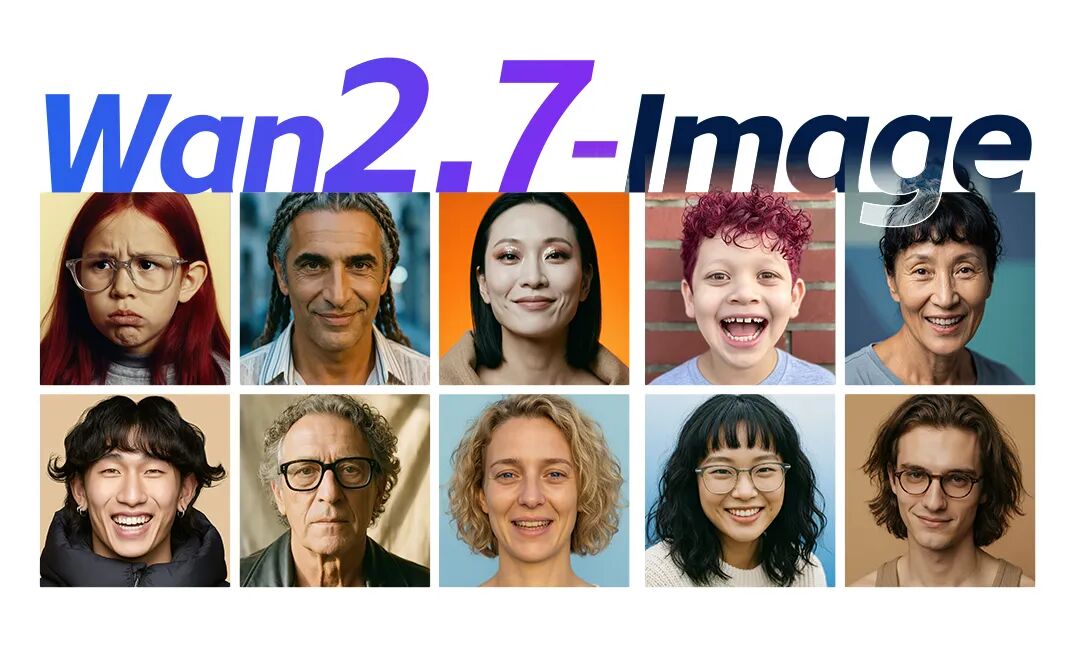

千人千面,精控调色,更懂你的Wan2.7-Image来了

今天,阿里发布图像生成与编辑统一模型Wan2.7-Image告别AI标准脸,实现“千人千面”全新支持“调色盘”,精准控制色彩3K token超长文本渲染,可写满一页A4纸交互式编辑,哪里不爽点哪里具备文生图、图生组图、图像指令编辑和交互式编辑等全链路能力文生图升级亮点千人千面:虚拟角色捏脸功能为告别千篇一律的“AI脸”,Wan2.7-Image强化了虚拟形象捏脸功能,支持从骨相、眼眸到五官细微处的…- 0

- 0

-

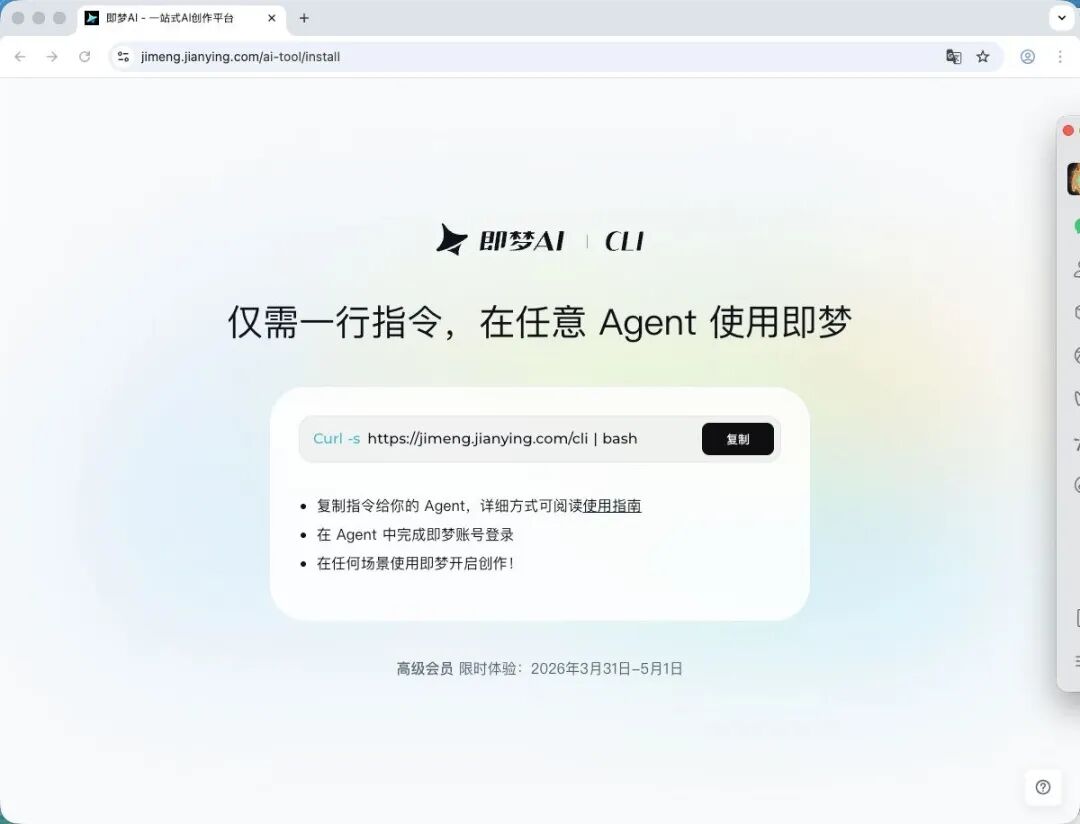

震惊!即梦推出 CLI,Agent 一行命令生成 Seedance 2.0 视频,AI 视频井喷

SMARTFLOW AI INSIGHT即梦出 CLI 了:一行命令让任意 Agent 生成图片和视频Seedance 2.0 · 文生图/文生视频/图生视频 · 限时体验 · 2026.03.31 字节跳动的即梦 AI 发布了官方 CLI 工具——一行 curl 安装,让任意 Agent(Claude Code、Codex、自定义脚本)直接调用即梦的图片和视频生成能力。高级会员限时体验…- 0

- 0

-

千问发布Qwen3.5-Omni全模态模型,超越Gemini3.1 Pro?附实测~

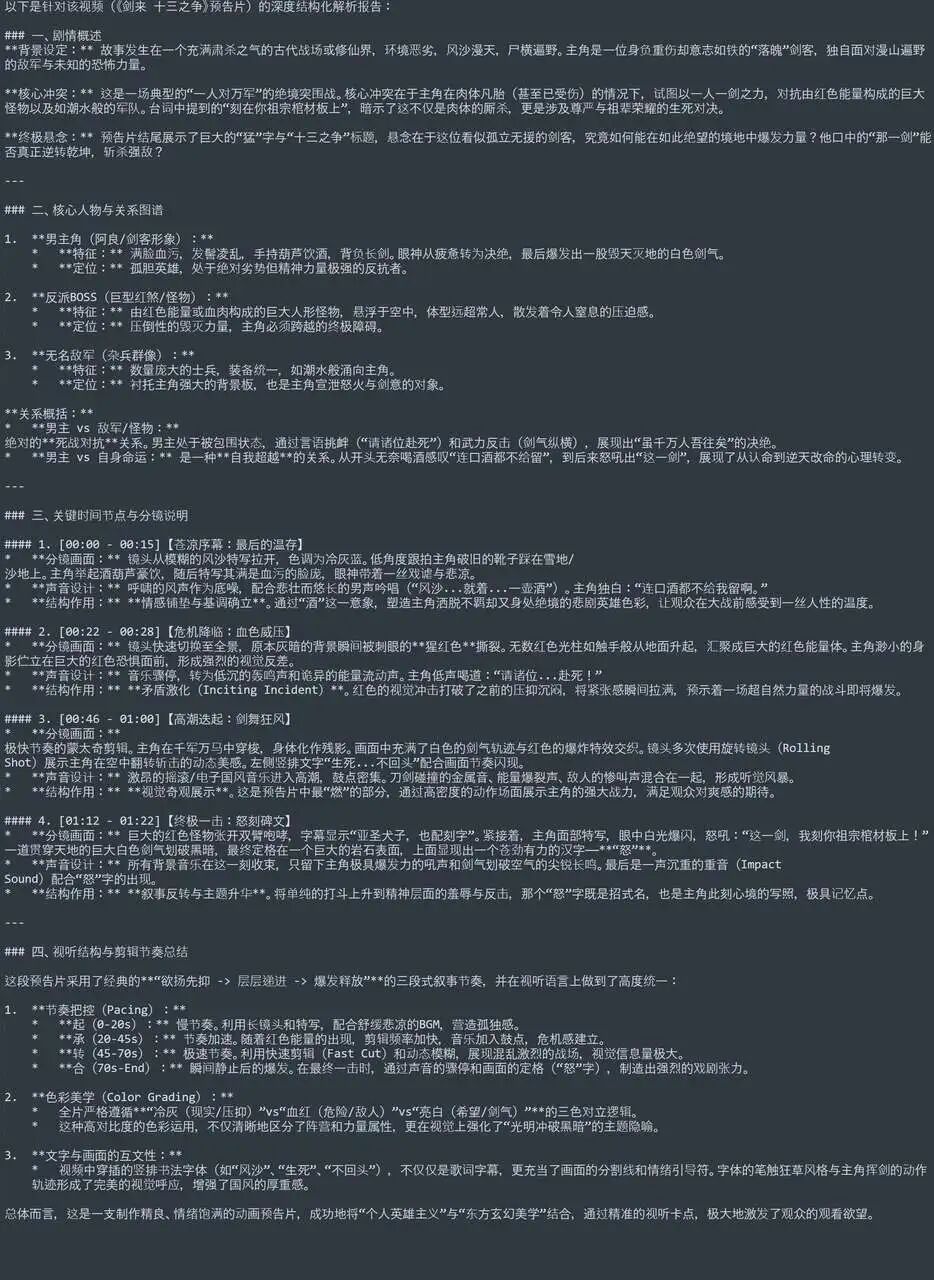

千问又又又更新模型了,Qwen3.5-Omni模型,也就是全模态模型,这里的全模态,是指支持全模态输入,输出是文本或者语音。话不多说,先看效果,我让Qwen3.5-Omni模型分析了一下剑来 阿良PV的相关内容,并且对比了Gemini3.1 Pro的效果,Qwen3.5-Omni更细致并且知道剑来~然后接入龙虾,我搞了个Skill,把罗永浩十字路口的2.5h的播客,直接4min速通,核心内容基本没…- 0

- 0

-

Google 和 Cohere 同日发布音频 AI 模型

Google 和 Cohere 在同一天发布了新的音频处理模型。Google 的 Gemini 3.1 Flash Live 主打自动化客户服务,Cohere Transcribe 则专注于语音转文字。两款模型都比前代有显著提升。这是 AI 从"看"到"听"的关键一步。Gemini 3.1 Flash Live:能听、能看、能懂情绪Google 这次有点东西…- 0

- 0

-

让“龙虾”帮你自动赚钱!OpenClaw Seedance 2.0 视频生成全攻略

千呼万唤始出来,终于肝完了龙虾(OpenClaw)实现seedance2.0视频一键生成本文将结合实战案例,介绍完整使用方法和心路历程,让大家感受下龙虾的强大服务器:适用于vps、自己电脑。Agent适用:openclaw、claude code 等一、源起这个事情起源于,推上一个大佬发的推文,看完后,我觉得专门开一个topic 来研究它结果龙虾出乎意料,顺利地将热门视频下载下来了,还…- 0

- 0

-

通用语音识别模型VibeVoice ASR:长达60分钟音频一次性“直出”结构化转写

语音识别技术在近年来取得了飞速发展,但在面对真实的复杂场景时,许多系统依然显得有些力不从心:漫长的会议、多人混杂的交谈、极具专业性的行业术语,或是中英夹杂的日常对话…… 传统的语音识别系统往往需要将长音频切分成一个个短小的片段,分别识别后再费力地“拼凑”起来。这种“化整为零”的方法不仅容易丢失上下文,还常常在谁说了什么、什么时候说的等问题上张冠李戴。近日,微软亚洲研究院发布了一款通用的语音识别模型…- 0

- 0

-

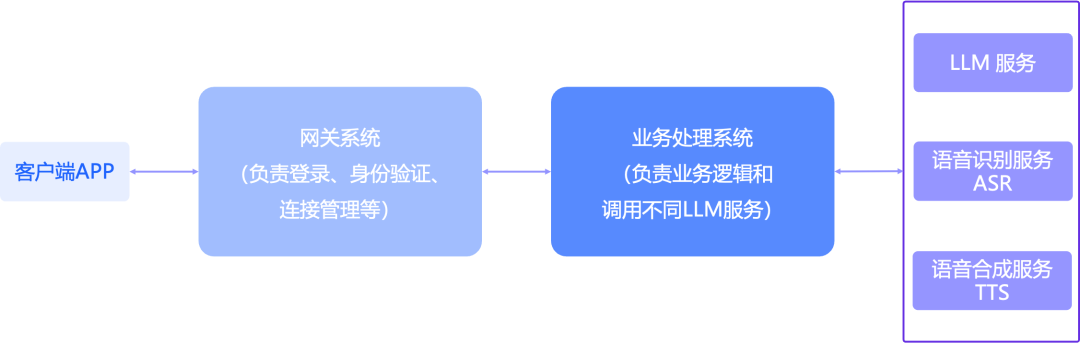

Agent 语音交互如何更稳、更快?一次高并发消息链路优化实践

随着大语言模型(LLM)、语音识别(ASR)、语音合成(TTS)等能力逐步成熟,AI Agent 开始从文本交互走向语音交互,典型场景包括 AI 教师、AI 情感聊天、AI 助手等。相比文本输入,语音更自然、更实时,用户可以直接通过说话完成提问、练习、任务触发与多轮对话,这也让“和 Agent 用语音对话”真正进入实际业务场景。但当 Agent 语音交互进入高并发场景后,很多团队会发现:最先遇到瓶…- 0

- 0

-

KDD 2026 | 小红书内容审核:Hi-Guard 让内容治理“知其然,更知其所以然”

引言:内容安全是平台治理的生命线,旨在精准识别与处置色情和暴力等不健康和违规内容。传统审核模型通过“黑盒”分数直接给出识别结论,在处理复杂语义和隐晦内容时和规则对齐方面存在困难。推动治理模型从“标签驱动”向“政策规则驱动”演进,同时具有政策规则的可解释性,已成为构建可信可泛化安全系统的核心方向。为解决上述问题,小红书内容理解团队提出层级式治理框架 Hi-Guard,通过分层流水线与路径感知的强化学…- 0

- 0

-

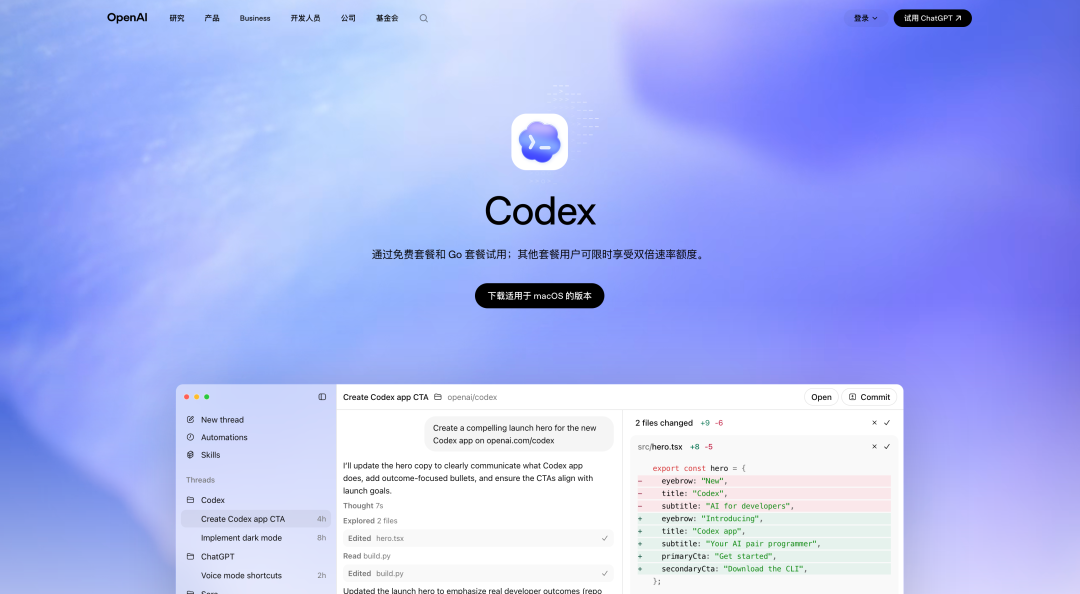

零帧起手 Codex × Figma 双向工作流实操

前几天我发了一篇关于 Figma 着急了!Codex 和 Figma 双向构建前端 UIAgent的完美融合" data-itemshowtype="0" linktype="text" data-linktype="2">取代Figma的新神器?Paper:设计、代码与AI Agent的完美融合的文章。很多人小…- 0

- 0

-

Seedance 2.0 正式发布

今天,我们正式发布新一代视频创作模型 Seedance 2.0。Seedance 2.0 采用统一的多模态音视频联合生成架构,支持文字、图片、音频、视频四种模态输入,集成了目前业界最全面的多模态内容参考和编辑能力。相比 1.5 版本,Seedance 2.0 的生成质量大幅提升,其在复杂交互和运动场景下的可用率更高,物理准确度、逼真度、可控性显著增强,更加贴合工业级创作场景的需求。其核心亮点如下:…- 0

- 0

-

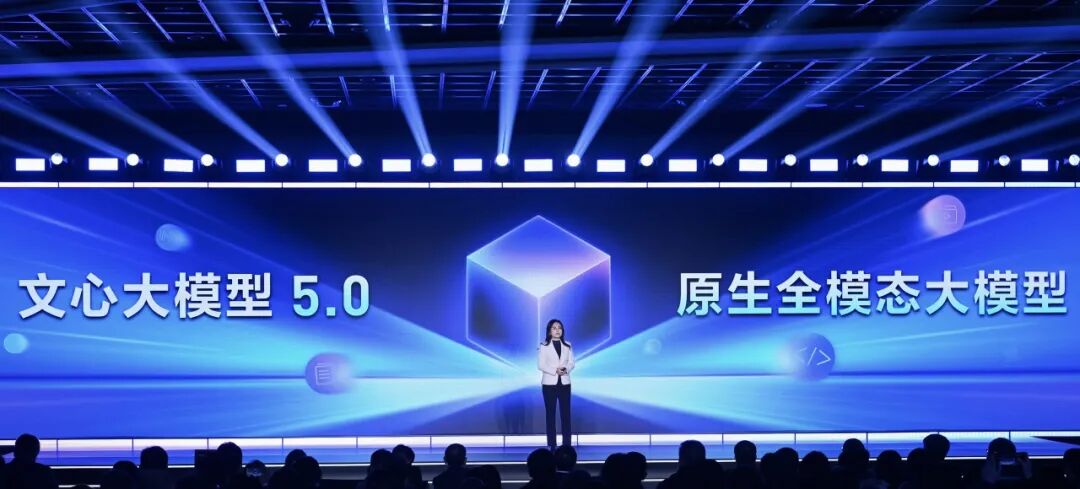

文心大模型5.0正式版,上线!

今天,在百度文心Moment大会现场,文心大模型5.0正式版上线。文心大模型5.0正式版参数达2.4万亿,采用原生全模态统一建模技术,具备全模态理解与生成能力,支持文本、图像、音频、视频等多种信息的输入与输出。在40余项权威基准的综合评测中,文心5.0正式版的语言与多模态理解能力稳居国际第一梯队。图像与视频生成能力与垂直领域专精模型相当,整体处于全球领先水平。目前,用户可在文心APP、文心一言官网…- 0

- 0

-

NanoBanana 2.0 来了, 对比前一代和即梦 5.0 lite,它依旧强的离谱

刚刚,Nano Banana 2.0 上线, 一看到这个名字有点恍惚,我以为上个版本也是 2.0,专门去搜索了,才弄明白:25 年 11 月 20 号发布的是 nanobanana pro25 年 9 月发的 nanobanana而香蕉模型的 API 生图名称是 gemini-3-pro-image-preview这个混乱的命名让我想起了 GPT4.0 系列,好在不需要在对话框里去选择那…- 0

- 0

-

Seedance 2.0上线火山方舟体验中心,API即将开放

今天,豆包视频生成模型 Seedance 2.0 正式上线火山方舟体验中心。Seedance 2.0采用多模态音视频联合生成架构,支持文字、图片、音频、视频四种模态输入,集成了目前业界最全面的多模态内容参考能力。相比1.5版本,Seedance 2.0的生成质量大幅提升,其在复杂交互和运动场景下的可用率更高,物理准确度、逼真度、可控性显著增强,更加贴合工业级创作场景的需求。企业和个人用户…- 0

- 0

-

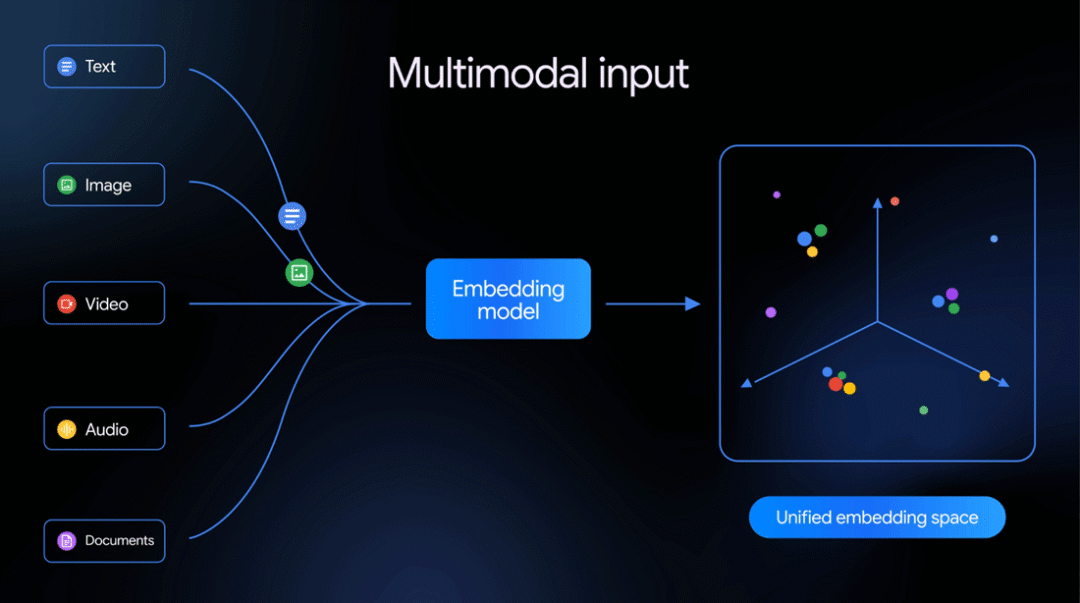

Google 发布首个全模态 Embedding 2 模型,文本图片音视频 PDF 统一到一个向量空间

Google 发布了一个新模型:Gemini Embedding 2。这是业界第一个原生支持五种模态的 Embedding 模型,能把文本、图片、视频、音频和 PDF 文档全部映射到同一个向量空间里。一个向量空间,五种数据类型。这个分量,做过 RAG 或语义搜索的,应该有所体会。先说 Embedding如果你不太了解 Embedding 是什么,可以这样理解:Embedding 就是把各种信息翻译…- 0

- 0

-

DeepSeek-OCR 2 来了,让 AI 也能像人一样,带着逻辑去看图

大家好,我是 Ai 学习的老章 关于 大模型 OCR,我之前写过不少: DeepSeek 最新开源OCR模型,实测,不如百度 DeepSeek-OCR本地部署(下):vLLM离线推理 为什么 DeepSeek-OCR 如此重要? 【教程】DeepSeek-OCR本地部署(上):CUDA 升级12.9,vLLM升级至最新稳定版 撸了一个 OCR 大模型对比工具:DeepSeekOCR、PaddleO…- 0

- 0

-

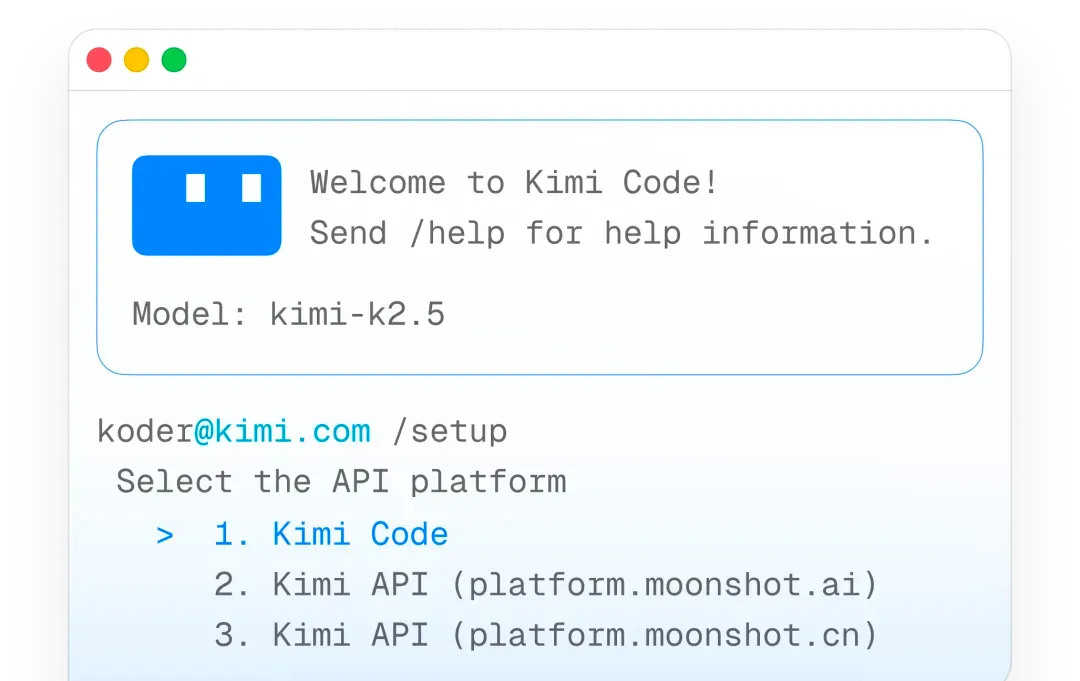

月之暗面Kimi正式发布官方编程工具:Kimi Code

月之暗面已正式发布 Kimi 的编程工具:Kimi Code。据介绍,它不仅能在终端里直接运行,还能无缝集成到 VSCode、Cursor、JetBrains 和 Zed 等主流编辑器中。Kimi Code 可充分发挥 K2.5 的多模态优势,支持直接输入图片和视频进行编程辅助,并能自动发现并将你现有的技能迁移到新的工作流中。官方介绍称,Kimi Code Bench 是其内部的代码能力评测基准,…- 0

- 0

-

Gemini Embedding 2把多模态信息整合同一向量空间了,还需要多向量列吗?

昨天,谷歌正式发布首个原生多模态嵌入模型 Gemini Embedding 2。可以一次性把文本、图像、视频、音频、文档几大模态数据,全部映射进同一个统一的向量空间,做统一的管理与检索。那么问题来了,既然一个向量模型就能搞定全模态数据的语义表示,那向量数据库深耕多年的多向量列技术,还有存在的必要吗?01 Gemini Embedding 2,突破在哪里?Embedding模型的本质,是把…- 0

- 0

-

一篇文章讲清楚:到底什么是NotebookLM?除了PPT,它还能做啥?

上个月谷歌的Gemini和Nano Banana那一阵之后随之火爆全网的还有同为谷歌系产品的NotebookLM这期内容,我将为大家详细讲解:NotebookLM,到底是什么?以及,它都能干些什么~首先,什么是NotebookLM?通俗地解释,NotebookLM是每个人的一个专属AI资料助手。或者还可以用简单贴切的描述来进行解释:一个私人知识库。在这个知识库里,你能将一些你用得上的资料分类存放在…- 0

- 0

❯

购物车

优惠劵

搜索

扫码打开当前页

联系我们

返回顶部

幸运之星正在降临...

点击领取今天的签到奖励!

恭喜!您今天获得了{{mission.data.mission.credit}}积分

我的优惠劵

-

¥优惠劵使用时效:无法使用使用时效:

之前

使用时效:永久有效优惠劵ID:×

没有优惠劵可用!