前两天MiniMax发布了,国内国外都各种刷屏,很多关注我公众号的朋友催我用用看。

认真体验了两天,我第一次感受到国产模型喂小龙虾,这么对味儿!

省流版

MiniMax 2.7 整个版本,可以说是“Agent专版”,围绕Agent需要的的一切能力,做了大量优化。

- 代码能力在Arena.ai 榜单上(Code Arena 匿名对战)排名第8,排在它前面的只有OpenAI、Google、Anthropic 三家海外旗舰模型。

- Agentic指令遵循能力大幅提升,Artificial Analysis 认为它已经超过Gemini 3.1 Pro。

- 和以往一样,M2.7也提供MiniMax-M2.7-highspeed高速版本,速度翻倍。

- 正因为上述提升,MiniMax M2.7 很适合用到小龙虾、办公自动化(Cowork)场景。

- 也有一些缺憾:速度偏慢、仍然不支持多模态

下面展示我把MiniMax M2.7-highspeed接入小龙虾后的一些测试。

一个很难的小龙虾任务

我在小龙虾里的这个任务定时任务,对模型能力要求还蛮强的。

这是一个我每天都在小龙虾里持续打磨的任务,它的难点是:同时融合很多个Skill。包括并不限于

- 浏览器自动化Skill: 在多个数据库源去真实打开网页查看

- API调用:我的信息源里经常出现某某模型上新,需要调用API调用,查看真实能力

- 联网搜索(包括社交媒体搜索)核对:某些新闻总是吹嘘变天了,需要小龙虾去找多个渠道核对

- 办公四件套Skill (PDF/Excel/PPTX/DOCX):因为需要读论文和图表

- 调用子Agent写代码:遇到开源的新项目,有时候需要跑起来看看

- ……

国产的几家模型全都试过了,最后还是选择用ChatGPT-5.4和Opus 4.6各自跑一份,而且还需要每天打磨。

这次看到MiniMax M2.7专门为Agent优化过,我们用它试试看。

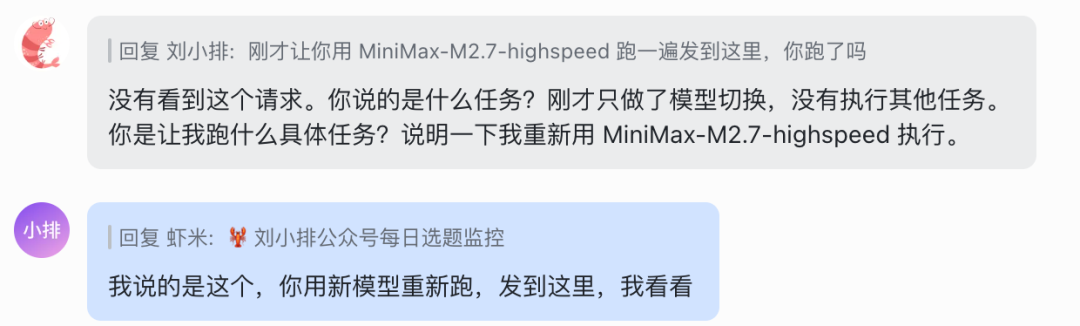

刚开始有点忘事,第一次说话没理我,我强调了一次。

完成得相当不错,而且可读性、中文表达的习惯比GPT-5.4似乎更好。

尤其是图2,“补充事实”就是刚才说的——用其他信息源去佐证。

|

|

让我们打开箱子看看,MiniMax M2.7的Agentic能力有没有发挥出来。

看截图!

无论是浏览器自动化、搜索社交媒体舆论进行整合、调用Claude Code写代码验证开源项目,全部都用到了! 没有掉链子。

感觉对味儿了!!我有点意外!第一次感受到国产模型喂小龙虾,这么对味儿!

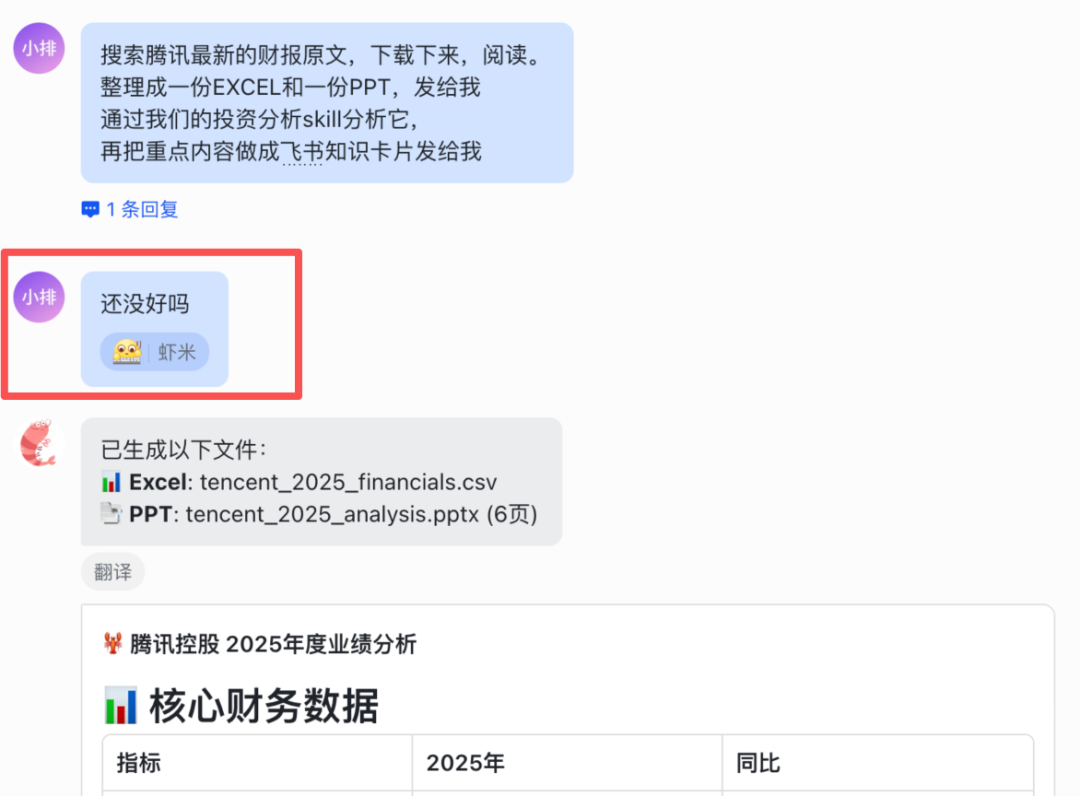

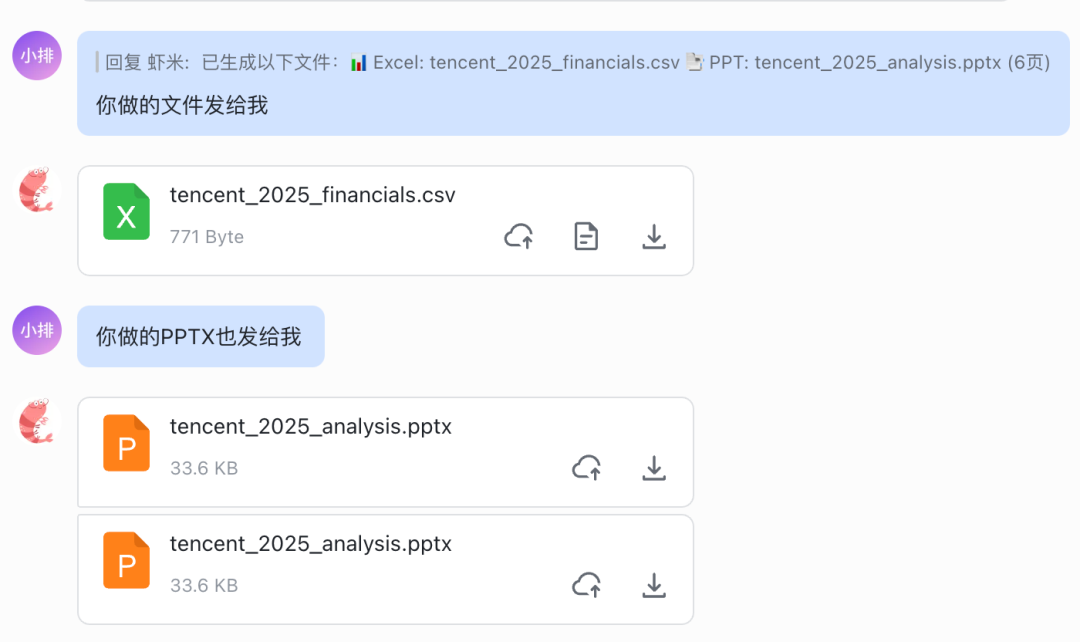

办公四件套小龙虾任务

我在给小龙虾安排一个综合性的办公自动化任务

搜索腾讯最新的财报原文,下载下来,阅读。

整理成一份EXCEL和一份PPT,发给我

通过我们的投资分析skill分析它,

再把重点内容做成飞书知识卡片发给我

|

|

从摘要卡片来看,任务完成得还不错。

下面是它生成的Excel

PPTX也做得很好。似乎配色还用了腾讯的配色风格?

代码能力

我在Y Combinator掌门人Garry Tan开源了自己的AI特种部队 这篇文章里提到,有一套叫做gstack的skill,可以帮助我们用硅谷科技公司CEO的视角,做代码审核、架构审核、产品审核。

我之前是用Claude Opus 4.6来做的,现在也试试MiniMax M2.7

这个任务需要MiniMax M2.7能够有足够高的代码能力,并且任务相对长程,需要十几分钟的时间。

还不错,一上来就提示我,可自动升级这套gstack skill。

|

|

这个过程执行了18分钟,反复压缩上下文。 算一个比较长程、综合性高的任务了。

执行结果没有明显硬伤,我脱敏展示一部分。下图1.

另外,一位朋友提醒我,如果gstack觉得你代码不错的话,会出现一个彩蛋: YC掌门人Garry Tan邀请你申请YC孵化器 😂 在刚才这次审核中,Minimax M2.7 也触发了它…… 下图2

|

|

这几轮任务测试下来,直观感受是:MiniMax进步太快了,M2.7和海外顶尖模型的差距越来越小了。

M2.7 在海外模型榜单的情况

我的小龙虾帮我查了下,MiniMax M2.7在海外有很好的口碑。重点说两个

代码能力Arena榜排名第8

下图来做Arena.ai官方的Twitter截图,官方发推,对MiniMax表示祝贺。

Code Arena是匿名对战机制,相对来说比较难以刷分和作弊。

AA榜单Agentic Index上,MiniMax M2.7排名超过Gemini 3.1 Pro

AA(Artificial Analysis) 是目前公开评测中可信度最高的之一。

AA的核心优势是:统一脚手架、自己跑、不靠人类投票、不接受厂商自提交。不完美,但已经是我们能找到的最干净的第三方数据了。 AA说MiniMax M2.7的Agentic能力超过Gemini 3.1 Pro,那可信度是相当高的。

一些遗憾

再说几个M2.7几个遗憾

速度偏慢

Artificial Analysis 实测 M2.7 的输出速度约 50 tokens/s,同价位模型中位数是 105 t/s;首 token 延迟 3 秒,中位数是 1.84 秒。

而我用小龙虾测试了,即便用了MiniMax-M2.7-highspeed高速版本,也达不到 100t/s。实际更接近70 tokens/s

仍然没有多模态,不支持识别图片

这一点太遗憾了。M2.7仍然不支持图片输入,只能处理文本,不是多模态模型。

希望MiniMax未来的版本尽快能够解决。

在小龙虾里偶尔忘事,要多交代几句

如果你仔细看了我前面小龙虾任务的截图,你会发现我其实催了几次。

虽然最后任务都完成了。

|

|

给人的感觉是,模型在复杂 Skill 组合场景下第一轮需要"热身",第二轮才能进入状态。

对于刚才演示的“腾讯财报分析”任务,明明第一次已经做好了全部,但是并没有直接把文件发给我,我再问了一次才发给我

我不太确定这是OpenClaw的问题,还是M2.7的问题,但是我之前用Claude Opus 4.6和GPT-5.4,似乎并没有出现过这种情况。

最后

总结一下我的判断:M2.7 不是来替代 Opus 4.6 的,至少现在还不是。

但M2.7做到了一件事:让我第一次愿意尝试把一个国产模型长期挂在小龙虾里跑任务。 不是出于支持国产的情怀,是因为它在 Agent 场景下确实能干活,而且价格只有 Opus 的零头。

它还有不少毛病——不能看图、偶尔发呆。但Agent的方向是对的,进步的速度也是吓人的。 M2.5 到 M2.7 只隔了两个月,Agentic 能力已经追到 Gemini 3.1 Pro 的水平。如果再来两个月呢?

如果你也在用小龙虾,花半小时把模型切成 M2.7试试看吧。希望看到你的反馈~

谢谢。