做过 RAG(检索增强生成)开发的同学,大概率都经历过这种痛苦:为了处理一份几百页的专业文档,你需要不断地调整切片大小、重叠度,还要折腾各种向量数据库和嵌入模型。可即便如此,AI 依然会给出驴唇不对马嘴的回答,或者在关键信息上“胡说八道”。

究其原因,是因为传统的向量检索本质上是寻找“语义相似度”。但在处理法律条文、金融报告或技术手册时,相似并不等同于相关。真正的精准检索需要的是逻辑推理,而不仅仅是空间距离。

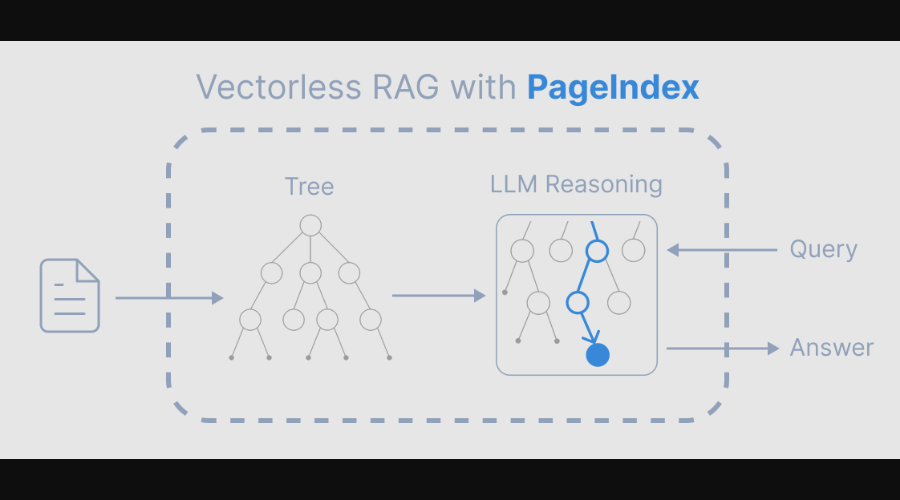

最近,一个名为 PageIndex 的开源项目引起了广泛关注。它另辟蹊径,抛弃了传统的向量数据库和暴力切片,提出了一种名为“无向量推理型 RAG”的新架构。

为什么说相似性不等于相关性

在处理专业长文档时,我们人类专家是怎么做的?我们不会把文档拆成几千个碎片然后背下来,而是先看目录,理解文档的层级结构,然后根据问题逻辑,定位到对应的章节,最后再深入阅读。

PageIndex 的灵感正是源于此。它认为,现有的向量检索其实是一种“氛围检索”,靠感觉在猜答案。而 PageIndex 则通过模仿人类专家的行为,将 RAG 流程分为两步:

- 1. 生成树状索引:将长文档转化为类似于“目录”的语义化树形结构。

- 2. 树搜索推理:利用大语言模型的推理能力,在索引树上进行路径搜索。

这种方法让 LLM 能够像人类一样“思考”并找到最相关的文档片段。

PageIndex 的核心杀手锏

与市面上主流的 RAG 方案相比,PageIndex 具有几个非常显著的特点:

- 1. 无需向量数据库:你不需要配置复杂的向量库,也不需要管理各种向量索引。

- 2. 告别暴力切片:文档不再被硬生生地切成固定长度的 Chunk,而是保留了自然的章节结构。

- 3. 极强的可解释性:检索过程是基于推理的,AI 会明确告诉你它在哪一页、哪一章找到了依据,告别“黑盒”检索。

- 4. 金融级准确率:在 FinanceBench(金融问答基准测试)中,基于 PageIndex 的系统达到了 98.7% 的准确率,远超传统的向量 RAG。

实测:它能解决什么问题

对于动辄几百页的 SEC 申报文件、审计报告或者学术教材,普通 LLM 的上下文窗口往往不够用,或者即便够用,也会因为信息过多导致“中间丢失”现象。

PageIndex 通过构建层级树,将长文档转化为模型易于理解的语义地图。即使文档内容极其复杂,它也能通过多轮推理,精准定位到具体的财务数据或法律条款。

此外,它还支持“基于愿景的 RAG”(Vision-based RAG)。这意味着你可以跳过繁琐的 OCR 过程,直接让模型通过页面图像进行逻辑分析,这对于包含大量表格和图表的 PDF 来说简直是救星。

如何快速上手

PageIndex 提供了多种使用方式,非常灵活。如果你是开发者,可以直接克隆 GitHub 仓库进行本地部署。

基本的安装步骤非常简单:

pip3 install --upgrade -r requirements.txt

配置好 API 密钥后,只需一行命令即可为你的 PDF 生成树状索引:

python3 run_pageindex.py --pdf_path /你的文档路径.pdf

生成的索引结构清晰,包含了标题、摘要、起始页码等信息,方便 LLM 快速检索。如果你不想写代码,官方也提供了一个类似 ChatGPT 的聊天平台,以及 MCP(Model Context Protocol)插件,可以无缝集成到 Claude 或 Cursor 中。

RAG 的未来是推理

从早期的简单向量检索,到后来的重排序(Rerank),再到现在的 PageIndex 推理型架构,RAG 正在从“找得像”向“懂得多”进化。

对于需要高度严谨性的企业级应用来说,PageIndex 这种可追溯、高准确度的方案或许才是未来的主流方向。

如果你也对目前的 RAG 效果感到不满,不妨试试这个项目,看看“无向量”方案是否能给你带来惊喜。