今天阿里千问发布了个新东西,叫 Qwen-Image-2.0。

说实话,我本来对这类新闻已经有点麻木了。毕竟现在各家大模型都在卷生图能力,今天你发个1.0,明天我发个2.0,看着都审美疲劳。

但这次,真的有点不一样。

先说结论

Qwen-Image-2.0 的核心卖点就三个:

- 支持 1K 长文本指令

——这是最炸的 - 中文文字生成能力很强

——这是最实用的 - 同时支持生图和图片编辑

——这是最完整的

这三个点组合在一起,基本上把国产生图模型的短板都补齐了。

1K 长文本是什么概念?

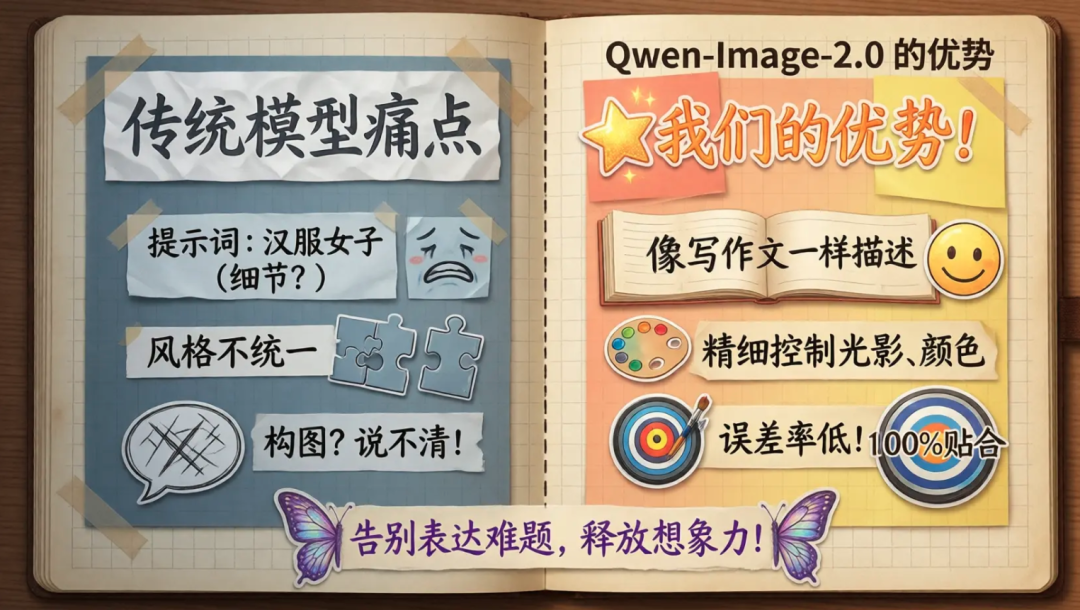

之前用 Midjourney 或者 DALL-E 3,最大的痛点是什么?

你没法把话说清楚。

你想生成一张复杂的图,需要描述人物、场景、光影、构图、风格……但提示词长度有限制,要么删减细节,要么分多次生成再拼。

Qwen-Image-2.0 直接把限制干到了 1K 字符。

这意味着什么?意味着你可以像写小作文一样写提示词。

比如你想生成一张古风场景,以前可能只能写:

"一位穿着汉服的女子在庭院中,樱花飘落,水墨画风格"

现在你可以写:

"一位身着浅粉色齐胸襦裙的女子,站在江南园林的月洞门前,身后的白墙黛瓦映衬着几株盛开的红梅。她微微侧首,长发用一支玉簪挽起,几缕发丝随风飘动。庭院里,一池春水泛起涟漪,几条锦鲤游弋其中。天空飘着细密的樱花,花瓣落在她的肩头、发梢。整体采用宋代院体画的风格,线条细腻,色彩淡雅,留白恰到好处,营造出一种静谧悠远的东方美学意境"

这完全不是一个量级的表达。

中文生图,终于不拧巴了

这是我最想夸的点。

之前用国外的生图模型,最大的问题就是——中文理解不到位。

你写"水墨画风格",它给你整成水彩;你写"留白",它给你整成空白;你写"意境",它根本不知道你在说什么。

原因很简单:这些模型都是用英文数据训练的,中文只是个"翻译层"。

但 Qwen-Image-2.0 不一样,它是原生中文训练的。

你用中文描述,它用中文理解,不需要经过英文这道"翻译关"。

实测了一下,效果确实惊艳:

-

"写意山水"能生成真正的写意风格,而不是工笔 -

"留白"能理解成构图技巧,而不是把图留白 -

"意境"能体现在整体氛围上,而不是某个具体元素

这就是母语优势,谁用谁知道。

生图+编辑,一个工具搞定

Qwen-Image-2.0 还有个很实用的功能:同时支持生图和编辑。

之前的工作流是这样的:

-

用 A 模型生成图 -

用 B 工具裁剪 -

用 C 工具调色 -

用 D 工具加文字

现在一个工具全搞定。

你可以:

-

先生成一张图 -

然后让 AI 帮你调整构图 -

再修改某个细节 -

最后加上文字

全程自然语言交互,不需要学什么复杂工具。

这对普通人来说,太友好了。

现在就能用

最关键的是,Qwen-Image-2.0 现在就能用。

打开 chat.qwen.ai,直接就能体验。

不用等,不用排队,不用申请内测。

当然,目前还没开源,官方说年后会发布开源权重。

实测效果

我亲自测了几张图,说实话,有点超出预期。

人物面部细节到位,不会出现之前那种"五官移位"的问题;

光影处理自然,不会出现奇怪的阴影;

文字生成准确,这是最让我惊喜的。

尤其是文字生成,之前用其他模型,生成的中文要么是乱码,要么字体奇怪,要么位置不对。

Qwen-Image-2.0 的文字生成,基本上做到了"所见即所得"。

这意味着什么?

从技术角度看,Qwen-Image-2.0 的发布,标志着国产生图模型在三个维度上实现了突破:

- 指令理解能力

——从简单提示词到复杂长文本 - 中文原生能力

——从翻译理解到母语理解 - 工具整合能力

——从单一功能到全流程覆盖

这三个突破,让国产生图模型第一次有了真正能打的产品。

从应用角度看,这意味着:

-

设计师可以用自然语言描述需求,而不是学复杂的工具 -

内容创作者可以快速生成配图,而不是找素材或者等设计师 -

普通用户可以用 AI 表达创意,而不是被技术门槛劝退

一点思考

写到这里,我想说点题外话。

之前大家都在说,AI 生图领域,国外领先,国产追赶。

但 Qwen-Image-2.0和最近Seedance 2.0 的发布,让我看到了一个不一样的路径:

不是简单模仿,而是基于本土需求做创新。

中文生图这个场景,国外模型确实做得好,但中文理解始终是短板。

与其在英文赛道上追赶,不如在中文赛道上做到极致。

Qwen-Image-2.0 就是一个很好的例子。

它可能不是全球最先进的生图模型,但它是最适合中文用户的生图模型。

这就够了。

最后

如果你对 AI 生图感兴趣,建议现在就去试试 Qwen-Image-2.0。

不用等开源,不用等评测,自己上手体验一下。

毕竟,好不好用,试过才知道。