1. 数据采集与清洗

-

数据源对接

-

工单系统:通过API直接拉取Jira/ServiceNow历史工单(字段包括标题、描述、解决方案、时间戳)

-

知识库:爬取Confluence运维手册(需处理Markdown/表格/流程图),提取章节

故障处理、应急预案 -

Postmortem报告:解析PDF/Word文档,提取

Root Cause、Action Items段落 -

去重策略:SimHash算法(相似度>90%的条目合并)

-

脱敏处理:正则表达式匹配IP/域名/账号(替换为

<IP>/<DOMAIN>/<USER>占位符)

2. 标注系统设计

-

标注工具:Label Studio + 定制化NER模板

# 标注规则示例entities: - Service: "^[A-Z]{3}-\d{3}$" # 匹配服务编码(如SRE-001) - ErrorType: ["超时", "资源泄露", "配置错误", "依赖故障"] # 预定义故障词典 - Severity: {"P0": "全网中断", "P1": "核心功能受损"} # 层级定义

-

标注流程

-

预标注:用flairNLP预训练模型自动标注(准确率约70%)

-

人工修正:3人交叉校验(标注一致性需Kappa系数>0.85)

-

冲突仲裁:领域专家每周复核争议样本

3. 数据格式转换

-

输出为标准JSONL格式(每条包含原始文本、实体span、标签)

{ "text": "<DOMAIN>服务出现P0级故障,原因为数据库连接池耗尽", "entities": [ {"start":1, "end":8, "label":"Service"}, {"start":12, "end":14, "label":"Severity"}, {"start":22, "end":30, "label":"ErrorType"} ]}

1. 环境配置

-

硬件要求:NVIDIA A100 40GB * 2(FSDP分布式训练)

-

依赖库:

pip install deepseek-llm>=0.3.2 pip install wandb # 训练过程可视化

2. 训练脚本优化

# 启动命令(实际需用SLURM调度)deepspeed --num_gpus 2 finetune.py --model_name "deepseek-7b" --dataset "ops_dataset_v1.jsonl" --lora_rank 64 --per_device_train_batch_size 4 --gradient_accumulation_steps 8 --learning_rate 2e-5 --warmup_ratio 0.1 --num_train_epochs 5 --logging_steps 50 --eval_steps 500 --deepspeed configs/ds_config_zero3.json # 启用ZeRO-3优化

3. 关键参数说明

-

LoRA配置:仅对q_proj/v_proj层适配(减少显存30%)

-

梯度检查点:启用

gradient_checkpointing支持更长上下文(2048 tokens) -

损失函数:实体识别采用CRF层 + Focal Loss(解决类别不均衡)

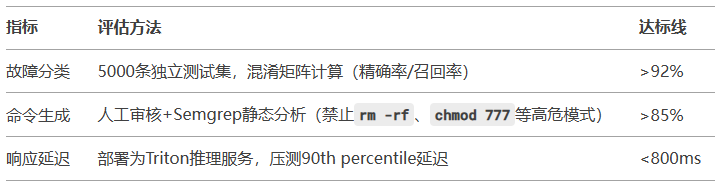

三、验证

1. 评估体系

2. 安全兜底方案

-

命令执行沙箱:所有生成的运维命令先进入隔离环境验证

class Sandbox: def execute(cmd): if regex.match(r"kill|rm|chmod", cmd): # 高危命令拦截 raise SecurityError return docker.run("sandbox_image", cmd) # 容器化执行

-

人工审核通道:P0级故障的处置建议必须经SRE确认

四、风险控制

-

数据泄露风险

-

存储加密:语料库存放于MinIO服务(开启SSL + AES-256加密)

-

访问控制:基于OpenPolicyAgent的RBAC策略(仅允许标注组访问)

-

模型幻觉风险

-

后处理规则:对未在知识库中出现的新服务名(如

SRE-999)强制拦截 -

置信度过滤:Softmax概率<0.7的输出标记为

低可信度建议 -

训练中断风险

-

断点续训:每2小时保存一次checkpoint到NFS共享存储

-

健康检查:GPU温度>85℃时自动暂停任务并告警