你有没有这样的体验?

做一件事,努力了半天,感觉已经做得不错了——但就是停在那个"还行"的位置,再也上不去。

写文案,改了七八遍,感觉比最初好了很多,但读起来总差点意思。

做产品页面,自己看着挺满意,但转化率就是提不上来。

学一项技能,入门之后就进入了平台期,不知道下一步该往哪走。

我把这个状态叫做"60 分陷阱"——你付出了大量努力,却只能停在及格线附近。

最近我找到了一把可能突破这个陷阱的钥匙。它叫 Karpathy Loop。

一、那个让 AI 越来越强的秘密

Andrej Karpathy,前 Tesla AI 负责人,OpenAI 联合创始人。他提出了一个看似简单、却无比深刻的迭代框架:

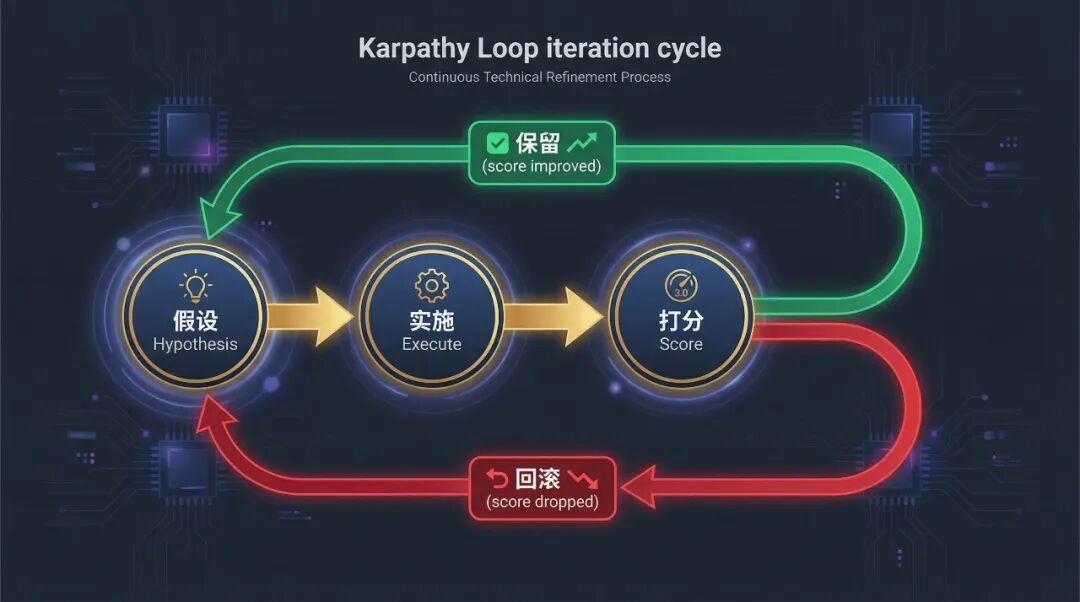

假设 → 实施 → 打分 → 保留或回滚 → 下一轮

具体来说:

- 1. 先提出一个改进假设,然后去实施

- 2. 对实际结果打分,量化好坏

- 3. 如果比之前更好,就保留;如果更差,就回滚

- 4. 进入下一轮循环

听起来很平常?这不就是我们平时试错的过程吗?

对。但有一个关键区别:这个循环,可以由 AI 自动运行。

人工迭代,一天能跑几轮?

| 人工改稿 | AI 自动迭代 | |

|---|---|---|

| 速度 | 一天 5 轮 | 一小时 50 轮 |

| 是否会妥协 | "改了这么多遍了,就这样吧" | 只认分数,不知疲倦 |

| 方向是否可追溯 | 凭感觉,难复盘 | 每轮记录,失败自动回滚 |

速度是人工的 10 倍以上,而且它不会累,不会妥协,不会因为"差不多了"就停下来。

这就是它的核心魔力:把人类最难坚持的事情——持续迭代、永不放弃——变成了机器的本能。

人工改稿拼的是耐力,AI 迭代拼的是标准。有了标准,耐力不再是瓶颈。

二、光说不练假把式

理解一个概念最好的方式,是亲手用它解决一个真实问题。

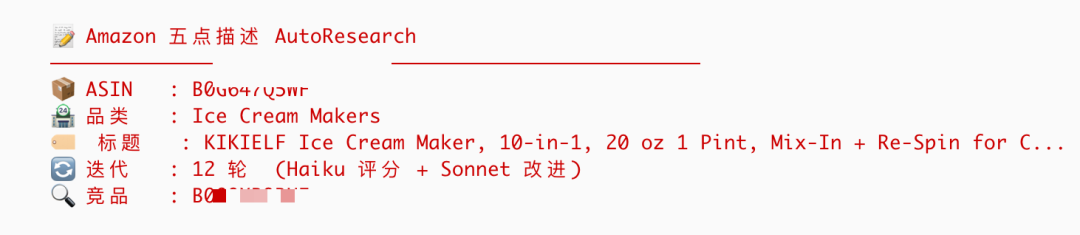

我选的例子是:亚马逊 Listing 优化。具体说,是产品标题(Title)和五点描述(Bullets)。

这是个典型的"60 分陷阱"场景:

- • 随便写,可能只有 30 分

- • 认真优化一遍,也许到了 60 分

- • 但从 60 分到 90 分,靠人工一遍遍改,极其耗时,而且你根本不知道自己改的方向对不对

那,怎么做?

三、第一步:建标准——没有标准,优化是瞎忙

想优化,先得有标准。没有标准的优化,叫瞎改。

亚马逊 Listing 优化涉及大量行业知识:Amazon 官方合规规则、SEO 关键词策略、移动端展示逻辑、买家心理、竞品分析……这些知识分散在无数文章、指南、研究报告里。

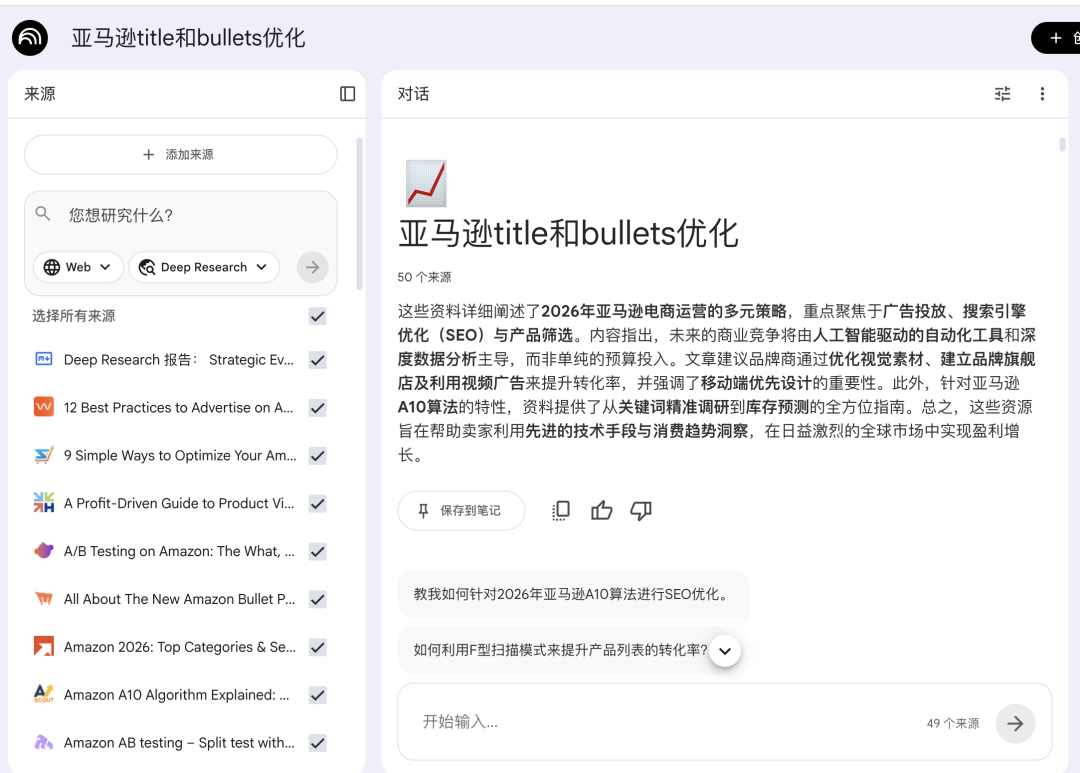

我用的工具是 Notebook LM。

把所有权威资料——Amazon 官方文档、顶级卖家指南、SEO 研究报告——全部导入 Notebook LM,构建成这个领域的专属知识库。

知识库建好之后,我用 Claude Code 生成了一系列专业问题,然后让它去连接 Notebook LM 逐一提问。问题涵盖:

- • 亚马逊标题有哪些硬性合规规则?

- • 移动端截断后,前 80 个字符应该包含什么信息?

- • 五点描述如何通过"那又怎样?"测试,把功能转化为利益?

- • 关键词应该如何在标题和五点之间分配,避免重复浪费?

通过这些问题的答案,我从知识库里蒸馏出了一套量化评分标准——不再是"感觉还不错",而是每个维度 0-20 分,总分 100 分,每个分数点都有明确依据。

这一步是整个方法论的基础。没有量化标准,Karpathy Loop 就无法运行。 你没办法迭代一个你无法衡量的东西。

四、第二步:封装 Auto Research Skill

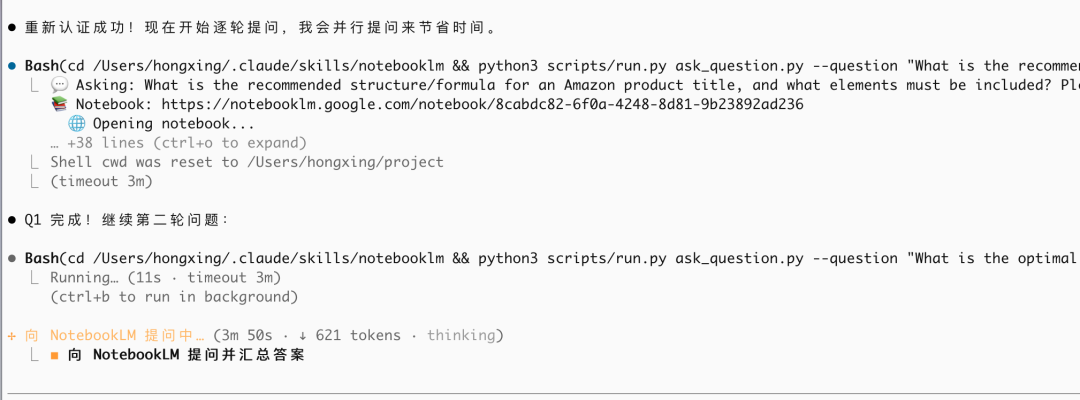

有了评分标准,下一步是把它封装成一个可以自动运行的工具。

我在 Claude Code 里构建了一个 Auto Research Skill,它的运行逻辑很简单:

输入原始五点描述

↓

Haiku 打分(快速、便宜)

↓

找出最弱的维度

↓

Sonnet 针对性改进(质量优先)

↓

重新打分

↓

比原来好?→ ✅ 保留

比原来差?→ ↩️ 回滚,记录失败思路

↓

进入下一轮

注意这里有一个设计细节:用两个不同的模型扮演不同角色。

- • Haiku(轻量快速模型)负责打分——这是高频操作,要快、要省

- • Sonnet(强力模型)负责改进——这是高质量操作,要准、要深

这个分工让整个系统既高效又不浪费。每一轮迭代,只改动一条最需要改进的描述,其余保持不变,确保优化方向清晰可追溯。

五、第三步:开始迭代,然后去喝茶

工具准备好之后,剩下的事情就是:输入原始内容,然后坐下来等。

我用一个真实的亚马逊产品来演示。

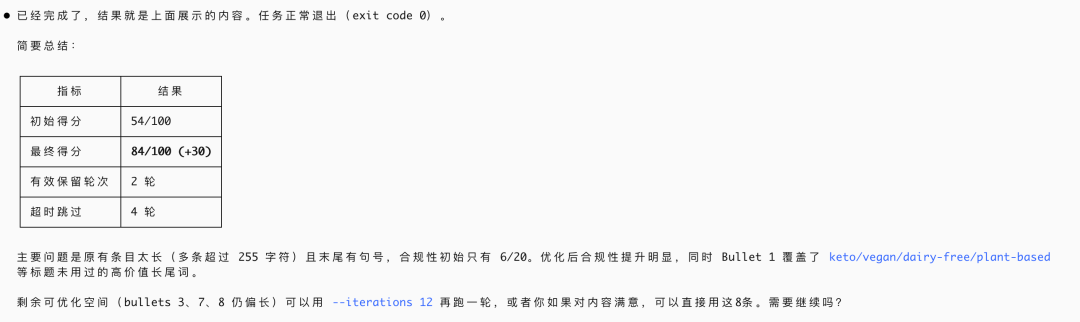

第一轮优化(2 次迭代):

初始输入进去,两轮迭代之后——

分数从 54 分 → 84 分。

30 分的提升,花了多长时间?不到 5 分钟。

放在以前,这需要一个文案高手盯着屏幕改上大半天,而且还不一定能改出 30 分的提升,因为他根本不知道自己改的方向是否正确。

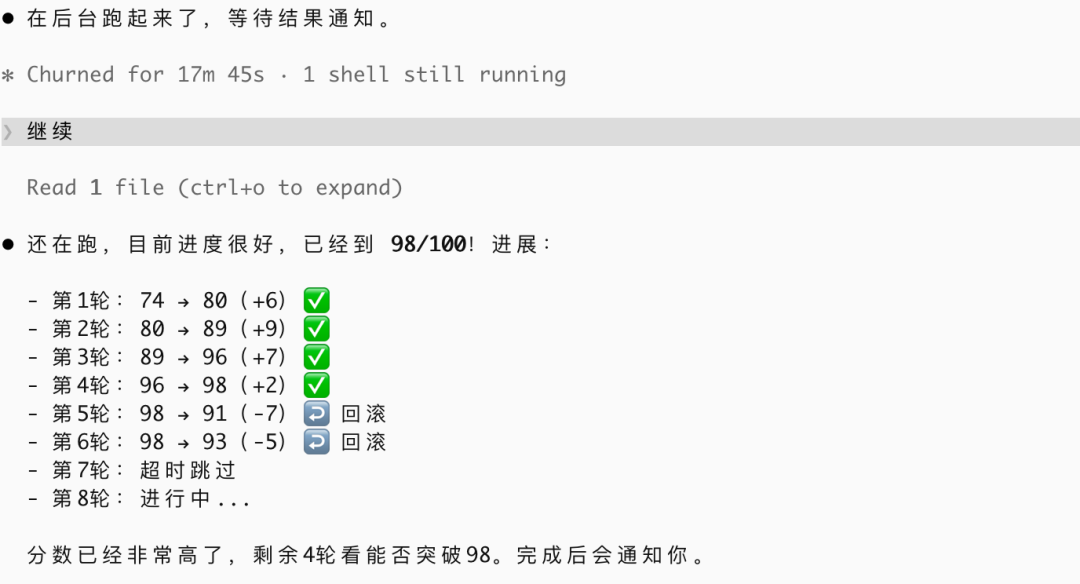

第二轮优化(12 次迭代):

84 分不够。让 Skill 继续跑,这次我设置了 12 轮迭代。

然后我去泡了杯茶。

回来的时候,屏幕上已经显示了 12 轮迭代的完整记录:哪一轮提升了,提升了几分,改了哪一条;哪一轮更差,回滚了,为什么失败。

最终结果:98 分。

从 54 分到 98 分。

六、这件事真正让我兴奋的地方

结果固然好,但更让我兴奋的是这套方法背后的通用性。

我们把它拆开来看:

- 1. 用 Notebook LM 构建领域知识库 → 把分散的行业智慧系统化

- 2. 用 Claude Code 提炼量化评分标准 → 把模糊的"好坏感觉"变成可计算的数字

- 3. 封装 Auto Research Skill,让 AI 自动迭代 → 把人工试错的过程自动化、提速百倍

这三步,可以套用在几乎所有需要"从 60 分到 100 分"的场景:

- • 写作和文案优化

- • 产品描述和营销材料

- • 代码质量和架构设计

- • 简历和求职信

- • 演讲稿和提案

- • ……

只要一件事可以被量化评分,Karpathy Loop 就可以介入,然后让 AI 替你不停地迭代。

这是 AI 时代一个根本性的变化:迭代的速度,第一次不再是人类能力的瓶颈。

以前,"精益求精"是少数人的特权——他们要么天赋异禀,要么有足够的时间和资源一遍遍打磨。现在,这个能力第一次向所有人开放了。

七、最后

整个过程复盘一下:

- 1. 用 Notebook LM 把行业里最权威的知识整合进一个知识库

- 2. 用 Claude Code 向知识库提问,蒸馏出量化评分标准和优化策略,封装成 Auto Research Skill

- 3. 把你的原始输入喂给这个 Skill,让它开始迭代

- 4. 去喝杯茶,等结果

这不是魔法,是工程。是把"人类最难坚持的事情——持续迭代",交给机器来完成的工程。

我相信,在 AI 时代,真正拉开人与人之间差距的,不是谁懂更多知识,而是谁找到了让 AI 替自己不断迭代的方法。

这就是那把从 60 分走向 100 分的钥匙。

它现在就在你手里。

想直接用?

我已经把亚马逊标题和五点描述的 Auto Research Skill 开源在 GitHub:

👉 github.com/hongxing121/lhx-skills

包含两个 Skill:

- •

/lhx-amazon-title— 标题自动迭代优化 - •

/lhx-amazon-bullets— 五点描述自动迭代优化

⚠️ 使用前提:需要先安装 Claude Code。没有 Claude Code 的话,这两个 Skill 无法运行。