在人工智能技术飞速发展的今天,搭建一个本地化知识库问答系统已成为企业和个人高效管理信息的利器。MaxKB 作为一款基于大语言模型和 RAG 的开源知识库问答系统,支持对接多种大模型,包括本地私有大模型(DeepSeek R1 / Llama 3 / Qwen 2 等)、国内公共大模型(通义千问 / 腾讯混元 / 字节豆包 / 百度千帆 / 智谱 AI / Kimi 等)和国外公共大模型(OpenAI / Claude / Gemini 等),无需编程基础即可快速部署。

在Windows系统本地部署DeepSeek详细教程中介绍了如何在自己的电脑上本地部署 `DeepSeek-R1-8B` 模型,本文将简单介绍如何安装和使用MaxKB,基于DeepSeek模型轻松构建自己的智能知识库!

01

安装准备

1.1

-

操作系统:Linux(推荐Ubuntu/CentOS)或Windows,本文使用的操作系统为Windows11

-

硬件:至少4GB内存,20GB硬盘空间(若使用大模型需更高配置),本文基于本地部署的 DeepSeek-R1-8B 模型,具体配置要求可参考Windows系统本地部署DeepSeek详细教程

1.2

安装Docker

MaxKB推荐使用Docker部署,Docker安装方法可参考:容器技术介绍:Docker简介及安装。

02

安装步骤

2.1

拉取MaxKB镜像

命令行窗口执行如下命令拉取maxkb:

$ docker pull 1panel/maxkb$ docker imagesREPOSITORY TAG IMAGE ID CREATED SIZE1panel/maxkb latest c239d64826e8 3 weeks ago 3.66GB

2.2

启动容器

执行如下命令启动:

$ docker run -d --name=maxkb --restart=always -p 8086:8080 -v D:/devWorkspace/AI_tools/maxkb/data:/var/lib/postgresql/data -v D:/devWorkspace/AI_tools/maxkb/python-packages:/opt/maxkb/app/sandbox/python-packages 1panel/maxkb

参数说明:

-

-d:容器后台运行 -

--name=maxkb: 指定为容器名称为maxkb。 -

--restart=always: 定义容器重启策略为“总是重启”。 -

-p 8086:8080: 端口映射,将宿主机的8086端口映射到容器的8080端口。 -

-v D:/.../data:/var/lib/postgresql/data: 挂载数据卷,将宿主机目录D:/devWorkspace/AI_tools/maxkb/data映射到容器内的 PostgreSQL 数据目录。 -

-v D:/.../python-packages:/opt/maxkb/app/sandbox/python-packages: 挂载自定义 Python 依赖包目录。

2.3

访问MaxKB

打开浏览器输入 http://localhost:8086,使用如下默认用户名密码登录:

# username: admin# pass: MaxKB@123..

03

使用MaxKB

3.1

模型设置

先配置用户环境变量 OLLAMA_HOST 变量,值为 0.0.0.0。

弹出框中选择ollama,然后按照如图界面填写。

3.2

创建应用

点击上面菜单的“应用”,点击“创建应用”。

然后进行设置

创建完成后,点击创建的应用,点击“演示”,就可以开始对话了

3.3

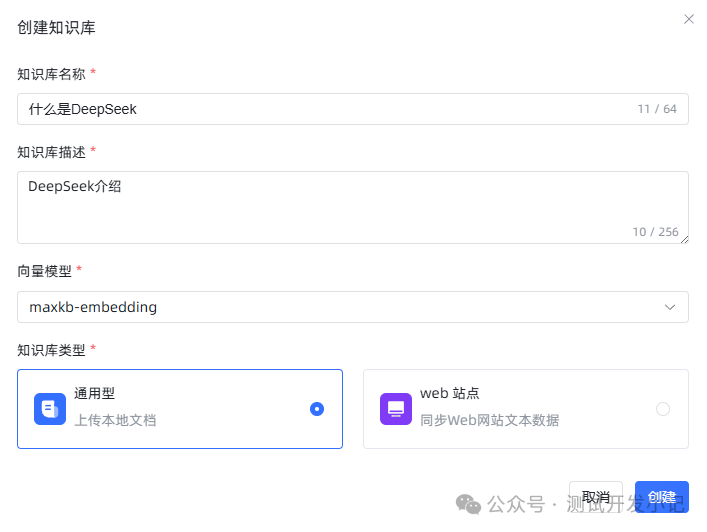

创建知识库

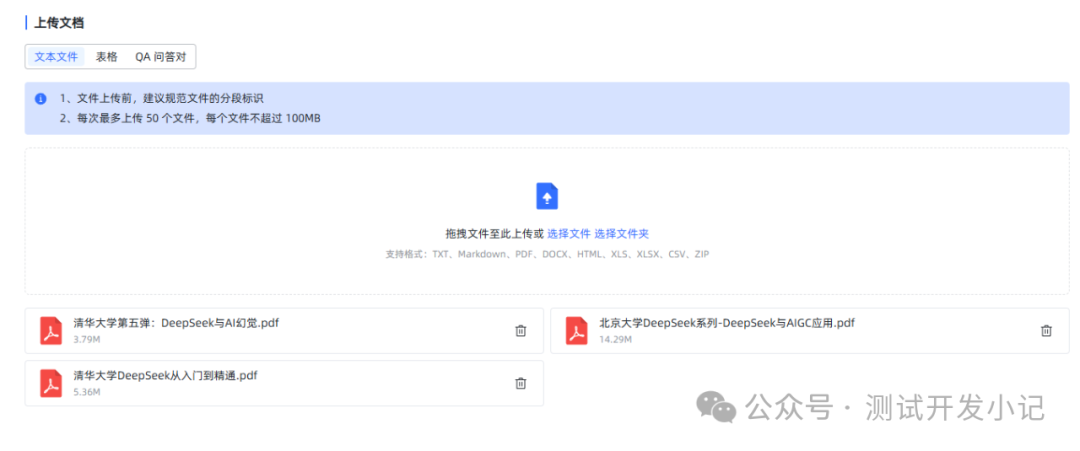

打开【知识库】页面,点击【创建知识库】,进入创建知识库页面。

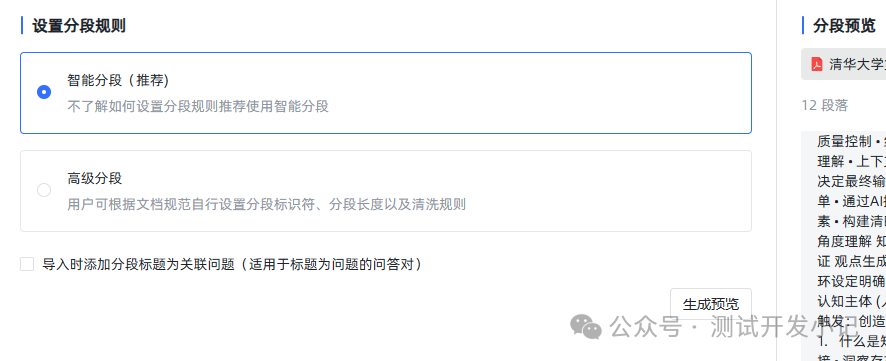

可设置分段规则:

知识库创建完成后,回到应用设置页面关联创建的知识库,关联完成后,使用AI对话时就会引用知识库,这样一个简单的个人知识库就创建完成了:

如果要创建其它知识库,再创建一个应用,然后关联知识库即可。