利用周末的时间,在自己的笔记本电脑上部署一个本地大模型,过程也记录下来分享给对此有兴趣的朋友们。

【步骤】

模型相关的基础概念这里不多赘述了,直接进入实战。

整个部署过程分为三个步骤:

步骤一:下载ollama大模型工具

步骤二:在ollama工具中,下载通义千问大模型

步骤三:下载AnythingLLM并配置选择ollama的通义千问模型,直接在窗口对话

※文末打包了本次部署的所有安装文件

【逐步骤讲解】

官网下载ollama

https://ollama.com/download

安装后启动ollama

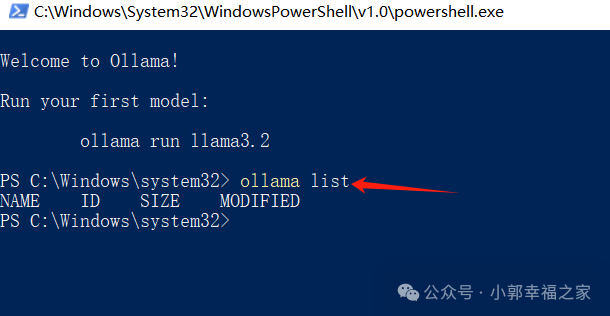

命令行窗口,敲入命令ollama list,此时显示没有任何大模型,开始去下载

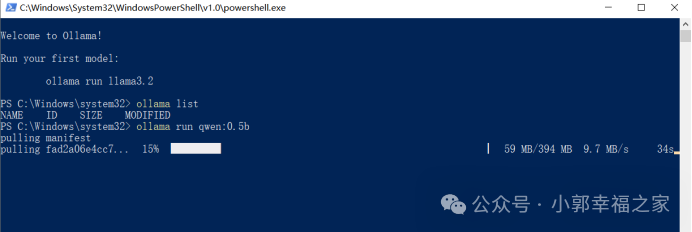

下载大模型,阿里千问 0.5b (5亿参数)

ollama run qwen:0.5b

特意一早爬起来 ,网速快得飞起。小400M不到一分钟下载完成。

,网速快得飞起。小400M不到一分钟下载完成。

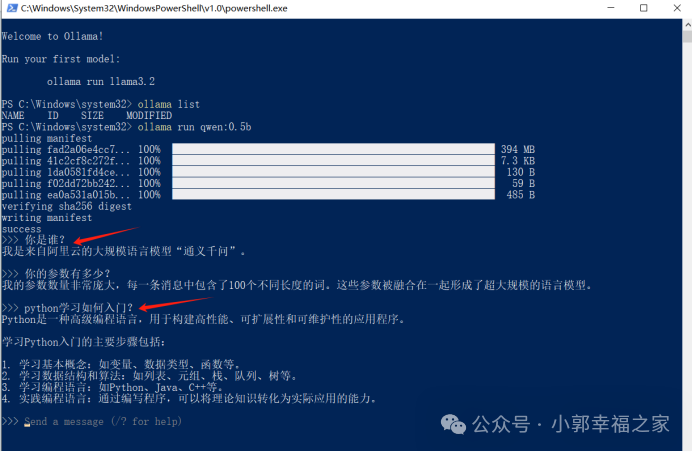

下载完成后,简单问一个小问题,看看反应如何?

0.5b是通义千问最小的一个模型,安装在普通笔记本上,反应速度还可以。返回的内容也还行,自己做练习搞点小研究足够了。

命令扩展:命令行窗口可以查看模型相关的信息

lollama list:显示模型列表。

lollama show:显示模型的信息

lollama pull:拉取模型

lollama push:推送模型

lollama cp:拷贝一个模型

lollama rm:删除一个模型

lollama run:运行一个模型

有条件的话,机器配置也能跟得上,可以下载更大的模型,如下表:

|

模型 |

参数 |

大小 |

下载 |

|

Llama 2 |

7B |

3.8GB |

ollama run llama2 |

|

Mistral |

7B |

4.1GB |

ollama run mistral |

|

Dolphin Phi |

2.7B |

1.6GB |

ollama run dolphin-phi |

|

Phi-2 |

2.7B |

1.7GB |

ollama run phi |

|

Neural Chat |

7B |

4.1GB |

ollama run neural-chat |

|

Starling |

7B |

4.1GB |

ollama run starling-lm |

|

Code Llama |

7B |

3.8GB |

ollama run codellama |

|

Llama 2 Uncensored |

7B |

3.8GB |

ollama run llama2-uncensored |

|

Llama 2 13B |

13B |

7.3GB |

ollama run llama2:13b |

|

Llama 2 70B |

70B |

39GB |

ollama run llama2:70b |

|

Orca Mini |

3B |

1.9GB |

ollama run orca-mini |

|

Vicuna |

7B |

3.8GB |

ollama run vicuna |

|

LLaVA |

7B |

4.5GB |

ollama run llava |

|

Gemma |

2B |

1.4GB |

ollama run gemma:2b |

|

Gemma |

7B |

4.8GB |

ollama run gemma:7b |

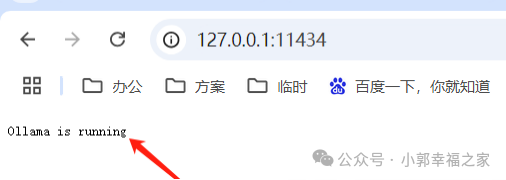

Ollama服务默认地址和端口是http://127.0.0.1:11434/

服务开启时,访问该地址会返回 Ollama is running

不过只能在命令行中玩耍还是不太方便,想个办法弄个网页版的,像chatgpt页面一样。

下载Anythingllm结合ollama使用。(这个文件有点大,干掉6个多G)

Anything下载地址https://anythingllm.com/desktop

安装后直接打开,创建新工作区

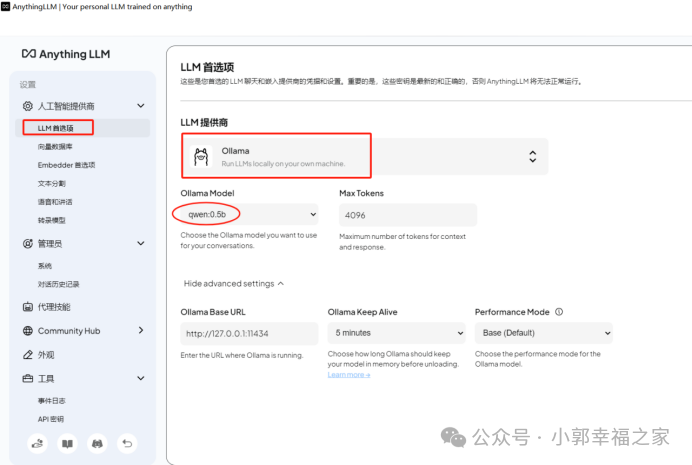

下面小扳手是设置,打开之后,

LLM提供商选择上面步骤安装的ollama,模型选择上面安装的qwen0.5b大模型。其他的默认不需修改

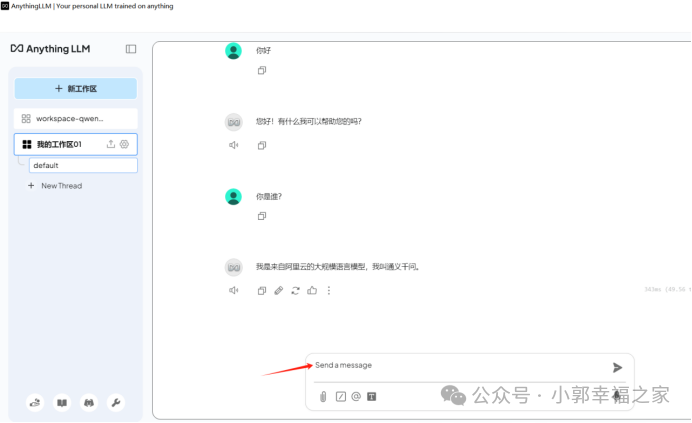

保存后,返回到我的工作区,聊天窗口可以愉快地体验自己部署的本地大模型啦。

到此为止,一个AnythingLLM+Ollama+qwen0.5b的本地大模型就部署好了。