导读 本文将分享如何基于 LLaMA Factory 实现大模型高效训练。

1. 大模型低资源训练技术总览

2. LLaMA Factory 整体介绍

3. LLaMA Factory 快速入门

4. LLaMA Factory 性能调优

5. LLaMA Factory 应用案例

6. Q&A

分享嘉宾|郑耀威 北京航空航天大学 研究员

编辑整理|王红雨

内容校对|李瑶

出品社区|DataFun

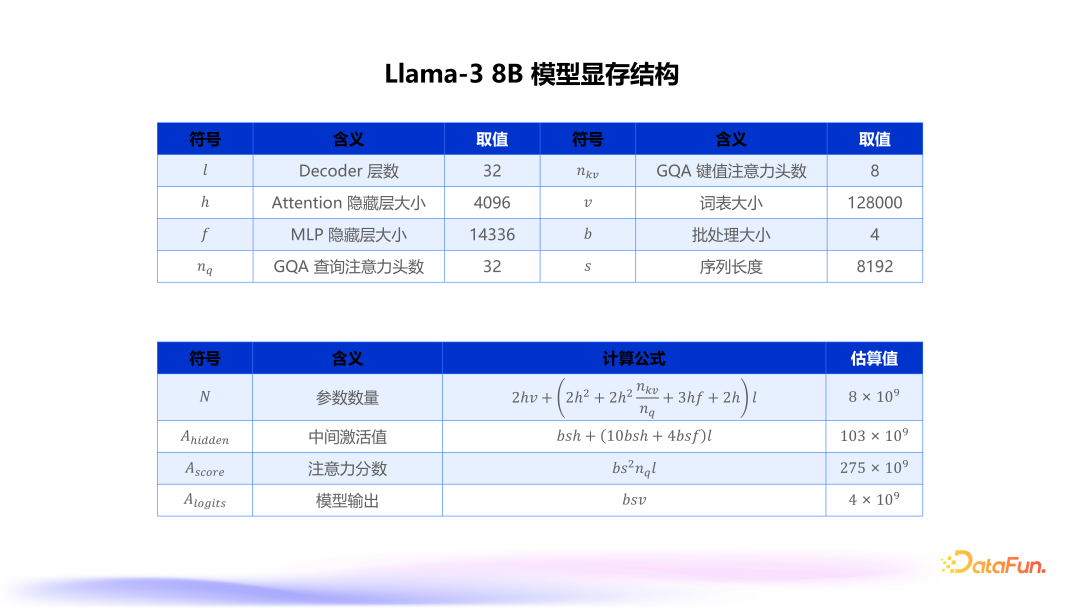

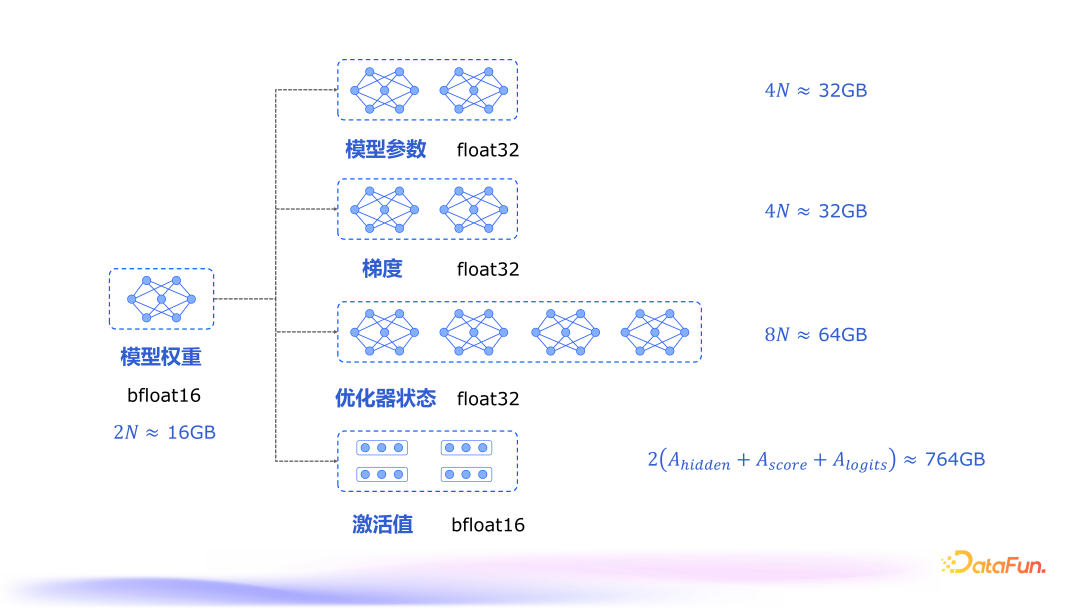

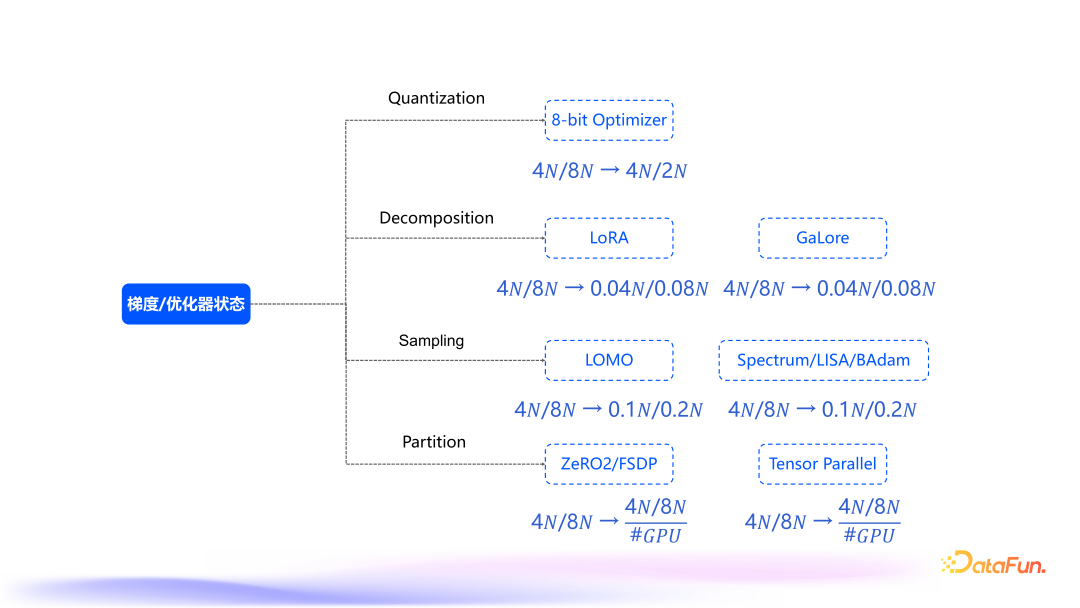

大模型低资源训练技术总览

-

量化:以更低的精度来表示模型参数。 -

分块:将显存占用分摊到多个 GPU 上,可以使用 ZeRO3 或 FSDP 策略,或采用张量并行的方式。 -

卸载:放到 CPU 上存储,用的时候再拿到 GPU,这样可以将 GPU 显存占用降到很小,但可能会影响训练速度。

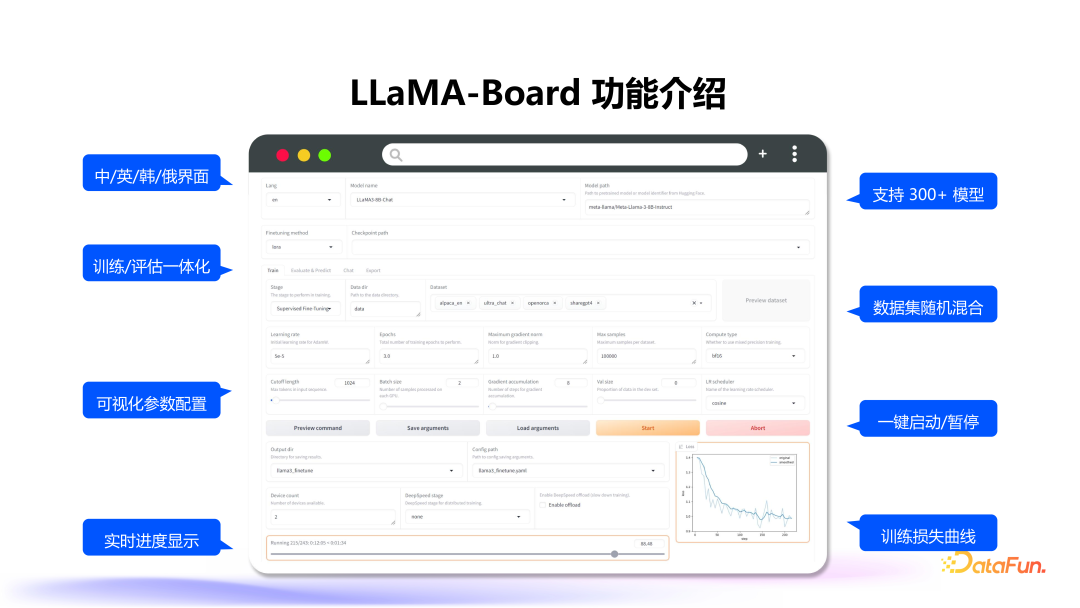

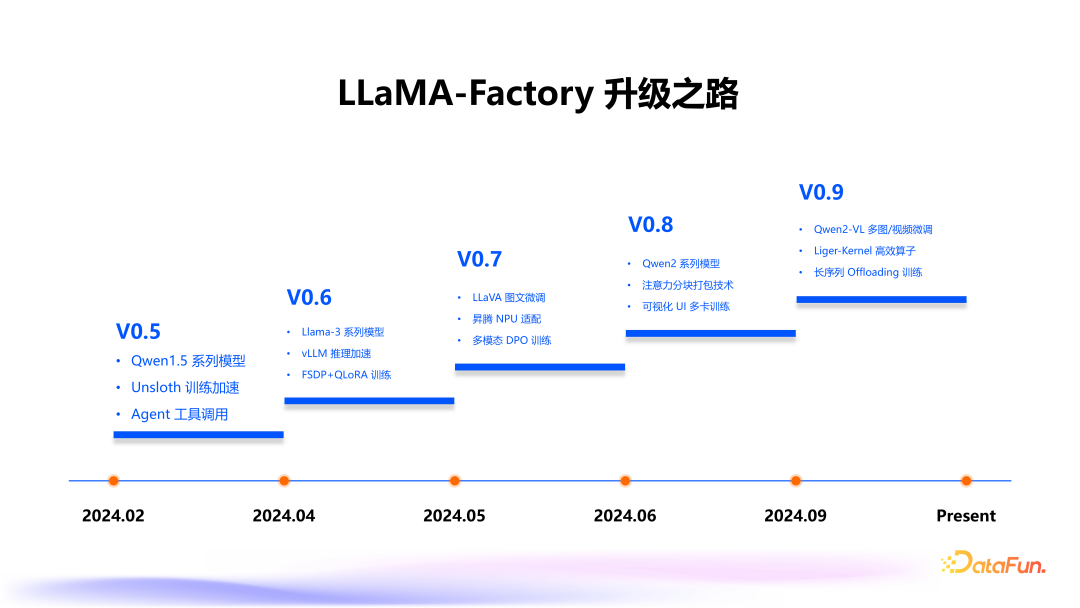

LLaMA-Factory 整体介绍

LLaMA-Factory 快速入门

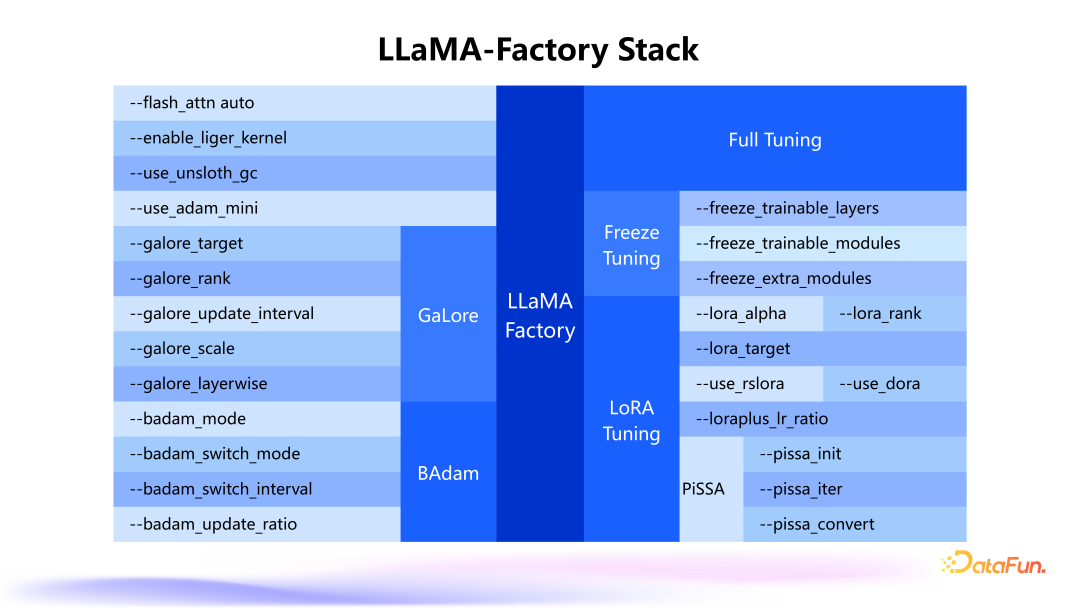

LLaMA-Factory 性能调优

LLaMA-Factory 应用案例

Q&A