-

该文档将以在线文档形式持续更新,点击文末“阅读原文”访问。 -

仅代表我们的视角(偏见),不代表市场整体观点和共识。 -

本系列文章假定读者是了解基本概念的业内人士,不对概念做科普。

一、典型应用场景

场景列表同样将在BISHENG在线文档(doc.bisheng.ai)持续更新,我们也非常乐意跟大家一起探讨和贡献各自的落地实践。

以下场景配图均使用Dreamina生成

对话助手

-

“对话助手-基于文档库”,即常说的RAG。 -

“对话助手-基于Function Call”,即对话过程中需要调用内外部系统获取信息。

报告生成

审核

知识管理/非结构化数据治理

数据分析

企业系统统一导航/交互

代码

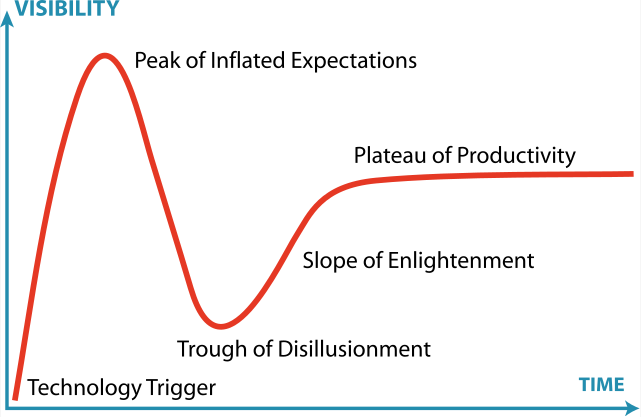

二、落地应用的困难与挑战

1.应用落地效果不及预期

2.缺乏高质量数据

3.基座模型选择困难

4.效果难以评估

三、我们尝试提出的解法与思路

建设思路

阶段1、探索与勇气

阶段2、建立认知

阶段3、寻找并扩大价值

阶段4、组织重塑

应用平台相关能力要求

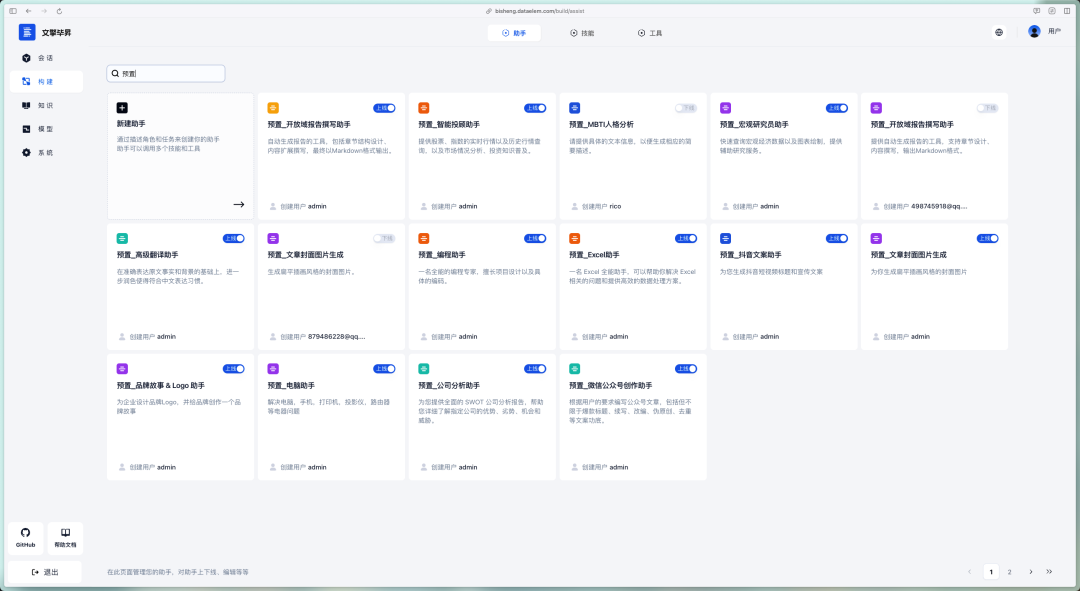

1.低门槛构建应用的能力

-

若想让企业内非技术人员/业务人员仅用几小时(甚至几分钟)就能完成应用开发,“低门槛”非常重要。OpenAI的GPTs 提供了这方面的最佳实践,仅需一段几十字的需求描述即可自动生成应用。[BISHENG Ready]

-

要实现这样的功能,核心依赖两方面能力:一方面是常说的大模型Function Call能力,包含了理解、推理、规划、外部工具调用与多轮交互能力;另一方面是足够丰富的外部工具接入,包含一些企业内部通用工具的预置以及对自定义工具接入能力的支持。[BISHENG Ready] -

当前效果最好的开源模型,如Command R plus(104B),基于我们内部的测试数据集,经过优化后,在Function Call 方面的能力,已经能达到GPT-4约90%的效果,未来可期。[BISHENG Ready]

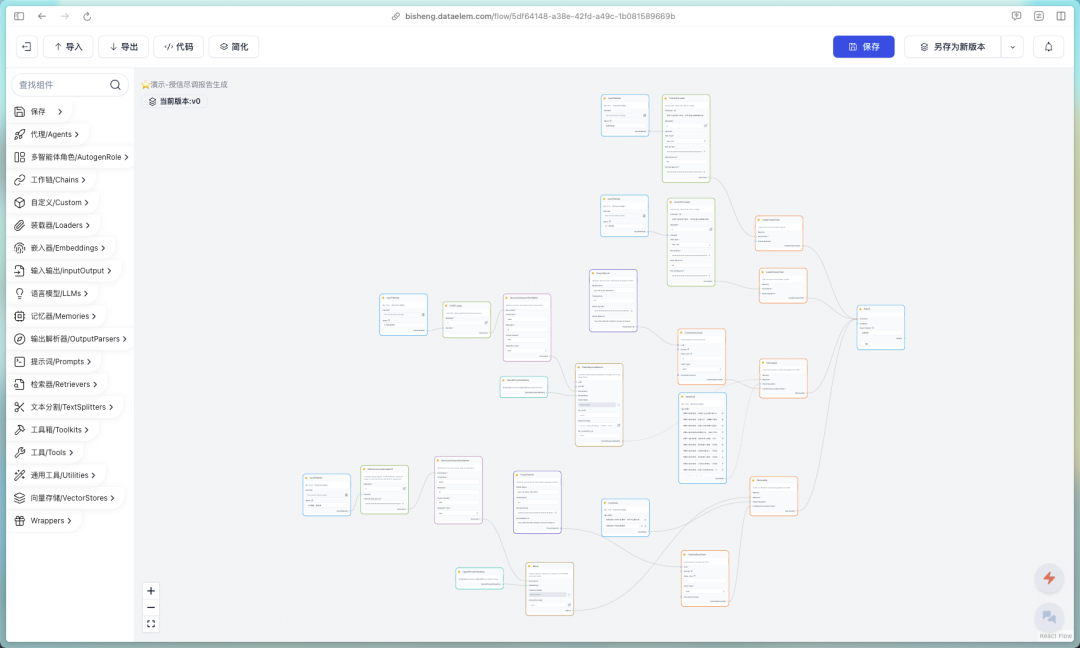

2.复杂业务逻辑表达与控制的能力

-

企业内应用场景的逻辑大部分是相对比较复杂的,除了面向非技术人员的低门槛构建能力,平台还需要具备复杂长流程编排的能力。[BISHENG Ready] -

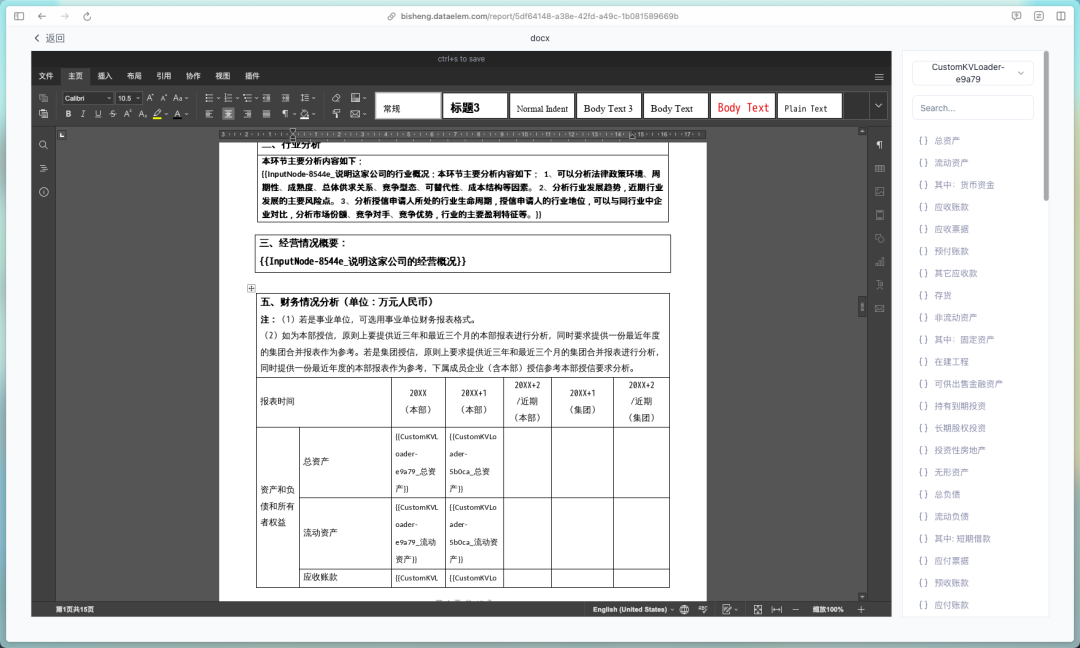

企业的应用形态与个人用户需求也存在差异,比如个人用户生成内容的场景多是“小红书文案生成”、“视频脚本生成”等短小的文案,而企业内则是“企业尽调报告生成”、“招标文件生成”等复杂长文档的生成,并且企业场景对于结果的可控程度要高很多,包括了版式与章节结构的可控、内容准确性的可控,这就要求平台需要有相关功能做支撑。[BISHENG Ready]

3.自定义能力

-

即使是同类场景,不同企业间也会存在差异,所以需要平台拥有足够强的开放性与灵活性,各层面参数都需要支持自定义设置。[BISHENG Ready] -

除了平台已有能力,企业应用开发的过程中经常需要纯定制化的特殊逻辑或内部专业系统能力的接入,系统应当支持低代码或全代码的定制。[BISHENG Ready]

4.多模型的接入能力

-

因为目前大模型能力的增长曲线仍然陡峭,所以最新发布的模型(特别是开源模型)在实验环境中应该能够尽快进行使用,平台需要支持一键切换或接入所有主流大模型(开源或闭源)[BISHENG Ready]

-

从模型选择思路角度,我们建议缩短决策路径,优先选择最好的开源模型进行场景验证。

5.便捷的开发调试

-

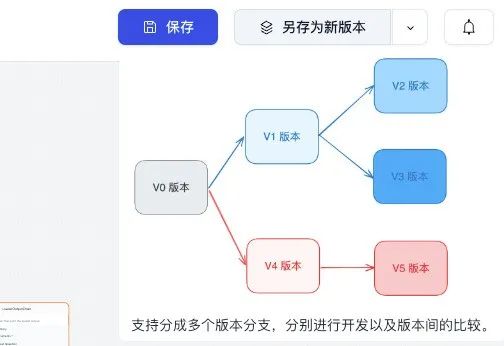

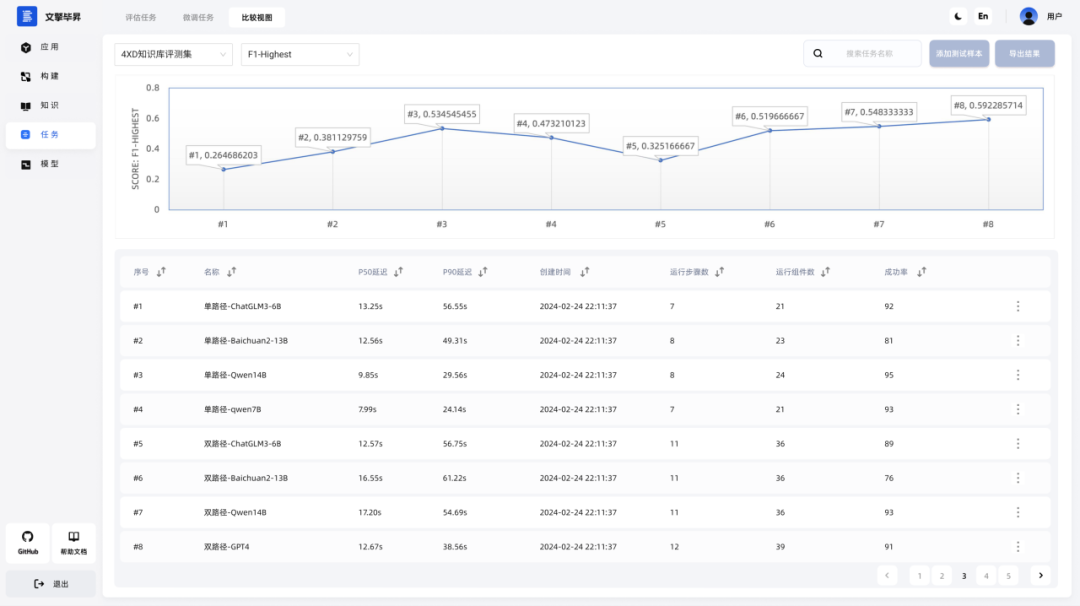

大模型应用的开发与传统软件开发最大的区别在于不确定性,相同的输入每次得到的输出是变化的,所以需要为大模型应用的开发过程提供便捷的调试对比能力。涉及的主要对比项包括但不限于:不同大模型、Prompt、知识库不同召回策略、知识库文档解析策略、Workflow的编排逻辑等。[BISHENG Ready]

-

在调试比对的基础上,支持对应用进行完善的版本管理,可选择或切换当前上线的版本。[BISHENG Ready]

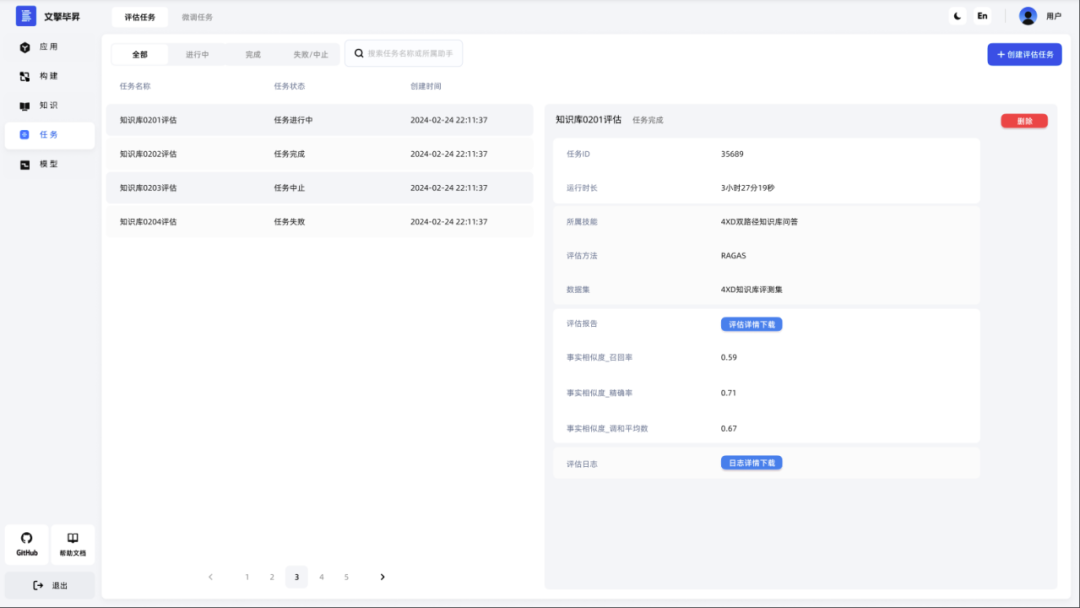

6.自动化效果评估

-

应用开发中的调试是比较轻量级的,一般只基于几个测试case;而应用开发完成后,需要更加完备科学的效果评估。这跟上一代AI系统的诉求是类似的,所以需要支持基于某个较大的数据集(几十或几百条case)进行自动化的端到端的效果评估。[BISHENG Planning]

-

与上一代AI系统不同的是,大模型解决的任务类型更广、输出的不确定性更高,抽象下来任务类型可以分为选择题(有精确答案)任务、阅读理解任务、作文任务,相应的评估方法是多样的,包括:模型方法(相似度、大模型评分)、规则方法、模型规则混合方法、人工标注方法等。评估结束后输出相应评估指标,并支持对不同版本或者不同应用之间的指标对比。[BISHENG Planning]

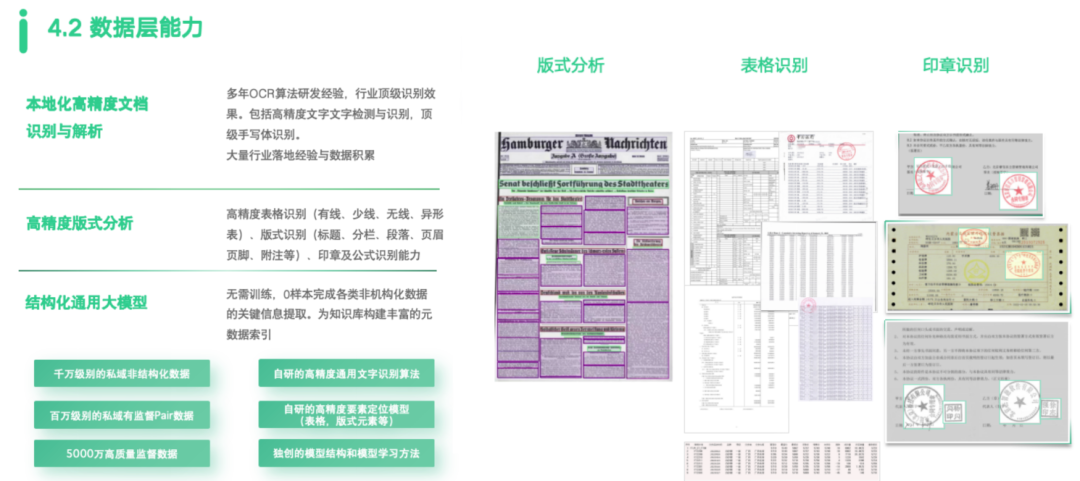

7.数据层能力

-

一方面是通用文档解析能力,该能力对于大模型应用落地的效果影响显著,但容易被忽视。常举的例子是,构建RAG类场景时,若一张表格跨页了没有被拼接起来,召回的内容很可能就是残缺的,导致模型即使再强也无法给出正确答案。好的文档解析需要包含的能力:高精度文字检测与识别(包含手写体检测与识别)、高精度表格识别(有线、少线、无线、异形表)、版式识别(标题、分栏、段落、页眉页脚、附注等)、印章及公式识别能力等。[BISHENG Ready] -

除通用解析外,我们在构建某些类型RAG场景时,业务元数据(如合同的甲方、乙方、合同金额…)索引能够有效提升搜索召回准确性与应用效果,这便需要对非结构化数据进行治理(非结构化转结构化)。[BISHENG Ready]

-

另一方面是场景相关数据的获取与积累,说白话就是,真实情况下业务人员会怎么问问题以及希望获得怎样的答案,这些数据目前是最难获取、最独特且最宝贵的。在前文提到过,最科学的方法肯定是让真实用户参与进来,产生最真实的交互数据,筛选、沉淀这些数据,然后需要技术团队能使用这些数据敏捷迭代应用效果,否则用户迟迟见不到改善容易失去信心。所以这里一方面需要大模型应用开发平台有很强的综合能力,另一方面需要有对用户使用过程数据进行自动化分析与管理的能力。[BISHENG Planning] -

当然,也有一些冷启动的方法,比如基于业务文档直接生成QA对,然后人工进行质检。但这是退而求其次的方法,因为这只适用于特定类型的场景,并且生成的结果仍然依赖人工检查。[BISHENG Ready]

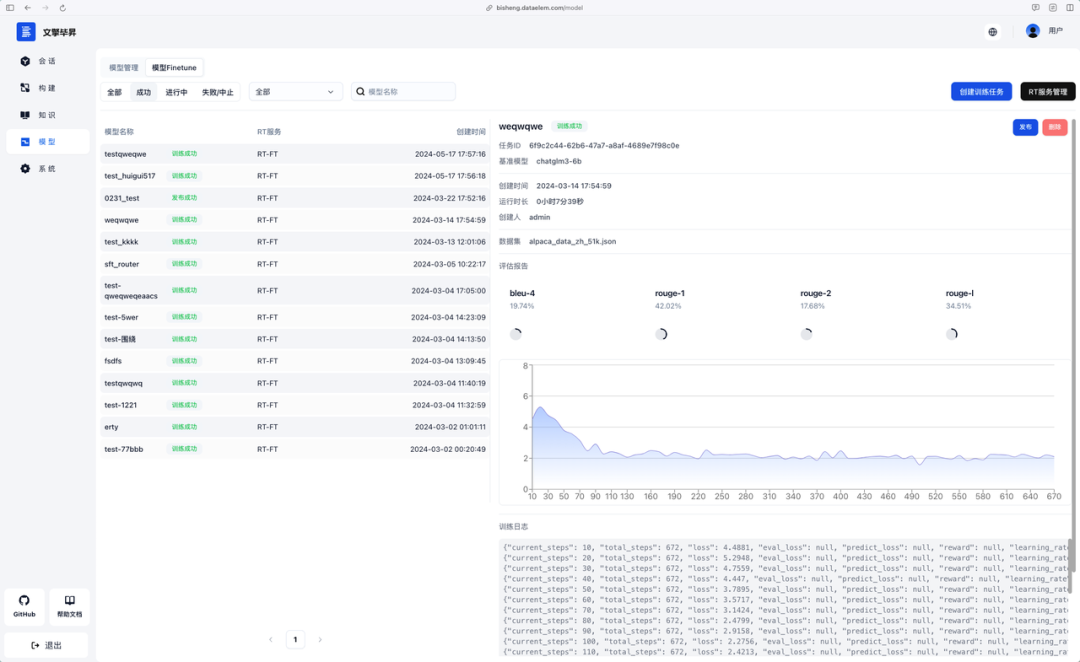

8.微调

-

首先,微调模型并非必要,前面提到过,大模型最被寄予众望的是其泛化与通用推理能力,否则如果每个场景都需要专门微调一下,那跟每个场景训练一个小模型就没有本质差别了。当然也有一些需要微调的情况,比如需要控制“你是谁”这类自我认知问题的回答时,比如某个场景价值很大,投入产出比能算过来时。 -

如果确认要进行微调,注意一定是面向问题的,所以这里跟上面提到的“场景相关数据的获取与积累”是紧密关联的,基于用户使用问题分析定位出模型问题后再谈微调。 -

常见的微调方式有全参、Freeze、Lora三种。[BISHENG Ready](目前还很少看到企业内跑起来RLHF框架做微调的)

-

下面有两个数据供参考,一个是不同参数量基座模型使用不同微调方式对算力要求的实验数据,另一个是三种微调方法最终效果的对比(可以看到Freeze是表现最均衡的,即在目标场景下有较大提升,同时保留了其通用能力)

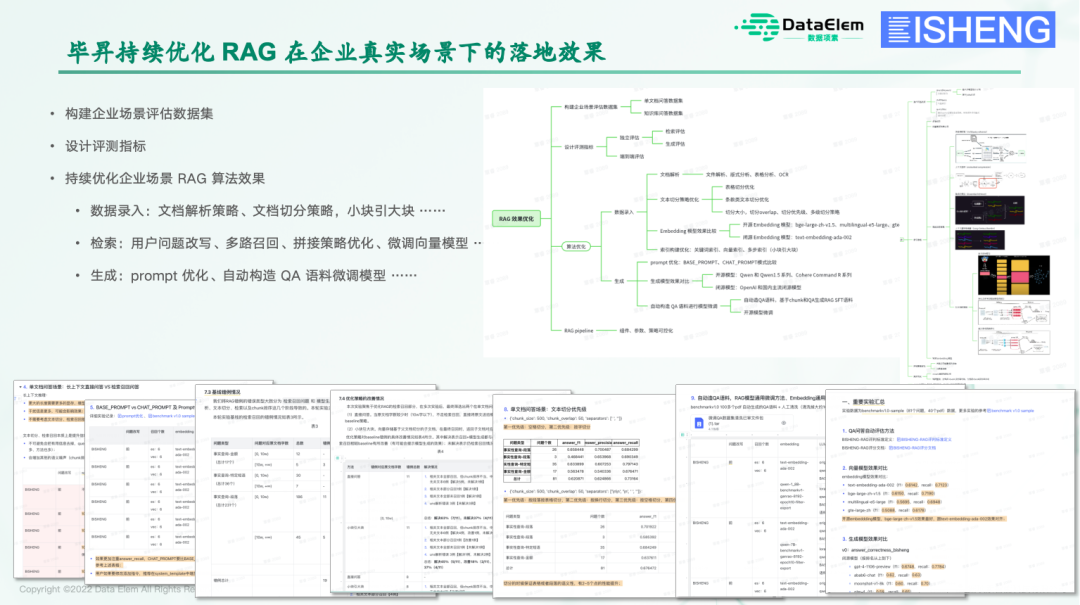

9.RAG与Function Call

-

RAG与Function Call是在两项最为基础和重要的通用技术能力,需要持续精进。过去BISHENG在RAG方向做了许多内部实验(见下图),并将最终最优策略集成到了BISHENG助手的知识库问答中。[BISHENG Ready]

-

目前Function Call能力也在BISHENG助手中有了初步集中体现,我们希望通过该能力,可以为企业员工提供一个统一入口,用户通过自然语言便可以直接查询或操作企业内上百个业务系统,这依赖与客户的紧密合作,有意向做这方面应用的朋友可以联系我们。[BISHENG Ready]

10.企业级特性

-

用户与权限管理,经典的RBAC基于角色的权限管理。[BISHENG Ready] -

部门(用户组)管理。[BISHENG Ready] -

SSO单点登录或其他统一登录。[BISHENG Ready] -

企业数据、系统对接与应用发布(接口、企业IM、界面嵌入)。[BISHENG Ready] -

高可用方案。[BISHENG Ready] -

监控:资源、接口监控与预警。[BISHENG Doing] -

流量控制:高峰期实时会话数/连接数控制,防止挤爆服务。[BISHENG Doing] -

审计:会话记录审计、系统操作审计(技能、应用、知识库、用户、角色等增删改查)。[BISHENG Doing] -

统计:调用数、token数、点赞点踩复制操作反馈率;区分总体/不同应用/不同用户组/不同时间段统计维度。[BISHENG Doing] -

安全:输入输出内容合规审查、加密传输、等保三级。[BISHENG Doing] -

资产沉淀:大模型应用、应用使用过程数据作为一种资产的沉淀。[BISHENG Doing]