-

Dify 上使用 Ollama 本地推理框架客户端

Ollama是一个本地推理框架客户端,允许一键部署诸如Llama 2、Mistral、Llava等大型语言模型(LLMs)。Dify支持集成通过Ollama部署的大型语言模型和文本嵌入能力。快速集成下载并启动Ollama对于其他模型,访问Ollama模型以获取更多详情。访问https://ollama.ai/download下载适用于您系统的Ollama客户端。运行Ollama并与Llava聊天:…- 1

- 0

-

Dify 开源大语言模型(LLM) 应用开发平台如何使用Docker部署与远程访问

本文主要介绍如何在Linux Ubuntu系统以Docker的方式快速部署Dify,并结合cpolar内网穿透工具实现公网远程访问本地Dify!Dify 是一款开源的大语言模型(LLM) 应用开发平台。它融合了后端即服务(Backend as Service)和 LLMOps 的理念,使开发者可以快速搭建生产级的生成式 AI 应用。即使你是非技术人员,也能参与到 AI 应用的定义和数据运营过程中。…- 1

- 0

-

Dify 上使用 Ollama 本地推理框架客户端

Ollama是一个本地推理框架客户端,允许一键部署诸如Llama 2、Mistral、Llava等大型语言模型(LLMs)。Dify支持集成通过Ollama部署的大型语言模型和文本嵌入能力。快速集成下载并启动Ollama对于其他模型,访问Ollama模型以获取更多详情。访问https://ollama.ai/download下载适用于您系统的Ollama客户端。运行Ollama并与Llava聊天:…- 1

- 0

-

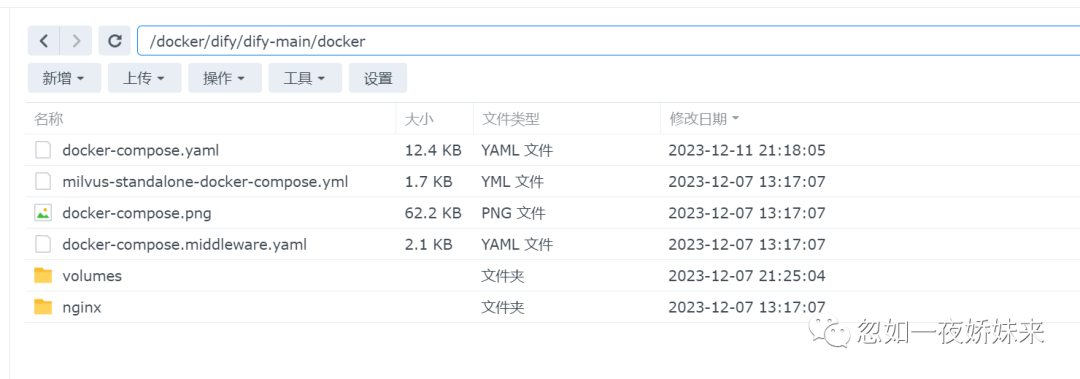

部署dify集成chatglm3搭建本地知识库调通

部署dify集成chatglm3搭建本地知识库调通dify 搭建:项目地址:https://github.com/langgenius/dify先拉取他的代码,因为docker目录下面有对应的配置,git clone 或者下载zip然后解压都行,看自己1.进入到对应的docker目录2.直接使用命令即可,没有image,会自动pull docker compose u…- 1

- 0

-

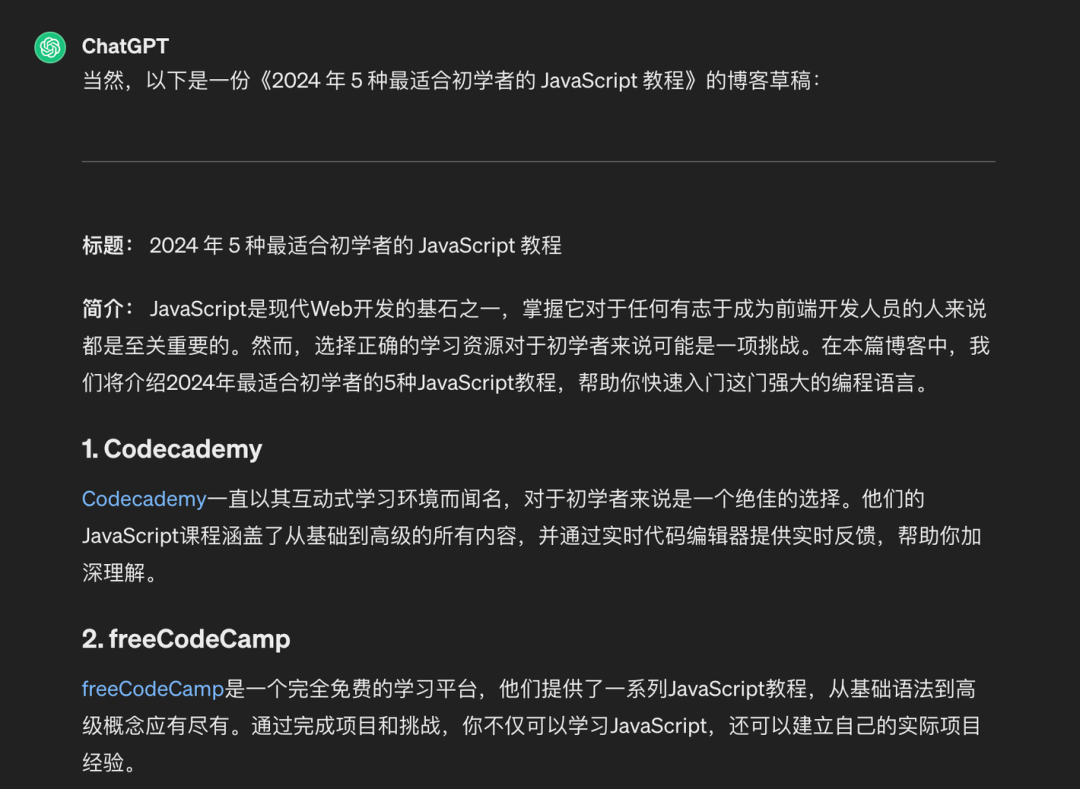

最佳实践|如何在 Dify 用 Workflow 构建一个 Blog SEO AI 应用?

引言SEO Bloger 都有一个普遍的烦恼,那就是个人精力与知识都有限,而谷歌又偏好长内容,为了写一篇优质的 Blog 总是要耗费不少的精力。虽然已经有了一些内置 Prompt 的 ChatGPT 辅助生成内容,但是当你真正使用上它时,就会发现所给出的内容依然非常简单,且数据过时。这同样说明了写作本身其实是一件复杂的创作过程。本期内容将会为你介绍如何借用 Dify 平台上强大的 Workflow…- 1

- 0

-

使用 Dify 和 Moonshot API 构建你的 AI 工作流(一):让不 AI 的应用 AI 化

有了之前的文章铺垫,这篇文章开始,我们聊聊如何折腾 AI 工作流,把不 AI 的应用,“AI 起来”。写在前面上个月,我们聊过了《使用 Dify 和 AWS Bedrock 玩转 Anthropic Claude 3[1]》,里面介绍了如何使用交互体验较好的 Prompt IDE,来帮助我们方便的调试 AI 应用中的 Prompt,以及快速搭建一个 AI 应用。半个月前,Dify 团队推出了包含 …- 1

- 0

-

使用 Dify 和 Moonshot API 构建你的 AI 工作流(一):让不 AI 的应用 AI 化

写在前面上个月,我们聊过了《使用 Dify 和 AWS Bedrock 玩转 Anthropic Claude 3[1]》,里面介绍了如何使用交互体验较好的 Prompt IDE,来帮助我们方便的调试 AI 应用中的 Prompt,以及快速搭建一个 AI 应用。半个月前,Dify 团队推出了包含 AI Workflow 新功能的 v0.6.0[2],这个功能虽然从去年年底就在做了,但是因…- 0

- 0

❯

购物车

优惠劵

搜索

扫码打开当前页

联系我们

返回顶部

幸运之星正在降临...

点击领取今天的签到奖励!

恭喜!您今天获得了{{mission.data.mission.credit}}积分

我的优惠劵

-

¥优惠劵使用时效:无法使用使用时效:

之前

使用时效:永久有效优惠劵ID:×

没有优惠劵可用!