-

EdgeVec:浏览器原生向量数据库,让AI应用彻底摆脱服务器

在浏览器中做向量检索,一直是个麻烦事。原生的IndexDB并不支持向量。之前笔者使用过pglite方案,完成浏览器内的向量检索及问答。我已经将它做为一款书签/桌面/资讯于一体的chrome插件,感兴趣的朋友可以下载使用。https://chromewebstore.google.com/detail/memwink/mpklgnebhehdpdpddabokaocemmalijn?hl=zh-CN…- 0

- 0

-

Claude Code 外挂最强大脑 NotebookLM Skill

这个Skills同样之前也有MCP,也被推翻使用Skills生重做了。一个PG数据库分析Skills用Claude Code 来读取几百个 PDF 和 Markdown目前来说不太现实。Claude Code的上下文就200K,直接挂载大量的外部数据,不可能。但使用传统的本地 RAG 又很弱很麻烦,切片,向量化,检索,这一套流程下来,经常因为切片破碎导致 AI 幻觉。今天这个Skill就完美地解决…- 0

- 0

-

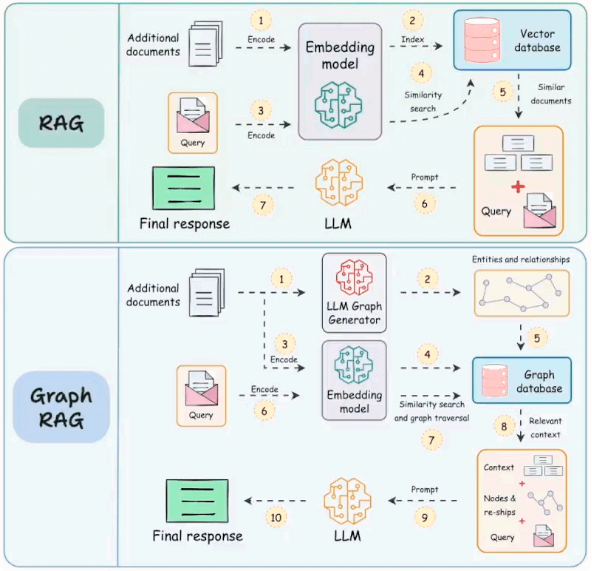

先RAG后KG,还是先KG后RAG?我们试了三种策略

近两年,大模型应用从“能聊两句”走到了“能干活”,而RAG(检索增强生成)与知识图谱(Knowledge Graph,KG)几乎成了构建企业智能问答系统的标配。但问题来了——很多团队“写了文章、拉了框图”,实际项目却效果一般,要么搜索不到关键信息,要么模型一本正经胡说八道。根本原因:你只是把RAG和KG放在一起,而不是让它们互相校验与协同推理。今天我们不仅讲三种融合策略,还带上工作流、示例代码、防…- 0

- 0

-

多层记忆架构:让你的AI“像人一样记忆”

一、困境:记忆越多越聪明,但Token有上限在AI对话系统开发中,我们面临一个经典的矛盾:记忆越多,AI表现越"聪明",但记忆多了又会触发Token上限。很多开发者会说:“我已经用Redis/数据库存储所有对话历史了。” 但这只解决了服务端存储性能问题,并没有解决核心矛盾——当对话记录积累到一定程度,依然会超过模型的上下文窗口限制。我们恰恰希望存储更多的聊天记录,因为只有这样,…- 0

- 0

-

不到 100 行代码用 LlamaIndex 搞一个“带脑子”的 RAG 系统(RAG + 知识图谱)

一个真实可落地、代码完整、部署简单的教程,手把手教你用 LlamaIndex + Neo4j(知识图谱) + Chroma(向量库) 搭建一个“能推理、会回答”的智能问答系统。以一个企业内部 IT 支持场景为例:员工问:“我怎么重置密码?”,系统不仅要返回操作步骤,还要知道“你是哪个部门的”——因为不同部门流程不同!这个案例跑起来,不需要 GPU,普通笔记本就行。🎯 场景设定假…- 0

- 0

-

ASR+LLM+RAG视频内容识别全方案

1 引言:技术背景与核心挑战在视频内容爆发式增长的当下,品牌广告植入场景日益复杂,如何快速精准判断推广品类,成为转转内容运营、竞品分析的核心需求。当前传统方案主要依赖关键词匹配与规则引擎,面临三大技术痛点:ASR 转写准确性不高,输入数据质量低下产品表述异构性模型泛化与迭代能力弱本文提出基于 “ASR+LLM+向量知识库” 的技术方案,通过分层处理、语义修复、历史常见词匹配、知识检索融合,解决上述…- 0

- 0

-

从工单、文档到结构化知识库:一套可复用的 Agent 知识采集方案

我们构建了一套“自动提取 → 智能泛化 → 增量更新 → 向量化同步”的全链路自动化 pipeline,将 Agent 知识库建设中的收集、提质与维护难题转化为简单易用的 Python 工具,让知识高效、持续、低门槛地赋能智能体。一、项目概述定位:知识刮削助手旨在补齐知识从原始位置(工单/文档)到向量知识库之间的自动化链路的空缺。核心能力:📥 多源接入 → 🤖 智能提取 → 🔄 知识泛化 → 💾 …- 0

- 0

-

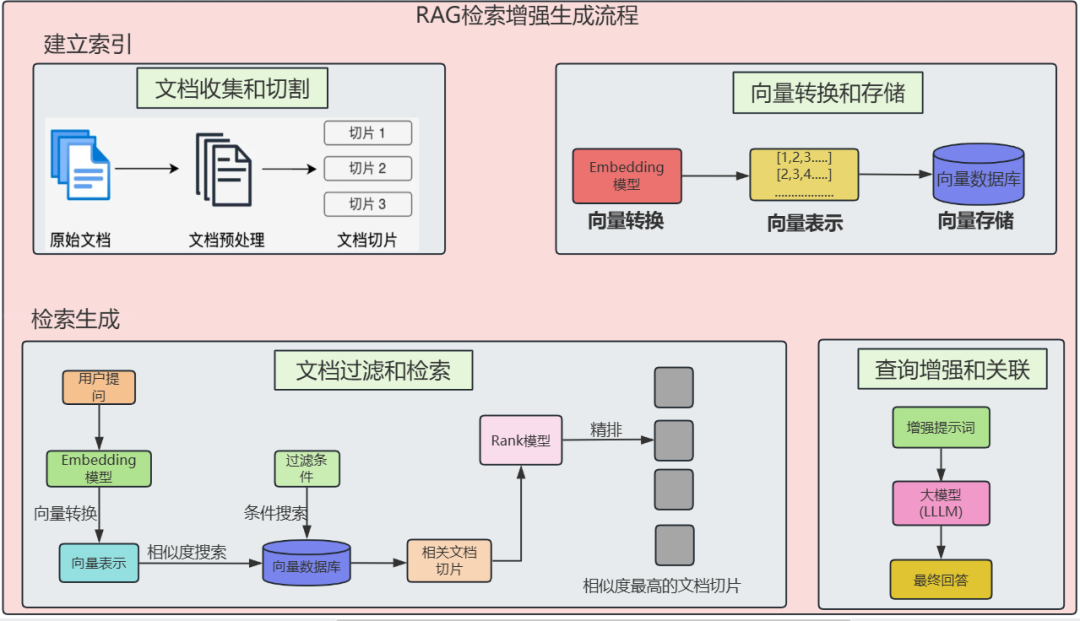

RAG知识库-文档过滤和检索

RAG完整流程文档过滤检索阶段拆分为:检索前、检索时、检索后。检索前预检索阶段负责处理和优化用户的原始查询,以提高后续检索的质量。Spring AI提供了多种查询处理组件。Spring AI提供了多种查询处理组件。查询转换-查询重写当用户查询含糊不清或包含无关信息时,使用RewriteQueryTransformer大模型语言对用户的原始检查进行改写。Query query =…- 0

- 0

-

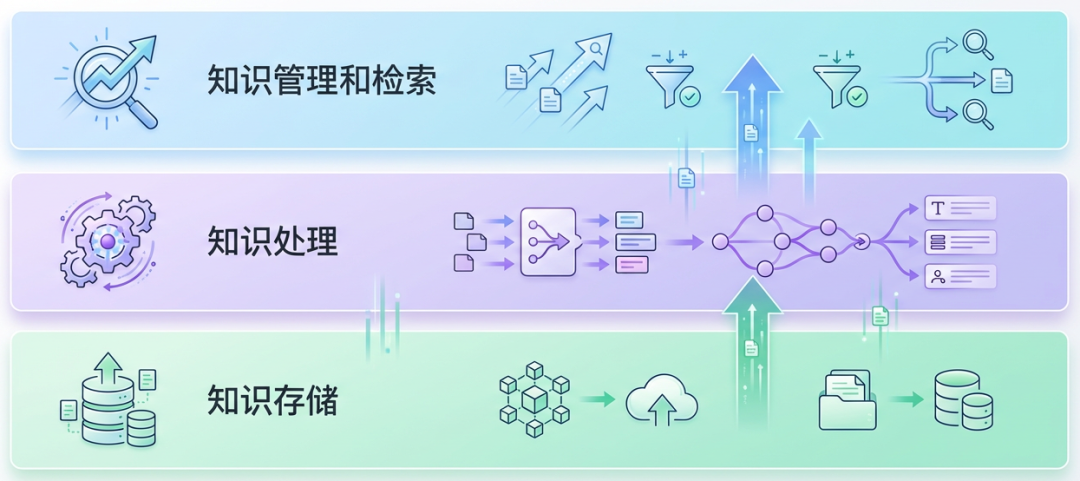

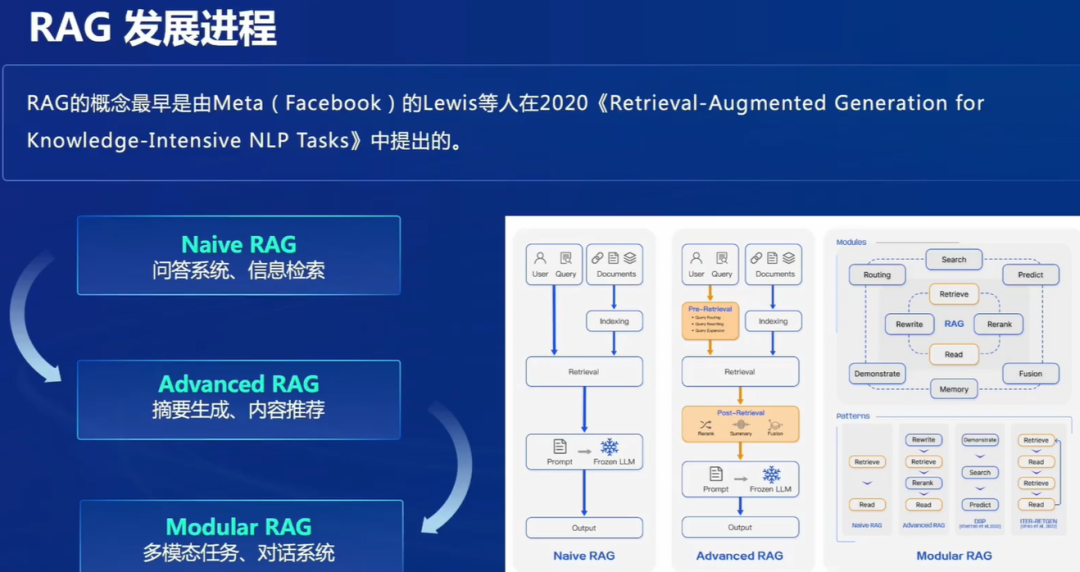

RAG落地实践:知识库三层架构和关键组件

在当前LLM(大型语言模型)的应用浪潮中,检索增强生成(RAG)已成为相对成熟且应用最广的落地模式之一。但无论是从最初的Naive RAG演进到Advanced RAG,还是最新的Agentic RAG,其核心都离不开一个关键底座:知识库管理系统。对于面向落地应用RAG的产品经理和工程化技术人员而言,如果只是停留在对LLM能力或RAG流程的表面理解,很难在真实复杂的业务场景中建立起高效、稳定的智能…- 0

- 0

-

Dify x 阿里云 Tablestore:向量检索与结构化数据统一存储方案

今天,dify 正式适配阿里云 Tablestore 向量索引能力,并依托阿里云计算巢提供一键部署体验。企业无需重构现有架构,就能获得更轻的运维负担、更灵活的按需计费,以及面向百亿级数据增长的扩展能力,让生产级 RAG 更容易落地。挑战:Dify 用户在构建生产级 RAG 时,常需额外部署和维护独立向量数据库,面临高昂内存成本、百亿级扩展困难、多系统数据同步复杂等难题,严重制约应用规模化落地。开源…- 0

- 0

-

RAG检索增强是在给大模型“喂”数据?不,你是在为它构建一整套物流体系

“ RAG就像一套完善的物流管理体系,其核心困难点永远在我们看不到的地方。”在很多人看来,做检索增强生成的难点在于提升检索召回的效率和准确率,因,因此很多人把大量的时间花在优化检索方案上。但作者作为一个对RAG有深入了解的开发人员,恰恰认为RAG真正的难点并不在检索端,而在于知识库的管理。为什么会说RAG的难点在知识库的管理,而不是数据召回?知识库管理很多人都知道RAG是检索增强生成,从…- 0

- 0

-

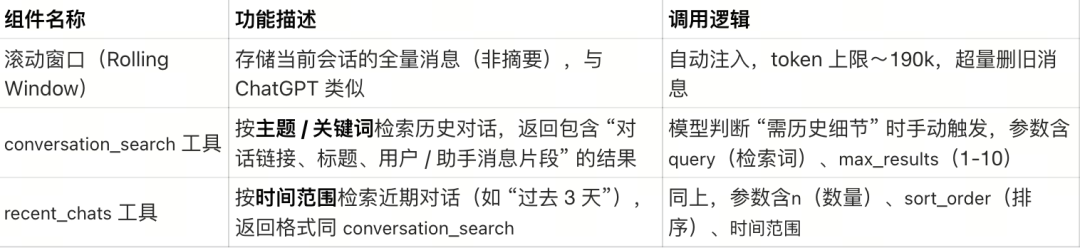

ChatGPT VS Claude ,Agent记忆用对话压缩还是RAG按需检索

在高质量 AI Agent 系统里,记忆模块的设计远比看起来复杂,它要解决三个关键问题:怎么存历史对话?什么时候检索?该检索哪些内容?这些问题直接决定了 Agent 的响应速度、资源占用和能力天花板。而我们常用的 ChatGPT、Claude 这类大模型,之所以能记住用户的长期偏好,越用越顺手,本质上是因为它们也算一种极简版 AI Agent。但在记忆模块的设计上,两者走了完全不同的路。最近,一位…- 0

- 0

-

上下文不等于记忆:从单Agent到多Agent协作,记忆系统是关键

开篇在Agent的浪潮中,我们经历了一次又一次的认知迭代。最初是提示工程,我们学习如何更好地提问;随后是上下文工程,随着窗口从8k卷到1M,我们误以为塞进去就是记住了。但当Manus、Anthropic 等团队开始引入file system和agent skill等概念后,上下文工程的边界又变得日益模糊。😳最近看了AWS re:Invent 2025 中关于memory的一场技术演讲以及Mongo…- 0

- 0

-

为什么Claude Code不用RAG?

引言最近看到有一些文章提出了“RAG已死”的观点。核心论据是 Claude Code 开发负责人 Boris Cherny 在一档播客节目[1]中,披露现在的 Claude Code已不再使用RAG,而改用 Agentic Search。他的主要观点如下:起初采用RAG路线,将整个代码库索引一遍,然后用 Voyage 这类检索器上,让模型用提示去查找信息,用的是标准模板。但到最后,团队放弃了结构化…- 0

- 0

-

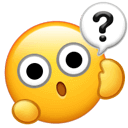

图索引性能提升 400%:详解 VSAG 向量检索框架

VSAG 是蚂蚁集团开源的图索引向量检索框架。本文源自 VSAG 团队在 VLDB'25 发表的《VSAG: An Optimized Search Framework for Graph-based Approximate Nearest Neighbor Search》,介绍 VSAG 框架如何通过缓存优化、自动调参和距离计算加速,在保证高召回率前提下将检索性能提升最高 …- 0

- 0

-

告别关键词高亮,语义高亮才是解决搜索 / Agent噪音的标准答案

今天聊一聊怎么在RAG、Agent场景中实现语义高亮(Semantic Highlight)。在AI落地的过程中,我们不管是用电商搜东西、用RAG查文档,还是靠AI Agent做信息挖掘,大家做检索最核心的需求其实就一个:快速找到有用的信息。而高亮功能,就是帮我们快速定位信息的关键。但传统基于关键词匹配的传统高亮,无法根据语义信息做内容定位,市面上已有的Semantic Highlight方案,又…- 0

- 0

-

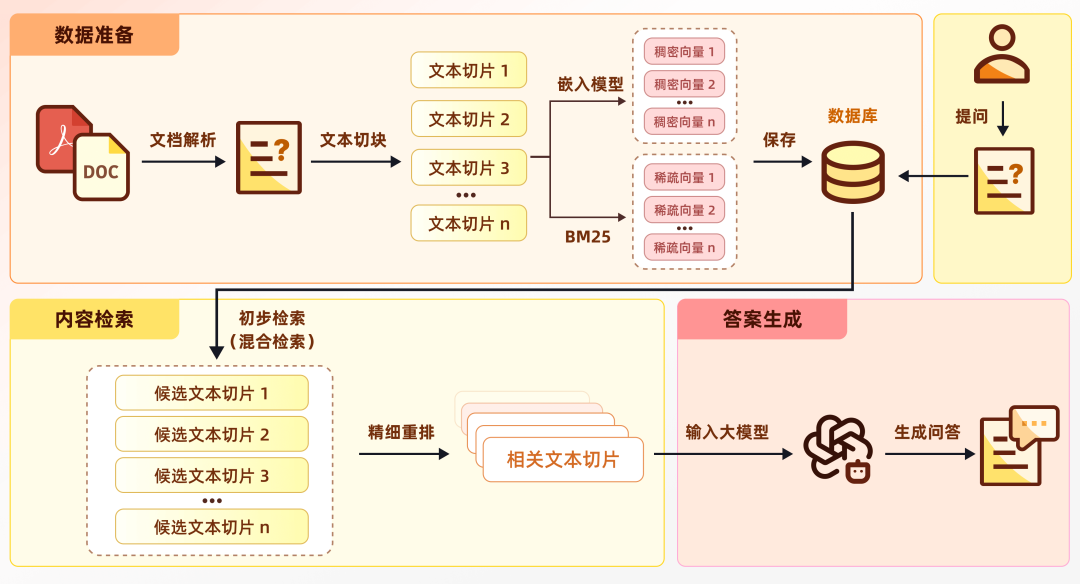

让RAG像人类一样“扫视全文”:上下文检索技术详解

尽管大语言模型本身的能力在快速演进,但它依然无法凭空获取训练数据之外最新或专有知识。检索增强生成(RAG, Retrieval-Augmented Generation)正是为解决这一问题而生:在回答问题前,先从知识库中检索相关资料,再让模型参考这些资料生成答案。换言之,RAG让大模型从“闭卷考试”变成了“开卷考试”。但“开卷”也不一定更容易。如果检索到的资料不完整、不准确,能力再强的大模型也无法…- 0

- 0

-

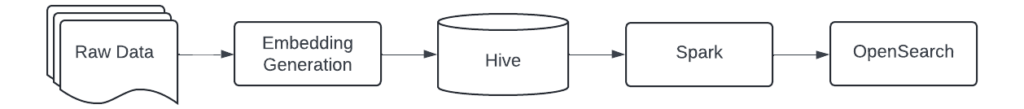

Uber 如何利用 OpenSearch 实现十亿级向量搜索

介绍在 Uber,我们的系统每天处理海量数据,涵盖从拼车到外卖的各个环节。我们传统上使用基于关键词的 Apache Lucene ^™^搜索。然而,我们需要超越简单的关键词匹配,转向语义搜索,才能理解搜索背后的含义。 为了实现这一目标,我们采用了 Amazon® ^OpenSearch^作为向量搜索引擎。其可扩展性、性能和灵活性是我们做出这一决定的关键因素。这篇博文将探讨我们…- 0

- 0

-

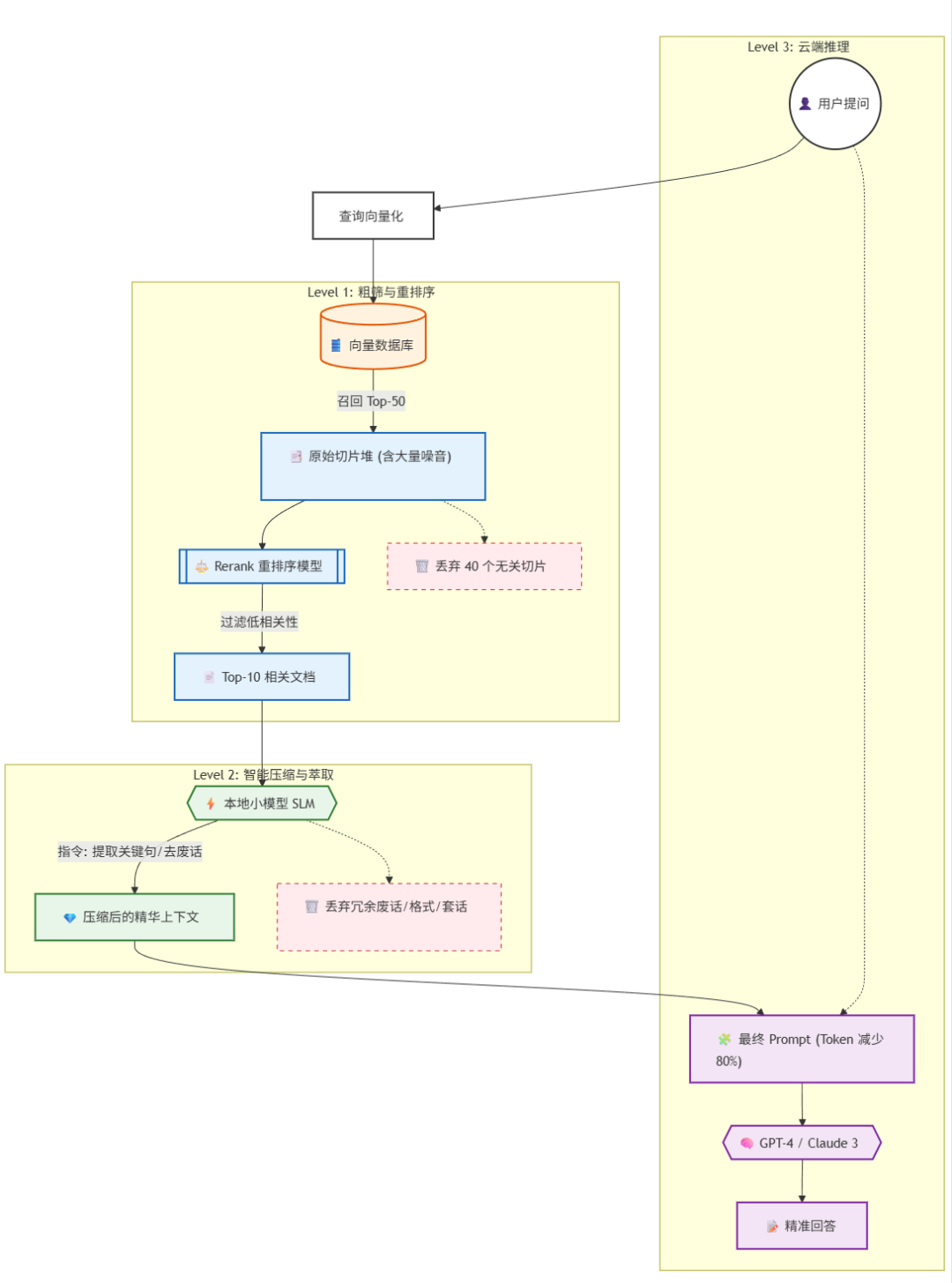

别让大模型在“垃圾堆”里找金子:深度解析 RAG 的上下文压缩技术

在 RAG(检索增强生成)的工程实践中,我们常常陷入一种“囤积癖”式的误区:为了防止漏掉关键信息,我们恨不得把检索到的 Top 20 文档,连同文件名、页码甚至页眉页脚,一股脑塞进大模型(LLM)的 Prompt 里。毕竟,现在的 GPT-4 Turbo 和 Claude 3 都支持 128k 甚至 200k 的上下文,不用白不用,对吧?但这恰恰是导致 RAG 系统“慢”、“贵”、“笨”的元凶。如…- 0

- 0

-

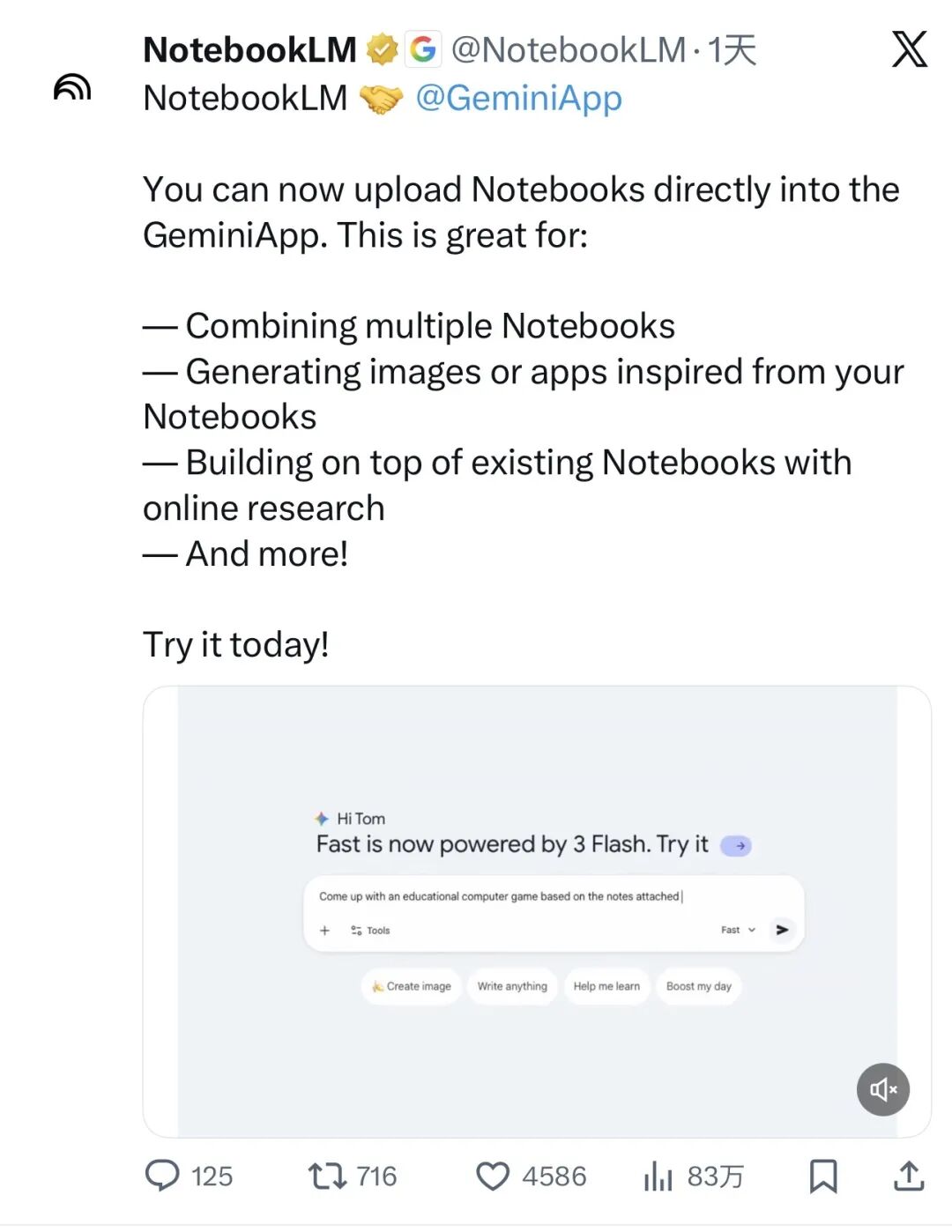

终于,NotebookLM 和 Gemini 合体了。这是什么神之更新?

昨天看到 NotebookLM 的社交账号更新了,NotebookLM 和 Gemini 🤝意思是:现在用户可以直接将笔记本(NotebookLM 里的)上传到 GeminiApp 中。这非常适合:— 整合多个笔记本— 根据笔记本生成图像或者做应用程序— 在现有笔记本的基础上,使用在线深度研究等功能— 还有更多我试了一下,其实 App 还不支持呢,只有 Pro 会员在 Gemini Web 版本里…- 0

- 0

-

Cohere 推出 Rerank 4,将上下文窗口从 8K 扩展至 32K,以交叉编码器架构强化长文档语义理解与跨段落关联捕捉

Cohere 推出的 Rerank 4,核心是将上下文窗口从 8K 扩展至 32K(四倍提升),以交叉编码器架构强化长文档语义理解与跨段落关联捕捉,通过 Fast/Pro 双版本适配不同企业场景,显著提升检索精度并降低 LLM 调用成本。技术突破:上下文窗口扩展与架构优化32K上下文窗口Rerank 4的上下文窗口从Rerank 3.5的8K扩展至32K,扩大四倍。这一突破使其能够处理更长的文档(…- 0

- 0

-

4.1K Star!GitHub 上挖到一个救星级别的 RAG 数据流水线项目!

很多人一开始做 RAG,注意力全在模型上。真正做过项目后才发现 —— 最折磨人的根本不是模型,而是数据处理。一般 RAG 项目里最容易失控的部分:• PDF、Markdown、网页、代码混在一起• 源文件一改,全量重跑 embedding• 跑一次向量化就是钱• 数据清洗、切片、入库脚本散落一地,没人敢动最终结果往往是:“RAG 能跑,但谁都不敢维护。”最近,我在 GitHu…- 0

- 0

-

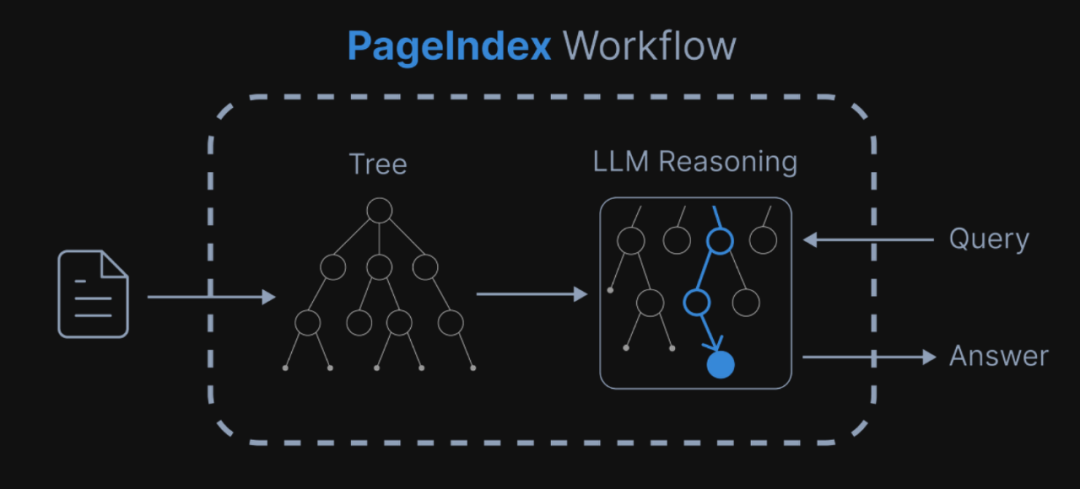

PageIndex:一种基于推理的 RAG 框架

最近在调研RAG的各种技术,关注到了PageIndex,觉得其思路颇有借鉴意义,故整理下PageIndex相关知识要点。1、PageIndex是什么PageIndex 是一种不依赖向量的、基于推理(reasoning-based)的信息检索框架,用于从长篇、复杂文档中进行知识检索,其设计理念是模拟人类专家阅读和定位信息的方式,通过将文档结构化为树,并让大模型在该结构上进行推理导航,从而实现可解释、…- 0

- 0

-

深度解析丨智能体架构,利用文件系统重塑上下文工程

智能体架构:利用文件系统重塑上下文工程在现代 AI 系统设计的宏伟蓝图中,深度智能体的一个核心特征在于它们能够驾驭一套文件系统工具。通过这些工具,深度智能体得以在文件系统中执行读取、写入、编辑、列出目录以及搜索文件等操作。这不仅仅是功能的堆叠,更是智能体认知架构的一次重要升级。为了理解文件系统的价值,我们必须先审视当下的智能体在哪些环节容易遭遇瓶颈。它们失败通常归结为两个核心原因:模型本身的推理能…- 0

- 0

❯

购物车

优惠劵

搜索

扫码打开当前页

联系我们

返回顶部

幸运之星正在降临...

点击领取今天的签到奖励!

恭喜!您今天获得了{{mission.data.mission.credit}}积分

我的优惠劵

-

¥优惠劵使用时效:无法使用使用时效:

之前

使用时效:永久有效优惠劵ID:×

没有优惠劵可用!