-

函数计算 AgentRun 重磅上线知识库功能,赋能智能体更“懂”你

阿里云函数计算 AgentRun 正式推出全新知识库功能,为智能体(Agent)注入更强的语义理解与上下文感知能力。通过深度集成百炼知识库与 RAGFlow 知识库,AgentRun 让开发者能够轻松构建具备“知识”的智能应用,真正实现“更懂用户、更贴场景、更高效响应”。为什么需要知识库?Cloud Native在传统智能体开发中,模型往往依赖通用训练数据,缺乏对特定…- 0

- 0

-

查个问题还要全图跑一遍?DA-RAG说我只取一瓢

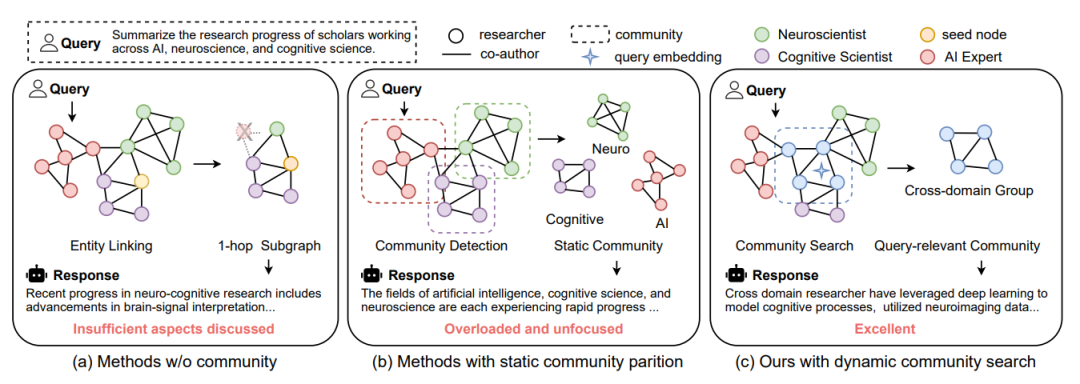

当前主流的GraphRAG(如微软GraphRAG、ArchRAG)存在一个致命缺陷:它们依赖离线预计算的静态社区划分。就像把图书馆的书籍提前分好类贴上标签,当用户问"某跨部门项目的人员协作情况"时,系统只能机械地返回预设的"部门A"或"部门B"信息,而无法动态整合跨边界的关键内容。更基础的G-RAG方法(如LightRAG、HippoR…- 0

- 0

-

走进 OceanBase 向量背后的算法库 —— VSAG

向量搜索技术,被认为是海量非结构化数据检索的关键技术之一,这会涉及到高维空间的搜索问题,通常会通过近似最近邻搜索(Approximate Nearest Neighbor Search, ANNS)的方式来在高维空间中进行检索,以此来找到满足要求的数据。随着 AI 应用场景的发展,半结构与非结构化数据的涌现,向量数据库成为 AI 时代重要的数据基座。在 VectorDBBench 基准测试中,Oc…- 0

- 0

-

Data Agent Ready Database:下一代企业数仓架构

如果说 2025 年是数据库的 AI Ready 元年(向量检索、AI 函数成为标配),那么 2026 年将是 Data Agent Ready 的开端。随着 Cursor、Codex 和 Claude Code 等编程 Data Agent 的兴起,以及各类数据分析 Data Agent 的普及,越来越多的数据库操作正在被 AI 接管。但企业级场景与个人实…- 0

- 0

-

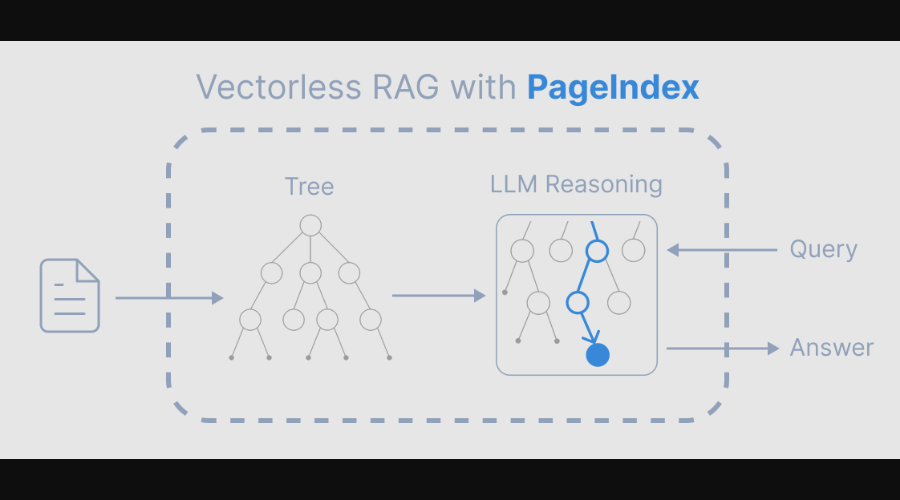

丢掉向量数据库!PageIndex 开启“推理型 RAG”新时代,长文档分析准确率高达 98.7%

做过 RAG(检索增强生成)开发的同学,大概率都经历过这种痛苦:为了处理一份几百页的专业文档,你需要不断地调整切片大小、重叠度,还要折腾各种向量数据库和嵌入模型。可即便如此,AI 依然会给出驴唇不对马嘴的回答,或者在关键信息上“胡说八道”。究其原因,是因为传统的向量检索本质上是寻找“语义相似度”。但在处理法律条文、金融报告或技术手册时,相似并不等同于相关。真正的精准检索需要的是逻辑推理…- 0

- 0

-

向量,向量化,向量数据库和向量计算

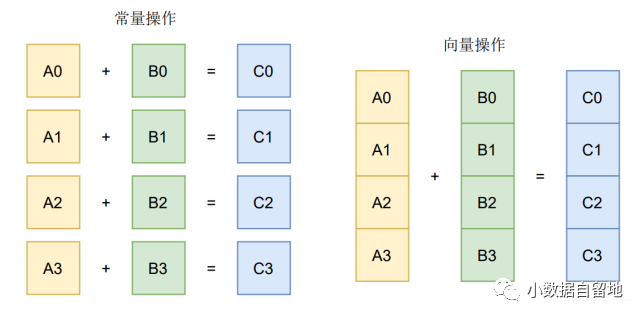

最近大家都在All in AI,我们的业务系统也要开始接入AI助手,伴随AI的向量数据库突然就变成了我们运维团队的下一个重要目标,向量,向量化,向量数据库和向量计算这些概念扑面而来,下面我们就一个个的解读下。向量化计算我们先看看这个向量计算,它本身和大模型无关,最初是在Clickhouse中注意到这个概念的,这个是Clickhouse的一个核心特性,现在其实很多大数据的计算引擎和数据库都支持向量计…- 0

- 0

-

别再迷信向量数据库了,RAG 的“大力出奇迹”该结束了

说真的,现在的 AI 圈子有点浮躁。只要是个做大模型的,开口闭口就是 RAG(检索增强生成)。确实,为了解决 LLM 那个像金鱼一样的短时记忆和一本正经胡说八道(幻觉)的毛病,RAG 几乎成了标准配置。但在过去这一年里,有多少公司的 RAG 方案是真的“能用”的?如果你在做金融研报分析、法律合同审查,或者哪怕只是想让 AI 读懂几十页的内部手册,你一定被那个叫向量检索(Vector S…- 0

- 0

-

告别黑盒开发!清华系团队开源 UltraRAG:用“搭积木”的方式构建复杂 RAG 流程

在生成式 AI 领域,RAG(检索增强生成)早已不是新鲜词汇。但真正动手做过项目的同学都知道,想要搭建一个能在生产环境稳定运行、逻辑复杂的 RAG 系统,往往需要编写大量繁琐的胶水代码。更头疼的是,一旦涉及到循环判断、多级检索等复杂逻辑,系统往往就变成了难以调试的“黑盒”。为了解决这些痛点,清华大学 THUNLP 实验室、东北大学 NEUIR 实验室、OpenBMB 以及 AI9sta…- 0

- 0

-

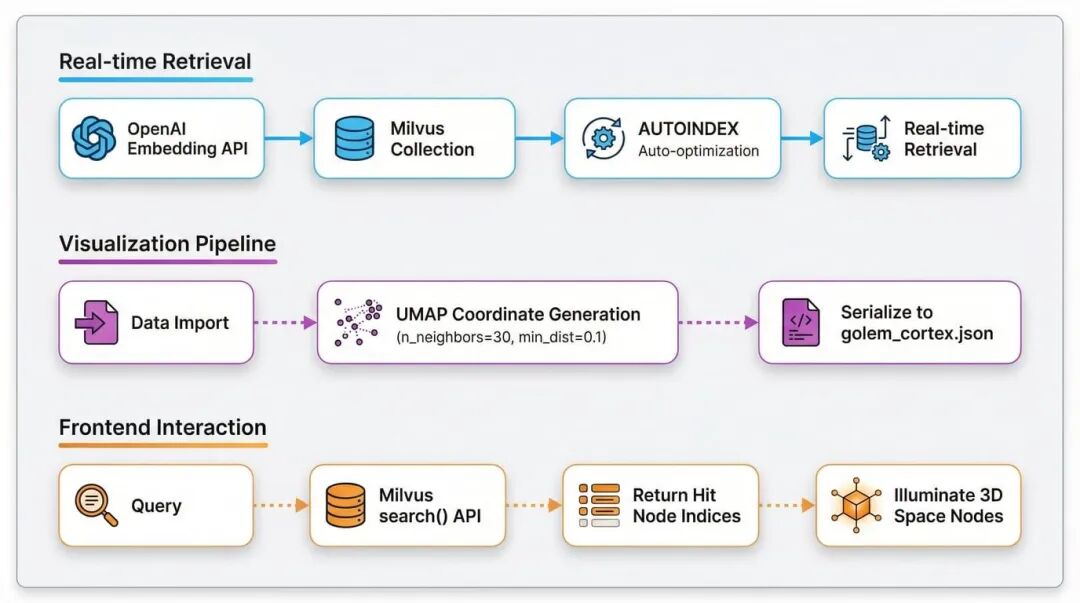

RAG优化不抓瞎!Milvus检索可视化,帮你快速定位嵌入、切块、索引哪有问题

最近,在GitHub上发现一个宝藏项目Project_Golem 。一直以来,RAG 是解决知识时效性、事实性问题的核心方案,但RAG 调试的黑盒却一直是个问题:我们只能看到相似度分数,却无从知晓文档在向量空间的实际分布,更搞不懂为什么是这些文档被召回、为什么核心文档会漏召 / 误召,调优全凭经验瞎猜。那么,到底是embedding模型选错了?chunking大小不合理?还是检索过程的索引算法选的…- 0

- 0

-

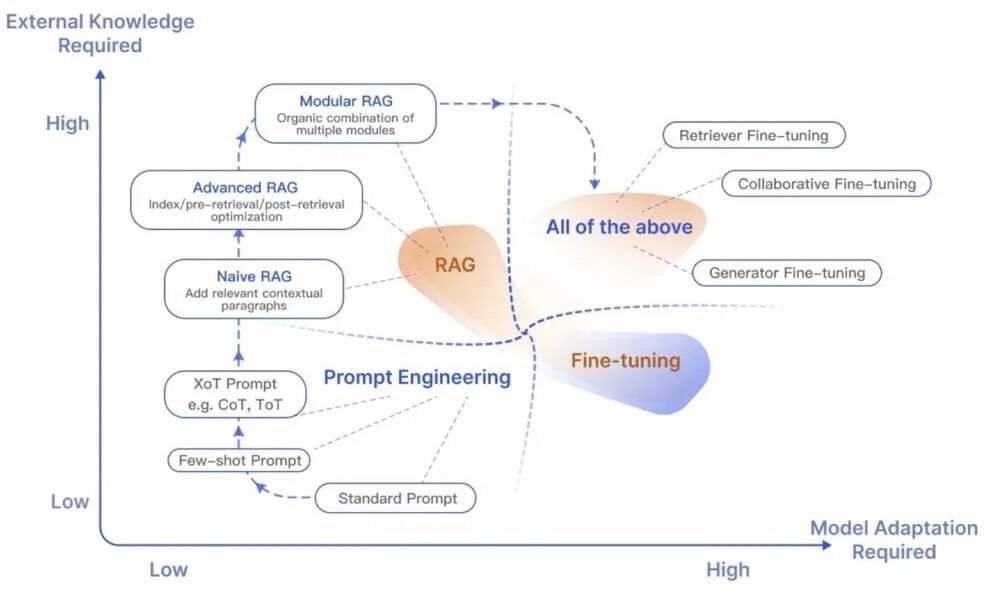

Fusion GraphRAG:超越 GraphRAG 的多模态企业级 AI 问答

今天我们不谈基础的图数据库概念与应用场景,而是聚焦于一个更前沿的融合领域——基于图的 RAG 平台。在大型语言模型席卷全球的当下,企业面临的核心挑战已从如何搭建一个大模型转变为如何安全、高效、低成本地使用大模型处理私有知识。一、当前大模型落地的现实路径面对私有化部署和知识更新问题,目前主要有两种路径:微调与纯接口调用。微调:成本高昂、流程复杂,文档的每次更新都可能触发重新训练纯接口调用:无法触及企…- 0

- 0

-

Semantic Kernel内存管理系统——为AI注入持久记忆与上下文感知能力

1. Memory系统核心概念与设计哲学Memory是Semantic Kernel框架中让AI应用真正具备"智能"的核心组件。与传统计算的缓存机制不同,Semantic Kernel的Memory系统模仿了人类的记忆过程,能够让AI模型记住历史交互、检索相关知识,并在后续决策中利用这些信息。1.1 什么是AI中的Memory?在Semantic Kernel中,Memory不…- 0

- 0

-

AgentSkills 揭示的真相:上下文工程走错了三年

一个反直觉结论:你越少喂上下文,Agent 反而越能干。RAG 很努力,但结果不稳定很多公司做知识库问答(RAG)都是“拼命三郎”:• 文档格式化• 索引调参• 检索融合• 还要给模型加反思链但最后呢?要么“找不到”,要么“胡编”。所以我们换个脑回路:不去替模型管上下文,而是给它一个可探索的文件系统。Agent 只拿一个最小起点,剩下的让它自己找。换句话说:你负责把食材放进冰箱分门别类…- 0

- 0

-

Langgraph从零开始构建第一个Agentic RAG 系统

使用自定义工具和向量数据库创建Agentic RAG 系统的分步指南,让它学会向人一样不断思考连续调用不同工具解决问题智能体人工智能正在迅速普及,现在是时候进行另一次详细的教程了,这不仅能帮助你构建你的第一个智能体 RAG 系统,还能让你深入了解它的组成部分。我们的教程从 RAG 开始,再过渡到Agentic RAG 。LLM 的内部知识有限,它基于训练数据和上下文长度。为了确保LLM能…- 0

- 0

-

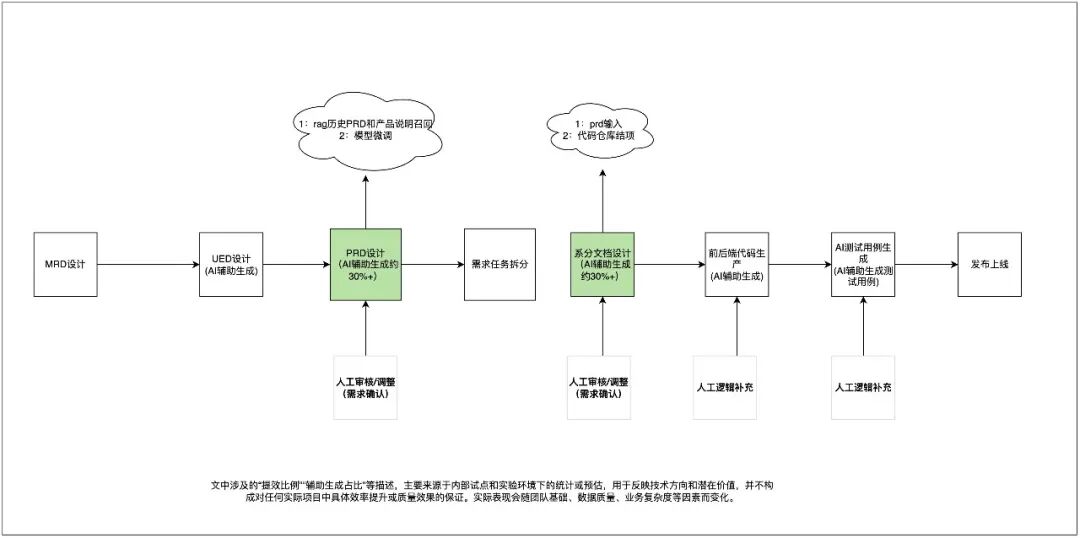

大模型在需求分析与设计中的提效实践

一、背景介绍随着 AI 技术的快速发展,越来越多的企业开始积极探索如何利用 AI 优化产品开发流程。从初期的产品需求文档(PRD)撰写、系统分析与设计,到高质量代码的生成,AI 正逐步渗透到开发全流程,构建起一个完整的“AI辅助开发生态”,显著缩短开发周期。在传统开发流程中,PRD 和系统分析文档的设计以及编码实现需要人工拆解、设计和开发,这不仅易产生理解偏差和重复工作,还存在效率低下、质量不稳定…- 0

- 0

-

GraphRAG:让 RAG 看见"关系网络"的技术进化

GraphRAG:让 RAG 看见"关系网络"的技术进化最近在折腾 RAG 相关的东西,发现一个挺有意思的现象——传统 RAG 在处理某些问题时简直就是"智商掉线"。举个具体的例子。我拿《三体》第一部做了个测试(注:选第一部是因为它够短、人物关系也相对简单,方便验证想法,不想被后面那两部复杂的剧情搞晕):问它"叶文洁是怎么联系上三体文明…- 0

- 0

-

企业级 AI 知识库问答,是不是面子工程? – 是也不是

2025年到现在,大模型在企业落地已经进入深水区,绝大部分场景因为建设难度难以成为CIO们眼中合适的大模型速赢项目,AI知识库问答成了大家的首选 – 既满足了大家对AI的想象,又很难失败。如果我们回归价值产出时,我很负责任的说,知识库项目是非常难“成功”的 - 它是一个非刚需、无直接价值产出、无当前场景替代的功能。即使如此,我仍然认为知识库问答是企业AI速赢…- 0

- 0

-

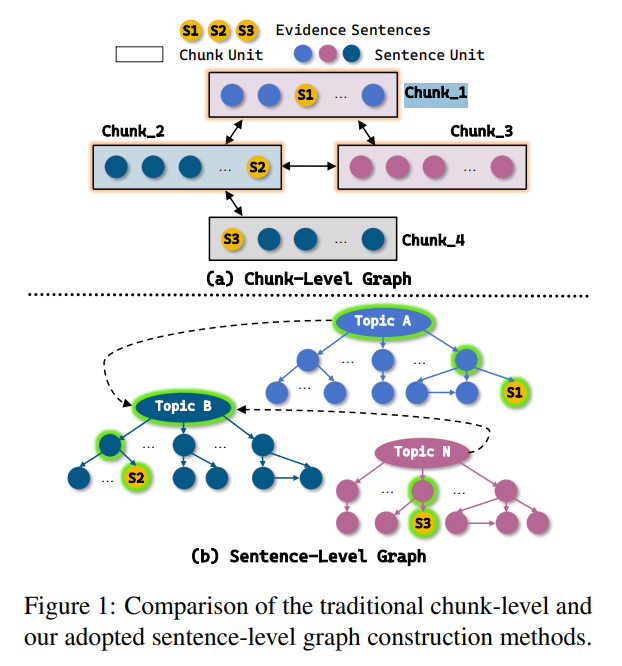

SentGraph:一句一句把多跳RAG“画”成图

为什么传统 RAG 会“断链”单跳场景:把文档切成 200 字左右的 chunk,做向量相似度检索 → LLM 直接答,够用。多跳场景:需要把 2-4 份文档里的证据拼成一条“推理链”。chunk 粒度粗,一次就带回一整段,里面 60% 是干扰句,关键句反而被淹没 → 链条断了,LLM 开始“胡编”。作者一句话总结:“不是检索不准,是检索单元太胖,逻辑关系太乱。”传统 chunk 图 …- 0

- 0

-

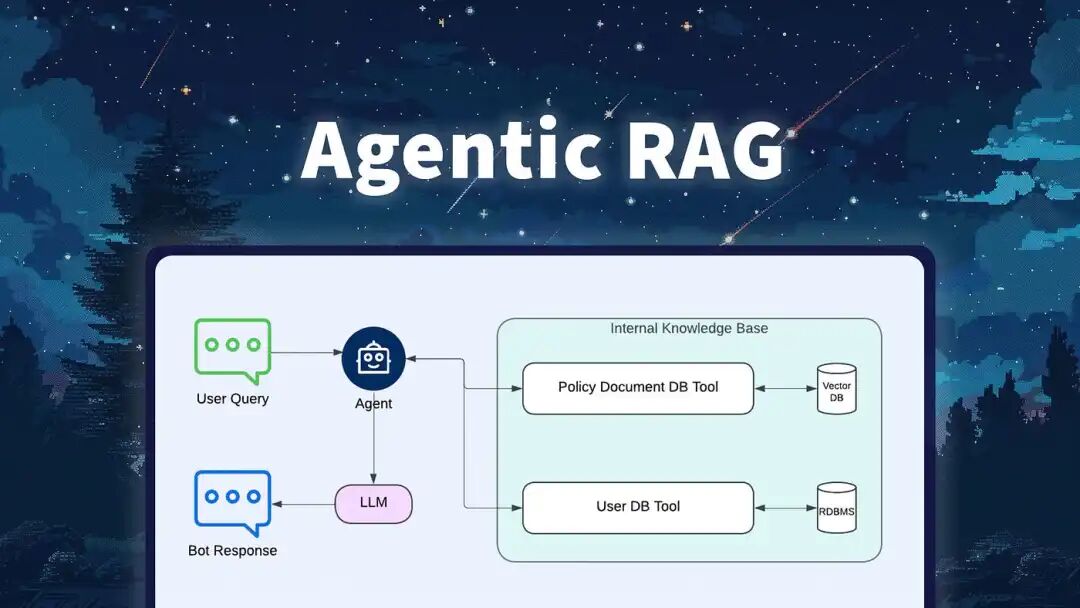

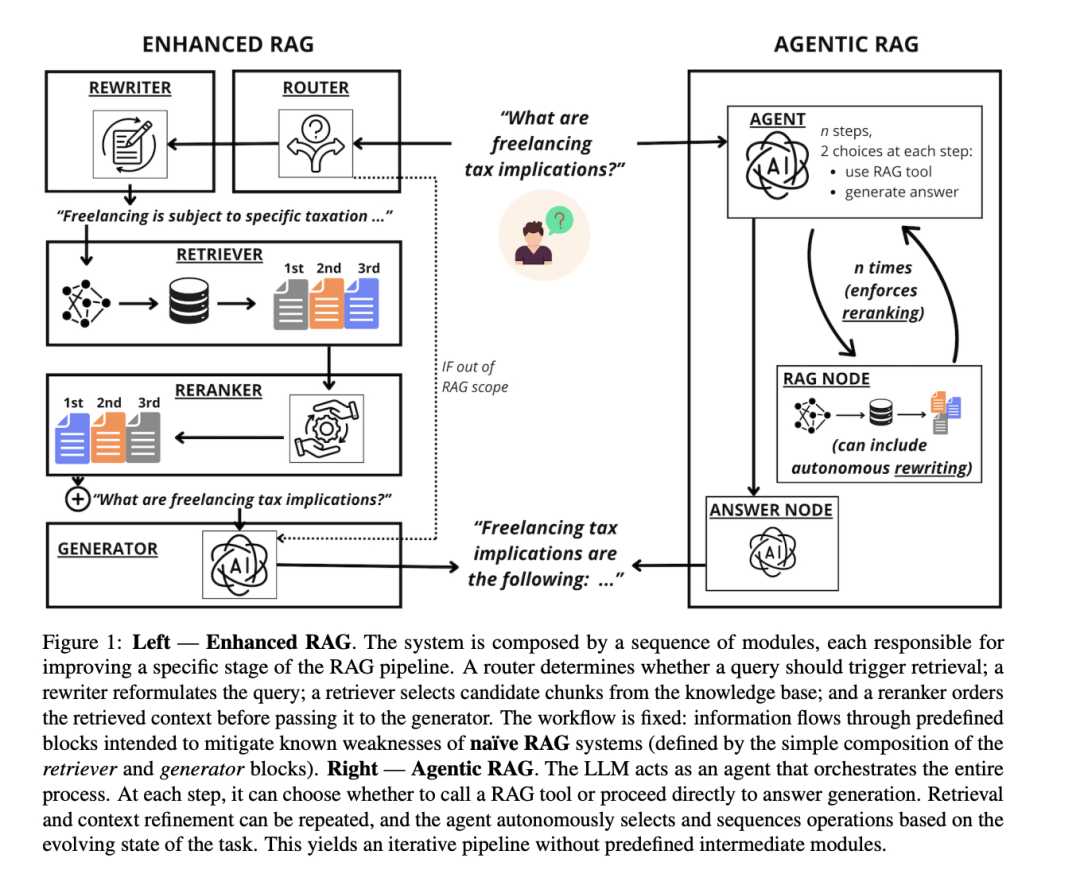

增强型RAG还是Agentic RAG?一场关于检索增强生成系统的全面对比实验

当LLM遇到知识库,检索增强生成(Retrieval-Augmented Generation,RAG)系统应运而生。但随着技术演进,两种截然不同的范式正在争夺主导地位:一种是通过精心设计的模块链条逐步优化的"增强型RAG",另一种是让LLM自主决策、动态调整的"Agentic RAG"。哪种方案更值得采用?成本与性能如何权衡?论文通过大规模实验给出了答案。…- 0

- 0

-

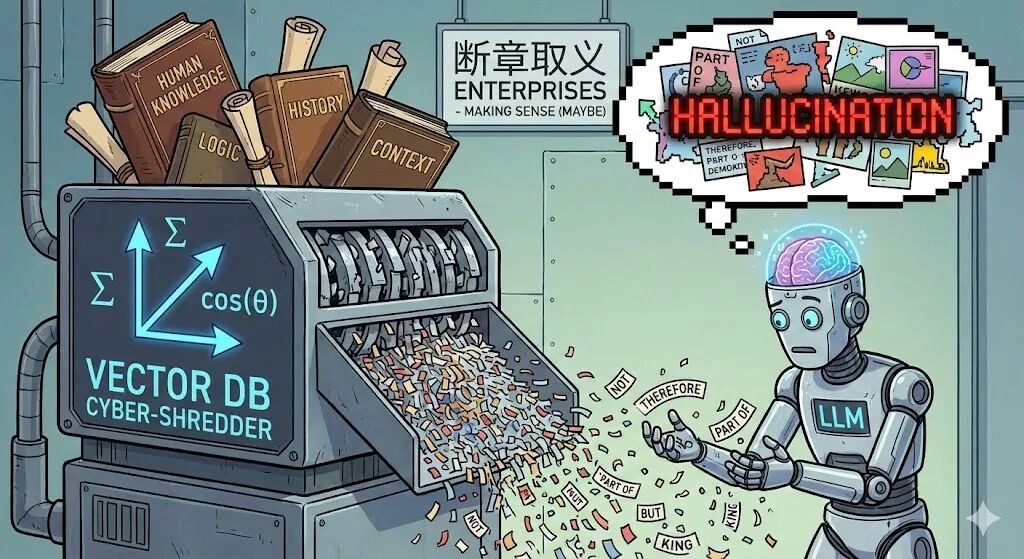

别再用向量数据库给AI灌"迷魂汤"了

一场关于"切片"的集体癔症如果未来的数字考古学家翻开2023-2025年的技术史,他们一定会看到一个荒诞的景观:成千上万的天才程序员,正满头大汗地把人类文明精妙的逻辑、厚重的典籍和严密的法典,塞进一台巨大的"赛博碎纸机"里。这台碎纸机有个高级的名字,叫 向量数据库(Vector Database)。在那段狂热的日子里,人们坚信只要把知识切成一段段5…- 0

- 0

-

DSPy 3 + GEPA:迄今最先进的 RAG 框架——自动推理与提示

上周,OpenAI 在半夜突发“飙车”,一度全网骚动。GPT-5.2 发布,全球 AI 王座再度易主。四个月左右就迎来一次大版本更新并不常见。导火索是竞争压力。路透社报道(https://www.reuters.com/technology/openai-launches-gpt-52-ai-model-with-improved-capabilities-2025-12-11/) 称,Altma…- 0

- 0

-

Anthropic一夜震撼升级:Claude获得「永久记忆」!全球打工人变天

搅翻整个硅谷的Anthropic,继续甩出新的核弹。就在今天,消息人士爆出:Anthropic正在给Claude Cowork重磅升级,知识库注入永久记忆!也就是说,从此Claude将不再是金鱼记忆,在它的「永存大脑」中,它将开始自动记住一切。从此,Claude将不再是个聊天机器人,这种永久记忆模式的Cowork模式,将会彻底颠覆AI办公革命!此外,Cowork模式将与Chat模式合并,并成为Cl…- 0

- 0

-

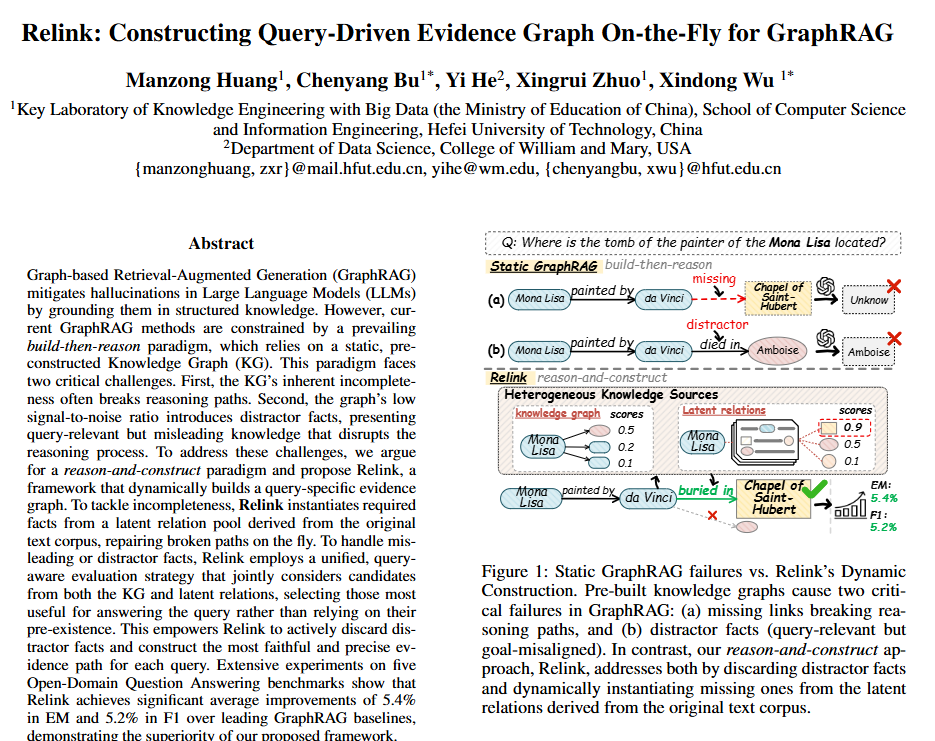

Relink:动态构建查询导向的知识图谱推理框架,新一代 GraphRAG

Graph-based Retrieval-Augmented Generation: Relink Framework文章摘要针对大语言模型幻觉问题,现有GraphRAG方法依赖静态知识图谱,面临知识不完整和干扰事实两大挑战。本文提出Relink框架,突破传统"先构建后推理"范式,采用"边推理边构建"策略,动态生成查询专属证据图谱,在五个开放域问答基准上实…- 0

- 0

-

【解密源码】WeKnora 文档切分与 Chunk 构建解析:腾讯生产级 RAG 的底层设计

引言WeKnora 是腾讯开源的一套生产级 RAG 框架,定位非常明确:解决真实业务场景下“文档复杂、类型多样、规模可控但质量要求极高”的知识增强问题。社区中有人将其视为 ima 的开源实现之一,虽然这一说法无从官方考证,但可以确定的是,WeKnora 在工程完整度、边界处理和异常降级策略上,是一套经过实战打磨的系统方案。从文档接入、解析、切分、向量化、多模态增强,到知识图谱、…- 0

- 0

-

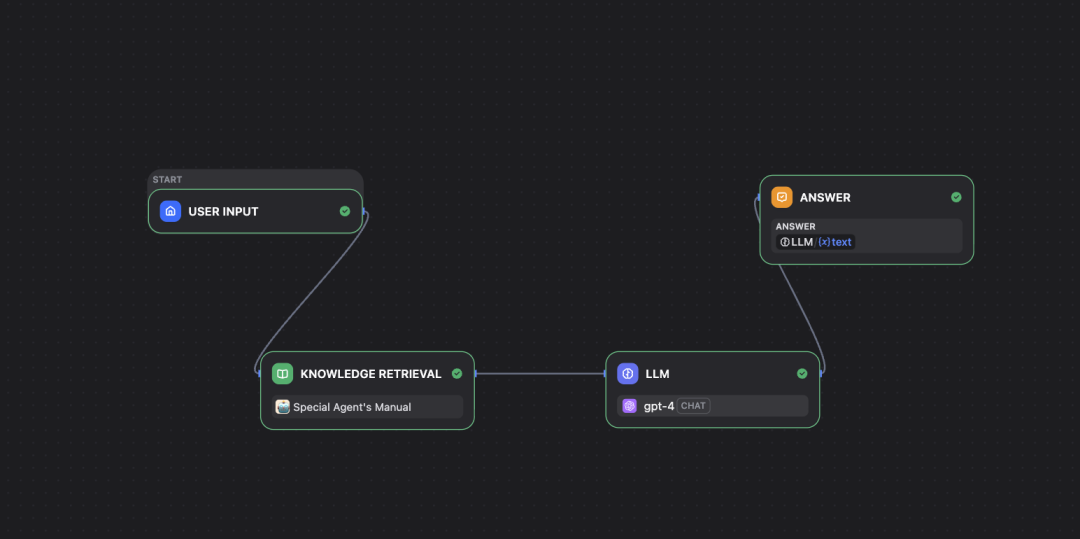

Dify 外部知识库最佳实践:基于 InfraNodus 扩展 RAG 图谱能力

dify 的外部知识库功能支持对接第三方知识系统,无需迁移数据即可使用专业的检索技术。本文将介绍如何把 InfraNodus(一个内置 GraphRAG 能力的文本网络分析工具)接入 Dify 工作流。为什么选择 InfraNodus?传统 RAG 依赖向量相似度搜索,处理具体问题时表现不错,但面对宽泛的问题往往力不从心。比如用户问“这个是用来做什么的?”,标准 RAG 很可能检索不到任何内容,或…- 0

- 0

❯

购物车

优惠劵

搜索

扫码打开当前页

联系我们

返回顶部

幸运之星正在降临...

点击领取今天的签到奖励!

恭喜!您今天获得了{{mission.data.mission.credit}}积分

我的优惠劵

-

¥优惠劵使用时效:无法使用使用时效:

之前

使用时效:永久有效优惠劵ID:×

没有优惠劵可用!