-

Chonkie:开源、轻量、极速的 RAG 分块神器 🦛

在不断扩展的大模型上下文里,分块不仅是技术需求,更是确保模型效率的关键手段。然而,面对大部分冗杂的分块工具,不少开发者需要更直接、更有效的解决方案。这时,Chonkie — 一款专为分块任务设计的轻量工具 — 应运而生,成为了 RAG 应用开发中的绝佳帮手。为什么需要分块?随着语言模型能够处理的上下文不断增加,在提供丰富上下文的同时也带来了计算速度与内存开销的挑战。通过分块,…- 6

- 0

-

Chonkie:开源、轻量、极速的 RAG 分块神器 🦛

在不断扩展的大模型上下文里,分块不仅是技术需求,更是确保模型效率的关键手段。然而,面对大部分冗杂的分块工具,不少开发者需要更直接、更有效的解决方案。这时,Chonkie — 一款专为分块任务设计的轻量工具 — 应运而生,成为了 RAG 应用开发中的绝佳帮手。为什么需要分块?随着语言模型能够处理的上下文不断增加,在提供丰富上下文的同时也带来了计算速度与内存开销的挑战。通过分块,…- 4

- 0

-

Chonkie:开源、轻量、极速的 RAG 分块神器 🦛

在不断扩展的大模型上下文里,分块不仅是技术需求,更是确保模型效率的关键手段。然而,面对大部分冗杂的分块工具,不少开发者需要更直接、更有效的解决方案。这时,Chonkie — 一款专为分块任务设计的轻量工具 — 应运而生,成为了 RAG 应用开发中的绝佳帮手。为什么需要分块?随着语言模型能够处理的上下文不断增加,在提供丰富上下文的同时也带来了计算速度与内存开销的挑战。通过分块,…- 4

- 0

-

精准与效率:RAG应用PDF文档图文提取OCR策略

在RAG应用中通常需要对各种文档进行文本提取,如果稳定是纯文本那文档提取会简单很多,但通常文档中会存在各种图片信息,这时就需要使用OCR在提取文档文本信息的同时对图片进行OCR获取图片中的文本内容。本文只介绍PDF文档中OCR技术方案。PDF文档解析目前有不少开源框架亦可支持对PDF中的图片进行OCR,但此类框架通常比较重如Marker、Unstructured等。 这里只使用PyMuPD…- 5

- 0

-

Chonkie:开源、轻量、极速的 RAG 分块神器 🦛

在不断扩展的大模型上下文里,分块不仅是技术需求,更是确保模型效率的关键手段。然而,面对大部分冗杂的分块工具,不少开发者需要更直接、更有效的解决方案。这时,Chonkie — 一款专为分块任务设计的轻量工具 — 应运而生,成为了 RAG 应用开发中的绝佳帮手。为什么需要分块?随着语言模型能够处理的上下文不断增加,在提供丰富上下文的同时也带来了计算速度与内存开销的挑战。通过分块,…- 3

- 0

-

Chonkie:开源、轻量、极速的 RAG 分块神器 🦛

在不断扩展的大模型上下文里,分块不仅是技术需求,更是确保模型效率的关键手段。然而,面对大部分冗杂的分块工具,不少开发者需要更直接、更有效的解决方案。这时,Chonkie — 一款专为分块任务设计的轻量工具 — 应运而生,成为了 RAG 应用开发中的绝佳帮手。为什么需要分块?随着语言模型能够处理的上下文不断增加,在提供丰富上下文的同时也带来了计算速度与内存开销的挑战。通过分块,…- 6

- 0

-

Chonkie:开源、轻量、极速的 RAG 分块神器 🦛

在不断扩展的大模型上下文里,分块不仅是技术需求,更是确保模型效率的关键手段。然而,面对大部分冗杂的分块工具,不少开发者需要更直接、更有效的解决方案。这时,Chonkie — 一款专为分块任务设计的轻量工具 — 应运而生,成为了 RAG 应用开发中的绝佳帮手。为什么需要分块?随着语言模型能够处理的上下文不断增加,在提供丰富上下文的同时也带来了计算速度与内存开销的挑战。通过分块,…- 2

- 0

-

Chonkie:开源、轻量、极速的 RAG 分块神器 🦛

在不断扩展的大模型上下文里,分块不仅是技术需求,更是确保模型效率的关键手段。然而,面对大部分冗杂的分块工具,不少开发者需要更直接、更有效的解决方案。这时,Chonkie — 一款专为分块任务设计的轻量工具 — 应运而生,成为了 RAG 应用开发中的绝佳帮手。为什么需要分块?随着语言模型能够处理的上下文不断增加,在提供丰富上下文的同时也带来了计算速度与内存开销的挑战。通过分块,…- 6

- 0

-

聊聊Dify如何集成Milvus向量库做RAG

概述 在dify集成Milvus向量库,做RAG知识库的存储与检索。 Dify[1]是一个开源平台,旨在通过将 Backend-as-a-Service 与 LLMOps 相结合来简化人工智能应用程序的构建。它支持主流 LLMs,提供直观的提示协调界面、高质量的 RAG 引擎和灵活的 AI Agents 框架。凭借低代码工作流、易用的界面和 API,Dify 使开发人员和非技术用户都能专注于创建创…- 8

- 0

-

Chonkie:开源、轻量、极速的 RAG 分块神器 🦛

在不断扩展的大模型上下文里,分块不仅是技术需求,更是确保模型效率的关键手段。然而,面对大部分冗杂的分块工具,不少开发者需要更直接、更有效的解决方案。这时,Chonkie — 一款专为分块任务设计的轻量工具 — 应运而生,成为了 RAG 应用开发中的绝佳帮手。为什么需要分块?随着语言模型能够处理的上下文不断增加,在提供丰富上下文的同时也带来了计算速度与内存开销的挑战。通过分块,…- 4

- 0

-

Chonkie:开源、轻量、极速的 RAG 分块神器 🦛

在不断扩展的大模型上下文里,分块不仅是技术需求,更是确保模型效率的关键手段。然而,面对大部分冗杂的分块工具,不少开发者需要更直接、更有效的解决方案。这时,Chonkie — 一款专为分块任务设计的轻量工具 — 应运而生,成为了 RAG 应用开发中的绝佳帮手。为什么需要分块?随着语言模型能够处理的上下文不断增加,在提供丰富上下文的同时也带来了计算速度与内存开销的挑战。通过分块,…- 5

- 0

-

Chonkie:开源、轻量、极速的 RAG 分块神器 🦛

在不断扩展的大模型上下文里,分块不仅是技术需求,更是确保模型效率的关键手段。然而,面对大部分冗杂的分块工具,不少开发者需要更直接、更有效的解决方案。这时,Chonkie — 一款专为分块任务设计的轻量工具 — 应运而生,成为了 RAG 应用开发中的绝佳帮手。为什么需要分块?随着语言模型能够处理的上下文不断增加,在提供丰富上下文的同时也带来了计算速度与内存开销的挑战。通过分块,…- 5

- 0

-

Chonkie:开源、轻量、极速的 RAG 分块神器 🦛

在不断扩展的大模型上下文里,分块不仅是技术需求,更是确保模型效率的关键手段。然而,面对大部分冗杂的分块工具,不少开发者需要更直接、更有效的解决方案。这时,Chonkie — 一款专为分块任务设计的轻量工具 — 应运而生,成为了 RAG 应用开发中的绝佳帮手。为什么需要分块?随着语言模型能够处理的上下文不断增加,在提供丰富上下文的同时也带来了计算速度与内存开销的挑战。通过分块,…- 4

- 0

-

RAG + Claude的1TB大文档问答系统实战操作

最近我和一个律师亲戚聊AI时,问了我应该怎么对现在律师事务所庞大的文档做AI检索,从技术上讲用现在的LLM+RAG可以满足需求,但细想不太对劲,因为这里面涉及到很多专业知识,还有律师的专有思维路径,一个不懂律师业务的程序员肯定是做不好的,于是有幸跟他们合伙人进行了深入沟通,合伙人说了一堆但我总结下来就这么一句话 “一个能回答我们所有文档相关问题的工具”。 比如:1)描述法庭上发生的事件,2)提…- 6

- 0

-

Chonkie:开源、轻量、极速的 RAG 分块神器 🦛

在不断扩展的大模型上下文里,分块不仅是技术需求,更是确保模型效率的关键手段。然而,面对大部分冗杂的分块工具,不少开发者需要更直接、更有效的解决方案。这时,Chonkie — 一款专为分块任务设计的轻量工具 — 应运而生,成为了 RAG 应用开发中的绝佳帮手。为什么需要分块?随着语言模型能够处理的上下文不断增加,在提供丰富上下文的同时也带来了计算速度与内存开销的挑战。通过分块,…- 3

- 0

-

RAG召回质量翻倍的两个核心技术:我是这样解决”找不准”问题的

最近在优化公司的知识问答系统时,遇到了一个让人头疼的问题:明明知识库里有相关内容,但LLM总是回答"我不知道"或者答非所问。经过深入分析发现,问题出在RAG的召回环节——检索到的文档片段要么不够相关,要么上下文支离破碎。 经过一番折腾,我找到了两个特别有效的解决方案:索引扩展和Small-to-Big策略。今天就来分享一下这两个技术的原理和具体实现,希望能帮到有同样困扰的朋友。…- 5

- 0

-

Chonkie:开源、轻量、极速的 RAG 分块神器 🦛

在不断扩展的大模型上下文里,分块不仅是技术需求,更是确保模型效率的关键手段。然而,面对大部分冗杂的分块工具,不少开发者需要更直接、更有效的解决方案。这时,Chonkie — 一款专为分块任务设计的轻量工具 — 应运而生,成为了 RAG 应用开发中的绝佳帮手。为什么需要分块?随着语言模型能够处理的上下文不断增加,在提供丰富上下文的同时也带来了计算速度与内存开销的挑战。通过分块,…- 2

- 0

-

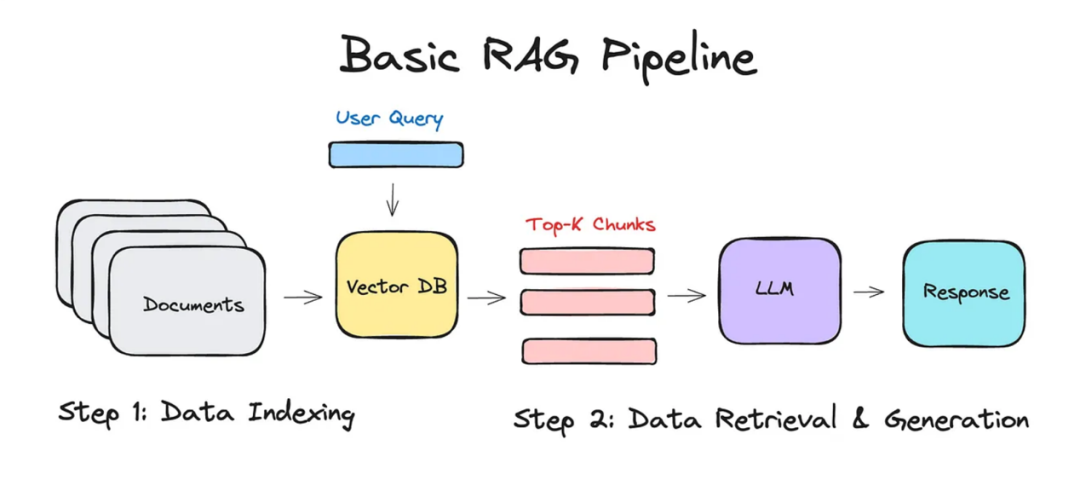

测试不同的RAG技术以找到最佳方案

点击“蓝字” 关注我们检索增强生成(RAG)技术通过结合大型语言模型(LLMs)与外部数据检索能力,能够提供准确且富含上下文的答案。无论是构建客户支持聊天机器人还是研究助手,RAG都能通过从数据库中提取相关信息来增强AI的性能。然而,不同的RAG技术在性能上存在差异,选择最佳技术需要进行测试。本文将全面探讨各类RAG技术,包括基础方法和高级手段,并对它们进行评估,以帮助您根据需求选择最合适的技术。…- 4

- 0

-

Chonkie:开源、轻量、极速的 RAG 分块神器 🦛

在不断扩展的大模型上下文里,分块不仅是技术需求,更是确保模型效率的关键手段。然而,面对大部分冗杂的分块工具,不少开发者需要更直接、更有效的解决方案。这时,Chonkie — 一款专为分块任务设计的轻量工具 — 应运而生,成为了 RAG 应用开发中的绝佳帮手。为什么需要分块?随着语言模型能够处理的上下文不断增加,在提供丰富上下文的同时也带来了计算速度与内存开销的挑战。通过分块,…- 4

- 0

-

Chonkie:开源、轻量、极速的 RAG 分块神器 🦛

在不断扩展的大模型上下文里,分块不仅是技术需求,更是确保模型效率的关键手段。然而,面对大部分冗杂的分块工具,不少开发者需要更直接、更有效的解决方案。这时,Chonkie — 一款专为分块任务设计的轻量工具 — 应运而生,成为了 RAG 应用开发中的绝佳帮手。为什么需要分块?随着语言模型能够处理的上下文不断增加,在提供丰富上下文的同时也带来了计算速度与内存开销的挑战。通过分块,…- 3

- 0

-

Chonkie:开源、轻量、极速的 RAG 分块神器 🦛

在不断扩展的大模型上下文里,分块不仅是技术需求,更是确保模型效率的关键手段。然而,面对大部分冗杂的分块工具,不少开发者需要更直接、更有效的解决方案。这时,Chonkie — 一款专为分块任务设计的轻量工具 — 应运而生,成为了 RAG 应用开发中的绝佳帮手。为什么需要分块?随着语言模型能够处理的上下文不断增加,在提供丰富上下文的同时也带来了计算速度与内存开销的挑战。通过分块,…- 2

- 0

-

Spring AI + Milvus 实现 RAG 智能问答实战

引言 “公司的文档太多,查找信息太慢!”、“客服回答总是千篇一律,不能精准解答用户问题!” —— 这些痛点背后,是传统关键词搜索和规则引擎的局限。如今,语义搜索(Semantic Search) 和 检索增强生成(Retrieval-Augmented Generation, RAG) 正成为解决这些问题的利器。它们能让应用“理解”用户问题的真正意图,并从海量资料中精准找出相关信息,甚至生成自然流…- 6

- 0

-

Chonkie:开源、轻量、极速的 RAG 分块神器 🦛

在不断扩展的大模型上下文里,分块不仅是技术需求,更是确保模型效率的关键手段。然而,面对大部分冗杂的分块工具,不少开发者需要更直接、更有效的解决方案。这时,Chonkie — 一款专为分块任务设计的轻量工具 — 应运而生,成为了 RAG 应用开发中的绝佳帮手。为什么需要分块?随着语言模型能够处理的上下文不断增加,在提供丰富上下文的同时也带来了计算速度与内存开销的挑战。通过分块,…- 4

- 0

-

Chonkie:开源、轻量、极速的 RAG 分块神器 🦛

在不断扩展的大模型上下文里,分块不仅是技术需求,更是确保模型效率的关键手段。然而,面对大部分冗杂的分块工具,不少开发者需要更直接、更有效的解决方案。这时,Chonkie — 一款专为分块任务设计的轻量工具 — 应运而生,成为了 RAG 应用开发中的绝佳帮手。为什么需要分块?随着语言模型能够处理的上下文不断增加,在提供丰富上下文的同时也带来了计算速度与内存开销的挑战。通过分块,…- 4

- 0

❯

购物车

优惠劵

搜索

扫码打开当前页

联系我们

返回顶部

幸运之星正在降临...

点击领取今天的签到奖励!

恭喜!您今天获得了{{mission.data.mission.credit}}积分

我的优惠劵

-

¥优惠劵使用时效:无法使用使用时效:

之前

使用时效:永久有效优惠劵ID:×

没有优惠劵可用!