-

本地部署大模型实现扫描版 PDF 文件 OCR 识别,笔记本可跑

在使用大模型处理书籍 PDF 时,有时你会遇到扫描版 PDF,也就是说每一页其实是图像形式。这时,大模型需要先从图片中提取文本,而这就需要借助 OCR(光学字符识别)技术。像 Gemini 2.5 这样的强大模型,具备非常强的从图片中提取文本的能力。实际上,我们完全可以利用它来执行 OCR 任务。利用这样的大模型进行&…- 7

- 0

-

Seedream 3.0 文生图模型技术报告发布

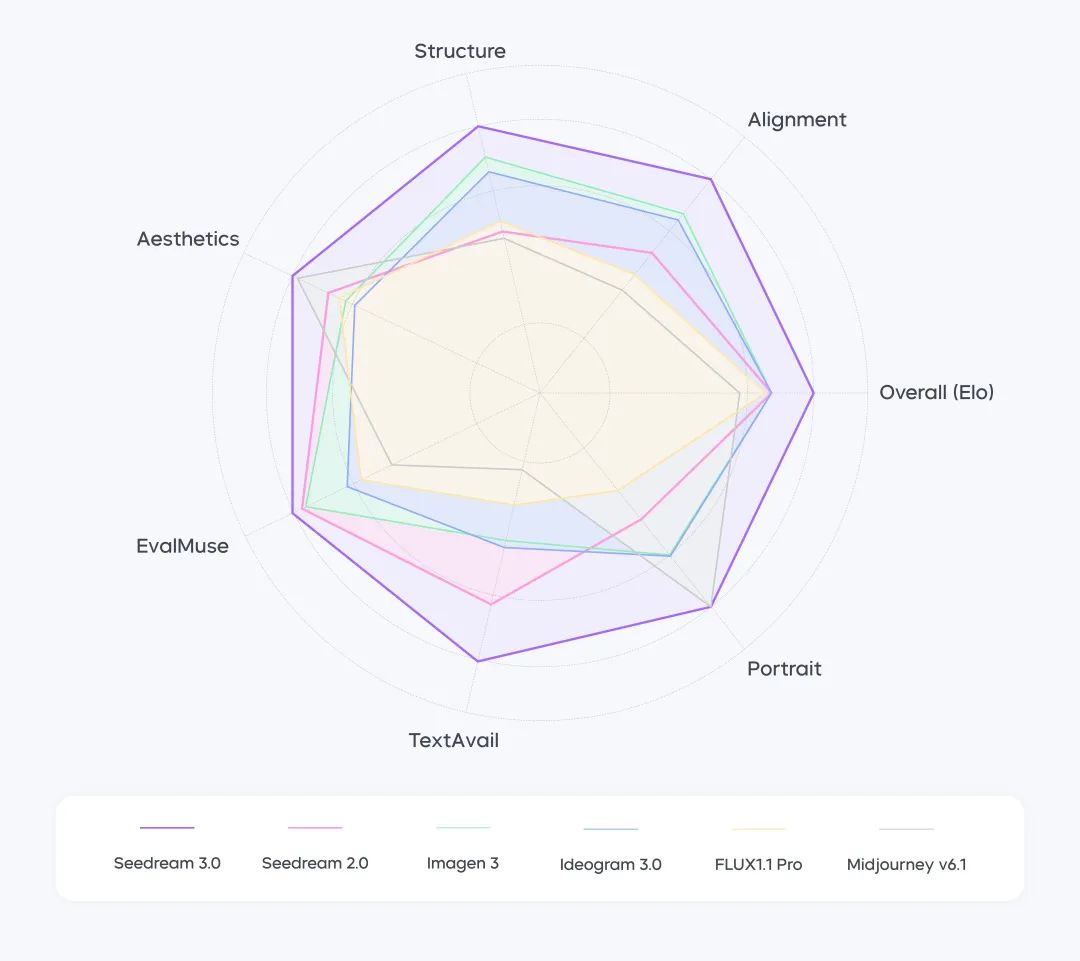

字节跳动 Seed 团队正式发布 Seedream 3.0 技术报告。Seedream 3.0 是一个原生高分辨率、支持中英双语的图像生成基础模型,对比 Seedream 2.0,这一版本的整体性能表现有较大提升,尤其在分辨率、生图结构准确性、数量准确性、多物体属性关系、小字生成与排版、美感效果、真实度等方面有所突破。具体亮点如下:原生 2K 直出,适配多比例场景:无需后处理可直接输出 2K 分辨…- 8

- 0

-

一口气讲清楚:向量库、训练集、多模态

这是“一口气讲清楚”AI系列第三篇文章。前面两篇文章,分别介绍了AGI、RAG、AIGC、LLM、MCP、EMB这六个在AI大模型领域的核心术语。想要真正了解AI大模型及各种工具的特点和原理,离不开这六个专业术语。但如果想要进一步深入理解大模型的实现原理和当前阶段的大模型特性,就需要进一步了解它的训练过程,那这个时候就离不开这三个专业术语:向量库、训练集、多模态。这篇文章,我会尽量用通俗易懂的语言…- 5

- 0

-

豆包深度思考模型正式发布!和 o3 一样能「看图思考」,还有一个 Agent 大招

这两个月,AI 模型和产品的发布节奏用「日新月异」都不足以形容了。GPT-4o 生图的爆火似乎还是昨天,OpenAI 放出了自家最强推理模型 o3 和 o4 mini,但这可能还不是这个月最重磅的 AI 发布,DeepSeek R2、Anthropic 的 Claude 4 以及马斯克剧透的「Grok-3.5」 ,极有可能将在本月陆续发布。而且就在今天,字节还发布了一整套 AI 全家桶,深度思考模…- 7

- 0

-

刚刚,o4-mini发布!OpenAI史上最强、最智能模型

今天凌晨1点,OpenAI进行了技术直播,发布了最强、最智能模型o4-mini和满血版o3。o4-mini和o3是两款多模态模型,能同时处理文本、图像和音频,并且能作为Agent智能体自动调用网络搜索、图像生成、代码解析等工具以及深度思考模式(思维链中可以思考图像)。根据OpenAI公布的测试数据显示,o4-mini在AIME2024和2025中,分别达到了93.4%和92.7%,比满血版o3还强…- 6

- 0

-

刚刚,OpenAI重磅发布o3和o4-mini多模态推理能力爆炸式提升!!!

提示词https://openai.com/index/thinking-with-images/ 将这个网页里面的内容输出为一篇图文并貌的微信公众号推文。2025年4月16日,OpenAI发布了其最新的人工智能模型o3和o4-mini,这两款模型在视觉推理领域取得了突破性进展。据OpenAI介绍,这些模型不仅能够“看到”图像,还能在推理链中“思考”图像,显著提升了处理视觉信息的能力。…- 4

- 0

-

OpenAI o3 和 o4-mini 多模态推理新模型重磅来袭

就在刚刚,OpenAI 发布了其 o 系列模型的最新成员 o3 和 o4-mini,这两款模型被认为是 OpenAI 迄今为止最智能的模型。它们经过训练后能够在做出反应前进行更长时间的思考,并且首次具备智能地使用和组合 ChatGPT 的所有工具的能力,包括网页搜索、Python 分析、视觉推理和图像生成。模型能够自主判断何时以及如何使用这些工具,从而以正确的格式生成详细且周到…- 10

- 0

-

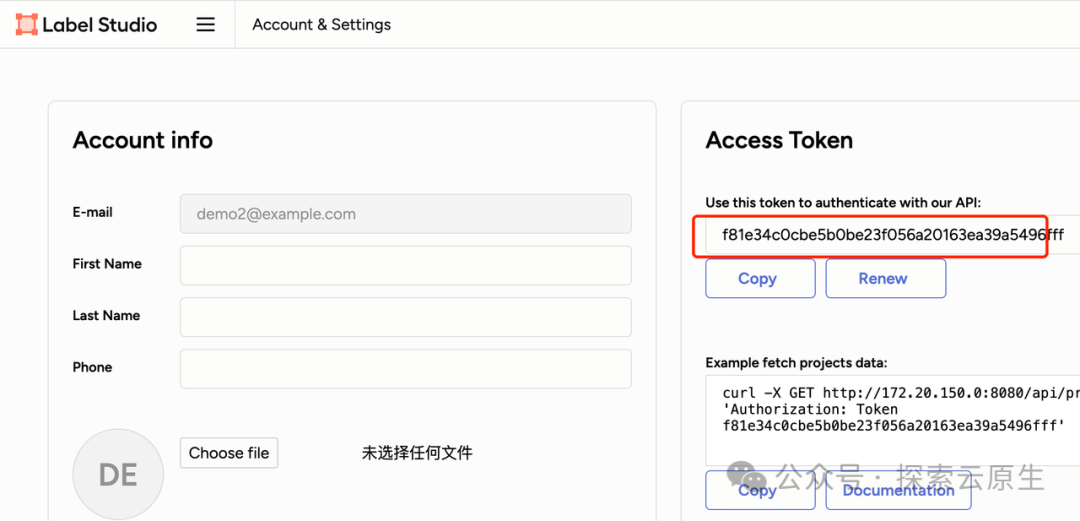

解放双手!LabelStudio 智能标注实战

LabelStudio 中使用智能标注(预标注)的大致流程如下:1)准备模型部署2)模型服务接入 LabelStudio3)配置标注模板时特殊处理4)开始智能标注ps:这里说的预标注/自动标签/智能标注都是指:让 ML/AI 模型自主预测标签,然后人工进行审查。智能标注流程:1)用户打开任务2)Label Studio 将请求发送到 ML 后端3)ML 后端执行预测并返回结果4)预测被加载到 La…- 2

- 0

-

Seedream 3.0 文生图模型技术报告发布

字节跳动 Seed 团队正式发布 Seedream 3.0 技术报告。Seedream 3.0 是一个原生高分辨率、支持中英双语的图像生成基础模型,对比 Seedream 2.0,这一版本的整体性能表现有较大提升,尤其在分辨率、生图结构准确性、数量准确性、多物体属性关系、小字生成与排版、美感效果、真实度等方面有所突破。具体亮点如下:原生 2K 直出,适配多比例场景:无需后处理可直接输出 2K 分辨…- 10

- 0

-

DupDub 插件登陆 Dify Marketplace,带来强大的音频 AI 能力

我们很高兴地宣布,DupDub 的一系列强大音频 AI 插件现已上架 dify Marketplace。通过此次集成,用户可在 Dify 平台中直接使用先进功能,如语音转写、语音克隆、说话人识别以及文本转语音合成等,帮助大家构建更多元、更具可及性和互动性的 AI 应用。Dify Marketplace:推动 AI 创新的新引擎自 Dify v1.0.0 发布以来,我们的 Marketplace 生…- 6

- 0

-

Google Gemini 2.0 网页抓取真丝滑

网页抓取从未如此简单——这一切都要归功于谷歌突破性的多模态实时APIGemini 2.0借助这个工具,你可以毫不费力地从任何网页提取数据,无论页面结构多么复杂、内容多么杂乱无章,或是需要提取非常特定的信息。今天,我将通过自己实操的两个案例,手把手带你体验整个流程。即使你是个完全的新手,也能很快掌握这项技能。准备工作:配置Google AI Studio在进入案例演示前,先完成基础设置:访问Goog…- 6

- 0

-

关于 GTP-4o 图片生成的10个赚钱方向

聊一聊 GPT-4o 可能带来的赚钱机遇。1、吉卜力图片生成GPT-4o 生图功能升级以来,吉卜力动画火爆网络,你可以利用 ChatGPT 帮别人生成各种吉卜力动画效果的图片。2、英语闪卡找到一本家长们都在让孩子学的单词书或者动画片用Gemini提取单词 然后给GPT4o来制作就可以快速做出类似的卡片 可以做成可以剪裁的正反版本然后卖打印即可也可以基于这个思路,做Gemini OCR扫…- 6

- 0

-

Gemma3+Mistral-OCR+RAG:实现多模态文档问答系统

我在这个项目中使用 Gemma3 + Mistral OCR + RAG 创建了一个能够支持包含表格、发票、文本和图表的多模态 PDF 文档问答系统。等你看完这篇文章后,你会明白是什么让 Mistral OCR 和 Gemma 3 与众不同,Gemma 3 是如何训练的,以及我们如何利用 Gemma 3、Mistral-OCR 和 RAG 创建一个强大的多模态文档问答系统。首先看一下我们…- 4

- 0

-

成功率提高7倍!新方法一句话就能让AI秒出分子设计+合成步骤

寻找具备研发新药物和新材料所需特性分子的过程既繁琐又昂贵,需要耗费大量计算资源,研究人员往往要花费数月时间,才能在浩如烟海的候选分子中筛选出数量有限的目标分子。像 ChatGPT 这样的大语言模型有望简化这一流程,然而,让大语言模型像理解句子中的单词那样理解和推理构成分子的原子与化学键却存在技术壁垒。近期,麻省理工学院和 MIT-IBM 沃森人工智能实验室的研究人员开发出一种颇具前景的方法,利用基…- 8

- 0

-

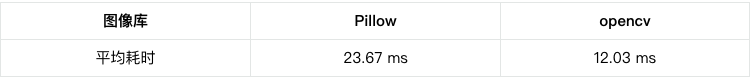

多模态视觉理解大模型推理优化

01 背景大模型时代是人工智能领域的一个重要发展阶段,在当今人工智能研究领域,基于Transformer架构的多模态视觉理解大模型(VLM)在全世界范围内引发了深度的技术关注。多模态视觉理解大模型的主要创新在于将语言和视觉两种模态进行有效的对齐,使其不仅能够进行基本的图像识别,还能执行基于视觉输入的动态内容推理和复杂问题解答。可以应用在房内家具家电识别、涉黄涉爆检测、商家店铺…- 5

- 0

-

99%的人不知道Claude的一句话生成SVG图片功能

零基础一句话学会使用Claude 3.7生成SVG图片有嘴就行。接下来直接上实例加口活儿,由简到难,一次教会。首先直接来一组简单的:一张SVG图片上包含以下8种团SVG模板及提示词基础图标模板提示词: "创建一个圆角矩形图标,填充蓝色,中心放置白色文本,适合作为应用按钮或功能标识"圆形进度条模板提示词: "设计一个圆形进度指示器,显示75%的完成度,使用绿色表示进度,…- 5

- 0

-

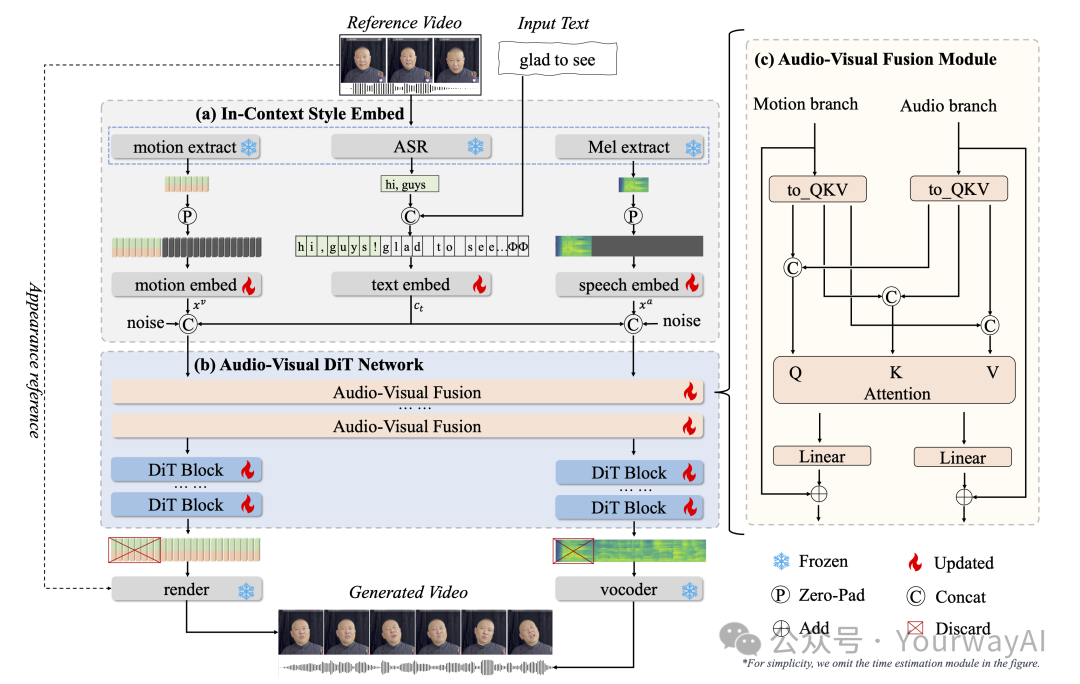

阿里OmniTalker震撼发布!0.8B参数实现25FPS实时音视频生成,跨语言情感表达精准同步

导语:数字人技术迎来重大突破!阿里通义实验室最新推出的OmniTalker,是全球首个端到端的文本驱动说话人视频生成系统。仅需单段参考视频,即可实现中英文零样本风格复刻,支持愤怒、快乐等6种情感表达,25帧/秒的实时生成速度重新定义人机交互体验。本文将深度解析其双分支Diffusion Transformer架构,并展示如何用一句话生成演讲视频!正文:1. 技术颠覆性突破• …- 8

- 0

-

字节超快超强声音克隆 MegaTTS3, 声音克隆几乎一模一样, 可跨语言克隆.

ComfyUI 的 MegaTTS3 声音克隆节点https://github.com/billwuhao/ComfyUI_MegaTTS3声音克隆质量非常高, 支持中英文, 并可跨语言克隆.? 更新[2025-04-06]⚒️: 发布 v1.0.0.安装cd ComfyUI/custom_nodesgit clone https://github.com/billw…- 9

- 0

-

这可能是目前最强的TTS,10秒复刻你的声音

怪怪的TTS前段时间,我把公众号的作者音色朗读给关了。虽然听起来是我的声音,但总感觉怪怪的,比如蹩脚的英文发音,莫名其妙的停顿,以及偶尔给你来个突兀的语调变化。有时候我自己开车听文章,都会被吓得一激灵。我不禁在思考:这是我吗?索性,干脆就关了。直到最近,我体验到另一个TTS(Text-To-Speech,文本转语音)模型,这才改变我对AI配音的看法。这是我随手生成的片段,现在已经这么强了吗?停顿、…- 1

- 0

-

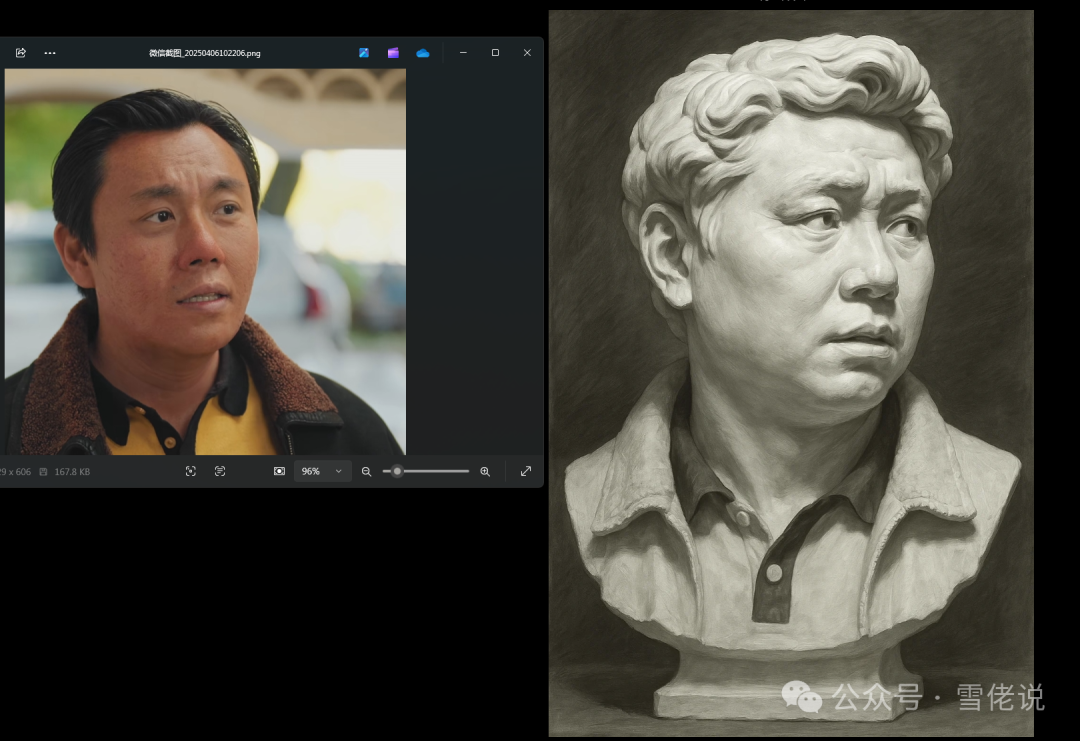

简单粗暴,4O终极魔法,这才是主体库的最终形态

写在前面:全文不到1000字,脑洞巨大。大家好,这里是有梗、有料、有干货的雪佬说,我是雪佬。有日子没更新了,最近雪佬一直在研究sora,当然,不是视频(我不会说它拉跨),没错,文生图,你没猜错。我个人感觉,这个才是主体库的最终形态,因为,实在是,太 好 用 了!此句必须加个感叹号。先看一张图,高端的图,往往需要最简单的烹饪方式,啊呸,不对,最简…- 6

- 0

-

环境有限?没条件用一步到位的高端AI?AI内容深加工/平民AI高端玩法:AI生成各种图、视频、音频、文档、可视化图表、程序等等等

没条件用一步到位的高端AI?别担心!通过和专业工具结合,也能实现动动嘴皮子,用AI生成各种内容形式!比如各种图(功能型:流程图、结构图、思维导图;艺术类:数字绘画、风格迁移、商业设计;专业向:工程制图、矢量插图、漫画创作)、各种视频(制作类:动画、实拍合成、教育、商业视频;技术向:智能剪辑、特效合成、字幕生成)、各种音频(语音类:语音合成、语音克隆;音乐类:智能编曲、场景配乐)、各种文档(办公类:…- 2

- 0

-

Llama 4首测:Mac狂飙2万亿,多模态惊艳代码翻车!

Meta今天凌晨发布的Llama 4系列模型代表了AI领域的重大突破,首次采用混合专家(MoE)架构并原生支持多模态能力,为开源模型社区带来新的发展方向。本报告深入分析了Llama 4的三款模型规格、在苹果Silicon芯片上的性能表现、成本效益优势、本地部署可能性以及其代码生成能力的短板。值得注意的是,首批测试数据显示,三台M3 Ultra Mac可协同运行参数量达2万亿的Llama 4 Beh…- 9

- 0

-

Llama 4全网首测来袭,3台Mac狂飙2万亿!多模态惊艳代码却翻车

一共三款模型,首次采用MoE架构,开启了原生多模态的Llama时代!Llama 4 Scout,激活17B,16个专家,109B参数;Llama 4 Maverick,激活17B,128个专家,402B参数;Llama 4 Behemoth,激活288B,16个专家,2T参数。Llama 4发布后排名瞬间跃升,甚至超过了DeepSeek-V3,Meta再一次回到牌桌。业界首个1000万上下文,RA…- 9

- 0

❯

购物车

优惠劵

搜索

扫码打开当前页

联系我们

返回顶部

幸运之星正在降临...

点击领取今天的签到奖励!

恭喜!您今天获得了{{mission.data.mission.credit}}积分

我的优惠劵

-

¥优惠劵使用时效:无法使用使用时效:

之前

使用时效:永久有效优惠劵ID:×

没有优惠劵可用!