-

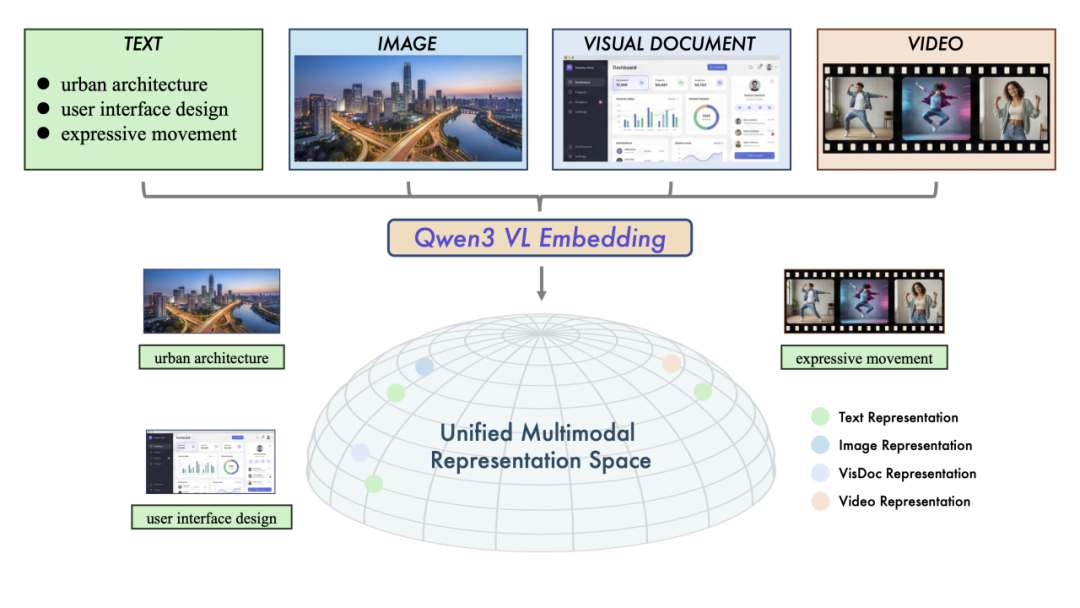

Qwen3-VL-Embedding系列上新:探索统一多模态表征与排序

2025年6月,我们开源了面向文本的Qwen3-Embedding和Qwen3-ReRanker 模型系列,在多语言文本检索、聚类和分类等多项下游任务中取得了业界领先的性能,被社区开发者广泛使用。 今天,我们非常荣幸地推出Qwen家族的最新成员:Qwen3-VL-Embedding和Qwen3-VL-Reranker模型系列。这些模型基于我们最近开源的Qwen3-VL模型构建,专为多模态信息检索和…- 0

- 0

-

NVIDIA Audio2Face-3D 实时语音驱动面部动画最新部署指南

先分享一下利用昨天集成的数字人口播视频模块做了一个孙悟空唱自己一生的视频,也是之前抖音上很火的一个形态。看看效果:整个过程在我3070电脑上跑了10分钟,效果还可以,就是由于素材的原因,脸部容易动。上述工作流是:Nano bananer生成图片,grok将图片动起来,然后gemini生成歌词,suno生成音乐。然后利用数字人口播视频模块生成上述视频。因为suno和生口播数字人的平台都是按时长收费的…- 0

- 0

-

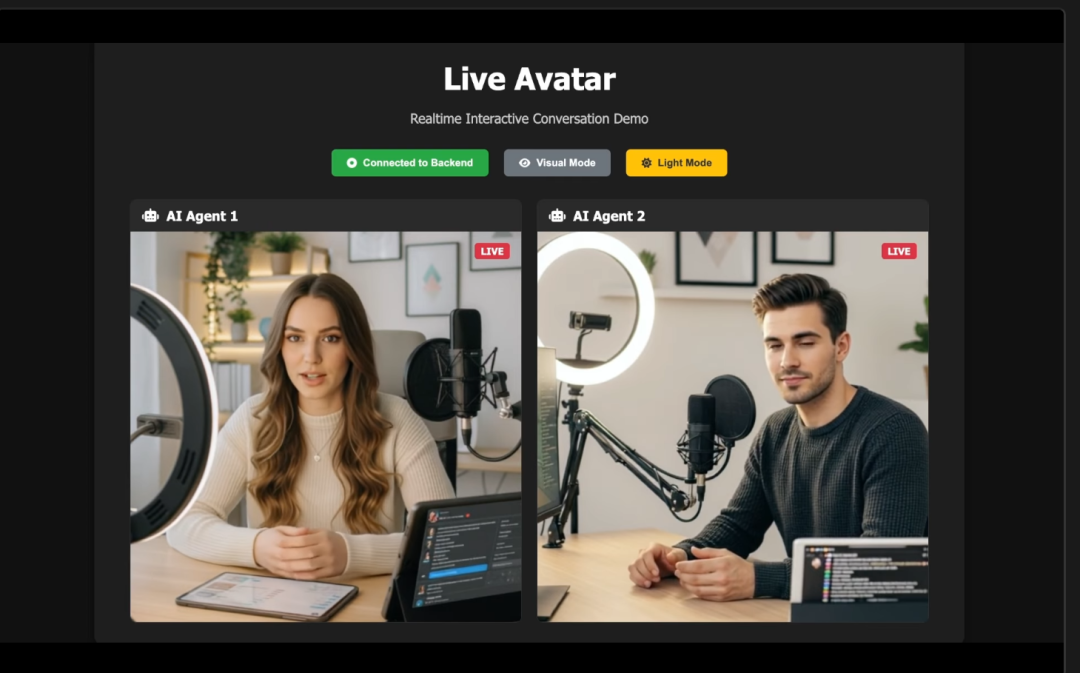

阿里突然开源Live Avatar!虚拟人进入“无限续帧时代”

过去一年,AI 视频生成的战场上,大家都在追逐“更逼真、更像真人”的短视频效果。但阿里联合多所高校开源的 Live Avatar,却悄悄把方向盘打向了另一个维度:不是做更好看的视频,而是做“能一直播下去”的虚拟人。这件事的意义,比你想象得大得多。为什么 Live Avatar 是一个时代分水岭?我们先说一句可能会被引用很久的话:Live Avatar 不是一个模型,它是“虚拟人基础设施”…- 0

- 0

-

蓝色光标×火山引擎:用AI实现多模态内容创作自由

生成式 AI 正在深刻改变营销行业,构建多模态内容能力成为提升效率、推动行业发展的关键。作为全球前十的广告营销企业,蓝色光标自2024年起,与火山引擎建立深度合作,围绕 AI 大模型技术在营销场景的落地展开多维度探索。近日,双方进一步深化合作,将火山引擎的 AI 和云计算技术与蓝色光标 BlueAI 应用引擎深度融合,用 AI 重塑营销内容生产模式和服务模式,高效应对营销行业对内容的爆发…- 0

- 0

-

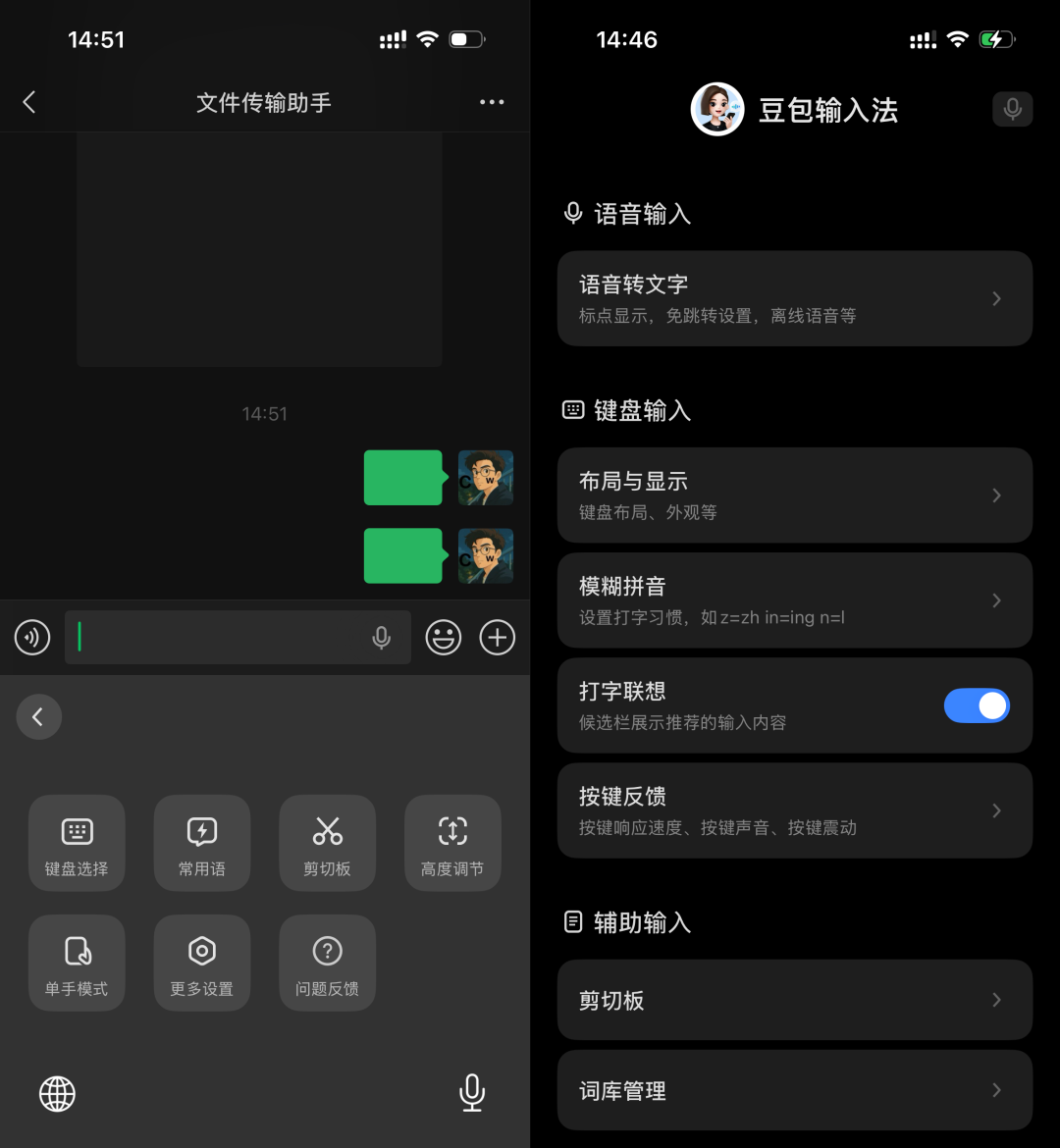

20年过去了,大厂们又开始卷输入法了。

前段时间,字节的豆包输入法正式上线了应用商店。世超也就是手痒,第一时间下回来替大家尝了个鲜。刚打开时我还挺惊讶的,因为软件简洁得有点过分了,不像大厂的产品。目前也只能看到一些输入相关的基础功能,没啥多余的复杂功能,设置页面也挺纯粹,是干嘛的调整啥的很清楚。它的词库联想能力还正常,要说能打败同行的亮点吧,就是它的语音识别,确实能打。又快又准,前脚说完后脚已经识别并修正好了,有时我甚至嘴瓢了它也能纠正…- 0

- 0

-

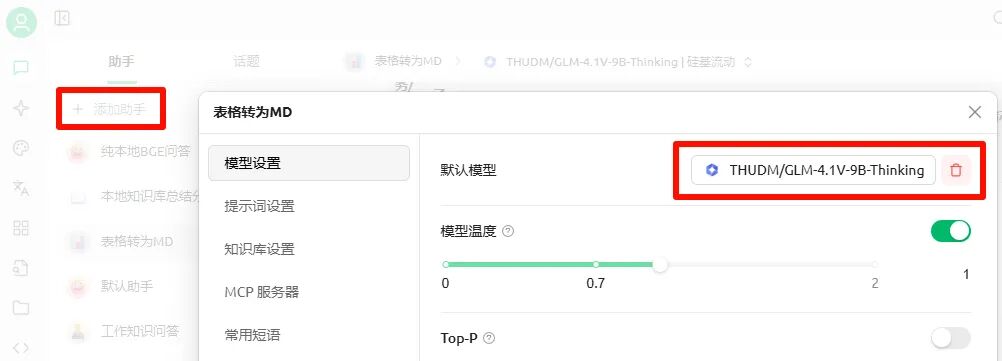

断网条件下使用本机AI助手软件实现Excel表格转换为机器可理解的Markdown格式

在不调用 MCP(Model Context Protocol)服务器或任何外部工具(如 Python 脚本、Azure 服务等)的情况下,仅通过 Prompt 工程来完成 Excel 到 Markdown 的转换,需要选择具备强大 视觉理解(Vision)能力的 多模态大语言模型(Multimodal LLM, MLLM)。不调用MCP工具的原因也是害怕把敏感数据通…- 0

- 0

-

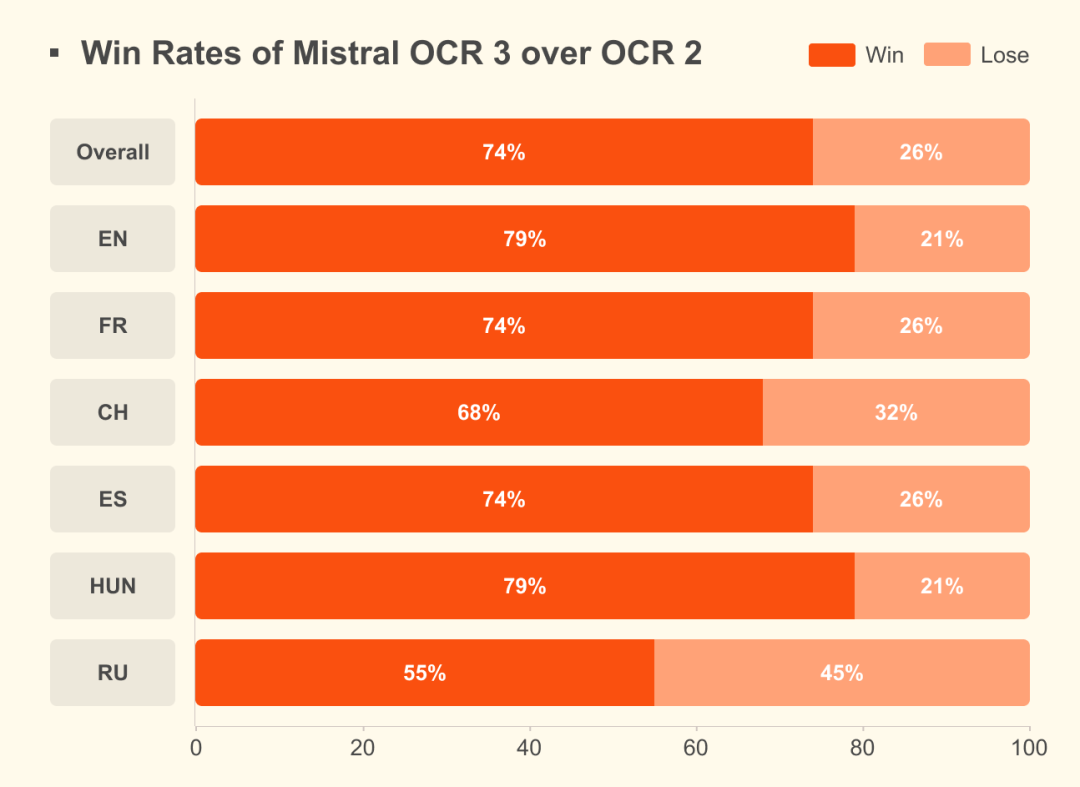

告别表格错行与手写噩梦:Mistral OCR 3 深度解析

本文将深入探讨 Mistral OCR 3 的核心升级、架构逻辑及其在 Document AI 生态中的地位。核心能力:四大维度的精度飞跃Mistral OCR 3 并非简单的增量更新。在针对真实业务场景的内部基准测试中,其综合胜率比前代产品 OCR 2 高出 **74%**。我们将其核心能力升级总结为以下四个方面:手写体深度解析:支持对草书、混合标注以及在印刷模板上叠加的手写文字进行精准捕捉。这…- 0

- 0

-

【一键部署系列】|09|TTS|把TTS流式延迟从2秒干到51毫秒,提升40倍的极限优化实战

【一键部署系列】|09|TTS|把TTS流式延迟从2秒干到51毫秒,提升40倍的极限优化实战微信公众号:[AI健自习室]关注Crypto与LLM技术、关注AI-StudyLab。问题或建议,请公众号留言。Info项目地址:https://github.com/neosun100/kokoro-ttsDocker Hub:https://hub.docker.com/r/neosun/k…- 0

- 0

-

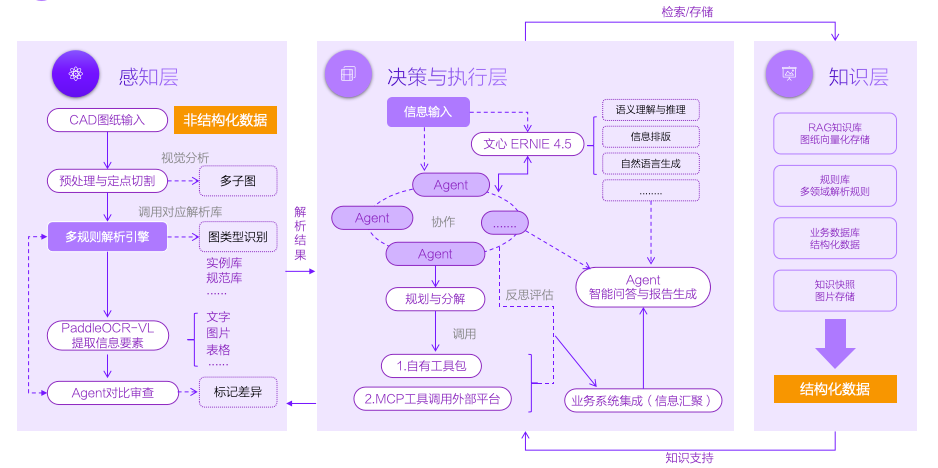

通信工程CAD图纸智能化,PaddleOCR-VL+ERNIE-4.5联手凯通科技实现“感知-决策-知识”闭环

行业背景&痛点计算机辅助设计(CAD)作为工业软件的重要组成部分,支撑着从产品设计到制造的全流程数字化,被广泛应用于航空、航天、汽车等多个领域。近年来,随着AI技术的发展,CAD与AI的融合成为趋势。国外厂商在这方面已经取得了显著成就,而国内厂商也在迅速追赶,尤其是在AI解决方案和实际应用方面展现出了独特的优势。然而,在CAD图纸智能审查领域仍普遍面临“图纸解析精度低、业务关联难”的技术瓶…- 0

- 0

-

零成本!我用 PaddleOCR API 做了一款视频字幕提取神器

前言前几天在体验视频解析文件AI应用的时候,发现了一个非常方便的功能:自动提取视频内容。核心原理是基于计算机视觉、图像处理和机器学习技术,通过对视频帧序列进行解码、分析和特征提取,将非结构化的视频数据转化为可识别、可检索的结构化信息。核心处理流程中肯定会用到OCR技术,如果能把多模态能力和 OCR 技术结合起来并把它整合到视频字幕提取工具里,是不是就能实现零成本提取视频字幕了呢?背景早在10月份的…- 0

- 0

-

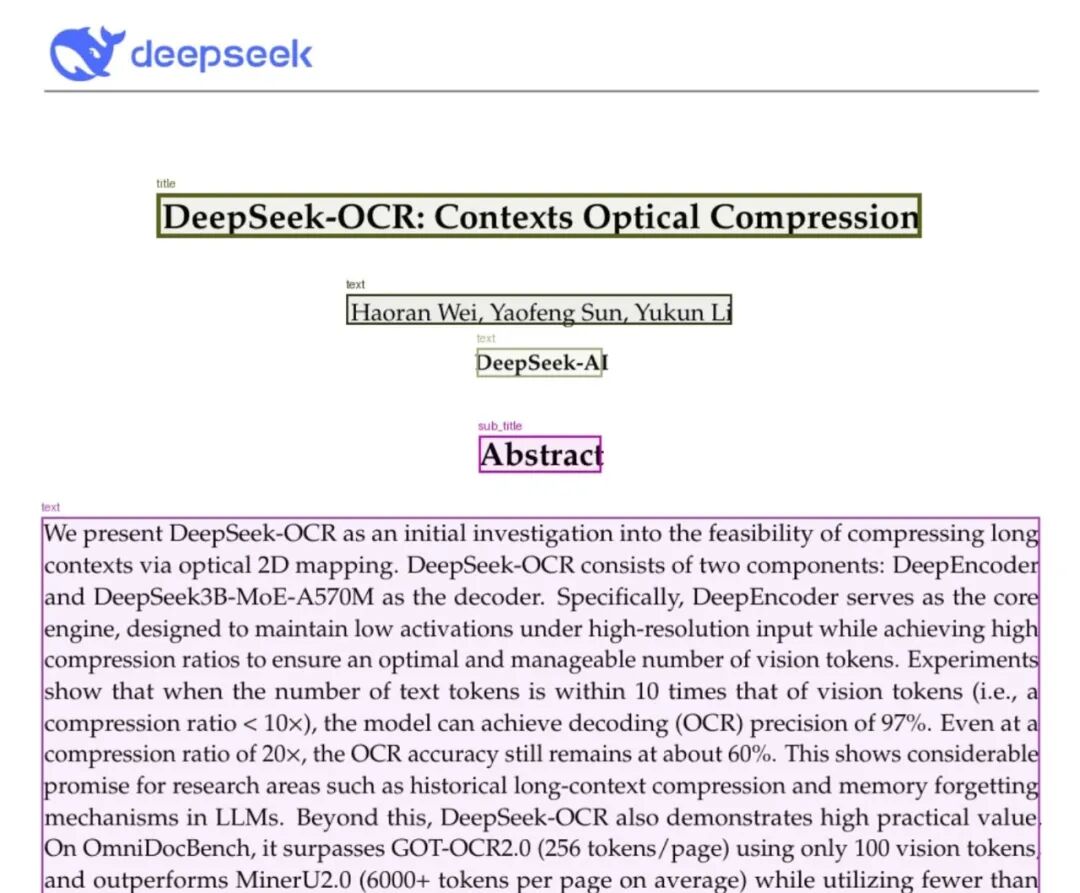

用一张12GB 显存的显卡本地部署 DeepSeek-OCR

运行环境配置NVIDIA GeForce RTX 3080 Ti(12G)Ubuntu 20.04 + CUDA 11.8 + PyTorch 2.6.0这种配置在许多开发者手中都很常见,无需专业服务器即可上手。源码安装步骤1. 克隆仓库:git clone https://github.com/DeepSeek-ai/DeepSeek-OCR.git2. 创建并激活虚拟环境:conda crea…- 0

- 0

-

京东推出JoyVoice,解决多说话人语音合成难题

标题:JoyVoice: Long-Context Conditioning for Anthropomorphic Multi-Speaker Conversational Synthesis链接: https://arxiv.org/pdf/2512.19090作者单位:JD SpeechTeam发表时间:2025年12月22日Demo地址:https://jea-speech.gi…- 0

- 0

-

“基于多模态大模型的智能保险理赔系统”荣获上海金融创新奖

12月26日,上海市人民政府进行2023—2024年度上海金融创新奖颁奖活动,蚂蚁集团“基于多模态大模型的智能保险理赔系统”荣获奖项。据了解, “上海金融创新奖”是国内首个聚焦金融创新领域的省部级政府奖项,也是金融领域唯一由上海市人民政府组织评选表彰的奖项,是金融创新领域最具含金量的奖项之一。“智能保险理赔系统”聚焦传统保险理赔长期存在的人工依赖重、流程冗长等痛点,融合三大核心技术,实现重大突破。…- 0

- 0

-

全模态大模型部署,vLLM-Omni 来了,100%开源

vLLM 是我们公众号的常客了,几乎所有关于大模型本地部署的文章都是用 vLLM 启动的安全审核大模型,本地部署,实测腾讯混元 OCR 大模型,本地部署,实测大模型本地部署相关文章,我做了一个网站但是部署多模态,尤其是最近 N 多全模态大模型,vLLM 就有点捉襟见肘了vllm-project 团队开源了一个新框架——vLLM-OmnivLLM-Omni什么是 vLLM-Omni? 最初,vLLM…- 0

- 0

-

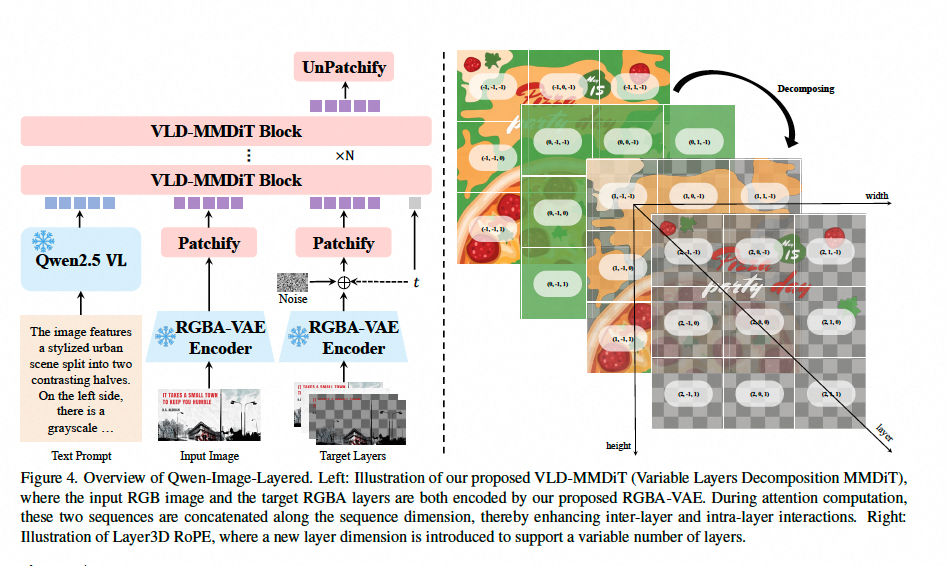

Qwen-lmage-Layered:图片分层 指哪改哪

我们很高兴推出全新图像生成模型Qwen-lmage-Layered,新模型采用自研创新架构,可将图片“拆解”成多个图层。这种分层表示赋予了图像内在的可编辑性:每个图层都可以独立操作,而不会影响其他内容。同时,这种分层结构天然支持高保真的基本编辑操作,例如缩放、移动和重新着色。通过将不同元素物理地隔离到不同的图层中,我们的方法实现了高保真的编辑效果。Qwen-lmage-Layered技术报告:ht…- 0

- 0

-

语音交互技术:让你的 AI 助手开始说话

语音交互技术:让你的 AI 助手开始说话在人工智能技术飞速发展的今天,AI 助手已从 “文字框里的应答者” 进化为 “能听会说的智能伙伴”。无论是手机端的 Siri、小爱同学,还是 Web 端的智能客服、教育 AI 助手,语音交互都成为其核心竞争力 —— 用户无需手动输入,只需开口提问,AI 助手就能用自然的语音回应。这一转变的背后,离不开前端语音识别与 TTS(文本转语音)技术的支撑。本文将聚焦…- 0

- 0

-

面向业务落地的AI产品评测体系设计与平台实现

一、背景和挑战1.1 背景在人工智能技术迅猛发展的推动下,各行各业正经历前所未有的数字化转型浪潮。从智能制造的智能调度系统,到医疗领域的辅助诊断工具;从金融行业的风险预测模型,到电商场景下的个性化推荐引擎——AI 正在以一种不可逆转的趋势重塑产业格局。尤其值得关注的是,大模型技术的突破性进展不仅显著降低了 AI 应用的技术与人员门槛,更催生了“产业+AI”融合创新的广泛应用场景,为行业智能化升级注…- 0

- 0

-

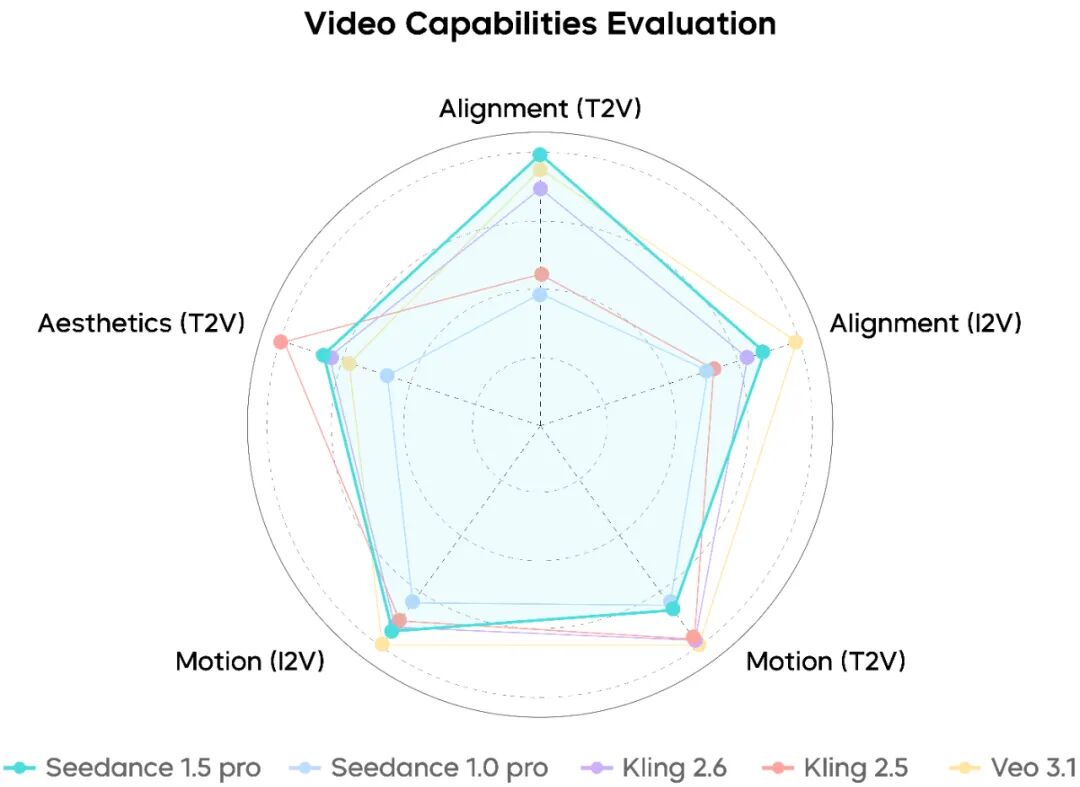

声画俱全,一镜入戏 | Seedance 1.5 pro 音视频创作模型正式发布

舞台中央,灯光聚焦,随着一段高亢的旦角唱腔,角色完成了一连串配合鼓点的长枪动作。这并非真实演出,而是 Seedance 1.5 pro 尝试一镜生成的创作片段,其演绎与专业戏曲表演尚有很大差距,但声韵已初见雏形。今天,我们正式发布新一代音视频创作模型 Seedance 1.5 pro。Seedance 1.5 pro 支持音视频联合生成,它能够执行多种任务,包括从文本到音视频的合成以及图像引导的音…- 0

- 0

-

OpenAI 发布 GPT Image 1.5:全面升级

刚刚,OpenAI 今天发布了新的图像模型:GPT Image 1.5核心变化一句话:精准编辑,不崩全图让它改哪,他就改哪,其他地方不乱动同时,对比上一代模型 GPT Image 1.0:• 更强的指令遵循• 更好的细节保持• 速度比上一代快4倍• API 价格降了 20% 以上今天开始,向所有 ChatGPT 用户推出。另外经实测,这个模型在中文处理上比 NanoBanan…- 0

- 0

-

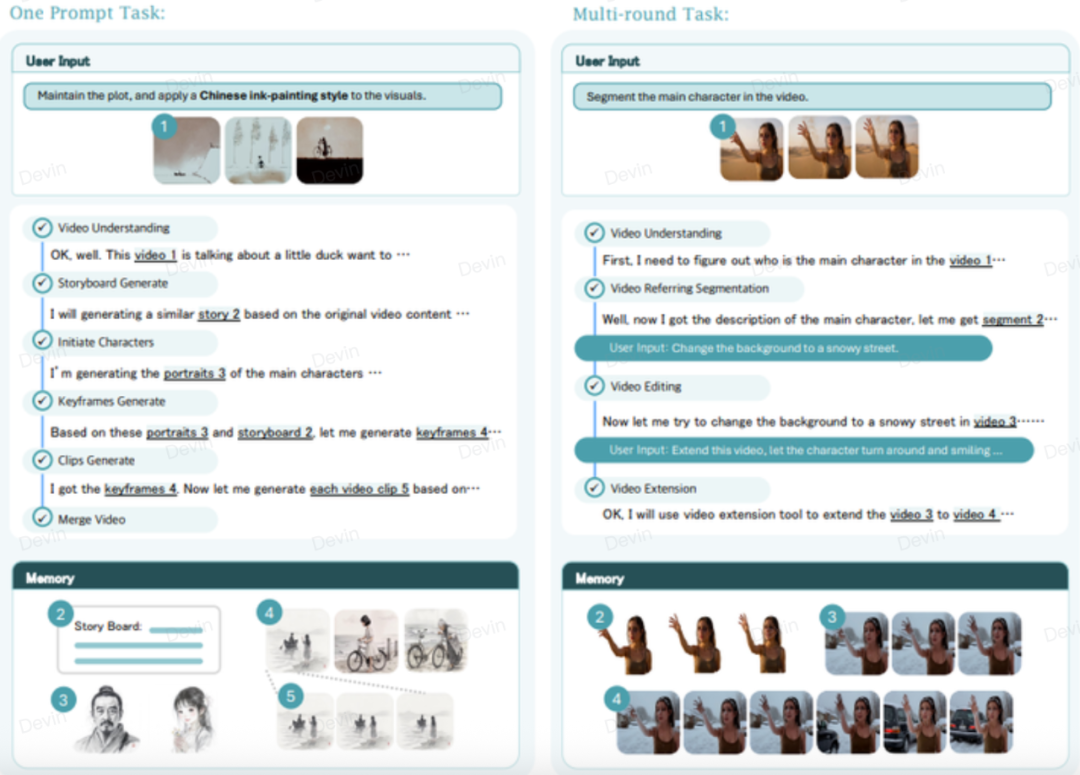

AI导演来了!UniVA:你的全能视频创作智能体

目录:1. UniVA视频超级智能体2. UniVA四个核心内容3. UniVA行业定位4. 结尾5.参考链接6.互动问题一年前我们团队就利用多模态大模型解决了音视频模型的多种理解任务,并成功处理了公司大部分视频,期待已久的多模态视频解析工具新功能来了。但受限于资源,去年部署了几个开源的文生视频的模型,效果差强人意,这块需求也就pending了。前段时间在北京阿里巴巴参加了一个多模态视频…- 0

- 0

-

万字拆解UI-TARS 2.0,看懂豆包手机背后的核心技术

导读近期,##豆包AI手机 的亮相引发了科技圈的广泛热议。许多数码博主发布的实测视频显示,其能够流畅执行跨应用复杂任务,效果令人惊艳。根据公开信息推测,其工作原理可能是:设备端大约每3秒向云端发送一帧当前屏幕图像;云端部署的强大多模态视觉语言模型(VLM)会对画面进行解析,理解界面元素与用户指令,进而生成具体的操作指令(Action)回传至手机端执行。 尽管我们尚不清楚其背…- 0

- 0

-

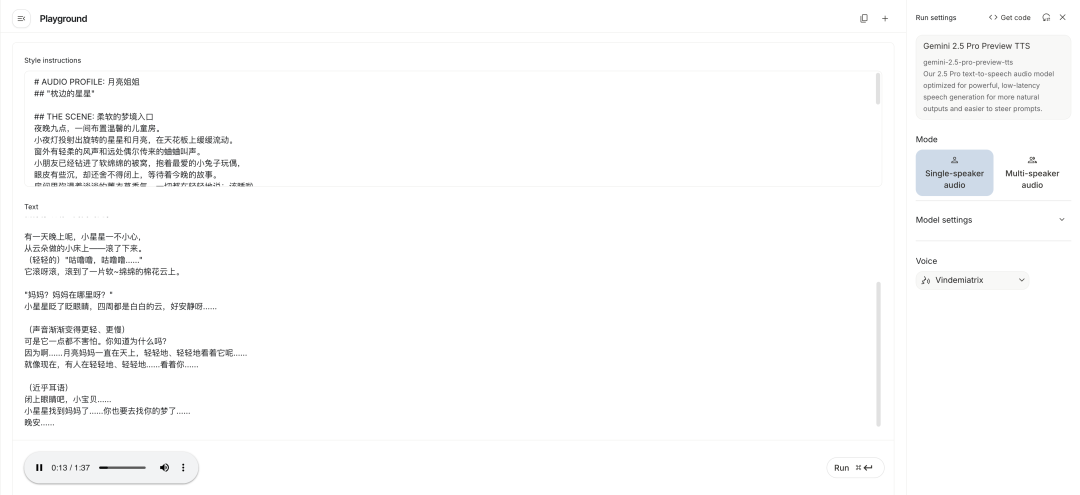

秒杀传统 TTS?!Gemini 原生中文 TTS 体验 + 提示词模板

Gemini 新推出的 TTS 模型在音质、情绪表达和可控性方面都远超预期。它最核心的特点可以用一句话概括:不仅知道说什么,而且知道如何说。无论是儿童故事的温馨细腻、悬疑剧情的紧张压抑,还是电竞解说的激情澎湃,Gemini 2.5 TTS 都能游刃有余地驾驭。本文将系统介绍它的效果、特点和实际玩法。一、先听效果:几个风格迥异的音频示例示例一:儿童睡前故事(温柔风格)效果评价:语调温柔、节奏舒缓,带…- 0

- 0

❯

购物车

优惠劵

搜索

扫码打开当前页

联系我们

返回顶部

幸运之星正在降临...

点击领取今天的签到奖励!

恭喜!您今天获得了{{mission.data.mission.credit}}积分

我的优惠劵

-

¥优惠劵使用时效:无法使用使用时效:

之前

使用时效:永久有效优惠劵ID:×

没有优惠劵可用!