-

大模型评估排障指南 | 关于 LaTeX 公式解析

这是 大模型评估排障指南 系列文章的第二篇,敬请关注系列文章:关于推理关于 公式解析关于可复现性解析 LaTeX 很难。这个问题在评估输出为 的模型时经常会遇到,例如 Hugging Face 的。这个基准使用 来表示数学领域的计算和符号。评估难点在于对模型输出与标准答案的解析和比较。 结果表明,解析 …- 0

- 0

-

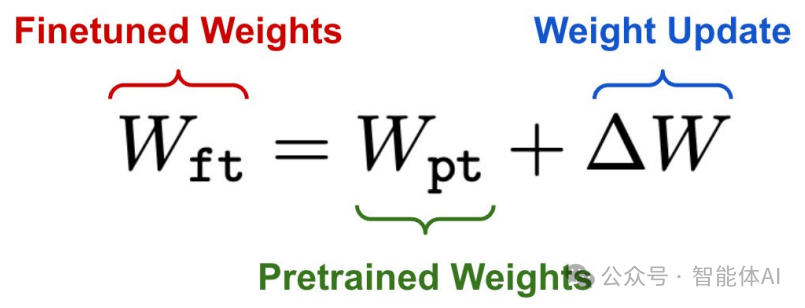

LoRA为何成为大模型微调不可或缺的核心技术?

在人工智能领域,大语言模型(LLMs)如Claude、LLaMA、DeepSeek等越来越强大,但想要让这些模型适应特定任务,比如法律问答、医学对话或者某企业内部知识问答,传统的方法是「微调」(Fine-tuning)模型。然而,这背后通常意味着巨大的计算开销和高昂的资源成本。有没有办法低成本、高效率地完成微调?有!这正是我们今天要聊的主角 —— LoRA(Low-Rank Adaptation)…- 0

- 0

-

为什么AI多轮对话总是那么傻?

使用DeepSeek整理SOP;使用扣子类平台验证SOP;最后做程序优化;有必要就做平台化;后续也是列举了个简单的社群AI分身的例子,只不过其中多轮聊天这块被我故意略去了,原因是他太复杂了。事实上,多轮聊天是整个AI应用最大的难点,也是很多人做不好AI产品的关键,一旦是涉及多聊天的产品,其实现复杂度都会大幅增加!所以,今天第一个问题是,AI多轮对话到底难在哪里?关于这个问题,也许大家没有注意到,其…- 0

- 0

-

Synthetic Data Kit:LLM微调的语料提炼方案

针对特定任务微调主流LLM的最大挑战是:高质量、任务专用的数据很难获取。Meta的合成数据工具包(Synthetic Data Kit,SDK)为此提供了一个精简的开源解决方案,用于生成、筛选和格式化合成数据集—无需数据科学家参与。小编认为它意义在于将微调过程中的预料准备经验进行了工具化的总结。大多数现实世界的数据集杂乱无章、结构混乱,很少采用LLM喜欢的"用户/助手"格式。M…- 0

- 0

-

大模型微调真的有技术含量吗?

当下,大模型微调成为了备受关注的焦点之一。然而,对于大模型微调是否具有技术含量以及技术含量的大小,业内存在着不同的声音。本文将从多个维度,结合具体数据,深入探讨大模型微调的技术含量。unsetunset一、数据质量:技术含量的第一道分水岭unsetunset微调的核心逻辑是用特定数据雕刻模型能力,但数据质量直接决定成败:低技术含量做法:直接套用现成开源数据(如Alpaca格式),仅能生成“正…- 0

- 0

-

Ollama环境变量配置全攻略:从基础设置到场景化调优

在Ollama的本地化部署与性能优化中,环境变量扮演着「神经中枢」的关键角色。通过灵活配置这些参数,开发者可精细调控模型运行时行为,适配从单机开发到分布式集群的多样化场景。本文将结合实战经验,分享一套系统化的环境变量配置方案,助你释放Ollama的最大潜力。一、跨平台环境变量配置指南 (一)Linux/macOS 配置方案 1. 临时生效(单次会话) …- 0

- 0

-

10行代码,实现你的OpenAPI MCP Server

一、引言:MCP Server新范式在Model Context Protocol (MCP)爆火的今天,MCP Server的局限性日益凸显:MCP市场提供的MCP Server往往只能提供有限的能力,不够灵活,无法根据用户的具体需求灵活拓展或调整,过多的工具又会导致Token的大量消耗。而作为阿里云的用户,阿里云OpenAPI便是我们和资源之间的桥梁与通道,通常我们会希望通过OpenAPI来实…- 0

- 0

-

Cursor 开发完N个大型项目后的硬核经验

Rules 规则首在 Cursor 中,Rules(规则)是指代码编辑器的自定义配置或行为规则,通常用于控制代码风格、格式化、静态分析或 AI 生成代码时的约束条件。具体来说,Rules 可以涉及代码格式化规则、AI 生成代码的约束、项目特定的规范现阶段不管是什么大模型都会有一个上下文长度的限制,特别是对于我们这种多轮对话的场景,对于同一个功能,Cursor 给出的实现可能…- 0

- 0

-

AI小智接入千问3,提速30%,opus传输并发提升1000%

我们对服务器进行了2块优化。我们4月28日千问3发布,是目前最快的千问模型,目前快充AI集成软件已经适配,需要关闭掉思考模式,才能体现出速度优势,经测试原先需要1.6s的,现在提升到1.1s左右。在线部署网站后台配置如下 模型是qwen-turbo-latest本地部署如果是本地部署qwen3模型,速度基本在0.3s左右,如下图但本地部署投入成本高,维护难度大,需RTX4090显卡和公网IP,和2…- 0

- 0

-

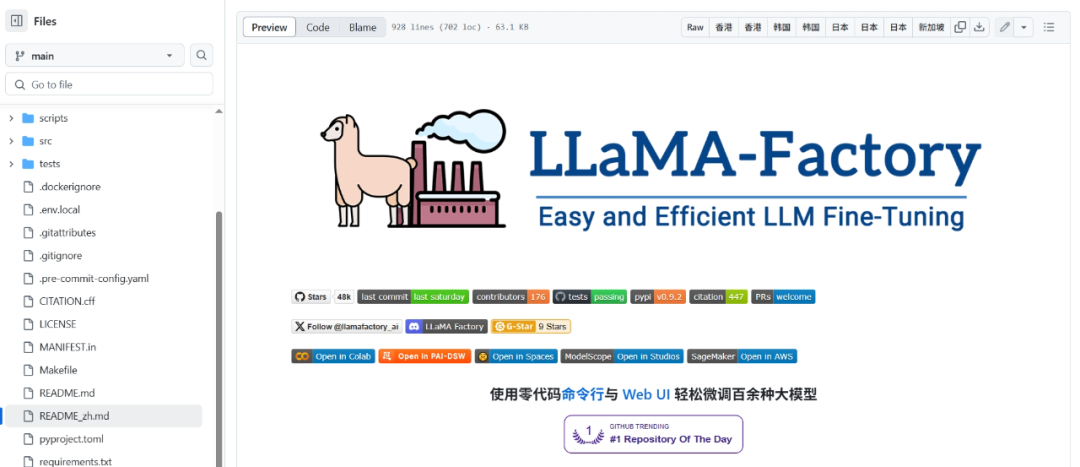

【一文了解】Llama-Factory

在当下流行的各种大模型工具中,Llama-Factory是全球开发者常用的一套工具集,它基于Transformer架构,为我们提供了一套简单、快速而又高效的大模型定制化训练与部署工具,并且它提供了模块化、可扩展和流程化的框架,支持多种主流的大语言模型(如 LLaMA、ChatGLM、Qwen 等),一站式地集成了数据预处理、训练、微调、评估和推理等多种功能。本篇我们一起来看看Llama-Facto…- 0

- 0

-

OpenAI企业AI落地七大经验:从评估到自动化的实践指南

近日,OpenAI发布了一份24页的AI应用企业案例集,详细分享了全球顶尖企业如何将人工智能真正融入业务流程并创造实际价值。这份报告不仅引发行业广泛讨论,也为正在思考AI转型的企业提供了宝贵参考。在报告中,OpenAI指出,AI已在三个关键领域带来显著提升:提高员工绩效、自动化日常操作和赋能产品体验。与传统软件部署不同,成功的AI实施需要一种全新模式,即"以试验为导向"的思维方…- 0

- 0

-

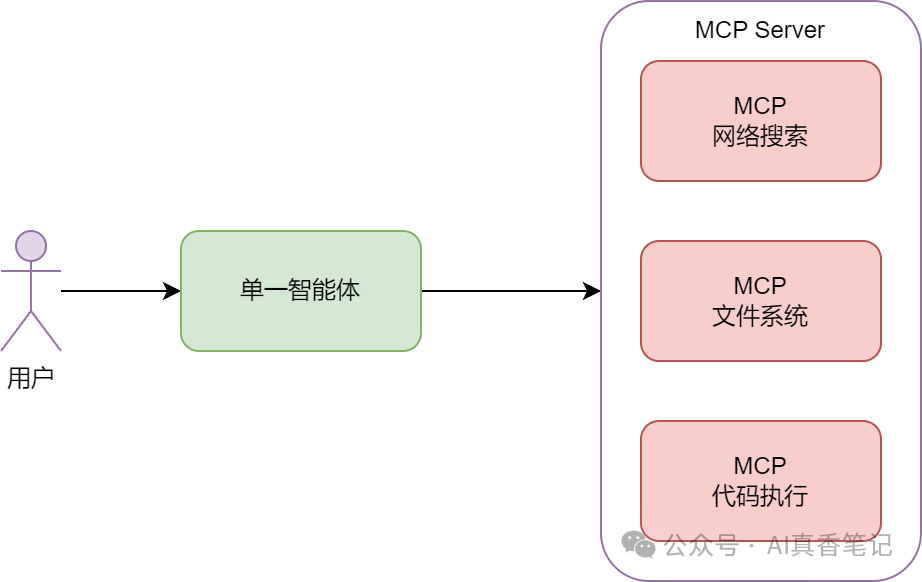

"单Agent+MCP"与"多Agent"架构对比分析(上):概念、优劣势与架构选择

随着AI智能体(Agent)技术的蓬勃发展,开发者面临着一个关键抉择:是使用功能齐全的单一智能体,还是构建由多个专业化智能体组成的系统?本文将揭开这两种架构的本质区别、各自优势以及如何做出明智选择。在开发AI应用时,笔者经常面临这样一个问题:单个Agent+多个MCP工具已经能够完成大部分功能,我们是否还有必要将MCP工具拆分到不同的Agent去构建多Agent系统?这个问题并不简单,它涉及到架构…- 0

- 0

-

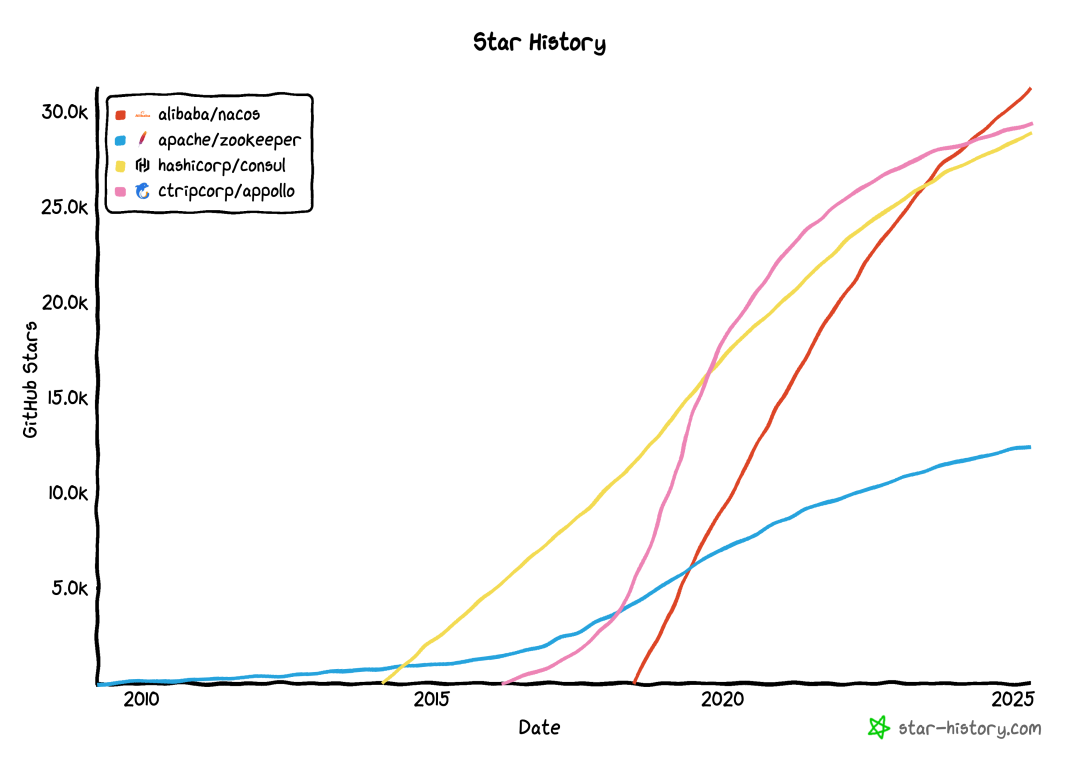

Nacos 3.0 正式发布:MCP Registry、安全零信任、链接更多生态

Nacos 3.0 正式版本发布啦!升级 MCP Registry,围绕着 MCP 服务管理,MCP 多种类型注册,包含 MCP Server 注册、编排、动态调试和管理,并且提供 Nacos-MCP-Router 可以进行 MCP 动态发现,可以自动安装、代理 MCP Server,全生态面向 AI Registry 进行升级;升级安全架构,默认开启鉴权,基础架构一系列升级,作为云原生时代的基础…- 0

- 0

-

Qwen3小模型实测:从4B到30B,到底哪个能用MCP和Obsidian顺畅对话?

本文实测 Qwen3 系列本地模型(4B/8B/14B)与 Obsidian-MCP 的知识库交互效果,发现小模型存在工具调用失效、响应幻觉及上下文限制等问题。4B 版本 因量化丢失指令理解能力,8B版本虽能调用工具但存在内容偏差。14B+就能正常对话了,本地小模型可用性在逐步上升,但我距离流畅交互还差一块 16G 显卡的距离?Qwen3 小模型实测:从 4B 到 30B,到…- 0

- 0

-

WeClone: 用微信聊天记录微调大语言模型

通过个人微信聊天记录对大语言模型(LLM)进行微调,打造专属的数字分身。它提供从聊天数据到模型微调、从文本生成到语音克隆、从训练到部署的全链路解决方案。让你的数字分身不仅“会说你的话”,还能“听起来像你本人”。主要功能聊天记录训练:用微信聊天记录微调大语言模型,模仿用户说话方式。高质量语音克隆:用0.5B参数模型和5秒语音样本,生成相似度高达95%的声音。微信机器人绑定:将数字分身接入微信,支持自…- 0

- 0

-

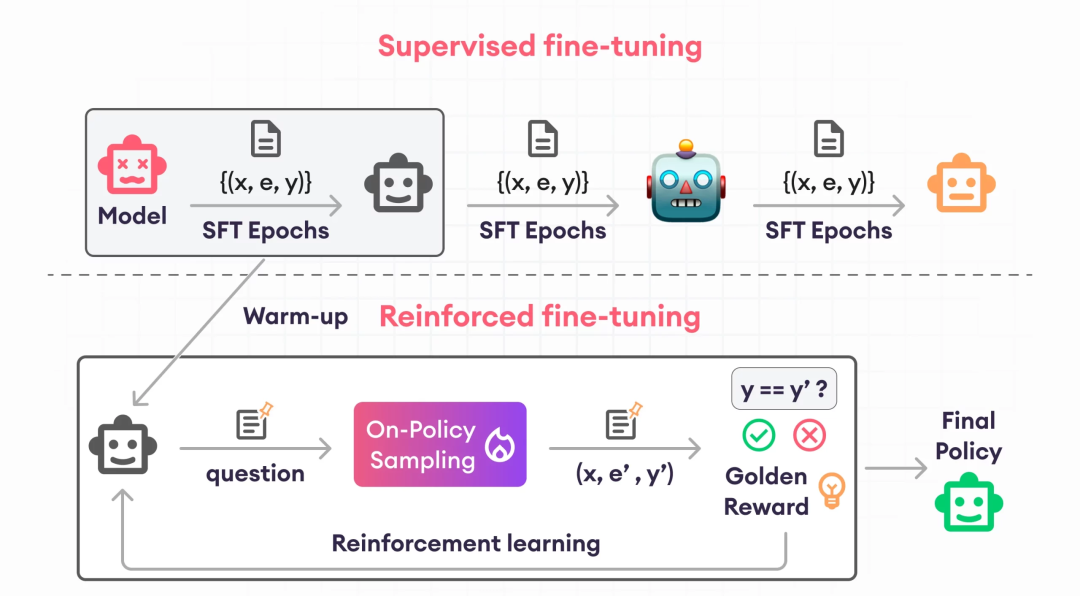

强化微调来袭!如何让AI真正“听懂”人类需求

在当今快速发展的 AI 领域,如何让模型更好地理解人类的需求并提供真正有价值的服务,一直是开发者们努力的方向。而强化微调(Reinforcement Finetuning)的出现,无疑是为这一目标带来了新的曙光。它通过结合人类反馈和强化学习,让模型能够不断调整自身行为,以更好地符合人类的价值观和期望。今天,就让我们深入探讨强化微调的奥秘,看看它是如何在现代 AI 开发中发挥重要作用的。一、强化学习…- 0

- 0

-

部署运维SRE专属大模型

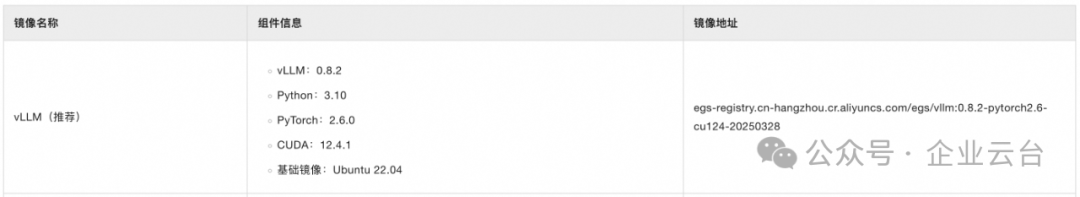

前段时间一位前同事说微调了一个SRE领域的专属大模型(基于 DeepSeek 架构的 7B 参数量模型,经过 LoRA 微调,专为运维领域任务设计。强化了三块能力:自动化脚本生成、系统监控分析、故障排查与根因定位),趁这两天放假打算部署体验一下。准备工作选择阿里云GPU服务器作为部署环境,本机MAC电脑实在跑不起来。GPU的配置建议:系统盘至少100G,内存60G。通过docker镜像的方式将依赖…- 0

- 0

-

Qwen3 一手实测

刚刚抽空对今天发布的Qwen3 -235B进行了一个简单测试我主要针对前端代码能力(简单提示,复杂提示),以及稍微具有复杂逻辑的普通人可以玩的小项目代码能力测试就我目前的的测试来看,qwen3的前端复杂提示表现不太好,复杂项目的代码细节处理稍微欠缺以下是测试结果:前端简单提示:卡片制作比如以下三个简单提示,抽卡表现挺稳定的,基本上能生成精美的卡片1.在strawberry中有多少个“r…- 0

- 0

-

MCP、RAG、Function Calling、Agent与微调如何重塑未来应用

2025年,AI技术正经历从“模型崇拜”到“场景适配”的深刻转变。企业不再满足于通用模型的“平均能力”,而是通过MCP、RAG、Function Calling、Agent与微调等技术组合,搭建适配业务的“AI乐高”。这些技术如何定义边界?如何协同创造价值?本文将从定义与核心功能、优劣势对比、场景应用三个维度为大家拆解,希望能有所帮助。一、技术…- 0

- 0

-

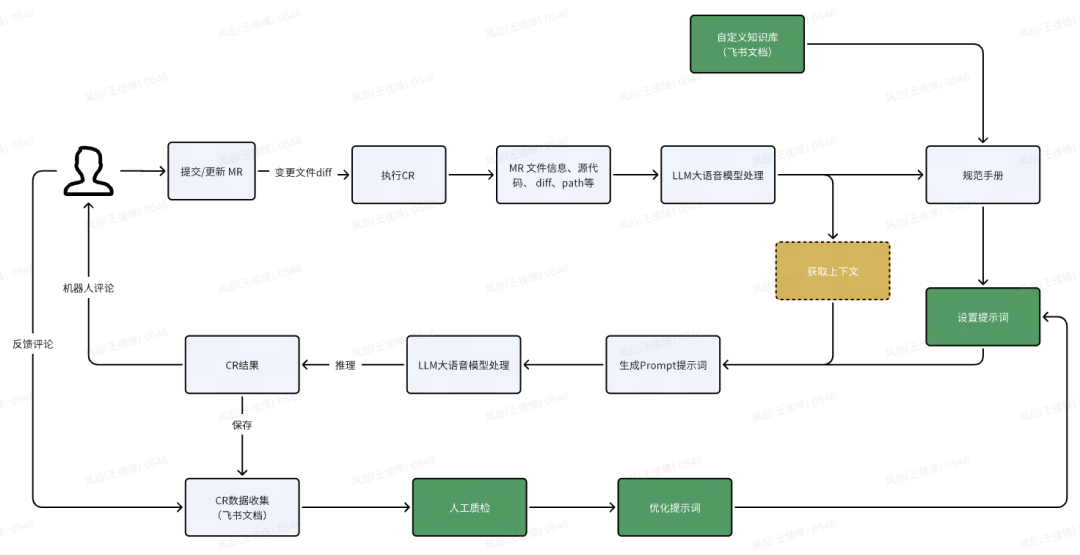

Al代码审查实践:从构想到快速落地

初衷年初,随着 DeepSeek 的爆火出圈,相信大家一定脑暴过各种利用 LLM 的创新应用场景。在这场技术浪潮中,我们团队内部也在积极规划探索 AI 能在现有研发流程中带来哪些助力,但同时考虑到目前行业飞速进化的趋势,大致明确了几个探索原则:? 核心原则快速行动,持续验证:做思想上的巨人,行动上的实践者,有想法就积极行动尝试;注重投入产…- 0

- 0

-

Trae 新版本增加 MCP、Agent、Rules 等多项功能,立即体验

最近几日,Trae 更新了自己的新版本,增加了很多功能,包括自定义智能体、MCP、增加 Rules 配置,以及联网搜索,文档集等。经过雨飞的实际体验和测试,将核心内容分享给大家。直接在官网下载最新版本,或者在原来的 IDE 中找到帮助菜单下面的更新按钮,进行更新就可以。更新之后,会进入到新的引导页面。首先,Chat 和 Builder 合而为一,可以使用 @ 符号唤起 Builder 功能可以自定…- 0

- 0

-

通用LLM插件系统——简化工具集成,提升2025年AI的灵活性

The Hook:The Hook:你正在构建一个 AI Agent。它很聪明,会聊天。但……它被困住了。它不能浏览网页。它不能访问文件。它不能调用 APIs。它被困在自己的沙盒里——就像给一位天才一本空白笔记本,却锁上了门。现在想象这样:你写六行代码,给你的 agent 配备浏览器控制、文件系统访问和实时 API 查询等工具——然后它立刻生效。欢迎使用 MCP-Use:一个看似简单的 …- 0

- 0

-

演讲实录:中小企业如何快速构建AI应用?

AI时代飞速发展,大模型和AI的应用创新不断涌现,面对百花齐放的AI模型,阿里云计算平台大数据AI解决方案总监魏博文分享如何通过阿里云提供的大数据AI一体化平台,解决企业开发难、部署繁、成本高等一系列问题,让中小企业快速搭建AI应用。首先第一个挑战,搭建AI应用,并不是简单地部署一个大模型,如今部署一个大模型也不再是一个困难的事情。通过通义大模型系列的不断更新,我们可以看到模型能力越来越强,但是如…- 0

- 0

-

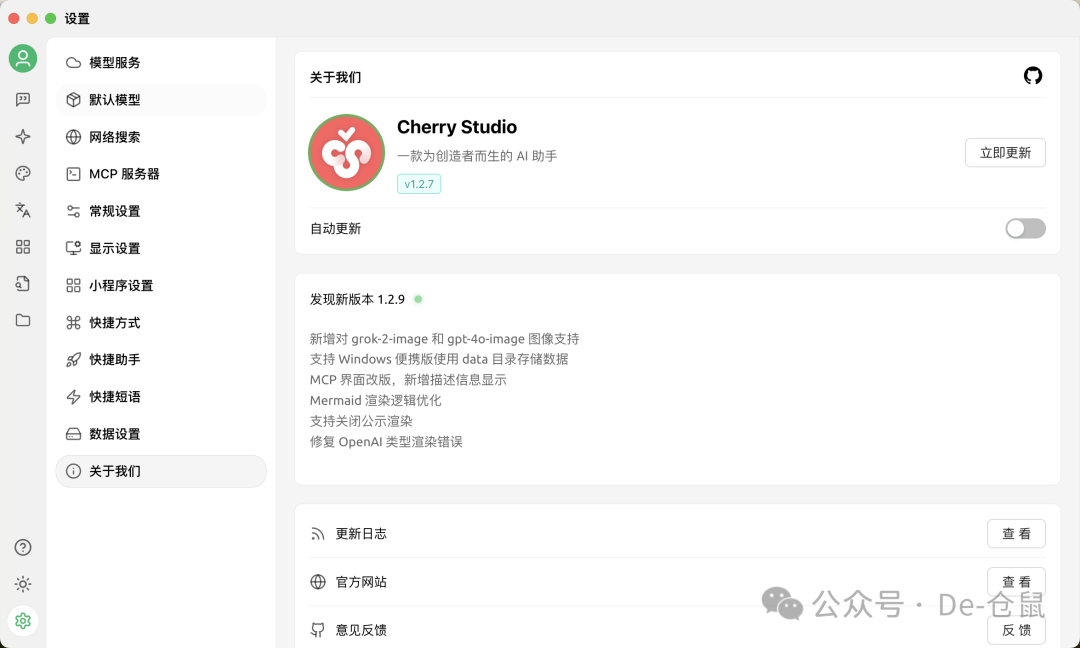

Cherry Studio v1.2.9:新增多个MCP特性

18小时前,Cherry Studio发布了v1.2.9版本,查看发布日志,发现新增了四项MCP特性:1、支持预览MCP调用结果当调用MCP后,可以浏览调用结果,如我调用了高德地图的MCP,点击浏览窗口:会显示格式化后的数据:2、MCP服务器列表新增ModelScope同步功能该功能是将ModelScope 上部署的MCP服务同步到Cherry Studio中:填写ModelScope平台的令牌:…- 0

- 0

❯

购物车

优惠劵

搜索

扫码打开当前页

联系我们

返回顶部

幸运之星正在降临...

点击领取今天的签到奖励!

恭喜!您今天获得了{{mission.data.mission.credit}}积分

我的优惠劵

-

¥优惠劵使用时效:无法使用使用时效:

之前

使用时效:永久有效优惠劵ID:×

没有优惠劵可用!