核心功能

1. 多模型支持

-

兼容主流大模型架构(LLaMA、ChatGLM、Qwen、Falcon 等)。

-

支持模型权重的加载与转换(如 Hugging Face 格式)。

2. 高效的微调方法

-

提供多种参数高效微调(PEFT)技术,如 LoRA(Low-Rank Adaptation)、Adapter、Prefix-Tuning 等。

-

支持全量微调(Full Fine-tuning)和分布式训练(多 GPU/TPU)。

3. 多模态训练支持

-

可处理文本、图像、音频等多模态数据的联合训练任务。

4. 数据预处理与增强

-

内置常用数据集的清洗、分词、格式转换工具。

-

提供数据增强策略(如回译、同义替换)以提升模型泛化能力。

5. 可视化与监控

-

集成 TensorBoard 和 WandB,实时监控训练过程(损失、准确率等指标)。

-

支持模型性能分析和错误案例可视化。

6. 一键部署与推理

-

提供模型导出为 ONNX、TorchScript 等格式的工具。

-

支持本地或云端服务化部署(如 Docker、Kubernetes)。

主要组件和工具

LLaMA-Factory 的整体架构围绕以下几个核心模块展开:

1. 模型支持框架(Model Support)

支持 Hugging Face Transformers 中的主流大语言模型:

-

– LLaMA / LLaMA2 / LLaMA3

-

– ChatGLM 系列

-

– Baichuan 系列

-

– Qwen 系列

-

– InternLM

-

– Mistral / Mixtral

-

– Falcon / BLOOM 等

这些模型可以通过 Hugging Face 的 AutoModelForCausalLM 和 AutoTokenizer 加载,兼容性强。

2. 微调方法(Fine-tuning Methods)

通过集成 PEFT(Parameter-Efficient Fine-Tuning)库,支持主流的参数高效微调策略:

-

LoRA (Low-Rank Adaptation)

-

QLoRA

-

Prefix Tuning

-

Prompt Tuning

-

Full Fine-tuning

-

AdaLoRA、LLaMA-Adapter、IA3 等(部分支持)

用户可以选择不同的微调方法来根据资源和需求进行训练。

3. 训练器模块(Trainer)

基于 Hugging Face 的 Trainer 类封装,增加对 PEFT 的支持。

支持:

-

多卡训练(DeepSpeed、FSDP)

-

混合精度(fp16/bf16)

-

Gradient Accumulation

-

Checkpoint 保存与恢复

4. 数据处理模块(Data Preprocessing)

支持多种数据格式:

-

SFT 格式(instruction + input + output)

-

Chat 格式(messages 列表)

-

ShareGPT、Alpaca、OpenAI 格式

-

自定义格式(通过转换脚本)

-

自动构建训练样本,支持多轮对话、多种模板。

5. 推理模块(Inference / Serving)

提供简单的推理脚本 `infer.py`,支持:

-

单轮 / 多轮对话

-

Web UI(基于 Gradio)

-

CLI 推理

-

支持加载微调后的模型进行评估或部署。

6. 评估模块(Evaluation)

支持自动评估方法:

-

BLEU / ROUGE / METEOR

-

GPT / LLM-based 评价(如 GPT-4 Judge)

-

MMLU、CMMLU、CEval 等标准数据集

-

支持模型输出与参考答案的自动对比。

7. 部署模块(Serving)

可选的部署方式:

-

Gradio Web UI

-

FastAPI

-

OpenAI API 兼容接口(适用于本地部署大模型)

8. 配置与脚本(Scripts & Configs)

提供丰富的训练、推理、部署脚本,如:

-

`train.py`

-

`infer.py`

-

`web_demo.py`

-

`export_model.py`(导出为 Hugging Face 或 GGUF 格式)

-

提供 YAML/json 配置文件,方便快速启动训练/推理任务。

微调实战

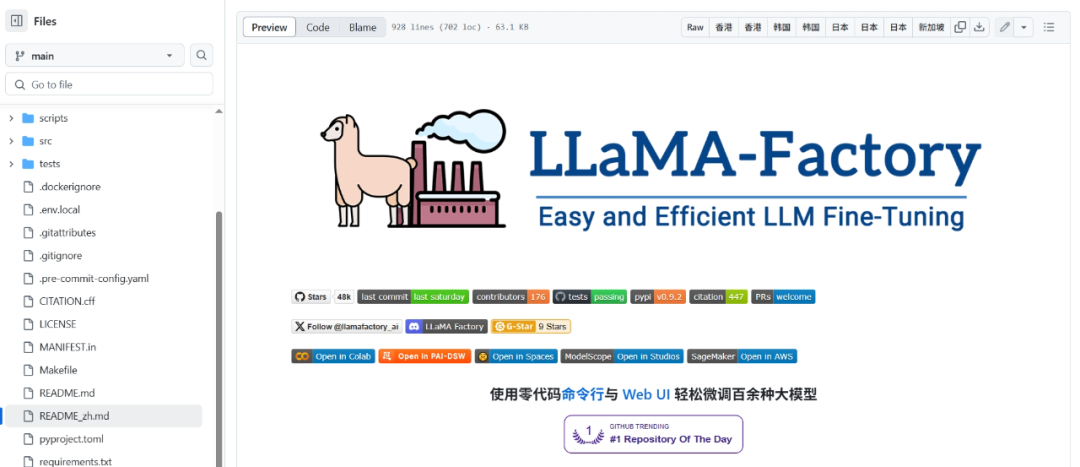

我们一起来看看如何用Llama-Factory微调llama3大模型,使用“弱智吧 ruozhiba”数据集。相比某些微调工具,LLaMA-Factory 整个操作过程还是比较简单的。

1. 环境准备

(1)克隆 LLaMA-Factory 仓库

git clone https://github.com/hiyouga/LLaMA-Factory.gitcd LLaMA-Factorypip install -r requirements.txt

(2) 确保在以下环境中进行微调:

-

Python 3.10+

-

CUDA 11.8+/12.x(支持 GPU 训练)

-

至少一张 24G 显存的 GPU(8B)或多张 A100/H100(70B)

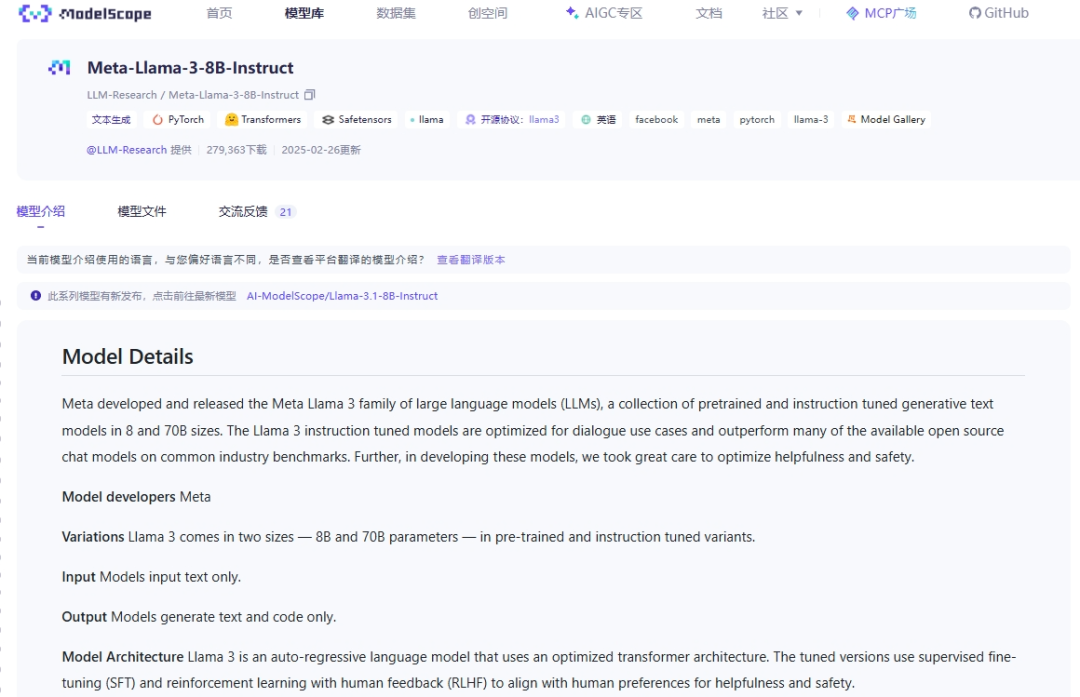

2. 模型与数据集下载

我们可以在Hugging Face或魔塔社区,下载llama3模型和ruozhiba数据集,具体方法多种多样,这里就不做详细介绍了。下图是我下载的模型文件与数据集文件。

3. 微调配置文件(`scripts/llama3/finetune_ruozhiba.sh`)

创建一个 shell 脚本如下:

#!/bin/bashCUDA_VISIBLE_DEVICES=0 accelerate launch src/train_bash.py--stage sft--model_name_or_path llama_models/llama-3-8b--do_train--dataset ruozhiba--dataset_dir data--template llama3--finetuning_type lora--output_dir output/llama3-ruozhiba-lora--overwrite_cache--per_device_train_batch_size 2--gradient_accumulation_steps 4--lr_scheduler_type cosine--logging_steps 10--save_steps 500--learning_rate 5e-5--num_train_epochs 3--plot_loss--fp16

参数说明:

-

stage sft:表示进行 SFT 微调

-

model_name_or_path:预训练模型路径

-

dataset ruozhiba:数据集名称(自动找 `ruozhiba.json` 文件)

-

template llama3:使用 llama3 prompt 模板

-

finetuning_type lora:使用 LoRA 微调方式(节省显存)

-

output_dir:输出模型路径

-

fp16:使用半精度训练(节省显存)

4. 开始训练

bash scripts/llama3/finetune_ruozhiba.sh

训练完成后,输出目录为:

output/llama3-ruozhiba-lora/├── adapter_config.json├── adapter_model.bin├── tokenizer.model└── ...

5. 推理测试(inference)

我们需要使用 `src/api_demo.py` 启动一个测试接口:

python src/api_demo.py --model_name_or_path llama_models/llama-3-8b --template llama3 --finetuning_type lora --adapter_name_or_path output/llama3-ruozhiba-lora