-

使用 Apache Dubbo 释放 DeepSeek R1 的全部潜力

2025年1月20日,国产大模型公司深度求索(DeepSeek)正式发布了大语言模型 DeepSeek-R1,并同步开源其模型权重。通过大规模强化学习技术,DeepSeek-R1 显著提升了推理能力,性能媲美顶尖闭源产品,迅速引发全球关注。用户量以惊人的速度飙升,DeepSeek App 在苹果应用商店中美、英等 157 个国家登顶下载榜,日活量快速突破 2000 万,成为全球增长最快的 APP。…- 0

- 0

-

DeepSeek:没用CUDA,没用NVlink,AMD率先拥抱

结论:deepseek 打破了两个固有思维:1.NVLink之前被吹的神乎其神,Deepseek实践证明NVLink不是必须的dpu完全可以替代2.cuda被认为是英伟达护城河,可以加速训练,deepseek实践证明cuda也不是必须的,PTX(Parallel Thread Execution)汇编直接操作硬件指令集效率更高,类似于dsp+软核方案,类似的方案,华为、寒武纪都有。 &…- 0

- 0

-

漫画趣解:一口气搞懂模型蒸馏!

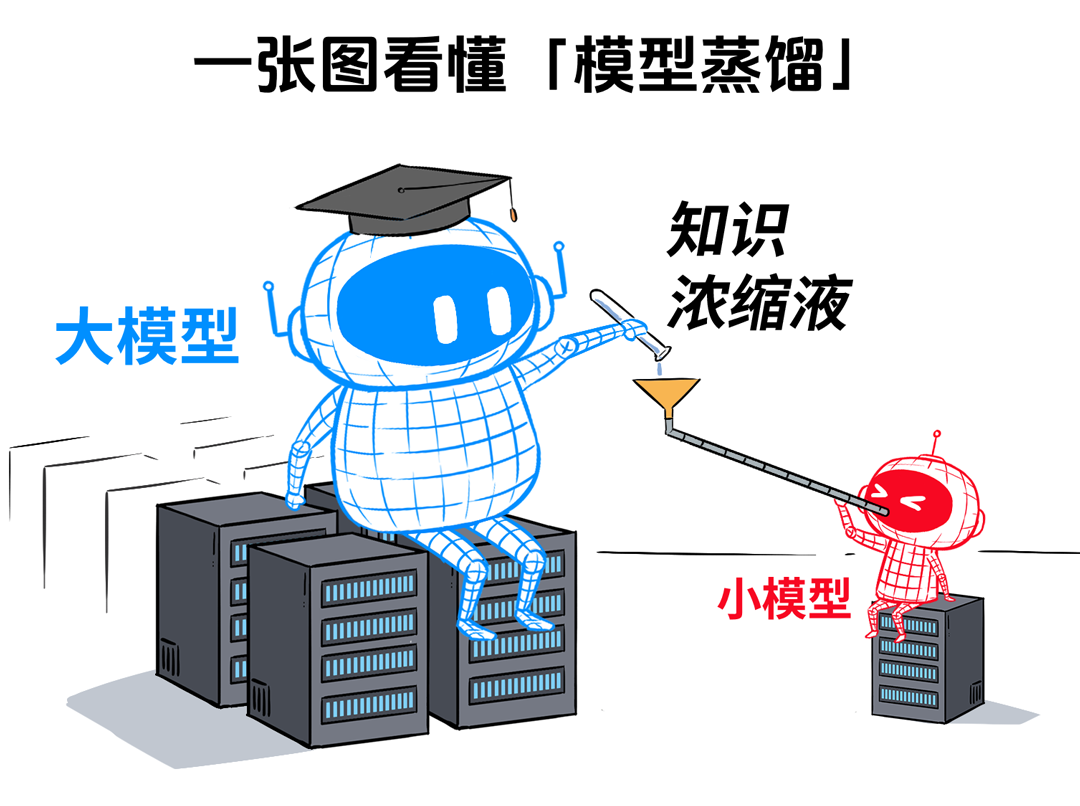

最近,伴随着DeepSeek的火爆,「模型蒸馏」这个专业名词,也频繁出现在大众视野。什么是模型蒸馏呢?“模型蒸馏”就是把大模型学到的本领,用“浓缩”的方式教给小模型的过程,在保证一定精度的同时,大幅降低运算成本和硬件要求。大模型:像一位见多识广、知识储备庞大的“大教授”,无所不知,但是“供养”他很贵。不仅培养他的过程很耗时耗力(训练成本高),请他过来讲课成本也很高,要有很大一笔安家费(部署模型的硬…- 0

- 0

-

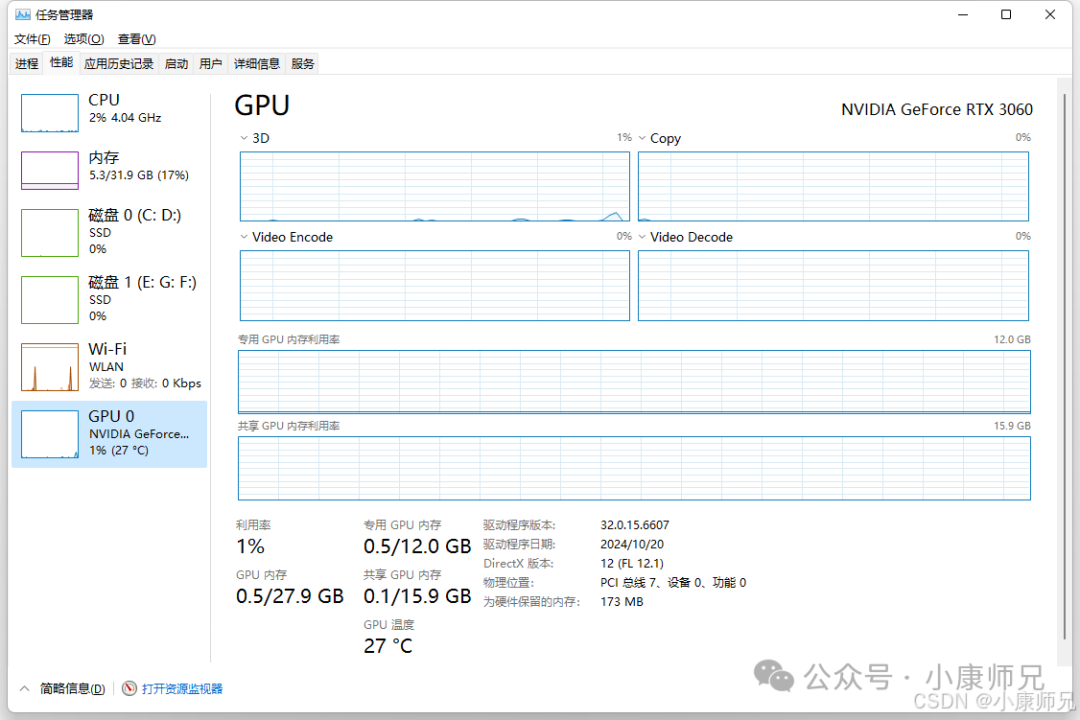

DeepSeek R1多版本性能与负载测试(基于RTX3060+R7 5800+32GB内存实测)

一、测试信息本机运行DeepSeek R1大模型文章如下:Windows电脑本地部署运行DeepSeek R1大模型(基于Ollama和Chatbox)【保姆级万字教程】在Windows计算机部署DeepSeek大模型,给在实验室无外网的同事们用(基于Ollama和OpenWebUI)本文章主要做个实验:基于RTX3060+R7 5800+32GB内存实测DeepSeek R1多版本的性能与负载。…- 0

- 0

-

深入理解 DeepSeek 与企业实践(一):蒸馏、部署与评测

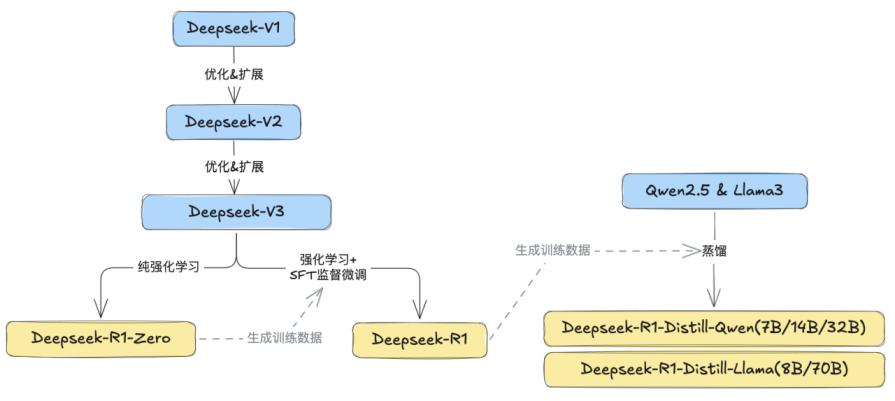

在人工智能迅猛发展的时代,每一次技术突破都如同在行业湖面投下巨石,激起千层浪。2025 年 1 月 20 日,DeepSeek-R1 震撼发布,迅速点燃 AI 社区的热情,成为万众瞩目的焦点。DeepSeek-R1 的卓越表现引发广泛热议,相信大家对它充满好奇。那么,这些模型背后有着怎样的诞生逻辑?它们是如何训练而成?不同模型之间又存在哪些区别,各自适用于何种场景?今天,我们将用最简洁易懂的语言,…- 0

- 0

-

DeepSeek本地部署+知识库+联网搜索,终极版方案,保姆级教程!

今天就来解决这些问题,一个本地部署+私人知识库+联网搜索的终极方案。本地部署DeepSeek如果你是老粉,看过我以前的文章,这一步可跳过,直接ollama run deepseek-r1:1.5b。首先打开ollama官网:https://ollama.com下载,一步步安装即可。CMD命令窗口运行,启动deepseek-r1模型:ollama run deepseek-r1:…- 0

- 0

-

4090单卡部署671B DeepSeek,本地部署“成本骤降32倍”,助力R1真正落地「中小企业」中!

“ 近期国内外都流行一股DeepSeek-R1部署热,大家都纷纷在自己的本地主机上面尝试着部署满血版本的DeepSeek-R1。然而,要部署一个完整的版本的DeepSeek-R1在本地,大概需要16张A800,大概会花费200百万左右的成本。产业界苦671B的大模型已久,希望能有一些低成本的满血版671B DeepSeek部署方案。小编今天给大家推荐一个框架-KTransformers,…- 0

- 0

-

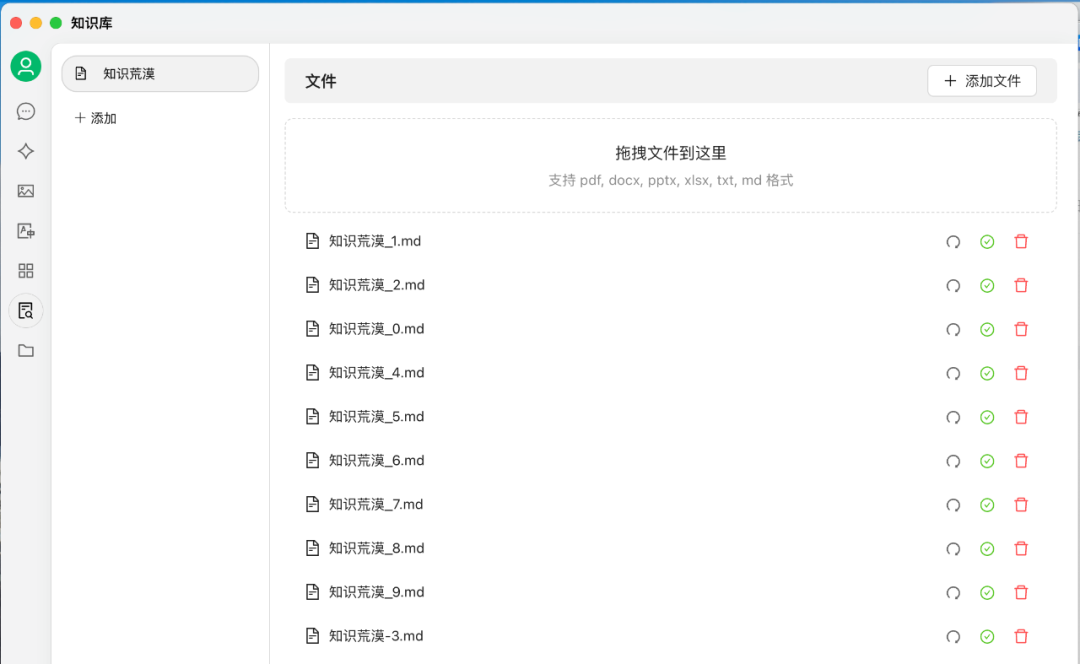

用本地文件调教 DeepSeek

在当今数字化的时代,信息和知识如同浩瀚的海洋,而我们每个人都要在其中寻找属于自己的宝藏。想象一下,作为一名医生,你手中握有海量的科研资料,它们如同一座座知识的孤岛,等待着被探索和整合。如果能够拥有一位专属的“知识机器人”,它不仅能够学习并吸收你所有的资料,还能在你需要时,迅速为你提供精准的答案,这将是多么令人向往的事情啊!你无需再耗费大量时间在繁琐的资料检索中,只需简单地向它提问,答案便如自来水般…- 0

- 0

-

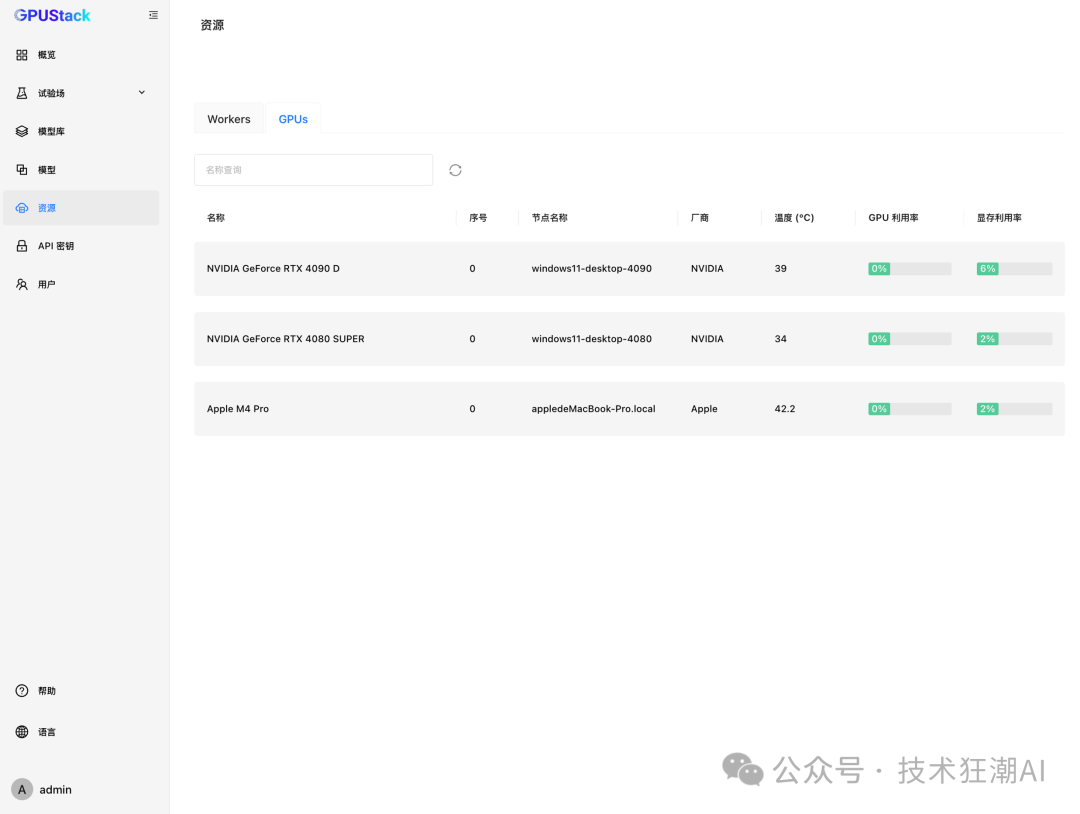

DeepSeek私有部署最全攻略:异构多机分布式、满血版、蒸馏版,国产GPU支持,总有一款适合你!

自 DeepSeek R1 横空出世,其强大的能力便引发了私有部署的热潮。然而,面对单机量化模型的种种局限,你是否也感到束手无策?单机算力捉襟见肘,部署配置繁琐复杂,并发吞吐难以突破,国产芯片适配无门…… 这些问题如同拦路虎,让私有部署之路充满荆棘。GPUStack 应运而生,为你扫清障碍,开启 DeepSeek R1 私有部署的新纪元!GPUStack(https:…- 0

- 0

-

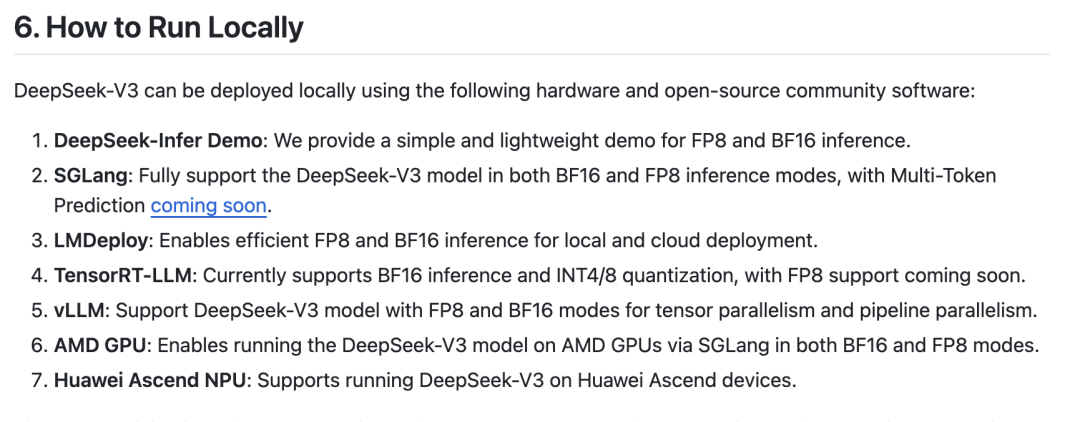

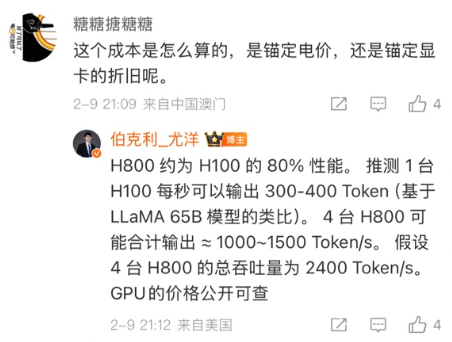

谈谈DeepSeek-R1满血版推理部署和优化

TL;DR春节假期开始, 好像很多人都在开始卷DeepSeek-R1的推理了. 渣B也被兄弟团队带着一起卷了一阵, 其实推理中还有很多约束, 比较认同的是章老师的一个观点: “推理框架很有可能就此走向两种极致分化的方向.“ 本文来做一个详细的阐述, 从一些乱七八糟的benchmark开始, 然后谈谈测试方法, 推理系统的各种约束, 推理框架的区别, 并行策略的区别,然后再解构一下DeepSeek的…- 0

- 0

-

一步步将DeepSeek R1微调成一个DeepDoctor(资深医生)

DeepSeek 颠覆了 AI 领域,挑战 OpenAI 的主导地位,推出了一系列先进的推理模型。最令人兴奋的是?这些模型完全免费,且没有任何使用限制,人人都可以访问。在本教程中,我们将对 DeepSeek-R1-Distill-Llama-8B 模型进行微调,使用来自 Hugging Face 的医学思维链数据集进行训练。该精简版 DeepSeek-R1 模型是通过在 DeepSeek-R1 生…- 0

- 0

-

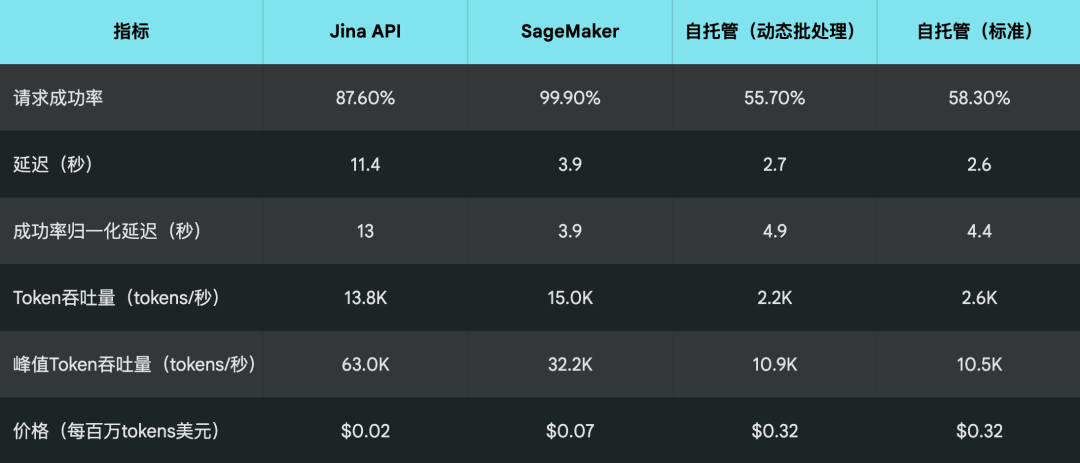

生产环境部署 Jina AI 搜索底座模型的实战指南

想要打造更好的搜索体验?选择合适的部署方案是关键。Jina AI 针对不同业务场景,提供了多种模型接入方式。本文将详细介绍各种部署方案,分析它们的优缺点,并结合实际业务场景,给出更实用的最佳实践建议,帮你快速找到最合适的方案。Jina 搜索底座模型概览我们的搜索底座模型(Jina AI Search Foundation Models)包括:Embedding 模型:通过向量空间映射,将数字对象转…- 0

- 0

-

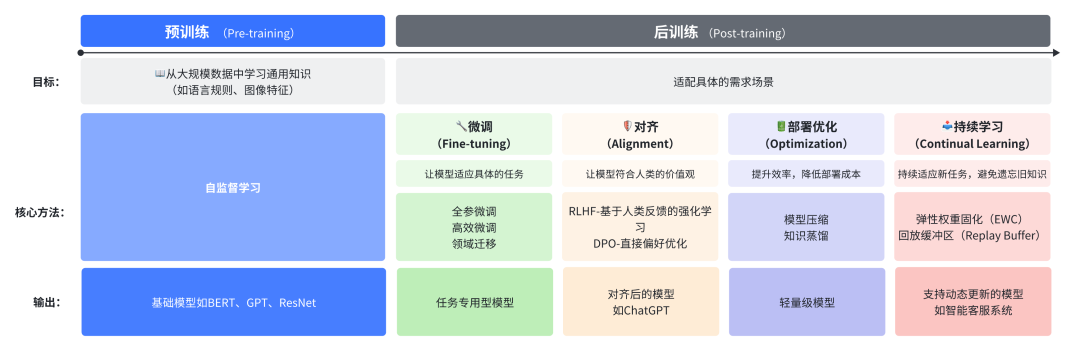

2025·人人都该懂一点的AI基础技术-ChatGPT、DeepSeekR1是如何被训练出来的?

写在前面。一周前,伴随着deepseek惊艳全球,我写了一篇以小白文科生视角理解蒸馏技术的学习笔记《Deepseek鲨疯了,但90%的人都不知道它提到的蒸馏技术是什么》,没想到居然有4万多人看过了。这也让我意识到:AI 已然成为家喻户晓的热词,但却仍然有很多像我一样怀揣着强烈的求知欲,却被一道道技术门槛阻拦的人。 互联网上当然也有很多非常棒的AI研究的学习资料,干货很多,但对于没有行业积累和技术背…- 0

- 0

-

Deepseek本地部署详细指南!从 Ollama 到个人知识库应用

系统介绍mbp pro一、Ollama 安装与配置1.1 跨平台安装指南Ollama 作为本地运行大模型的利器,支持三大主流操作系统:# macOS一键安装# Windows用户访问官网 https://ollama.com/download 下载安装包# Linux安装(Ubuntu/Debian为例)curl -fsSL h…- 0

- 0

-

运行 70B的LLM,需要多大GPU显存 ?

正如文章标题所言,你是否也曾好奇过:加载使用一个 70B 大小的 LLM,究竟需要多大的 GPU 显存呢?读完这篇文章应该会有答案。为什么是GPU,而不是CPUAI 本质上是大量的 矩阵 与 向量 运算 ,属于计算密集型运算,需要大量的内存空间来保存模型的训练参数。一般通用 CPU 运算单元都是标量 ,而 GPU 是一个把SIMD(单指令多数据)和…- 0

- 0

-

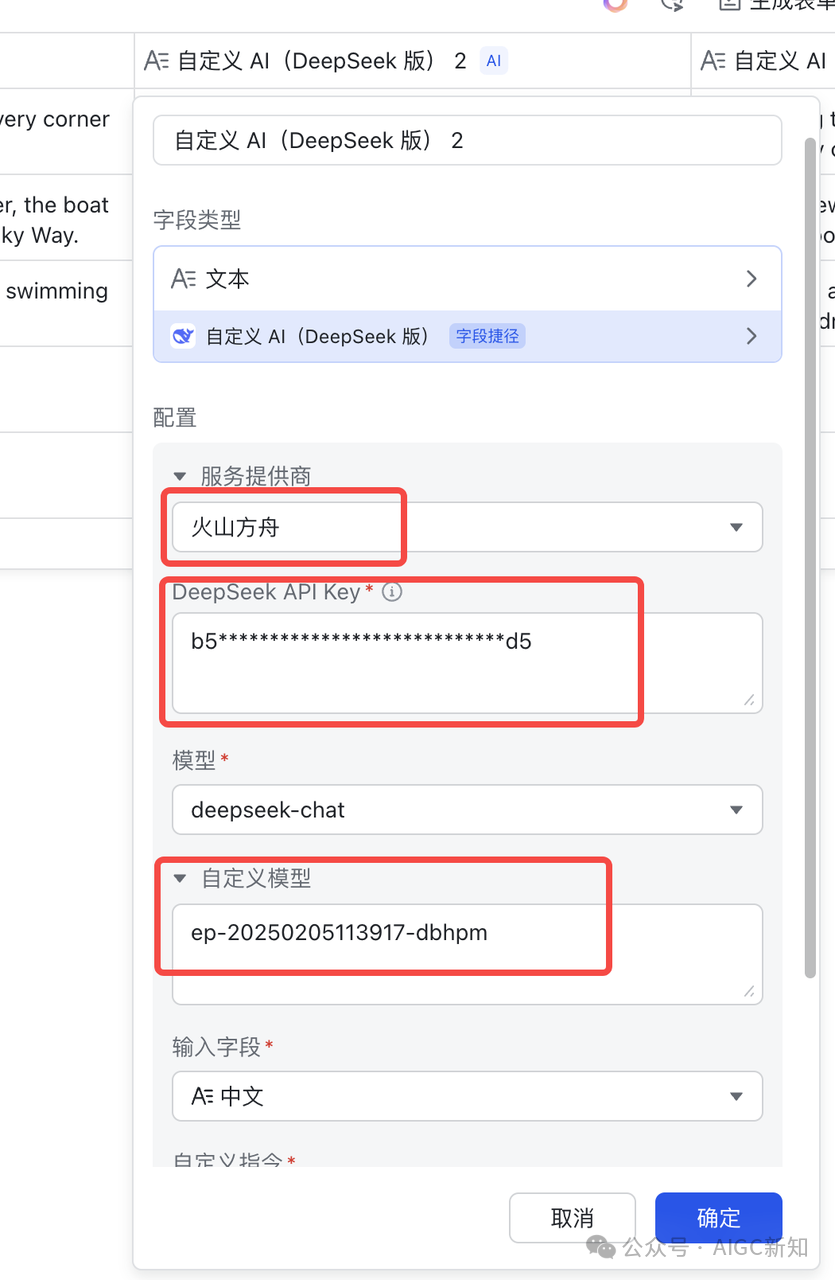

先进团队,先用飞书(多维表格+DeepSeek-R1)

现在及时支持火山引擎&硅基流动两家的API。在字段捷径中填写:- 服务商选择:火山方舟;- API key 填写在火山生成的(粘贴进去后,删掉多余的换行符)- 自定义模型:填写火山上的模型 ID(填写自定义模型后,优先使用自定义模型;官方模型是必选,但不会生效)- 服务商选择:硅基流动- API key:填写在硅基流动生成的 key- 模型:填写deepseek-ai/DeepSeek-R…- 0

- 0

-

高效微调大模型:XTuner 工具库全面解析

在大模型时代,微调(Fine-tuning)是让预训练模型适应特定任务的关键步骤。然而,微调大模型通常需要大量的计算资源和复杂的配置,这让许多开发者望而却步。今天,我们将介绍一款高效、灵活且功能全面的微调工具库——XTuner,它能够帮助你在有限的资源下轻松微调大语言模型(LLM)和多模态图文模型(VLM)。XTuner 是什么?XTuner 是由 InternLM 团队推出的一款轻量化大模型微调…- 0

- 0

-

一场技术突围战:DeepSeek如何让我扔掉百度飞桨和阿里OCR?

当产品经理突然要求"图片转结构化数据",这个春节我经历了从百度飞桨到阿里OCR,最终被国产黑马DeepSeek惊艳的技术选型之旅...一、需求暴击:3套方案生死时速年前接到的需求看似简单——将用户上传的图片转成结构化JSON数据。但当我们从CPU解析8秒/张的百度飞桨方案,转向需要精准结构化时,技术方案经历了三次迭代:1️⃣ 理想派方案:直接调用视觉大模型(ChatG…- 0

- 0

-

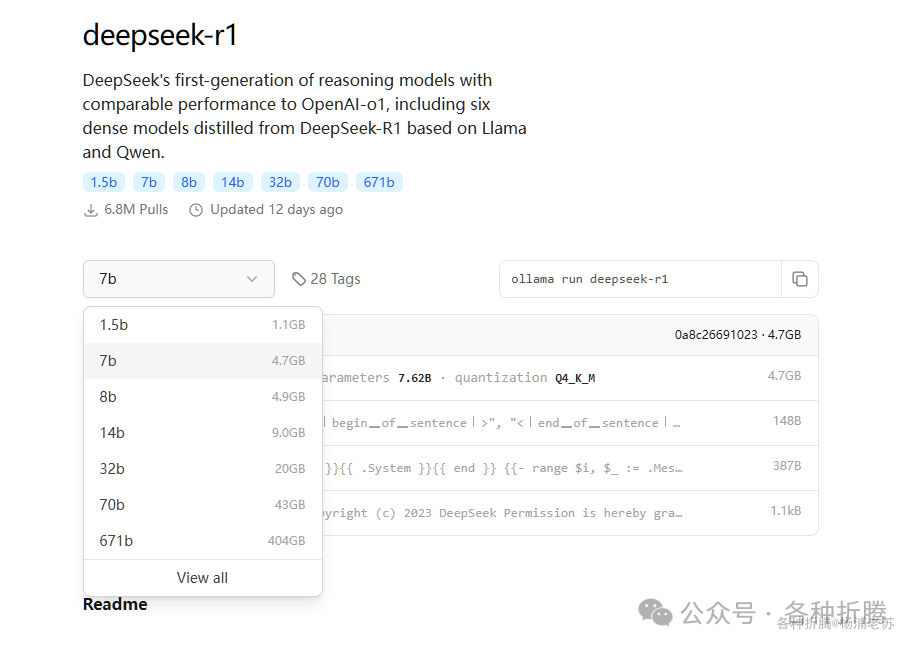

群晖上私有化部署DeepSeek-R1

简介上一篇介绍的 deepseek-free-api ,主要是提供接口服务,允许用户通过网络访问 DeepSeek 模型的能力。这意味着,尽管用户可以在本地容器中运行该 API,但实际的模型推理和处理仍依赖于远程服务器或云服务,用户在使用时需要考虑网络连接的稳定性和访问权限。什么是 DeepSeek-R1 ?DeepSeek-R1 是 DeepSeek 的第一代推理模型,在数学、代码和…- 0

- 0

-

推理模型的Prompt

缘起之前的 Prompt,针对的都是 SFT Model,清晰明确地表达自己的思路,引入 Few-shots 示范想要的「味道」,都是为了引导大模型「得我们的意」,输出符合我们需求的内容。GPT-o1,Deepseek-R1,这类 RL/RLHF Model 来了。它们在 SFT Model 基础上,引入了 RL 的训练方式,给模型 Q & A,让模型自己尝试推理如何从 Q ⇒ A。结果就是 SF…- 0

- 0

-

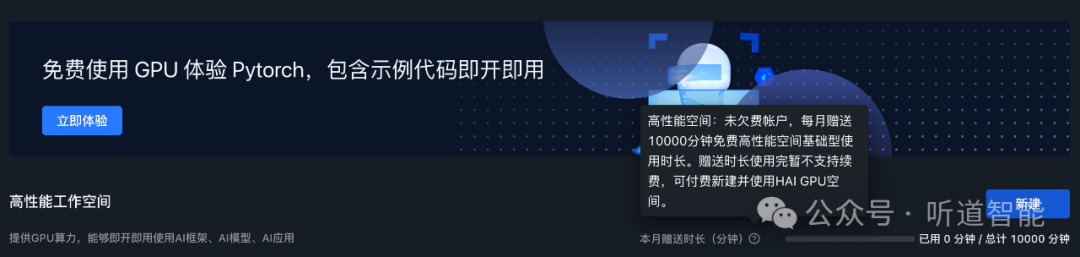

腾讯云究极薅羊毛部署最近爆火的DeepSeek

如果你还在看如何用ollama在本地部署DeepSeek这样的入门级文章,那是时候来看看高级一点的玩法了!ollama确实很适合新手小白,但是如果你看到的文章标题号称“企业级”还在教你下载ollama,那你可以直接拉黑那个文章作者了,确信无疑是在误人子弟和蹭热点。不会有哪个“企业”真的用ollama在生产环境部署大模型服务。好了,进入正题!既然是薅羊毛,就得找到这只羊,这次,我们选腾讯云。腾讯云最…- 0

- 0

-

2个安装包1条命令搞定:DeepSeek-R1最佳本地部署+知识库+联网搜索

前言公众号上看了很多关于Deepseek部署的文章,要么讲的太复杂,要么就是操作不成功。其实甭管是免费也好还是解决服务器繁忙也罢。本质都是本地部署,本地部署本身就非常简单,只需要三步环境就可以搭建起来,剩下的就是配置。跟着下面的步骤操作真的是小白都能运行起来。1. Ollama 官方版下载下载地址:https://ollama.com/download2. AnythingLLM 下载下载地址:h…- 0

- 0

-

新增AI Agent,GitHub Copilot重大更新,超强自动化编程

全球最大开源平台之一GitHub在官网宣布,对AI编程助手Copilot进行了重磅更新,增加AI Agent模式,可以自动迭代代码,识别并修复BUG。GitHub同时还发布了另一个Agent—Project Padawan的预览版,主要协助开发人员自动执行一些重复、繁琐的开发流程,例如,设置开发环境、运行测试、合并代码等。此外,GitHub在去年10月推出的Copilot Edits功能现在可以使…- 0

- 0

-

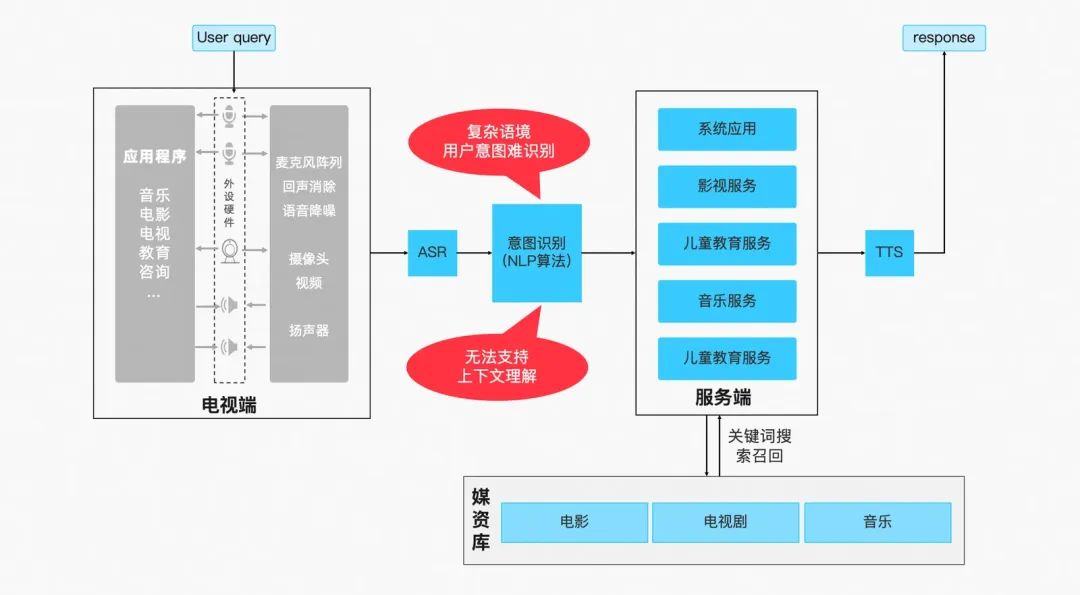

微调碾压RAG?大模型意图识别工程化实践

本文重点介绍大模型意图识别能力在智能电视核心链路中的落地过程和思考,对比了基础模型、RAG 、以及7b模型微调三种方案的优缺点。业务背景今年是智能电视行业在AI领域发力的元年,各厂家纷纷在自家电视OS中融入大模型能力,某国产品牌厂家更是提出了“可见即可说”的概念,希望借助AI大模型强大的自然语言处理以及逻辑推理能力,在电视端提升用户体验以及创造新的业务增长场景。通过下面这个视频可以先对整体交互有个…- 0

- 0

❯

购物车

优惠劵

搜索

扫码打开当前页

联系我们

返回顶部

幸运之星正在降临...

点击领取今天的签到奖励!

恭喜!您今天获得了{{mission.data.mission.credit}}积分

我的优惠劵

-

¥优惠劵使用时效:无法使用使用时效:

之前

使用时效:永久有效优惠劵ID:×

没有优惠劵可用!