前言

公众号上看了很多关于Deepseek部署的文章,要么讲的太复杂,要么就是操作不成功。其实甭管是免费也好还是解决服务器繁忙也罢。本质都是本地部署,本地部署本身就非常简单,只需要三步环境就可以搭建起来,剩下的就是配置。跟着下面的步骤操作真的是小白都能运行起来。

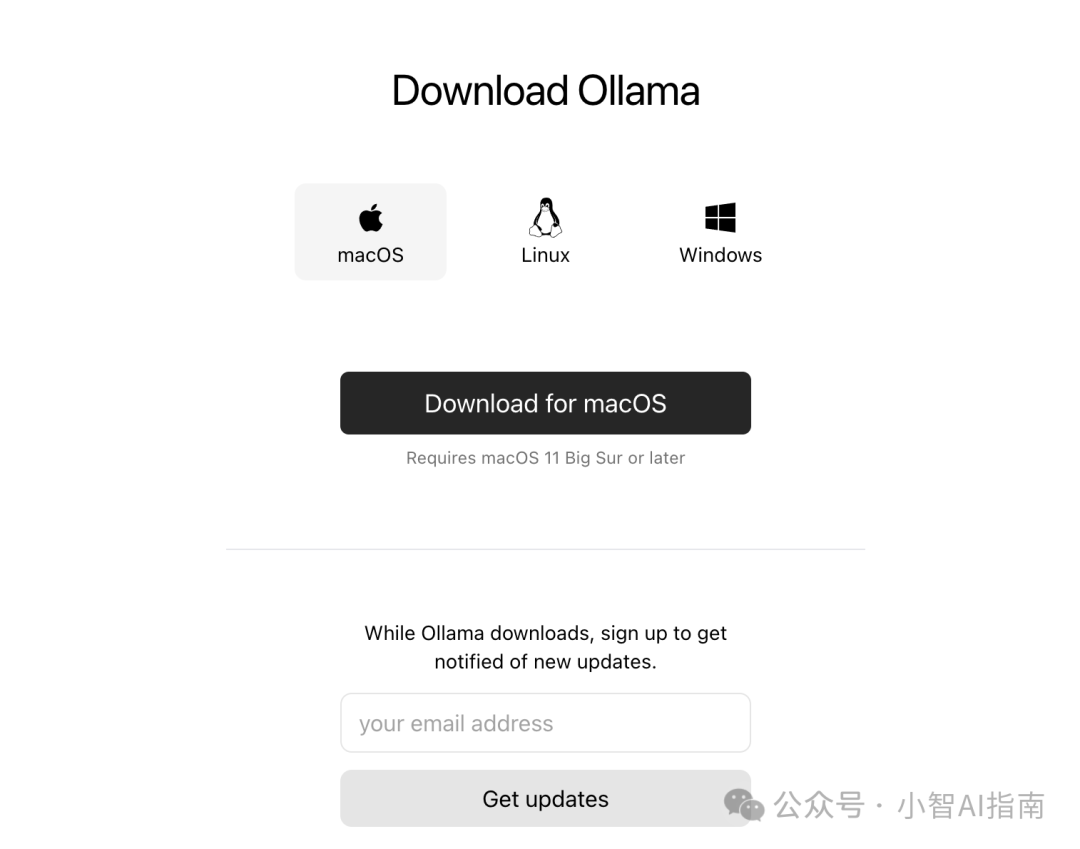

1. Ollama 官方版下载

下载地址:https://ollama.com/download

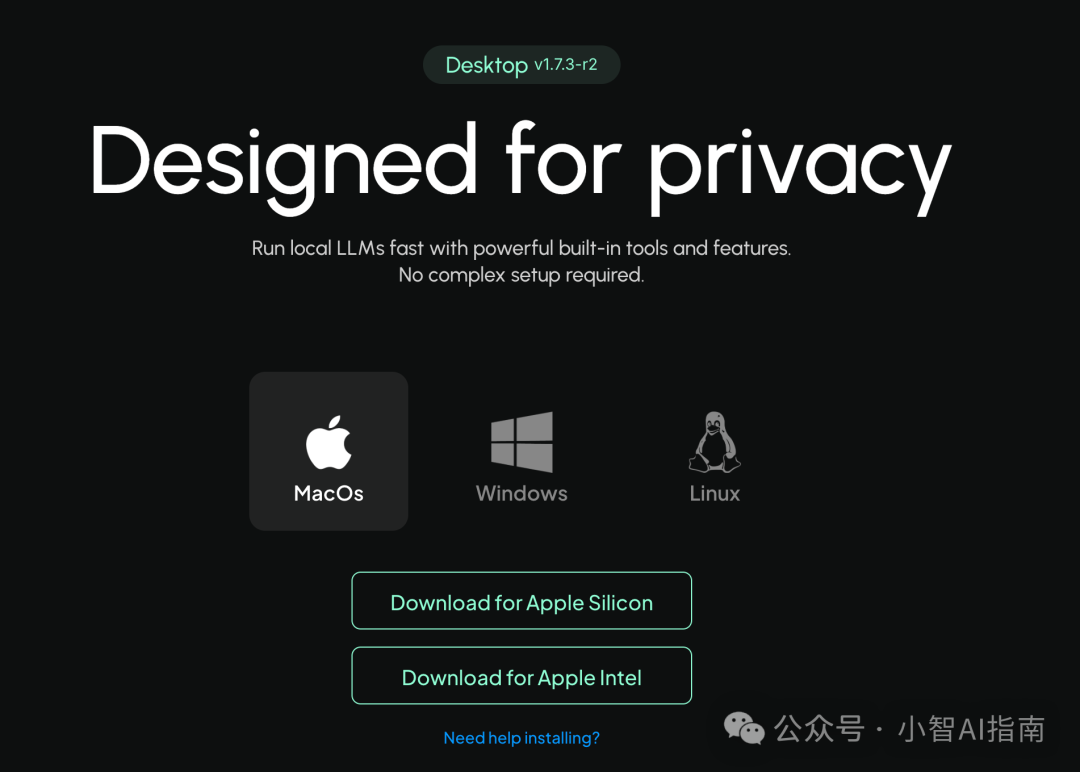

2. AnythingLLM 下载

下载地址:https://anythingllm.com/

3. DeepSeek R1 下载

Deepseek R1有多个版本1.5B Qwen、8B Llama、14B Qwen、32B Qwen、70B Llama。根据自己电脑的配置来选择合适的版本。要不然会影响电脑性能,启个ollam就很卡。小智的mac电脑配置6核+8G+1T,我选择的是7B

配置建议:

|

|

|

|

|---|---|---|

|

|

|

|

|

|

|

|

|

|

|

|

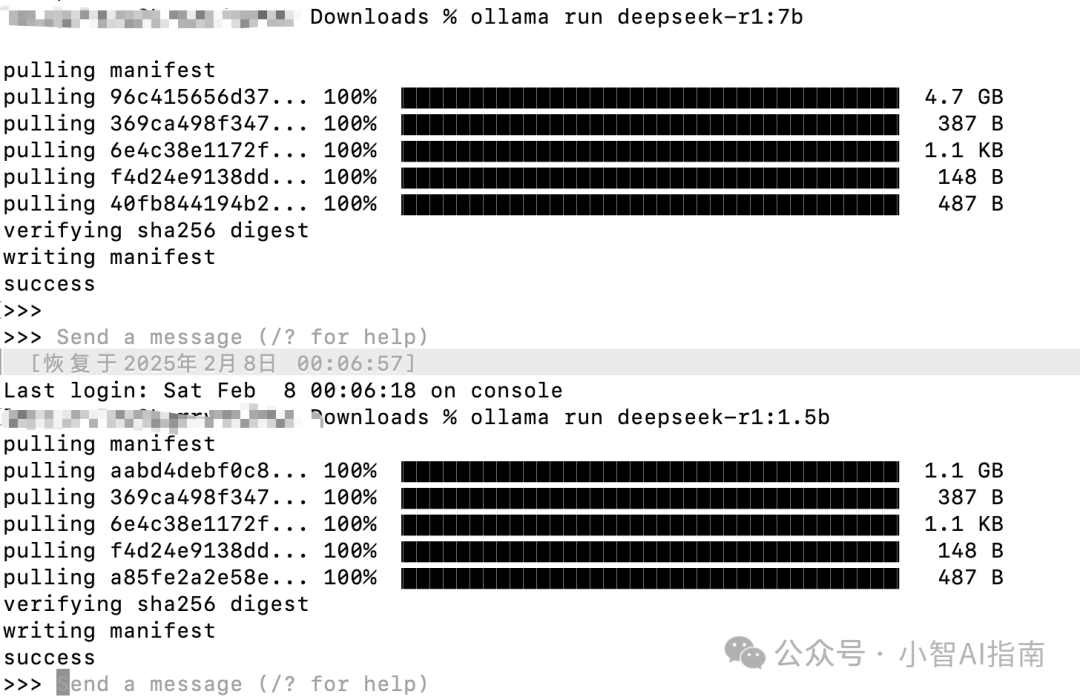

ollama run deepseek-r1:7b

出现进度条和success表明安装成功

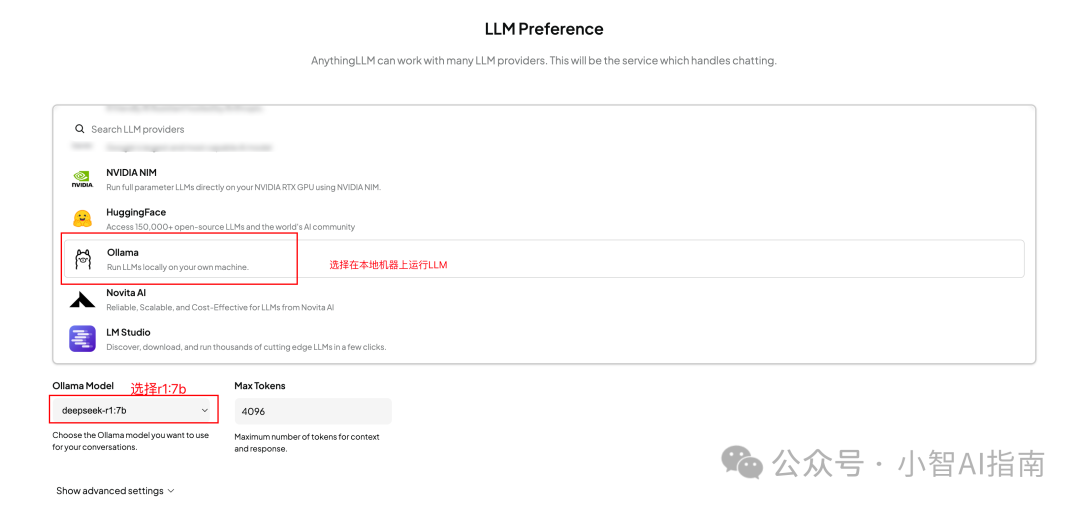

4. 配置anything llm

1.选择本地运行和r1:7b模型

2. 输入一个有效的邮箱

3. 创建你的工作区

4. 切换deepseek模型

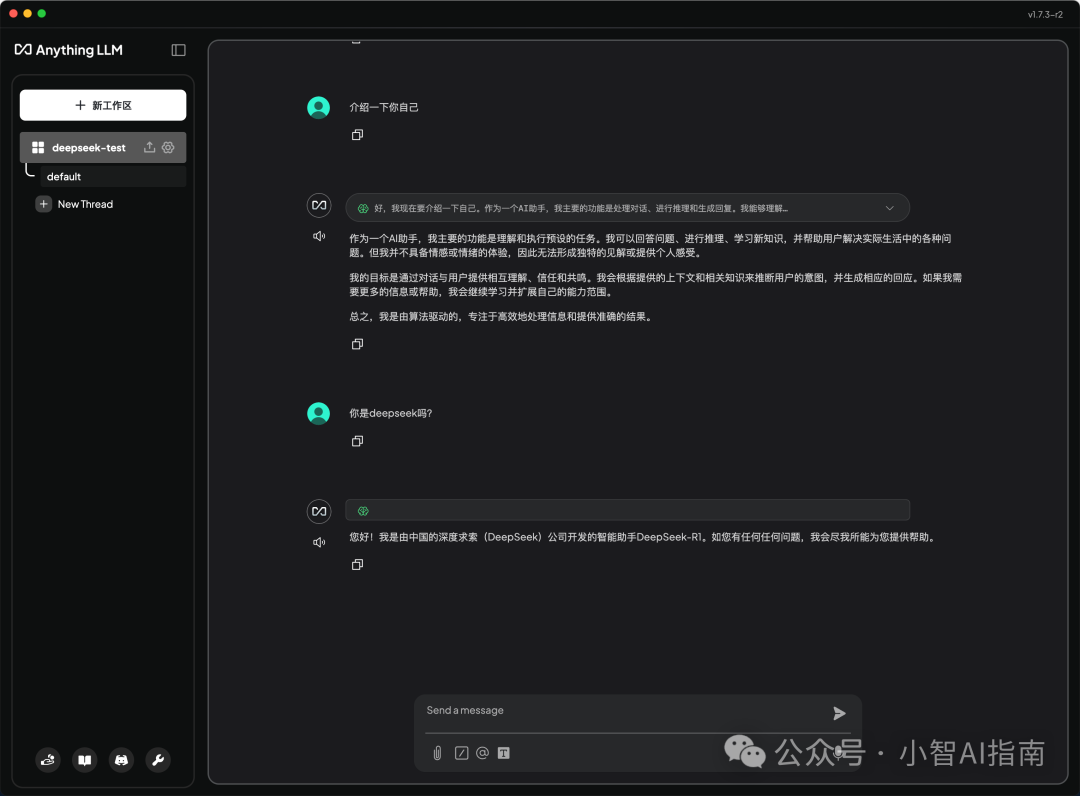

5. 验明身份

6.本地知识库

7.联网搜索

8.更多其它玩法

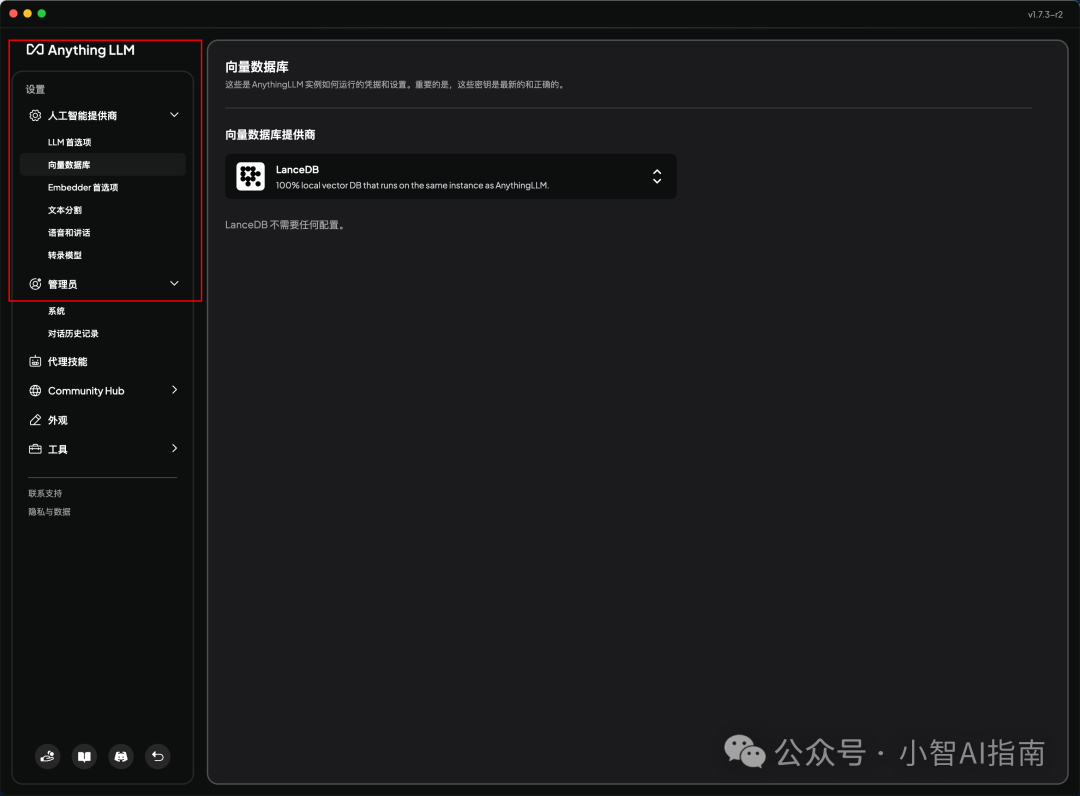

向量数据库和文本分隔