-

RoostGPT:改变了自动化软件测试的游戏规则

(RoostGPT架构、工作原理示意图)Artillery 中的 API 测试用例 — 能根据用户的反馈进行增强API 测试数据 — 用户可添加/修改值集成测试用例除了 API 和集成测试之外,Roost.ai 还将其支持扩展到各种编程语言,包括 Go、Python、Java、Node.js 和 C#。这允许 Roost.ai 生成在语法和语义上与特定于语言的最佳实践和测试框架(例如适用于 Jav…- 0

- 0

-

8分钟打造一个DeepSeek API智能测试引擎:当咖啡还没凉,测试报告已出炉

最近忙完Jira cloud xray SDK的开发,稍微空了一丢丢的时间,趁下班时间,快速分享一个LLM全自动化API测试的场景,希望抛砖引玉,拿回家(厂)里能用到。相信很多人都有同感,过去很多花了几千块票钱(当然是公司的钱)去听的AI大会,多数时间是听了个寂寞,听的LLM赋能测试的讲座基本都是看看就好,很难落地到自己家。8分钟系列争取能做到开箱即用,所有的测试工程师能享用的LLM才是好的LLM…- 0

- 0

-

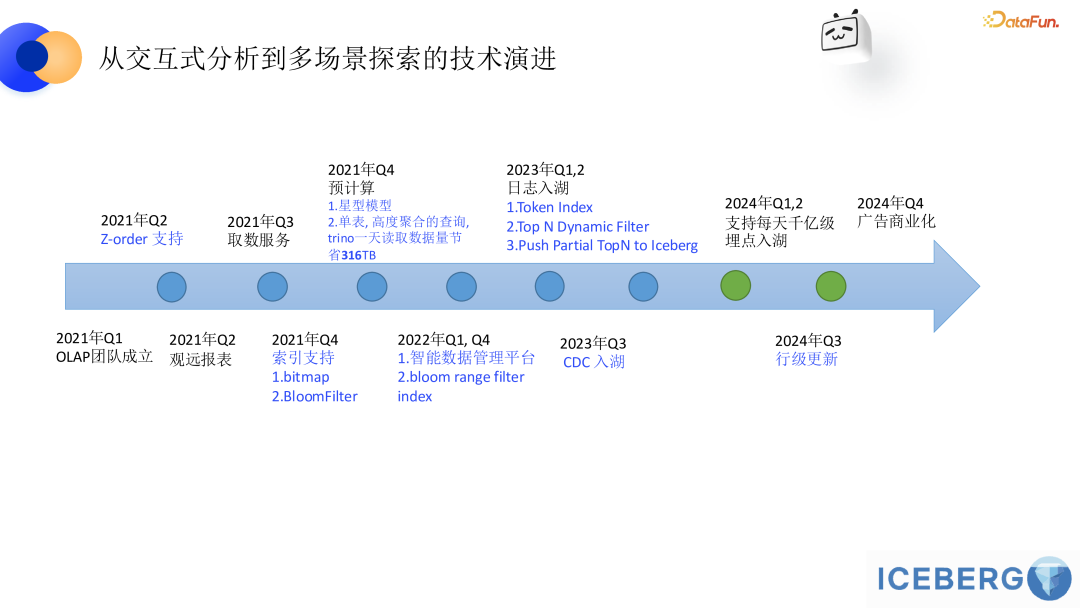

lceberg 助力 B 站商业化模型样本行级更新的实践

导读 本次分享重点讲解了 Iceberg 的业务应用,涵盖特征调研、更新场景支持及性能兼顾等实际应用,包括在 branch 上支持独立 schema 的实现,优化特征调研流程;通过 ColumnFile 实现灵活高效的更新场景;以及宽表治理与数据回刷方案,显著提升了数据管理和使用的灵活性,为复杂业务需求提供了高效解决方案。主要介绍以下五个部分:1. 从交互式分析到多场景探索的技…- 0

- 0

-

单卡4090微调DeepSeek-R1-32B

用上篇文章 单卡 RTX 4090 用 unsloth 和医学数据微调 DeepSeek-R1-Distill-Qwen-14B 同样的方法,也可以在 24G 显存的单卡 4090 上微调训练 deepseek-ai/DeepSeek-R1-Distill-Qwen-32B;即使该模型的权重文件大小已经达到 62G,这是因为 unsloth 和 lora 的量化微调和部分参数微…- 0

- 0

-

QwQ总结能力测评,32b小模型真能超过deepseek吗

最近阿里通义QwQ-32B在一系列基准测试中进行了评估,各项能力甚至接近deepseek-r1,一个32b模型竟然和671b模型能力差不多。 阿里是用了什么魔法嘛,我们先来看看他们介绍是怎么做到的吧。 QWQ基于冷启动开展大规模强化学习。初始阶段,特别针对数学和编程任务进行RL训练。与依赖传统奖励模型不同,通过校验生成答案的正确性来为数学问题提供反馈,并通过代码执行服务器评估生…- 0

- 0

-

为什么vLLM做不到?解密Ollama越级部署黑科技:以DeepSeek-R1-8B为例

最近在折腾双4090GPU,近200g内存服务器vllm部署70b的实验。使用ragflow知识库。按照我之前使用ollama的理解,我觉的部署70b应该没啥问题,然后一个个的坑。先说下• 部署30b,还是很流畅的,但是推理能力确实比较弱• 部署70b,通过不断地优化参数,最大tokens,4096 tokens没问题(还部署了一个bge-m3)• 但是在ragflow中使用的时候,由…- 0

- 0

-

为什么Manus底层模型没用DeepSeek?——Manus六问六答

在Manus迅速出圈之后,各种信息漫天飞舞,有严肃分析和解读,但并不多,更多的是各类博主(特别是短视频博主)震惊体式的摇旗呐喊。那么在Manus各类信息过载的同时,潘寒试图从各种信息中抽出部分有价值的进行分析,总结了六个问题。力求让读者看懂“是什么”之后也真正搞懂“为什么”,同时在眼花缭乱的AI信息爆炸中破除FOMO焦虑——一、为什么Manus底层模型没用DeepSeek?Manus各类出色任务背…- 0

- 0

-

Cherry Studio 发布 v1.0.0 版本支持联网搜索

Cherry Studio 工具最近更新发布了 v1.0,0 版本,本次更新带来所有模型联网能力。如果在用这款工具的小伙伴应该也会收到更新的弹窗提示进行更新。搜索配置首先,我们需要配置一下搜索工具才能够在对话框中使用这个功能从界面上可以看到,这个搜索功能其实是需要用到第三方平台的服务 tavily,并配置对应的 API Key 才能够使用…- 0

- 0

-

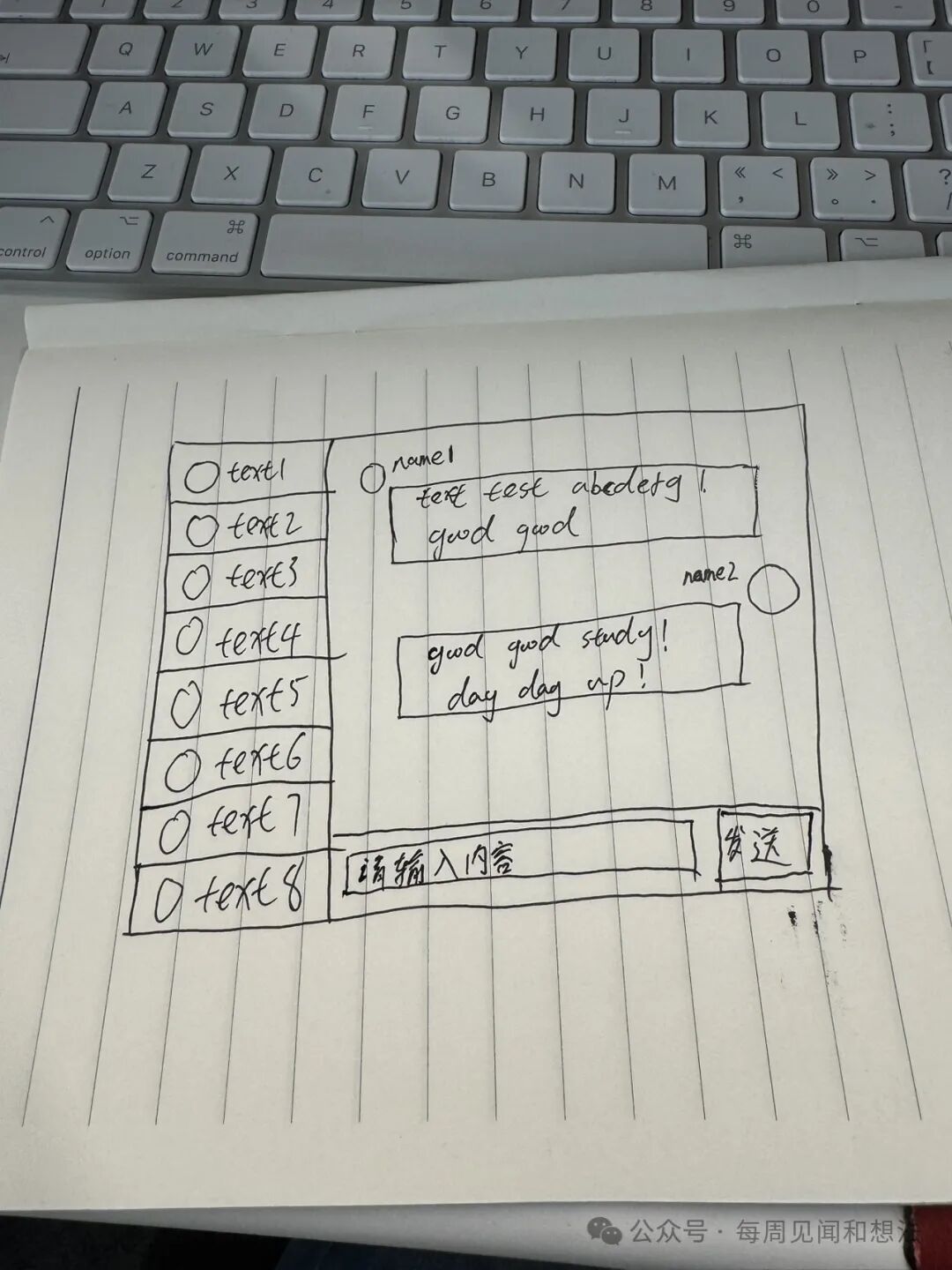

Claude 3.7 Sonnet 使用结论

前言2 月 24 日 Anthropic 发布了 Claude 3.7 sonnet,之前使用 claude 3.5 sonnet 的时候就很惊艳,所以迫不及待的想试一下 claude 3.7 sonnet 的效果。正文测试方法提供一张手绘的 UI 图给 Claude 3.7 sonnet,让它生成对应的代码。这里分别让他生成 iOS 和安卓的代码。 iOS 选择了 SwiftUI,安卓选择了 k…- 0

- 0

-

Manus,为何是他们做出来了?

故事从去年10月26日说起,在那天,黄叔非常喜欢的Arc浏览器被创始人Josh Miller决定战略性放弃,开始开发新的AI Agent浏览器Dia: 同一天,HideCloud和Peak刚从武汉飞回北京,落地后,HideCloud震惊的发现,打开手机刷的第一条推特就是上面这条,因为,此前的两天,他们在武汉决定了终止AI浏览器的研发工作,莫名其妙的中美两只团队在同一刻达成了共识。 为何放弃A…- 0

- 0

-

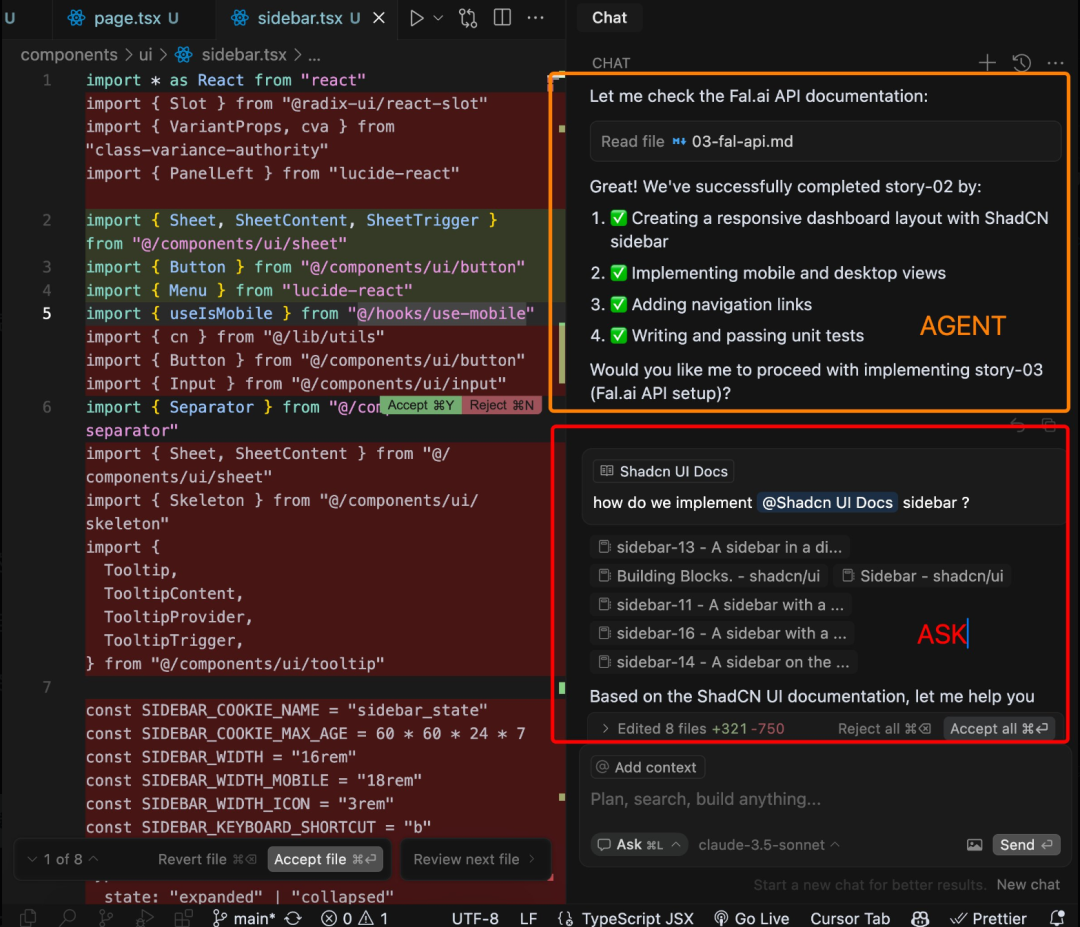

Cursor 新版本要来了!同一个窗口使用Agent+Chat!上下文增强、UI升级、界面更清爽。

Cursor的v0.46要来了。Composer 与 Chat 结合使用,界面更清爽,agent更聪明。开发团队正在小范围测试,确保万无一失。更新会自动推送,不用着急去官网下载。完整更新日志到时候会在cursor.com/changelog公布。开发团队还在后台准备更多惊喜。这次更新,让我们的工作效率再提升一点,让使用体验再美好一些。我们先来一览社区发现的Cursor新变化:• 新的 C…- 0

- 0

-

Cursor + MCP:效率狂飙!一键克隆网站、自动调试错误,社区:每个人都在谈论MCP!

AI 需要与现实世界的数据建立联系,MCP 即将变得极为重要,开发工具正在走向一个全新的时代。MCP的实用性令人惊叹。WindSurf + Firecrawl MCP 一键克隆Grok聊天网站:我后面会介绍这种方法,并实战演示。Browser Tools MCP(与后文Playwright类似) 从浏览器实时修复控制台错误此MCP开发者为Ted Werbel:https://www.ag…- 0

- 0

-

DeepSeek-进阶版部署(Linux+GPU)

前面几个小节讲解的Win和Linux部署DeepSeek的比较简单的方法,而且采用的模型也是最小的,作为测试体验使用是没问题的。如果要在生产环境使用还是需要用到GPU来实现,下面我将以有一台带上GPU显卡的Linux机器来部署DeepSeek。这里还只是先体验单机单卡,后期会更新多机多卡使用更高模型的文章。1.确认配置由于是虚拟机,并且虚拟机方面做了配置,所以这里并未显示真实显卡型号,实际型号:N…- 0

- 0

-

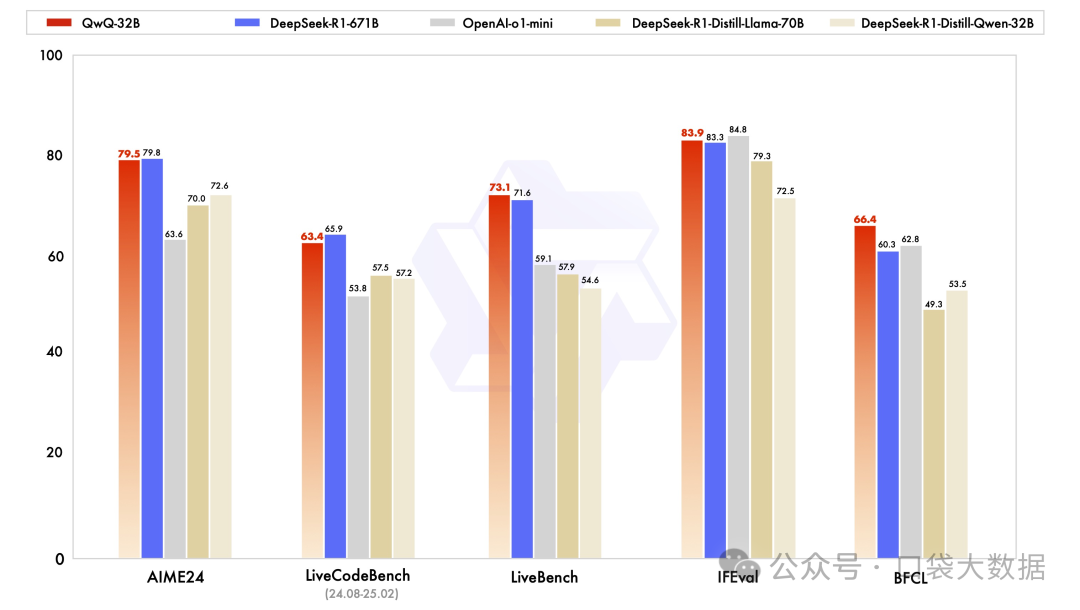

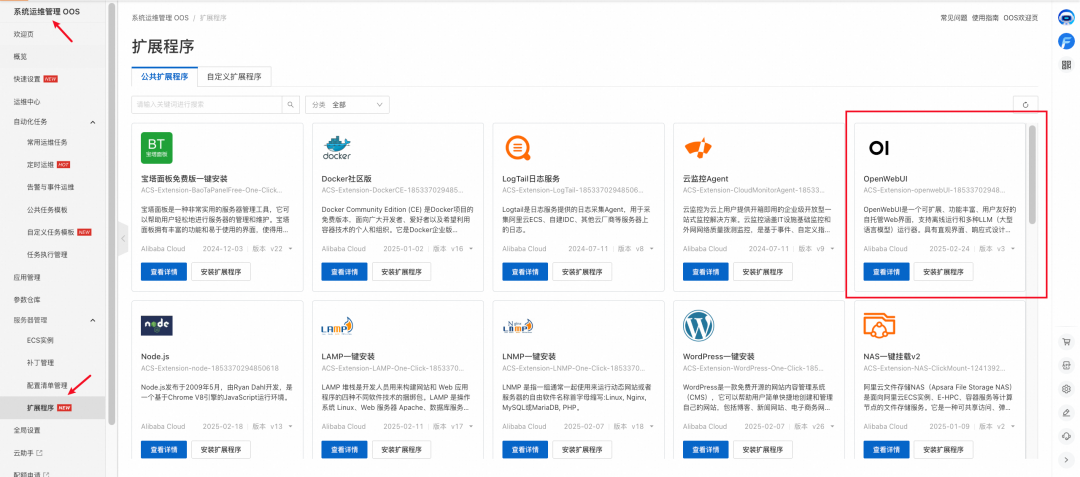

QwQ-32B一键部署!真正的0代码,0脚本,0门槛

阿里云发布的最新模型QwQ-32B,通过强化学习大幅度提升了模型推理能力。模型数学代码等核心指标(AIME 24/25、livecodebench)以及部分通用指标(IFEval、LiveBench等)达到DeepSeek-R1 满血版水平,各指标均显著超过同样基于 Qwen2.5-32B 的 DeepSeek-R1-Distill-Qwen-32B。阿里云系统运维管理(OOS)的公共扩展功能为您…- 0

- 0

-

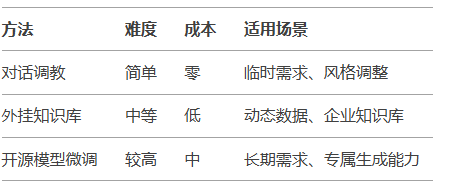

一篇文章讲清楚,到底如何训练自己的专属大模型

大模型就像一位“全能学霸”,能写文章、画图、解答问题,但它未必能完全贴合你的需求。比如,你想让这位“学霸”专门帮你写公司财报,或者生成你家宠物猫的专属表情包,该怎么办?今天我就用一篇文章跟你说清楚!方法一:大模型对话调教:像教小朋友一样核心逻辑:通过聊天,让大模型记住你的偏好。比如,你想让大模型用“鲁迅风格”写文案,可以这样调教:1)明确指令:“请用鲁迅的口吻,写一段关于年轻人熬夜的危…- 0

- 0

-

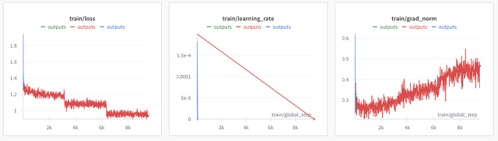

这可能是全网最保姆的DeepSeek微调教学

微调是增强大模型原生能力的最佳方法。借助微调,我们可以优化大模型的问答语气风格、可以增强模型推理能力和Agent 能力,甚至是进行专业领域的知识灌注。本次以医疗领域为例,对 DeepSeek 进行专项提升!最终达到问答风格优化 + 知识灌注目的,让模型在微调过程中掌握复杂医学问题的专业推理过程,并提高疾病诊断的准确率。这套微调流程可以适用于任意尺寸任意精度的 Deep…- 0

- 0

-

对o1模型的技术分析(重制版)

现在大家对o1都已经不那么关注了,(虽然说即使到现在其实很多人仍然不理解o1的能力)。在翻老文章的时候,发现之前对于o1的技术分析中猜错的部分较多,结合目前的信息应该重写一版分析了。所以标题叫做重制版,算是一个长期留存版本吧。0、回顾历史错误原因先反思一下为什么当时分析的方向错了,应该是受到以下因素的影响:拾象出了一个LLM RL范式的报告,虽然说现在来看RL这部分是对的,但其他并不对,现在看起来…- 0

- 0

-

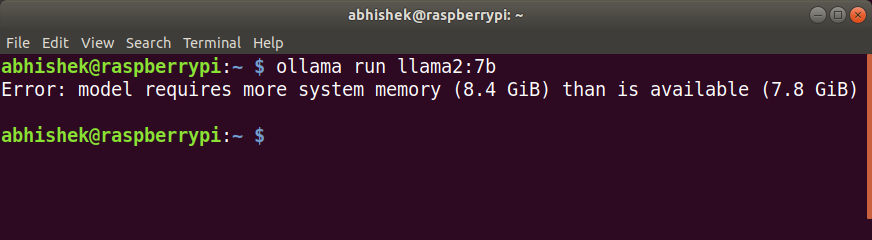

在树莓派5上运行9款流行的AI模型:哪些能用?哪些不行?

我在Raspberry Pi 5上运行了一些从非常基础到非常强大的AI模型。结果并不令人意外。先简单回顾一下,Raspberry Pi 5是一台小型电脑,配备4核Cortex-A76 CPU、高达8GB的内存和VideoCore VI GPU。它基本上是一台口袋大小的电脑。现在,真正的乐趣开始了。本次实验的参与者包括各种大型语言模型,它们各有优势和局限。我们将测试Phi-3.5B、Gemma2-2…- 0

- 0

-

LLM模型层+应用层 Full-Stack RL的一种设想

本文是一个超短文,不过后面具体方案倒是不短。正文Post-training阶段的RL直接从reward学习这点大家都已经知道,OpenAI o1和DeepSeek R1都为我们打了样,这里不展开。从API往应用层来看,workflow也可以纳入到RL过程中,直接针对一个多轮之后的业务reward进行学习。当然这里如果能把多个节点都使用同一个LLM的话,RFT时的显存占用会更小一些,不必维持多个模型…- 0

- 0

-

DeepSeek到底用了多少GPU?

关于这个问题,网上也是说法不一,甚至连“美国钢铁侠”马斯克也在疯狂质疑DeepSeek:不信只用了极少的芯片。那么DeepSeek到底用了多少GPU呢?最近国外网站SemiAnalysis对这一话题进行了分析,我个人觉得相对比较符合事实,我们今天拿过来一起来讨论一下。▉ DeepSeek与幻方对于密切关注AI大模型领域的人来说,DeepSeek严格意义上其实并不算一家新公司。DeepSe…- 0

- 0

-

速抢!体验TencentOS Server AI 全栈DeepSeek工具箱,获得80%提速

考虑到信息安全和个性化,很多企业都开始做私有化DeepSeek的部署,然而在部署过程中,通常一开始就会遇到这2个问题:部署复杂度高、推理性能不及预期。腾讯云针对这两个问题,发布了TencentOS Server AI,提供了从操作系统到AI框架以及模型的全栈式AI环境,一方面简化部署,另一方面通过高性能的AI框架,实现大模型如DeepSeek推理效率成倍的增加。本文介绍如何通过TencentOS …- 0

- 0

-

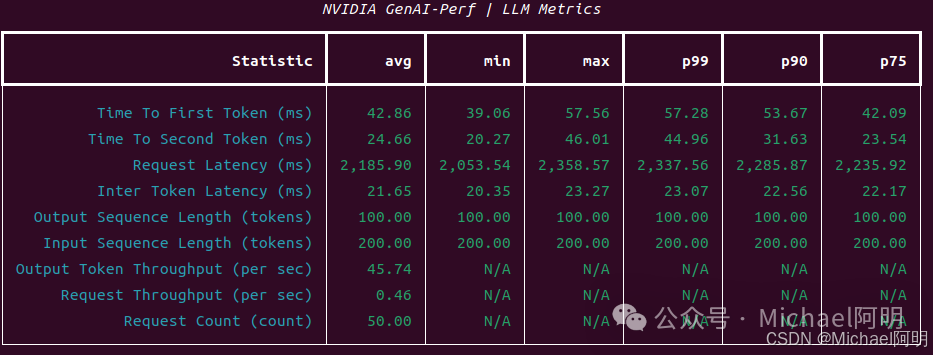

triton+vllm后端部署LLM服务

vLLM后端部署大模型部署步骤去 https://catalog.ngc.nvidia.com/orgs/nvidia/containers/tritonserver/tags 拉取 vllm 后端的镜像进入容器docker run -it --name triton_vllm_25.01 --ipc=host --network host --entrypoint…- 0

- 0

-

Ollama和vLLM我们到底应该用哪个?

今天和大家深入讲讲大语言模型(LLM)推理框架的不同优缺点对比,方便大家根据自己的场景选择合适的推理框架。这场对比并不是要找出来哪一个框架最好,而是要了解哪个框架在不同的场景中表现更出色。我们将重点关注以下几个方面:资源利用和效率部署和维护的便捷性特定的用例和建议安全性和生产就绪性文档让我们深入对比实践,看看最终结果如何吧~?基准设置 ⚡为了确保公平对比,我们将为两个框架使用相同的硬件和模型:硬件…- 0

- 0

-

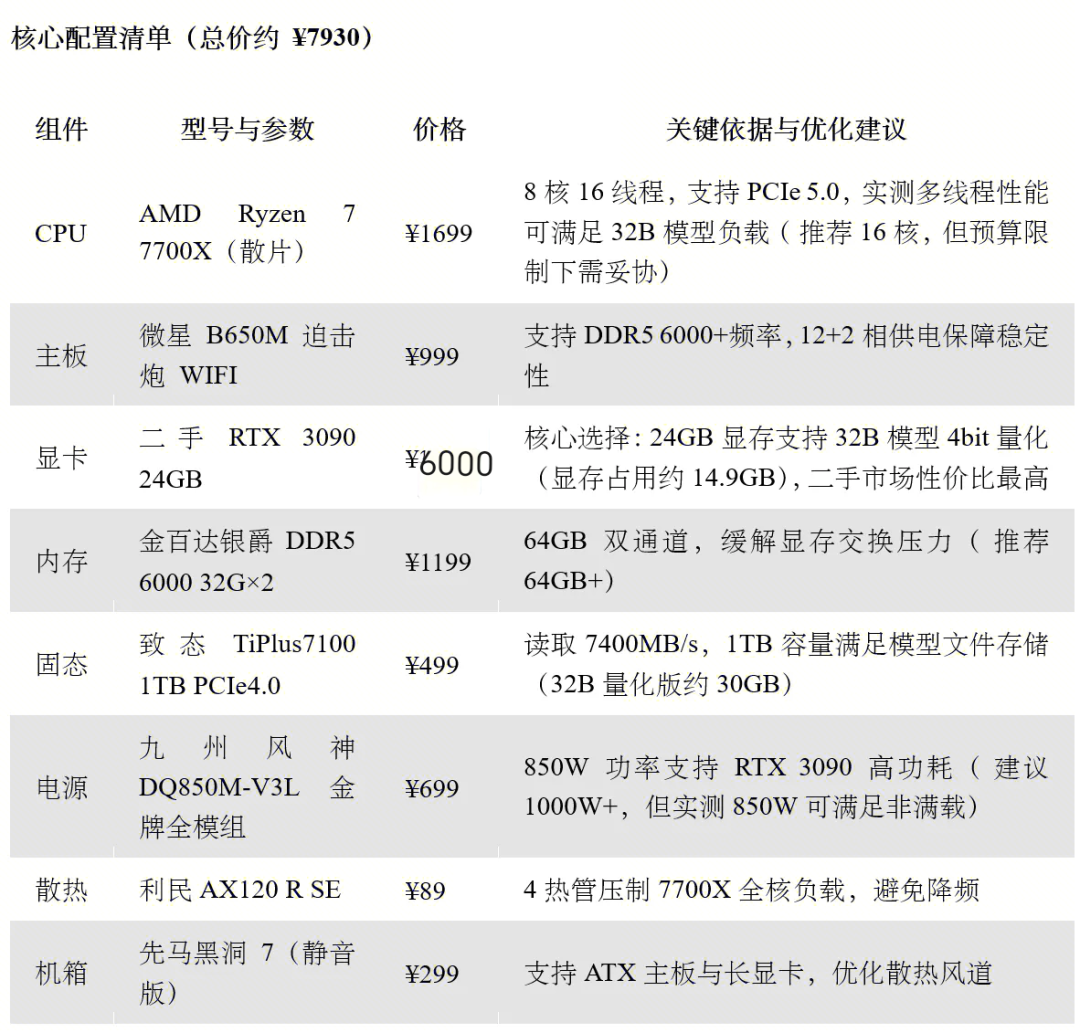

不建议在本地部署DeepSeek-R1:32B以下小模型,文末推荐适用主机

今年以来,随着DeepSeek-R1蒸馏模型对电脑要求的降低,许多AI爱好者尝试在个人电脑上部署本地模型,希望实现高效写作、知识库管理或代码生成等功能。然而,笔者在实测中发现,DeepSeek系列中参数量低于32B的模型(如1.5B、7B等)在本地部署后表现平平,仅能满足基础对话需求,而在复杂任务中难堪大用。本文结合实测结果分析原因,并建议爱好者本地至少部署32B的模型,最后文后推荐一套总价约10…- 0

- 0

❯

购物车

优惠劵

搜索

扫码打开当前页

联系我们

返回顶部

幸运之星正在降临...

点击领取今天的签到奖励!

恭喜!您今天获得了{{mission.data.mission.credit}}积分

我的优惠劵

-

¥优惠劵使用时效:无法使用使用时效:

之前

使用时效:永久有效优惠劵ID:×

没有优惠劵可用!