方法一:大模型对话调教:像教小朋友一样

核心逻辑:通过聊天,让大模型记住你的偏好。

比如,你想让大模型用“鲁迅风格”写文案,可以这样调教:

1)明确指令:

“请用鲁迅的口吻,写一段关于年轻人熬夜的危害。”

2)反馈修正:

如果生成的文案不够犀利,可以补充:“再尖锐一些,多用比喻,比如‘熬夜如同慢性毒药’。”

多次对话后,大模型会逐渐适应你的需求,甚至自动关联“鲁迅风”和“熬夜”主题。

方法二:外挂知识库(RAG):给大模型配个“移动硬盘”

核心逻辑:让大模型学会查资料。

比如,你想让大模型回答公司内部财务数据,但它原本并不了解这些信息。这时可以:

1)准备资料库:

将公司财报、制度文档等整理成结构化文件。

2)连接检索工具:

用RAG技术(检索增强生成),让大模型在回答时自动从资料库中查找相关内容。

3)生成答案:

比如提问:“2024年Q3的营收是多少?”大模型会先检索资料库,再结合检索结果生成回答。

方法三:开源模型微调:给大模型“上补习班”

比如,你想训练一个生成“水墨画风格猫咪”的模型,步骤如下:

步骤1:准备训练数据——收集“教材”

-

数据要求: -

20-50张高清水墨画猫咪图片(构图简单、特征明显)。 -

统一分辨率(如512×512),可用工具批量处理。

-

打标签:用工具(如Stable Diffusion的标签插件)为每张图片添加关键词,例如“水墨风格”“猫咪”“毛笔笔触”。

步骤2:选择微调方法——高效改造模型

推荐使用**LoRA(低秩适配)**技术,像给模型“打补丁”:

-

原理:只调整模型的一小部分参数(类似只修改学霸的“解题思路”)。 -

优势:训练快(几小时)、模型小(几十MB)、硬件要求低(家用显卡即可)。

步骤3:配置训练参数——设定“学习计划”

-

基础设置: -

训练轮次(Epochs):5-10轮(太多会“死记硬背”,太少学不会)。 -

学习率:0.0001(学习速度适中,避免“学偏”)。 -

高级技巧: -

混合精度训练:用FP16半精度节省显存(类似用简笔画学素描)。 -

梯度累积:显存不足时分批训练,累积效果后更新参数。

步骤4:训练与测试——验收“学习成果”

-

云端训练示例(以Google Colab为例): -

效果测试:

生成多组对比图,调整权重(如0.3-1.0),选择效果最佳的模型。比如权重0.7时,猫咪的水墨轮廓最清晰。

2)设置参数后启动训练,等待生成模型文件。

适用场景:

-

生成特定画风(如公司品牌插画)。 -

垂直领域问答(如法律咨询、医疗诊断)。

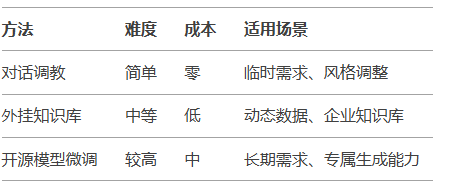

总结:三种方法如何选?