-

MCP 传输协议改进提案解读:从 HTTP+SSE 到"可流式 HTTP"

导读这个 Pull Request (#206) 提出了一个名为 "可流式 HTTP" (Streamable HTTP)的新传输协议,用于替代 MCP (Model Context Protocol) 当前使用的 HTTP+SSE 传输方式。这是一个重要的技术改进,旨在解决现有传输方式的一些关键限制,同时保留其优势。地址:https://github.com/mo…- 0

- 0

-

从 0 到 1,Agentic Ops 如何打造企业级 AI 生产力?

智能体时代的企业突围战随着大模型技术的飞速发展,Agent(智能体) 逐渐成为 AI 产业的核心驱动力。从 AutoGPT、Manus 这样的通用 AI 代理,到企业级智能助手,Agent 技术正在重塑人机交互方式,加速智能化应用落地。这场变革背后,是三大根本性范式转移:交互范式革命从“指令式交互”到“自然语言交互”的跨越,用户不再需要学习复杂系统,通过对话即可驱动智能体完成数据分析、流程审批等专…- 0

- 0

-

挑战4张2080Ti22G跑本地部署的DeepSeek 671b满血版大模型

前言最近因为访问人数过多,大家在访问Deepseek官网或是使用手机APP版本的时候,经常会遇到服务器繁忙,请稍后再试的情况。于是就出现了很多本地部署DeepSeek大模型的文章或者视频教程,但是跑跑轻量级的还好,如果想体验满血版DeepSeek R1 671B这种几百个G的大模型,那在本地部署所需的硬件配置与费用也会更高。各种版本的DeepSeek参数和本地部署的要求大家可以参考下图:为了能花更…- 0

- 0

-

比DeepSeek、o1高3倍!首创无服务器强化微调,只需十几个数据点,

今天凌晨,知名大模型训练、开发平台Predibase发布了,首个端到端强化微调平台(RFT)。与传统的监督式微调相比,RFT不依赖大量的标注数据,而是通过奖励和自定义函数来完成持续的强化学习,同时支持无服务器和端到端训练方法,从数据管理、训练模型到应用部署可以在同一个平台全部完成。也就是说,你只需要一个浏览器,设定微调目标、上传数据、就能完成以前非常复杂的大模型微调流程。在线体验地址:https:…- 0

- 0

-

如何去掉DeepSeek R1的思考过程

在与类似DeepSeek类似的大语言模型交互时,你是否曾经遇到过这样的困惑:DeepSeek-R1的思考过程是否可以去掉?大多数情况下,我们希望AI能直接给出答案,而不是在输出中展示“思考过程”。DeepSeek-R1会在回答前生成一个<think>标签,表示其推理过程。如果这个过程过长,用户可能会感到冗余,甚至影响使用体验。那么,能否去掉DeepSeek-R1的思考过程呢?答案是肯定…- 0

- 0

-

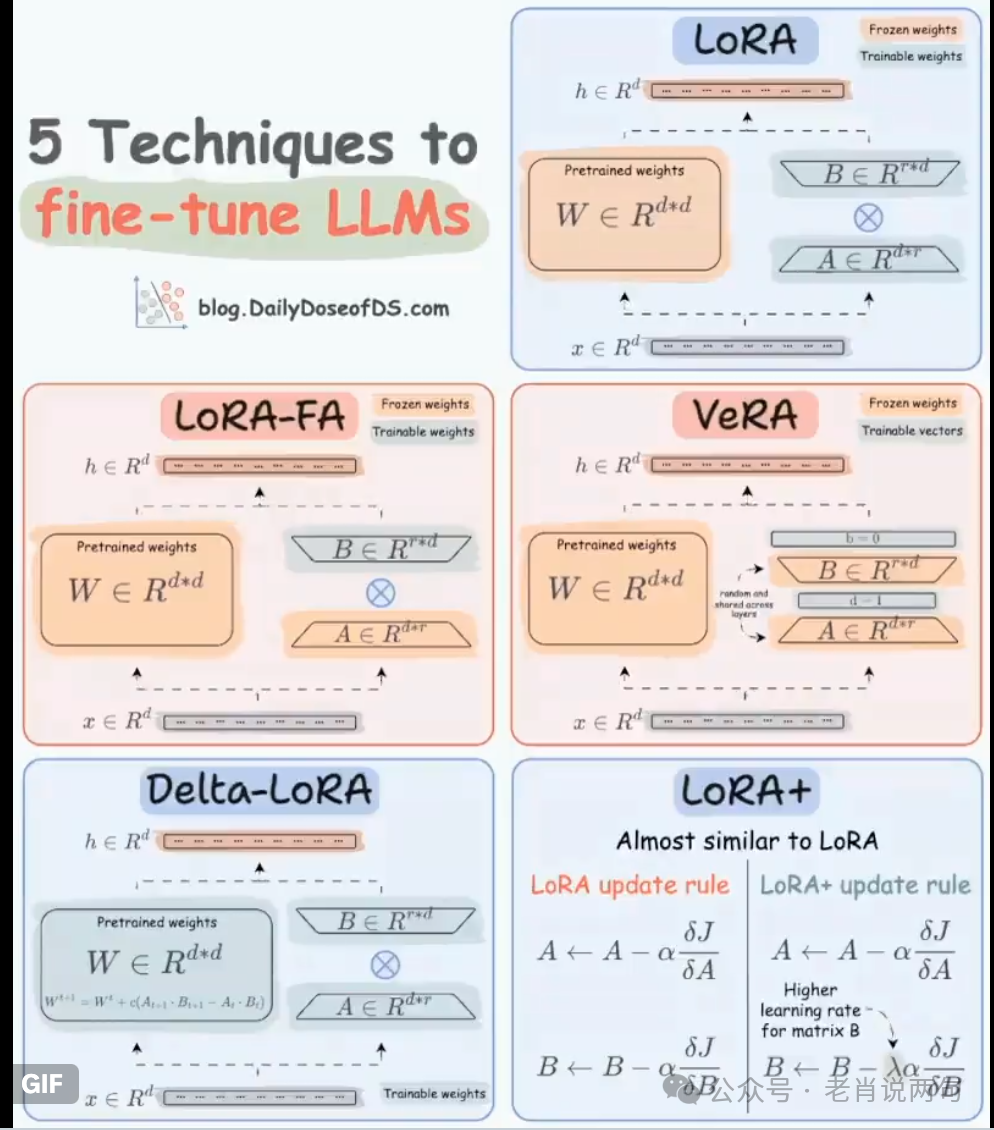

5种微调大语言模型(LLMs)的技术,一图看懂!

在人工智能领域,微调大语言模型(LLMs)一直是提升模型性能的重要手段。传统上,微调LLMs意味着要调整数十亿个参数,这不仅需要强大的计算能力,还需要大量的资源。然而,随着一些创新方法的出现,这一过程已经发生了革命性的变化。今天,我们将通过视觉化的方式,为你介绍五种最新的LLMs微调技术,让你轻松理解这些复杂的技术概念。1️⃣ LoRA(低秩适应)LoRA引入了两个低秩矩阵A和B,与主权重矩阵W协…- 0

- 0

-

党政机关举办Deepseek讲座培训时的重要考虑

当下,全民对AI尤其是Deepseek的热情持续高涨,党政机关和企事业单位纷纷掀起了学习的热潮。举办Deepseek讲座培训,学习内容上应该考虑以下三点,以确保培训效果最大化。第一,学习内容应从简单到复杂,注重同步操作和清晰演示。由于参与者的知识结构和学习能力各异,循序渐进的方式能够帮助大家更好地理解和掌握Deepseek的基本功能和使用技巧。通过实际操作,学员能够在动手实践中加深对技术的理解,避…- 0

- 0

-

MCP协议或迎来重大更新:引入Streamable HTTP传输

大家通过上面这张图简单了解一下什么是MCPMCP协议迎来重大更新,引入了全新的Streamable HTTP传输机制。这一更新解决了当前HTTP+SSE传输方式的关键限制,同时保留了其优势。这项改进得益于来自Shopify、Pydantic、Cloudflare、LangChain、Vercel、Anthropic团队及MCP社区众多成员的宝贵反馈。主要变更与当前HTTP+SSE传输相比,新版本有…- 0

- 0

-

大型语言模型(LLM)推理框架的全面分析与选型指南(2025年版)

1. 引言大型语言模型(LLM)已成为驱动智能客服、内容创作、代码生成等领域变革的核心力量。推理框架作为LLM高效部署的关键组件,直接关系到应用的性能、成本和开发效率。为帮助读者在繁多的框架中做出明智选择,本文将深入分析主流推理框架(如XInference、LiteLLM、LMDeploy、SGLang、vLLM等)的功能特性、性能表现、易用性及适用场景。结合DeepSeek AI的开源基础设施索…- 0

- 0

-

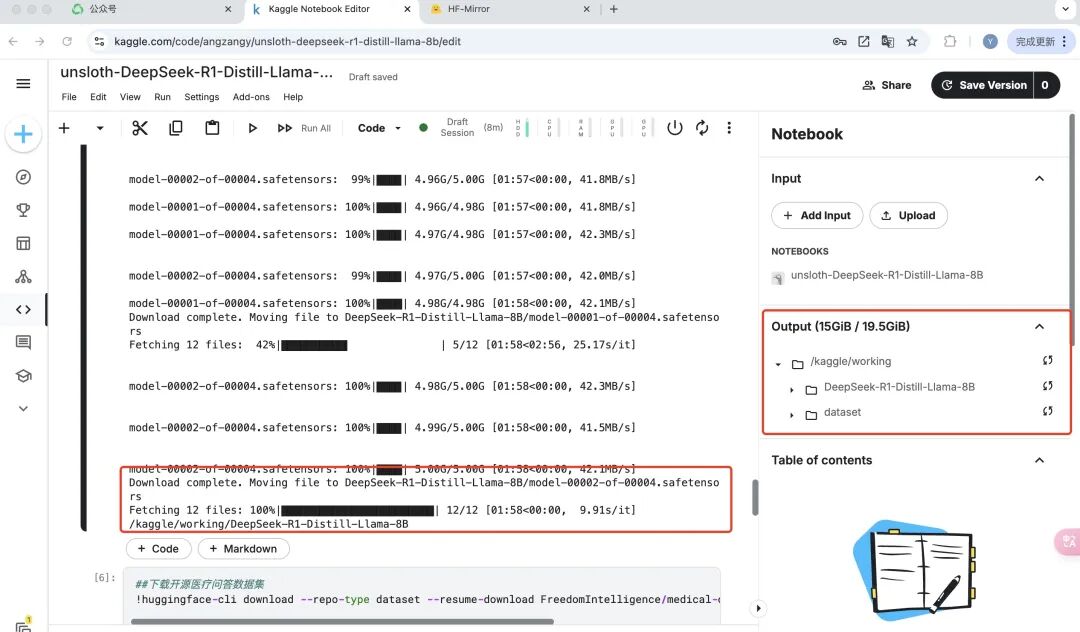

DeekSeek-R1大模型本地微调-构建医疗问答模型

本次使用hugging face开源数据集(dataset),在Kaggle Notebook(Kaggle Notebook教程请见免费GPU云服务使用指南-Kaggle Notebook)免费云服务上完成对DeepSeek-R1-Distill-Llama-8B模型的本地微调。1.注册wandb(https://wandb.ai/site)账号,获取wandb API key,来可视化训练过程…- 0

- 0

-

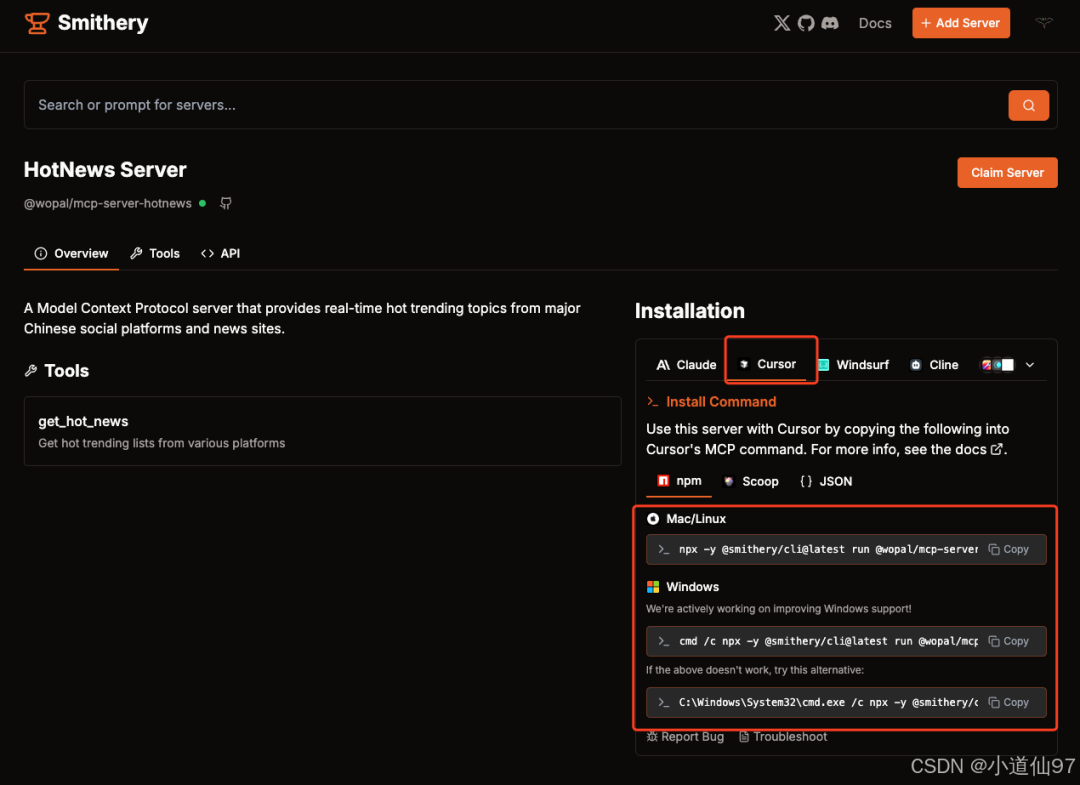

MCP入门实践,Cursor+MCP

一、引入问题1-1、方案一1-2、方案二1-3、方案三二、解决问题(实践MCP)2-1、获取MCP2-2、Cursor 配置MCP2-3、实战三、相关文档学习之前,需要知道什么是MCP(Model Context Protocol,模型上下文协议),官方的解释如下MCP 是一种开放协议,它标准化了应用程序向 LLM 提供上下文的方式。可以将 MCP 视为 AI 应用程序的 USB-C 端口。正如 …- 0

- 0

-

阿里大模型QWQ-32B低成本部署(两分钟了解AI社区最新动态)

近些年AI Agent井喷式发展,涌出一大批高性能的大模型,大大推动各行业发展和智能化水平发展。然而,性能优越的大模型往往具有庞大的参数量,想要部署到本地设备进行使用的话,对硬件性能要求较高,高性能的推理模型往往需要在高端的专业级显卡或者大规模的服务器集群上才能部署成功并进行使用,较高的使用成本和技术门槛使很多开发者和企业望而却步。性能强大却难以部署的困局以满血版DeepSeek R1为例,其功能…- 0

- 0

-

使用 VLLM 部署 DeepSeek:基于 Ubuntu 22.04 + RTX 4090 + Docker 的完整指南

最近,大语言模型(LLM)的部署已经成为 AI 开发者绕不开的核心技能。而 VLLM 作为一款高性能、低延迟的推理引擎,在大模型推理领域迅速崛起。今天,我就带大家从零开始,在 Ubuntu 22.04 + RTX 4090 + Docker 环境下,部署 DeepSeek模型,并让它跑起来!这篇文章适合那些想快速上手 vLLM 的开发者,文章涵盖了显卡驱动、CUDA、Docker 环境的安装,以及…- 0

- 0

-

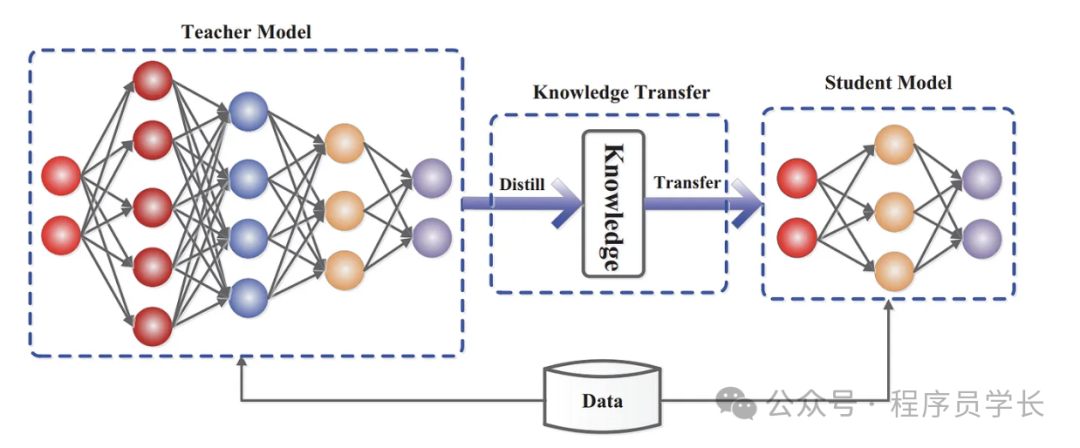

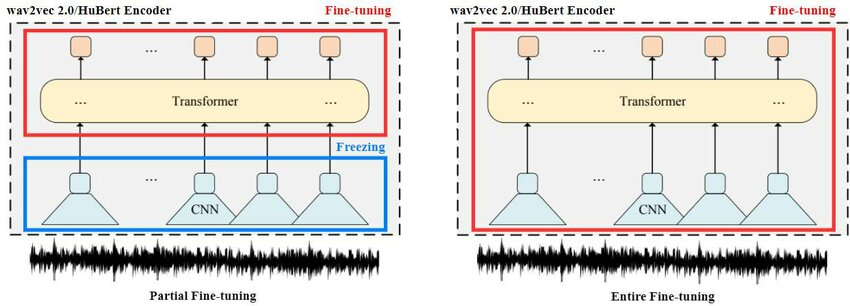

终于把深度学习中的微调、提炼和迁移学习搞懂了!!

今天给大家分享深度学习中的三个重要知识点,微调、提炼和迁移学习在深度学习中,微调(Fine-tuning)、提炼(Distillation,即知识蒸馏)和迁移学习(Transfer Learning)是三种常见的模型优化技术,主要用于提高模型的泛化能力、减少训练时间以及优化资源利用率。微调微调是指在一个已经训练好的模型(通常是预训练模型)的基础上,对部分或全部参数进行进一步训练,以适应特定的新任务…- 0

- 0

-

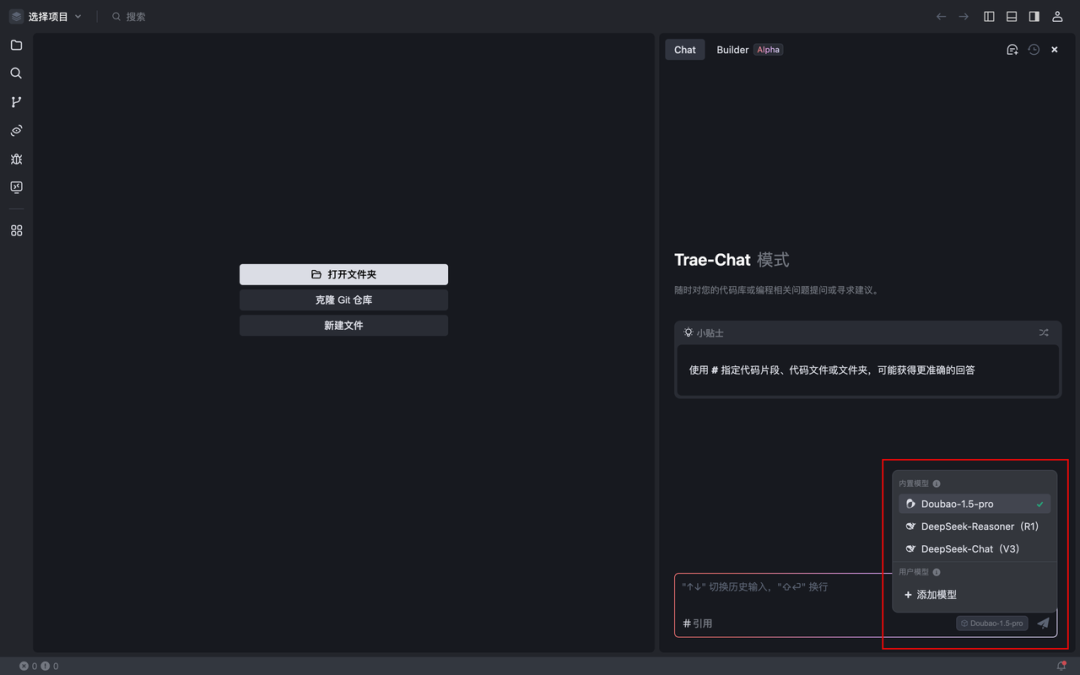

Trae 接入硅基流动 SiliconCloud,高效提升开发者编程体验

Trae 是由字节跳动发布的中国首个 AI 原生集成开发环境(AI IDE),以“人机协同、互相增强”为核心理念,对代码补全、代码理解、Bug 修复、基于自然语言生成代码等开发过程全场景都有非常好的适应性,不仅是一个开发工具,更是一位全天候开发“拍档”,为开发者带来更加高效、优质的开发体验。现在,Trae 预置了硅基流动 SiliconCloud 平台作为模型提供方,支持用户通过 API 密钥(A…- 0

- 0

-

《大模型微调的十种方法》

在人工智能领域,大模型已经成为解决复杂任务的核心工具。然而,直接使用预训练模型往往无法满足特定任务的需求,这时就需要对模型进行微调(Fine-Tuning)。微调的本质是让模型在通用知识的基础上,进一步学习特定任务的数据,从而提升性能。但微调并不是“一刀切”的操作,针对不同的任务需求、数据量和资源限制,有多种微调方法可供选择。本文将详细介绍10种大模型微调方法,从全参数微调到适配器微调,从提示微调…- 0

- 0

-

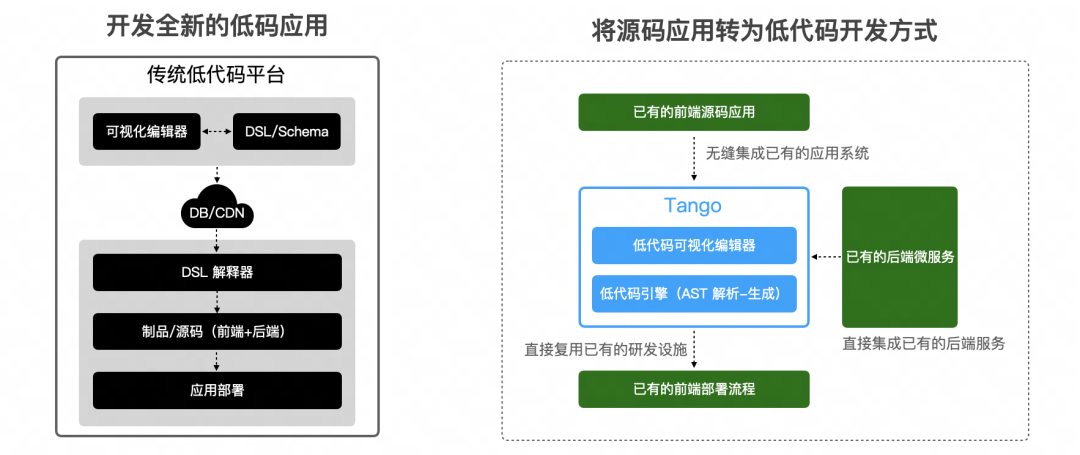

AI Code 在团队开发工作流的融合思考

2024 已过去大半,生成式人工智能(Generative AI)在软件工程领域中的应用已经变得越来越广泛和深入,传统的软件开发和交付过程正伴随着 AI 能力的介入而获得增强与革新。一方面,在源码开发模式中,AI Code 能力逐步渗透到开发工作流的每个环节中,包括建模,编码,测试,文档等;另一方面,低代码开发模式如何与大模型能力有机集合也成为低代码厂商新的命题,此外还面临诸多挑战,例如如何快速响…- 0

- 0

-

使用Ollama部署deepseek大模型

使用Ollama部署deepseek大模型前置条件 使用英伟达显卡下载cuda驱动https://developer.nvidia.com/cuda-downloadsOllama Ollama 官方版: https://ollama.com/我的显卡在Windows电脑上面 所以使用Windows的安装方式去安装若你的显卡是在Linux上面 可以使用如下命令安装curl -f…- 0

- 0

-

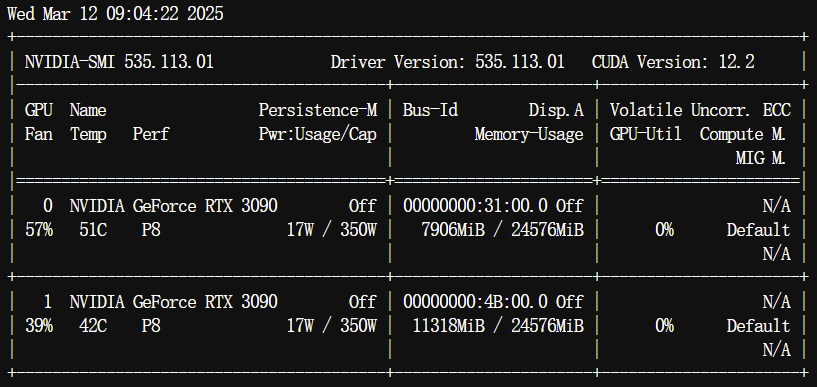

DeepSeek-R1的Qwen-32B蒸馏模型与QwQ-32B模型,谁更强?

由于硬件限制,让结果跑得顺畅一点,选择这两个32B参数的模型都以4-bit量化的方式加载运行,,同时将关键参数均设置为官方网站上建议的值,比如temperature设为0.6。为了确保不发生输出内容截断的情况,两个模型加载时设定的输出最大tokens为32K,也符合正常的思维链输出需要。同时推理代码也采用相同的代码,只针对模型本身的差异做调整,如路径不同。经过这样的比较就更加客观一点,更具有可比性…- 0

- 0

-

deepseek-r1:32b在低性能电脑部署运行

当春节的喧嚣逐渐沉寂红色的灯笼在夜空中渐渐暗淡夜色如同最柔软的丝绸轻轻披在每个渴望宁静的心灵之上在这春意盎然的时刻在这祥和的夜晚让我们一起学习部署DeepSee这个强大的AI大模型以其无与伦比的智慧为我们的数据处理带来革命性的进步让这份技术之美如同春节后的第一场春雨悄无声息地滋润你的心田引领我们探索智能新时代正片开始Deepseek本地部署适合的场景是数据不能公开,需要建立私有知识库,代替自己书写…- 0

- 0

-

简化 Cursor, Windsurf 和 Cline 的开发流程:揭示 8 个必备的 MCP Server 插件

背景随着智能体(Agent)技术的快速发展,MCP(Model Communication Protocol)协议因其易用性和高效性,逐渐成为智能体生态中的核心通信标准。越来越多的头部 AI 代码编辑器(如 Cursor、Windsurf 等)开始支持 MCP 协议,进一步推动了智能体的普及。而 Cline 更是推出了 MCP Server 市场,为开发者提供了丰富的工具选择。那么,在众多的 MC…- 0

- 0

-

部署DeepSeek的4条路,企业级客户到底该咋走?

2025开年以来,各路行业客户纷纷掀起了DeepSeek部署热潮,各种比学赶帮超…那么,怎样才能不落人后,快速把DeepSeek投入生产呢?目前看,主要有四种路径↓❶ 采购DeepSeek一体机:优点:本地部署开箱即用;缺点:满血版一次性采购成本较高,蒸馏版则可用度不够,未来模型迭代、算力扩容、系统维护、软硬件升级都受限。❷ 基于原有基础设施部署:优点:可利旧,盘活闲置算力,本…- 0

- 0

-

部署Ollama后端引擎运行LLM

自己使用ollama部署大模型的一些笔记1、linux 安装 Ollama 部署框架1.1、初次安装Ollama 官网命令行安装国内网络卡顿,仓库直接下载 tgz 文件,超级管理员解压安装。curl -L https://ollama.com/download/ollama-linux-amd64.tgz -o ollama-linux-amd64.tgzsudo …- 0

- 0

-

内网服务器离线安装部署 DeepSeek

安装 OllamaOllama 官网:https://ollama.com/1. 安装curl -fsSL https://ollama.com/install.sh | sh二进制文件安装:使用 curl 命令下载或者直接在 Github 上下载二进制文件curl -L https://ollama.com/download/ollama-linux-amd64.tgz -o ollama-li…- 0

- 0

❯

购物车

优惠劵

搜索

扫码打开当前页

联系我们

返回顶部

幸运之星正在降临...

点击领取今天的签到奖励!

恭喜!您今天获得了{{mission.data.mission.credit}}积分

我的优惠劵

-

¥优惠劵使用时效:无法使用使用时效:

之前

使用时效:永久有效优惠劵ID:×

没有优惠劵可用!