当春节的喧嚣逐渐沉寂

红色的灯笼在夜空中渐渐暗淡

夜色如同最柔软的丝绸

轻轻披在每个渴望宁静的心灵之上

在这春意盎然的时刻

在这祥和的夜晚

让我们一起学习部署DeepSee

这个强大的AI大模型

以其无与伦比的智慧

为我们的数据处理带来革命性的进步

让这份技术之美

如同春节后的第一场春雨

悄无声息地滋润你的心田

引领我们探索智能新时代

0. 前置工作

0. 前置工作

当春节的喧嚣逐渐沉寂

红色的灯笼在夜空中渐渐暗淡

夜色如同最柔软的丝绸

轻轻披在每个渴望宁静的心灵之上

在这春意盎然的时刻

在这祥和的夜晚

让我们一起学习部署DeepSee

这个强大的AI大模型

以其无与伦比的智慧

为我们的数据处理带来革命性的进步

让这份技术之美

如同春节后的第一场春雨

悄无声息地滋润你的心田

引领我们探索智能新时代

正片开始

Deepseek本地部署适合的场景是数据不能公开,需要建立私有知识库,代替自己书写论文专利或者其他有保密要求的文档的情况,亦或者是调教电子宠物。

本教程主要为在任意电脑,不论电脑性能情况下部署 deepseek-r1:32b 的大模型私有化使用,后续会有私有化调试,建立私有知识库等教程。

教程开始

0. 前置工作

0. 前置工作0.1 拥有联网浏览器

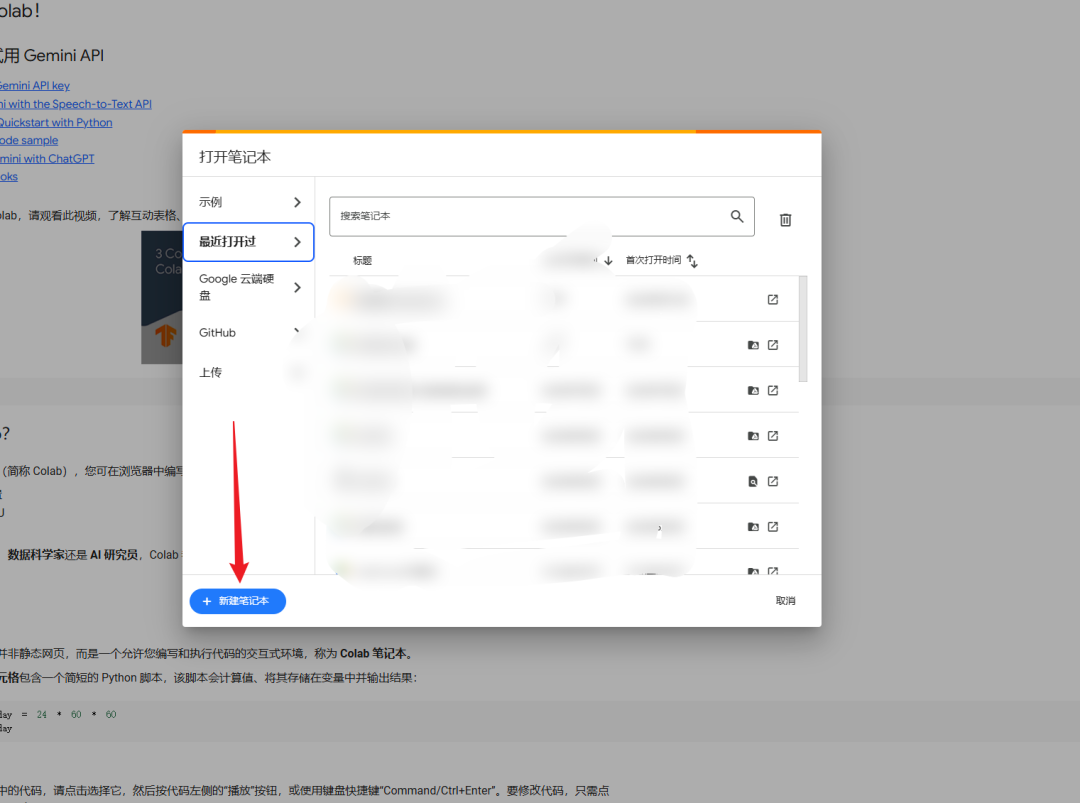

0.2 打开 colab.research.google.com 该网页

1. 新建笔记本

2. 将下面代码粘贴

!nvidia-smi!curl -fsSL https://ollama.com/install.sh | sh!pip install colab-xterm%load_ext colabxterm%xterm

点击左边按钮执行,显示类似下面

3 启动服务

3.1 执行下面代码启动命令窗口

%xterm

3.2 在启动的黑色窗口执行如下面命令,用于启动ollama 服务

ollama serve

如图:

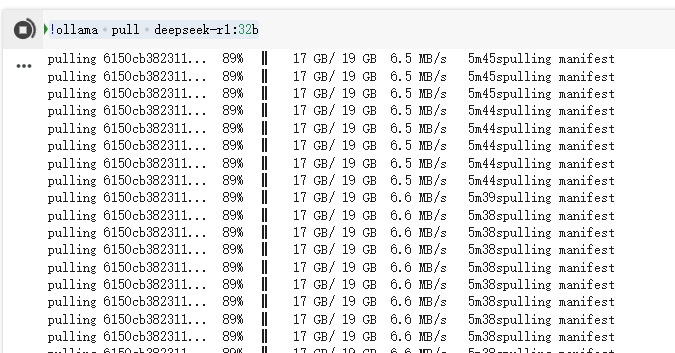

4 代码块执行

!ollama pull deepseek-r1:32b

5 执行如命令,用于启动交互式deepseek

!ollama run deepseek-r1:32b

经测试,以上教程可以在任意主机运行

缺点:1、依赖网络;2、每天使用时间存在限制。

期待大家发掘更多的功能。

后续计划写一个python调用,以及投喂更多私有数据,训练专用AI的教程,敬请期待。

扫码打开当前页

联系我们

之前