-

Cloudflare推出Markdown for Agents:AI抓取网页的方式彻底变了

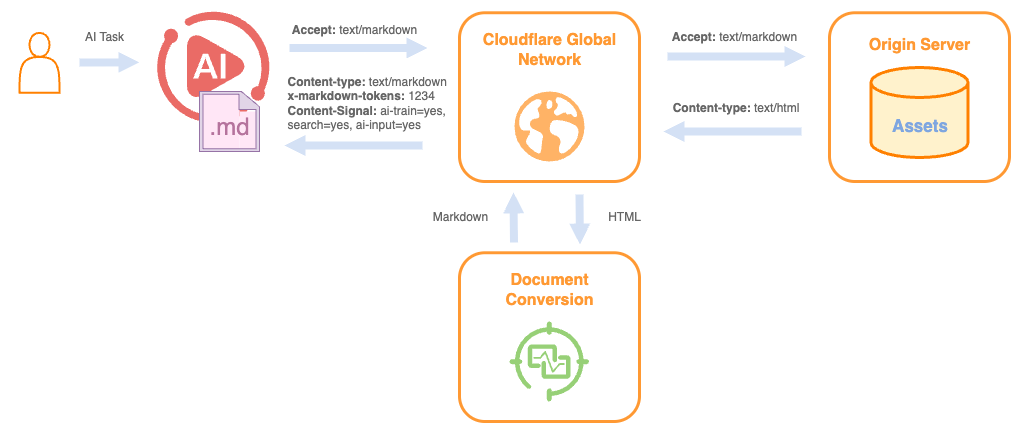

Cloudflare最近推出的Markdown for Agents功能,让AI抓取网页的方式发生了根本变化。这项技术允许网站在服务器端直接将HTML内容实时转换为Markdown格式,而不是让每个AI系统各自进行转换。这个功能的关键在于内容协商机制。当AI系统在HTTP请求头中添加Accept: text/markdown时,启用该功能的Cloudflare网站就会直接返回Markdown格式的…- 0

- 0

-

任何格式RAG数据实现秒级转换!彻底解决RAG系统中最令人头疼的数据准备环节

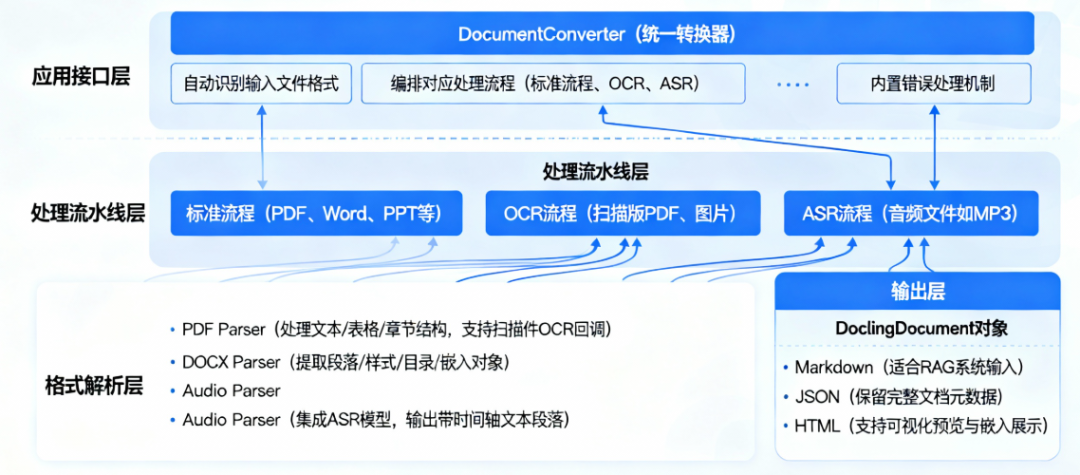

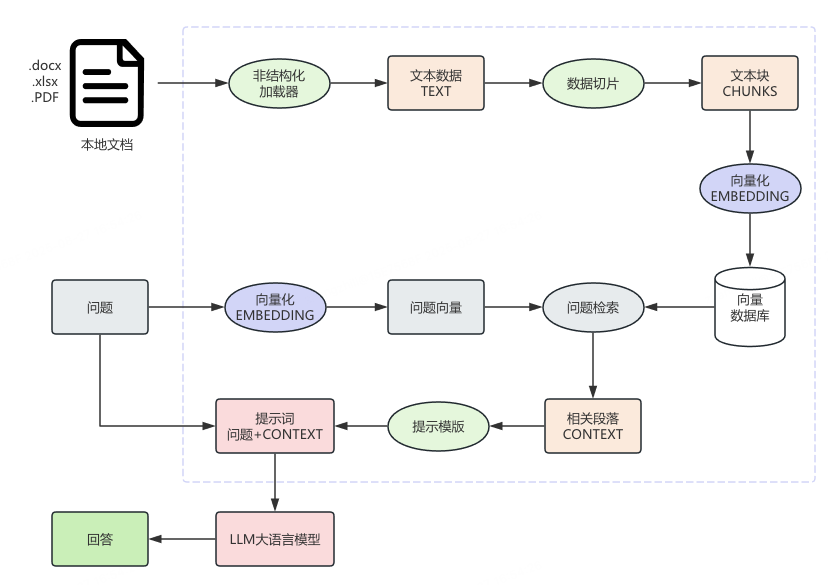

传统RAG系统开发者都知道,从PDF、Word、音频等复杂文件中提取结构化文本,往往需要整合多个工具、编写大量胶水代码,整个流程耗时费力且容易出错。而Docling将这个过程简化为5分钟的自动化流程,支持PDF、DOCX、PPTX、XLSX、HTML、音频、视频字幕等多达15种文件格式,并提供开箱即用的智能分块策略。其核心价值在于彻底解决RAG(检索增强生成)系统中最令人头疼的数据准备环节。Doc…- 0

- 0

-

国产模型再发力!刚刚,字节发布 Doubao 2.0 Pro,硬刚 GPT-5.2!

快过年了,国产模型这几天都要开始搞事情了!前两天,GLM-5 刚刚开源,把 Agentic Engineering 的概念推向高潮,而 DeepSeek 放出了一点风声" data-itemshowtype="8" linktype="text" data-linktype="2">DeepSeek 放出了一点风…- 0

- 0

-

总结了 13 个 顶级 RAG 技术

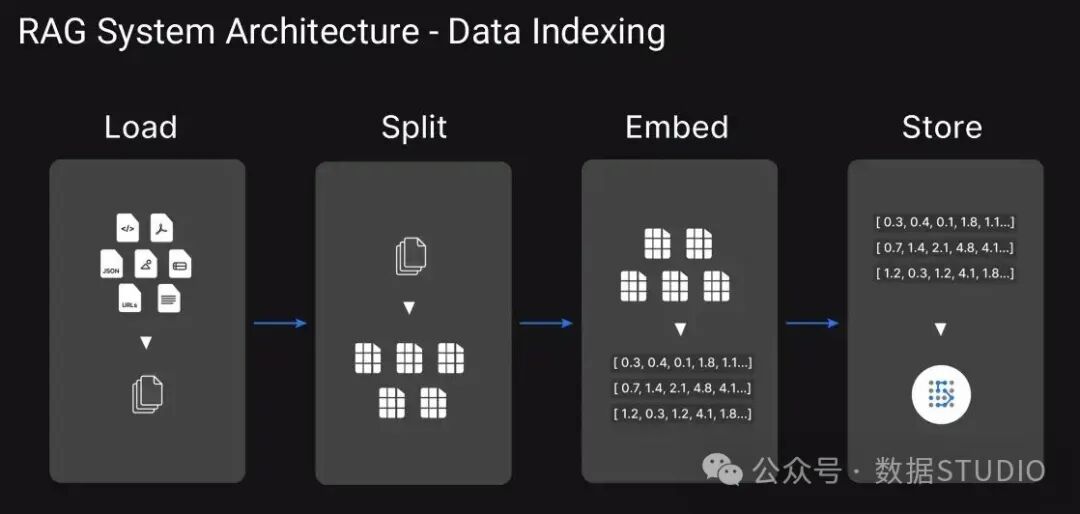

AI 能否大规模生成真正相关的答案?我们如何确保它理解复杂的多轮对话?我们如何防止它轻率地吐出错误的事实?这些都是现代 AI 系统面临的挑战,尤其是使用 RAG 构建的系统。RAG 将文档检索的强大功能与语言生成的流畅性相结合,使系统能够基于上下文感知、基于事实的响应来回答问题。虽然基本的 RAG 系统在处理简单任务时表现良好,但在处理复杂查询、幻听以及长时间交互中的上下文记忆时,它们往往会遇到问…- 0

- 0

-

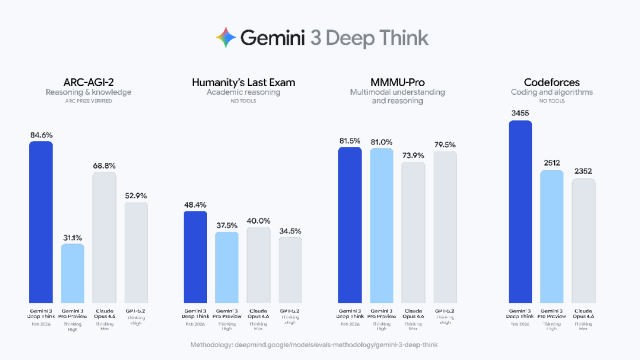

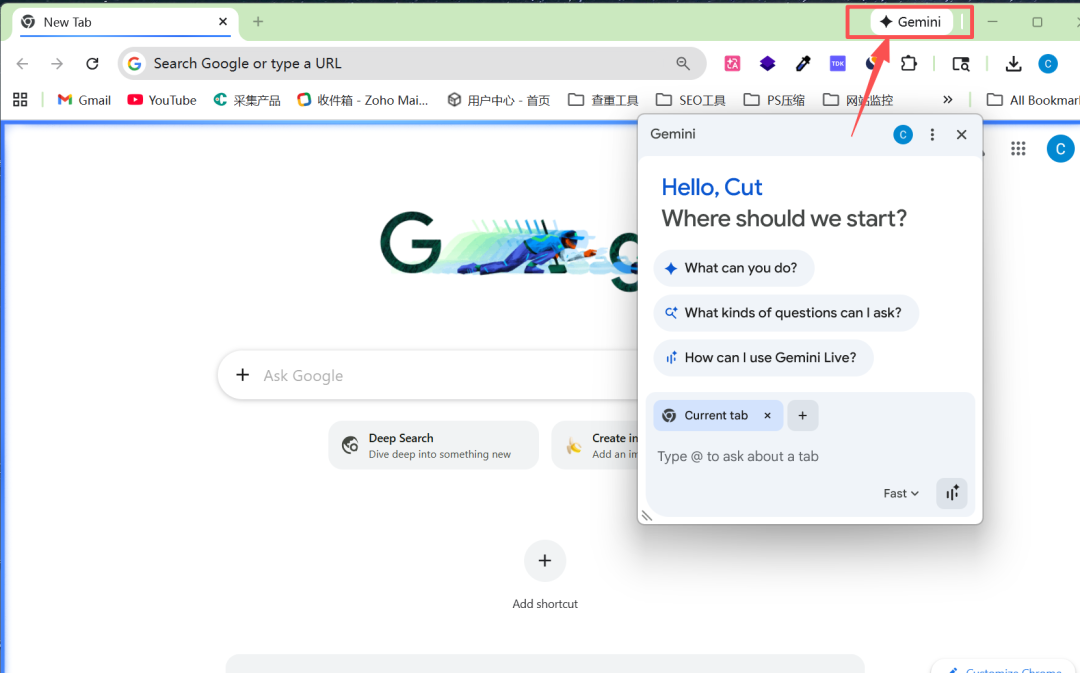

试用 “全球最强模型” Gemini 3 Deep Think

Google DeepMind 宣布 Gemini 3 Deep Think 现在是全球表现最强的模型,可处理研究级数学与编程问题的推理系统。从 IMO 金牌到研究代理(Research Agent)Google 强调一个核心升级 Deep Think 内部使用 research agent 机制。其流程包括:分步推理(step-by-step reasoning)自检答案修正错误找不到有效解时主…- 0

- 0

-

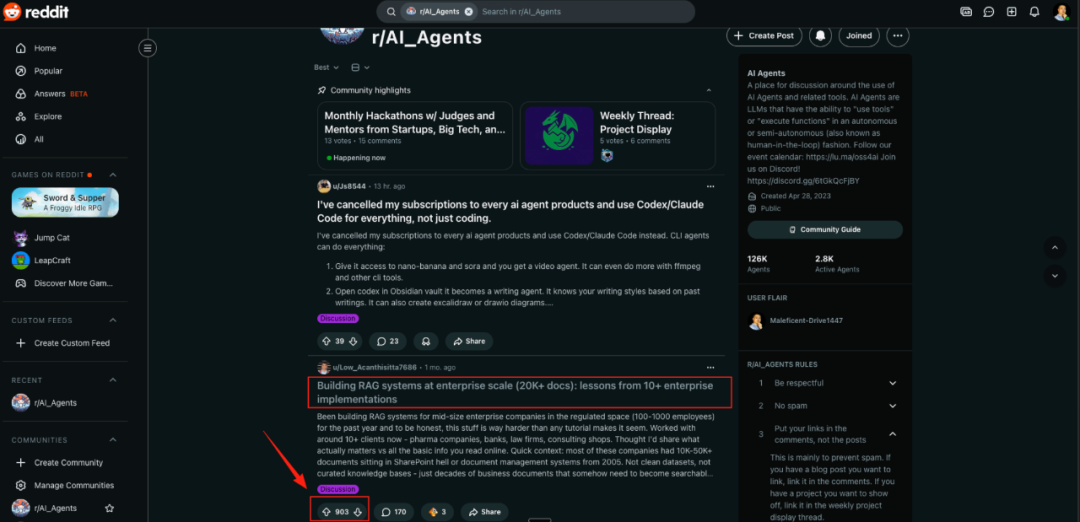

企业级 RAG 系统实战(2万+文档):10 个项目踩过的坑(附代码工程示例)

So,从这篇开始,我会把日常闲暇时观摩的一些海外优质内容整理和加工后,附上自己的不同观察和思考也通过文章或者视频的形式发布出来,给各位做个参考。主要聚焦在 Reddit、Medium、X、Youtube 等平台。这篇就以 Reddit 上 r/AI_Agents 中一个月前发布的一篇有 905 upvotes 的帖子做个翻译整理。这篇试图说清楚:原帖的中文翻译(人话版)、原帖中四个工程要点的代码示…- 0

- 0

-

一切皆可Agent Skills,无处不在的AI Agent会替代业务流程吗?

一篇文章,看懂业务流程、工作流、Agentic Workflow、AI Agent、Agent Skills之间的区别与联系。没有谁替代谁,只有融合发展。全文约4900字阅读时间8分钟你公司的ERP审批流程,点十几个按钮,转三个部门,等五天才能报销一张发票。隔壁创业公司,一句话跟AI说帮我处理这笔报销,三分钟搞定。老板叫你进办公室:咱们那套三百万的工作流系统,是不是可以扔了?先别慌。我…- 0

- 0

-

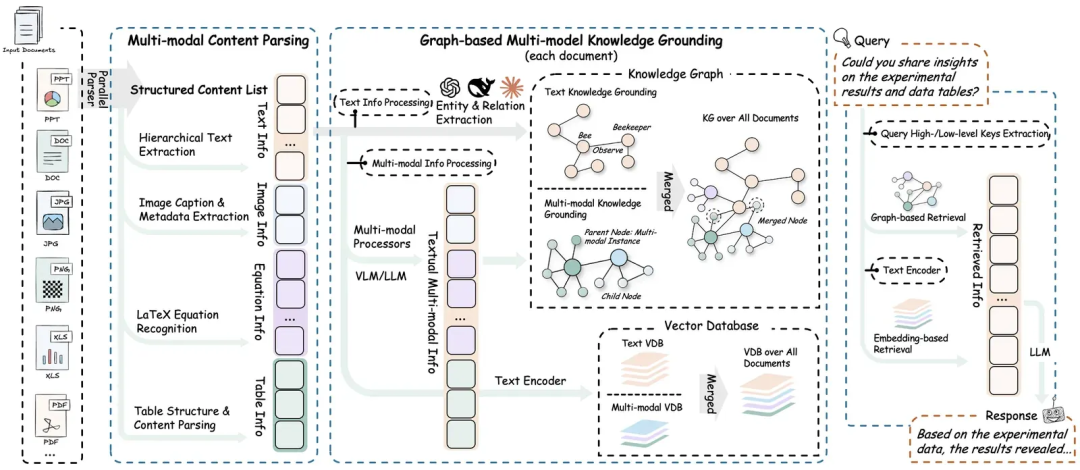

RAG-Anything × Milvus:读PDF要集成20个工具的RAG时代结束了!

AI落地主流场景之一是知识库,而做知识库,必定少不了PDF文件。传统RAG要想精准读取这些图文并茂的PDF,就需要集成PyPDF2、OpenCV、Camelot、Tesseract等多个工具,系统庞杂且低效。此外,不同 PDF 各有侧重:报告重图表、财报重表格、论文重公式,如何精准调用这些工具同样难度不低。香港大学数据科学学院刚刚开源的RAG-Anything项目,结合开源的Milvus向量数据库…- 0

- 0

-

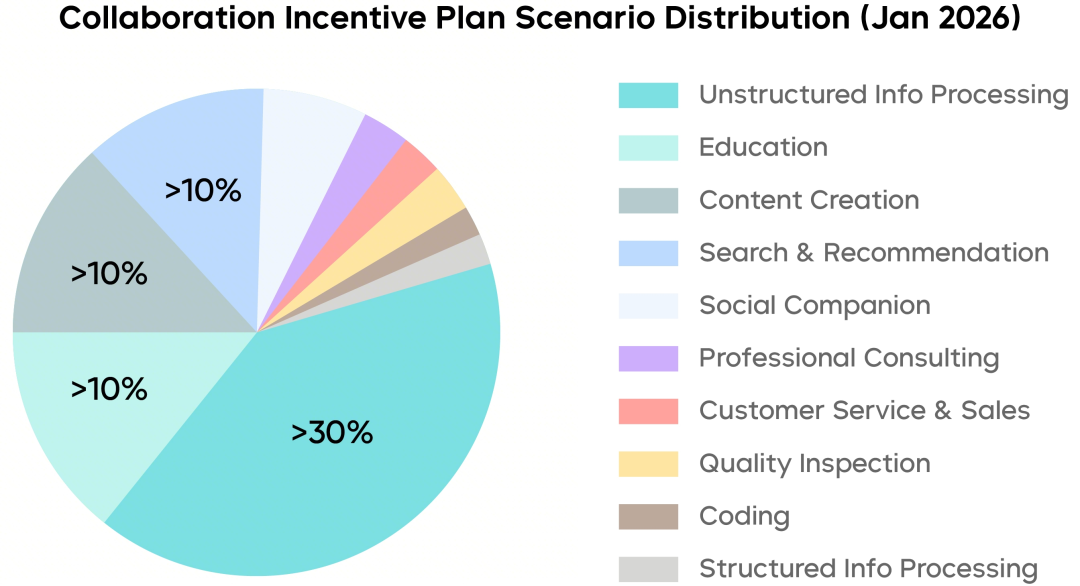

豆包大模型2.0发布

今天,豆包大模型正式进入2.0阶段。随着Agent时代到来,大模型将在现实世界发挥更大作用。豆包2.0(Doubao-Seed-2.0)围绕大规模生产环境下的使用需求做了系统性优化,依托高效推理、多模态理解与复杂指令执行能力,更好地完成真实世界复杂任务。豆包2.0系列包含Pro、Lite、Mini三款通用Agent模型和Code模型,灵活适配各类业务场景:豆包2.0 Pro面向深度推理与长链路任务…- 0

- 0

-

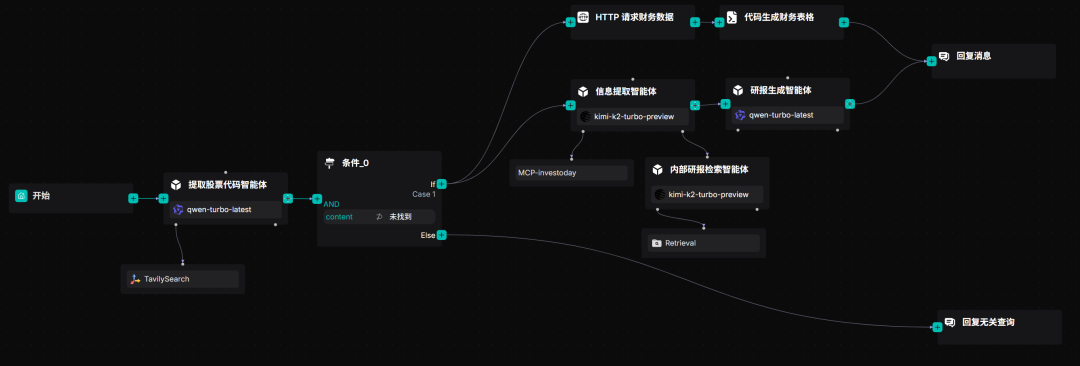

RAGFlow 实践:公司研报深度研究智能体

背景金融机构的投资研究部的实际工作中,每天都会接触大量行业和公司的分析报告、第三方研究数据以及实时市场动态,信息来源多元且分散。金融分析师的工作是根据以上信息,快速形成明确的投资建议,比如具体推荐哪只股票、如何调整持仓比例,或是预判行业下一步走向。由此,我们开发了“智能投研助手”,帮金融分析师快速整理信息。它能自动抓取公司数据、整合财务指标和研报观点,让分析师几分钟就能看清一只股票值不值得买,不用…- 0

- 0

-

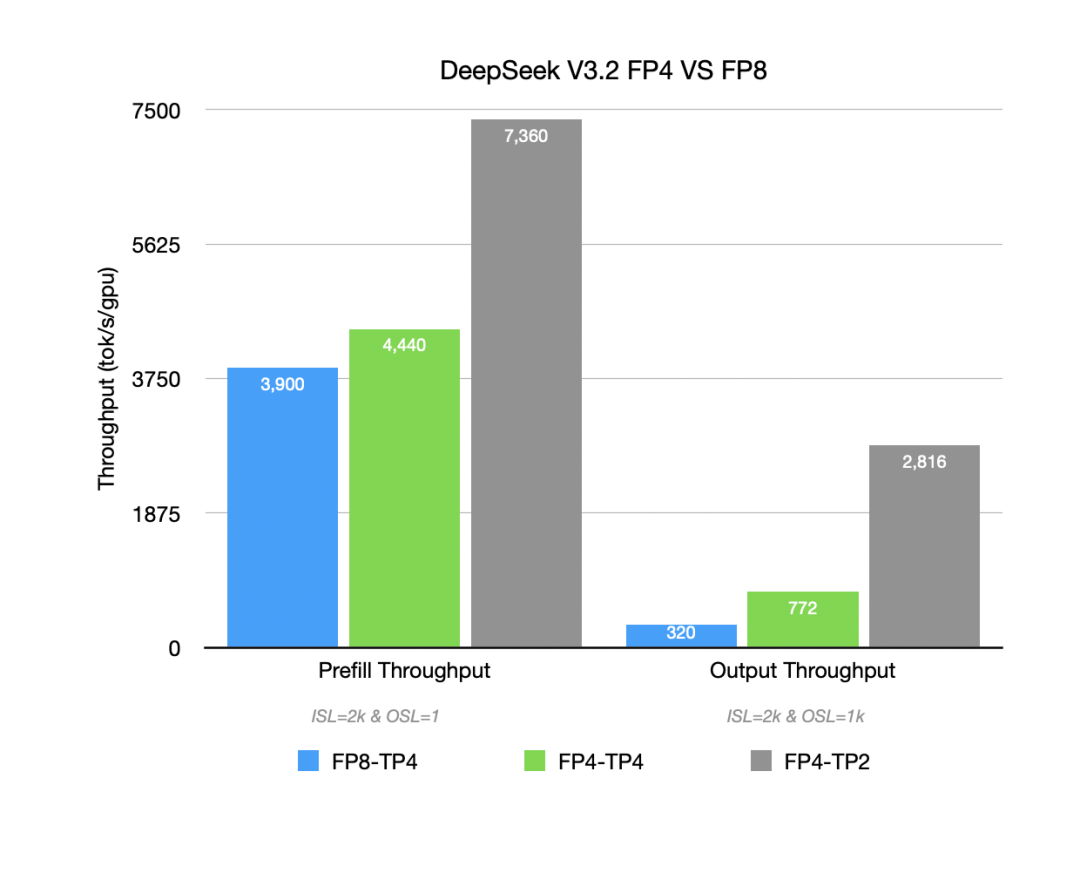

DeepSeek-V3.2 on GB300:性能表现与部署实践

摘要DeepSeek-V3.2(NVFP4 + TP2)已在 GB300(SM103 - Blackwell Ultra)上成功、顺畅地运行。借助 FP4 量化,其单 GPU 在纯 Prefill 场景下的吞吐量达到 7360 TGS(tokens / GPU / second)。在混合场景 (ISL=2k, OSL=1k) 下,输出吞吐量为 28…- 0

- 0

-

Chonkie:开源、轻量、极速的 RAG 分块神器 🦛

在不断扩展的大模型上下文里,分块不仅是技术需求,更是确保模型效率的关键手段。然而,面对大部分冗杂的分块工具,不少开发者需要更直接、更有效的解决方案。这时,Chonkie — 一款专为分块任务设计的轻量工具 — 应运而生,成为了 RAG 应用开发中的绝佳帮手。为什么需要分块?随着语言模型能够处理的上下文不断增加,在提供丰富上下文的同时也带来了计算速度与内存开销的挑战。通过分块,…- 0

- 0

-

CoPaw发布:即刻加载你的专属智能搭档

今年年初,OpenClaw(前身 ClawdBot)以「本地优先、多频道接入、主动心跳」的智能体范式引起关注:个人 AI 不再只是聊天框里的问答,而是可以跑在用户自己的电脑里、连着用户常用的软件、能按节奏主动执行任务的「数字搭档」。在 AgentScope 的智能体生态下,我们希望在延续这一范式的同时,做出一款更易用、可本地可云端部署的个人智能助理,相较 OpenClaw,追求安装极简与「本地 +…- 0

- 0

-

OpenAI Frontier 发布:不是新模型,而是「企业级 AI 操作系统」的诞生

OpenAI Frontier 发布:不是新模型,而是「企业级 AI 操作系统」的诞生很多人第一眼看到 OpenAI Frontier,可能会以为:又一个平台?又一个工具?又一个企业版产品?但如果你只把它当成「企业用的 ChatGPT 升级版」,那就低估它了。这可能是 OpenAI 近几年最被低估、却最关键的一步棋。甚至可以说:Frontier 不是模型发布,而是 OpenA…- 0

- 0

-

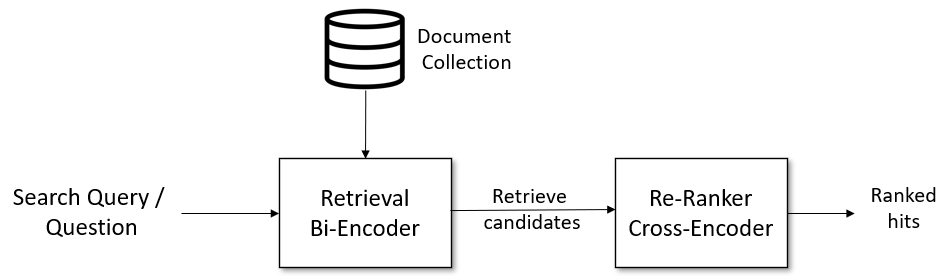

Embedding与Rerank:90%的RAG系统都搞错了!为什么单靠向量检索会毁了你的AI应用?

文章概要作为一名深耕RAG系统多年的技术专家,我发现太多人在embedding和rerank的选择上犯了致命错误。今天我要用最直白的方式告诉你:embedding就像雷达,负责快速扫描海量信息;而rerank则是精准制导系统,确保命中目标。通过实际案例和技术对比,你会发现rerank绝不是锦上添花,而是决定系统成败的关键环节。想象一下,你正在茫茫大海中寻找一艘沉船。如果只靠望远镜快速扫…- 0

- 0

-

-

存算一体破局向量检索瓶颈,IBM放出王炸VSM:性能飙升100倍,能效碾压GPU千倍,RAG要变天?

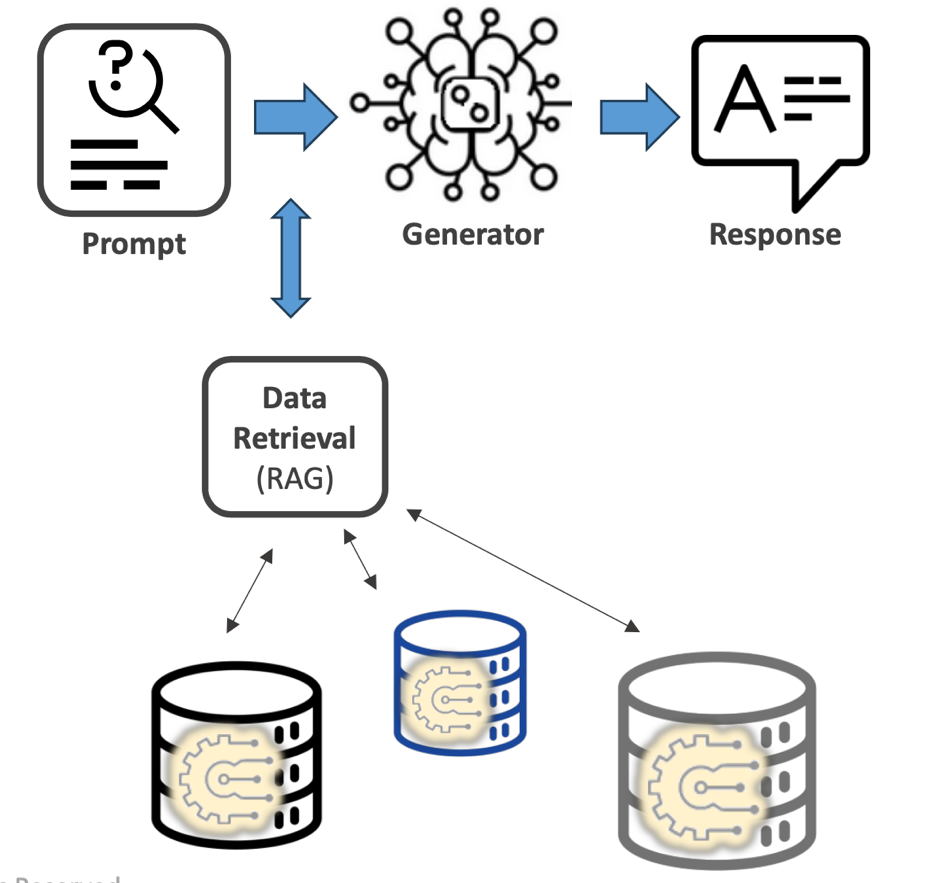

生成式人工智能,特别是以检索增强生成(Retrieval-Augmented Generation, RAG)为代表的技术范式,正从根本上重塑企业与海量非结构化数据的交互方式。RAG通过从外部知识库中检索相关信息来“锚定”大型语言模型(LLM),有效缓解了模型幻觉,使其生成的内容更具事实性和时效性。这一流程将向量数据库从一项利基技术推向了人工智能技术栈的核心,使其成为支撑下一代智能应用的关键基础设…- 0

- 0

-

每秒一万个 Token 是为了给 AI 预留足够的思考空间

2 月 13 日,Google 首席 AI 科学家 Jeff Dean 接受了 Latent Space 播客的深度专访。本次对话全面回顾了 Google 如何在激烈的 AI 竞赛中通过 Gemini 占据前沿,深入拆解了模型蒸馏、长上下文处理向万亿 Token 的跨越、TPU 硬件协同设计、分层搜索逻辑,以及 AI Agent 对未来软件工程的重塑。Jeff Dean 还在对话中复盘了 Goog…- 0

- 0

-

RAG在B站大会员中心数据智能平台的应用实践

在数字化浪潮中,数据已成为企业的核心资产。在B站大会员中心部门,数据智能平台扮演着举足轻重的角色。它不仅要处理和分析大规模的会员数据,为会员服务的优化和拓展提供坚实的数据支撑,还要满足业务对于数据洞察的多样化需求。传统的数据查询方式依赖专业的SQL语句,这对于非技术背景的业务人员来说,无疑是一道难以跨越的门槛。他们往往有明确的业务问题,却因为缺乏SQL技能而无法快速获取所需数据。例如,运营人员想要…- 0

- 0

-

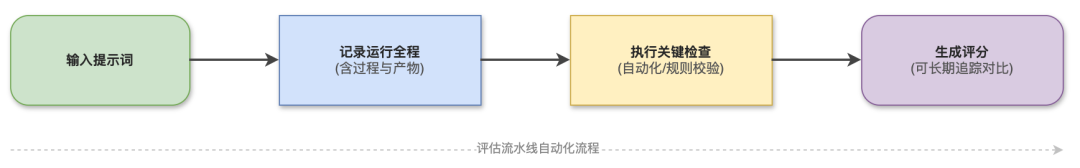

OpenAI 开发者的 Skill 经验:如何使用评估系统来优化 Skill

当你给 Codex 这类 AI 智能体迭代技能时,你往往摸不透效果:到底是真的优化了技能,还是只是改变了它的行为模式?比如这个版本感觉更快,那个版本似乎更可靠,但突然就出问题了:技能不触发、跳过必要步骤,或者留下一堆多余文件。本质上,针对大语言模型的技能,其实就是一组有条理的提示词和指令集合。要让技能持续改进,最靠谱的方法就是像评估其他大语言模型应用的提示词那样来评估它。模型评估(evaluati…- 0

- 0

-

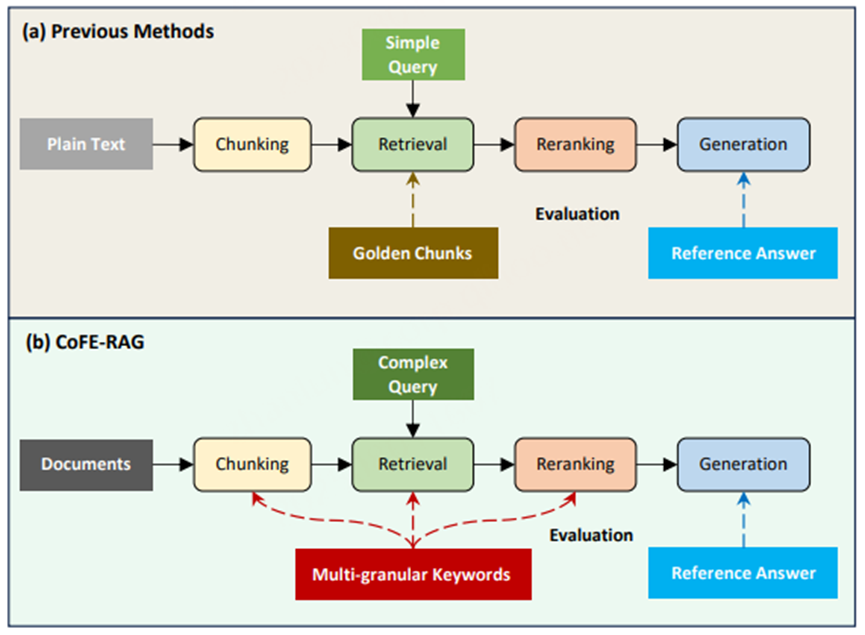

阿里RAG全链路评估框架之CoFE-RAG

CoFE 论文学习CoFE-RAG是一种面向检索增强生成(RAG)系统的全链路综合评估框架研究背景与动机RAG显著提升了回答的准确性与可靠性,有效缓解了传统生成模型中的“幻觉”问题。然而,现有RAG评估方法存在三大核心挑战:Ø 数据多样性不足:知识来源和查询类型的多样性不足限制了RAG系统的适用性。【现有评价方法的外部知识库基本来源于从HTML中抓取的格式良好的纯文本,缺乏数据多样性,难…- 0

- 0

-

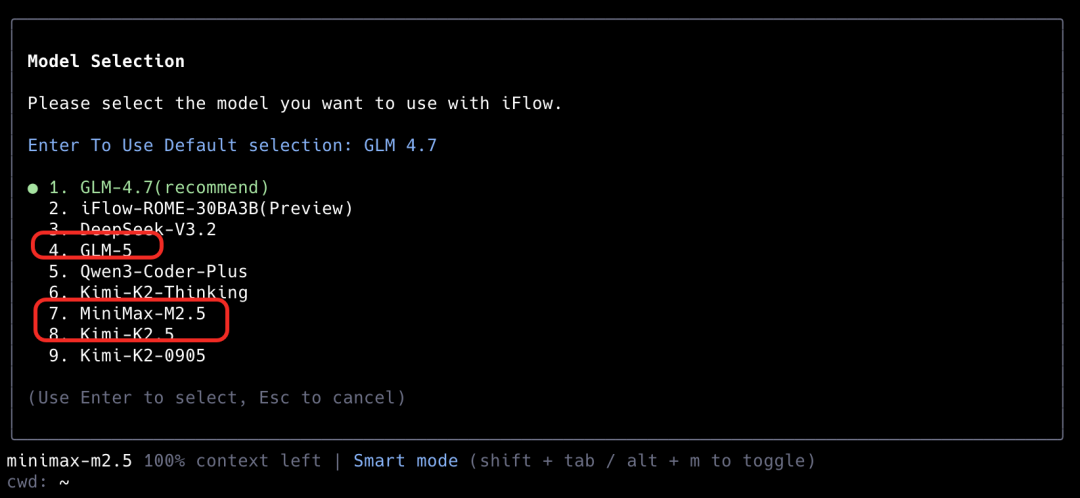

告诉你如何免费使用GLM5,MiniMax2.5,kim2.5(教程)

阿里又来发福利了,你如果只是想体验下最新模型,比如GLM5,MiniMax2.5,kim2.5,但又不抢不到code plan,那么我建议你按我的方式,进行免费的模型体验。以上体验路径就是心流iflow CLI。官方网址:https://platform.iflow.cn/cli/quickstart操作方法:1、安装 iflow CLI 快速安装macOS/Linux# 一键安装脚本,…- 0

- 0

-

从“黑盒”到“白盒”:Dify 2.0 知识管道,赋予企业RAG前所未有的可控性

摘要:dify 2.0 beta版带来不少新的升级,知识管道(Knowledge Pipeline)是我认为目前最有价值的升级。知识管道打破企业 RAG 数据瓶颈,可视化搞定非结构化数据处理。做企业级 RAG(检索增强生成)时,你是不是也遇到过这些头疼问题?PDF 里的表格、PPT 里的图表一解析就丢;ERP、Notion、云盘里的分散数据,整合一次要写一堆适配代码;数据处理全程像 “黑箱”,出了…- 0

- 0

-

context是什么?怎么用?

彭友们好,我是老彭啊。今天很多同事都肥老家过年了。据说今天还没放假的单位天花板都长这样:你单位的天花板啥样啊?给我瞅瞅~~~今天下午,剩下的同事们都在唠嗑,有个同事想让我讲讲context。这个我还真有蛮多感触的,也有一些经验可以跟大家分享一下。Context 到底是啥?先给结论:context 就是小学就学过的上下文,没有那么神神秘秘的。顾名思义,就是看到一句话、一个词,不能断章取义片面理解,得…- 0

- 0

❯

购物车

优惠劵

搜索

扫码打开当前页

联系我们

返回顶部

幸运之星正在降临...

点击领取今天的签到奖励!

恭喜!您今天获得了{{mission.data.mission.credit}}积分

我的优惠劵

-

¥优惠劵使用时效:无法使用使用时效:

之前

使用时效:永久有效优惠劵ID:×

没有优惠劵可用!