-

GLM-5 发布:从“写代码”到“写工程”的范式跃迁

2026 年 2 月 11 日深夜,智谱 AI 正式发布新一代旗舰模型 GLM-5。这不是一次常规的版本迭代,而是一场针对 Agentic Engineering 范式的系统性重构。当行业还在讨论“如何让 AI 写出更好的代码”时,GLM-5 已经将目标锁定在“如何让 AI 完成真实的系统工程”。神秘面纱下的实力验证在 GLM-5 正式发布前,一个代号为 “Pony …- 0

- 0

-

应对知识管理挑战:RAG技术如何驱动企业智能化升级

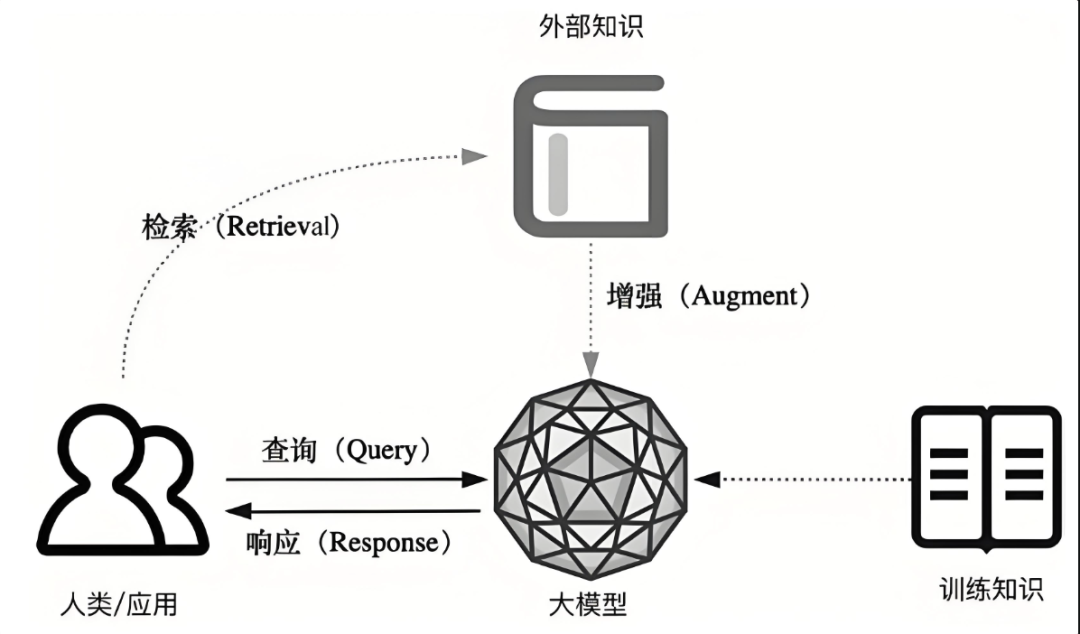

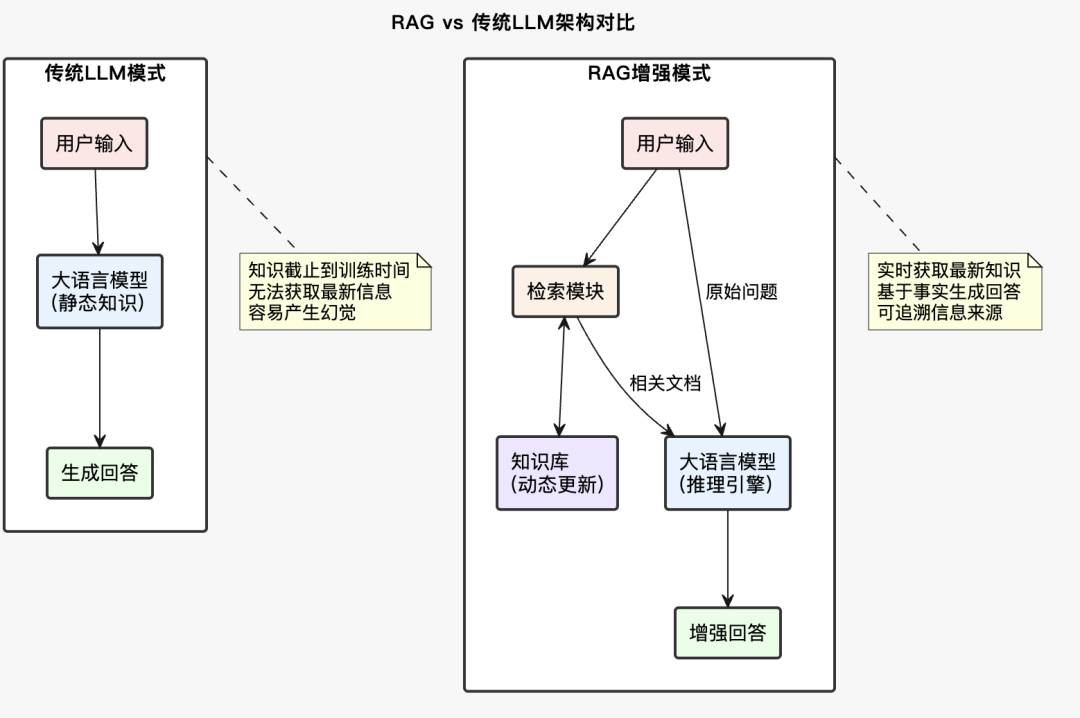

在人工智能技术迅速发展的背景下,检索增强生成(Retrieval-Augmented Generation, RAG)作为一种融合信息检索与自然语言生成的关键技术,正逐步成为企业推进数字化转型的重要工具。近年来,基于 RAG 的解决方案市场需求显著增长,多个行业积极引入该技术以提升知识管理及应用效率。据多家权威机构报告,企业对于 RAG 相关技…- 0

- 0

-

模型能力、提示词、Skill、工作流、Vibe Coding——到底都是什么?

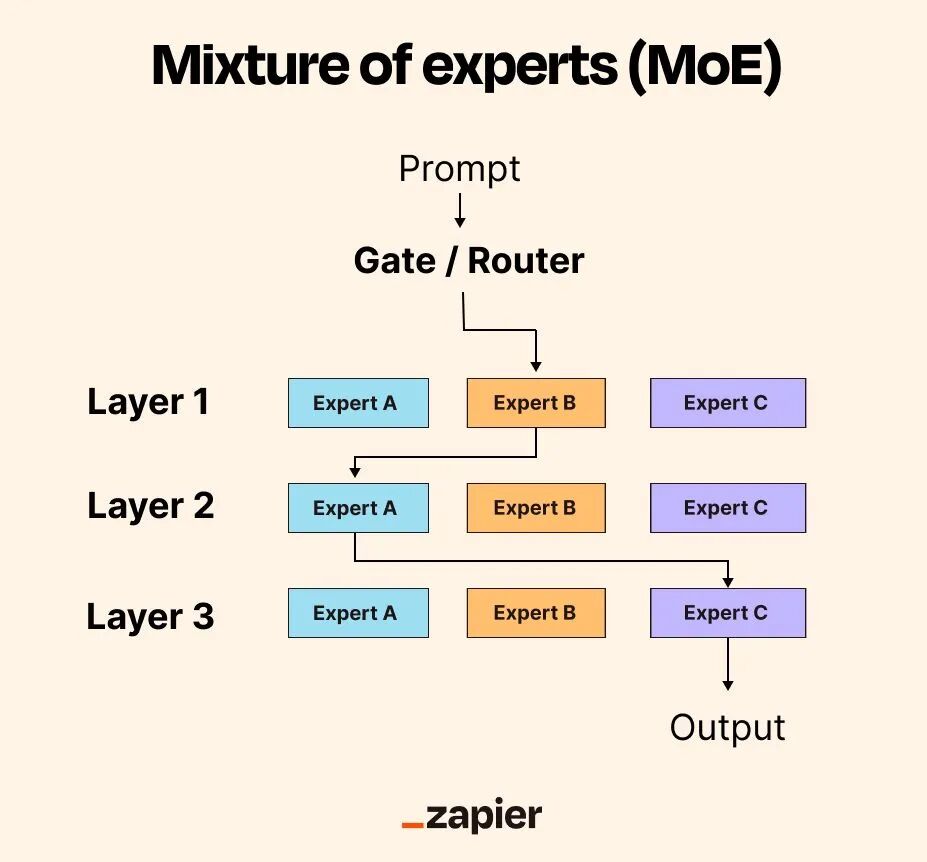

这半年,不管是自己学习 AI ,还是做项目,有五个词反复出现又经常让小白困惑:模型能力、提示词、Skill、工作流、Vibe Coding。它们各自是什么、什么关系、你现在该关心哪个——面向小白和非专业人士,分享一点个人的观点,仅供参考。🧠 模型能力大模型本身具备的底层能力——理解语言、生成文字、识别图片、逻辑推理。ChatGPT、Claude、DeepSeek、豆包,都属于这一层。它是一切的基础…- 0

- 0

-

RAG彻底爆了!一文掌握其效果优化的架构设计及核心要点

RAG技术全解析:让大模型告别"胡说八道",构建企业级AI知识库的终极指南你是否遇到过这样的场景:向大模型询问公司最新的产品规格,它却给出了2021年的过时信息?或者让AI助手帮你查找内部文档,它却开始"一本正经地胡说八道"?根据Stanford的最新研究,即使是GPT-5这样的顶级大模型,在处理特定领域知识时的准确率也仅有47%。而当企业试图将AI应用于实…- 0

- 0

-

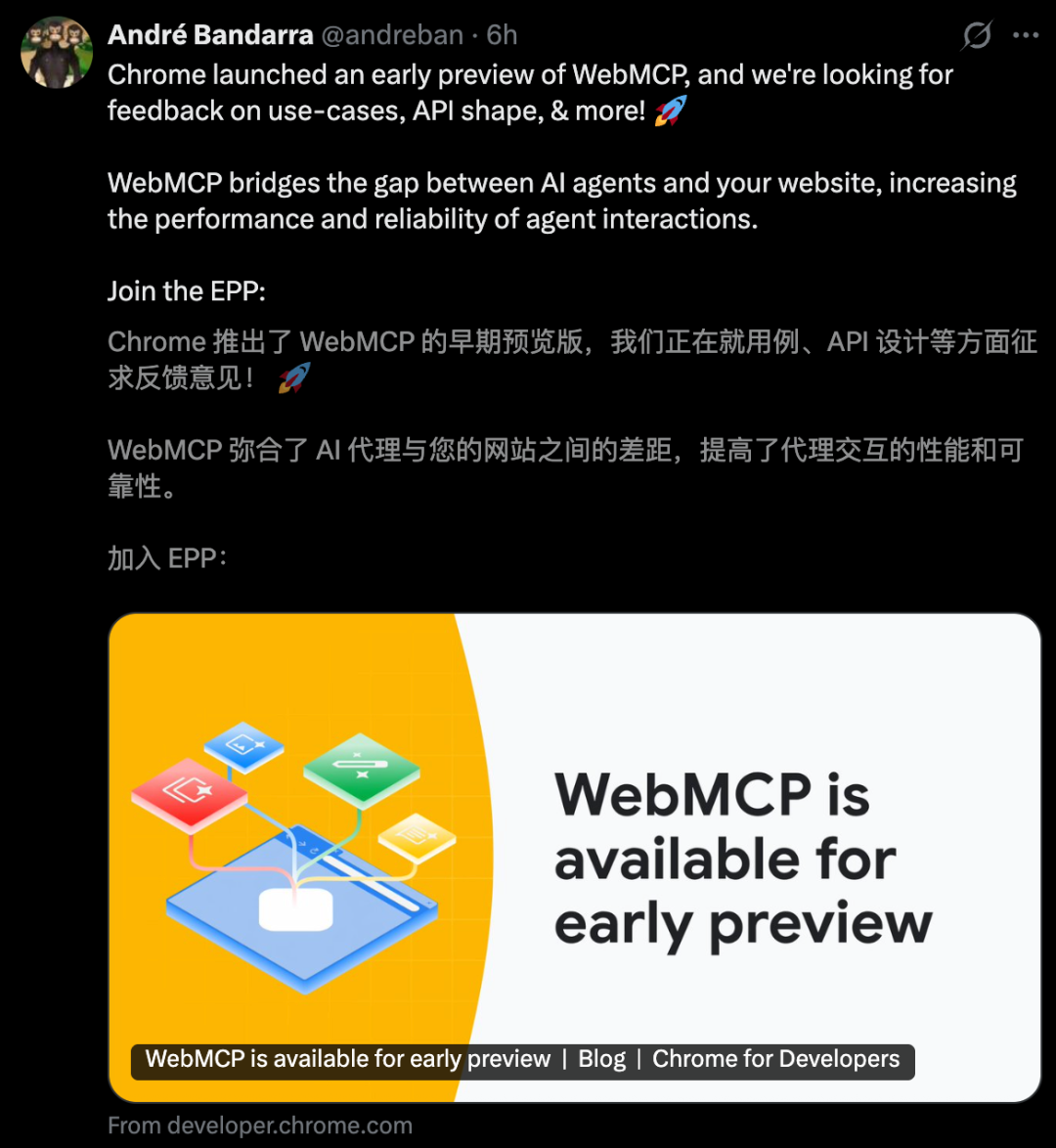

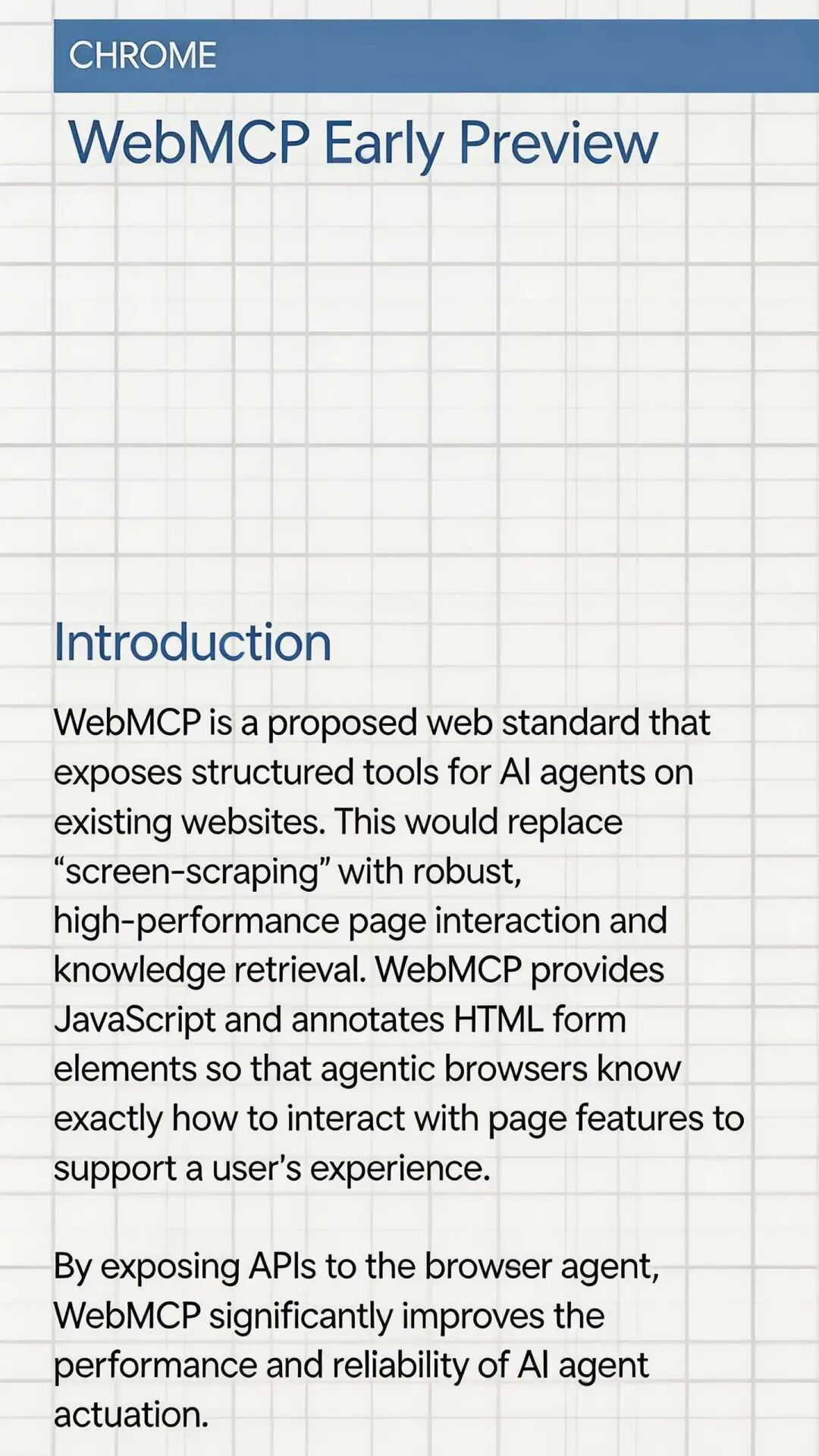

谷歌Chrome深夜爆更,Agent不用「装」人了!前端最后防线崩了?

今天,谷歌Chrome团队投下了一枚深水炸弹:WebMCP(Web模型上下文协议)正式登场。它可以让AI智能体跳过「人类用户界面」,直接与现有的网站和Web应用深度交互。在Chrome 146的早期预览版中,开启特定flag即可体验WebMCP这相当于给Agent加上了「超能力」,从此不用再「装得像个人一样」,去看网页、找按钮,或是点链接。仅通过一个API:navigator.modelConte…- 0

- 0

-

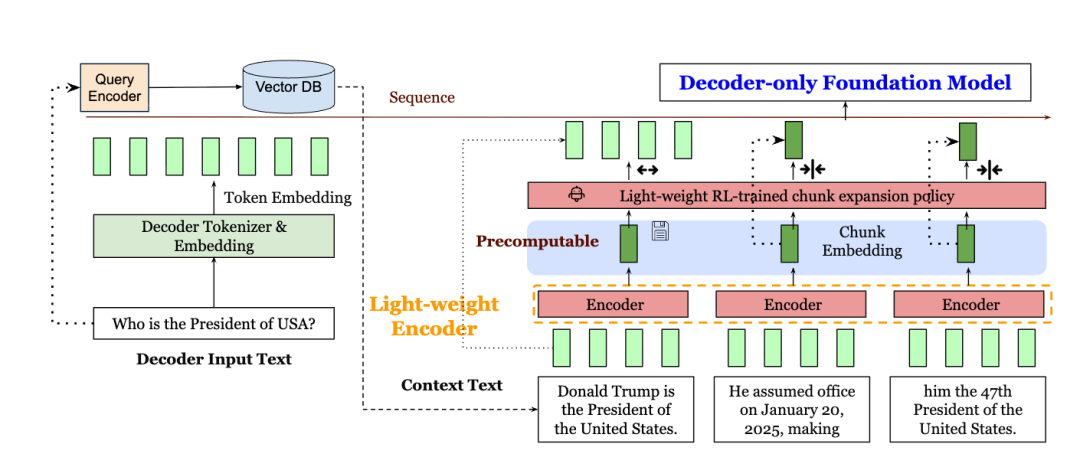

Meta如何给RAG做Context Engineering,让模型上下文增加16倍

最近一段时间,Context Engineering(上下文工程)的热度已无需多言,而 Meta 超级智能实验室发布的首篇论文,便聚焦于该领域的核心议题——模型上下文智能压缩,展开了深度研究。相信在开发 RAG与 Agent时,上下文太长导致输出效果崩掉,几乎做AI 应用人的家常便饭。其具体体现有二:长上下文导致了更高内存成本,模型的首 token 生成时间(TTFT)会随之呈二次方增加。冗余计算…- 0

- 0

-

WebMCP:谷歌刚给 Chrome 动了个手术,AI Agent 的玩法全废了

搞技术这些年,真正让我觉得「范式要变了」的时刻不多。WebMCP 算一个。先说结论Google 在 Chrome 146 里塞了个叫 WebMCP 的东西,目前还藏在 flag 后面,要手动开启。这玩意儿做的事情用一句话概括:让网站主动告诉 AI Agent「我能干啥」,而不是让 Agent 像个瞎子一样截屏猜。开发者 Alex Volkov 给了个精准的比喻——「UI 里的 API」…- 0

- 0

-

检索器江湖:那些让RAG神功大成的武林绝学

你是否曾有过这样的经历?在AI上输入一个问题,结果返回的内容让你怀疑自己是不是在火星上网?或者问AI一个问题,它给你的答案却南辕北辙?别担心,这不是你的问题,而是背后的"检索器"没有练好内功!在RAG(检索增强生成)这门武功中,检索器就像是掌门人的左膀右臂,它的好坏直接决定了最终的武功效果。今天,我们就来聊聊这个看似简单实则暗藏玄机的检索器江湖。为什么要学习检索器?想象一下,你…- 0

- 0

-

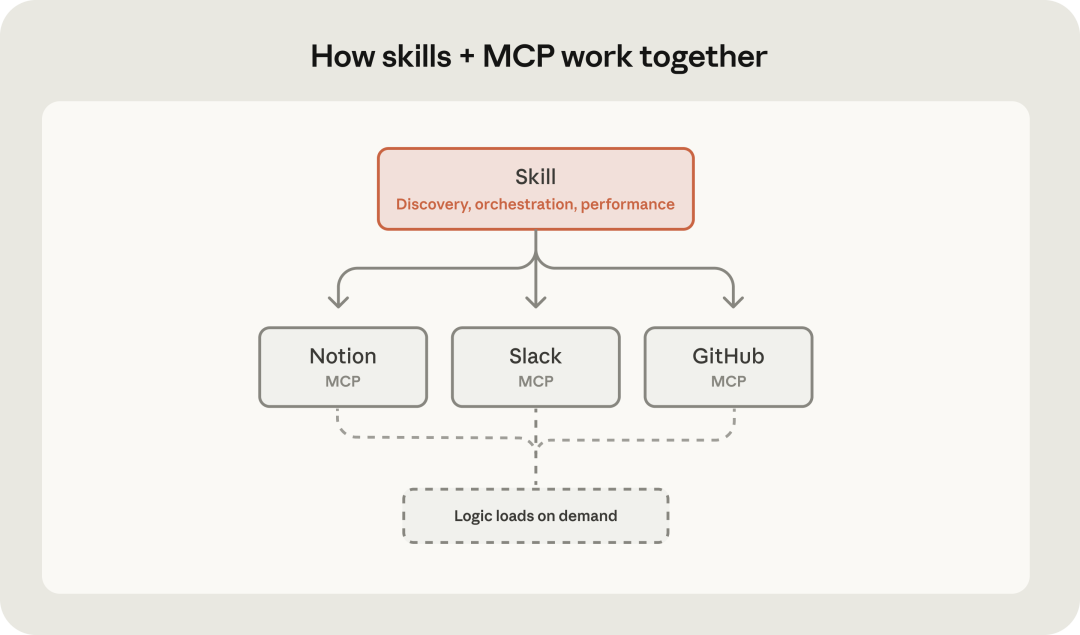

2026 做 Agent 的正确姿势:单 Agent 起步,Skills 沉淀方法论,MCP 负责连接

今天是 2026 年 2 月 11 日。过去一段时间,我集中读完了 Anthropic 关于 Claude Agents 的四篇博客。读完之后最大的感受不是"又出了几个新名词",而是——他们在做一件很多厂商不愿意明说的事:把 Agent 从"能聊天的能力展示"往"可稳定交付的工程系统"上推。这四篇文章发布时间横跨 2025 年…- 0

- 0

-

Dify + Oracle + MCP:轻松构建 RAG 与 MCP Agent 智能应用

在 AI 应用开发领域,检索增强生成(RAG)已成为构建智能问答、文档分析等场景的核心技术。通过 RAG,AI 应用能够结合现有知识库,在生成回答时引入外部信息,从而为用户提供更准确、更智能的响应。同时,通过组合 AI Agent + DB MCP Server,从而实现通过 AI 与数据库的交互操作也是数据库系统接入 AI 应用的一个常见场景。本文将通过一个实践案例,展示如何使用 Oracle …- 0

- 0

-

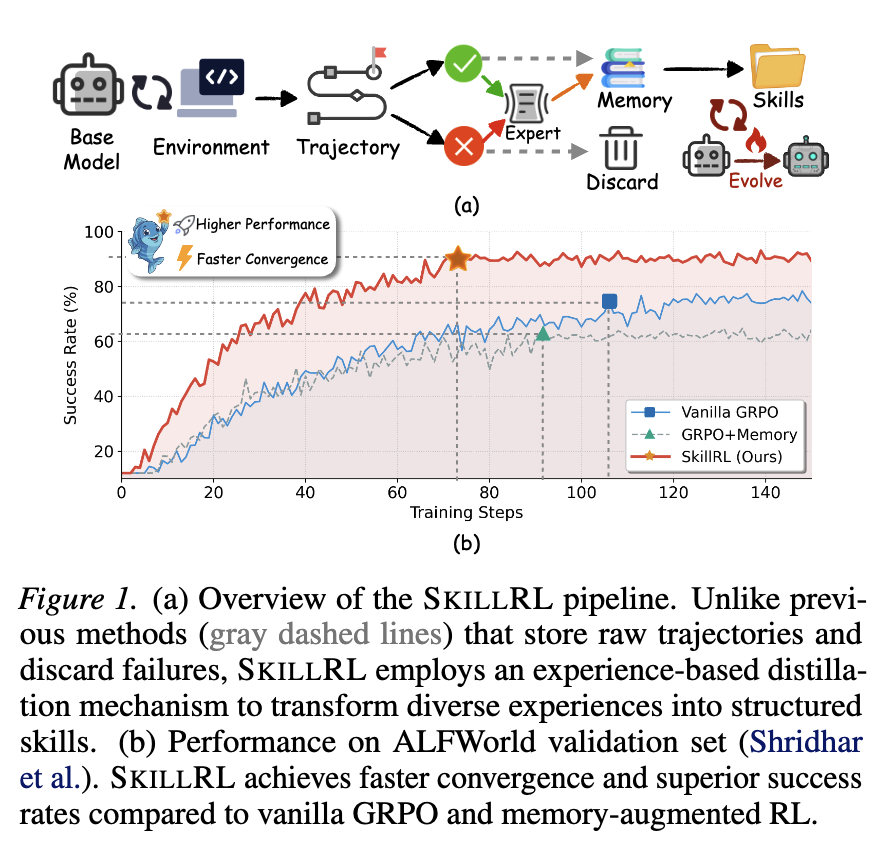

别再存轨迹了:SkillRL 让 Agent 把经验炼成技能,还会自我进化

别再存轨迹了:SkillRL 让 Agent 把经验炼成技能,还会自我进化Takeaways论文提出 SkillRL:把交互轨迹“蒸馏”为可检索、可复用的技能(SkillBank),再在强化学习过程中按验证失败递归扩展技能库,实现“策略—技能库”协同进化。相比存原始轨迹的记忆方法,技能抽象带来约 10–20× 的上下文压缩,同时提升决策可用性,缓解“冗余/噪声”与“信息密度”的矛盾。在 ALFWo…- 0

- 0

-

做好 RAG 落地最后环节 —— 评估 RAG 应用

一、为什么RAG应用需要评估随着大模型技术的发展,我们已经具备了开发完整 RAG(Retrieval-Augmented Generation,检索增强生成)应用的技术能力。借助 LlamaIndex、LangChain 等成熟框架,可以在较短时间内实现从原型到应用的快速构建。然而,真正将 RAG 应用推向生产环境,远不只是“搭建起来”那么简单,仍有许多问题值得提前思考与应对。1. 大模型输出的不…- 0

- 0

-

Claude Code 源码揭秘:为什么它能无感切换 AWS、Google、Azure

你可能没注意过,Claude Code 不只能连 Anthropic 官方 API。把 AWS_REGION 和 AWS_ACCESS_KEY_ID 配好,它就自动切换到 AWS Bedrock。把 ANTHROPIC_VERTEX_PROJECT_ID 配好,它就走 Google Vertex AI。甚至从 2.0.45 版本开始,还支…- 0

- 0

-

企业级RAG系统实战心得:来自10多个项目的深度总结

在Reddit的AI_Agents版本刷到一个帖子,讲的RAG系统在企业中的落地,觉得写的不错,翻译共享给大家,英文原文直接让DeepSeek翻译后有些生硬,手动润色了一下。配图:Google Nano Banana【原贴】Building RAG systems at enterprise scale (20K+ docs): lessons from 10+ enterprise implem…- 0

- 0

-

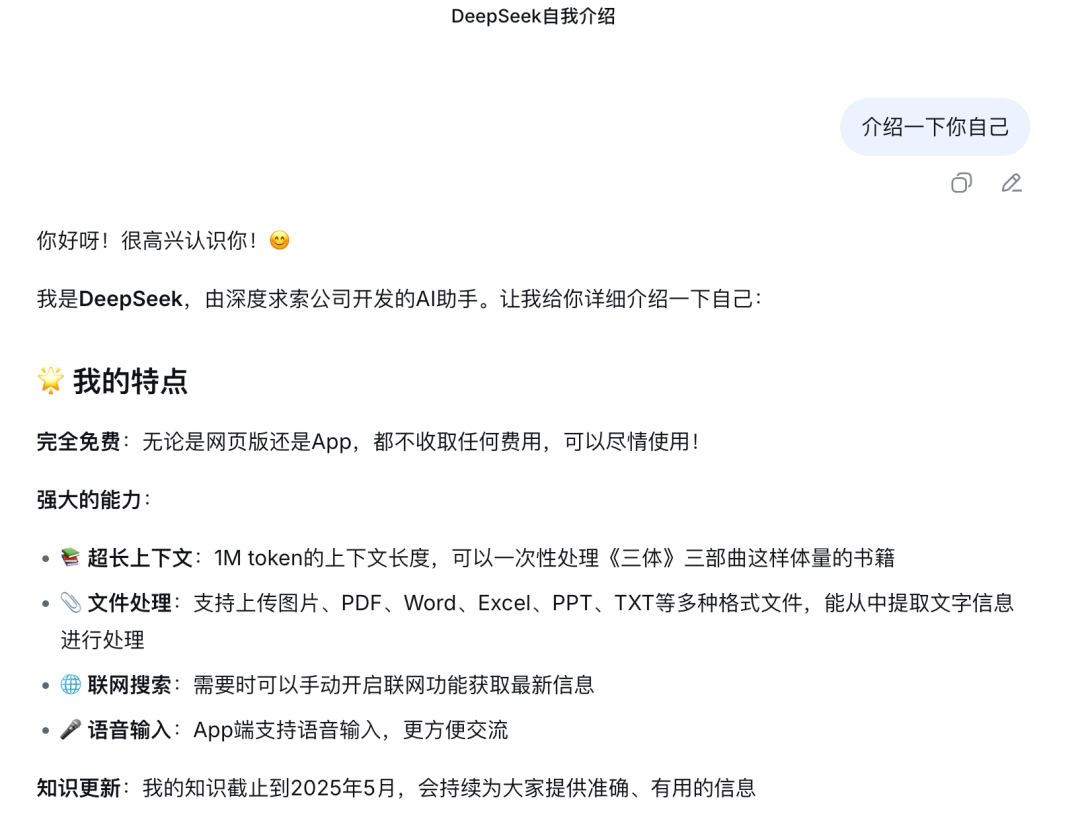

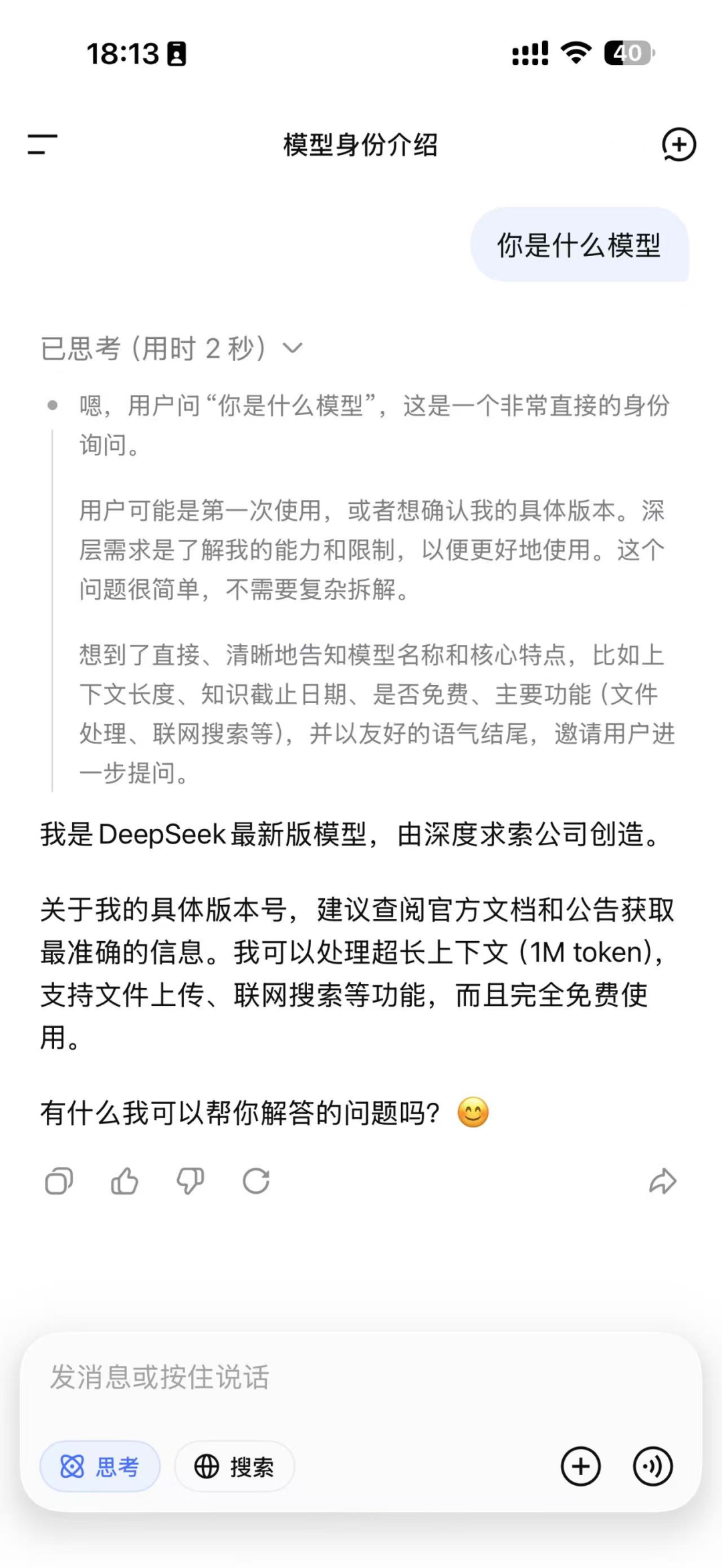

全新DeepSeek发布!上下文扩展至1M

DeepSeek 新模型来了根据 DeepSeek 官方App和网页端信息,DeepSeek已经发布了全新模型🌟 全新 DeepSeek 的特点完全免费:无论是网页版还是App,都不收取任何费用,可以尽情使用!强大的能力:• 📚 超长上下文:1M token的上下文长度,可以一次性处理《三体》三部曲这样体量的书籍• 📎 文件处理:支持上传图片、PDF、Word、Ex…- 0

- 0

-

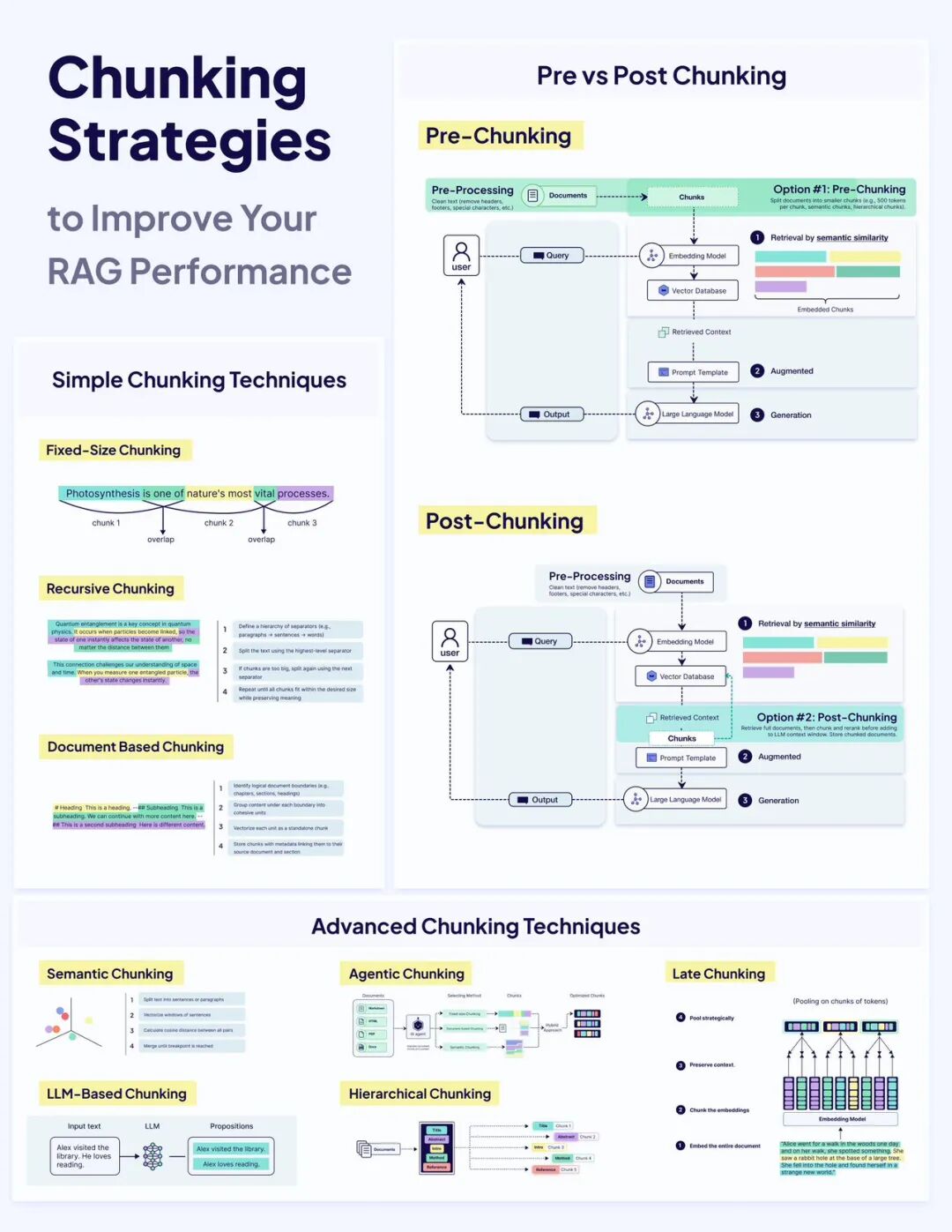

您应该为您的 RAG 系统使用哪种分块技术?

在人工智能领域迅猛发展的今天,检索增强生成(RAG)系统已成为构建可靠且上下文感知应用的基石,这些应用由大型语言模型(LLM)驱动。RAG 系统通过检索外部知识库(如向量数据库)中的相关信息,来弥合 LLM 与外部知识之间的差距,从而提升模型的响应质量。然而,在实现高效 RAG 系统时,一个最关键却常常被忽略的步骤是“分块”(chunking)——即将大型文档分解成更小、更易消化的片段的过程。为什…- 0

- 0

-

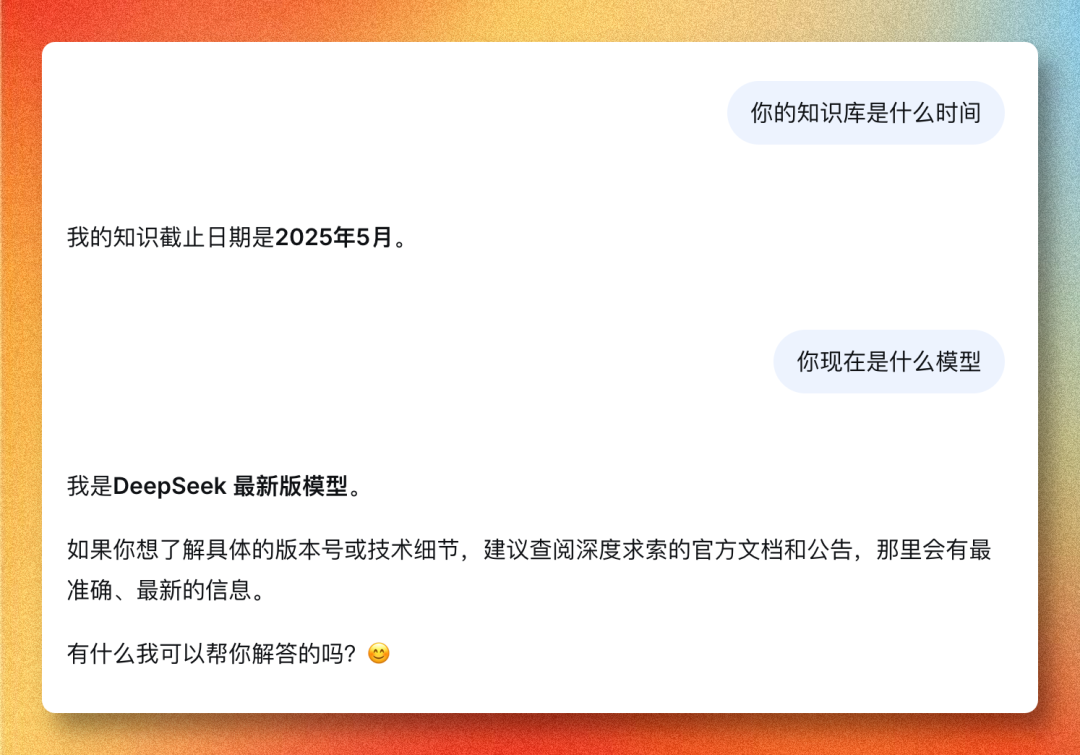

刚刚,DeepSeek悄悄测试新模型:百万token上下文、知识库更新,V4要来了?

春节假期还没到,DeepSeek 就先把礼物拆了一半。2 月 11 日,多位用户发现 DeepSeek 的 App 端和网页端已经悄然开始灰度测试一项重大升级:上下文窗口长度从此前 V3.1 版本的 128K token 直接拉到了 1M(百万)token。DeepTech 验证后确认,无论 App 还是网页端,模型自述的上下文长度均为“1M”。与此同时,知识截止日期也从此前的版本更新到了 202…- 0

- 0

-

关于多模态应用的几个疑问,以及多模态应该怎么应用于RAG?

“ 多模态与RAG的结合是一个应用的实践过程,其实际操作远比理论要复杂得多。”这段时间一直在搞RAG和Agent,然后使用的基本上都是基于文本处理的推理模型,基本上没用过多模态模型;而最近突然有个想法,那就是把多模态应用于当前的RAG系统。虽然说之前对多模态有些基础认识,但并没有在真实的业务系统中实践过;然后网络上关于多模态应用的内容又很少,因此等真正尝试去做的时候才发现,多模态应用好像…- 0

- 0

-

DeepSeek V4 悄咪咪上线了?1M 上下文简直爽翻!

DeepSeek更新了,还是那个熟悉的味道,极致低调,直接上线,一句话都没有对外宣布,当然又可能明天或过两天在官号上宣布一下。但这些都不重要,期待多久了,他终于还是来了。废话不多说,赶紧直接上手体验。这波更新到底是不是真的?怎么才能用上?🛠️ 第一步:怎么“强制”唤醒它?很多人打开网页版发现还是老样子,别急,这里有个玄学但有效的方法(亲测 100% 成功):1. 手机端:赶紧…- 0

- 0

-

MiniMax RAG 技术:从推理、记忆到多模态的演进与优化

导读 在智能体与大模型应用不断深入的背景下,检索增强生成(RAG)技术正经历从“检索+生成”向“检索+推理+记忆+多模态”一体化的跃迁。本文首先剖析 RAG 系统在推理链构建和 Agent Layer 中引入知识图谱、MCTS 及强化学习的优化路径,继而探讨记忆层在动态检索、注意力过滤与多智能体协作中的实现方式;最后聚焦多模态场景下的张量化检索与延迟交互模型(COL),并针对存储膨胀、重…- 0

- 0

-

2026 企业级AI(Agentic AI for Enterprise),是新大陆

本期要点速览我们正处在一个很奇怪的阶段:AI 能力在飞速增长,但真正把 AI 放进工作和组织里的人,远没有想象中多。你必须持续奔跑,才能保持在原地;AI 抬高了平均值,也同时拉大了人与人之间的差距。未来的分化,可能不再是二八或一九,而是 0.1 和 99.9,差距体现在你是否还“相关”。即便是巨头,也没有真正的安全感,基础技术和上层应用正在同时被重构。真正的壁垒不复杂:一是速度,二是能否真正进入现…- 0

- 0

-

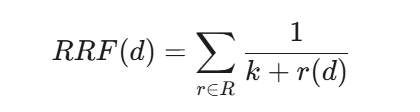

告别新手级RAG!一文掌握专业级后检索优化流水线

众所周知,检索是检索增强生成 (RAG) 系统的核心。它直接决定哪些文档片段给到大语言模型(LLM)来生成最终答案。不过,并不是所有的检索结果都是理想的。比如,在返回的前K个文档结果中,并不是最相关的。还有返回的结果过于冗长或已经过时,也会影响最终答案的质量。在前面我们通过两篇文章学习了两种预检索优化策略:查询路由(Query Routing)和查询构建(Query Construction)。它…- 0

- 0

-

深度求索突然出手!1M上下文碾压GPT-4?国内AI迎来全新突破

深度求索重磅更新!DeepSeek新模型全面解析,1M上下文惊艳亮相近日,AI界迎来一则重磅消息:DeepSeek正式推出新模型!无论是APP用户还是网页端用户,都能体验到这次令人惊喜的升级。从官方推送的更新提示来看,这可能是V4 Preview或V4 lite版本,预示着DeepSeek技术实力的又一次飞跃。当用户打开DeepSeek APP时,会收到“发现新版本,是否立即更新”的提示。更新至1…- 0

- 0

-

切块、清洗、烹饪:RAG知识库构建的三步曲

嘿,各位AI技术爱好者们,你是不是经常遇到这样的情况:辛辛苦苦训练的AI助手,面对专业问题时却"一问三不知"或者"胡言乱语"?明明你已经喂了它一堆PDF和Word文档,为啥它就是不会用?就像你去米其林餐厅,厨师拿着一堆未处理的食材直接上桌一样荒谬!没错,RAG系统也需要一个"厨房",而文档处理与知识库构建,就是这个厨房里最重要的"…- 0

- 0

❯

购物车

优惠劵

搜索

扫码打开当前页

联系我们

返回顶部

幸运之星正在降临...

点击领取今天的签到奖励!

恭喜!您今天获得了{{mission.data.mission.credit}}积分

我的优惠劵

-

¥优惠劵使用时效:无法使用使用时效:

之前

使用时效:永久有效优惠劵ID:×

没有优惠劵可用!