小时候我们玩过“你问我答”的游戏。

你问:“长颈鹿吃什么?”

我答:“树叶!”

这个看似简单的对话,其实隐藏着两个关键能力:理解问题 + 找到答案。

而在 AI 的世界里,要做到这一点,就得靠一套“幕后指挥系统”来安排各种流程、调用各种工具。这时候,LangChain登场了!

如果说大语言模型(LLM)像一个知识渊博但健忘的老师,LangChain 就是那个贴心的助教,帮你安排好一切,从记笔记、查资料、到回答问题,一条龙服务。

今天就带大家深入浅出地聊聊:用 LangChain 怎么构建一个真正“聪明”的问答助手?

技术背景解析:大模型+LangChain = 智能对话系统的灵魂CP

什么是 LangChain?

LangChain 是一个开源 Python 框架,专门用来把大语言模型变成“能记、能查、能做”的应用。

大模型能生成内容,但它“不知道去哪查资料”;LangChain 给它“装上了工具”,包括:

-

Prompt 模板:写提示词更结构化;

-

Memory 记忆:支持多轮对话上下文;

-

Tool 工具调用:如搜索、计算器、数据库;

-

Agent 智能体:让模型自动决定下一步行动;

-

Retriever 检索器:用向量搜索找到相关知识。

可以说,它就像是一个 AI 开发者的“全家桶”。

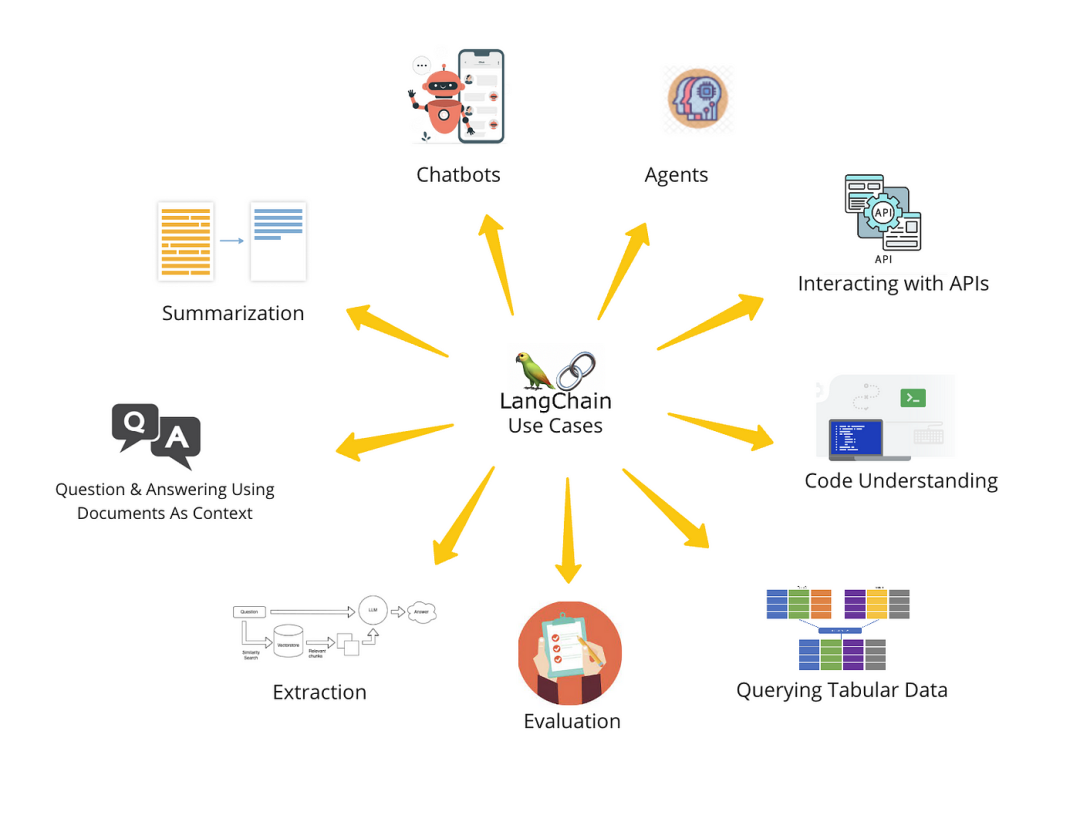

应用场景举例:LangChain 问答助手的用武之地

-

智能客服机器人

自动从 FAQ、文档、产品说明中找答案,支持中文、英文自由切换。 -

教育学习助手

帮学生查找课本知识点,生成题目、讲解错题、甚至写作文。 -

企业知识中台

整合内部资料(如PDF、数据库、文档),构建专属AI员工,回答业务问题。 -

医疗/法律辅助问答

结合专业知识库,构建“专业+可信”的问答助手(需监管合规)。 -

个人效率工具

比如:“我上传了一份合同PDF,帮我总结主要条款。”

技术实现方案:构建一个基础问答助手(以中文知识库为例)

1. 准备工作

-

安装依赖库:

pip install langchain openai faiss-cpu unstructured tiktoken

-

获取 OpenAI API Key 或用本地模型(如 DeepSeek、ChatGLM、Qwen)

2. 向量知识库构建(以PDF为例)

from langchain.vectorstores import FAISSfrom langchain.embeddings.openai import OpenAIEmbeddingsfrom langchain.document_loaders import UnstructuredPDFLoaderfrom langchain.text_splitter import RecursiveCharacterTextSplitter# 载入文档loader = UnstructuredPDFLoader("example.pdf")docs = loader.load()# 拆分文本splitter = RecursiveCharacterTextSplitter(chunk_size=500, chunk_overlap=50)splits = splitter.split_documents(docs)# 向量化embeddings = OpenAIEmbeddings()vectorstore = FAISS.from_documents(splits, embeddings)

3. 构建问答链(QA Chain)

from langchain.chains import RetrievalQAfrom langchain.chat_models import ChatOpenAIllm = ChatOpenAI(model_name="gpt-3.5-turbo", temperature=0)qa_chain = RetrievalQA.from_chain_type( llm=llm, retriever=vectorstore.as_retriever(), return_source_documents=True)

4. 接口调用(模拟对话)

query = "这份PDF文件的主要内容是什么?"result = qa_chain.run(query)print(result)

延伸功能建议(打造“能记、能查、能进阶”的助手)

-

加入 ChatMemory,实现连续对话;

-

加入 Tool,如计算器、天气API;

-

多模态支持:上传图像,结合图文分析;

-

多语言切换,适配国际用户;

-

前端部署:Gradio、Streamlit、Next.js + FastAPI,发布成网页。

未来趋势分析:LangChain 将成为 AI 应用的“中间件标准”

随着企业对“可控、可扩展、可集成”的 AI 应用需求增加,LangChain 有望成为:

-

AI 工程化的主流框架;

-

各种 RAG(检索增强生成)系统的核心支撑;

-

GPT/GLM/Qwen 模型之间的通用适配层;

-

AI Agent 系统(自主行动AI)的基础建设。

说白了,未来不会是“一个超级AI回答所有问题”,而是“你的数据 + 你的工具 + 你的 AI 助理”。

LangChain,正是那个把一切串起来的“粘合剂”。

不是模型变强,而是你能用好它

大模型每天都在进化,但真正有价值的,是你如何用它做出属于自己的应用。

LangChain 的出现,让我们不再只能“对话”,而是能“构建一个有大脑、有记忆、有行动力”的AI助手。

你不再只是提问者,也可以是 AI 的设计者。