忘掉配置的烦恼吧,Ollama launch 是启动 Claude Code、Codex、OpenCode、Moltbot 或任意其他 CLI 工具的全新简易方式。

Ollama v0.15 引入了名为

ollama launch的新命令,可使用本地或云端模型,自动完成 Claude Code、OpenCode、Codex 等常用编码工具的配置与启动。

如果你不是 Medium 高级会员,可在此处免费阅读完整教程:read the full tutorial FREE here,也欢迎考虑加入 Medium 支持我的创作。

如果你一直关注 Ollama 的近期更新,你会知道他们在 v0.14 加入了对 Anthropic API 的兼容。

这为像 Claude Code 这样的工具接入开源模型打开了大门。

我之前在这里分享过如何配置的详细指南——I Tried New Claude Code Ollama Workflow ( It's Wild & Free)

但那时仍需要手动配置,比如导出环境变量、设置 base URL、以及摸索哪些模型更适合写代码。

ollama launch 这个新命令改变了这一切,让启动过程更顺滑。

我想亲自测试并把发现分享给你们,因为我知道很多人都在寻找能在本地运行具备 Agent 能力的编码工具、同时又不烧 API 点数的方法。

于是我花了一个下午,完成多种集成的设置,测试了多款模型,并记录了哪些方案可行。

在这篇文章里,我会告诉你我对 Ollama Launch 的发现,以及如何把它与 Ollama Cloud 模型一起快速用起来。

什么是 Ollama Launch?

想象一下,只用这个命令、无需任何配置就能启动你最喜欢的工具

ollama launch 是一个新命令,负责把各类编码工具与 Ollama 模型连接所需的一切设置。

它会引导你选择模型,并自动启动你选定的集成。

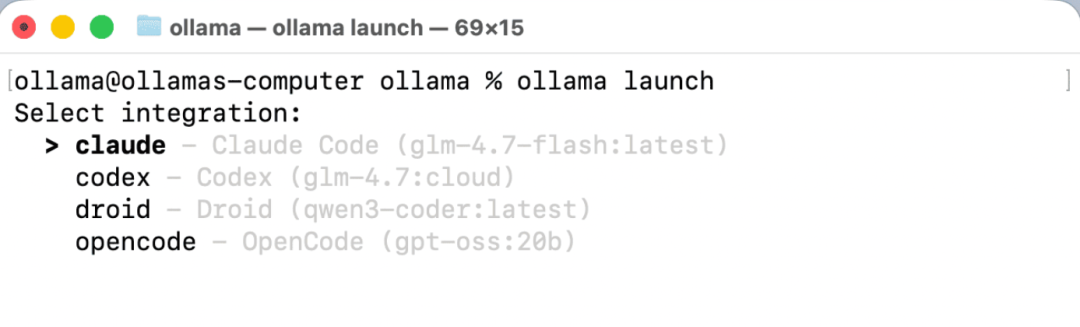

目前支持四种集成:

-

Claude Code —— Anthropic 的终端内 agentic 编码工具 -

OpenCode —— 面向终端编码的开源替代品 -

Codex —— OpenAI 的编码助手集成 -

Droid —— 另一种编码工具选项

运行 ollama launch 时,你会看到一个交互式菜单来选择想用的集成。

也可以直接用如 ollama launch claude 或 ollama launch opencode 这样的命令指定某个工具。

它会在后台替你完成 Anthropic API 的配置。以前你需要手动设置:

export ANTHROPIC_AUTH_TOKEN=ollama

export ANTHROPIC_BASE_URL=http://localhost:11434

现在只需一个命令,你就能开始写代码了。

配置 Ollama Launch

整个流程大概五分钟。你需要做这些:

步骤 1:更新 Ollama

确保你已安装 Ollama v0.15 或更高版本。若版本较旧,请到 ollama.com 下载最新版。

确认已安装 Ollama v0.15+

-

检查版本: ollama --version

我当前版本偏旧,需要更新一下。

如需更新,请访问:https://ollama.com/download

下载完成后,点击安装包开始升级,按向导完成步骤:

安装完成后,确认版本应为 0.15.2 或更高:

你需要一款对代码友好的模型。Ollama 推荐如下:

本地模型(需约 23GB VRAM,支持 64K context):

glm-4.7-flashqwen3-codergpt-oss:20b

云端模型(完整 context length,无硬件要求):

glm-4.7:cloudminimax-m2.1:cloudqwen3-coder:480b-cloud

拉取你选定的模型:

ollama pull glm-4.7-flash

或使用云端模型:

ollama pull glm-4.7:cloud

预期输出:模型将被下载/注册(云端模型很轻量,因为推理在远端进行)

步骤 3:配置 Context Length

这一步很重要,也最容易被忽略。

Ollama 默认的 context length 是 4,096 tokens。

编码工具要正常工作需要更长的上下文。建议至少为 64,000 tokens,特别是 Claude Code 等工具。

打开 Ollama 设置,更新 context length。

如果不改这个设置,模型的“记忆”不够,无法处理多文件操作、tool calls 或较长的编码会话。

使用云端模型会自动启用完整的 context length,如果你用的是云端模型,这一步可以跳过。

步骤 4:启动

ollama launch claude

很快你就会看到 Claude Code 使用你选择的模型启动起来。

注意,我在上一步拉取的是 GLM-4.7 的云端版本。

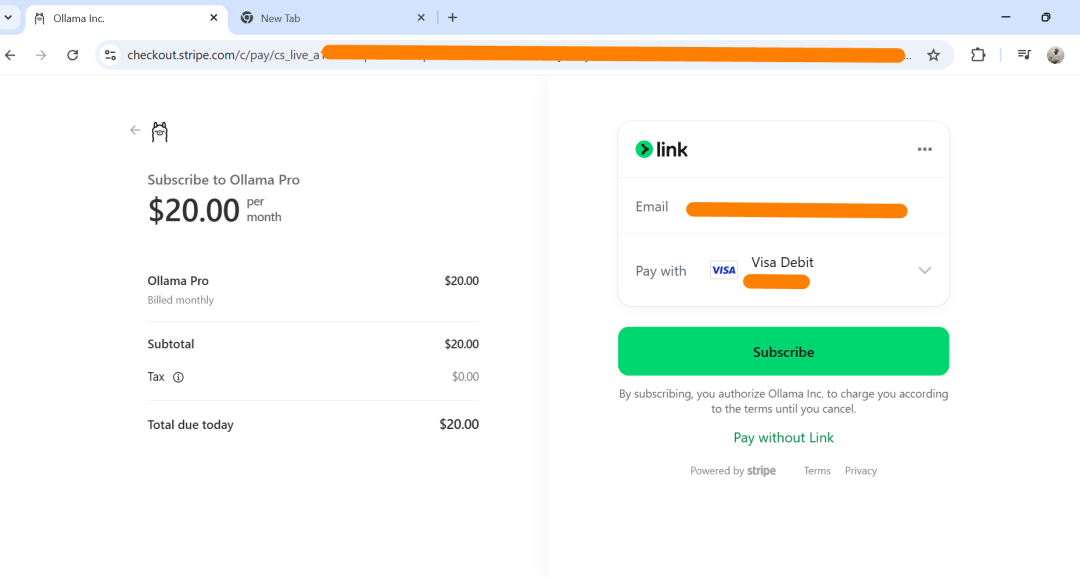

要完成这一步,你需要一个 Ollama Cloud 账号。我自己是按每月 20 美元订阅的,之前在这篇教程里注册的——I Tried Claude Code Ollama Workflow

如果你想拉取其他模型,可使用以下命令:

# GLM 4.7 Cloud - 推荐用于编码

ollama pull glm-4.7:cloud

# MiniMax M2.1 Cloud - 备选

ollama pull minimax-m2.1:cloud

# Qwen3 Coder 480B Cloud - 体量最大的编码模型

ollama pull qwen3-coder:480b-cloud

# GPT-OSS 120B Cloud - 另一款大型模型

ollama pull gpt-oss:120b-cloud

我之前也拉取过 gpt-oss:120b-cloud、DeepSeek-coder:1.3b 和 qwen2.5-coder:7b,所以你会在我的可用模型列表里看到它们:

Ollama Launch 测试

我用 Claude Code 和 OpenCode 测试了 ollama launch。

首先确保已安装 Claude Code:

-

macOS/Linux/WSL: curl -fsSL https://claude.ai/install.sh | bash -

Windows PowerShell: irm https://claude.ai/install.ps1 | iex

使用云端模型时,你可能需要一个 Ollama 账号:

-

若被提示,请到 ollama.com 注册

当你运行

ollama launch claude时,会出现一个模型选择提示。在我这里,同时有本地和云端选项可用:

deepseek-coder:1.3b (local)glm-4.7:cloudgpt-oss:120b-cloudqwen2.5-coder:7b (local)

我选择了 glm-4.7:cloud 作为主要测试模型,因为云端模型具备完整的 context length 且没有硬件限制。

选好模型后,Claude Code 会非常快地启动,再也不用像我之前的方案那样折腾配置了。

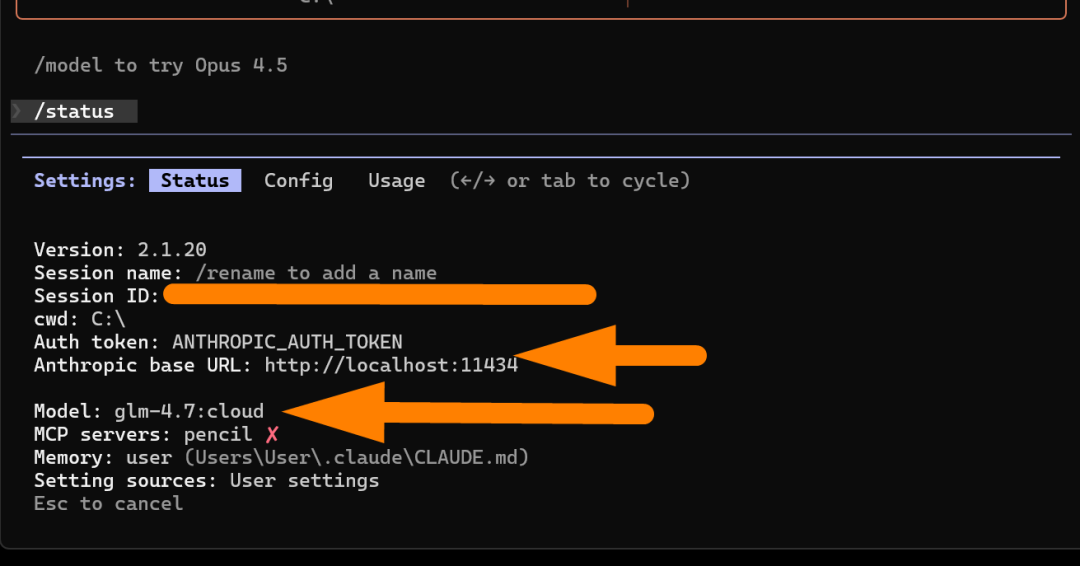

检查状态时,我看到环境如下:

-

Model: glm-4.7:cloud -

Auth token: ANTHROPIC_AUTH_TOKEN -

Anthropic base URL: http://localhost:11434

Claude Code 运行后,我用第一个指令做测试:

创建一个计算斐波那契数列的 Python 函数,并将其保存为 fib.py

如你所见,它很快就生成了代码。现在我用这套简洁的 Ollama Launch 配置,把 Ollama Cloud 模型和 Claude Code 结合起来了。

OpenAI Codex 的 Ollama Launch 测试

测试 OpenAI Codex 前,先确保已安装:

npm install -g @openai/codex

现在用这条命令测试 Ollama launch:

ollama launch codex --model glm-4.7:cloud

它会以 glm-4.7:cloud 模型启动,我也能复现在 Claude Code 上做过的同一测试:

创建一个计算斐波那契数列的 Python 函数,并将其保存为 fib.py

几秒钟内就生成了代码,并已准备好写入文件。

OpenCode 的 Ollama Launch 测试

第一步,确保你已安装 OpenCode:

npm install -g opencode-ai

用 OpenCode 测试启动,命令如下:

ollama launch opencode --model glm-4.7:cloud

它会先提示将修改 OpenCode 的配置,并告知备份文件的保存路径。

接受后即可启动 OpenCode。

同样,OpenCode 和 Claude Code、OpenAI Codex 一样,都会以 glm-4.7:cloud 模型启动,我也能复现同样的测试:

创建一个计算斐波那契数列的 Python 函数,并将其保存为 fib.py

和另外两者一样,它很快就生成了代码,并已准备好写入文件。

我们已经用三款最流行的终端编码工具成功测试了 Ollama Launch。

和之前那篇用 Claude Code 手动配置的帖子相比,你会发现它更快、更易用——参考这里的旧方法。

总结

ollama launch 是 Ollama 工具集中最棒的新增功能之一,再也不用把时间浪费在手动配置上。

它消除了配置编码工具集成的摩擦,使整个流程对更多开发者更友好。只用这一条命令,你就能从零到用本地模型运行起 Claude Code。

文中提到的一切链接都能在 Ollama 文档里找到。动手试试吧,也欢迎告诉我你在本地环境中的体验。

你测试过 ollama launch 吗?欢迎留言分享你的体验——我很想知道在不同硬件条件下,哪些模型和配置最好用。