刚刚,

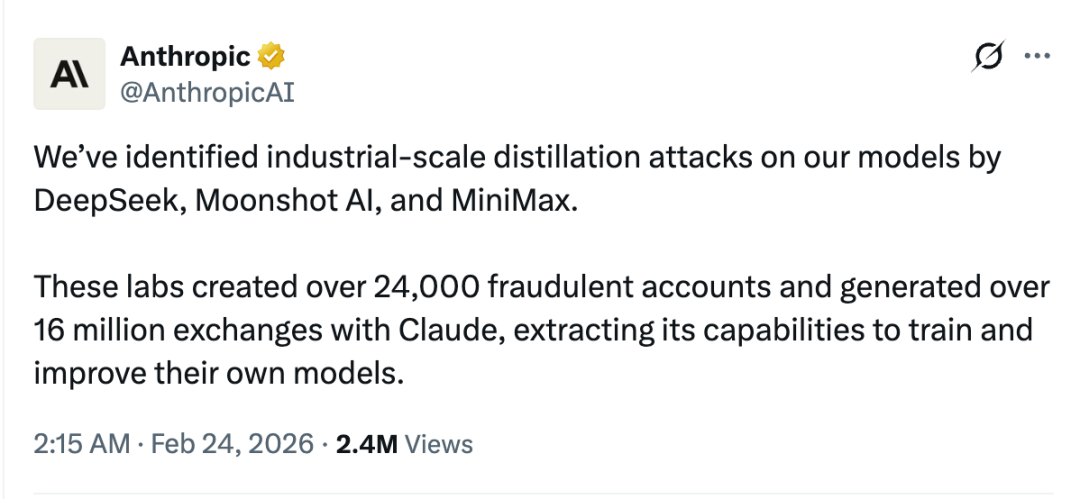

Anthropic 发推称,DeepSeek、Moonshot AI和MiniMax三家国内的 AI 公司对Claude进行大规模的蒸馏攻击。

OK, A 社你真的很讨厌中国公司了。

简单说就是:这三家公司用大量假账号,疯狂地向 Claude 提问,然后拿 Claude 的回答去训练自己的模型。

而根据 Anthropic 的统计,蒸馏攻击超过 1600 万次对话,大约有 2.4 万个虚假账号。

他们甚至为此写了一篇博文:

https://www.anthropic.com/news/detecting-and-preventing-distillation-attacks

OK,其实,我一开始也不知道。

因为我只知道蒸馏和攻击,真的很少见到蒸馏攻击这个说法。

根据 Anthropic 的定义,所说的蒸馏攻击其实就是这几家公司都大规模的在用假账号、代理服务来访问 Claude,试图提取 Claude 的能力,比如推理、工具调用、写代码等等。

根据 Anthropic 的官方发文来看,

DeepSeek 进行了超过 15 万次对话

DeepSeek 的操作比较"精"。他们主要薅的是 Claude 的三个能力:

- 推理能力

:让 Claude 做各种复杂推理任务 - 奖励模型数据

:让 Claude 当"评委",给答案打分,生成强化学习训练数据 - 审查规避

:让 Claude 生成"政治安全"的替代回答

最骚的一个操作是什么呢?

他们让 Claude "回忆"自己的推理过程,一步一步写出来——这等于直接白嫖了高质量的Chain-of-Thought训练数据。

还有一个细节:Anthropic 说他们发现了一些 prompt,是让 Claude 生成审查安全版本的回答。

比如关于领导人、威权主义的敏感话题,DeepSeek 似乎想用这些数据来训练自己的模型,让它学会避开这类话题。

Anthropic 甚至通过请求元数据,追溯到了 DeepSeek 实验室里的具体研究人员。

月之暗面(Moonshot/Kimi):340 万次对话

月之暗面的胃口更大,主攻 Claude 的四个方向:

- Agent推理和工具调用

-

代码和数据分析 -

计算机使用的能力 -

计算机视觉

他们用了几百个假账号,走了多条访问路径,让整个行动看起来不像是一个有组织的操作。

但 Anthropic 还是通过请求元数据把他们给认出来了——元数据直接匹配上了月之暗面高管的公开资料。

后期月之暗面还升级了策略,试图直接提取和还原 Claude 的推理轨迹。

MiniMax:1300 万次对话

MiniMax 是三家里规模最大的,1300 万次对话,主要薅 Agent 编程和工具编排能力。

Anthropic 是在 MiniMax 的蒸馏行动还在进行中的时候抓到他们的——甚至是在 MiniMax 还没发布用这些数据训练的新模型之前。

这意味着 Anthropic 完整地看到了整个蒸馏攻击的生命周期:从数据生成到模型发布。

还有一个细节是,当 Anthropic 在 MiniMax 的蒸馏行动期间发布了新模型后,MiniMax 在 24 小时内就调转了近一半的流量,去薅新模型的能力。

大家知道,Anthropic 出于国家安全考虑,不在中国提供 Claude 的商业访问。

那这些公司怎么用上 Claude 的?

答案是:代理服务商。

这些代理商运营着所谓的九头蛇集群架构——一个庞大的假账号网络,把流量分散到 Anthropic 的API和各种第三方云平台上。

一个代理网络同时管理着超过 2 万个假账号,还把蒸馏流量和正常客户的请求混在一起,增加检测难度。

砍掉一个账号?马上冒出一个新的。

原因有两个:

第一,安全护栏没了。

Anthropic 花了大量精力给 Claude 加上安全限制,防止模型被用来开发生化武器、搞网络攻击之类的。但通过蒸馏出来的模型,这些安全护栏大概率是没有的。

也就是说,危险的能力扩散了,但保护措施被扒光了。

如果这些蒸馏模型再被开源……那后果就更难控制了。

第二,出口管制被架空了。

我觉得这才是最主要的。。

美国搞芯片出口管制,本质上就是想维持 AI 领域的领先优势。但如果中国公司可以通过蒸馏直接抄作业,那出口管制的效果就大打折扣。

更讽刺的是,这些公司通过蒸馏取得的进步,反而被外界解读为"出口管制没用,人家照样能创新"。

但事实是,这些"创新"很大程度上依赖于从美国模型中提取的能力。

Anthropic 列出了几个方向:

- 检测系统

:建了好几个分类器和行为指纹系统,专门识别 API 流量中的蒸馏模式 - 情报共享

:和其他 AI 公司、云服务商、相关政府部门共享技术指标 - 加强准入

:收紧了教育账号、安全研究项目、初创企业等最容易被利用的注册通道 - 反制措施

:在产品、API 和模型层面开发防护手段,降低蒸馏输出的可用性,同时不影响正常用户体验

但 Anthropic 也承认:靠一家公司解决不了这个问题。

这需要整个行业、云服务商和政策制定者的协同行动。

说实话,

蒸馏这个事情在行业里本身一直就是公开的秘密。

美国公司之间本身也在互相蒸馏。。。

只不过我美国公司可以,而你中国公司就不行。。。

Anthropic 要是真有本事也该把中文从训练语料里剔除。。。

毕竟自己这么讲安全,讲管控,肯定是从来不会在未经许可的情况下,抓取中文互联网的训练语料来试图教会 Claude 中文能力的对吧?

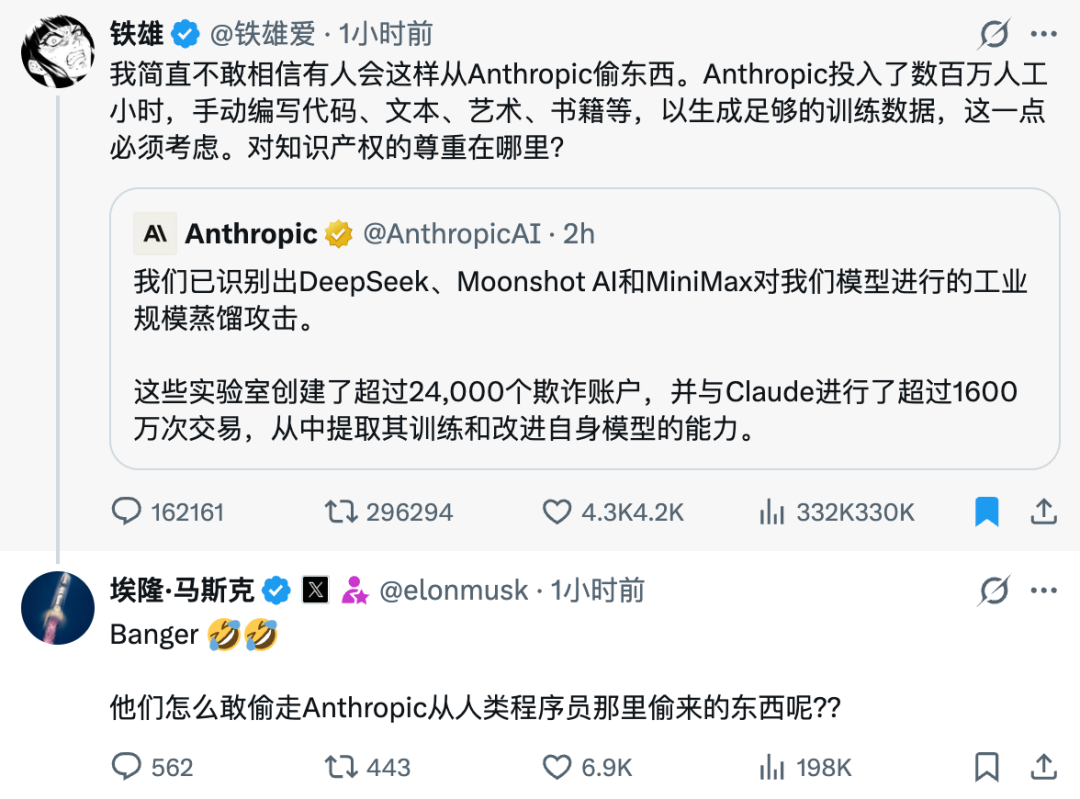

最后,还是老马吐槽的比较直接😂

以上,

感谢您读到这里。