基于此,本文对上一篇内容做个补充,主要介绍Dify如何接入本地模型。

对于先前已经搭建好的知识库,需要简单调整。

Dify接入本地大模型

如何用Dify接入本地大模型?

需要查看本地是否用Ollama成功部署大模型。

1、 如果你已经在本地部署了大模型。

可以直接在主页->设置->模型供应商中全局配置

配置成功后可看到Ollama

2、如果本地还没有安装模型,

详细可参考:《Ollama本地安装部署大模型》

核心步骤如下:

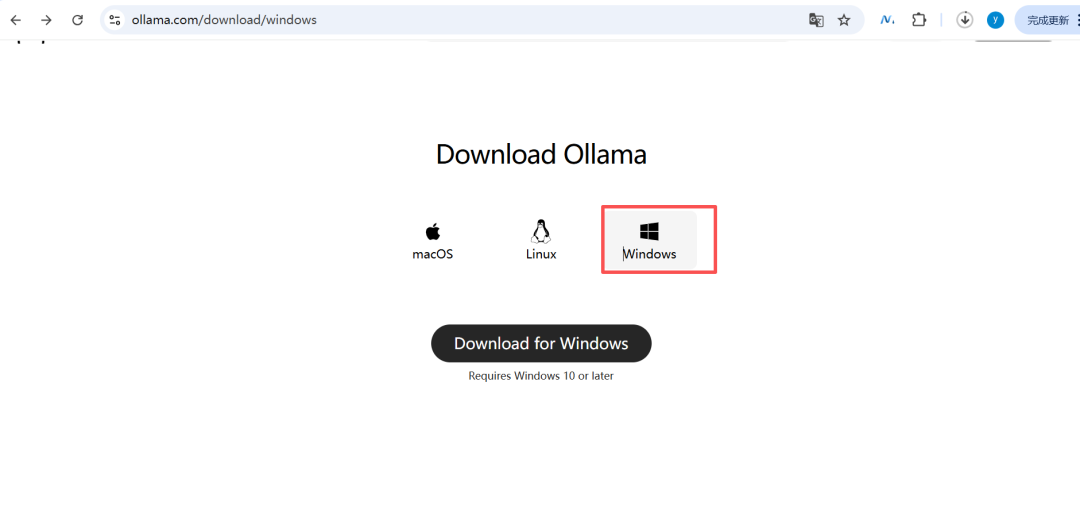

1、下载安装Ollama

官网地址:https://ollama.com/download/windows

点击下载windows 版本,其它版本网上自行检索

2、双击运行

点下一步,无脑安装。

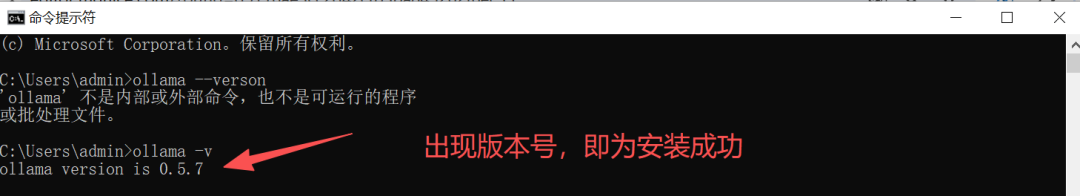

3、检测是否安装成功

windows+R ,输入命令

C:Usersadmin>ollama -v

出现相应的版本号即为安装成功

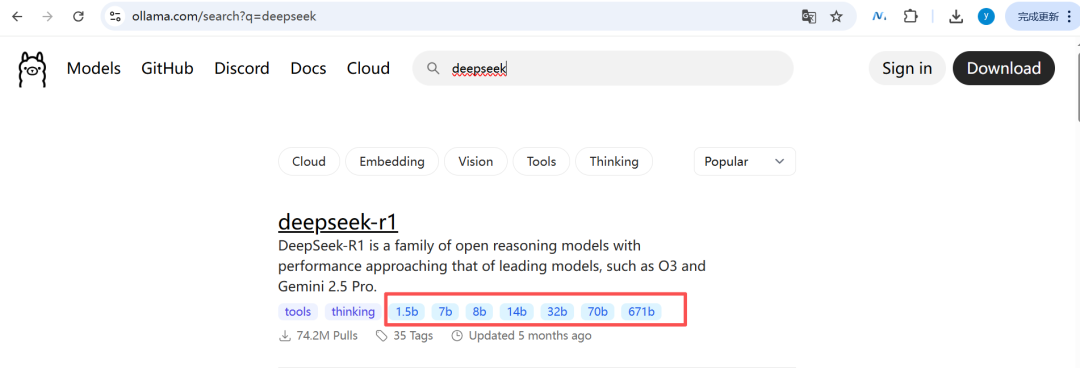

4、本地部署大模型

考虑到本地机器性能,以接入DeepSeek-r1为例,用Ollama部署

选取模型规格及参数

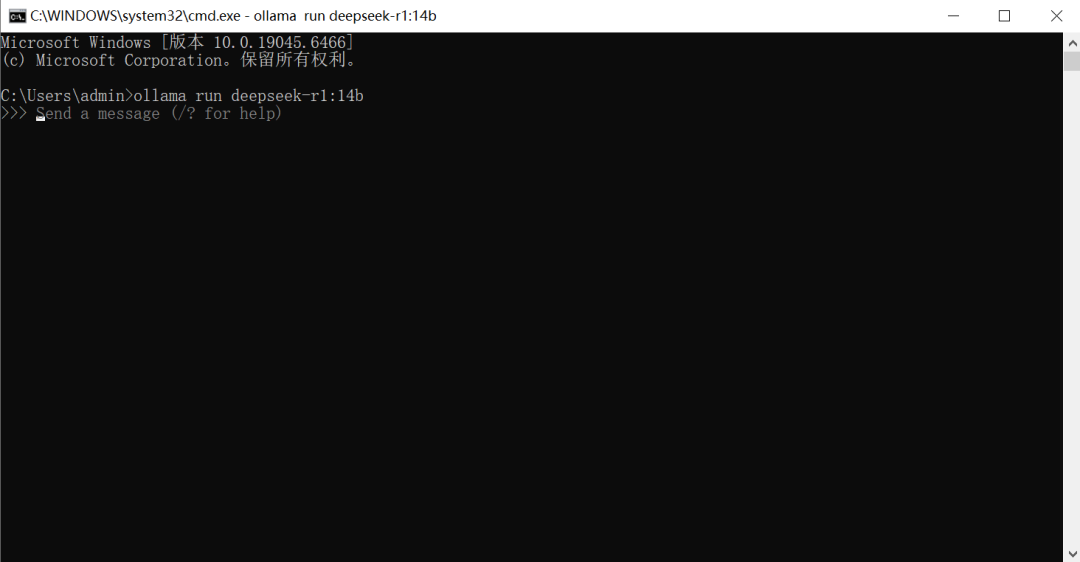

接入deepseek-r1:14b,看到发送消息这个对话提示就是安装成了

好了,现在用Ollama部署了本地大模型。

如果Dify本地安装也未完成,可参考:Dify本地安装Winodws版本

这里不在赘述。

到此,我们具备了以下条件:

-

Ollama本地部署deepseek大模型成功. -

Docker 部署Dify成功

接下来正式操作如何接入本地模型?

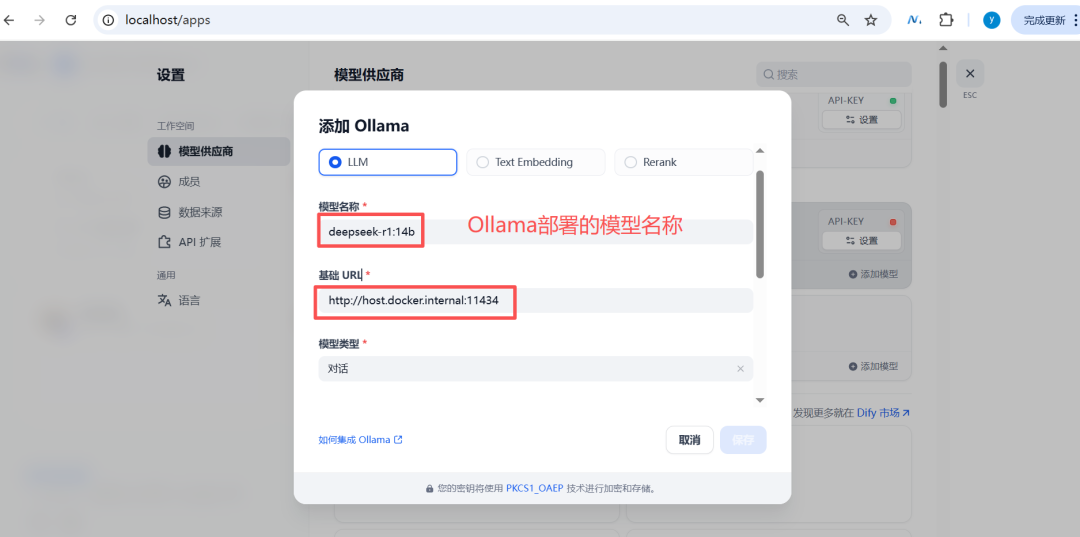

关键点:这里需要填写以下内容

-

基础 URL (Base URL):ollama部署的地址。

-

模型名称:(必须与本地部署的大模型名字完全一致,个人使用的是deepseek-r1:14b,就配置)

-

模型类型:对话 (Chat)上下文

-

长度:4096 (根据显存情况调整)

踩坑!!!:如果你的 Ollama 跑在宿主机上,Dify 跑在 Docker 里,Base URL 千万别填 localhost!

正确姿势:

Mac/Win:http://host.docker.internal:11434

Linux: http://172.17.0.1:11434 (Docker 网关 IP)

设置中可视化配置如下:

好了,到这里基本完成Dify本地接入大模型。

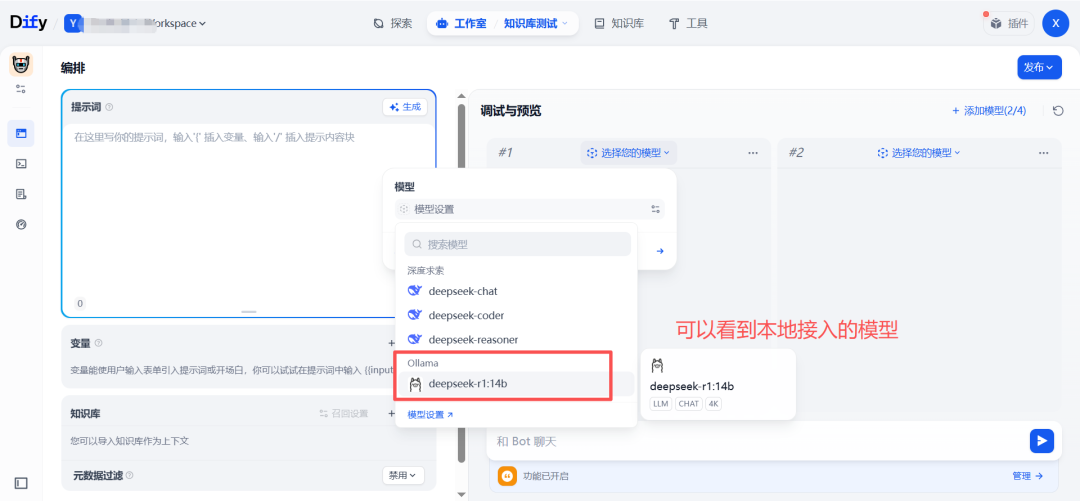

知识库配置本地模型

最后,回到知识库本地化模型配置。

详细配置修改如下:

1、点击进入已经建好的知识库

2、点击模型设置,选择本地模型

可以看到已显示本地部署的模型

3、测试验证

比较简单,遇到问题请留言或者私聊~